-

뇌처럼 생각·반응하는 반도체 나왔다

뉴랜지스터(Neuransistor)는 ‘뉴런(Neuron) + 트랜지스터(Transistor)’의 합성어로 뇌의 뉴런 특성을 구현하는 트랜지스터라는 의미로 만들어진 새로운 용어이다. 이는 뇌 속 신경세포(뉴런)의 흥분과 억제 반응을 모방하여 시간에 따라 달라지는 정보를 스스로 처리하고 학습할 수 있는 차세대 인공지능 하드웨어의 핵심 반도체 소자다. KAIST 연구진이 뉴랜지스터의 개념을 제시하고 최초로 뉴랜지스터를 개발하는데 성공했다.

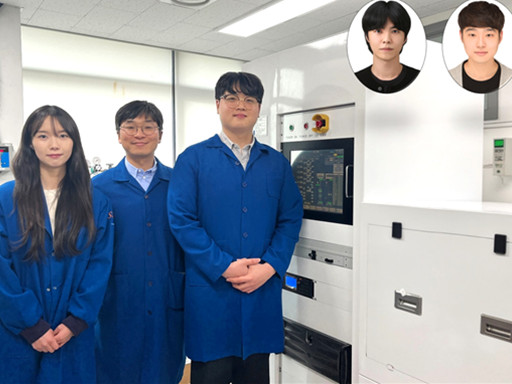

우리 대학 신소재공학과 김경민 교수 연구팀이 시간에 따라 변화하는 정보를 효과적으로 처리할 수 있는 액체 상태 기계(Liquid State Machine, 이하 LSM)*의 하드웨어 구현을 가능케 하는 뉴랜지스터 소자 개발에 성공했다.

* 액체상태 기계(LSM): 생물학적 신경망의 동적 특성을 모사해, 시간에 따라 변화하는 입력 데이터를 처리하는 스파이킹 뉴럴 네트워크 모델

현재의 컴퓨터는 동영상과 같이 시간 흐름에 따라 변하는 데이터인 시계열 데이터를 분석하는데 복잡한 알고리즘을 사용하며, 이는 매우 많은 시간과 전력 소모를 필요로 했다.

김경민 교수 연구팀은 이러한 난제를 해결하며 뇌 속 뉴런처럼 흥분하거나 억제되는 반응을 전기 신호만으로 동시에 구현하여 시계열 데이터의 정보 처리에 특화된 단일 반도체 소자를 새롭게 설계했다.

해당 소자는 산화 티타늄(TiO2)과 산화 알루미늄(Al2O3)이라는 두 산화물층을 쌓아 만든 구조로, 두 층이 맞닿는 계면에서는 전자가 자유롭게 빠르게 이동하는 이차원 전자가스(2DEG)** 층이 형성된다. 그리고, 이 층의 양 끝에는 흥분성 및 억제성 신호에 모두 반응하는 뉴런형 소자가 연결되어 있다.

**2DEG(Two-Dimensional Electron Gas): 계면에서 전도성이 우수한 전자 층이 형성되는 현상으로, 높은 이동도와 빠른 응답속도를 제공함

이러한 독특한 구조 덕분에 뉴랜지스터는 게이트 전압의 극성에 따라 소스와 드레인 간에 흥분성(EPSP) 또는 억제성(IPSP) 반응을 선택적으로 구현할 수 있다.

이 소자는 또한 기존 LSM 구현에서 필수적이었던 복잡한 입력 신호 전처리 과정(마스킹)도 간단히 해결했다. 기존에는 '마스킹' 기능 구현이 매우 복잡했으나, 뉴랜지스터는 소스 전극에 가해지는 전압을 조절함으로써 간단하게 마스킹 기능을 구현하고, 시계열 입력 신호를 다차원의 출력 정보로 정확하게 변환하였다. 또한, 높은 내구성과 소자 간의 균일성도 확보해 실용성도 역시 뛰어났다.

연구팀은 뉴랜지스터를 기반으로 복잡한 시계열 데이터를 처리하는 ‘두뇌형 정보처리 시스템’인 LSM을 구현하였다. 실험 결과, 뉴랜지스터를 활용하는 경우 기존의 방식보다 10배 이상 낮은 오차율과 높은 예측 정확도를 기록했고, 학습 속도도 더 빨라졌다.

김경민 교수는 “이번 연구는 인간 뇌의 신호 처리 방식과 유사한 구조를 실제 반도체 소자로 구현했다는 데 큰 의의가 있다”며 “이 기술은 향후 뇌신경 모사형 AI, 예측 시스템, 혼돈 신호 제어 등 다양한 분야에서 중요한 역할을 할 것으로 기대된다”고 전했다.

이번 연구는 신소재공학과 정운형 박사, 김근영 박사가 공동 제1 저자로 참여했으며, 재료 분야 세계적 권위의 국제 학술지 ‘어드밴스드 머터리얼즈(Advanced Materials, IF: 27.4)’에 2025년 4월 8일 字 게재됐다.

(논문명: A Neuransistor with Excitatory and Inhibitory Neuronal Behaviors for Liquid State Machine, DOI: 10.1002/adma.202419122)

한편, 이번 연구는 나노종합기술원, 한국연구재단의 지원을 받아 수행됐다.

뇌처럼 생각·반응하는 반도체 나왔다

뉴랜지스터(Neuransistor)는 ‘뉴런(Neuron) + 트랜지스터(Transistor)’의 합성어로 뇌의 뉴런 특성을 구현하는 트랜지스터라는 의미로 만들어진 새로운 용어이다. 이는 뇌 속 신경세포(뉴런)의 흥분과 억제 반응을 모방하여 시간에 따라 달라지는 정보를 스스로 처리하고 학습할 수 있는 차세대 인공지능 하드웨어의 핵심 반도체 소자다. KAIST 연구진이 뉴랜지스터의 개념을 제시하고 최초로 뉴랜지스터를 개발하는데 성공했다.

우리 대학 신소재공학과 김경민 교수 연구팀이 시간에 따라 변화하는 정보를 효과적으로 처리할 수 있는 액체 상태 기계(Liquid State Machine, 이하 LSM)*의 하드웨어 구현을 가능케 하는 뉴랜지스터 소자 개발에 성공했다.

* 액체상태 기계(LSM): 생물학적 신경망의 동적 특성을 모사해, 시간에 따라 변화하는 입력 데이터를 처리하는 스파이킹 뉴럴 네트워크 모델

현재의 컴퓨터는 동영상과 같이 시간 흐름에 따라 변하는 데이터인 시계열 데이터를 분석하는데 복잡한 알고리즘을 사용하며, 이는 매우 많은 시간과 전력 소모를 필요로 했다.

김경민 교수 연구팀은 이러한 난제를 해결하며 뇌 속 뉴런처럼 흥분하거나 억제되는 반응을 전기 신호만으로 동시에 구현하여 시계열 데이터의 정보 처리에 특화된 단일 반도체 소자를 새롭게 설계했다.

해당 소자는 산화 티타늄(TiO2)과 산화 알루미늄(Al2O3)이라는 두 산화물층을 쌓아 만든 구조로, 두 층이 맞닿는 계면에서는 전자가 자유롭게 빠르게 이동하는 이차원 전자가스(2DEG)** 층이 형성된다. 그리고, 이 층의 양 끝에는 흥분성 및 억제성 신호에 모두 반응하는 뉴런형 소자가 연결되어 있다.

**2DEG(Two-Dimensional Electron Gas): 계면에서 전도성이 우수한 전자 층이 형성되는 현상으로, 높은 이동도와 빠른 응답속도를 제공함

이러한 독특한 구조 덕분에 뉴랜지스터는 게이트 전압의 극성에 따라 소스와 드레인 간에 흥분성(EPSP) 또는 억제성(IPSP) 반응을 선택적으로 구현할 수 있다.

이 소자는 또한 기존 LSM 구현에서 필수적이었던 복잡한 입력 신호 전처리 과정(마스킹)도 간단히 해결했다. 기존에는 '마스킹' 기능 구현이 매우 복잡했으나, 뉴랜지스터는 소스 전극에 가해지는 전압을 조절함으로써 간단하게 마스킹 기능을 구현하고, 시계열 입력 신호를 다차원의 출력 정보로 정확하게 변환하였다. 또한, 높은 내구성과 소자 간의 균일성도 확보해 실용성도 역시 뛰어났다.

연구팀은 뉴랜지스터를 기반으로 복잡한 시계열 데이터를 처리하는 ‘두뇌형 정보처리 시스템’인 LSM을 구현하였다. 실험 결과, 뉴랜지스터를 활용하는 경우 기존의 방식보다 10배 이상 낮은 오차율과 높은 예측 정확도를 기록했고, 학습 속도도 더 빨라졌다.

김경민 교수는 “이번 연구는 인간 뇌의 신호 처리 방식과 유사한 구조를 실제 반도체 소자로 구현했다는 데 큰 의의가 있다”며 “이 기술은 향후 뇌신경 모사형 AI, 예측 시스템, 혼돈 신호 제어 등 다양한 분야에서 중요한 역할을 할 것으로 기대된다”고 전했다.

이번 연구는 신소재공학과 정운형 박사, 김근영 박사가 공동 제1 저자로 참여했으며, 재료 분야 세계적 권위의 국제 학술지 ‘어드밴스드 머터리얼즈(Advanced Materials, IF: 27.4)’에 2025년 4월 8일 字 게재됐다.

(논문명: A Neuransistor with Excitatory and Inhibitory Neuronal Behaviors for Liquid State Machine, DOI: 10.1002/adma.202419122)

한편, 이번 연구는 나노종합기술원, 한국연구재단의 지원을 받아 수행됐다.

2025.04.16

조회수 3878

-

로봇 등 온디바이스 인공지능 실현 가능

자율주행차, 로봇 등 온디바이스 자율 시스템 환경에서 클라우드의 원격 컴퓨팅 자원 없이 기기 자체에 내장된 인공지능 칩을 활용한 온디바이스 자원만으로 적응형 AI를 실현하는 기술이 개발됐다.

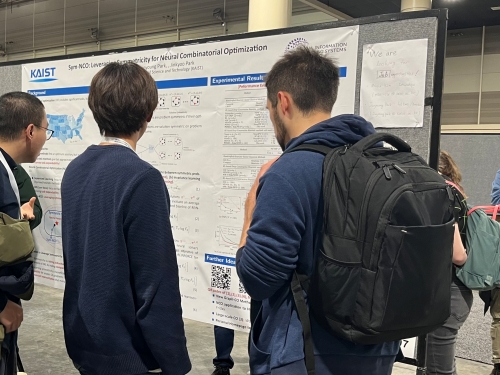

우리 대학 전산학부 박종세 교수 연구팀이 지난 6월 29일부터 7월 3일까지 아르헨티나 부에노스아이레스에서 열린 ‘2024 국제 컴퓨터구조 심포지엄(International Symposium on Computer Architecture, ISCA 2024)’에서 최우수 연구 기록물상(Distinguished Artifact Award)을 수상했다고 1일 밝혔다.

* 논문명: 자율 시스템의 비디오 분석을 위한 연속학습 가속화 기법(DaCapo: Accelerating Continuous Learning in Autonomous Systems for Video Analytics)

국제 컴퓨터 구조 심포지움(ISCA)은 컴퓨터 아키텍처 분야에서 최고 권위를 자랑하는 국제 학회로 올해는 423편의 논문이 제출됐으며 그중 83편 만이 채택됐다. (채택률 19.6%). 최우수 연구 기록물 상은 학회에서 주어지는 특별한 상 중 하나로, 제출 논문 중 연구 기록물의 혁신성, 활용 가능성, 영향력을 고려해 선정된다.

이번 수상 연구는 적응형 AI의 기반 기술인 ‘연속 학습’ 가속을 위한 NPU(신경망처리장치) 구조 및 온디바이스 소프트웨어 시스템을 최초 개발한 점, 향후 온디바이스 AI 시스템 연구의 지속적인 발전을 위해 오픈소스로 공개한 코드, 데이터 등의 완성도 측면에서 높은 평가를 받았다.

연구 결과는 소프트웨어 중심 자동차(SDV; Software-Defined Vehicles), 소프트웨어 중심 로봇(SDR; Software-Defined Robots)으로 대표되는 미래 모빌리티 환경에서 온디바이스 AI 시스템을 구축하는 등 다양한 분야에 활용될 수 있을 것으로 기대된다.

상을 받은 전산학부 박종세 교수는 “이번 연구를 통해 온디바이스 자원만으로 적응형 AI를 실현할 수 있다는 것을 입증하게 되어 매우 기쁘고 이 성과는 학생들의 헌신적인 노력과 구글 및 메타 연구자들과의 긴밀한 협력 덕분이다”라며, “앞으로도 온디바이스 AI를 위한 하드웨어와 소프트웨어 연구를 지속해 나갈 것이다”라고 소감을 전했다.

이번 연구는 우리 대학 전산학부 김윤성, 오창훈, 황진우, 김원웅, 오성룡, 이유빈 학생들과 메타(Meta)의 하딕 샤르마(Hardik Sharma) 박사, 구글 딥마인드(Google Deepmind)의 아미르 야즈단바크시(Amir Yazdanbakhsh) 박사, 전산학부 박종세 교수가 참여했다.

한편 이번 연구는 한국연구재단 우수신진연구자지원사업, 정보통신기획평가원(IITP), 대학ICT연구센터(ITRC), 인공지능대학원지원사업, 인공지능반도체대학원지원사업의 지원을 받아 수행됐다.

로봇 등 온디바이스 인공지능 실현 가능

자율주행차, 로봇 등 온디바이스 자율 시스템 환경에서 클라우드의 원격 컴퓨팅 자원 없이 기기 자체에 내장된 인공지능 칩을 활용한 온디바이스 자원만으로 적응형 AI를 실현하는 기술이 개발됐다.

우리 대학 전산학부 박종세 교수 연구팀이 지난 6월 29일부터 7월 3일까지 아르헨티나 부에노스아이레스에서 열린 ‘2024 국제 컴퓨터구조 심포지엄(International Symposium on Computer Architecture, ISCA 2024)’에서 최우수 연구 기록물상(Distinguished Artifact Award)을 수상했다고 1일 밝혔다.

* 논문명: 자율 시스템의 비디오 분석을 위한 연속학습 가속화 기법(DaCapo: Accelerating Continuous Learning in Autonomous Systems for Video Analytics)

국제 컴퓨터 구조 심포지움(ISCA)은 컴퓨터 아키텍처 분야에서 최고 권위를 자랑하는 국제 학회로 올해는 423편의 논문이 제출됐으며 그중 83편 만이 채택됐다. (채택률 19.6%). 최우수 연구 기록물 상은 학회에서 주어지는 특별한 상 중 하나로, 제출 논문 중 연구 기록물의 혁신성, 활용 가능성, 영향력을 고려해 선정된다.

이번 수상 연구는 적응형 AI의 기반 기술인 ‘연속 학습’ 가속을 위한 NPU(신경망처리장치) 구조 및 온디바이스 소프트웨어 시스템을 최초 개발한 점, 향후 온디바이스 AI 시스템 연구의 지속적인 발전을 위해 오픈소스로 공개한 코드, 데이터 등의 완성도 측면에서 높은 평가를 받았다.

연구 결과는 소프트웨어 중심 자동차(SDV; Software-Defined Vehicles), 소프트웨어 중심 로봇(SDR; Software-Defined Robots)으로 대표되는 미래 모빌리티 환경에서 온디바이스 AI 시스템을 구축하는 등 다양한 분야에 활용될 수 있을 것으로 기대된다.

상을 받은 전산학부 박종세 교수는 “이번 연구를 통해 온디바이스 자원만으로 적응형 AI를 실현할 수 있다는 것을 입증하게 되어 매우 기쁘고 이 성과는 학생들의 헌신적인 노력과 구글 및 메타 연구자들과의 긴밀한 협력 덕분이다”라며, “앞으로도 온디바이스 AI를 위한 하드웨어와 소프트웨어 연구를 지속해 나갈 것이다”라고 소감을 전했다.

이번 연구는 우리 대학 전산학부 김윤성, 오창훈, 황진우, 김원웅, 오성룡, 이유빈 학생들과 메타(Meta)의 하딕 샤르마(Hardik Sharma) 박사, 구글 딥마인드(Google Deepmind)의 아미르 야즈단바크시(Amir Yazdanbakhsh) 박사, 전산학부 박종세 교수가 참여했다.

한편 이번 연구는 한국연구재단 우수신진연구자지원사업, 정보통신기획평가원(IITP), 대학ICT연구센터(ITRC), 인공지능대학원지원사업, 인공지능반도체대학원지원사업의 지원을 받아 수행됐다.

2024.08.01

조회수 6604

-

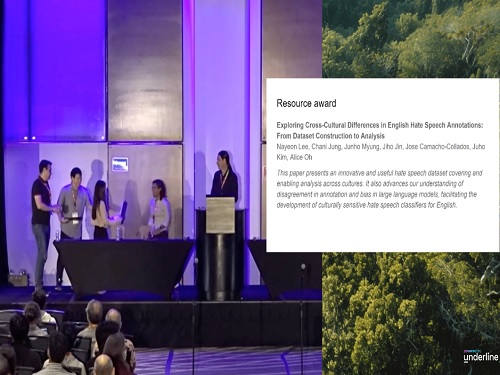

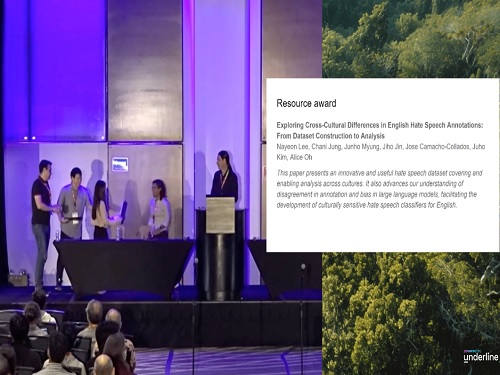

혐오 발언 탐지의 문화적 차이 해결, NAACL 2024에서 Resource Award 수상

전산학부 Users & Information Lab. 연구실의 오혜연 교수와 제1저자 석사과정 이나연(오혜연 교수 지도 학생)의 연구가 지난 6월 16일부터 21일까지 멕시코시티에서 열린 '2024 Annual Conference of the North American Chapter of the Association for Computational Linguistics' (NAACL 2024) 국제 학회에서 '교차 문화적 데이터셋 구축을 통한 영어 혐오 발언 어노테이션의 문화 간 차이와 영향 분석(Exploring Cross-Cultural Differences in English Hate Speech Annotations: From Dataset Construction to Analysis)'에 관한 논문으로 '리소스 어워드(Resource Award)'를 수상했다.

NAACL은 자연어처리 분야에서 최고 권위를 자랑하는 국제 학회로, 올해는 2,434편의 논문이 제출되었으며 그 중 565편만이 채택되었다 (채택률 23.2%).

Resource Award는 학회에서 주어지는 특별한 상 중 하나로, 제출 논문 중 혁신성, 활용 가능성, 영향력, 품질을 고려하여 선정된다.

이번 수상 연구는 교차 문화적 영어 혐오 발언 데이터셋을 구축하고, 문화 간 어노테이션 차이와 대형 언어 모델의 편향성을 분석하여 영어 혐오 발언 분류기의 문화적 민감성을 향상시키는 데 기여했다는점에서 높은 평가를 받았다.

이번 연구에는 KAIST 전산학부의 이나연, 정찬이, 명준호, 진지호 학생들과 Cardiff University의 Jose Camacho-Collados 교수, KAIST 전산학부의 김주호 교수, 오혜연 교수가 참여하였다. 본 연구는 미국, 호주, 영국, 싱가포르, 남아프리카 공화국의 5개 영어권 국가에서 수집된 데이터와 어노테이션을 기반으로 하여, 각국의 문화적 배경이 혐오 발언 어노테이션에 미치는 영향을 분석했다. 이를 통해 문화적 배경이 혐오 발언 인식에 미치는 중요한 차이를 밝혀냈으며, 특히 서구권 국가와 다른 문화적 맥락을 가진 국가 간의 어노테이션 차이가 두드러짐을 보였다.

오혜연 교수와 이나연 학생은 "이번 연구를 통해 혐오 발언 탐지에 있어 문화적 차이의 중요성을 밝힐 수 있어 기쁩니다. 연구팀의 노력 덕분에 이러한 성과를 얻을 수 있었으며, 앞으로도 자연어처리 분야에서 문화적 다양성을 고려한 연구를 지속해 나가겠습니다."라고 소감을 전했다.

이번 수상은 KAIST 연구팀의 혁신적인 접근과 자연어처리 분야에서의 문화 간 연구의 중요성을 국제적으로 인정받은 결과이다. 이는 앞으로 관련 연구 발전에 큰 기여를 할 것으로 기대된다.

연구 결과는 혐오 발언 탐지 분야뿐만 아니라, 다문화 사회에서의 인공지능 윤리와 문화적 편향성 해소 등 다양한 분야에 활용될 수 있을 것으로 기대된다.

자세한 내용은 논문 링크(https://aclanthology.org/2024.naacl-long.236)에서 확인할 수 있다.

혐오 발언 탐지의 문화적 차이 해결, NAACL 2024에서 Resource Award 수상

전산학부 Users & Information Lab. 연구실의 오혜연 교수와 제1저자 석사과정 이나연(오혜연 교수 지도 학생)의 연구가 지난 6월 16일부터 21일까지 멕시코시티에서 열린 '2024 Annual Conference of the North American Chapter of the Association for Computational Linguistics' (NAACL 2024) 국제 학회에서 '교차 문화적 데이터셋 구축을 통한 영어 혐오 발언 어노테이션의 문화 간 차이와 영향 분석(Exploring Cross-Cultural Differences in English Hate Speech Annotations: From Dataset Construction to Analysis)'에 관한 논문으로 '리소스 어워드(Resource Award)'를 수상했다.

NAACL은 자연어처리 분야에서 최고 권위를 자랑하는 국제 학회로, 올해는 2,434편의 논문이 제출되었으며 그 중 565편만이 채택되었다 (채택률 23.2%).

Resource Award는 학회에서 주어지는 특별한 상 중 하나로, 제출 논문 중 혁신성, 활용 가능성, 영향력, 품질을 고려하여 선정된다.

이번 수상 연구는 교차 문화적 영어 혐오 발언 데이터셋을 구축하고, 문화 간 어노테이션 차이와 대형 언어 모델의 편향성을 분석하여 영어 혐오 발언 분류기의 문화적 민감성을 향상시키는 데 기여했다는점에서 높은 평가를 받았다.

이번 연구에는 KAIST 전산학부의 이나연, 정찬이, 명준호, 진지호 학생들과 Cardiff University의 Jose Camacho-Collados 교수, KAIST 전산학부의 김주호 교수, 오혜연 교수가 참여하였다. 본 연구는 미국, 호주, 영국, 싱가포르, 남아프리카 공화국의 5개 영어권 국가에서 수집된 데이터와 어노테이션을 기반으로 하여, 각국의 문화적 배경이 혐오 발언 어노테이션에 미치는 영향을 분석했다. 이를 통해 문화적 배경이 혐오 발언 인식에 미치는 중요한 차이를 밝혀냈으며, 특히 서구권 국가와 다른 문화적 맥락을 가진 국가 간의 어노테이션 차이가 두드러짐을 보였다.

오혜연 교수와 이나연 학생은 "이번 연구를 통해 혐오 발언 탐지에 있어 문화적 차이의 중요성을 밝힐 수 있어 기쁩니다. 연구팀의 노력 덕분에 이러한 성과를 얻을 수 있었으며, 앞으로도 자연어처리 분야에서 문화적 다양성을 고려한 연구를 지속해 나가겠습니다."라고 소감을 전했다.

이번 수상은 KAIST 연구팀의 혁신적인 접근과 자연어처리 분야에서의 문화 간 연구의 중요성을 국제적으로 인정받은 결과이다. 이는 앞으로 관련 연구 발전에 큰 기여를 할 것으로 기대된다.

연구 결과는 혐오 발언 탐지 분야뿐만 아니라, 다문화 사회에서의 인공지능 윤리와 문화적 편향성 해소 등 다양한 분야에 활용될 수 있을 것으로 기대된다.

자세한 내용은 논문 링크(https://aclanthology.org/2024.naacl-long.236)에서 확인할 수 있다.

2024.07.16

조회수 4560

-

멀티모달 대형언어모델이 GPT-4V를 뛰어넘다

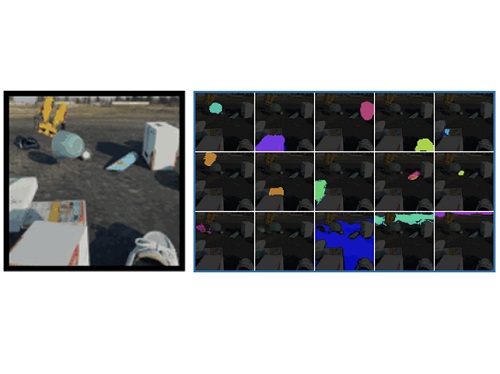

멀티모달 대형 언어모델이란 텍스트뿐만 아니라 이미지 데이터 유형까지 처리할 수 있는 초대형 언어모델을 말한다. 해외 대형 기업의 풍부한 컴퓨팅 자원의 지원으로부터 인간의 뇌에 있는 신경망의 개수와 유사한 수준초대형모델들이 만들어지고 있으나 학계에서는 이런 개발이 쉽지 않았다. KAIST 연구진이 오픈AI의 GPT-4V와 구글의 제미나이-프로(Gemini-Pro)를 뛰어넘는 멀티모달 대형언어모델을 개발하여 화제다.

우리 대학 전기및전자공학부 노용만 교수 연구팀이 오픈AI(OpenAI)의 GPT-4V 등 기업에서 비공개하고 있는 상업 모델인 초대형 언어모델의 시각 성능을 뛰어넘는 공개형 멀티모달 대형 언어모델을 개발해 출시했다고 20일 밝혔다.

노용만 교수 연구팀은 단순히 모델의 크기를 키우거나 고품질의 시각적 지시 조정 데이터셋을 만들지 않고 멀티모달 대형언어모델의 시각 성능을 획기적으로 높인 콜라보(CoLLaVO), 모아이(MoAI) 2가지 기술을 연속적으로 개발했다고 밝혔다.

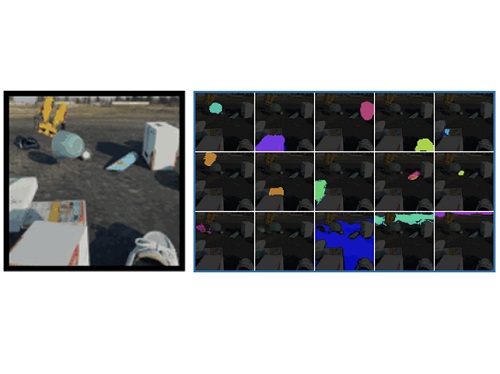

연구팀이 개발한 첫번째 기술인 ‘콜라보(CoLLaVO)’는 현존하는 공개형 멀티모달 대형언어모델이 비공개형 모델의 성능에 비해 현저하게 낮은 이유를 일차적으로 물체 수준에 대한 이미지 이해 능력이 현저하게 떨어진다는 것을 먼저 검증해 보였다.

해당 능력을 효율적으로 증가시켜 시각-언어 태스크에 대한 성능을 향상 하기 위해 연구팀은 이미지 내의 정보를 배경과 물체 단위로 분할하고 각 배경 및 물체에 대한 정보를 멀티모달 대형언어모델에 입력으로 직접 넣어주는 새로운 방법‘크레용 프롬프트(Crayon Prompt)’라는 시각적 프롬프트를 새롭게 제안했다.

또한 시각적 지시 조정 단계에서 크레용 프롬프트로 학습한 정보를 잃어버리지 않기 위해 연구팀은 물체 수준 이미지 이해 능력과 시각-언어 태스크 처리 능력을 서로 다른 파라미터로 학습해 서로 간의 정보를 잃지 않게 만드는 획기적인 학습 전략인 ‘듀얼 큐로라(Dual QLoRA)’를 제안했다. 이를 통해, 콜라보(CoLLaVO) 멀티모달 대형언어모델은 이미지 내에서 배경 및 물체를 구분하는 능력이 뛰어나 일차원적인 시각 구분 능력이 크게 향상됐다고 밝혔다.

두 번째 대형언어모델인 ‘모아이(MoAI)’는 인간이 사물을 판단할 때 물체의 존재, 상태, 물체 간의 상호작용, 배경에 대한 이해, 텍스트에 대한 이해 등으로부터 상황을 판단하는 인지과학적인 요소에 영감을 받아서 만들어졌다고 밝혔다.

이는 기존 멀티모달 대형언어모델이 텍스트에 의미적으로 정렬된 시각 인코더(vision encoder)만을 사용하기 때문에, 이미지 픽셀 수준에서의 상세하고 종합적인 실세계 장면 이해가 부족하다는 점을 지적하며 이런 컴퓨터 비전 모델들의 결과를 받으면 모두 인간이 이해할 수 있는 언어로 변환한 뒤에 멀티모달 대형언어모델에 입력으로 직접 사용했다.

노용만 교수는 “연구팀에서 개발한 공개형 멀티모달 대형언어모델이 허깅페이스 일간 화제의 논문(Huggingface Daily Papers)에 추천됐고, 각종 SNS를 통해 세계 연구자에게 알려지고 있으며, 모든 모델을 공개형 대형언어모델로 출시 했기 때문에 이 연구모델이 멀티모달 대형언어모델 발전에 기여할 것이다”이라고 언급했다.

연구팀이 개발한 멀티모달 대형언어모델인 콜라보(CoLLaVO)와 모아이(MoAI)는 KAIST 전기및전자공학부 이병관 박사과정이 제1 저자로 참여하고 박범찬 석박사통합과정, 김채원 박사과정이 공동 저자로 참여했다.

콜라보(CoLLaVO)는 자연어 처리(NLP) 분야 최고의 국제 학회인 ‘Findings of the Association for Computational Linguistics(ACL Findings) 2024’에 5월 16일 자로 학회에 승인받았고, 모아이(MoAI)는 컴퓨터 비전 최고의 국제 학회인 ‘European Conference on Computer Vision(ECCV) 2024’학회 승인 결과를 기다리고 있다고 밝혔다.

한편 이번 연구는 KAIST 미래국방 인공지능 특화연구센터 및 전기및전자공학부의 지원을 받아 수행됐다.

[1] CoLLaVO 데모 GIF 영상

https://github.com/ByungKwanLee/CoLLaVO

[2] MoAI 데모 GIF 영상

https://github.com/ByungKwanLee/MoAI

멀티모달 대형언어모델이 GPT-4V를 뛰어넘다

멀티모달 대형 언어모델이란 텍스트뿐만 아니라 이미지 데이터 유형까지 처리할 수 있는 초대형 언어모델을 말한다. 해외 대형 기업의 풍부한 컴퓨팅 자원의 지원으로부터 인간의 뇌에 있는 신경망의 개수와 유사한 수준초대형모델들이 만들어지고 있으나 학계에서는 이런 개발이 쉽지 않았다. KAIST 연구진이 오픈AI의 GPT-4V와 구글의 제미나이-프로(Gemini-Pro)를 뛰어넘는 멀티모달 대형언어모델을 개발하여 화제다.

우리 대학 전기및전자공학부 노용만 교수 연구팀이 오픈AI(OpenAI)의 GPT-4V 등 기업에서 비공개하고 있는 상업 모델인 초대형 언어모델의 시각 성능을 뛰어넘는 공개형 멀티모달 대형 언어모델을 개발해 출시했다고 20일 밝혔다.

노용만 교수 연구팀은 단순히 모델의 크기를 키우거나 고품질의 시각적 지시 조정 데이터셋을 만들지 않고 멀티모달 대형언어모델의 시각 성능을 획기적으로 높인 콜라보(CoLLaVO), 모아이(MoAI) 2가지 기술을 연속적으로 개발했다고 밝혔다.

연구팀이 개발한 첫번째 기술인 ‘콜라보(CoLLaVO)’는 현존하는 공개형 멀티모달 대형언어모델이 비공개형 모델의 성능에 비해 현저하게 낮은 이유를 일차적으로 물체 수준에 대한 이미지 이해 능력이 현저하게 떨어진다는 것을 먼저 검증해 보였다.

해당 능력을 효율적으로 증가시켜 시각-언어 태스크에 대한 성능을 향상 하기 위해 연구팀은 이미지 내의 정보를 배경과 물체 단위로 분할하고 각 배경 및 물체에 대한 정보를 멀티모달 대형언어모델에 입력으로 직접 넣어주는 새로운 방법‘크레용 프롬프트(Crayon Prompt)’라는 시각적 프롬프트를 새롭게 제안했다.

또한 시각적 지시 조정 단계에서 크레용 프롬프트로 학습한 정보를 잃어버리지 않기 위해 연구팀은 물체 수준 이미지 이해 능력과 시각-언어 태스크 처리 능력을 서로 다른 파라미터로 학습해 서로 간의 정보를 잃지 않게 만드는 획기적인 학습 전략인 ‘듀얼 큐로라(Dual QLoRA)’를 제안했다. 이를 통해, 콜라보(CoLLaVO) 멀티모달 대형언어모델은 이미지 내에서 배경 및 물체를 구분하는 능력이 뛰어나 일차원적인 시각 구분 능력이 크게 향상됐다고 밝혔다.

두 번째 대형언어모델인 ‘모아이(MoAI)’는 인간이 사물을 판단할 때 물체의 존재, 상태, 물체 간의 상호작용, 배경에 대한 이해, 텍스트에 대한 이해 등으로부터 상황을 판단하는 인지과학적인 요소에 영감을 받아서 만들어졌다고 밝혔다.

이는 기존 멀티모달 대형언어모델이 텍스트에 의미적으로 정렬된 시각 인코더(vision encoder)만을 사용하기 때문에, 이미지 픽셀 수준에서의 상세하고 종합적인 실세계 장면 이해가 부족하다는 점을 지적하며 이런 컴퓨터 비전 모델들의 결과를 받으면 모두 인간이 이해할 수 있는 언어로 변환한 뒤에 멀티모달 대형언어모델에 입력으로 직접 사용했다.

노용만 교수는 “연구팀에서 개발한 공개형 멀티모달 대형언어모델이 허깅페이스 일간 화제의 논문(Huggingface Daily Papers)에 추천됐고, 각종 SNS를 통해 세계 연구자에게 알려지고 있으며, 모든 모델을 공개형 대형언어모델로 출시 했기 때문에 이 연구모델이 멀티모달 대형언어모델 발전에 기여할 것이다”이라고 언급했다.

연구팀이 개발한 멀티모달 대형언어모델인 콜라보(CoLLaVO)와 모아이(MoAI)는 KAIST 전기및전자공학부 이병관 박사과정이 제1 저자로 참여하고 박범찬 석박사통합과정, 김채원 박사과정이 공동 저자로 참여했다.

콜라보(CoLLaVO)는 자연어 처리(NLP) 분야 최고의 국제 학회인 ‘Findings of the Association for Computational Linguistics(ACL Findings) 2024’에 5월 16일 자로 학회에 승인받았고, 모아이(MoAI)는 컴퓨터 비전 최고의 국제 학회인 ‘European Conference on Computer Vision(ECCV) 2024’학회 승인 결과를 기다리고 있다고 밝혔다.

한편 이번 연구는 KAIST 미래국방 인공지능 특화연구센터 및 전기및전자공학부의 지원을 받아 수행됐다.

[1] CoLLaVO 데모 GIF 영상

https://github.com/ByungKwanLee/CoLLaVO

[2] MoAI 데모 GIF 영상

https://github.com/ByungKwanLee/MoAI

2024.06.20

조회수 8432

-

‘당신 우울한가요?’ 스마트폰으로 진단하다

요즘 현대인들에게 많이 찾아오는 우울증을 진단하기 위한 스마트폰으로 진단하는 연구가 개발되어 화제다.

우리 대학 전기및전자공학부 이성주 교수 연구팀이 사용자의 언어 사용 패턴을 개인정보 유출 없이 스마트폰에서 자동으로 분석해 사용자의 정신건강 상태를 모니터링하는 인공지능 기술을 개발했다고 21일 밝혔다. 사용자가 스마트폰을 소지하고 일상적으로 사용하기만 해도 스마트폰이 사용자의 정신건강 상태를 분석 및 진단할 수 있는 것이다.

연구팀은 임상적으로 이뤄지는 정신질환 진단이 환자와의 상담을 통한 언어 사용 분석에서 이루어진다는 점에 착안해 연구를 진행했다. 이번 기술에서는 (1) 사용자가 직접 작성한 문자 메시지 등의 키보드 입력 내용과, (2) 스마트폰 위 마이크에서 실시간으로 수집되는 사용자의 음성 데이터를 기반으로 정신건강 진단을 수행한다.

이러한 언어 데이터는 사용자의 민감한 정보를 담고 있을 수 있어 기존에는 활용이 어려웠다. 이러한 문제의 해결을 위해 이번 기술에는 연합학습 인공지능 기술이 적용됐는데, 이는 사용자 기기 외부로의 데이터 유출 없이 인공지능 모델을 학습해 사생활 침해의 우려가 없다는 것이 특징이다.

인공지능 모델은 일상 대화 내용과 화자의 정신건강을 바탕으로 한 데이터셋을 기반으로 학습되었다. 모델은 스마트폰에서 입력으로 주어지는 대화를 실시간으로 분석하여 학습된 내용을 바탕으로 사용자의 정신건강 척도를 예측한다.

더 나아가, 연구팀은 스마트폰 위 대량으로 주어지는 사용자 언어 데이터로부터 효과적인 정신건강 진단을 수행하는 방법론을 개발했다. 연구팀은 사용자들이 언어를 사용하는 패턴이 실생활 속 다양한 상황에 따라 다르다는 것에 착안해, 스마트폰 위에서 주어지는 현재 상황에 대한 단서를 기반으로, 인공지능 모델이 상대적으로 중요한 언어 데이터에 집중하도록 설계했다. 예를 들어, 업무 시간보다는 저녁 시간에 가족 또는 친구들과 나누는 대화에 정신건강을 모니터링 할 수 있는 단서가 많다고 인공지능 모델이 판단해 중점을 두고 분석하는 식이다.

이번 논문은 전산학부 신재민 박사과정, 전기및전자공학부 윤형준 박사과정, 이승주 석사과정, 이성주 교수와 박성준 SoftlyAI 대표(KAIST 졸업생), 중국 칭화대학교 윤신 리우(Yunxin Liu) 교수, 그리고 미국 에모리(Emory) 대학교 최진호 교수의 공동연구로 이뤄졌다.

이번 논문은 올해 12월 6일부터 10일까지 싱가폴에서 열린 자연어 처리 분야 최고 권위 학회인 EMNLP(Conference on Empirical Methods in Natural Language Processing)에서 발표됐다.

※ 논문명(FedTherapist: Mental Health Monitoring with User-Generated Linguistic Expressions on Smartphones via Federated Learning)

이성주 교수는 "이번 연구는 모바일 센싱, 자연어 처리, 인공지능, 심리학 전문가들의 협력으로 이루어져서 의미가 깊으며, 정신질환으로 어려워하는 사람들이 많은데, 개인정보 유출이나 사생활 침범의 걱정 없이 스마트폰 사용만으로 정신건강 상태를 조기진단 할 수 있게 되었다ˮ라며, "이번 연구가 서비스화되어 사회에 도움이 되면 좋겠다ˮ라고 소감을 밝혔다.

이 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행됐다. (No. 2022-0-00495, 휴대폰 단말에서의 보이스피싱 탐지 예방 기술 개발, No. 2022-0-00064, 감정노동자의 정신건강 위험 예측 및 관리를 위한 휴먼 디지털 트윈 기술 개발)

‘당신 우울한가요?’ 스마트폰으로 진단하다

요즘 현대인들에게 많이 찾아오는 우울증을 진단하기 위한 스마트폰으로 진단하는 연구가 개발되어 화제다.

우리 대학 전기및전자공학부 이성주 교수 연구팀이 사용자의 언어 사용 패턴을 개인정보 유출 없이 스마트폰에서 자동으로 분석해 사용자의 정신건강 상태를 모니터링하는 인공지능 기술을 개발했다고 21일 밝혔다. 사용자가 스마트폰을 소지하고 일상적으로 사용하기만 해도 스마트폰이 사용자의 정신건강 상태를 분석 및 진단할 수 있는 것이다.

연구팀은 임상적으로 이뤄지는 정신질환 진단이 환자와의 상담을 통한 언어 사용 분석에서 이루어진다는 점에 착안해 연구를 진행했다. 이번 기술에서는 (1) 사용자가 직접 작성한 문자 메시지 등의 키보드 입력 내용과, (2) 스마트폰 위 마이크에서 실시간으로 수집되는 사용자의 음성 데이터를 기반으로 정신건강 진단을 수행한다.

이러한 언어 데이터는 사용자의 민감한 정보를 담고 있을 수 있어 기존에는 활용이 어려웠다. 이러한 문제의 해결을 위해 이번 기술에는 연합학습 인공지능 기술이 적용됐는데, 이는 사용자 기기 외부로의 데이터 유출 없이 인공지능 모델을 학습해 사생활 침해의 우려가 없다는 것이 특징이다.

인공지능 모델은 일상 대화 내용과 화자의 정신건강을 바탕으로 한 데이터셋을 기반으로 학습되었다. 모델은 스마트폰에서 입력으로 주어지는 대화를 실시간으로 분석하여 학습된 내용을 바탕으로 사용자의 정신건강 척도를 예측한다.

더 나아가, 연구팀은 스마트폰 위 대량으로 주어지는 사용자 언어 데이터로부터 효과적인 정신건강 진단을 수행하는 방법론을 개발했다. 연구팀은 사용자들이 언어를 사용하는 패턴이 실생활 속 다양한 상황에 따라 다르다는 것에 착안해, 스마트폰 위에서 주어지는 현재 상황에 대한 단서를 기반으로, 인공지능 모델이 상대적으로 중요한 언어 데이터에 집중하도록 설계했다. 예를 들어, 업무 시간보다는 저녁 시간에 가족 또는 친구들과 나누는 대화에 정신건강을 모니터링 할 수 있는 단서가 많다고 인공지능 모델이 판단해 중점을 두고 분석하는 식이다.

이번 논문은 전산학부 신재민 박사과정, 전기및전자공학부 윤형준 박사과정, 이승주 석사과정, 이성주 교수와 박성준 SoftlyAI 대표(KAIST 졸업생), 중국 칭화대학교 윤신 리우(Yunxin Liu) 교수, 그리고 미국 에모리(Emory) 대학교 최진호 교수의 공동연구로 이뤄졌다.

이번 논문은 올해 12월 6일부터 10일까지 싱가폴에서 열린 자연어 처리 분야 최고 권위 학회인 EMNLP(Conference on Empirical Methods in Natural Language Processing)에서 발표됐다.

※ 논문명(FedTherapist: Mental Health Monitoring with User-Generated Linguistic Expressions on Smartphones via Federated Learning)

이성주 교수는 "이번 연구는 모바일 센싱, 자연어 처리, 인공지능, 심리학 전문가들의 협력으로 이루어져서 의미가 깊으며, 정신질환으로 어려워하는 사람들이 많은데, 개인정보 유출이나 사생활 침범의 걱정 없이 스마트폰 사용만으로 정신건강 상태를 조기진단 할 수 있게 되었다ˮ라며, "이번 연구가 서비스화되어 사회에 도움이 되면 좋겠다ˮ라고 소감을 밝혔다.

이 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행됐다. (No. 2022-0-00495, 휴대폰 단말에서의 보이스피싱 탐지 예방 기술 개발, No. 2022-0-00064, 감정노동자의 정신건강 위험 예측 및 관리를 위한 휴먼 디지털 트윈 기술 개발)

2023.12.21

조회수 9695

-

구글딥마인드와 공동연구를 통해 인공지능으로 시각을 상상하다

‘노란 포도'나 `보라색 바나나'와 같이 본 적 없는 시각 개념을 이해하고 상상하는 인공지능 능력 구현이 가능해졌다.

우리 대학 전산학부 안성진 교수 연구팀이 구글 딥마인드 및 미국 럿거스 대학교와의 국제 공동 연구를 통해 시각적 지식을 체계적으로 조합해 새로운 개념을 이해하는 인공지능 새로운 모델과 프로그램을 수행하는 벤치마크를 개발했다고 30일 밝혔다.

인간은 `보라색 포도'와 `노란 바나나' 같은 개념을 학습하고, 이를 분리한 뒤 재조합해 `노란 포도'나 `보라색 바나나'와 같이 본 적 없는 개념을 상상하는 능력이 있다. 이런 능력은 체계적 일반화 혹은 조합적 일반화라고 불리며, 범용 인공지능을 구현하는 데 있어 핵심적인 요소로 여겨진다.

체계적 일반화 문제는 1988년 미국의 저명한 인지과학자 제리 포더(Jerry Fodor)와 제논 필리쉰(Zenon Pylyshyn)이 인공신경망이 이 문제를 해결할 수 없다고 주장한 이후, 35년 동안 인공지능 딥러닝 분야에서 큰 도전 과제로 남아 있다. 이 문제는 언어뿐만 아니라 시각 정보에서도 발생하지만, 지금까지는 주로 언어의 체계적 일반화에만 초점이 맞춰져 있었고, 시각 정보에 관한 연구는 상대적으로 부족했다.

안성진 교수가 이끄는 국제 공동 연구팀은 이러한 공백을 메우고자 시각 정보에 대한 체계적 일반화를 연구할 수 있는 벤치마크를 개발했다. 시각 정보는 언어와는 달리 명확한 `단어'나 `토큰'의 구조가 없어, 이 구조를 학습하고 체계적 일반화를 달성하는 것이 큰 도전이다.

연구를 주도한 안성진 교수는 “시각 정보의 체계적 일반화가 범용 인공지능을 달성하기 위해 필수적인 능력이며 이 연구를 통해 인공지능의 추론능력과 상상능력 관련 분야의 발전을 가속할 것으로 기대한다”고 말했다.

또한, 딥마인드의 책임 연구원으로 연구에 참여한 연구원이자 현재 스위스 로잔연방공과대학교(EPFL)의 찰라 걸셔(Caglar Gulcehre) 교수는 “체계적 일반화가 가능해지면 현재보다 훨씬 적은 데이터로 더 높은 성능을 낼 수 있게 될 것이다”라고 전했다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Imagine the Unseen World: A Benchmark for Systematic Generalization in Visual World Models”, Yeongbin Kim, Gautam Singh, Junyeong Park, Caglar Gulcehre, Sungjin Ahn, NeurIPS 23

구글딥마인드와 공동연구를 통해 인공지능으로 시각을 상상하다

‘노란 포도'나 `보라색 바나나'와 같이 본 적 없는 시각 개념을 이해하고 상상하는 인공지능 능력 구현이 가능해졌다.

우리 대학 전산학부 안성진 교수 연구팀이 구글 딥마인드 및 미국 럿거스 대학교와의 국제 공동 연구를 통해 시각적 지식을 체계적으로 조합해 새로운 개념을 이해하는 인공지능 새로운 모델과 프로그램을 수행하는 벤치마크를 개발했다고 30일 밝혔다.

인간은 `보라색 포도'와 `노란 바나나' 같은 개념을 학습하고, 이를 분리한 뒤 재조합해 `노란 포도'나 `보라색 바나나'와 같이 본 적 없는 개념을 상상하는 능력이 있다. 이런 능력은 체계적 일반화 혹은 조합적 일반화라고 불리며, 범용 인공지능을 구현하는 데 있어 핵심적인 요소로 여겨진다.

체계적 일반화 문제는 1988년 미국의 저명한 인지과학자 제리 포더(Jerry Fodor)와 제논 필리쉰(Zenon Pylyshyn)이 인공신경망이 이 문제를 해결할 수 없다고 주장한 이후, 35년 동안 인공지능 딥러닝 분야에서 큰 도전 과제로 남아 있다. 이 문제는 언어뿐만 아니라 시각 정보에서도 발생하지만, 지금까지는 주로 언어의 체계적 일반화에만 초점이 맞춰져 있었고, 시각 정보에 관한 연구는 상대적으로 부족했다.

안성진 교수가 이끄는 국제 공동 연구팀은 이러한 공백을 메우고자 시각 정보에 대한 체계적 일반화를 연구할 수 있는 벤치마크를 개발했다. 시각 정보는 언어와는 달리 명확한 `단어'나 `토큰'의 구조가 없어, 이 구조를 학습하고 체계적 일반화를 달성하는 것이 큰 도전이다.

연구를 주도한 안성진 교수는 “시각 정보의 체계적 일반화가 범용 인공지능을 달성하기 위해 필수적인 능력이며 이 연구를 통해 인공지능의 추론능력과 상상능력 관련 분야의 발전을 가속할 것으로 기대한다”고 말했다.

또한, 딥마인드의 책임 연구원으로 연구에 참여한 연구원이자 현재 스위스 로잔연방공과대학교(EPFL)의 찰라 걸셔(Caglar Gulcehre) 교수는 “체계적 일반화가 가능해지면 현재보다 훨씬 적은 데이터로 더 높은 성능을 낼 수 있게 될 것이다”라고 전했다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Imagine the Unseen World: A Benchmark for Systematic Generalization in Visual World Models”, Yeongbin Kim, Gautam Singh, Junyeong Park, Caglar Gulcehre, Sungjin Ahn, NeurIPS 23

2023.11.30

조회수 7880

-

예종철 교수 연구팀, 삼성휴먼테크 논문대상 신호처리분야 금상 수상

우리 대학 김재철AI대학원 예종철 교수팀이 `확산모델 (diffusion model)의 사후 샘플링(posterior sampling)을 이용한 일반적인 역문제 해결 기법'으로 제 29회 삼성휴먼테크논문대상에서 신호처리 분야 금상을 수상했다고 밝혔다.

삼성휴먼테크논문대상은 과학기술 저변 확대와 과학 인재 양성을 위해 삼성전자가 1994년 제정한 논문상으로, 매년 2,000편 가량의 논문 중 서면 및 발표 심사를 거쳐 창의성, 논리성, 실용성, 발전성이 뛰어난 논문을 선정하여 수여되는 상이다.

바이오및뇌공학과 박사과정 졍형진, 김정솔 학생이 공동 1저자로 참여한 이 논문은, 확산 모델과 사후 샘플링을 결합하여 일반적인 역문제에 대한 새로운 관점과 해결방법을 제시하였고, 그 실용성과 독창성을 인정받아 대학부 신호처리 분야 수상작 7편 중 1위로 금상을 수상하였다.

역문제는 영상을 획득하는 과정에서 이미징 시스템의 특성과 잡음의 영향으로 망가진 측정값으로부터 실제 신호를 복원하는 문제로 정의된다. 이러한 문제는 영상 화질 개선부터 위상 복원을 통한 세포 구조 시각화와 같은 다양한 과학 분야에서 중요성과 실용성을 가지며, 수십 년간 지속적으로 연구되어 왔다. 과거의 인공지능 및 딥러닝 알고리즘은 이미징 시스템이 선형이며 잡음이 없는 경우를 가정하여 역문제를 효과적으로 해결하였으나, 이러한 가정은 현실 세계에서의 상황과 비교하여 훨씬 단순화된 형태였다.

이 연구에서는 처음으로 확산 모델을 이용해 사후 샘플링을 진행하는 방법으로 역문제를 해결하였는데, 이는 확산 모델이 생성하는 중간 이미지로 측정값을 근사하고, 실제 측정값과의 차이가 줄어들도록 중간 이미지를 보정하는 방식으로 구현된다.

이를 통해 이미징 시스템이 선형 및 비선형인 경우, 그리고 이미징 시스템에서 흔히 발생하는 가우시안 잡음과 푸아송 잡음이 존재하는 경우에 대한 일반적인 역문제 해결이 가능함을 입증하였다. 나아가 개발된 기술은 여러 종류의 역문제에 대한 개별적 학습을 필요로 하지 않는 특성을 가지며, 이는 논문의 실용성을 높이고, 이전의 연구들과 차별성을 지니게 한다.

정형진, 김정솔 바이오및뇌공학과 박사과정 학생은 “큰 규모의 논문대회에서 연구의 내용을 인정받아 기쁘고, 좋은 논문을 작성할 수 있도록 지도해주신 예종철 교수님께 감사하다” 고 소감을 밝혔다. 또한, 알고리즘의 성능과 효율성을 높이는 연구를 이어나가 역문제의 해결이 필요한 다양한 과학 분야들에 기여하고 싶다는 희망을 전했다.

논문명: Diffusion Posterior Sampling for General Noisy Inverse Problems

예종철 교수 연구팀, 삼성휴먼테크 논문대상 신호처리분야 금상 수상

우리 대학 김재철AI대학원 예종철 교수팀이 `확산모델 (diffusion model)의 사후 샘플링(posterior sampling)을 이용한 일반적인 역문제 해결 기법'으로 제 29회 삼성휴먼테크논문대상에서 신호처리 분야 금상을 수상했다고 밝혔다.

삼성휴먼테크논문대상은 과학기술 저변 확대와 과학 인재 양성을 위해 삼성전자가 1994년 제정한 논문상으로, 매년 2,000편 가량의 논문 중 서면 및 발표 심사를 거쳐 창의성, 논리성, 실용성, 발전성이 뛰어난 논문을 선정하여 수여되는 상이다.

바이오및뇌공학과 박사과정 졍형진, 김정솔 학생이 공동 1저자로 참여한 이 논문은, 확산 모델과 사후 샘플링을 결합하여 일반적인 역문제에 대한 새로운 관점과 해결방법을 제시하였고, 그 실용성과 독창성을 인정받아 대학부 신호처리 분야 수상작 7편 중 1위로 금상을 수상하였다.

역문제는 영상을 획득하는 과정에서 이미징 시스템의 특성과 잡음의 영향으로 망가진 측정값으로부터 실제 신호를 복원하는 문제로 정의된다. 이러한 문제는 영상 화질 개선부터 위상 복원을 통한 세포 구조 시각화와 같은 다양한 과학 분야에서 중요성과 실용성을 가지며, 수십 년간 지속적으로 연구되어 왔다. 과거의 인공지능 및 딥러닝 알고리즘은 이미징 시스템이 선형이며 잡음이 없는 경우를 가정하여 역문제를 효과적으로 해결하였으나, 이러한 가정은 현실 세계에서의 상황과 비교하여 훨씬 단순화된 형태였다.

이 연구에서는 처음으로 확산 모델을 이용해 사후 샘플링을 진행하는 방법으로 역문제를 해결하였는데, 이는 확산 모델이 생성하는 중간 이미지로 측정값을 근사하고, 실제 측정값과의 차이가 줄어들도록 중간 이미지를 보정하는 방식으로 구현된다.

이를 통해 이미징 시스템이 선형 및 비선형인 경우, 그리고 이미징 시스템에서 흔히 발생하는 가우시안 잡음과 푸아송 잡음이 존재하는 경우에 대한 일반적인 역문제 해결이 가능함을 입증하였다. 나아가 개발된 기술은 여러 종류의 역문제에 대한 개별적 학습을 필요로 하지 않는 특성을 가지며, 이는 논문의 실용성을 높이고, 이전의 연구들과 차별성을 지니게 한다.

정형진, 김정솔 바이오및뇌공학과 박사과정 학생은 “큰 규모의 논문대회에서 연구의 내용을 인정받아 기쁘고, 좋은 논문을 작성할 수 있도록 지도해주신 예종철 교수님께 감사하다” 고 소감을 밝혔다. 또한, 알고리즘의 성능과 효율성을 높이는 연구를 이어나가 역문제의 해결이 필요한 다양한 과학 분야들에 기여하고 싶다는 희망을 전했다.

논문명: Diffusion Posterior Sampling for General Noisy Inverse Problems

2023.11.07

조회수 5859

-

KAIST, 세계적 권위의 AI 학회에서 연구 역량 입증

우리 대학 연구진이 인공지능 분야에서 세계 최고의 권위를 자랑하는 신경정보처리시스템학회(이하, NeurIPS)에서 왕성한 연구 역량과 위상을 입증했다. NeurIPS는 산업계와 학계에서 최신 인공지능 연구를 발표하는 권위 있는 국제학회다. 우리 대학은 2020년에 20편, 2021년에 45편의 논문을 발표했고, 올해도 작년 수준과 비슷한 37편을 게재해 인공지능 분야에서의 왕성한 연구 능력을 학계에 선보였다. 특히, 예종철 김재철AI대학원 교수의 논문(Energy-Based Contrastive Learning of Visual Representations)이 상위 6%만을 선정하는 구두 발표 논문으로 선정되어 질적으로도 우수한 연구 수준을 인정받았다. 이뿐만이 아니라 지난달 28일부터 미국 루이지애나주 뉴올리언스에서 열린 NeurIPS 2022 학회에서 우리 대학 교수진과 동문이 눈에 띄게 활약했다. 오혜연 전산학부 교수(KAIST 인공지능연구원 부원장)와 조경현 동문(KAIST 전산학부 학사 졸업)은 학술위원장 (Program chair)을, 안성진 전산학부 교수는 워크숍위원장(Workshop chair)을 맡았다. 김주호 전산학부 교수는 기조 강연자로 초청되어 ‘인터렉션 센트릭 AI(Interaction-Centric AI)’를 주제로 발표했다. 오혜연 교수는 “다수의 KAIST 연구진이 국제학회 조직위원 및 기조 강연자로 선정되었다는 것은 인공지능 연구 분야에서 KAIST의 위상이 세계적으로 높아졌음을 시사한다”라고 설명했다.

KAIST, 세계적 권위의 AI 학회에서 연구 역량 입증

우리 대학 연구진이 인공지능 분야에서 세계 최고의 권위를 자랑하는 신경정보처리시스템학회(이하, NeurIPS)에서 왕성한 연구 역량과 위상을 입증했다. NeurIPS는 산업계와 학계에서 최신 인공지능 연구를 발표하는 권위 있는 국제학회다. 우리 대학은 2020년에 20편, 2021년에 45편의 논문을 발표했고, 올해도 작년 수준과 비슷한 37편을 게재해 인공지능 분야에서의 왕성한 연구 능력을 학계에 선보였다. 특히, 예종철 김재철AI대학원 교수의 논문(Energy-Based Contrastive Learning of Visual Representations)이 상위 6%만을 선정하는 구두 발표 논문으로 선정되어 질적으로도 우수한 연구 수준을 인정받았다. 이뿐만이 아니라 지난달 28일부터 미국 루이지애나주 뉴올리언스에서 열린 NeurIPS 2022 학회에서 우리 대학 교수진과 동문이 눈에 띄게 활약했다. 오혜연 전산학부 교수(KAIST 인공지능연구원 부원장)와 조경현 동문(KAIST 전산학부 학사 졸업)은 학술위원장 (Program chair)을, 안성진 전산학부 교수는 워크숍위원장(Workshop chair)을 맡았다. 김주호 전산학부 교수는 기조 강연자로 초청되어 ‘인터렉션 센트릭 AI(Interaction-Centric AI)’를 주제로 발표했다. 오혜연 교수는 “다수의 KAIST 연구진이 국제학회 조직위원 및 기조 강연자로 선정되었다는 것은 인공지능 연구 분야에서 KAIST의 위상이 세계적으로 높아졌음을 시사한다”라고 설명했다.

2022.12.11

조회수 8841

-

세계 최초로 사람처럼 사물의 개념을 스스로 학습하는 장면 인식 기술 개발

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스(Rutgers) 대학교와 공동연구를 통해 사람의 라벨링 없이 스스로 영상 속 객체를 식별할 수 있는 인공지능 기술을 개발했다고 1일 밝혔다. 이 모델은 복잡한 영상에서 각 장면의 객체들에 대한 명시적인 라벨링 없이도 객체를 식별하는 최초의 인공지능 모델이다.

기계가 주변 환경을 지능적으로 인지하고 추론하기 위해서는 시각적 장면을 구성하는 객체들과 그들의 관계를 파악하는 능력이 필수적이다. 하지만 이 분야의 연구는 대부분 영상의 각 픽셀에 대응하는 객체의 라벨을 사람이 일일이 표시해야 하는 지도적 학습 방식을 사용했다. 이 같은 수작업은 오류가 발생하기 쉽고 많은 시간과 비용을 요구한다는 단점이 있다.

이에 반해 이번에 연구팀이 개발한 기술은 인간과 유사하게 환경에 대한 관측만으로 객체의 개념을 스스로 자가 학습하는 방식을 취한다. 이렇게 인간의 지도 없이 스스로 객체의 개념을 학습할 수 있는 인공지능은 차세대 인지 기술의 핵심으로 기대돼왔다.

비지도 학습을 이용한 이전 연구들은 단순한 객체 형태와 배경이 명확히 구분될 수 있는 단순한 장면에서만 객체를 식별하는 단점이 있었다. 이와 달리 이번에 안성진 교수 연구팀이 개발한 기술은 복잡한 형태의 많은 객체가 존재하는 사실적인 장면에도 적용될 수 있는 최초의 모델이다.

이 연구는 그림 인공지능 소프트웨어인 DALL-E와 같이 텍스트 입력을 통해 사실적인 이미지를 생성할 수 있는 이미지 생성 연구에서 영감을 얻었다. 연구팀은 텍스트를 입력하는 대신, 모델이 장면에서 객체를 감지하고 그 객체의 표상(representation)으로부터 이미지를 생성하는 방식으로 모델을 학습시켰다. 또한, 모델에 DALL-E와 유사한 트랜스포머 디코더를 사용하는 것이 사실적이고 복잡한 영상을 처리할 수 있게 한 주요 요인이라고 밝혔다.

연구팀은 복잡하고 정제되지 않은 영상뿐만 아니라, 많은 물고기가 있는 수족관과 교통이 혼잡한 도로의 상황을 담은 유튜브 영상과 같이 복잡한 실제 영상에서도 모델의 성능을 측정했다. 그 결과, 제시된 모델이 기존 모델보다 객체를 훨씬 더 정확하게 분할하고 일반화하는 것을 확인할 수 있었다.

연구팀을 이끈 안성진 교수는 "인간과 유사한 자가 학습 방식으로 상황을 인지하고 해석하는 혁신적인 기술ˮ이라며 "시각적 상황인지 능력을 획기적으로 개선해 지능형 로봇 분야, 자율 주행 분야뿐만 아니라 시각적 인공지능 기술 전반에 비용 절감과 성능향상을 가져올 수 있다ˮ고 말했다.

이번 연구는 미국 뉴올리언스에서 지난 11월 28일부터 개최되어 12월 9일까지 진행 예정인 세계 최고 수준의 기계학습(머신러닝) 학회인 제36회 신경정보처리학회(NeurIPS)에서 발표됐다.

세계 최초로 사람처럼 사물의 개념을 스스로 학습하는 장면 인식 기술 개발

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스(Rutgers) 대학교와 공동연구를 통해 사람의 라벨링 없이 스스로 영상 속 객체를 식별할 수 있는 인공지능 기술을 개발했다고 1일 밝혔다. 이 모델은 복잡한 영상에서 각 장면의 객체들에 대한 명시적인 라벨링 없이도 객체를 식별하는 최초의 인공지능 모델이다.

기계가 주변 환경을 지능적으로 인지하고 추론하기 위해서는 시각적 장면을 구성하는 객체들과 그들의 관계를 파악하는 능력이 필수적이다. 하지만 이 분야의 연구는 대부분 영상의 각 픽셀에 대응하는 객체의 라벨을 사람이 일일이 표시해야 하는 지도적 학습 방식을 사용했다. 이 같은 수작업은 오류가 발생하기 쉽고 많은 시간과 비용을 요구한다는 단점이 있다.

이에 반해 이번에 연구팀이 개발한 기술은 인간과 유사하게 환경에 대한 관측만으로 객체의 개념을 스스로 자가 학습하는 방식을 취한다. 이렇게 인간의 지도 없이 스스로 객체의 개념을 학습할 수 있는 인공지능은 차세대 인지 기술의 핵심으로 기대돼왔다.

비지도 학습을 이용한 이전 연구들은 단순한 객체 형태와 배경이 명확히 구분될 수 있는 단순한 장면에서만 객체를 식별하는 단점이 있었다. 이와 달리 이번에 안성진 교수 연구팀이 개발한 기술은 복잡한 형태의 많은 객체가 존재하는 사실적인 장면에도 적용될 수 있는 최초의 모델이다.

이 연구는 그림 인공지능 소프트웨어인 DALL-E와 같이 텍스트 입력을 통해 사실적인 이미지를 생성할 수 있는 이미지 생성 연구에서 영감을 얻었다. 연구팀은 텍스트를 입력하는 대신, 모델이 장면에서 객체를 감지하고 그 객체의 표상(representation)으로부터 이미지를 생성하는 방식으로 모델을 학습시켰다. 또한, 모델에 DALL-E와 유사한 트랜스포머 디코더를 사용하는 것이 사실적이고 복잡한 영상을 처리할 수 있게 한 주요 요인이라고 밝혔다.

연구팀은 복잡하고 정제되지 않은 영상뿐만 아니라, 많은 물고기가 있는 수족관과 교통이 혼잡한 도로의 상황을 담은 유튜브 영상과 같이 복잡한 실제 영상에서도 모델의 성능을 측정했다. 그 결과, 제시된 모델이 기존 모델보다 객체를 훨씬 더 정확하게 분할하고 일반화하는 것을 확인할 수 있었다.

연구팀을 이끈 안성진 교수는 "인간과 유사한 자가 학습 방식으로 상황을 인지하고 해석하는 혁신적인 기술ˮ이라며 "시각적 상황인지 능력을 획기적으로 개선해 지능형 로봇 분야, 자율 주행 분야뿐만 아니라 시각적 인공지능 기술 전반에 비용 절감과 성능향상을 가져올 수 있다ˮ고 말했다.

이번 연구는 미국 뉴올리언스에서 지난 11월 28일부터 개최되어 12월 9일까지 진행 예정인 세계 최고 수준의 기계학습(머신러닝) 학회인 제36회 신경정보처리학회(NeurIPS)에서 발표됐다.

2022.12.02

조회수 8699

-

이성주, 신진우 교수팀, 스스로 새로운 환경 적응하는 인공지능 기술 개발

우리 대학 전기및전자공학부 이성주 교수와 AI대학원 신진우 교수 연구팀이 공동연구를 통해 스스로 환경변화에 적응하는 테스트타임 적응 인공지능 기술을 개발했다고 밝혔다.

해당 연구는 “NOTE: Robust Continual Test-time Adaptation Against Temporal Correlation”라는 제목으로 인공지능 분야 최고권위 국제학술대회 ‘신경정보처리시스템학회(NeurIPS) 2022'에서12월 발표될 예정이다.

이성주 교수와 신진우 교수 공동 연구팀이 스스로 새로운 환경에 적응하는 “테스트타임 적응 (Test-Time Adaptation)” 인공지능 기술을 개발하였다. 연구팀이 제안한 알고리즘은 기존의 최고 성능 알고리즘보다 평균 11% 향상된 정확도를 보였다.

기계학습 모델들의 한계점은 학습했던 데이터와 다른 분포의 데이터에 적용되면 성능이 급격히 하락한다는 것이다. 이를 푸는 여러 방법 중에서 데이터를 미리 수집할 필요없이 모델이 스스로 테스트 데이터를 분석하여 변하는 환경에 적응하고 성능을 향상시키는 기술인 테스트타임 도메인 적응 (Test-Time Adaptation) 방법이 최근 산학계에서 크게 각광을 받고 있었다.

연구팀은 기존의 테스트타임 도메인 적응 기술들이 모두 데이터가 이상적인 균일분포를 따른다는 가정을 한다는 문제점에 착안했다. 실제 데이터는 환경 변화나 시간 변화에 따라 데이터 분포가 변하거나 비균일분포의 데이터에 대해서는 기존 기술을 동작하지 않는다. 하지만 연구팀이 제시한 “NOTE” 기술은 비균일분포의 데이터에서도 기존 최대 성능 알고리즘 보다 평균 11%만큼 향상된 정확도를 보였다.

이성주 교수 연구팀과 신진우 교수 연구팀의 공동연구로, 공태식 박사과정이 제1저자로 연구를 이끌었고, 정종헌 박사과정, 김태원 학사과정, 김예원 석사과정이 공동 저자로 기여하였다.

이성주 교수와 신진우 교수는 ”테스트타임 도메인 적응은 인공지능이 스스로 환경 변화에 적응하여 성능을 향상시키는 기술로, 활용도가 무궁무진하다. 이번에 발표될 NOTE 기술은 실제 데이터 분포에서 성능향상을 보인 최초의 기술이고 자율주행, 인공지능 의료, 모바일 헬스케어 등 다양한 분야에 적용이 가능할 것으로 기대된다.” 라고 밝혔다.

이 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원 (No. NRF-2020R1A2C1004062)과 방위사업청과 국방과학연구소의 지원(UD190031RD)으로 한국과학기술원 미래 국방 인공지능 특화연구센터에서 수행된 연구이다.

이성주, 신진우 교수팀, 스스로 새로운 환경 적응하는 인공지능 기술 개발

우리 대학 전기및전자공학부 이성주 교수와 AI대학원 신진우 교수 연구팀이 공동연구를 통해 스스로 환경변화에 적응하는 테스트타임 적응 인공지능 기술을 개발했다고 밝혔다.

해당 연구는 “NOTE: Robust Continual Test-time Adaptation Against Temporal Correlation”라는 제목으로 인공지능 분야 최고권위 국제학술대회 ‘신경정보처리시스템학회(NeurIPS) 2022'에서12월 발표될 예정이다.

이성주 교수와 신진우 교수 공동 연구팀이 스스로 새로운 환경에 적응하는 “테스트타임 적응 (Test-Time Adaptation)” 인공지능 기술을 개발하였다. 연구팀이 제안한 알고리즘은 기존의 최고 성능 알고리즘보다 평균 11% 향상된 정확도를 보였다.

기계학습 모델들의 한계점은 학습했던 데이터와 다른 분포의 데이터에 적용되면 성능이 급격히 하락한다는 것이다. 이를 푸는 여러 방법 중에서 데이터를 미리 수집할 필요없이 모델이 스스로 테스트 데이터를 분석하여 변하는 환경에 적응하고 성능을 향상시키는 기술인 테스트타임 도메인 적응 (Test-Time Adaptation) 방법이 최근 산학계에서 크게 각광을 받고 있었다.

연구팀은 기존의 테스트타임 도메인 적응 기술들이 모두 데이터가 이상적인 균일분포를 따른다는 가정을 한다는 문제점에 착안했다. 실제 데이터는 환경 변화나 시간 변화에 따라 데이터 분포가 변하거나 비균일분포의 데이터에 대해서는 기존 기술을 동작하지 않는다. 하지만 연구팀이 제시한 “NOTE” 기술은 비균일분포의 데이터에서도 기존 최대 성능 알고리즘 보다 평균 11%만큼 향상된 정확도를 보였다.

이성주 교수 연구팀과 신진우 교수 연구팀의 공동연구로, 공태식 박사과정이 제1저자로 연구를 이끌었고, 정종헌 박사과정, 김태원 학사과정, 김예원 석사과정이 공동 저자로 기여하였다.

이성주 교수와 신진우 교수는 ”테스트타임 도메인 적응은 인공지능이 스스로 환경 변화에 적응하여 성능을 향상시키는 기술로, 활용도가 무궁무진하다. 이번에 발표될 NOTE 기술은 실제 데이터 분포에서 성능향상을 보인 최초의 기술이고 자율주행, 인공지능 의료, 모바일 헬스케어 등 다양한 분야에 적용이 가능할 것으로 기대된다.” 라고 밝혔다.

이 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원 (No. NRF-2020R1A2C1004062)과 방위사업청과 국방과학연구소의 지원(UD190031RD)으로 한국과학기술원 미래 국방 인공지능 특화연구센터에서 수행된 연구이다.

2022.10.21

조회수 10672

-

세계 최초 그래프 기반 인공지능 추론 가능한 SSD 개발

우리 대학 전기및전자공학부 정명수 교수 연구팀(컴퓨터 아키텍처 및 메모리 시스템 연구실)이 세계 최초로 그래프 기계학습 추론의 그래프처리, 그래프 샘플링 그리고 신경망 가속을 스토리지/SSD 장치 근처에서 수행하는 `전체론적 그래프 기반 신경망 기계학습 기술(이하 홀리스틱 GNN)'을 개발하는데 성공했다고 10일 밝혔다.

연구팀은 자체 제작한 프로그래밍 가능 반도체(FPGA)를 동반한 새로운 형태의 계산형 스토리지/SSD 시스템에 기계학습 전용 신경망 가속 하드웨어와 그래프 전용 처리 컨트롤러/소프트웨어를 시제작했다. 이는 이상적 상황에서 최신 고성능 엔비디아 GPU를 이용한 기계학습 가속 컴퓨팅 대비 7배의 속도 향상과 33배의 에너지 절약을 가져올 수 있다고 밝혔다.

그래프 자료구조가 적용된 새로운 기계학습 모델은 기존 신경망 기반 기계학습 기법들과 달리, 데이터 사이의 연관 관계를 표현할 수 있어 페이스북, 구글, 링크드인, 우버 등, 대규모 소셜 네트워크 서비스(SNS)부터, 내비게이션, 신약개발 등 광범위한 분야와 응용에서 사용된다. 예를 들면 그래프 구조로 저장된 사용자 네트워크를 분석하는 경우 일반적인 기계학습으로는 불가능했던 현실적인 상품 및 아이템 추천, 사람이 추론한 것 같은 친구 추천 등이 가능하다. 이러한 신흥 그래프 기반 신경망 기계학습은 그간 GPU와 같은 일반 기계학습의 가속 시스템을 재이용해 연산 되어왔는데, 이는 그래프 데이터를 스토리지로부터 메모리로 적재하고 샘플링하는 등의 데이터 전처리 과정에서 심각한 성능 병목현상과 함께 장치 메모리 부족 현상으로 실제 시스템 적용에 한계를 보여 왔다.

정명수 교수 연구팀이 개발한 홀리스틱 GNN 기술은 그래프 데이터 자체가 저장된 스토리지 근처에서 사용자 요청에 따른 추론의 모든 과정을 직접 가속한다. 구체적으로는 프로그래밍 가능한 반도체를 스토리지 근처에 배치한 새로운 계산형 스토리지(Computational SSD) 구조를 활용해 대규모 그래프 데이터의 이동을 제거하고 데이터 근처(Near Storage)에서 그래프처리 및 그래프 샘플링 등을 가속해 그래프 기계학습 전처리 과정에서의 병목현상을 해결했다.

일반적인 계산형 스토리지는 장치 내 고정된 펌웨어와 하드웨어 구성을 통해서 데이터를 처리해야 했기 때문에 그 사용에 제한이 있었다. 그래프처리 및 그래프샘플링 외에도, 연구팀의 홀리스틱 GNN 기술은 인공지능 추론 가속에 필요한 다양한 하드웨어 구조, 그리고 소프트웨어를 후원할 수 있도록 다수 그래프 기계학습 모델을 프로그래밍할 수 있는 장치수준의 소프트웨어와 사용자가 자유롭게 변경할 수 있는 신경망 가속 하드웨어 프레임워크 구조를 제공한다.

연구팀은 홀리스틱 GNN 기술의 실효성을 검증하기 위해 계산형 스토리지의 프로토타입을 자체 제작한 후, 그 위에 개발된 그래프 기계학습용 하드웨어 *RTL과 소프트웨어 프레임워크를 구현해 탑재했다. 그래프 기계학습 추론 성능을 제작된 계산형 스토리지 가속기 프로토타입과 최신 고성능 엔비디아 GPU 가속 시스템(RTX 3090)에서 평가한 결과, 홀리스틱 GNN 기술이 이상적인 상황에서 기존 엔비디아 GPU를 이용해 그래프 기계학습을 가속하는 시스템의 경우에 비해 평균 7배 빠르고 33배 에너지를 감소시킴을 확인했다. 특히, 그래프 규모가 점차 커질수록 전처리 병목현상 완화 효과가 증가해 기존 GPU 대비 최대 201배 향상된 속도와 453배 에너지를 감소할 수 있었다.

☞ RTL (Registor Transistor Logic): 저항과 트랜지스터로 구성한 컴퓨터에 사용되는 회로

정명수 교수는 "대규모 그래프에 대해 스토리지 근처에서 그래프 기계학습을 고속으로 추론할 뿐만 아니라 에너지 절약에 최적화된 계산형 스토리지 가속 시스템을 확보했다ˮ며 "기존 고성능 가속 시스템을 대체해 초대형 추천시스템, 교통 예측 시스템, 신약 개발 등의 광범위한 실제 응용에 적용될 수 있을 것ˮ이라고 말했다.

한편 이번 연구는 미국 산호세에서 오는 2월에 열릴 스토리지 시스템 분야 최우수 학술대회인 `유즈닉스 패스트(USENIX Conference on File and Storage Technologies, FAST), 2022'에 관련 논문(논문명: Hardware/Software Co-Programmable Framework for Computational SSDs to Accelerate Deep Learning Service on Large-Scale Graphs)으로 발표될 예정이다.

해당 연구는 삼성미래기술육성사업 지원을 받아 진행됐고 자세한 내용은 연구실 웹사이트(http://camelab.org)에서 확인할 수 있다.

세계 최초 그래프 기반 인공지능 추론 가능한 SSD 개발

우리 대학 전기및전자공학부 정명수 교수 연구팀(컴퓨터 아키텍처 및 메모리 시스템 연구실)이 세계 최초로 그래프 기계학습 추론의 그래프처리, 그래프 샘플링 그리고 신경망 가속을 스토리지/SSD 장치 근처에서 수행하는 `전체론적 그래프 기반 신경망 기계학습 기술(이하 홀리스틱 GNN)'을 개발하는데 성공했다고 10일 밝혔다.

연구팀은 자체 제작한 프로그래밍 가능 반도체(FPGA)를 동반한 새로운 형태의 계산형 스토리지/SSD 시스템에 기계학습 전용 신경망 가속 하드웨어와 그래프 전용 처리 컨트롤러/소프트웨어를 시제작했다. 이는 이상적 상황에서 최신 고성능 엔비디아 GPU를 이용한 기계학습 가속 컴퓨팅 대비 7배의 속도 향상과 33배의 에너지 절약을 가져올 수 있다고 밝혔다.

그래프 자료구조가 적용된 새로운 기계학습 모델은 기존 신경망 기반 기계학습 기법들과 달리, 데이터 사이의 연관 관계를 표현할 수 있어 페이스북, 구글, 링크드인, 우버 등, 대규모 소셜 네트워크 서비스(SNS)부터, 내비게이션, 신약개발 등 광범위한 분야와 응용에서 사용된다. 예를 들면 그래프 구조로 저장된 사용자 네트워크를 분석하는 경우 일반적인 기계학습으로는 불가능했던 현실적인 상품 및 아이템 추천, 사람이 추론한 것 같은 친구 추천 등이 가능하다. 이러한 신흥 그래프 기반 신경망 기계학습은 그간 GPU와 같은 일반 기계학습의 가속 시스템을 재이용해 연산 되어왔는데, 이는 그래프 데이터를 스토리지로부터 메모리로 적재하고 샘플링하는 등의 데이터 전처리 과정에서 심각한 성능 병목현상과 함께 장치 메모리 부족 현상으로 실제 시스템 적용에 한계를 보여 왔다.

정명수 교수 연구팀이 개발한 홀리스틱 GNN 기술은 그래프 데이터 자체가 저장된 스토리지 근처에서 사용자 요청에 따른 추론의 모든 과정을 직접 가속한다. 구체적으로는 프로그래밍 가능한 반도체를 스토리지 근처에 배치한 새로운 계산형 스토리지(Computational SSD) 구조를 활용해 대규모 그래프 데이터의 이동을 제거하고 데이터 근처(Near Storage)에서 그래프처리 및 그래프 샘플링 등을 가속해 그래프 기계학습 전처리 과정에서의 병목현상을 해결했다.

일반적인 계산형 스토리지는 장치 내 고정된 펌웨어와 하드웨어 구성을 통해서 데이터를 처리해야 했기 때문에 그 사용에 제한이 있었다. 그래프처리 및 그래프샘플링 외에도, 연구팀의 홀리스틱 GNN 기술은 인공지능 추론 가속에 필요한 다양한 하드웨어 구조, 그리고 소프트웨어를 후원할 수 있도록 다수 그래프 기계학습 모델을 프로그래밍할 수 있는 장치수준의 소프트웨어와 사용자가 자유롭게 변경할 수 있는 신경망 가속 하드웨어 프레임워크 구조를 제공한다.

연구팀은 홀리스틱 GNN 기술의 실효성을 검증하기 위해 계산형 스토리지의 프로토타입을 자체 제작한 후, 그 위에 개발된 그래프 기계학습용 하드웨어 *RTL과 소프트웨어 프레임워크를 구현해 탑재했다. 그래프 기계학습 추론 성능을 제작된 계산형 스토리지 가속기 프로토타입과 최신 고성능 엔비디아 GPU 가속 시스템(RTX 3090)에서 평가한 결과, 홀리스틱 GNN 기술이 이상적인 상황에서 기존 엔비디아 GPU를 이용해 그래프 기계학습을 가속하는 시스템의 경우에 비해 평균 7배 빠르고 33배 에너지를 감소시킴을 확인했다. 특히, 그래프 규모가 점차 커질수록 전처리 병목현상 완화 효과가 증가해 기존 GPU 대비 최대 201배 향상된 속도와 453배 에너지를 감소할 수 있었다.

☞ RTL (Registor Transistor Logic): 저항과 트랜지스터로 구성한 컴퓨터에 사용되는 회로

정명수 교수는 "대규모 그래프에 대해 스토리지 근처에서 그래프 기계학습을 고속으로 추론할 뿐만 아니라 에너지 절약에 최적화된 계산형 스토리지 가속 시스템을 확보했다ˮ며 "기존 고성능 가속 시스템을 대체해 초대형 추천시스템, 교통 예측 시스템, 신약 개발 등의 광범위한 실제 응용에 적용될 수 있을 것ˮ이라고 말했다.

한편 이번 연구는 미국 산호세에서 오는 2월에 열릴 스토리지 시스템 분야 최우수 학술대회인 `유즈닉스 패스트(USENIX Conference on File and Storage Technologies, FAST), 2022'에 관련 논문(논문명: Hardware/Software Co-Programmable Framework for Computational SSDs to Accelerate Deep Learning Service on Large-Scale Graphs)으로 발표될 예정이다.

해당 연구는 삼성미래기술육성사업 지원을 받아 진행됐고 자세한 내용은 연구실 웹사이트(http://camelab.org)에서 확인할 수 있다.

2022.01.10

조회수 11224

-

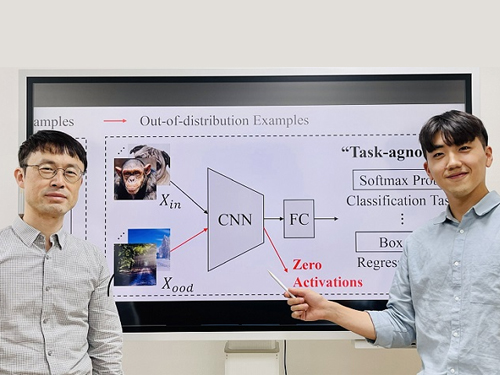

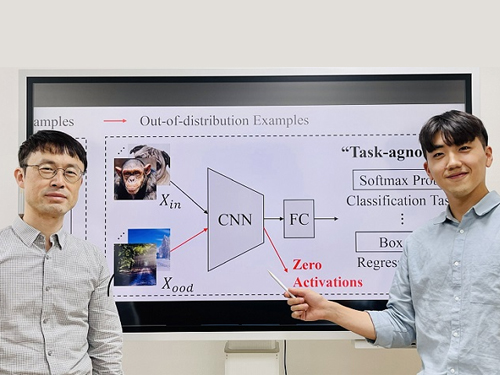

소량의 데이터로 딥러닝 정확도 향상기술 발표

최근 다양한 분야에서 심층 학습(딥러닝) 기술을 활용한 서비스가 급속히 증가하고 있다. 서비스 구축을 위해서는 심층 학습 모델을 훈련해야 하며, 이를 위해서는 충분한 훈련 데이터를 준비해야 한다. 특히 훈련 데이터에 정답지를 만드는 레이블링(labeling) 과정이 필요한데 (예를 들어, 낙타 사진에 `낙타'라고 정답을 적어줌), 이 과정은 일반적으로 수작업으로 진행되므로 엄청난 노동력과 시간이 소요된다. 따라서 훈련 데이터가 충분하지 않은 상황을 효과적으로 타개하는 방법이 요구되고 있다.

우리 대학 전산학부 이재길 교수 연구팀이 적은 양의 훈련 데이터가 존재할 때도 높은 예측 정확도를 달성할 수 있는 새로운 모델 훈련 기술을 개발했다고 27일 밝혔다.

심층 학습 모델의 훈련은 주어진 훈련 데이터에서 레이블과 관련성이 높은 특성을 찾아내는 과정으로 볼 수 있다. 예를 들어, `낙타'의 주요 특성이 등에 있는 `혹'이라는 것을 알아내는 것이다. 그런데 훈련 데이터가 불충분할 경우 바람직하지 않은 특성까지도 같이 추출될 수 있는 문제가 발생한다. 예를 들어, 낙타 사진의 배경으로 종종 사막이 등장하기에 낙타에 대한 특성으로 `사막'이 추출되는 것도 가능하다. 사막은 낙타의 고유한 특성이 아닐뿐더러, 이러한 바람직하지 않은 특성으로 인해 사막이 아닌 곳(예: 동물원)에 있는 낙타는 인식하지 못할 수 있다.

이 교수팀이 개발한 기술은 심층 학습 모델의 훈련에서 바람직하지 않은 특성을 억제해 충분하지 않은 훈련 데이터를 가지고도 높은 예측 정확도를 달성할 수 있게 해준다.

우리 대학 지식서비스공학대학원에 재학 중인 박동민 박사과정 학생이 제1 저자, 송환준 박사, 김민석 박사과정 학생이 제2, 제3 저자로 각각 참여한 이번 연구는 최고권위 국제학술대회 `신경정보처리시스템학회(NeurIPS) 2021'에서 올 12월 발표될 예정이다. (논문명 : Task-Agnostic Undesirable Feature Deactivation Using Out-of-Distribution Data)

바람직하지 않은 특성을 억제하기 위해서 분포 外(out-of-distribution) 데이터를 활용한다. 예를 들어, 낙타와 호랑이 사진의 분류를 위한 훈련 데이터에 대해 여우 사진은 분포 외 데이터가 된다. 이때 이 교수팀이 착안한 점은 훈련 데이터에 존재하는 바람직하지 않은 특성은 분포 외 데이터에도 존재할 수 있다는 점이다.

즉, 위의 예에서 여우 사진의 배경으로도 사막이 나올 수 있다. 따라서 다량의 분포 외 데이터를 추가로 활용해 여기에서 추출된 특성은 영(0) 벡터가 되도록 심층 학습 모델의 훈련 과정을 규제해 바람직하지 않은 특성의 효과를 억제한다. 훈련 과정을 규제한다는 측면에서 정규화 방법론의 일종이라 볼 수 있다. 분포 외 데이터는 쓸모없는 것이라 여겨지고 있었으나, 이번 기술에 의해 훈련 데이터 부족을 해소할 수 있는 유용한 보완재로 탈바꿈될 수 있다.

연구팀은 이 정규화 방법론을 `비선호(比選好) 특성 억제'라고 이름 붙이고 이미지 데이터 분석의 세 가지 주요 문제에 적용했다. 그 결과, 기존 최신 방법론과 비교했을 때, 이미지 분류 문제에서 최대 12% 예측 정확도를 향상했고, 객체 검출 문제에서 최대 3% 예측 정확도를 향상했으며, 객체 지역화 문제에서 최대 8% 예측 정확도를 향상했다.

제1 저자인 박동민 박사과정 학생은 "이번 기술은 훈련 데이터 부족 현상을 해결할 수 있는 새로운 방법ˮ 이라면서 "분류, 회귀 분석을 비롯한 다양한 기계 학습 문제에 폭넓게 적용될 수 있어, 심층 학습의 전반적인 성능 개선에 기여할 수 있다ˮ 고 밝혔다.

연구팀을 지도한 이재길 교수도 "이 기술이 텐서플로우(TensorFlow) 혹은 파이토치(PyTorch)와 같은 기존의 심층 학습 라이브러리에 추가되면 기계 학습 및 심층 학습 학계에 큰 파급효과를 낼 수 있을 것이다ˮ고 말했다.

한편, 이 기술은 과학기술정보통신부 재원으로 정보통신기획평가원의 지원을 받아 SW컴퓨팅산업원천기술개발사업 SW스타랩 과제로 개발한 연구성과 결과물(2020-0-00862, DB4DL: 딥러닝 지원 고사용성 및 고성능 분산 인메모리 DBMS 개발)이다. (끝).

소량의 데이터로 딥러닝 정확도 향상기술 발표

최근 다양한 분야에서 심층 학습(딥러닝) 기술을 활용한 서비스가 급속히 증가하고 있다. 서비스 구축을 위해서는 심층 학습 모델을 훈련해야 하며, 이를 위해서는 충분한 훈련 데이터를 준비해야 한다. 특히 훈련 데이터에 정답지를 만드는 레이블링(labeling) 과정이 필요한데 (예를 들어, 낙타 사진에 `낙타'라고 정답을 적어줌), 이 과정은 일반적으로 수작업으로 진행되므로 엄청난 노동력과 시간이 소요된다. 따라서 훈련 데이터가 충분하지 않은 상황을 효과적으로 타개하는 방법이 요구되고 있다.

우리 대학 전산학부 이재길 교수 연구팀이 적은 양의 훈련 데이터가 존재할 때도 높은 예측 정확도를 달성할 수 있는 새로운 모델 훈련 기술을 개발했다고 27일 밝혔다.

심층 학습 모델의 훈련은 주어진 훈련 데이터에서 레이블과 관련성이 높은 특성을 찾아내는 과정으로 볼 수 있다. 예를 들어, `낙타'의 주요 특성이 등에 있는 `혹'이라는 것을 알아내는 것이다. 그런데 훈련 데이터가 불충분할 경우 바람직하지 않은 특성까지도 같이 추출될 수 있는 문제가 발생한다. 예를 들어, 낙타 사진의 배경으로 종종 사막이 등장하기에 낙타에 대한 특성으로 `사막'이 추출되는 것도 가능하다. 사막은 낙타의 고유한 특성이 아닐뿐더러, 이러한 바람직하지 않은 특성으로 인해 사막이 아닌 곳(예: 동물원)에 있는 낙타는 인식하지 못할 수 있다.

이 교수팀이 개발한 기술은 심층 학습 모델의 훈련에서 바람직하지 않은 특성을 억제해 충분하지 않은 훈련 데이터를 가지고도 높은 예측 정확도를 달성할 수 있게 해준다.

우리 대학 지식서비스공학대학원에 재학 중인 박동민 박사과정 학생이 제1 저자, 송환준 박사, 김민석 박사과정 학생이 제2, 제3 저자로 각각 참여한 이번 연구는 최고권위 국제학술대회 `신경정보처리시스템학회(NeurIPS) 2021'에서 올 12월 발표될 예정이다. (논문명 : Task-Agnostic Undesirable Feature Deactivation Using Out-of-Distribution Data)

바람직하지 않은 특성을 억제하기 위해서 분포 外(out-of-distribution) 데이터를 활용한다. 예를 들어, 낙타와 호랑이 사진의 분류를 위한 훈련 데이터에 대해 여우 사진은 분포 외 데이터가 된다. 이때 이 교수팀이 착안한 점은 훈련 데이터에 존재하는 바람직하지 않은 특성은 분포 외 데이터에도 존재할 수 있다는 점이다.

즉, 위의 예에서 여우 사진의 배경으로도 사막이 나올 수 있다. 따라서 다량의 분포 외 데이터를 추가로 활용해 여기에서 추출된 특성은 영(0) 벡터가 되도록 심층 학습 모델의 훈련 과정을 규제해 바람직하지 않은 특성의 효과를 억제한다. 훈련 과정을 규제한다는 측면에서 정규화 방법론의 일종이라 볼 수 있다. 분포 외 데이터는 쓸모없는 것이라 여겨지고 있었으나, 이번 기술에 의해 훈련 데이터 부족을 해소할 수 있는 유용한 보완재로 탈바꿈될 수 있다.

연구팀은 이 정규화 방법론을 `비선호(比選好) 특성 억제'라고 이름 붙이고 이미지 데이터 분석의 세 가지 주요 문제에 적용했다. 그 결과, 기존 최신 방법론과 비교했을 때, 이미지 분류 문제에서 최대 12% 예측 정확도를 향상했고, 객체 검출 문제에서 최대 3% 예측 정확도를 향상했으며, 객체 지역화 문제에서 최대 8% 예측 정확도를 향상했다.

제1 저자인 박동민 박사과정 학생은 "이번 기술은 훈련 데이터 부족 현상을 해결할 수 있는 새로운 방법ˮ 이라면서 "분류, 회귀 분석을 비롯한 다양한 기계 학습 문제에 폭넓게 적용될 수 있어, 심층 학습의 전반적인 성능 개선에 기여할 수 있다ˮ 고 밝혔다.

연구팀을 지도한 이재길 교수도 "이 기술이 텐서플로우(TensorFlow) 혹은 파이토치(PyTorch)와 같은 기존의 심층 학습 라이브러리에 추가되면 기계 학습 및 심층 학습 학계에 큰 파급효과를 낼 수 있을 것이다ˮ고 말했다.

한편, 이 기술은 과학기술정보통신부 재원으로 정보통신기획평가원의 지원을 받아 SW컴퓨팅산업원천기술개발사업 SW스타랩 과제로 개발한 연구성과 결과물(2020-0-00862, DB4DL: 딥러닝 지원 고사용성 및 고성능 분산 인메모리 DBMS 개발)이다. (끝).

2021.10.27

조회수 12802

뇌처럼 생각·반응하는 반도체 나왔다

뉴랜지스터(Neuransistor)는 ‘뉴런(Neuron) + 트랜지스터(Transistor)’의 합성어로 뇌의 뉴런 특성을 구현하는 트랜지스터라는 의미로 만들어진 새로운 용어이다. 이는 뇌 속 신경세포(뉴런)의 흥분과 억제 반응을 모방하여 시간에 따라 달라지는 정보를 스스로 처리하고 학습할 수 있는 차세대 인공지능 하드웨어의 핵심 반도체 소자다. KAIST 연구진이 뉴랜지스터의 개념을 제시하고 최초로 뉴랜지스터를 개발하는데 성공했다.

우리 대학 신소재공학과 김경민 교수 연구팀이 시간에 따라 변화하는 정보를 효과적으로 처리할 수 있는 액체 상태 기계(Liquid State Machine, 이하 LSM)*의 하드웨어 구현을 가능케 하는 뉴랜지스터 소자 개발에 성공했다.

* 액체상태 기계(LSM): 생물학적 신경망의 동적 특성을 모사해, 시간에 따라 변화하는 입력 데이터를 처리하는 스파이킹 뉴럴 네트워크 모델

현재의 컴퓨터는 동영상과 같이 시간 흐름에 따라 변하는 데이터인 시계열 데이터를 분석하는데 복잡한 알고리즘을 사용하며, 이는 매우 많은 시간과 전력 소모를 필요로 했다.

김경민 교수 연구팀은 이러한 난제를 해결하며 뇌 속 뉴런처럼 흥분하거나 억제되는 반응을 전기 신호만으로 동시에 구현하여 시계열 데이터의 정보 처리에 특화된 단일 반도체 소자를 새롭게 설계했다.

해당 소자는 산화 티타늄(TiO2)과 산화 알루미늄(Al2O3)이라는 두 산화물층을 쌓아 만든 구조로, 두 층이 맞닿는 계면에서는 전자가 자유롭게 빠르게 이동하는 이차원 전자가스(2DEG)** 층이 형성된다. 그리고, 이 층의 양 끝에는 흥분성 및 억제성 신호에 모두 반응하는 뉴런형 소자가 연결되어 있다.

**2DEG(Two-Dimensional Electron Gas): 계면에서 전도성이 우수한 전자 층이 형성되는 현상으로, 높은 이동도와 빠른 응답속도를 제공함

이러한 독특한 구조 덕분에 뉴랜지스터는 게이트 전압의 극성에 따라 소스와 드레인 간에 흥분성(EPSP) 또는 억제성(IPSP) 반응을 선택적으로 구현할 수 있다.

이 소자는 또한 기존 LSM 구현에서 필수적이었던 복잡한 입력 신호 전처리 과정(마스킹)도 간단히 해결했다. 기존에는 '마스킹' 기능 구현이 매우 복잡했으나, 뉴랜지스터는 소스 전극에 가해지는 전압을 조절함으로써 간단하게 마스킹 기능을 구현하고, 시계열 입력 신호를 다차원의 출력 정보로 정확하게 변환하였다. 또한, 높은 내구성과 소자 간의 균일성도 확보해 실용성도 역시 뛰어났다.

연구팀은 뉴랜지스터를 기반으로 복잡한 시계열 데이터를 처리하는 ‘두뇌형 정보처리 시스템’인 LSM을 구현하였다. 실험 결과, 뉴랜지스터를 활용하는 경우 기존의 방식보다 10배 이상 낮은 오차율과 높은 예측 정확도를 기록했고, 학습 속도도 더 빨라졌다.

김경민 교수는 “이번 연구는 인간 뇌의 신호 처리 방식과 유사한 구조를 실제 반도체 소자로 구현했다는 데 큰 의의가 있다”며 “이 기술은 향후 뇌신경 모사형 AI, 예측 시스템, 혼돈 신호 제어 등 다양한 분야에서 중요한 역할을 할 것으로 기대된다”고 전했다.

이번 연구는 신소재공학과 정운형 박사, 김근영 박사가 공동 제1 저자로 참여했으며, 재료 분야 세계적 권위의 국제 학술지 ‘어드밴스드 머터리얼즈(Advanced Materials, IF: 27.4)’에 2025년 4월 8일 字 게재됐다.

(논문명: A Neuransistor with Excitatory and Inhibitory Neuronal Behaviors for Liquid State Machine, DOI: 10.1002/adma.202419122)

한편, 이번 연구는 나노종합기술원, 한국연구재단의 지원을 받아 수행됐다.

2025.04.16 조회수 3878

뇌처럼 생각·반응하는 반도체 나왔다

뉴랜지스터(Neuransistor)는 ‘뉴런(Neuron) + 트랜지스터(Transistor)’의 합성어로 뇌의 뉴런 특성을 구현하는 트랜지스터라는 의미로 만들어진 새로운 용어이다. 이는 뇌 속 신경세포(뉴런)의 흥분과 억제 반응을 모방하여 시간에 따라 달라지는 정보를 스스로 처리하고 학습할 수 있는 차세대 인공지능 하드웨어의 핵심 반도체 소자다. KAIST 연구진이 뉴랜지스터의 개념을 제시하고 최초로 뉴랜지스터를 개발하는데 성공했다.

우리 대학 신소재공학과 김경민 교수 연구팀이 시간에 따라 변화하는 정보를 효과적으로 처리할 수 있는 액체 상태 기계(Liquid State Machine, 이하 LSM)*의 하드웨어 구현을 가능케 하는 뉴랜지스터 소자 개발에 성공했다.

* 액체상태 기계(LSM): 생물학적 신경망의 동적 특성을 모사해, 시간에 따라 변화하는 입력 데이터를 처리하는 스파이킹 뉴럴 네트워크 모델

현재의 컴퓨터는 동영상과 같이 시간 흐름에 따라 변하는 데이터인 시계열 데이터를 분석하는데 복잡한 알고리즘을 사용하며, 이는 매우 많은 시간과 전력 소모를 필요로 했다.

김경민 교수 연구팀은 이러한 난제를 해결하며 뇌 속 뉴런처럼 흥분하거나 억제되는 반응을 전기 신호만으로 동시에 구현하여 시계열 데이터의 정보 처리에 특화된 단일 반도체 소자를 새롭게 설계했다.

해당 소자는 산화 티타늄(TiO2)과 산화 알루미늄(Al2O3)이라는 두 산화물층을 쌓아 만든 구조로, 두 층이 맞닿는 계면에서는 전자가 자유롭게 빠르게 이동하는 이차원 전자가스(2DEG)** 층이 형성된다. 그리고, 이 층의 양 끝에는 흥분성 및 억제성 신호에 모두 반응하는 뉴런형 소자가 연결되어 있다.

**2DEG(Two-Dimensional Electron Gas): 계면에서 전도성이 우수한 전자 층이 형성되는 현상으로, 높은 이동도와 빠른 응답속도를 제공함

이러한 독특한 구조 덕분에 뉴랜지스터는 게이트 전압의 극성에 따라 소스와 드레인 간에 흥분성(EPSP) 또는 억제성(IPSP) 반응을 선택적으로 구현할 수 있다.

이 소자는 또한 기존 LSM 구현에서 필수적이었던 복잡한 입력 신호 전처리 과정(마스킹)도 간단히 해결했다. 기존에는 '마스킹' 기능 구현이 매우 복잡했으나, 뉴랜지스터는 소스 전극에 가해지는 전압을 조절함으로써 간단하게 마스킹 기능을 구현하고, 시계열 입력 신호를 다차원의 출력 정보로 정확하게 변환하였다. 또한, 높은 내구성과 소자 간의 균일성도 확보해 실용성도 역시 뛰어났다.

연구팀은 뉴랜지스터를 기반으로 복잡한 시계열 데이터를 처리하는 ‘두뇌형 정보처리 시스템’인 LSM을 구현하였다. 실험 결과, 뉴랜지스터를 활용하는 경우 기존의 방식보다 10배 이상 낮은 오차율과 높은 예측 정확도를 기록했고, 학습 속도도 더 빨라졌다.

김경민 교수는 “이번 연구는 인간 뇌의 신호 처리 방식과 유사한 구조를 실제 반도체 소자로 구현했다는 데 큰 의의가 있다”며 “이 기술은 향후 뇌신경 모사형 AI, 예측 시스템, 혼돈 신호 제어 등 다양한 분야에서 중요한 역할을 할 것으로 기대된다”고 전했다.

이번 연구는 신소재공학과 정운형 박사, 김근영 박사가 공동 제1 저자로 참여했으며, 재료 분야 세계적 권위의 국제 학술지 ‘어드밴스드 머터리얼즈(Advanced Materials, IF: 27.4)’에 2025년 4월 8일 字 게재됐다.

(논문명: A Neuransistor with Excitatory and Inhibitory Neuronal Behaviors for Liquid State Machine, DOI: 10.1002/adma.202419122)

한편, 이번 연구는 나노종합기술원, 한국연구재단의 지원을 받아 수행됐다.

2025.04.16 조회수 3878 로봇 등 온디바이스 인공지능 실현 가능

자율주행차, 로봇 등 온디바이스 자율 시스템 환경에서 클라우드의 원격 컴퓨팅 자원 없이 기기 자체에 내장된 인공지능 칩을 활용한 온디바이스 자원만으로 적응형 AI를 실현하는 기술이 개발됐다.

우리 대학 전산학부 박종세 교수 연구팀이 지난 6월 29일부터 7월 3일까지 아르헨티나 부에노스아이레스에서 열린 ‘2024 국제 컴퓨터구조 심포지엄(International Symposium on Computer Architecture, ISCA 2024)’에서 최우수 연구 기록물상(Distinguished Artifact Award)을 수상했다고 1일 밝혔다.

* 논문명: 자율 시스템의 비디오 분석을 위한 연속학습 가속화 기법(DaCapo: Accelerating Continuous Learning in Autonomous Systems for Video Analytics)

국제 컴퓨터 구조 심포지움(ISCA)은 컴퓨터 아키텍처 분야에서 최고 권위를 자랑하는 국제 학회로 올해는 423편의 논문이 제출됐으며 그중 83편 만이 채택됐다. (채택률 19.6%). 최우수 연구 기록물 상은 학회에서 주어지는 특별한 상 중 하나로, 제출 논문 중 연구 기록물의 혁신성, 활용 가능성, 영향력을 고려해 선정된다.

이번 수상 연구는 적응형 AI의 기반 기술인 ‘연속 학습’ 가속을 위한 NPU(신경망처리장치) 구조 및 온디바이스 소프트웨어 시스템을 최초 개발한 점, 향후 온디바이스 AI 시스템 연구의 지속적인 발전을 위해 오픈소스로 공개한 코드, 데이터 등의 완성도 측면에서 높은 평가를 받았다.

연구 결과는 소프트웨어 중심 자동차(SDV; Software-Defined Vehicles), 소프트웨어 중심 로봇(SDR; Software-Defined Robots)으로 대표되는 미래 모빌리티 환경에서 온디바이스 AI 시스템을 구축하는 등 다양한 분야에 활용될 수 있을 것으로 기대된다.

상을 받은 전산학부 박종세 교수는 “이번 연구를 통해 온디바이스 자원만으로 적응형 AI를 실현할 수 있다는 것을 입증하게 되어 매우 기쁘고 이 성과는 학생들의 헌신적인 노력과 구글 및 메타 연구자들과의 긴밀한 협력 덕분이다”라며, “앞으로도 온디바이스 AI를 위한 하드웨어와 소프트웨어 연구를 지속해 나갈 것이다”라고 소감을 전했다.

이번 연구는 우리 대학 전산학부 김윤성, 오창훈, 황진우, 김원웅, 오성룡, 이유빈 학생들과 메타(Meta)의 하딕 샤르마(Hardik Sharma) 박사, 구글 딥마인드(Google Deepmind)의 아미르 야즈단바크시(Amir Yazdanbakhsh) 박사, 전산학부 박종세 교수가 참여했다.

한편 이번 연구는 한국연구재단 우수신진연구자지원사업, 정보통신기획평가원(IITP), 대학ICT연구센터(ITRC), 인공지능대학원지원사업, 인공지능반도체대학원지원사업의 지원을 받아 수행됐다.

2024.08.01 조회수 6604

로봇 등 온디바이스 인공지능 실현 가능

자율주행차, 로봇 등 온디바이스 자율 시스템 환경에서 클라우드의 원격 컴퓨팅 자원 없이 기기 자체에 내장된 인공지능 칩을 활용한 온디바이스 자원만으로 적응형 AI를 실현하는 기술이 개발됐다.

우리 대학 전산학부 박종세 교수 연구팀이 지난 6월 29일부터 7월 3일까지 아르헨티나 부에노스아이레스에서 열린 ‘2024 국제 컴퓨터구조 심포지엄(International Symposium on Computer Architecture, ISCA 2024)’에서 최우수 연구 기록물상(Distinguished Artifact Award)을 수상했다고 1일 밝혔다.

* 논문명: 자율 시스템의 비디오 분석을 위한 연속학습 가속화 기법(DaCapo: Accelerating Continuous Learning in Autonomous Systems for Video Analytics)

국제 컴퓨터 구조 심포지움(ISCA)은 컴퓨터 아키텍처 분야에서 최고 권위를 자랑하는 국제 학회로 올해는 423편의 논문이 제출됐으며 그중 83편 만이 채택됐다. (채택률 19.6%). 최우수 연구 기록물 상은 학회에서 주어지는 특별한 상 중 하나로, 제출 논문 중 연구 기록물의 혁신성, 활용 가능성, 영향력을 고려해 선정된다.

이번 수상 연구는 적응형 AI의 기반 기술인 ‘연속 학습’ 가속을 위한 NPU(신경망처리장치) 구조 및 온디바이스 소프트웨어 시스템을 최초 개발한 점, 향후 온디바이스 AI 시스템 연구의 지속적인 발전을 위해 오픈소스로 공개한 코드, 데이터 등의 완성도 측면에서 높은 평가를 받았다.

연구 결과는 소프트웨어 중심 자동차(SDV; Software-Defined Vehicles), 소프트웨어 중심 로봇(SDR; Software-Defined Robots)으로 대표되는 미래 모빌리티 환경에서 온디바이스 AI 시스템을 구축하는 등 다양한 분야에 활용될 수 있을 것으로 기대된다.

상을 받은 전산학부 박종세 교수는 “이번 연구를 통해 온디바이스 자원만으로 적응형 AI를 실현할 수 있다는 것을 입증하게 되어 매우 기쁘고 이 성과는 학생들의 헌신적인 노력과 구글 및 메타 연구자들과의 긴밀한 협력 덕분이다”라며, “앞으로도 온디바이스 AI를 위한 하드웨어와 소프트웨어 연구를 지속해 나갈 것이다”라고 소감을 전했다.

이번 연구는 우리 대학 전산학부 김윤성, 오창훈, 황진우, 김원웅, 오성룡, 이유빈 학생들과 메타(Meta)의 하딕 샤르마(Hardik Sharma) 박사, 구글 딥마인드(Google Deepmind)의 아미르 야즈단바크시(Amir Yazdanbakhsh) 박사, 전산학부 박종세 교수가 참여했다.

한편 이번 연구는 한국연구재단 우수신진연구자지원사업, 정보통신기획평가원(IITP), 대학ICT연구센터(ITRC), 인공지능대학원지원사업, 인공지능반도체대학원지원사업의 지원을 받아 수행됐다.

2024.08.01 조회수 6604 혐오 발언 탐지의 문화적 차이 해결, NAACL 2024에서 Resource Award 수상

전산학부 Users & Information Lab. 연구실의 오혜연 교수와 제1저자 석사과정 이나연(오혜연 교수 지도 학생)의 연구가 지난 6월 16일부터 21일까지 멕시코시티에서 열린 '2024 Annual Conference of the North American Chapter of the Association for Computational Linguistics' (NAACL 2024) 국제 학회에서 '교차 문화적 데이터셋 구축을 통한 영어 혐오 발언 어노테이션의 문화 간 차이와 영향 분석(Exploring Cross-Cultural Differences in English Hate Speech Annotations: From Dataset Construction to Analysis)'에 관한 논문으로 '리소스 어워드(Resource Award)'를 수상했다.

NAACL은 자연어처리 분야에서 최고 권위를 자랑하는 국제 학회로, 올해는 2,434편의 논문이 제출되었으며 그 중 565편만이 채택되었다 (채택률 23.2%).

Resource Award는 학회에서 주어지는 특별한 상 중 하나로, 제출 논문 중 혁신성, 활용 가능성, 영향력, 품질을 고려하여 선정된다.

이번 수상 연구는 교차 문화적 영어 혐오 발언 데이터셋을 구축하고, 문화 간 어노테이션 차이와 대형 언어 모델의 편향성을 분석하여 영어 혐오 발언 분류기의 문화적 민감성을 향상시키는 데 기여했다는점에서 높은 평가를 받았다.

이번 연구에는 KAIST 전산학부의 이나연, 정찬이, 명준호, 진지호 학생들과 Cardiff University의 Jose Camacho-Collados 교수, KAIST 전산학부의 김주호 교수, 오혜연 교수가 참여하였다. 본 연구는 미국, 호주, 영국, 싱가포르, 남아프리카 공화국의 5개 영어권 국가에서 수집된 데이터와 어노테이션을 기반으로 하여, 각국의 문화적 배경이 혐오 발언 어노테이션에 미치는 영향을 분석했다. 이를 통해 문화적 배경이 혐오 발언 인식에 미치는 중요한 차이를 밝혀냈으며, 특히 서구권 국가와 다른 문화적 맥락을 가진 국가 간의 어노테이션 차이가 두드러짐을 보였다.

오혜연 교수와 이나연 학생은 "이번 연구를 통해 혐오 발언 탐지에 있어 문화적 차이의 중요성을 밝힐 수 있어 기쁩니다. 연구팀의 노력 덕분에 이러한 성과를 얻을 수 있었으며, 앞으로도 자연어처리 분야에서 문화적 다양성을 고려한 연구를 지속해 나가겠습니다."라고 소감을 전했다.

이번 수상은 KAIST 연구팀의 혁신적인 접근과 자연어처리 분야에서의 문화 간 연구의 중요성을 국제적으로 인정받은 결과이다. 이는 앞으로 관련 연구 발전에 큰 기여를 할 것으로 기대된다.

연구 결과는 혐오 발언 탐지 분야뿐만 아니라, 다문화 사회에서의 인공지능 윤리와 문화적 편향성 해소 등 다양한 분야에 활용될 수 있을 것으로 기대된다.

자세한 내용은 논문 링크(https://aclanthology.org/2024.naacl-long.236)에서 확인할 수 있다.

2024.07.16 조회수 4560

혐오 발언 탐지의 문화적 차이 해결, NAACL 2024에서 Resource Award 수상

전산학부 Users & Information Lab. 연구실의 오혜연 교수와 제1저자 석사과정 이나연(오혜연 교수 지도 학생)의 연구가 지난 6월 16일부터 21일까지 멕시코시티에서 열린 '2024 Annual Conference of the North American Chapter of the Association for Computational Linguistics' (NAACL 2024) 국제 학회에서 '교차 문화적 데이터셋 구축을 통한 영어 혐오 발언 어노테이션의 문화 간 차이와 영향 분석(Exploring Cross-Cultural Differences in English Hate Speech Annotations: From Dataset Construction to Analysis)'에 관한 논문으로 '리소스 어워드(Resource Award)'를 수상했다.

NAACL은 자연어처리 분야에서 최고 권위를 자랑하는 국제 학회로, 올해는 2,434편의 논문이 제출되었으며 그 중 565편만이 채택되었다 (채택률 23.2%).

Resource Award는 학회에서 주어지는 특별한 상 중 하나로, 제출 논문 중 혁신성, 활용 가능성, 영향력, 품질을 고려하여 선정된다.

이번 수상 연구는 교차 문화적 영어 혐오 발언 데이터셋을 구축하고, 문화 간 어노테이션 차이와 대형 언어 모델의 편향성을 분석하여 영어 혐오 발언 분류기의 문화적 민감성을 향상시키는 데 기여했다는점에서 높은 평가를 받았다.

이번 연구에는 KAIST 전산학부의 이나연, 정찬이, 명준호, 진지호 학생들과 Cardiff University의 Jose Camacho-Collados 교수, KAIST 전산학부의 김주호 교수, 오혜연 교수가 참여하였다. 본 연구는 미국, 호주, 영국, 싱가포르, 남아프리카 공화국의 5개 영어권 국가에서 수집된 데이터와 어노테이션을 기반으로 하여, 각국의 문화적 배경이 혐오 발언 어노테이션에 미치는 영향을 분석했다. 이를 통해 문화적 배경이 혐오 발언 인식에 미치는 중요한 차이를 밝혀냈으며, 특히 서구권 국가와 다른 문화적 맥락을 가진 국가 간의 어노테이션 차이가 두드러짐을 보였다.

오혜연 교수와 이나연 학생은 "이번 연구를 통해 혐오 발언 탐지에 있어 문화적 차이의 중요성을 밝힐 수 있어 기쁩니다. 연구팀의 노력 덕분에 이러한 성과를 얻을 수 있었으며, 앞으로도 자연어처리 분야에서 문화적 다양성을 고려한 연구를 지속해 나가겠습니다."라고 소감을 전했다.

이번 수상은 KAIST 연구팀의 혁신적인 접근과 자연어처리 분야에서의 문화 간 연구의 중요성을 국제적으로 인정받은 결과이다. 이는 앞으로 관련 연구 발전에 큰 기여를 할 것으로 기대된다.

연구 결과는 혐오 발언 탐지 분야뿐만 아니라, 다문화 사회에서의 인공지능 윤리와 문화적 편향성 해소 등 다양한 분야에 활용될 수 있을 것으로 기대된다.

자세한 내용은 논문 링크(https://aclanthology.org/2024.naacl-long.236)에서 확인할 수 있다.

2024.07.16 조회수 4560 멀티모달 대형언어모델이 GPT-4V를 뛰어넘다

멀티모달 대형 언어모델이란 텍스트뿐만 아니라 이미지 데이터 유형까지 처리할 수 있는 초대형 언어모델을 말한다. 해외 대형 기업의 풍부한 컴퓨팅 자원의 지원으로부터 인간의 뇌에 있는 신경망의 개수와 유사한 수준초대형모델들이 만들어지고 있으나 학계에서는 이런 개발이 쉽지 않았다. KAIST 연구진이 오픈AI의 GPT-4V와 구글의 제미나이-프로(Gemini-Pro)를 뛰어넘는 멀티모달 대형언어모델을 개발하여 화제다.

우리 대학 전기및전자공학부 노용만 교수 연구팀이 오픈AI(OpenAI)의 GPT-4V 등 기업에서 비공개하고 있는 상업 모델인 초대형 언어모델의 시각 성능을 뛰어넘는 공개형 멀티모달 대형 언어모델을 개발해 출시했다고 20일 밝혔다.

노용만 교수 연구팀은 단순히 모델의 크기를 키우거나 고품질의 시각적 지시 조정 데이터셋을 만들지 않고 멀티모달 대형언어모델의 시각 성능을 획기적으로 높인 콜라보(CoLLaVO), 모아이(MoAI) 2가지 기술을 연속적으로 개발했다고 밝혔다.

연구팀이 개발한 첫번째 기술인 ‘콜라보(CoLLaVO)’는 현존하는 공개형 멀티모달 대형언어모델이 비공개형 모델의 성능에 비해 현저하게 낮은 이유를 일차적으로 물체 수준에 대한 이미지 이해 능력이 현저하게 떨어진다는 것을 먼저 검증해 보였다.

해당 능력을 효율적으로 증가시켜 시각-언어 태스크에 대한 성능을 향상 하기 위해 연구팀은 이미지 내의 정보를 배경과 물체 단위로 분할하고 각 배경 및 물체에 대한 정보를 멀티모달 대형언어모델에 입력으로 직접 넣어주는 새로운 방법‘크레용 프롬프트(Crayon Prompt)’라는 시각적 프롬프트를 새롭게 제안했다.

또한 시각적 지시 조정 단계에서 크레용 프롬프트로 학습한 정보를 잃어버리지 않기 위해 연구팀은 물체 수준 이미지 이해 능력과 시각-언어 태스크 처리 능력을 서로 다른 파라미터로 학습해 서로 간의 정보를 잃지 않게 만드는 획기적인 학습 전략인 ‘듀얼 큐로라(Dual QLoRA)’를 제안했다. 이를 통해, 콜라보(CoLLaVO) 멀티모달 대형언어모델은 이미지 내에서 배경 및 물체를 구분하는 능력이 뛰어나 일차원적인 시각 구분 능력이 크게 향상됐다고 밝혔다.

두 번째 대형언어모델인 ‘모아이(MoAI)’는 인간이 사물을 판단할 때 물체의 존재, 상태, 물체 간의 상호작용, 배경에 대한 이해, 텍스트에 대한 이해 등으로부터 상황을 판단하는 인지과학적인 요소에 영감을 받아서 만들어졌다고 밝혔다.

이는 기존 멀티모달 대형언어모델이 텍스트에 의미적으로 정렬된 시각 인코더(vision encoder)만을 사용하기 때문에, 이미지 픽셀 수준에서의 상세하고 종합적인 실세계 장면 이해가 부족하다는 점을 지적하며 이런 컴퓨터 비전 모델들의 결과를 받으면 모두 인간이 이해할 수 있는 언어로 변환한 뒤에 멀티모달 대형언어모델에 입력으로 직접 사용했다.

노용만 교수는 “연구팀에서 개발한 공개형 멀티모달 대형언어모델이 허깅페이스 일간 화제의 논문(Huggingface Daily Papers)에 추천됐고, 각종 SNS를 통해 세계 연구자에게 알려지고 있으며, 모든 모델을 공개형 대형언어모델로 출시 했기 때문에 이 연구모델이 멀티모달 대형언어모델 발전에 기여할 것이다”이라고 언급했다.

연구팀이 개발한 멀티모달 대형언어모델인 콜라보(CoLLaVO)와 모아이(MoAI)는 KAIST 전기및전자공학부 이병관 박사과정이 제1 저자로 참여하고 박범찬 석박사통합과정, 김채원 박사과정이 공동 저자로 참여했다.

콜라보(CoLLaVO)는 자연어 처리(NLP) 분야 최고의 국제 학회인 ‘Findings of the Association for Computational Linguistics(ACL Findings) 2024’에 5월 16일 자로 학회에 승인받았고, 모아이(MoAI)는 컴퓨터 비전 최고의 국제 학회인 ‘European Conference on Computer Vision(ECCV) 2024’학회 승인 결과를 기다리고 있다고 밝혔다.

한편 이번 연구는 KAIST 미래국방 인공지능 특화연구센터 및 전기및전자공학부의 지원을 받아 수행됐다.

[1] CoLLaVO 데모 GIF 영상

https://github.com/ByungKwanLee/CoLLaVO

[2] MoAI 데모 GIF 영상

https://github.com/ByungKwanLee/MoAI

2024.06.20 조회수 8432

멀티모달 대형언어모델이 GPT-4V를 뛰어넘다

멀티모달 대형 언어모델이란 텍스트뿐만 아니라 이미지 데이터 유형까지 처리할 수 있는 초대형 언어모델을 말한다. 해외 대형 기업의 풍부한 컴퓨팅 자원의 지원으로부터 인간의 뇌에 있는 신경망의 개수와 유사한 수준초대형모델들이 만들어지고 있으나 학계에서는 이런 개발이 쉽지 않았다. KAIST 연구진이 오픈AI의 GPT-4V와 구글의 제미나이-프로(Gemini-Pro)를 뛰어넘는 멀티모달 대형언어모델을 개발하여 화제다.

우리 대학 전기및전자공학부 노용만 교수 연구팀이 오픈AI(OpenAI)의 GPT-4V 등 기업에서 비공개하고 있는 상업 모델인 초대형 언어모델의 시각 성능을 뛰어넘는 공개형 멀티모달 대형 언어모델을 개발해 출시했다고 20일 밝혔다.

노용만 교수 연구팀은 단순히 모델의 크기를 키우거나 고품질의 시각적 지시 조정 데이터셋을 만들지 않고 멀티모달 대형언어모델의 시각 성능을 획기적으로 높인 콜라보(CoLLaVO), 모아이(MoAI) 2가지 기술을 연속적으로 개발했다고 밝혔다.

연구팀이 개발한 첫번째 기술인 ‘콜라보(CoLLaVO)’는 현존하는 공개형 멀티모달 대형언어모델이 비공개형 모델의 성능에 비해 현저하게 낮은 이유를 일차적으로 물체 수준에 대한 이미지 이해 능력이 현저하게 떨어진다는 것을 먼저 검증해 보였다.

해당 능력을 효율적으로 증가시켜 시각-언어 태스크에 대한 성능을 향상 하기 위해 연구팀은 이미지 내의 정보를 배경과 물체 단위로 분할하고 각 배경 및 물체에 대한 정보를 멀티모달 대형언어모델에 입력으로 직접 넣어주는 새로운 방법‘크레용 프롬프트(Crayon Prompt)’라는 시각적 프롬프트를 새롭게 제안했다.

또한 시각적 지시 조정 단계에서 크레용 프롬프트로 학습한 정보를 잃어버리지 않기 위해 연구팀은 물체 수준 이미지 이해 능력과 시각-언어 태스크 처리 능력을 서로 다른 파라미터로 학습해 서로 간의 정보를 잃지 않게 만드는 획기적인 학습 전략인 ‘듀얼 큐로라(Dual QLoRA)’를 제안했다. 이를 통해, 콜라보(CoLLaVO) 멀티모달 대형언어모델은 이미지 내에서 배경 및 물체를 구분하는 능력이 뛰어나 일차원적인 시각 구분 능력이 크게 향상됐다고 밝혔다.

두 번째 대형언어모델인 ‘모아이(MoAI)’는 인간이 사물을 판단할 때 물체의 존재, 상태, 물체 간의 상호작용, 배경에 대한 이해, 텍스트에 대한 이해 등으로부터 상황을 판단하는 인지과학적인 요소에 영감을 받아서 만들어졌다고 밝혔다.

이는 기존 멀티모달 대형언어모델이 텍스트에 의미적으로 정렬된 시각 인코더(vision encoder)만을 사용하기 때문에, 이미지 픽셀 수준에서의 상세하고 종합적인 실세계 장면 이해가 부족하다는 점을 지적하며 이런 컴퓨터 비전 모델들의 결과를 받으면 모두 인간이 이해할 수 있는 언어로 변환한 뒤에 멀티모달 대형언어모델에 입력으로 직접 사용했다.

노용만 교수는 “연구팀에서 개발한 공개형 멀티모달 대형언어모델이 허깅페이스 일간 화제의 논문(Huggingface Daily Papers)에 추천됐고, 각종 SNS를 통해 세계 연구자에게 알려지고 있으며, 모든 모델을 공개형 대형언어모델로 출시 했기 때문에 이 연구모델이 멀티모달 대형언어모델 발전에 기여할 것이다”이라고 언급했다.

연구팀이 개발한 멀티모달 대형언어모델인 콜라보(CoLLaVO)와 모아이(MoAI)는 KAIST 전기및전자공학부 이병관 박사과정이 제1 저자로 참여하고 박범찬 석박사통합과정, 김채원 박사과정이 공동 저자로 참여했다.

콜라보(CoLLaVO)는 자연어 처리(NLP) 분야 최고의 국제 학회인 ‘Findings of the Association for Computational Linguistics(ACL Findings) 2024’에 5월 16일 자로 학회에 승인받았고, 모아이(MoAI)는 컴퓨터 비전 최고의 국제 학회인 ‘European Conference on Computer Vision(ECCV) 2024’학회 승인 결과를 기다리고 있다고 밝혔다.

한편 이번 연구는 KAIST 미래국방 인공지능 특화연구센터 및 전기및전자공학부의 지원을 받아 수행됐다.

[1] CoLLaVO 데모 GIF 영상

https://github.com/ByungKwanLee/CoLLaVO

[2] MoAI 데모 GIF 영상

https://github.com/ByungKwanLee/MoAI

2024.06.20 조회수 8432 ‘당신 우울한가요?’ 스마트폰으로 진단하다

요즘 현대인들에게 많이 찾아오는 우울증을 진단하기 위한 스마트폰으로 진단하는 연구가 개발되어 화제다.

우리 대학 전기및전자공학부 이성주 교수 연구팀이 사용자의 언어 사용 패턴을 개인정보 유출 없이 스마트폰에서 자동으로 분석해 사용자의 정신건강 상태를 모니터링하는 인공지능 기술을 개발했다고 21일 밝혔다. 사용자가 스마트폰을 소지하고 일상적으로 사용하기만 해도 스마트폰이 사용자의 정신건강 상태를 분석 및 진단할 수 있는 것이다.

연구팀은 임상적으로 이뤄지는 정신질환 진단이 환자와의 상담을 통한 언어 사용 분석에서 이루어진다는 점에 착안해 연구를 진행했다. 이번 기술에서는 (1) 사용자가 직접 작성한 문자 메시지 등의 키보드 입력 내용과, (2) 스마트폰 위 마이크에서 실시간으로 수집되는 사용자의 음성 데이터를 기반으로 정신건강 진단을 수행한다.

이러한 언어 데이터는 사용자의 민감한 정보를 담고 있을 수 있어 기존에는 활용이 어려웠다. 이러한 문제의 해결을 위해 이번 기술에는 연합학습 인공지능 기술이 적용됐는데, 이는 사용자 기기 외부로의 데이터 유출 없이 인공지능 모델을 학습해 사생활 침해의 우려가 없다는 것이 특징이다.

인공지능 모델은 일상 대화 내용과 화자의 정신건강을 바탕으로 한 데이터셋을 기반으로 학습되었다. 모델은 스마트폰에서 입력으로 주어지는 대화를 실시간으로 분석하여 학습된 내용을 바탕으로 사용자의 정신건강 척도를 예측한다.

더 나아가, 연구팀은 스마트폰 위 대량으로 주어지는 사용자 언어 데이터로부터 효과적인 정신건강 진단을 수행하는 방법론을 개발했다. 연구팀은 사용자들이 언어를 사용하는 패턴이 실생활 속 다양한 상황에 따라 다르다는 것에 착안해, 스마트폰 위에서 주어지는 현재 상황에 대한 단서를 기반으로, 인공지능 모델이 상대적으로 중요한 언어 데이터에 집중하도록 설계했다. 예를 들어, 업무 시간보다는 저녁 시간에 가족 또는 친구들과 나누는 대화에 정신건강을 모니터링 할 수 있는 단서가 많다고 인공지능 모델이 판단해 중점을 두고 분석하는 식이다.

이번 논문은 전산학부 신재민 박사과정, 전기및전자공학부 윤형준 박사과정, 이승주 석사과정, 이성주 교수와 박성준 SoftlyAI 대표(KAIST 졸업생), 중국 칭화대학교 윤신 리우(Yunxin Liu) 교수, 그리고 미국 에모리(Emory) 대학교 최진호 교수의 공동연구로 이뤄졌다.

이번 논문은 올해 12월 6일부터 10일까지 싱가폴에서 열린 자연어 처리 분야 최고 권위 학회인 EMNLP(Conference on Empirical Methods in Natural Language Processing)에서 발표됐다.

※ 논문명(FedTherapist: Mental Health Monitoring with User-Generated Linguistic Expressions on Smartphones via Federated Learning)

이성주 교수는 "이번 연구는 모바일 센싱, 자연어 처리, 인공지능, 심리학 전문가들의 협력으로 이루어져서 의미가 깊으며, 정신질환으로 어려워하는 사람들이 많은데, 개인정보 유출이나 사생활 침범의 걱정 없이 스마트폰 사용만으로 정신건강 상태를 조기진단 할 수 있게 되었다ˮ라며, "이번 연구가 서비스화되어 사회에 도움이 되면 좋겠다ˮ라고 소감을 밝혔다.

이 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행됐다. (No. 2022-0-00495, 휴대폰 단말에서의 보이스피싱 탐지 예방 기술 개발, No. 2022-0-00064, 감정노동자의 정신건강 위험 예측 및 관리를 위한 휴먼 디지털 트윈 기술 개발)

2023.12.21 조회수 9695

‘당신 우울한가요?’ 스마트폰으로 진단하다

요즘 현대인들에게 많이 찾아오는 우울증을 진단하기 위한 스마트폰으로 진단하는 연구가 개발되어 화제다.

우리 대학 전기및전자공학부 이성주 교수 연구팀이 사용자의 언어 사용 패턴을 개인정보 유출 없이 스마트폰에서 자동으로 분석해 사용자의 정신건강 상태를 모니터링하는 인공지능 기술을 개발했다고 21일 밝혔다. 사용자가 스마트폰을 소지하고 일상적으로 사용하기만 해도 스마트폰이 사용자의 정신건강 상태를 분석 및 진단할 수 있는 것이다.

연구팀은 임상적으로 이뤄지는 정신질환 진단이 환자와의 상담을 통한 언어 사용 분석에서 이루어진다는 점에 착안해 연구를 진행했다. 이번 기술에서는 (1) 사용자가 직접 작성한 문자 메시지 등의 키보드 입력 내용과, (2) 스마트폰 위 마이크에서 실시간으로 수집되는 사용자의 음성 데이터를 기반으로 정신건강 진단을 수행한다.

이러한 언어 데이터는 사용자의 민감한 정보를 담고 있을 수 있어 기존에는 활용이 어려웠다. 이러한 문제의 해결을 위해 이번 기술에는 연합학습 인공지능 기술이 적용됐는데, 이는 사용자 기기 외부로의 데이터 유출 없이 인공지능 모델을 학습해 사생활 침해의 우려가 없다는 것이 특징이다.

인공지능 모델은 일상 대화 내용과 화자의 정신건강을 바탕으로 한 데이터셋을 기반으로 학습되었다. 모델은 스마트폰에서 입력으로 주어지는 대화를 실시간으로 분석하여 학습된 내용을 바탕으로 사용자의 정신건강 척도를 예측한다.

더 나아가, 연구팀은 스마트폰 위 대량으로 주어지는 사용자 언어 데이터로부터 효과적인 정신건강 진단을 수행하는 방법론을 개발했다. 연구팀은 사용자들이 언어를 사용하는 패턴이 실생활 속 다양한 상황에 따라 다르다는 것에 착안해, 스마트폰 위에서 주어지는 현재 상황에 대한 단서를 기반으로, 인공지능 모델이 상대적으로 중요한 언어 데이터에 집중하도록 설계했다. 예를 들어, 업무 시간보다는 저녁 시간에 가족 또는 친구들과 나누는 대화에 정신건강을 모니터링 할 수 있는 단서가 많다고 인공지능 모델이 판단해 중점을 두고 분석하는 식이다.

이번 논문은 전산학부 신재민 박사과정, 전기및전자공학부 윤형준 박사과정, 이승주 석사과정, 이성주 교수와 박성준 SoftlyAI 대표(KAIST 졸업생), 중국 칭화대학교 윤신 리우(Yunxin Liu) 교수, 그리고 미국 에모리(Emory) 대학교 최진호 교수의 공동연구로 이뤄졌다.

이번 논문은 올해 12월 6일부터 10일까지 싱가폴에서 열린 자연어 처리 분야 최고 권위 학회인 EMNLP(Conference on Empirical Methods in Natural Language Processing)에서 발표됐다.

※ 논문명(FedTherapist: Mental Health Monitoring with User-Generated Linguistic Expressions on Smartphones via Federated Learning)

이성주 교수는 "이번 연구는 모바일 센싱, 자연어 처리, 인공지능, 심리학 전문가들의 협력으로 이루어져서 의미가 깊으며, 정신질환으로 어려워하는 사람들이 많은데, 개인정보 유출이나 사생활 침범의 걱정 없이 스마트폰 사용만으로 정신건강 상태를 조기진단 할 수 있게 되었다ˮ라며, "이번 연구가 서비스화되어 사회에 도움이 되면 좋겠다ˮ라고 소감을 밝혔다.

이 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행됐다. (No. 2022-0-00495, 휴대폰 단말에서의 보이스피싱 탐지 예방 기술 개발, No. 2022-0-00064, 감정노동자의 정신건강 위험 예측 및 관리를 위한 휴먼 디지털 트윈 기술 개발)

2023.12.21 조회수 9695 구글딥마인드와 공동연구를 통해 인공지능으로 시각을 상상하다

‘노란 포도'나 `보라색 바나나'와 같이 본 적 없는 시각 개념을 이해하고 상상하는 인공지능 능력 구현이 가능해졌다.

우리 대학 전산학부 안성진 교수 연구팀이 구글 딥마인드 및 미국 럿거스 대학교와의 국제 공동 연구를 통해 시각적 지식을 체계적으로 조합해 새로운 개념을 이해하는 인공지능 새로운 모델과 프로그램을 수행하는 벤치마크를 개발했다고 30일 밝혔다.

인간은 `보라색 포도'와 `노란 바나나' 같은 개념을 학습하고, 이를 분리한 뒤 재조합해 `노란 포도'나 `보라색 바나나'와 같이 본 적 없는 개념을 상상하는 능력이 있다. 이런 능력은 체계적 일반화 혹은 조합적 일반화라고 불리며, 범용 인공지능을 구현하는 데 있어 핵심적인 요소로 여겨진다.

체계적 일반화 문제는 1988년 미국의 저명한 인지과학자 제리 포더(Jerry Fodor)와 제논 필리쉰(Zenon Pylyshyn)이 인공신경망이 이 문제를 해결할 수 없다고 주장한 이후, 35년 동안 인공지능 딥러닝 분야에서 큰 도전 과제로 남아 있다. 이 문제는 언어뿐만 아니라 시각 정보에서도 발생하지만, 지금까지는 주로 언어의 체계적 일반화에만 초점이 맞춰져 있었고, 시각 정보에 관한 연구는 상대적으로 부족했다.

안성진 교수가 이끄는 국제 공동 연구팀은 이러한 공백을 메우고자 시각 정보에 대한 체계적 일반화를 연구할 수 있는 벤치마크를 개발했다. 시각 정보는 언어와는 달리 명확한 `단어'나 `토큰'의 구조가 없어, 이 구조를 학습하고 체계적 일반화를 달성하는 것이 큰 도전이다.

연구를 주도한 안성진 교수는 “시각 정보의 체계적 일반화가 범용 인공지능을 달성하기 위해 필수적인 능력이며 이 연구를 통해 인공지능의 추론능력과 상상능력 관련 분야의 발전을 가속할 것으로 기대한다”고 말했다.

또한, 딥마인드의 책임 연구원으로 연구에 참여한 연구원이자 현재 스위스 로잔연방공과대학교(EPFL)의 찰라 걸셔(Caglar Gulcehre) 교수는 “체계적 일반화가 가능해지면 현재보다 훨씬 적은 데이터로 더 높은 성능을 낼 수 있게 될 것이다”라고 전했다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Imagine the Unseen World: A Benchmark for Systematic Generalization in Visual World Models”, Yeongbin Kim, Gautam Singh, Junyeong Park, Caglar Gulcehre, Sungjin Ahn, NeurIPS 23

2023.11.30 조회수 7880

구글딥마인드와 공동연구를 통해 인공지능으로 시각을 상상하다

‘노란 포도'나 `보라색 바나나'와 같이 본 적 없는 시각 개념을 이해하고 상상하는 인공지능 능력 구현이 가능해졌다.

우리 대학 전산학부 안성진 교수 연구팀이 구글 딥마인드 및 미국 럿거스 대학교와의 국제 공동 연구를 통해 시각적 지식을 체계적으로 조합해 새로운 개념을 이해하는 인공지능 새로운 모델과 프로그램을 수행하는 벤치마크를 개발했다고 30일 밝혔다.

인간은 `보라색 포도'와 `노란 바나나' 같은 개념을 학습하고, 이를 분리한 뒤 재조합해 `노란 포도'나 `보라색 바나나'와 같이 본 적 없는 개념을 상상하는 능력이 있다. 이런 능력은 체계적 일반화 혹은 조합적 일반화라고 불리며, 범용 인공지능을 구현하는 데 있어 핵심적인 요소로 여겨진다.

체계적 일반화 문제는 1988년 미국의 저명한 인지과학자 제리 포더(Jerry Fodor)와 제논 필리쉰(Zenon Pylyshyn)이 인공신경망이 이 문제를 해결할 수 없다고 주장한 이후, 35년 동안 인공지능 딥러닝 분야에서 큰 도전 과제로 남아 있다. 이 문제는 언어뿐만 아니라 시각 정보에서도 발생하지만, 지금까지는 주로 언어의 체계적 일반화에만 초점이 맞춰져 있었고, 시각 정보에 관한 연구는 상대적으로 부족했다.

안성진 교수가 이끄는 국제 공동 연구팀은 이러한 공백을 메우고자 시각 정보에 대한 체계적 일반화를 연구할 수 있는 벤치마크를 개발했다. 시각 정보는 언어와는 달리 명확한 `단어'나 `토큰'의 구조가 없어, 이 구조를 학습하고 체계적 일반화를 달성하는 것이 큰 도전이다.

연구를 주도한 안성진 교수는 “시각 정보의 체계적 일반화가 범용 인공지능을 달성하기 위해 필수적인 능력이며 이 연구를 통해 인공지능의 추론능력과 상상능력 관련 분야의 발전을 가속할 것으로 기대한다”고 말했다.

또한, 딥마인드의 책임 연구원으로 연구에 참여한 연구원이자 현재 스위스 로잔연방공과대학교(EPFL)의 찰라 걸셔(Caglar Gulcehre) 교수는 “체계적 일반화가 가능해지면 현재보다 훨씬 적은 데이터로 더 높은 성능을 낼 수 있게 될 것이다”라고 전했다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Imagine the Unseen World: A Benchmark for Systematic Generalization in Visual World Models”, Yeongbin Kim, Gautam Singh, Junyeong Park, Caglar Gulcehre, Sungjin Ahn, NeurIPS 23

2023.11.30 조회수 7880 예종철 교수 연구팀, 삼성휴먼테크 논문대상 신호처리분야 금상 수상

우리 대학 김재철AI대학원 예종철 교수팀이 `확산모델 (diffusion model)의 사후 샘플링(posterior sampling)을 이용한 일반적인 역문제 해결 기법'으로 제 29회 삼성휴먼테크논문대상에서 신호처리 분야 금상을 수상했다고 밝혔다.

삼성휴먼테크논문대상은 과학기술 저변 확대와 과학 인재 양성을 위해 삼성전자가 1994년 제정한 논문상으로, 매년 2,000편 가량의 논문 중 서면 및 발표 심사를 거쳐 창의성, 논리성, 실용성, 발전성이 뛰어난 논문을 선정하여 수여되는 상이다.

바이오및뇌공학과 박사과정 졍형진, 김정솔 학생이 공동 1저자로 참여한 이 논문은, 확산 모델과 사후 샘플링을 결합하여 일반적인 역문제에 대한 새로운 관점과 해결방법을 제시하였고, 그 실용성과 독창성을 인정받아 대학부 신호처리 분야 수상작 7편 중 1위로 금상을 수상하였다.

역문제는 영상을 획득하는 과정에서 이미징 시스템의 특성과 잡음의 영향으로 망가진 측정값으로부터 실제 신호를 복원하는 문제로 정의된다. 이러한 문제는 영상 화질 개선부터 위상 복원을 통한 세포 구조 시각화와 같은 다양한 과학 분야에서 중요성과 실용성을 가지며, 수십 년간 지속적으로 연구되어 왔다. 과거의 인공지능 및 딥러닝 알고리즘은 이미징 시스템이 선형이며 잡음이 없는 경우를 가정하여 역문제를 효과적으로 해결하였으나, 이러한 가정은 현실 세계에서의 상황과 비교하여 훨씬 단순화된 형태였다.

이 연구에서는 처음으로 확산 모델을 이용해 사후 샘플링을 진행하는 방법으로 역문제를 해결하였는데, 이는 확산 모델이 생성하는 중간 이미지로 측정값을 근사하고, 실제 측정값과의 차이가 줄어들도록 중간 이미지를 보정하는 방식으로 구현된다.

이를 통해 이미징 시스템이 선형 및 비선형인 경우, 그리고 이미징 시스템에서 흔히 발생하는 가우시안 잡음과 푸아송 잡음이 존재하는 경우에 대한 일반적인 역문제 해결이 가능함을 입증하였다. 나아가 개발된 기술은 여러 종류의 역문제에 대한 개별적 학습을 필요로 하지 않는 특성을 가지며, 이는 논문의 실용성을 높이고, 이전의 연구들과 차별성을 지니게 한다.

정형진, 김정솔 바이오및뇌공학과 박사과정 학생은 “큰 규모의 논문대회에서 연구의 내용을 인정받아 기쁘고, 좋은 논문을 작성할 수 있도록 지도해주신 예종철 교수님께 감사하다” 고 소감을 밝혔다. 또한, 알고리즘의 성능과 효율성을 높이는 연구를 이어나가 역문제의 해결이 필요한 다양한 과학 분야들에 기여하고 싶다는 희망을 전했다.

논문명: Diffusion Posterior Sampling for General Noisy Inverse Problems

2023.11.07 조회수 5859

예종철 교수 연구팀, 삼성휴먼테크 논문대상 신호처리분야 금상 수상

우리 대학 김재철AI대학원 예종철 교수팀이 `확산모델 (diffusion model)의 사후 샘플링(posterior sampling)을 이용한 일반적인 역문제 해결 기법'으로 제 29회 삼성휴먼테크논문대상에서 신호처리 분야 금상을 수상했다고 밝혔다.

삼성휴먼테크논문대상은 과학기술 저변 확대와 과학 인재 양성을 위해 삼성전자가 1994년 제정한 논문상으로, 매년 2,000편 가량의 논문 중 서면 및 발표 심사를 거쳐 창의성, 논리성, 실용성, 발전성이 뛰어난 논문을 선정하여 수여되는 상이다.

바이오및뇌공학과 박사과정 졍형진, 김정솔 학생이 공동 1저자로 참여한 이 논문은, 확산 모델과 사후 샘플링을 결합하여 일반적인 역문제에 대한 새로운 관점과 해결방법을 제시하였고, 그 실용성과 독창성을 인정받아 대학부 신호처리 분야 수상작 7편 중 1위로 금상을 수상하였다.

역문제는 영상을 획득하는 과정에서 이미징 시스템의 특성과 잡음의 영향으로 망가진 측정값으로부터 실제 신호를 복원하는 문제로 정의된다. 이러한 문제는 영상 화질 개선부터 위상 복원을 통한 세포 구조 시각화와 같은 다양한 과학 분야에서 중요성과 실용성을 가지며, 수십 년간 지속적으로 연구되어 왔다. 과거의 인공지능 및 딥러닝 알고리즘은 이미징 시스템이 선형이며 잡음이 없는 경우를 가정하여 역문제를 효과적으로 해결하였으나, 이러한 가정은 현실 세계에서의 상황과 비교하여 훨씬 단순화된 형태였다.

이 연구에서는 처음으로 확산 모델을 이용해 사후 샘플링을 진행하는 방법으로 역문제를 해결하였는데, 이는 확산 모델이 생성하는 중간 이미지로 측정값을 근사하고, 실제 측정값과의 차이가 줄어들도록 중간 이미지를 보정하는 방식으로 구현된다.

이를 통해 이미징 시스템이 선형 및 비선형인 경우, 그리고 이미징 시스템에서 흔히 발생하는 가우시안 잡음과 푸아송 잡음이 존재하는 경우에 대한 일반적인 역문제 해결이 가능함을 입증하였다. 나아가 개발된 기술은 여러 종류의 역문제에 대한 개별적 학습을 필요로 하지 않는 특성을 가지며, 이는 논문의 실용성을 높이고, 이전의 연구들과 차별성을 지니게 한다.

정형진, 김정솔 바이오및뇌공학과 박사과정 학생은 “큰 규모의 논문대회에서 연구의 내용을 인정받아 기쁘고, 좋은 논문을 작성할 수 있도록 지도해주신 예종철 교수님께 감사하다” 고 소감을 밝혔다. 또한, 알고리즘의 성능과 효율성을 높이는 연구를 이어나가 역문제의 해결이 필요한 다양한 과학 분야들에 기여하고 싶다는 희망을 전했다.

논문명: Diffusion Posterior Sampling for General Noisy Inverse Problems

2023.11.07 조회수 5859 KAIST, 세계적 권위의 AI 학회에서 연구 역량 입증

우리 대학 연구진이 인공지능 분야에서 세계 최고의 권위를 자랑하는 신경정보처리시스템학회(이하, NeurIPS)에서 왕성한 연구 역량과 위상을 입증했다. NeurIPS는 산업계와 학계에서 최신 인공지능 연구를 발표하는 권위 있는 국제학회다. 우리 대학은 2020년에 20편, 2021년에 45편의 논문을 발표했고, 올해도 작년 수준과 비슷한 37편을 게재해 인공지능 분야에서의 왕성한 연구 능력을 학계에 선보였다. 특히, 예종철 김재철AI대학원 교수의 논문(Energy-Based Contrastive Learning of Visual Representations)이 상위 6%만을 선정하는 구두 발표 논문으로 선정되어 질적으로도 우수한 연구 수준을 인정받았다. 이뿐만이 아니라 지난달 28일부터 미국 루이지애나주 뉴올리언스에서 열린 NeurIPS 2022 학회에서 우리 대학 교수진과 동문이 눈에 띄게 활약했다. 오혜연 전산학부 교수(KAIST 인공지능연구원 부원장)와 조경현 동문(KAIST 전산학부 학사 졸업)은 학술위원장 (Program chair)을, 안성진 전산학부 교수는 워크숍위원장(Workshop chair)을 맡았다. 김주호 전산학부 교수는 기조 강연자로 초청되어 ‘인터렉션 센트릭 AI(Interaction-Centric AI)’를 주제로 발표했다. 오혜연 교수는 “다수의 KAIST 연구진이 국제학회 조직위원 및 기조 강연자로 선정되었다는 것은 인공지능 연구 분야에서 KAIST의 위상이 세계적으로 높아졌음을 시사한다”라고 설명했다.

2022.12.11 조회수 8841

KAIST, 세계적 권위의 AI 학회에서 연구 역량 입증

우리 대학 연구진이 인공지능 분야에서 세계 최고의 권위를 자랑하는 신경정보처리시스템학회(이하, NeurIPS)에서 왕성한 연구 역량과 위상을 입증했다. NeurIPS는 산업계와 학계에서 최신 인공지능 연구를 발표하는 권위 있는 국제학회다. 우리 대학은 2020년에 20편, 2021년에 45편의 논문을 발표했고, 올해도 작년 수준과 비슷한 37편을 게재해 인공지능 분야에서의 왕성한 연구 능력을 학계에 선보였다. 특히, 예종철 김재철AI대학원 교수의 논문(Energy-Based Contrastive Learning of Visual Representations)이 상위 6%만을 선정하는 구두 발표 논문으로 선정되어 질적으로도 우수한 연구 수준을 인정받았다. 이뿐만이 아니라 지난달 28일부터 미국 루이지애나주 뉴올리언스에서 열린 NeurIPS 2022 학회에서 우리 대학 교수진과 동문이 눈에 띄게 활약했다. 오혜연 전산학부 교수(KAIST 인공지능연구원 부원장)와 조경현 동문(KAIST 전산학부 학사 졸업)은 학술위원장 (Program chair)을, 안성진 전산학부 교수는 워크숍위원장(Workshop chair)을 맡았다. 김주호 전산학부 교수는 기조 강연자로 초청되어 ‘인터렉션 센트릭 AI(Interaction-Centric AI)’를 주제로 발표했다. 오혜연 교수는 “다수의 KAIST 연구진이 국제학회 조직위원 및 기조 강연자로 선정되었다는 것은 인공지능 연구 분야에서 KAIST의 위상이 세계적으로 높아졌음을 시사한다”라고 설명했다.

2022.12.11 조회수 8841 세계 최초로 사람처럼 사물의 개념을 스스로 학습하는 장면 인식 기술 개발

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스(Rutgers) 대학교와 공동연구를 통해 사람의 라벨링 없이 스스로 영상 속 객체를 식별할 수 있는 인공지능 기술을 개발했다고 1일 밝혔다. 이 모델은 복잡한 영상에서 각 장면의 객체들에 대한 명시적인 라벨링 없이도 객체를 식별하는 최초의 인공지능 모델이다.

기계가 주변 환경을 지능적으로 인지하고 추론하기 위해서는 시각적 장면을 구성하는 객체들과 그들의 관계를 파악하는 능력이 필수적이다. 하지만 이 분야의 연구는 대부분 영상의 각 픽셀에 대응하는 객체의 라벨을 사람이 일일이 표시해야 하는 지도적 학습 방식을 사용했다. 이 같은 수작업은 오류가 발생하기 쉽고 많은 시간과 비용을 요구한다는 단점이 있다.

이에 반해 이번에 연구팀이 개발한 기술은 인간과 유사하게 환경에 대한 관측만으로 객체의 개념을 스스로 자가 학습하는 방식을 취한다. 이렇게 인간의 지도 없이 스스로 객체의 개념을 학습할 수 있는 인공지능은 차세대 인지 기술의 핵심으로 기대돼왔다.

비지도 학습을 이용한 이전 연구들은 단순한 객체 형태와 배경이 명확히 구분될 수 있는 단순한 장면에서만 객체를 식별하는 단점이 있었다. 이와 달리 이번에 안성진 교수 연구팀이 개발한 기술은 복잡한 형태의 많은 객체가 존재하는 사실적인 장면에도 적용될 수 있는 최초의 모델이다.

이 연구는 그림 인공지능 소프트웨어인 DALL-E와 같이 텍스트 입력을 통해 사실적인 이미지를 생성할 수 있는 이미지 생성 연구에서 영감을 얻었다. 연구팀은 텍스트를 입력하는 대신, 모델이 장면에서 객체를 감지하고 그 객체의 표상(representation)으로부터 이미지를 생성하는 방식으로 모델을 학습시켰다. 또한, 모델에 DALL-E와 유사한 트랜스포머 디코더를 사용하는 것이 사실적이고 복잡한 영상을 처리할 수 있게 한 주요 요인이라고 밝혔다.

연구팀은 복잡하고 정제되지 않은 영상뿐만 아니라, 많은 물고기가 있는 수족관과 교통이 혼잡한 도로의 상황을 담은 유튜브 영상과 같이 복잡한 실제 영상에서도 모델의 성능을 측정했다. 그 결과, 제시된 모델이 기존 모델보다 객체를 훨씬 더 정확하게 분할하고 일반화하는 것을 확인할 수 있었다.

연구팀을 이끈 안성진 교수는 "인간과 유사한 자가 학습 방식으로 상황을 인지하고 해석하는 혁신적인 기술ˮ이라며 "시각적 상황인지 능력을 획기적으로 개선해 지능형 로봇 분야, 자율 주행 분야뿐만 아니라 시각적 인공지능 기술 전반에 비용 절감과 성능향상을 가져올 수 있다ˮ고 말했다.

이번 연구는 미국 뉴올리언스에서 지난 11월 28일부터 개최되어 12월 9일까지 진행 예정인 세계 최고 수준의 기계학습(머신러닝) 학회인 제36회 신경정보처리학회(NeurIPS)에서 발표됐다.

2022.12.02 조회수 8699

세계 최초로 사람처럼 사물의 개념을 스스로 학습하는 장면 인식 기술 개발

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스(Rutgers) 대학교와 공동연구를 통해 사람의 라벨링 없이 스스로 영상 속 객체를 식별할 수 있는 인공지능 기술을 개발했다고 1일 밝혔다. 이 모델은 복잡한 영상에서 각 장면의 객체들에 대한 명시적인 라벨링 없이도 객체를 식별하는 최초의 인공지능 모델이다.

기계가 주변 환경을 지능적으로 인지하고 추론하기 위해서는 시각적 장면을 구성하는 객체들과 그들의 관계를 파악하는 능력이 필수적이다. 하지만 이 분야의 연구는 대부분 영상의 각 픽셀에 대응하는 객체의 라벨을 사람이 일일이 표시해야 하는 지도적 학습 방식을 사용했다. 이 같은 수작업은 오류가 발생하기 쉽고 많은 시간과 비용을 요구한다는 단점이 있다.

이에 반해 이번에 연구팀이 개발한 기술은 인간과 유사하게 환경에 대한 관측만으로 객체의 개념을 스스로 자가 학습하는 방식을 취한다. 이렇게 인간의 지도 없이 스스로 객체의 개념을 학습할 수 있는 인공지능은 차세대 인지 기술의 핵심으로 기대돼왔다.

비지도 학습을 이용한 이전 연구들은 단순한 객체 형태와 배경이 명확히 구분될 수 있는 단순한 장면에서만 객체를 식별하는 단점이 있었다. 이와 달리 이번에 안성진 교수 연구팀이 개발한 기술은 복잡한 형태의 많은 객체가 존재하는 사실적인 장면에도 적용될 수 있는 최초의 모델이다.

이 연구는 그림 인공지능 소프트웨어인 DALL-E와 같이 텍스트 입력을 통해 사실적인 이미지를 생성할 수 있는 이미지 생성 연구에서 영감을 얻었다. 연구팀은 텍스트를 입력하는 대신, 모델이 장면에서 객체를 감지하고 그 객체의 표상(representation)으로부터 이미지를 생성하는 방식으로 모델을 학습시켰다. 또한, 모델에 DALL-E와 유사한 트랜스포머 디코더를 사용하는 것이 사실적이고 복잡한 영상을 처리할 수 있게 한 주요 요인이라고 밝혔다.

연구팀은 복잡하고 정제되지 않은 영상뿐만 아니라, 많은 물고기가 있는 수족관과 교통이 혼잡한 도로의 상황을 담은 유튜브 영상과 같이 복잡한 실제 영상에서도 모델의 성능을 측정했다. 그 결과, 제시된 모델이 기존 모델보다 객체를 훨씬 더 정확하게 분할하고 일반화하는 것을 확인할 수 있었다.

연구팀을 이끈 안성진 교수는 "인간과 유사한 자가 학습 방식으로 상황을 인지하고 해석하는 혁신적인 기술ˮ이라며 "시각적 상황인지 능력을 획기적으로 개선해 지능형 로봇 분야, 자율 주행 분야뿐만 아니라 시각적 인공지능 기술 전반에 비용 절감과 성능향상을 가져올 수 있다ˮ고 말했다.

이번 연구는 미국 뉴올리언스에서 지난 11월 28일부터 개최되어 12월 9일까지 진행 예정인 세계 최고 수준의 기계학습(머신러닝) 학회인 제36회 신경정보처리학회(NeurIPS)에서 발표됐다.

2022.12.02 조회수 8699 이성주, 신진우 교수팀, 스스로 새로운 환경 적응하는 인공지능 기술 개발

우리 대학 전기및전자공학부 이성주 교수와 AI대학원 신진우 교수 연구팀이 공동연구를 통해 스스로 환경변화에 적응하는 테스트타임 적응 인공지능 기술을 개발했다고 밝혔다.

해당 연구는 “NOTE: Robust Continual Test-time Adaptation Against Temporal Correlation”라는 제목으로 인공지능 분야 최고권위 국제학술대회 ‘신경정보처리시스템학회(NeurIPS) 2022'에서12월 발표될 예정이다.

이성주 교수와 신진우 교수 공동 연구팀이 스스로 새로운 환경에 적응하는 “테스트타임 적응 (Test-Time Adaptation)” 인공지능 기술을 개발하였다. 연구팀이 제안한 알고리즘은 기존의 최고 성능 알고리즘보다 평균 11% 향상된 정확도를 보였다.

기계학습 모델들의 한계점은 학습했던 데이터와 다른 분포의 데이터에 적용되면 성능이 급격히 하락한다는 것이다. 이를 푸는 여러 방법 중에서 데이터를 미리 수집할 필요없이 모델이 스스로 테스트 데이터를 분석하여 변하는 환경에 적응하고 성능을 향상시키는 기술인 테스트타임 도메인 적응 (Test-Time Adaptation) 방법이 최근 산학계에서 크게 각광을 받고 있었다.

연구팀은 기존의 테스트타임 도메인 적응 기술들이 모두 데이터가 이상적인 균일분포를 따른다는 가정을 한다는 문제점에 착안했다. 실제 데이터는 환경 변화나 시간 변화에 따라 데이터 분포가 변하거나 비균일분포의 데이터에 대해서는 기존 기술을 동작하지 않는다. 하지만 연구팀이 제시한 “NOTE” 기술은 비균일분포의 데이터에서도 기존 최대 성능 알고리즘 보다 평균 11%만큼 향상된 정확도를 보였다.

이성주 교수 연구팀과 신진우 교수 연구팀의 공동연구로, 공태식 박사과정이 제1저자로 연구를 이끌었고, 정종헌 박사과정, 김태원 학사과정, 김예원 석사과정이 공동 저자로 기여하였다.

이성주 교수와 신진우 교수는 ”테스트타임 도메인 적응은 인공지능이 스스로 환경 변화에 적응하여 성능을 향상시키는 기술로, 활용도가 무궁무진하다. 이번에 발표될 NOTE 기술은 실제 데이터 분포에서 성능향상을 보인 최초의 기술이고 자율주행, 인공지능 의료, 모바일 헬스케어 등 다양한 분야에 적용이 가능할 것으로 기대된다.” 라고 밝혔다.

이 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원 (No. NRF-2020R1A2C1004062)과 방위사업청과 국방과학연구소의 지원(UD190031RD)으로 한국과학기술원 미래 국방 인공지능 특화연구센터에서 수행된 연구이다.

2022.10.21 조회수 10672

이성주, 신진우 교수팀, 스스로 새로운 환경 적응하는 인공지능 기술 개발

우리 대학 전기및전자공학부 이성주 교수와 AI대학원 신진우 교수 연구팀이 공동연구를 통해 스스로 환경변화에 적응하는 테스트타임 적응 인공지능 기술을 개발했다고 밝혔다.

해당 연구는 “NOTE: Robust Continual Test-time Adaptation Against Temporal Correlation”라는 제목으로 인공지능 분야 최고권위 국제학술대회 ‘신경정보처리시스템학회(NeurIPS) 2022'에서12월 발표될 예정이다.

이성주 교수와 신진우 교수 공동 연구팀이 스스로 새로운 환경에 적응하는 “테스트타임 적응 (Test-Time Adaptation)” 인공지능 기술을 개발하였다. 연구팀이 제안한 알고리즘은 기존의 최고 성능 알고리즘보다 평균 11% 향상된 정확도를 보였다.

기계학습 모델들의 한계점은 학습했던 데이터와 다른 분포의 데이터에 적용되면 성능이 급격히 하락한다는 것이다. 이를 푸는 여러 방법 중에서 데이터를 미리 수집할 필요없이 모델이 스스로 테스트 데이터를 분석하여 변하는 환경에 적응하고 성능을 향상시키는 기술인 테스트타임 도메인 적응 (Test-Time Adaptation) 방법이 최근 산학계에서 크게 각광을 받고 있었다.

연구팀은 기존의 테스트타임 도메인 적응 기술들이 모두 데이터가 이상적인 균일분포를 따른다는 가정을 한다는 문제점에 착안했다. 실제 데이터는 환경 변화나 시간 변화에 따라 데이터 분포가 변하거나 비균일분포의 데이터에 대해서는 기존 기술을 동작하지 않는다. 하지만 연구팀이 제시한 “NOTE” 기술은 비균일분포의 데이터에서도 기존 최대 성능 알고리즘 보다 평균 11%만큼 향상된 정확도를 보였다.

이성주 교수 연구팀과 신진우 교수 연구팀의 공동연구로, 공태식 박사과정이 제1저자로 연구를 이끌었고, 정종헌 박사과정, 김태원 학사과정, 김예원 석사과정이 공동 저자로 기여하였다.

이성주 교수와 신진우 교수는 ”테스트타임 도메인 적응은 인공지능이 스스로 환경 변화에 적응하여 성능을 향상시키는 기술로, 활용도가 무궁무진하다. 이번에 발표될 NOTE 기술은 실제 데이터 분포에서 성능향상을 보인 최초의 기술이고 자율주행, 인공지능 의료, 모바일 헬스케어 등 다양한 분야에 적용이 가능할 것으로 기대된다.” 라고 밝혔다.

이 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원 (No. NRF-2020R1A2C1004062)과 방위사업청과 국방과학연구소의 지원(UD190031RD)으로 한국과학기술원 미래 국방 인공지능 특화연구센터에서 수행된 연구이다.

2022.10.21 조회수 10672 세계 최초 그래프 기반 인공지능 추론 가능한 SSD 개발

우리 대학 전기및전자공학부 정명수 교수 연구팀(컴퓨터 아키텍처 및 메모리 시스템 연구실)이 세계 최초로 그래프 기계학습 추론의 그래프처리, 그래프 샘플링 그리고 신경망 가속을 스토리지/SSD 장치 근처에서 수행하는 `전체론적 그래프 기반 신경망 기계학습 기술(이하 홀리스틱 GNN)'을 개발하는데 성공했다고 10일 밝혔다.

연구팀은 자체 제작한 프로그래밍 가능 반도체(FPGA)를 동반한 새로운 형태의 계산형 스토리지/SSD 시스템에 기계학습 전용 신경망 가속 하드웨어와 그래프 전용 처리 컨트롤러/소프트웨어를 시제작했다. 이는 이상적 상황에서 최신 고성능 엔비디아 GPU를 이용한 기계학습 가속 컴퓨팅 대비 7배의 속도 향상과 33배의 에너지 절약을 가져올 수 있다고 밝혔다.

그래프 자료구조가 적용된 새로운 기계학습 모델은 기존 신경망 기반 기계학습 기법들과 달리, 데이터 사이의 연관 관계를 표현할 수 있어 페이스북, 구글, 링크드인, 우버 등, 대규모 소셜 네트워크 서비스(SNS)부터, 내비게이션, 신약개발 등 광범위한 분야와 응용에서 사용된다. 예를 들면 그래프 구조로 저장된 사용자 네트워크를 분석하는 경우 일반적인 기계학습으로는 불가능했던 현실적인 상품 및 아이템 추천, 사람이 추론한 것 같은 친구 추천 등이 가능하다. 이러한 신흥 그래프 기반 신경망 기계학습은 그간 GPU와 같은 일반 기계학습의 가속 시스템을 재이용해 연산 되어왔는데, 이는 그래프 데이터를 스토리지로부터 메모리로 적재하고 샘플링하는 등의 데이터 전처리 과정에서 심각한 성능 병목현상과 함께 장치 메모리 부족 현상으로 실제 시스템 적용에 한계를 보여 왔다.

정명수 교수 연구팀이 개발한 홀리스틱 GNN 기술은 그래프 데이터 자체가 저장된 스토리지 근처에서 사용자 요청에 따른 추론의 모든 과정을 직접 가속한다. 구체적으로는 프로그래밍 가능한 반도체를 스토리지 근처에 배치한 새로운 계산형 스토리지(Computational SSD) 구조를 활용해 대규모 그래프 데이터의 이동을 제거하고 데이터 근처(Near Storage)에서 그래프처리 및 그래프 샘플링 등을 가속해 그래프 기계학습 전처리 과정에서의 병목현상을 해결했다.

일반적인 계산형 스토리지는 장치 내 고정된 펌웨어와 하드웨어 구성을 통해서 데이터를 처리해야 했기 때문에 그 사용에 제한이 있었다. 그래프처리 및 그래프샘플링 외에도, 연구팀의 홀리스틱 GNN 기술은 인공지능 추론 가속에 필요한 다양한 하드웨어 구조, 그리고 소프트웨어를 후원할 수 있도록 다수 그래프 기계학습 모델을 프로그래밍할 수 있는 장치수준의 소프트웨어와 사용자가 자유롭게 변경할 수 있는 신경망 가속 하드웨어 프레임워크 구조를 제공한다.

연구팀은 홀리스틱 GNN 기술의 실효성을 검증하기 위해 계산형 스토리지의 프로토타입을 자체 제작한 후, 그 위에 개발된 그래프 기계학습용 하드웨어 *RTL과 소프트웨어 프레임워크를 구현해 탑재했다. 그래프 기계학습 추론 성능을 제작된 계산형 스토리지 가속기 프로토타입과 최신 고성능 엔비디아 GPU 가속 시스템(RTX 3090)에서 평가한 결과, 홀리스틱 GNN 기술이 이상적인 상황에서 기존 엔비디아 GPU를 이용해 그래프 기계학습을 가속하는 시스템의 경우에 비해 평균 7배 빠르고 33배 에너지를 감소시킴을 확인했다. 특히, 그래프 규모가 점차 커질수록 전처리 병목현상 완화 효과가 증가해 기존 GPU 대비 최대 201배 향상된 속도와 453배 에너지를 감소할 수 있었다.

☞ RTL (Registor Transistor Logic): 저항과 트랜지스터로 구성한 컴퓨터에 사용되는 회로

정명수 교수는 "대규모 그래프에 대해 스토리지 근처에서 그래프 기계학습을 고속으로 추론할 뿐만 아니라 에너지 절약에 최적화된 계산형 스토리지 가속 시스템을 확보했다ˮ며 "기존 고성능 가속 시스템을 대체해 초대형 추천시스템, 교통 예측 시스템, 신약 개발 등의 광범위한 실제 응용에 적용될 수 있을 것ˮ이라고 말했다.

한편 이번 연구는 미국 산호세에서 오는 2월에 열릴 스토리지 시스템 분야 최우수 학술대회인 `유즈닉스 패스트(USENIX Conference on File and Storage Technologies, FAST), 2022'에 관련 논문(논문명: Hardware/Software Co-Programmable Framework for Computational SSDs to Accelerate Deep Learning Service on Large-Scale Graphs)으로 발표될 예정이다.

해당 연구는 삼성미래기술육성사업 지원을 받아 진행됐고 자세한 내용은 연구실 웹사이트(http://camelab.org)에서 확인할 수 있다.

2022.01.10 조회수 11224

세계 최초 그래프 기반 인공지능 추론 가능한 SSD 개발

우리 대학 전기및전자공학부 정명수 교수 연구팀(컴퓨터 아키텍처 및 메모리 시스템 연구실)이 세계 최초로 그래프 기계학습 추론의 그래프처리, 그래프 샘플링 그리고 신경망 가속을 스토리지/SSD 장치 근처에서 수행하는 `전체론적 그래프 기반 신경망 기계학습 기술(이하 홀리스틱 GNN)'을 개발하는데 성공했다고 10일 밝혔다.

연구팀은 자체 제작한 프로그래밍 가능 반도체(FPGA)를 동반한 새로운 형태의 계산형 스토리지/SSD 시스템에 기계학습 전용 신경망 가속 하드웨어와 그래프 전용 처리 컨트롤러/소프트웨어를 시제작했다. 이는 이상적 상황에서 최신 고성능 엔비디아 GPU를 이용한 기계학습 가속 컴퓨팅 대비 7배의 속도 향상과 33배의 에너지 절약을 가져올 수 있다고 밝혔다.

그래프 자료구조가 적용된 새로운 기계학습 모델은 기존 신경망 기반 기계학습 기법들과 달리, 데이터 사이의 연관 관계를 표현할 수 있어 페이스북, 구글, 링크드인, 우버 등, 대규모 소셜 네트워크 서비스(SNS)부터, 내비게이션, 신약개발 등 광범위한 분야와 응용에서 사용된다. 예를 들면 그래프 구조로 저장된 사용자 네트워크를 분석하는 경우 일반적인 기계학습으로는 불가능했던 현실적인 상품 및 아이템 추천, 사람이 추론한 것 같은 친구 추천 등이 가능하다. 이러한 신흥 그래프 기반 신경망 기계학습은 그간 GPU와 같은 일반 기계학습의 가속 시스템을 재이용해 연산 되어왔는데, 이는 그래프 데이터를 스토리지로부터 메모리로 적재하고 샘플링하는 등의 데이터 전처리 과정에서 심각한 성능 병목현상과 함께 장치 메모리 부족 현상으로 실제 시스템 적용에 한계를 보여 왔다.

정명수 교수 연구팀이 개발한 홀리스틱 GNN 기술은 그래프 데이터 자체가 저장된 스토리지 근처에서 사용자 요청에 따른 추론의 모든 과정을 직접 가속한다. 구체적으로는 프로그래밍 가능한 반도체를 스토리지 근처에 배치한 새로운 계산형 스토리지(Computational SSD) 구조를 활용해 대규모 그래프 데이터의 이동을 제거하고 데이터 근처(Near Storage)에서 그래프처리 및 그래프 샘플링 등을 가속해 그래프 기계학습 전처리 과정에서의 병목현상을 해결했다.

일반적인 계산형 스토리지는 장치 내 고정된 펌웨어와 하드웨어 구성을 통해서 데이터를 처리해야 했기 때문에 그 사용에 제한이 있었다. 그래프처리 및 그래프샘플링 외에도, 연구팀의 홀리스틱 GNN 기술은 인공지능 추론 가속에 필요한 다양한 하드웨어 구조, 그리고 소프트웨어를 후원할 수 있도록 다수 그래프 기계학습 모델을 프로그래밍할 수 있는 장치수준의 소프트웨어와 사용자가 자유롭게 변경할 수 있는 신경망 가속 하드웨어 프레임워크 구조를 제공한다.

연구팀은 홀리스틱 GNN 기술의 실효성을 검증하기 위해 계산형 스토리지의 프로토타입을 자체 제작한 후, 그 위에 개발된 그래프 기계학습용 하드웨어 *RTL과 소프트웨어 프레임워크를 구현해 탑재했다. 그래프 기계학습 추론 성능을 제작된 계산형 스토리지 가속기 프로토타입과 최신 고성능 엔비디아 GPU 가속 시스템(RTX 3090)에서 평가한 결과, 홀리스틱 GNN 기술이 이상적인 상황에서 기존 엔비디아 GPU를 이용해 그래프 기계학습을 가속하는 시스템의 경우에 비해 평균 7배 빠르고 33배 에너지를 감소시킴을 확인했다. 특히, 그래프 규모가 점차 커질수록 전처리 병목현상 완화 효과가 증가해 기존 GPU 대비 최대 201배 향상된 속도와 453배 에너지를 감소할 수 있었다.

☞ RTL (Registor Transistor Logic): 저항과 트랜지스터로 구성한 컴퓨터에 사용되는 회로

정명수 교수는 "대규모 그래프에 대해 스토리지 근처에서 그래프 기계학습을 고속으로 추론할 뿐만 아니라 에너지 절약에 최적화된 계산형 스토리지 가속 시스템을 확보했다ˮ며 "기존 고성능 가속 시스템을 대체해 초대형 추천시스템, 교통 예측 시스템, 신약 개발 등의 광범위한 실제 응용에 적용될 수 있을 것ˮ이라고 말했다.

한편 이번 연구는 미국 산호세에서 오는 2월에 열릴 스토리지 시스템 분야 최우수 학술대회인 `유즈닉스 패스트(USENIX Conference on File and Storage Technologies, FAST), 2022'에 관련 논문(논문명: Hardware/Software Co-Programmable Framework for Computational SSDs to Accelerate Deep Learning Service on Large-Scale Graphs)으로 발표될 예정이다.

해당 연구는 삼성미래기술육성사업 지원을 받아 진행됐고 자세한 내용은 연구실 웹사이트(http://camelab.org)에서 확인할 수 있다.

2022.01.10 조회수 11224 소량의 데이터로 딥러닝 정확도 향상기술 발표

최근 다양한 분야에서 심층 학습(딥러닝) 기술을 활용한 서비스가 급속히 증가하고 있다. 서비스 구축을 위해서는 심층 학습 모델을 훈련해야 하며, 이를 위해서는 충분한 훈련 데이터를 준비해야 한다. 특히 훈련 데이터에 정답지를 만드는 레이블링(labeling) 과정이 필요한데 (예를 들어, 낙타 사진에 `낙타'라고 정답을 적어줌), 이 과정은 일반적으로 수작업으로 진행되므로 엄청난 노동력과 시간이 소요된다. 따라서 훈련 데이터가 충분하지 않은 상황을 효과적으로 타개하는 방법이 요구되고 있다.

우리 대학 전산학부 이재길 교수 연구팀이 적은 양의 훈련 데이터가 존재할 때도 높은 예측 정확도를 달성할 수 있는 새로운 모델 훈련 기술을 개발했다고 27일 밝혔다.

심층 학습 모델의 훈련은 주어진 훈련 데이터에서 레이블과 관련성이 높은 특성을 찾아내는 과정으로 볼 수 있다. 예를 들어, `낙타'의 주요 특성이 등에 있는 `혹'이라는 것을 알아내는 것이다. 그런데 훈련 데이터가 불충분할 경우 바람직하지 않은 특성까지도 같이 추출될 수 있는 문제가 발생한다. 예를 들어, 낙타 사진의 배경으로 종종 사막이 등장하기에 낙타에 대한 특성으로 `사막'이 추출되는 것도 가능하다. 사막은 낙타의 고유한 특성이 아닐뿐더러, 이러한 바람직하지 않은 특성으로 인해 사막이 아닌 곳(예: 동물원)에 있는 낙타는 인식하지 못할 수 있다.

이 교수팀이 개발한 기술은 심층 학습 모델의 훈련에서 바람직하지 않은 특성을 억제해 충분하지 않은 훈련 데이터를 가지고도 높은 예측 정확도를 달성할 수 있게 해준다.

우리 대학 지식서비스공학대학원에 재학 중인 박동민 박사과정 학생이 제1 저자, 송환준 박사, 김민석 박사과정 학생이 제2, 제3 저자로 각각 참여한 이번 연구는 최고권위 국제학술대회 `신경정보처리시스템학회(NeurIPS) 2021'에서 올 12월 발표될 예정이다. (논문명 : Task-Agnostic Undesirable Feature Deactivation Using Out-of-Distribution Data)

바람직하지 않은 특성을 억제하기 위해서 분포 外(out-of-distribution) 데이터를 활용한다. 예를 들어, 낙타와 호랑이 사진의 분류를 위한 훈련 데이터에 대해 여우 사진은 분포 외 데이터가 된다. 이때 이 교수팀이 착안한 점은 훈련 데이터에 존재하는 바람직하지 않은 특성은 분포 외 데이터에도 존재할 수 있다는 점이다.

즉, 위의 예에서 여우 사진의 배경으로도 사막이 나올 수 있다. 따라서 다량의 분포 외 데이터를 추가로 활용해 여기에서 추출된 특성은 영(0) 벡터가 되도록 심층 학습 모델의 훈련 과정을 규제해 바람직하지 않은 특성의 효과를 억제한다. 훈련 과정을 규제한다는 측면에서 정규화 방법론의 일종이라 볼 수 있다. 분포 외 데이터는 쓸모없는 것이라 여겨지고 있었으나, 이번 기술에 의해 훈련 데이터 부족을 해소할 수 있는 유용한 보완재로 탈바꿈될 수 있다.

연구팀은 이 정규화 방법론을 `비선호(比選好) 특성 억제'라고 이름 붙이고 이미지 데이터 분석의 세 가지 주요 문제에 적용했다. 그 결과, 기존 최신 방법론과 비교했을 때, 이미지 분류 문제에서 최대 12% 예측 정확도를 향상했고, 객체 검출 문제에서 최대 3% 예측 정확도를 향상했으며, 객체 지역화 문제에서 최대 8% 예측 정확도를 향상했다.

제1 저자인 박동민 박사과정 학생은 "이번 기술은 훈련 데이터 부족 현상을 해결할 수 있는 새로운 방법ˮ 이라면서 "분류, 회귀 분석을 비롯한 다양한 기계 학습 문제에 폭넓게 적용될 수 있어, 심층 학습의 전반적인 성능 개선에 기여할 수 있다ˮ 고 밝혔다.

연구팀을 지도한 이재길 교수도 "이 기술이 텐서플로우(TensorFlow) 혹은 파이토치(PyTorch)와 같은 기존의 심층 학습 라이브러리에 추가되면 기계 학습 및 심층 학습 학계에 큰 파급효과를 낼 수 있을 것이다ˮ고 말했다.

한편, 이 기술은 과학기술정보통신부 재원으로 정보통신기획평가원의 지원을 받아 SW컴퓨팅산업원천기술개발사업 SW스타랩 과제로 개발한 연구성과 결과물(2020-0-00862, DB4DL: 딥러닝 지원 고사용성 및 고성능 분산 인메모리 DBMS 개발)이다. (끝).

2021.10.27 조회수 12802

소량의 데이터로 딥러닝 정확도 향상기술 발표

최근 다양한 분야에서 심층 학습(딥러닝) 기술을 활용한 서비스가 급속히 증가하고 있다. 서비스 구축을 위해서는 심층 학습 모델을 훈련해야 하며, 이를 위해서는 충분한 훈련 데이터를 준비해야 한다. 특히 훈련 데이터에 정답지를 만드는 레이블링(labeling) 과정이 필요한데 (예를 들어, 낙타 사진에 `낙타'라고 정답을 적어줌), 이 과정은 일반적으로 수작업으로 진행되므로 엄청난 노동력과 시간이 소요된다. 따라서 훈련 데이터가 충분하지 않은 상황을 효과적으로 타개하는 방법이 요구되고 있다.

우리 대학 전산학부 이재길 교수 연구팀이 적은 양의 훈련 데이터가 존재할 때도 높은 예측 정확도를 달성할 수 있는 새로운 모델 훈련 기술을 개발했다고 27일 밝혔다.

심층 학습 모델의 훈련은 주어진 훈련 데이터에서 레이블과 관련성이 높은 특성을 찾아내는 과정으로 볼 수 있다. 예를 들어, `낙타'의 주요 특성이 등에 있는 `혹'이라는 것을 알아내는 것이다. 그런데 훈련 데이터가 불충분할 경우 바람직하지 않은 특성까지도 같이 추출될 수 있는 문제가 발생한다. 예를 들어, 낙타 사진의 배경으로 종종 사막이 등장하기에 낙타에 대한 특성으로 `사막'이 추출되는 것도 가능하다. 사막은 낙타의 고유한 특성이 아닐뿐더러, 이러한 바람직하지 않은 특성으로 인해 사막이 아닌 곳(예: 동물원)에 있는 낙타는 인식하지 못할 수 있다.

이 교수팀이 개발한 기술은 심층 학습 모델의 훈련에서 바람직하지 않은 특성을 억제해 충분하지 않은 훈련 데이터를 가지고도 높은 예측 정확도를 달성할 수 있게 해준다.

우리 대학 지식서비스공학대학원에 재학 중인 박동민 박사과정 학생이 제1 저자, 송환준 박사, 김민석 박사과정 학생이 제2, 제3 저자로 각각 참여한 이번 연구는 최고권위 국제학술대회 `신경정보처리시스템학회(NeurIPS) 2021'에서 올 12월 발표될 예정이다. (논문명 : Task-Agnostic Undesirable Feature Deactivation Using Out-of-Distribution Data)

바람직하지 않은 특성을 억제하기 위해서 분포 外(out-of-distribution) 데이터를 활용한다. 예를 들어, 낙타와 호랑이 사진의 분류를 위한 훈련 데이터에 대해 여우 사진은 분포 외 데이터가 된다. 이때 이 교수팀이 착안한 점은 훈련 데이터에 존재하는 바람직하지 않은 특성은 분포 외 데이터에도 존재할 수 있다는 점이다.