%EC%9D%B8%EA%B3%B5%EC%A7%80%EB%8A%A5+%EB%B0%98%EB%8F%84%EC%B2%B4

-

유회준 교수, ISSCC 반도체 설계 최고 권위자로 선정

국제고체회로학회(International Solid-State Circuits Conference, 이하 ISSCC)는 세계 반도체올림픽이라고 불리며 70주년 기념식을 올해 2월 20일 미국 샌프란시스코 메리어트 호텔에서 개최했다.

우리 대학 전기및전자공학부 유회준 교수가 63편의 논문을 발표한 실적으로 동양인으로서 유일하게 톱5에 들어 최다 논문 발표자로 선정되었다고 1일 밝혔다.

유 교수는 ISSCC의 설립 41년이 지난 1995년에 현대전자(現 SK하이닉스)에서 세계 최초로 256M SDRAM을 개발한 뒤 이를 동 학회에서 한국 최초 논문을 발표한 바 있다. 이후 유 교수 연구팀은 KAIST로 옮겨 2000년부터 2023년까지 62편의 논문을 발표하여 동 학회에서 총 63편의 논문을 발표했다.

1996년에 유 교수가 집필한 `DRAM의 설계'라는 책은 삼성전자나 하이닉스 기술자들의 필독서로 활용됐다. 또한, 동 학회에서 DRAM 관련 반도체에 대해 5편, 바이오메디컬용 반도체 및 저전력 무선 통신용 칩에 대해 총 26편, 증강현실(AR)용 웨어러블 반도체에 대해 총 14편 발표했다. 특히 2008년부터 인공지능 반도체를 연구하기 시작해 2014년 세계 최초로 DNN 가속기를 발표하는 등 올해까지 총 18 편의 인공지능(이하 AI) 반도체 관련 연구 결과를 동 학회에서 발표했다. 아울러, 아시아 교수로는 최초로 2019년 AI 반도체에 관련한 ISSCC 기조강연자로 초청되기도 하였다.

올해는 특히 트랜지스터의 발명 75주년이기도 한데 이를 기념하기 위해 국제전기전자공학회 (IEEE) 전자소자학회/고체회로학회 (EDS/SSCS) 에서 10인의 대표강연자를 선정하여 세계 순회 강연을 계획 중에 있으며 이 중 1인으로 유 교수가 선정됐다. 또한 올해는 모든 반도체 제조에 이용되는 모스펫(이하 MOSFET)발명 60주년이기도 한데 MOSFET의 발명자인 강대원 박사를 기리는 강대원 상을 올해 2월 14일에 한국반도체 학술대회에서 수상하기도 했다.

올해 ISSCC 학회에서는 DRAM을 이용한 지능형 반도체(이하 PIM 반도체)인 다이나플라지아(DynaPlasia), 뉴로모픽 반도체인 스파이크 인공신경망(SNN, Spike Neural Network)과 기존의 합성곱 인공신경망(CNN, Convolutional Neural Network)을 결합해 저전력으로 동작하는 상보 심층신경망(C-DNN), 그리고 3차원 영상 제작 및 가속의 혁명을 가져올 NeRF(Neural Radiance Fields) 가속 칩을 세계 최초로 개발해 총 3편의 혁신적인 새로운 연구 방향을 제시하는 논문들을 발표하여 매우 우수하다는 평가를 받았다.

유 교수의 연구 결과에 대해 일본 동경대 전자공학과 학과장인 타케우치 교수는 "항상 새로운 방향을 제시하는 연구를 발표하는 것이 존경스럽다"고 했으며 미국 MIT 공대 학장인 아난싸 찬드라카산 교수는 "끊임없이 좋은 연구 결과를 내는 그 비결을 알고 싶다"며 찬사를 보내고 있다.

유 교수의 연구 결과는 삼성전자에 기술이전 되기도 했고, 특히 5개의 국내 대표 AI 반도체 벤처 창업들이 있다. 이중 `리벨리온'은 최근 챗GPT용 가속 인공지능 칩인 아톰칩(ATOM)을 개발해 KT와 함께 상용화를 하고 있으며 `모빌린트'는 자동차용 인공지능 칩을 개발하여 2023년 CES에서 선보이기도 했다.

유회준 교수는 2022년 6월에 과기정통부의 지원으로 PIM반도체 설계연구센터(AI-PIM)을 KAIST에 설립해 한국의 PIM반도체 연구의 허브로서 한국 메모리 산업, 시스템 반도체 기술의 업그레이드와 미래 도약 발판을 위해 아직도 왕성한 연구 의욕을 불태우고 있다.

2023.03.02 조회수 4162

유회준 교수, ISSCC 반도체 설계 최고 권위자로 선정

국제고체회로학회(International Solid-State Circuits Conference, 이하 ISSCC)는 세계 반도체올림픽이라고 불리며 70주년 기념식을 올해 2월 20일 미국 샌프란시스코 메리어트 호텔에서 개최했다.

우리 대학 전기및전자공학부 유회준 교수가 63편의 논문을 발표한 실적으로 동양인으로서 유일하게 톱5에 들어 최다 논문 발표자로 선정되었다고 1일 밝혔다.

유 교수는 ISSCC의 설립 41년이 지난 1995년에 현대전자(現 SK하이닉스)에서 세계 최초로 256M SDRAM을 개발한 뒤 이를 동 학회에서 한국 최초 논문을 발표한 바 있다. 이후 유 교수 연구팀은 KAIST로 옮겨 2000년부터 2023년까지 62편의 논문을 발표하여 동 학회에서 총 63편의 논문을 발표했다.

1996년에 유 교수가 집필한 `DRAM의 설계'라는 책은 삼성전자나 하이닉스 기술자들의 필독서로 활용됐다. 또한, 동 학회에서 DRAM 관련 반도체에 대해 5편, 바이오메디컬용 반도체 및 저전력 무선 통신용 칩에 대해 총 26편, 증강현실(AR)용 웨어러블 반도체에 대해 총 14편 발표했다. 특히 2008년부터 인공지능 반도체를 연구하기 시작해 2014년 세계 최초로 DNN 가속기를 발표하는 등 올해까지 총 18 편의 인공지능(이하 AI) 반도체 관련 연구 결과를 동 학회에서 발표했다. 아울러, 아시아 교수로는 최초로 2019년 AI 반도체에 관련한 ISSCC 기조강연자로 초청되기도 하였다.

올해는 특히 트랜지스터의 발명 75주년이기도 한데 이를 기념하기 위해 국제전기전자공학회 (IEEE) 전자소자학회/고체회로학회 (EDS/SSCS) 에서 10인의 대표강연자를 선정하여 세계 순회 강연을 계획 중에 있으며 이 중 1인으로 유 교수가 선정됐다. 또한 올해는 모든 반도체 제조에 이용되는 모스펫(이하 MOSFET)발명 60주년이기도 한데 MOSFET의 발명자인 강대원 박사를 기리는 강대원 상을 올해 2월 14일에 한국반도체 학술대회에서 수상하기도 했다.

올해 ISSCC 학회에서는 DRAM을 이용한 지능형 반도체(이하 PIM 반도체)인 다이나플라지아(DynaPlasia), 뉴로모픽 반도체인 스파이크 인공신경망(SNN, Spike Neural Network)과 기존의 합성곱 인공신경망(CNN, Convolutional Neural Network)을 결합해 저전력으로 동작하는 상보 심층신경망(C-DNN), 그리고 3차원 영상 제작 및 가속의 혁명을 가져올 NeRF(Neural Radiance Fields) 가속 칩을 세계 최초로 개발해 총 3편의 혁신적인 새로운 연구 방향을 제시하는 논문들을 발표하여 매우 우수하다는 평가를 받았다.

유 교수의 연구 결과에 대해 일본 동경대 전자공학과 학과장인 타케우치 교수는 "항상 새로운 방향을 제시하는 연구를 발표하는 것이 존경스럽다"고 했으며 미국 MIT 공대 학장인 아난싸 찬드라카산 교수는 "끊임없이 좋은 연구 결과를 내는 그 비결을 알고 싶다"며 찬사를 보내고 있다.

유 교수의 연구 결과는 삼성전자에 기술이전 되기도 했고, 특히 5개의 국내 대표 AI 반도체 벤처 창업들이 있다. 이중 `리벨리온'은 최근 챗GPT용 가속 인공지능 칩인 아톰칩(ATOM)을 개발해 KT와 함께 상용화를 하고 있으며 `모빌린트'는 자동차용 인공지능 칩을 개발하여 2023년 CES에서 선보이기도 했다.

유회준 교수는 2022년 6월에 과기정통부의 지원으로 PIM반도체 설계연구센터(AI-PIM)을 KAIST에 설립해 한국의 PIM반도체 연구의 허브로서 한국 메모리 산업, 시스템 반도체 기술의 업그레이드와 미래 도약 발판을 위해 아직도 왕성한 연구 의욕을 불태우고 있다.

2023.03.02 조회수 4162 -

사진에서 3차원 정보를 추론하는 인공지능 반도체 IP(지식재산권) 세계 최초 개발

우리 대학 전기및전자공학부 유회준 교수가 이끄는 PIM 반도체 설계 연구센터(AI-PIM)가 유수 학계에서 인정한 5종의 최첨단 인공지능 반도체 IP(지식재산권)를 개발했다고 29일 밝혔다.

대표적으로 심층신경망 추론 기술 및 센서 퓨전* 기술을 통해 사진으로부터 3차원 공간정보 추출하고 물체를 인식해 처리하는 인공지능(AI) 칩은 KAIST에서 세계 최초로 개발해 SRAM PIM** 시스템에 필요한 기술을 IP(지식재산권)화 한 것이다.

* 센서 퓨전 : 카메라, 거리센서 등의 각종 센서로부터 얻은 데이터를 결합하여보다 정확한 데이터를 얻는 방식

** SRAM PIM : 기존 메모리 SRAM과 DRAM 중 SRAM에 연산기를 결합한 PIM반도체

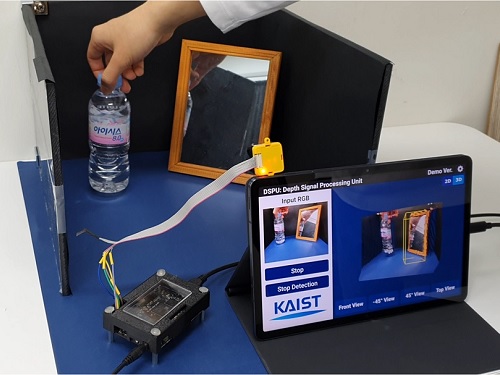

이 IP는 올해 2월 20일부터 28일까지 개최된 국제고체회로설계학회(ISSCC)에서 현장 시연을 통해 많은 주목을 받았으며, 이를 누구라도 편리하게 활용할 수 있도록 한 것이다. (웹사이트 : www.ai-pim.org)

KAIST PIM 반도체 설계연구센터는 해당 IP를 포함해 ADC*, PLL** 등 총 5가지의 PIM IP를 확보했으며, 지난 28일 웹사이트를 오픈해 연구자들이 공유할 수 있는 환경을 제공하고 있다.

* ADC(Analog to Digital Converter) : 아날로그 데이터를 디지털 데이터로 변환시키는 회로

** PLL(Phase-Locked Loop) : 내부 신호의 위상과 외부 신호의 위상을 동기화할 수 있도록 설계된 회로

기존 물체 인식 인공지능 반도체는 사진과 같은 2차원 정보를 인식하는 `사진인식기술'에 불과하다. 하지만 현실 세계의 물체들은 3차원 구조물이기 때문에 3차원 공간정보를 활용해야만 정확한 `물체인식'이 가능하다.

3차원 공간정보는 사진과 같은 2차원 정보에 거리정보를 포함시켜 실제 3차원 공간을 표현한 것으로, 3차원 공간정보에 물체를 식별해 해당 물체의 위치 및 각도를 추적하는 3차원 물체인식 기술이다. 이는 자율주행, 자동화 기술, 개인용 증강현실 (AR)과 가상현실(VR) 등과 같은 3D 어플리케이션에서 사용하는 핵심기술이다.

기존 ToF 센서*를 활용해 센서 뷰 내에 있는 모든 물체에 대한 정밀한 3차원 정보를 추출하는 것은 전력 소모가 매우 크기 때문에 배터리 기반 모바일 장치(스마트폰, 태블릿 등)에서는 사용하기 어렵다.

* ToF 센서 : 3차원 공간정보를 추출하는 Time-of-Flight 센서로, 레이저를 방출하고 반사된 레이저가 검출되는 시간을 측정하여 거리를 계산, 대표적인 센서로 3D 라이다 (LiDAR) 센서가 있음

또한, ToF 센서는 특정 측정 환경에서 3차원 정보가 손실되는 문제와 데이터 전처리 과정에 많은 시간이 소요된다는 문제점이 있다.

3차원 물체인식 기술은 데이터가 복잡해 기존 인공지능 2차원 사진인식 가속 프로세서로 처리하기 어렵다. 이는 3차원 포인트 클라우드 데이터를 어떻게 선택하고 그룹화하느냐에 따라 메모리 접근량이 달라진다.

따라서 3차원 포인트 클라우드 기반 인공지능 추론은 연산 능력이 제한적이고 메모리가 작은 모바일 장치에서는 소프트웨어만으로 구현할 수 없었다.

이에 연구팀은 카메라와 저전력 거리센서 (64픽셀)를 사용하여 3차원 공간정보를 생성했고, 모바일에서도 3차원 어플리케이션 구현이 가능한 반도체 (DSPU: Depth Signal Processing Unit)를 개발함으로써 인공지능 반도체의 활용범위를 넓혔다.

모바일 기기에서 저전력 센서를 활용한 3차원 정보 처리 시스템을 구동하면서, 실시간 심층신경망 추론과 센서 퓨전 기술을 가속하기 위해서는 다양한 핵심기술이 필요하다. 인공지능 핵심기술이 적용된 DSPU는 단순 ToF센서에 의존했던 3차원 물체인식 가속기 반도체 대비 63.4% 낮춘 전력 소모와 53.6% 낮춘 지연시간을 달성했다.

PIM반도체 설계연구센터(AI-PIM)의 소장인 유회준 교수는 “이번 연구는 저가의 거리센서와 카메라를 융합해 3차원 데이터 처리를 가능하게 한 인공지능 반도체를 IP화했다는 점에서 의미가 크며, 모바일 기기에서 인공지능 활용 영역을 크게 넓혀 다양한 분야에 응용 및 기술이전을 기대하고 있다”고 연구의 의의를 설명했다.

한편, 이번 연구는 과학기술정보통신부와 정보통신기획평가원의 PIM인공지능반도체핵심기술개발사업을 통해 개발되었으며, 이와 관련해 PIM 반도체 관련 기업과 연구기관에 개발된 IP들의 기술이전 및 활용을 돕고 있다.

2022.12.29 조회수 4533

사진에서 3차원 정보를 추론하는 인공지능 반도체 IP(지식재산권) 세계 최초 개발

우리 대학 전기및전자공학부 유회준 교수가 이끄는 PIM 반도체 설계 연구센터(AI-PIM)가 유수 학계에서 인정한 5종의 최첨단 인공지능 반도체 IP(지식재산권)를 개발했다고 29일 밝혔다.

대표적으로 심층신경망 추론 기술 및 센서 퓨전* 기술을 통해 사진으로부터 3차원 공간정보 추출하고 물체를 인식해 처리하는 인공지능(AI) 칩은 KAIST에서 세계 최초로 개발해 SRAM PIM** 시스템에 필요한 기술을 IP(지식재산권)화 한 것이다.

* 센서 퓨전 : 카메라, 거리센서 등의 각종 센서로부터 얻은 데이터를 결합하여보다 정확한 데이터를 얻는 방식

** SRAM PIM : 기존 메모리 SRAM과 DRAM 중 SRAM에 연산기를 결합한 PIM반도체

이 IP는 올해 2월 20일부터 28일까지 개최된 국제고체회로설계학회(ISSCC)에서 현장 시연을 통해 많은 주목을 받았으며, 이를 누구라도 편리하게 활용할 수 있도록 한 것이다. (웹사이트 : www.ai-pim.org)

KAIST PIM 반도체 설계연구센터는 해당 IP를 포함해 ADC*, PLL** 등 총 5가지의 PIM IP를 확보했으며, 지난 28일 웹사이트를 오픈해 연구자들이 공유할 수 있는 환경을 제공하고 있다.

* ADC(Analog to Digital Converter) : 아날로그 데이터를 디지털 데이터로 변환시키는 회로

** PLL(Phase-Locked Loop) : 내부 신호의 위상과 외부 신호의 위상을 동기화할 수 있도록 설계된 회로

기존 물체 인식 인공지능 반도체는 사진과 같은 2차원 정보를 인식하는 `사진인식기술'에 불과하다. 하지만 현실 세계의 물체들은 3차원 구조물이기 때문에 3차원 공간정보를 활용해야만 정확한 `물체인식'이 가능하다.

3차원 공간정보는 사진과 같은 2차원 정보에 거리정보를 포함시켜 실제 3차원 공간을 표현한 것으로, 3차원 공간정보에 물체를 식별해 해당 물체의 위치 및 각도를 추적하는 3차원 물체인식 기술이다. 이는 자율주행, 자동화 기술, 개인용 증강현실 (AR)과 가상현실(VR) 등과 같은 3D 어플리케이션에서 사용하는 핵심기술이다.

기존 ToF 센서*를 활용해 센서 뷰 내에 있는 모든 물체에 대한 정밀한 3차원 정보를 추출하는 것은 전력 소모가 매우 크기 때문에 배터리 기반 모바일 장치(스마트폰, 태블릿 등)에서는 사용하기 어렵다.

* ToF 센서 : 3차원 공간정보를 추출하는 Time-of-Flight 센서로, 레이저를 방출하고 반사된 레이저가 검출되는 시간을 측정하여 거리를 계산, 대표적인 센서로 3D 라이다 (LiDAR) 센서가 있음

또한, ToF 센서는 특정 측정 환경에서 3차원 정보가 손실되는 문제와 데이터 전처리 과정에 많은 시간이 소요된다는 문제점이 있다.

3차원 물체인식 기술은 데이터가 복잡해 기존 인공지능 2차원 사진인식 가속 프로세서로 처리하기 어렵다. 이는 3차원 포인트 클라우드 데이터를 어떻게 선택하고 그룹화하느냐에 따라 메모리 접근량이 달라진다.

따라서 3차원 포인트 클라우드 기반 인공지능 추론은 연산 능력이 제한적이고 메모리가 작은 모바일 장치에서는 소프트웨어만으로 구현할 수 없었다.

이에 연구팀은 카메라와 저전력 거리센서 (64픽셀)를 사용하여 3차원 공간정보를 생성했고, 모바일에서도 3차원 어플리케이션 구현이 가능한 반도체 (DSPU: Depth Signal Processing Unit)를 개발함으로써 인공지능 반도체의 활용범위를 넓혔다.

모바일 기기에서 저전력 센서를 활용한 3차원 정보 처리 시스템을 구동하면서, 실시간 심층신경망 추론과 센서 퓨전 기술을 가속하기 위해서는 다양한 핵심기술이 필요하다. 인공지능 핵심기술이 적용된 DSPU는 단순 ToF센서에 의존했던 3차원 물체인식 가속기 반도체 대비 63.4% 낮춘 전력 소모와 53.6% 낮춘 지연시간을 달성했다.

PIM반도체 설계연구센터(AI-PIM)의 소장인 유회준 교수는 “이번 연구는 저가의 거리센서와 카메라를 융합해 3차원 데이터 처리를 가능하게 한 인공지능 반도체를 IP화했다는 점에서 의미가 크며, 모바일 기기에서 인공지능 활용 영역을 크게 넓혀 다양한 분야에 응용 및 기술이전을 기대하고 있다”고 연구의 의의를 설명했다.

한편, 이번 연구는 과학기술정보통신부와 정보통신기획평가원의 PIM인공지능반도체핵심기술개발사업을 통해 개발되었으며, 이와 관련해 PIM 반도체 관련 기업과 연구기관에 개발된 IP들의 기술이전 및 활용을 돕고 있다.

2022.12.29 조회수 4533 -

세계 최초 개인정보 보호 기술이 적용된 인공지능(AI) 반도체 개발

우리 대학 전기및전자공학부 유민수 교수 연구팀이 세계 최초로 `차등 프라이버시 기술이 적용된 인공지능(AI) 어플리케이션(Differentially private machine learning)'의 성능을 비약적으로 높이는 인공지능 반도체를 개발했다고 19일 밝혔다.

빅데이터 및 인공지능 기술의 발전과 함께 구글, 애플, 마이크로소프트 등 클라우드 서비스를 제공하는 기업들은 전 세계 수십억 명의 사용자들에게 인공지능 기술을 기반으로 여러 가지 서비스(머신러닝 애즈 어 서비스, ML-as-a-Service, MLaaS)를 제공하고 있다. 이러한 서비스 중에는, 대표적으로 유튜브나 페이스북 등에서 시청자의 개별 취향에 맞춰 동영상 콘텐츠나 상품 등을 추천하는 `개인화 추천 시스템 기술(예- 딥러닝 추천 모델, Deep Learning Recommendation Model)' 이나, 구글 포토(Photo) 와 애플 아이클라우드(iCloud) 등에서 사진을 인물 별로 분류해주는 `안면 인식 기술 (예- 합성곱 신경망 네트워크 안면 인식, Convolutional Neural Network based Face Recognition)' 등이 있다.

이와 같은 서비스는 사용자의 정보를 대량으로 수집해, 이를 기반으로 인공지능 알고리즘의 정확도와 성능을 개선한다. 이 과정에서 필연적으로 많은 양의 사용자 정보가 서비스 제공 기업의 데이터 센터로 전송되고, 민감한 개인정보나 파일들이 저장되고 사용되는 과정에서 정보가 유출되는 문제가 발생하기도 한다.

또한 이러한 문제는 최근 주목받는 대형 인공지능 모델의 경우에 더 쉽게 발생하는 경향이 있으며, 실제 구글에서 사용하는 대화형 인공지능 모델인 GPT-2의 경우, 특정 단어들을 이야기했을 때 사용자의 개인정보 등을 유출하는 문제를 보였다. [참고1] 유사사례로서 국내에서 2020년 화제가 되었던 스캐터랩의 인공지능 챗봇 이루다의 경우에도 비슷한 문제가 불거진 적이 있다. [참고2]

[참고1] https://ai.googleblog.com/2020/12/privacy-considerations-in-large.html

[참고2] https://n.news.naver.com/mnews/article/092/0002243051?sid=105

이에 애플, 구글, 마이크로소프트 등 빅 테크 기업에서는 `차등 프라이버시 (differential privacy)' 기술을 크게 주목하고 있다. 차등 프라이버시 기술은 학습에 사용되는 그라디언트(gradient, 학습 방향 기울기)에 잡음(노이즈)를 섞음으로써 인공지능 모델로부터 사용자의 개인정보를 유출하는 모든 종류의 공격을 방어할 수 있다.

하지만 이러한 장점에도 불구하고, 차등 프라이버시 기술 적용 시, 기존 대비 어플리케이션의 속도와 성능이 크게 하락하는 문제 때문에 아직까지 범용적으로 널리 적용되지는 못했다. 이는 차등 프라이버시 머신러닝 학습 과정이 일반적인 머신러닝 학습과 다른 특성을 보이고, 이로 인해 기존의 하드웨어에서 효과적으로 실행되지 않아 메모리 사용량, 학습 속도 및 하드웨어 활용도 (hardware utilization) 측면에서 비효율적이기 때문이다.

이에 유민수 교수 연구팀은 차등 프라이버시 기술의 성능 병목 구간을 분석해 해당 기술이 적용된 어플리케이션의 성능을 크게 시킬 수 있는 `차등 프라이버시 머신러닝을 위한 인공지능(AI) 반도체 칩'을 개발했다. 유민수 교수팀이 개발한 인공지능 반도체는 외적 기반 연산기와 덧셈기 트리 기반의 후처리 연산기 등으로 구성돼 있으며, 현재 가장 널리 사용되는 인공지능 프로세서인 구글 TPUv3 대비 차등 프라이버시 인공지능 학습 과정을 3.6 배 빠르게 실행시킬 수 있고, 엔비디아의 최신 GPU A100 대비 10배 적은 자원으로 대등한 성능을 보인다고 연구팀 관계자는 설명했다. 또한 이번 개발을 통해서 기존 하드웨어의 한계로 널리 쓰이지 못했던 차등 정보보호 기술의 대중화에 도움을 줄 수 있을 것으로 기대된다고 전했다.

우리 대학 전기및전자공학부 박범식, 황랑기 연구원이 공동 제1 저자로, 윤동호, 최윤혁 연구원이 공동 저자로 참여한 이번 연구는 미국 시카고에서 열리는 컴퓨터 구조 분야 최우수 국제 학술대회인 `55th IEEE/ACM International Symposium on Microarchitecture(MICRO 2022)'에서 오늘 10월 발표될 예정이다. (논문명 : DiVa: An Accelerator for Differentially Private Machine Learning)

또한 이번 연구는 지금까지는 없던 차등 프라이버시가 적용된 인공지능 반도체를 세계 최초로 개발했다는 점에서 의의가 있으며, 차등 프라이버시 인공지능 기술을 대중화해 인공지능 기반 서비스 사용자들의 개인정보를 보호하는 데에 큰 도움을 줄 수 있을 것으로 보인다. 또한, 가속기의 성능 향상은 인공지능 연구 효율을 높여 차등 프라이버시 인공지능 모델의 정확도 개선에도 기여할 것으로 보인다.

한편 이번 연구는 한국연구재단, 삼성전자, 그리고 반도체설계교육센터 (IDEC, IC Design Education Center)의 지원을 받아 수행됐다.

2022.08.19 조회수 6534

세계 최초 개인정보 보호 기술이 적용된 인공지능(AI) 반도체 개발

우리 대학 전기및전자공학부 유민수 교수 연구팀이 세계 최초로 `차등 프라이버시 기술이 적용된 인공지능(AI) 어플리케이션(Differentially private machine learning)'의 성능을 비약적으로 높이는 인공지능 반도체를 개발했다고 19일 밝혔다.

빅데이터 및 인공지능 기술의 발전과 함께 구글, 애플, 마이크로소프트 등 클라우드 서비스를 제공하는 기업들은 전 세계 수십억 명의 사용자들에게 인공지능 기술을 기반으로 여러 가지 서비스(머신러닝 애즈 어 서비스, ML-as-a-Service, MLaaS)를 제공하고 있다. 이러한 서비스 중에는, 대표적으로 유튜브나 페이스북 등에서 시청자의 개별 취향에 맞춰 동영상 콘텐츠나 상품 등을 추천하는 `개인화 추천 시스템 기술(예- 딥러닝 추천 모델, Deep Learning Recommendation Model)' 이나, 구글 포토(Photo) 와 애플 아이클라우드(iCloud) 등에서 사진을 인물 별로 분류해주는 `안면 인식 기술 (예- 합성곱 신경망 네트워크 안면 인식, Convolutional Neural Network based Face Recognition)' 등이 있다.

이와 같은 서비스는 사용자의 정보를 대량으로 수집해, 이를 기반으로 인공지능 알고리즘의 정확도와 성능을 개선한다. 이 과정에서 필연적으로 많은 양의 사용자 정보가 서비스 제공 기업의 데이터 센터로 전송되고, 민감한 개인정보나 파일들이 저장되고 사용되는 과정에서 정보가 유출되는 문제가 발생하기도 한다.

또한 이러한 문제는 최근 주목받는 대형 인공지능 모델의 경우에 더 쉽게 발생하는 경향이 있으며, 실제 구글에서 사용하는 대화형 인공지능 모델인 GPT-2의 경우, 특정 단어들을 이야기했을 때 사용자의 개인정보 등을 유출하는 문제를 보였다. [참고1] 유사사례로서 국내에서 2020년 화제가 되었던 스캐터랩의 인공지능 챗봇 이루다의 경우에도 비슷한 문제가 불거진 적이 있다. [참고2]

[참고1] https://ai.googleblog.com/2020/12/privacy-considerations-in-large.html

[참고2] https://n.news.naver.com/mnews/article/092/0002243051?sid=105

이에 애플, 구글, 마이크로소프트 등 빅 테크 기업에서는 `차등 프라이버시 (differential privacy)' 기술을 크게 주목하고 있다. 차등 프라이버시 기술은 학습에 사용되는 그라디언트(gradient, 학습 방향 기울기)에 잡음(노이즈)를 섞음으로써 인공지능 모델로부터 사용자의 개인정보를 유출하는 모든 종류의 공격을 방어할 수 있다.

하지만 이러한 장점에도 불구하고, 차등 프라이버시 기술 적용 시, 기존 대비 어플리케이션의 속도와 성능이 크게 하락하는 문제 때문에 아직까지 범용적으로 널리 적용되지는 못했다. 이는 차등 프라이버시 머신러닝 학습 과정이 일반적인 머신러닝 학습과 다른 특성을 보이고, 이로 인해 기존의 하드웨어에서 효과적으로 실행되지 않아 메모리 사용량, 학습 속도 및 하드웨어 활용도 (hardware utilization) 측면에서 비효율적이기 때문이다.

이에 유민수 교수 연구팀은 차등 프라이버시 기술의 성능 병목 구간을 분석해 해당 기술이 적용된 어플리케이션의 성능을 크게 시킬 수 있는 `차등 프라이버시 머신러닝을 위한 인공지능(AI) 반도체 칩'을 개발했다. 유민수 교수팀이 개발한 인공지능 반도체는 외적 기반 연산기와 덧셈기 트리 기반의 후처리 연산기 등으로 구성돼 있으며, 현재 가장 널리 사용되는 인공지능 프로세서인 구글 TPUv3 대비 차등 프라이버시 인공지능 학습 과정을 3.6 배 빠르게 실행시킬 수 있고, 엔비디아의 최신 GPU A100 대비 10배 적은 자원으로 대등한 성능을 보인다고 연구팀 관계자는 설명했다. 또한 이번 개발을 통해서 기존 하드웨어의 한계로 널리 쓰이지 못했던 차등 정보보호 기술의 대중화에 도움을 줄 수 있을 것으로 기대된다고 전했다.

우리 대학 전기및전자공학부 박범식, 황랑기 연구원이 공동 제1 저자로, 윤동호, 최윤혁 연구원이 공동 저자로 참여한 이번 연구는 미국 시카고에서 열리는 컴퓨터 구조 분야 최우수 국제 학술대회인 `55th IEEE/ACM International Symposium on Microarchitecture(MICRO 2022)'에서 오늘 10월 발표될 예정이다. (논문명 : DiVa: An Accelerator for Differentially Private Machine Learning)

또한 이번 연구는 지금까지는 없던 차등 프라이버시가 적용된 인공지능 반도체를 세계 최초로 개발했다는 점에서 의의가 있으며, 차등 프라이버시 인공지능 기술을 대중화해 인공지능 기반 서비스 사용자들의 개인정보를 보호하는 데에 큰 도움을 줄 수 있을 것으로 보인다. 또한, 가속기의 성능 향상은 인공지능 연구 효율을 높여 차등 프라이버시 인공지능 모델의 정확도 개선에도 기여할 것으로 보인다.

한편 이번 연구는 한국연구재단, 삼성전자, 그리고 반도체설계교육센터 (IDEC, IC Design Education Center)의 지원을 받아 수행됐다.

2022.08.19 조회수 6534 -

KAIST, 인공지능 반도체 생태계를 선도하다

인공지능 반도체(이하 AI 반도체)가 국가적인 전략기술로 두드러지면서 KAIST의 관련 성과도 주목받고 있다. 과학기술정보통신부는 지난해 2030년 세계 AI 반도체 시장 20% 점유를 목표로 인공지능 반도체 지원사업에 본격적으로 착수한 바 있다. 올해에는 산학연 논의를 거쳐 5년간 1조 200억 원을 투입하는 `인공지능 반도체 산업 성장 지원대책'으로 지원을 확대했다. 이에 따라 AI 반도체 전문가 양성을 위해 주요 대학들의 행보도 분주해졌다.

KAIST는 반도체와 인공지능 양대 핵심 분야에서 최상급의 교육, 연구 역량을 쌓아 왔다. 반도체 분야에서는 지난 17년 동안 메사추세츠 공과대학(이하 MIT), 스탠퍼드(Stanford)와 같은 세계적인 학교를 제치고 국제반도체회로학회(이하 ISSCC, International Solid State Circuit Conference)에서 대학 중 1위를 지켜 왔다는 점이 돋보인다. ISSCC는 1954년 설립된 반도체 집적회로 설계 분야 세계 최고 권위 학회다. 참가자 중 60% 이상이 삼성, 퀄컴, TSMC, 인텔을 비롯한 산업계 소속일만큼 산업적인 실용성을 중시해서 `반도체 설계 올림픽'이라는 별명도 있다.

KAIST는 ISSCC에서 채택 논문 수 기준 매년 전 세계 대학교 중 1~2위를 유지했다. 최근 17년간 평균 채택 논문 수를 살펴보면 압도적인 선두다. 해당 기간 채택된 KAIST의 논문은 평균 8.4편으로, 경쟁자인 MIT(4.6편)와 캘리포니아대학교 로스앤젤레스(UCLA)(3.6편)에 비해 두 배 가까운 성과다. 국내에서는 반도체 설계 분야 부동의 1위인 삼성에 이어 종합 2위 자리를 유지하고 있다. 그럴 뿐만 아니라 ISSCC와 쌍벽을 이루는 집적회로 분야 학술대회인 초고밀도집적회로학회에서도 KAIST는 2022년 전 세계 대학 중 1위를 기록했다.

KAIST의 연구진들이 반도체 산업 핵심 분야 전반에서 신기술을 발표해 연구의 질적인 수준도 높다. 전기및전자공학부 정명수 교수 연구팀은 고성능 저전력을 추구하는 현재 업계의 수요에 대응해 전력 공급 없이도 동작을 유지하는 컴퓨터를 개발했다. 소재 분야에서는 신소재공학과의 박병국 교수 연구팀이 기존의 메모리에 비해 동작 속도가 10배 이상 빠른 `스핀궤도토크 자성메모리' 소자를 개발해서 기존 `폰노이만 구조'의 한계를 극복하는 방안을 제시하기도 했다.

이처럼 현재 반도체 산업의 주요 과제에 솔루션을 제공하는 한편으로 미래의 새로운 반도체 분야를 선점하는 데 필요한 신기술 개발도 활발하다. 암호 및 비선형 연산 분야에서 차세대 컴퓨팅으로 주목받는 양자컴퓨팅 분야에서는 전기및전자공학부 김상현 교수 연구팀이 3차원 집적 기술을 세계 최초로 선보였다. 신경계의 원리를 활용해 인공지능 분야에서 발군의 성능을 보일 것으로 기대되는 뉴로모픽 컴퓨팅에서는 전기및전자공학부 최신현 교수 연구팀이 신경세포를 모사하는 차세대 멤리스터를 개발 중이다.

인공지능 분야에서도 비약적으로 성장했다. 인공지능 분야의 양대 세계 최고 권위 학회인 국제머신러닝학회(ICML)과 인공신경망학회(NeurIPS) 논문 수 기준으로 KAIST는 2020년 세계 6위, 아시아에서는 1위를 기록했다. KAIST의 순위는 2012년부터 꾸준히 우상향 그래프를 그려 8년만에 37위에서 6위로, 무려 31계단이나 도약했다. 2021년에는 인공지능 분야 톱 학회 11개에 발표된 한국 논문 중 약 40%에 달하는 129편이 KAIST에서 나왔다. KAIST의 이러한 활약에 힘입어 2021년 한국은 글로벌 인공지능 톱 학회 등재 논문 수 기준으로 미국, 중국, 영국, 캐나다, 독일에 이어 6위에 올랐다.

내용 면에서도 KAIST의 인공지능 연구는 최전선에 있다. 전기및전자공학부 유회준 교수 연구팀은 모바일기기에서 인공지능 실시간 학습을 구현해 에지 네트워크의 단점을 보완했다. 인공지능을 구현하려면 데이터 축적관 막대한 양의 연산이 필요한데, 이를 위해 고성능 서버가 방대한 연산을 담당하고 사용자 단말은 데이터 수집과 간단한 연산만 하는 `에지 네트워크'가 사용된다. 유 교수의 연구는 사용자 단말에 학습 능력을 부여함으로써 인공지능의 처리 속도와 성능을 크게 높일 수 있다.

지난 6월에는 전산학부 김민수 교수 연구팀이 초대규모 인공지능 모델 처리에 꼭 필요한 솔루션을 제시했다. 연구팀이 개발한 초대규모 기계학습 시스템은 현재 업계에서 주로 사용되는 구글의 텐서플로우(Tensorflow)나 IBM의 시스템DS 대비 최대 8.8배나 빠른 속도를 달성할 수 있을 것으로 기대된다.

KAIST는 반도체와 인공지능이 결합된 AI 반도체 분야에서도 주목할만한 성과를 내고 있다. 2020년 전기및전자공학부 유민수 교수 연구팀은 세계 최초로 추천시스템에 최적화된 AI 반도체를 개발하는 데 성공했다. 인공지능 추천시스템은 방대한 콘텐츠와 사용자 정보를 다룬다는 특성상 범용 인공지능 시스템으로 운영하면 병목현상으로 성능에 한계가 있다. 유민수 교수팀은 `프로세싱-인-메모리(이하 PIM, Processing-In-Memory)' 기술을 기반으로 기존 시스템 대비 최대 21배 빠른 속도를 낼 수 있는 반도체를 개발했다. PIM은 처리할 데이터를 임시로 저장하기만 하던 `램'에서 연산까지 수행해 효율을 높이는 기술이다. PIM 기술이 본격적으로 상용화되면 메모리 분야에서 강세인 한국 기업의 AI 반도체 시장 경쟁력이 비약적으로 높아질 것으로 기대된다.

KAIST는 그간의 성과에 안주하지 않고 인공지능 및 반도체, 그리고 AI 반도체 분야 초격차를 유지하고자 다각적인 노력을 기울이고 있다. 1990년 국내 최초로 인공지능연구센터를 설립한 데 이어 2019년에는 김재철AI대학원을 개설해 전문인력을 양성 중이다. 2020년에는 인공지능과 반도체 연구를 융합해 ITRC 인공지능반도체시스템 연구센터가 출범했으며, 2021년에는 인공지능을 다양한 분야에 접목하는 `AI+X' 연구를 활성화하고자 김재철AI대학원과 별도로 AI 연구원을 설립했다.

KAIST는 이러한 노력으로 축적된 내적 역량을 바탕으로 네이버 등 기업과 공동연구센터를 설립하는 한편, 화성시와 같은 지자체와 협력해 동시다발적인 전문인력 양성에 나섰다. 지난 2021년에는 삼성전자와 함께 반도체시스템공학과 설립 협약을 체결하고 새로운 반도체 전문인력 교육과정을 준비하고 있다. 새로 설립되는 반도체시스템공학과는 2023년부터 매년 100명 내외의 신입생을 선발하고, 이들이 전문역량을 꽃피울 수 있도록 학생 전원에게 특별장학금을 지급할 예정이다. 또한 산업계와의 긴밀한 협력을 통해 삼성전자 견학과 인턴십, 공동 워크숍을 지원해 현장에 밀착한 교육을 제공할 예정이다.

KAIST는 국내 반도체 분야 박사 인력의 25%, 박사 출신 중견 및 벤처기업 CEO의 20%를 배출하며 한국 반도체 산업 생태계가 성장하는 데 중대한 공헌을 했다. 본격적으로 열린 AI 반도체 경쟁 체제를 앞두고 KAIST가 다시 산업 생태계의 구심점 역할을 할지 귀추가 주목된다.

2022.08.04 조회수 12640

KAIST, 인공지능 반도체 생태계를 선도하다

인공지능 반도체(이하 AI 반도체)가 국가적인 전략기술로 두드러지면서 KAIST의 관련 성과도 주목받고 있다. 과학기술정보통신부는 지난해 2030년 세계 AI 반도체 시장 20% 점유를 목표로 인공지능 반도체 지원사업에 본격적으로 착수한 바 있다. 올해에는 산학연 논의를 거쳐 5년간 1조 200억 원을 투입하는 `인공지능 반도체 산업 성장 지원대책'으로 지원을 확대했다. 이에 따라 AI 반도체 전문가 양성을 위해 주요 대학들의 행보도 분주해졌다.

KAIST는 반도체와 인공지능 양대 핵심 분야에서 최상급의 교육, 연구 역량을 쌓아 왔다. 반도체 분야에서는 지난 17년 동안 메사추세츠 공과대학(이하 MIT), 스탠퍼드(Stanford)와 같은 세계적인 학교를 제치고 국제반도체회로학회(이하 ISSCC, International Solid State Circuit Conference)에서 대학 중 1위를 지켜 왔다는 점이 돋보인다. ISSCC는 1954년 설립된 반도체 집적회로 설계 분야 세계 최고 권위 학회다. 참가자 중 60% 이상이 삼성, 퀄컴, TSMC, 인텔을 비롯한 산업계 소속일만큼 산업적인 실용성을 중시해서 `반도체 설계 올림픽'이라는 별명도 있다.

KAIST는 ISSCC에서 채택 논문 수 기준 매년 전 세계 대학교 중 1~2위를 유지했다. 최근 17년간 평균 채택 논문 수를 살펴보면 압도적인 선두다. 해당 기간 채택된 KAIST의 논문은 평균 8.4편으로, 경쟁자인 MIT(4.6편)와 캘리포니아대학교 로스앤젤레스(UCLA)(3.6편)에 비해 두 배 가까운 성과다. 국내에서는 반도체 설계 분야 부동의 1위인 삼성에 이어 종합 2위 자리를 유지하고 있다. 그럴 뿐만 아니라 ISSCC와 쌍벽을 이루는 집적회로 분야 학술대회인 초고밀도집적회로학회에서도 KAIST는 2022년 전 세계 대학 중 1위를 기록했다.

KAIST의 연구진들이 반도체 산업 핵심 분야 전반에서 신기술을 발표해 연구의 질적인 수준도 높다. 전기및전자공학부 정명수 교수 연구팀은 고성능 저전력을 추구하는 현재 업계의 수요에 대응해 전력 공급 없이도 동작을 유지하는 컴퓨터를 개발했다. 소재 분야에서는 신소재공학과의 박병국 교수 연구팀이 기존의 메모리에 비해 동작 속도가 10배 이상 빠른 `스핀궤도토크 자성메모리' 소자를 개발해서 기존 `폰노이만 구조'의 한계를 극복하는 방안을 제시하기도 했다.

이처럼 현재 반도체 산업의 주요 과제에 솔루션을 제공하는 한편으로 미래의 새로운 반도체 분야를 선점하는 데 필요한 신기술 개발도 활발하다. 암호 및 비선형 연산 분야에서 차세대 컴퓨팅으로 주목받는 양자컴퓨팅 분야에서는 전기및전자공학부 김상현 교수 연구팀이 3차원 집적 기술을 세계 최초로 선보였다. 신경계의 원리를 활용해 인공지능 분야에서 발군의 성능을 보일 것으로 기대되는 뉴로모픽 컴퓨팅에서는 전기및전자공학부 최신현 교수 연구팀이 신경세포를 모사하는 차세대 멤리스터를 개발 중이다.

인공지능 분야에서도 비약적으로 성장했다. 인공지능 분야의 양대 세계 최고 권위 학회인 국제머신러닝학회(ICML)과 인공신경망학회(NeurIPS) 논문 수 기준으로 KAIST는 2020년 세계 6위, 아시아에서는 1위를 기록했다. KAIST의 순위는 2012년부터 꾸준히 우상향 그래프를 그려 8년만에 37위에서 6위로, 무려 31계단이나 도약했다. 2021년에는 인공지능 분야 톱 학회 11개에 발표된 한국 논문 중 약 40%에 달하는 129편이 KAIST에서 나왔다. KAIST의 이러한 활약에 힘입어 2021년 한국은 글로벌 인공지능 톱 학회 등재 논문 수 기준으로 미국, 중국, 영국, 캐나다, 독일에 이어 6위에 올랐다.

내용 면에서도 KAIST의 인공지능 연구는 최전선에 있다. 전기및전자공학부 유회준 교수 연구팀은 모바일기기에서 인공지능 실시간 학습을 구현해 에지 네트워크의 단점을 보완했다. 인공지능을 구현하려면 데이터 축적관 막대한 양의 연산이 필요한데, 이를 위해 고성능 서버가 방대한 연산을 담당하고 사용자 단말은 데이터 수집과 간단한 연산만 하는 `에지 네트워크'가 사용된다. 유 교수의 연구는 사용자 단말에 학습 능력을 부여함으로써 인공지능의 처리 속도와 성능을 크게 높일 수 있다.

지난 6월에는 전산학부 김민수 교수 연구팀이 초대규모 인공지능 모델 처리에 꼭 필요한 솔루션을 제시했다. 연구팀이 개발한 초대규모 기계학습 시스템은 현재 업계에서 주로 사용되는 구글의 텐서플로우(Tensorflow)나 IBM의 시스템DS 대비 최대 8.8배나 빠른 속도를 달성할 수 있을 것으로 기대된다.

KAIST는 반도체와 인공지능이 결합된 AI 반도체 분야에서도 주목할만한 성과를 내고 있다. 2020년 전기및전자공학부 유민수 교수 연구팀은 세계 최초로 추천시스템에 최적화된 AI 반도체를 개발하는 데 성공했다. 인공지능 추천시스템은 방대한 콘텐츠와 사용자 정보를 다룬다는 특성상 범용 인공지능 시스템으로 운영하면 병목현상으로 성능에 한계가 있다. 유민수 교수팀은 `프로세싱-인-메모리(이하 PIM, Processing-In-Memory)' 기술을 기반으로 기존 시스템 대비 최대 21배 빠른 속도를 낼 수 있는 반도체를 개발했다. PIM은 처리할 데이터를 임시로 저장하기만 하던 `램'에서 연산까지 수행해 효율을 높이는 기술이다. PIM 기술이 본격적으로 상용화되면 메모리 분야에서 강세인 한국 기업의 AI 반도체 시장 경쟁력이 비약적으로 높아질 것으로 기대된다.

KAIST는 그간의 성과에 안주하지 않고 인공지능 및 반도체, 그리고 AI 반도체 분야 초격차를 유지하고자 다각적인 노력을 기울이고 있다. 1990년 국내 최초로 인공지능연구센터를 설립한 데 이어 2019년에는 김재철AI대학원을 개설해 전문인력을 양성 중이다. 2020년에는 인공지능과 반도체 연구를 융합해 ITRC 인공지능반도체시스템 연구센터가 출범했으며, 2021년에는 인공지능을 다양한 분야에 접목하는 `AI+X' 연구를 활성화하고자 김재철AI대학원과 별도로 AI 연구원을 설립했다.

KAIST는 이러한 노력으로 축적된 내적 역량을 바탕으로 네이버 등 기업과 공동연구센터를 설립하는 한편, 화성시와 같은 지자체와 협력해 동시다발적인 전문인력 양성에 나섰다. 지난 2021년에는 삼성전자와 함께 반도체시스템공학과 설립 협약을 체결하고 새로운 반도체 전문인력 교육과정을 준비하고 있다. 새로 설립되는 반도체시스템공학과는 2023년부터 매년 100명 내외의 신입생을 선발하고, 이들이 전문역량을 꽃피울 수 있도록 학생 전원에게 특별장학금을 지급할 예정이다. 또한 산업계와의 긴밀한 협력을 통해 삼성전자 견학과 인턴십, 공동 워크숍을 지원해 현장에 밀착한 교육을 제공할 예정이다.

KAIST는 국내 반도체 분야 박사 인력의 25%, 박사 출신 중견 및 벤처기업 CEO의 20%를 배출하며 한국 반도체 산업 생태계가 성장하는 데 중대한 공헌을 했다. 본격적으로 열린 AI 반도체 경쟁 체제를 앞두고 KAIST가 다시 산업 생태계의 구심점 역할을 할지 귀추가 주목된다.

2022.08.04 조회수 12640 -

스스로 그림 그리는 인공지능 반도체 칩 개발

전기및전자공학부 유회준 교수 연구팀이 생성적 적대 신경망(GAN: Generative Adversarial Network)을 저전력, 효율적으로 처리하는 인공지능(AI: Artificial Intelligent) 반도체를 개발했다.

연구팀이 개발한 인공지능 반도체는 다중-심층 신경망을 처리할 수 있고 이를 저전력의 모바일 기기에서도 학습할 수 있다. 연구팀은 이번 반도체 칩 개발을 통해 이미지 합성, 스타일 변환, 손상 이미지 복원 등의 생성형 인공지능 기술을 모바일 기기에서 구현하는 데 성공했다.

강상훈 박사과정이 1 저자로 참여한 이번 연구결과는 지난 2월 17일 3천여 명 반도체 연구자들이 미국 샌프란시스코에 모여 개최한 국제고체회로설계학회(ISSCC)에서 발표됐다. (논문명 : GANPU: A 135TFLOPS/W Multi-DNN Training Processor for GANs with Speculative Dual-Sparsity Exploitation)

기존에 많이 연구된 인공지능 기술인 분류형 모델(Discriminative Model)은 주어진 질문에 답을 하도록 학습된 인공지능 모델로 물체 인식 및 추적, 음성인식, 얼굴인식 등에 활용된다.

이와 달리 생성적 적대 신경망(GAN)은 새로운 이미지를 생성·재생성할 수 있어 이미지 스타일 변환, 영상 합성, 손상된 이미지 복원 등 광범위한 분야에 활용된다. 또한, 모바일 기기의 다양한 응용 프로그램(영상·이미지 내 사용자의 얼굴 합성)에도 사용돼 학계뿐만 아니라 산업계에서도 주목을 받고 있다.

그러나 생성적 적대 신경망은 기존의 딥러닝 네트워크와는 달리 여러 개의 심층 신경망으로 이루어진 구조로, 개별 심층 신경망마다 다른 요구 조건으로 최적화된 가속을 하는 것이 어렵다.

또한, 고해상도 이미지를 생성하기 위해 기존 심층 신경망 모델보다 수십 배 많은 연산량을 요구한다. 즉, 적대적 생성 신경망은 연산 능력이 제한적이고 사용되는 메모리가 작은 모바일 장치(스마트폰, 태블릿 등)에서는 소프트웨어만으로 구현할 수 없었다.

최근 모바일 기기에서 인공지능을 구현하기 위해 다양한 가속기 개발이 이뤄지고 있지만, 기존 연구들은 추론 단계만 지원하거나 단일-심층 신경망 학습에 한정돼 있다.

연구팀은 단일-심층 신경망뿐만 아니라 생성적 적대 신경망과 같은 다중-심층 신경망을 처리할 수 있으면서 모바일에서 학습도 가능한 인공지능 반도체 GANPU(Generative Adversarial Networks Processing Unit)를 개발해 모바일 장치의 인공지능 활용범위를 넓혔다.

연구팀이 개발한 인공지능 반도체는 서버로 데이터를 보내지 않고 모바일 장치 내에서 생성적 적대 신경망(GAN)을 스스로 학습할 수 있어 사생활을 보호를 가능케 하는 프로세서라는 점에서 그 활용도가 기대된다.

모바일 기기에서 저전력으로 다중-심층 신경망을 가속하기 위해서 다양한 핵심 기술이 필요하다. 연구팀이 개발한 GANPU에 사용된 핵심 기술 중 대표적인 기술 3가지는 ▲적응형 워크로드 할당(ASTM, 처리해야 할 워크로드*를 파악해 칩 상의 다중-심층 신경망의 연산 및 메모리 특성에 맞춰 시간·공간으로 나누어 할당함으로써 효율적으로 가속하는 방법) ▲입출력 희소성 활용 극대화(IOAS, 인공신경망 입력 데이터에서 나타나는 0뿐만 아니라 출력의 0도 예측해 연산에서 제외함으로써 추론 및 학습 과정에서의 속도와 에너지효율 극대화) ▲지수부만을 사용한 0 패턴 추측(EORS, 인공신경망 출력의 0을 예측하기 위한 알고리즘으로 인공신경망 입력과 연결 강도(weight)의 부동소수점 데이터 중 지수 부분만을 사용해 연산을 간단히 수행하는 방법)이다.

위의 기술을 사용함으로써 연구팀의 GANPU는 기존 최고 성능을 보이던 심층 신경망 학습 반도체 대비 4.8배 증가한 에너지효율을 달성했다.

연구팀은 GANPU의 활용 예시로 태블릿 카메라로 찍은 사진을 사용자가 직접 수정할 수 있는 응용 기술을 시연했다. 사진상의 얼굴에서 머리·안경·눈썹 등 17가지 특징에 대해 추가·삭제 및 수정사항을 입력하면 GANPU가 실시간으로 이를 자동으로 완성해 보여 주는 얼굴 수정 시스템을 개발했다.

2020.04.06 조회수 14738

스스로 그림 그리는 인공지능 반도체 칩 개발

전기및전자공학부 유회준 교수 연구팀이 생성적 적대 신경망(GAN: Generative Adversarial Network)을 저전력, 효율적으로 처리하는 인공지능(AI: Artificial Intelligent) 반도체를 개발했다.

연구팀이 개발한 인공지능 반도체는 다중-심층 신경망을 처리할 수 있고 이를 저전력의 모바일 기기에서도 학습할 수 있다. 연구팀은 이번 반도체 칩 개발을 통해 이미지 합성, 스타일 변환, 손상 이미지 복원 등의 생성형 인공지능 기술을 모바일 기기에서 구현하는 데 성공했다.

강상훈 박사과정이 1 저자로 참여한 이번 연구결과는 지난 2월 17일 3천여 명 반도체 연구자들이 미국 샌프란시스코에 모여 개최한 국제고체회로설계학회(ISSCC)에서 발표됐다. (논문명 : GANPU: A 135TFLOPS/W Multi-DNN Training Processor for GANs with Speculative Dual-Sparsity Exploitation)

기존에 많이 연구된 인공지능 기술인 분류형 모델(Discriminative Model)은 주어진 질문에 답을 하도록 학습된 인공지능 모델로 물체 인식 및 추적, 음성인식, 얼굴인식 등에 활용된다.

이와 달리 생성적 적대 신경망(GAN)은 새로운 이미지를 생성·재생성할 수 있어 이미지 스타일 변환, 영상 합성, 손상된 이미지 복원 등 광범위한 분야에 활용된다. 또한, 모바일 기기의 다양한 응용 프로그램(영상·이미지 내 사용자의 얼굴 합성)에도 사용돼 학계뿐만 아니라 산업계에서도 주목을 받고 있다.

그러나 생성적 적대 신경망은 기존의 딥러닝 네트워크와는 달리 여러 개의 심층 신경망으로 이루어진 구조로, 개별 심층 신경망마다 다른 요구 조건으로 최적화된 가속을 하는 것이 어렵다.

또한, 고해상도 이미지를 생성하기 위해 기존 심층 신경망 모델보다 수십 배 많은 연산량을 요구한다. 즉, 적대적 생성 신경망은 연산 능력이 제한적이고 사용되는 메모리가 작은 모바일 장치(스마트폰, 태블릿 등)에서는 소프트웨어만으로 구현할 수 없었다.

최근 모바일 기기에서 인공지능을 구현하기 위해 다양한 가속기 개발이 이뤄지고 있지만, 기존 연구들은 추론 단계만 지원하거나 단일-심층 신경망 학습에 한정돼 있다.

연구팀은 단일-심층 신경망뿐만 아니라 생성적 적대 신경망과 같은 다중-심층 신경망을 처리할 수 있으면서 모바일에서 학습도 가능한 인공지능 반도체 GANPU(Generative Adversarial Networks Processing Unit)를 개발해 모바일 장치의 인공지능 활용범위를 넓혔다.

연구팀이 개발한 인공지능 반도체는 서버로 데이터를 보내지 않고 모바일 장치 내에서 생성적 적대 신경망(GAN)을 스스로 학습할 수 있어 사생활을 보호를 가능케 하는 프로세서라는 점에서 그 활용도가 기대된다.

모바일 기기에서 저전력으로 다중-심층 신경망을 가속하기 위해서 다양한 핵심 기술이 필요하다. 연구팀이 개발한 GANPU에 사용된 핵심 기술 중 대표적인 기술 3가지는 ▲적응형 워크로드 할당(ASTM, 처리해야 할 워크로드*를 파악해 칩 상의 다중-심층 신경망의 연산 및 메모리 특성에 맞춰 시간·공간으로 나누어 할당함으로써 효율적으로 가속하는 방법) ▲입출력 희소성 활용 극대화(IOAS, 인공신경망 입력 데이터에서 나타나는 0뿐만 아니라 출력의 0도 예측해 연산에서 제외함으로써 추론 및 학습 과정에서의 속도와 에너지효율 극대화) ▲지수부만을 사용한 0 패턴 추측(EORS, 인공신경망 출력의 0을 예측하기 위한 알고리즘으로 인공신경망 입력과 연결 강도(weight)의 부동소수점 데이터 중 지수 부분만을 사용해 연산을 간단히 수행하는 방법)이다.

위의 기술을 사용함으로써 연구팀의 GANPU는 기존 최고 성능을 보이던 심층 신경망 학습 반도체 대비 4.8배 증가한 에너지효율을 달성했다.

연구팀은 GANPU의 활용 예시로 태블릿 카메라로 찍은 사진을 사용자가 직접 수정할 수 있는 응용 기술을 시연했다. 사진상의 얼굴에서 머리·안경·눈썹 등 17가지 특징에 대해 추가·삭제 및 수정사항을 입력하면 GANPU가 실시간으로 이를 자동으로 완성해 보여 주는 얼굴 수정 시스템을 개발했다.

2020.04.06 조회수 14738 -

유회준 교수, 인공지능 얼굴인식 시스템 K-EYE 개발

우리 대학 전기및전자공학과 유회준 교수 연구팀이 딥러닝 알고리즘을 세계 최소 전력으로 구현하는 인공지능 반도체 칩 CNNP를 개발했다. 그리고 이를 내장한 얼굴인식 시스템 K-Eye 시리즈를 개발했다.

연구팀이 개발한 K-Eye 시리즈는 웨어러블 디바이스와 동글 타입 2가지로 구성된다. 웨어러블 타입인 K-Eye는 블루투스로 스마트폰과 연동 가능하다.

봉경렬 박사과정이 주도하고 ㈜유엑스팩토리(대표 박준영)과 공동으로 개발한 이번 연구는 지난 2월 미국에서 열린 국제고체회로설계학회(ISSCC)에서 세계 최저전력 CNN칩으로 발표돼 주목을 받았다.

최근 글로벌 IT 기업들이 알파고를 비롯한 인공지능 관련 기술들을 경쟁적으로 발표하고 있다. 그러나 대부분은 소프트웨어 기술이라 속도가 느리고 모바일 환경에서는 구현이 어렵다는 한계가 있다.

따라서 이를 고속 및 저전력으로 구동하기 위해 인공지능 반도체 칩 개발이 필수적이다.

연구팀의 K-Eye 시리즈는 1mW 내외의 적은 전력만으로도 항상 얼굴 인식을 수행하는 상태를 유지하면서 사람의 얼굴을 먼저 알아보고 반응할 수 있다는 특징을 갖는다.

K-Eye의 핵심 기술인 얼웨이즈 온(Always-On) 이미지 센서와 CNNP라는 얼굴 인식 처리 칩이 있었기 때문에 위와 같은 세계 최저전력 기술이 가능했다.

첫 번째 칩인 얼웨이즈 온(Always-On) 이미지 센서는 얼굴이 있는지 없는지 스스로 판단할 수 있어 얼굴 인식이 될 때에만 작동하게 해 대기 전력을 대폭 낮출 수 있다.

얼굴 검출 이미지 센서는 아날로그 프로세싱으로 디지털 프로세싱을 제어해 센서 자체의 출력 소모를 줄였다. 픽셀과 결합된 아날로그 프로세서는 배경 부분과 얼굴 부분을 구분하는 역할을 하고 디지털 프로세서는 선택된 일부 영역에서만 얼굴 검출을 수행하면 돼 효율적인 작업이 가능하다.

두 번째 칩인 CNNP는 딥러닝을 회로, 구조, 알고리즘 전반에 도입하고 재해석을 진행해 최저 수준의 전력을 구현하는 역할을 했다.

특히 CNNP칩은 3가지의 핵심 기술을 사용했는데 ▲알파고 인공지능 알고리즘에서 사용하는 2차원 계산을 1차원 계산으로 바꿔 고속 저전력화 ▲분산형으로 배치된 칩 내 메모리가 가로방향 뿐 아니라 세로방향도 읽어낼 수 있는 특수 저전력 분산 메모리로의 설계 ▲1024개의 곱셈기와 덧셈기가 동시에 구동돼 막강한 계산력을 가지면서 외부 통신망을 거치지 않고 직접 계산 결과를 주고받을 수 있게 한 점이다.

CNNP는 97%의 인식률을 가지면서도 알파고에 사용된 GPU에 비해 5천분의 1정도의 낮은 전력인 0.6mW만을 소모한다.

K-Eye를 목에 건 사용자는 앞에서 다가오는 상대방의 얼굴이 화면에 떠오르면 미리 저장된 정보와 실시간으로 찍힌 사진을 비교해 상대방의 이름 등 정보를 자연스럽게 확인할 수 있다.

동글 타입인 K-EyeQ는 스마트폰에 장착해 이용할 수 있는데 사용자를 알아보고 반응하는 기능을 한다. 미리 기억시킨 사용자의 얼굴이 화면을 향하기만 하면 스마트폰 화면이 저절로 켜지면서 그와 관련된 정보를 제공한다.

또한 입력된 얼굴이 사진인지 실제 사람인지도 구분할 수 있어 사용자의 얼굴 대신 사진을 보여주면 스마트폰은 반응하지 않는다.

유 교수는 “인공지능 반도체 프로세서가 4차 산업혁명시대를 주도할 것으로 기대된다”며 “이번 인공지능 칩과 인식기의 개발로 인해 세계시장에서 한국이 인공지능 산업의 주도권을 갖길 기대한다”고 말했다.

□ 사진 설명.

사진1. K-EYE 사진

사진2. K-EYEQ 사진

사진3. CNNP 칩 사진

2017.06.14 조회수 13922

유회준 교수, 인공지능 얼굴인식 시스템 K-EYE 개발

우리 대학 전기및전자공학과 유회준 교수 연구팀이 딥러닝 알고리즘을 세계 최소 전력으로 구현하는 인공지능 반도체 칩 CNNP를 개발했다. 그리고 이를 내장한 얼굴인식 시스템 K-Eye 시리즈를 개발했다.

연구팀이 개발한 K-Eye 시리즈는 웨어러블 디바이스와 동글 타입 2가지로 구성된다. 웨어러블 타입인 K-Eye는 블루투스로 스마트폰과 연동 가능하다.

봉경렬 박사과정이 주도하고 ㈜유엑스팩토리(대표 박준영)과 공동으로 개발한 이번 연구는 지난 2월 미국에서 열린 국제고체회로설계학회(ISSCC)에서 세계 최저전력 CNN칩으로 발표돼 주목을 받았다.

최근 글로벌 IT 기업들이 알파고를 비롯한 인공지능 관련 기술들을 경쟁적으로 발표하고 있다. 그러나 대부분은 소프트웨어 기술이라 속도가 느리고 모바일 환경에서는 구현이 어렵다는 한계가 있다.

따라서 이를 고속 및 저전력으로 구동하기 위해 인공지능 반도체 칩 개발이 필수적이다.

연구팀의 K-Eye 시리즈는 1mW 내외의 적은 전력만으로도 항상 얼굴 인식을 수행하는 상태를 유지하면서 사람의 얼굴을 먼저 알아보고 반응할 수 있다는 특징을 갖는다.

K-Eye의 핵심 기술인 얼웨이즈 온(Always-On) 이미지 센서와 CNNP라는 얼굴 인식 처리 칩이 있었기 때문에 위와 같은 세계 최저전력 기술이 가능했다.

첫 번째 칩인 얼웨이즈 온(Always-On) 이미지 센서는 얼굴이 있는지 없는지 스스로 판단할 수 있어 얼굴 인식이 될 때에만 작동하게 해 대기 전력을 대폭 낮출 수 있다.

얼굴 검출 이미지 센서는 아날로그 프로세싱으로 디지털 프로세싱을 제어해 센서 자체의 출력 소모를 줄였다. 픽셀과 결합된 아날로그 프로세서는 배경 부분과 얼굴 부분을 구분하는 역할을 하고 디지털 프로세서는 선택된 일부 영역에서만 얼굴 검출을 수행하면 돼 효율적인 작업이 가능하다.

두 번째 칩인 CNNP는 딥러닝을 회로, 구조, 알고리즘 전반에 도입하고 재해석을 진행해 최저 수준의 전력을 구현하는 역할을 했다.

특히 CNNP칩은 3가지의 핵심 기술을 사용했는데 ▲알파고 인공지능 알고리즘에서 사용하는 2차원 계산을 1차원 계산으로 바꿔 고속 저전력화 ▲분산형으로 배치된 칩 내 메모리가 가로방향 뿐 아니라 세로방향도 읽어낼 수 있는 특수 저전력 분산 메모리로의 설계 ▲1024개의 곱셈기와 덧셈기가 동시에 구동돼 막강한 계산력을 가지면서 외부 통신망을 거치지 않고 직접 계산 결과를 주고받을 수 있게 한 점이다.

CNNP는 97%의 인식률을 가지면서도 알파고에 사용된 GPU에 비해 5천분의 1정도의 낮은 전력인 0.6mW만을 소모한다.

K-Eye를 목에 건 사용자는 앞에서 다가오는 상대방의 얼굴이 화면에 떠오르면 미리 저장된 정보와 실시간으로 찍힌 사진을 비교해 상대방의 이름 등 정보를 자연스럽게 확인할 수 있다.

동글 타입인 K-EyeQ는 스마트폰에 장착해 이용할 수 있는데 사용자를 알아보고 반응하는 기능을 한다. 미리 기억시킨 사용자의 얼굴이 화면을 향하기만 하면 스마트폰 화면이 저절로 켜지면서 그와 관련된 정보를 제공한다.

또한 입력된 얼굴이 사진인지 실제 사람인지도 구분할 수 있어 사용자의 얼굴 대신 사진을 보여주면 스마트폰은 반응하지 않는다.

유 교수는 “인공지능 반도체 프로세서가 4차 산업혁명시대를 주도할 것으로 기대된다”며 “이번 인공지능 칩과 인식기의 개발로 인해 세계시장에서 한국이 인공지능 산업의 주도권을 갖길 기대한다”고 말했다.

□ 사진 설명.

사진1. K-EYE 사진

사진2. K-EYEQ 사진

사진3. CNNP 칩 사진

2017.06.14 조회수 13922