-

차세대 새로운 패러다임 동영상 인식기술 개발

챗GPT와 같은 거대 언어 모델의 근간이 되는 트랜스포머로 구축된 기존 비디오 모델보다 8배 낮은 연산량과 4배 낮은 메모리 사용량으로도 높은 정확도를 기록했으며, 추론 속도 또한 기존 트랜스포머 기반 모델 대비 4배의 매우 빠른 속도를 달성한 동영상 인식기술이 우리 연구진에 의해 개발됐다.

우리 대학 전기및전자공학부 김창익 교수 연구팀이 초고효율 동영상 인식 모델 ‘비디오맘바(VideoMamba)’를 개발했다고 23일 밝혔다.

비디오맘바는 기존 트랜스포머 기반 모델들이 가지고 있는 높은 계산 복잡성을 해결하기 위해 설계된 새로운 동영상 인식 모델이다. 기존의 트랜스포머 기반 모델들은 셀프-어텐션(self-attention)이라는 메커니즘에 의존해 계산 복잡도가 제곱으로 증가하는 문제를 가지고 있었다.

김창익 교수 연구팀의 비디오맘바는 선택적 상태 공간 모델(Selective State Space Model, Selective SSM)* 메커니즘을 활용해 선형 복잡도**로 효율적인 처리가 가능하다. 이를 통해 비디오맘바는 동영상의 시공간적 정보를 효과적으로 포착해 긴 종속성을 가진 동영상 데이터도 효율적으로 처리할 수 있다.

*선택적 상태 공간 모델(Selective SSM): 입력에 따라 동적으로 매개변수를 조정하여 시퀀스 데이터의 문맥을 더 잘 이해하는 상태 공간 모델

**선형 복잡도:입력 데이터의 크기에 비례하여 계산량이 증가하는 알고리즘 복잡도

김창익 교수 연구팀은 동영상 인식 모델의 효율성을 극대화하기 위해 비디오맘바에 1차원 데이터 처리에 국한된 기존 선택적 상태 공간 메커니즘을 3차원 시공간 데이터 분석이 가능하도록 고도화한 시공간적 전방 및 후방 선택적 상태 공간 모델(spatio-temporal forward and backward SSM)을 도입했다. 이 모델은 순서가 없는 공간 정보와 순차적인 시간 정보를 효과적으로 통합해 인식 성능을 향상한다. 연구팀은 다양한 동영상 인식 벤치마크에서 비디오맘바의 성능을 검증했다.

연구팀이 개발한 비디오맘바는 영상 분석이 필요한 다양한 응용 분야에서 효율적이고 실용적인 솔루션을 제공할 수 있다. 예를 들어, 자율주행에서는 주행 영상을 분석해 도로 상황을 정확하게 파악하고, 보행자와 장애물을 실시간으로 인식해 사고를 예방할 수 있다. 의료 분야에서는 수술 영상을 분석해 환자의 상태를 실시간으로 모니터링하고 긴급 상황 발생 시 신속히 대처할 수 있다. 스포츠 분야에서는 경기 중 선수들의 움직임과 전술을 분석해 전략을 개선하고, 훈련 중 피로도나 부상 가능성을 실시간으로 감지해 예방할 수 있다.

연구를 주도한 김창익 교수는 “비디오맘바의 빠른 처리 속도와 낮은 메모리 사용량, 그리고 뛰어난 성능은 우리 생활에서의 다양한 동영상 활용 분야에 큰 장점을 제공할 것이다”고 연구의 의의를 설명했다.

이번 연구에는 전기및전자공학부 박진영 석박사통합과정, 김희선 박사과정, 고강욱 박사과정이 공동 제1 저자, 김민범 박사과정이 공동 저자, 그리고 전기및전자공학부 김창익 교수가 교신 저자로 참여했다. 연구 결과는 올해 9월 이탈리아 밀라노에서 열리는 컴퓨터 비전 분야 최우수 국제 학회 중 하나인 ‘European Conference on Computer Vision(ECCV) 2024’에서 발표될 예정이다. (논문명: VideoMamba: Spatio-Temporal Selective State Space Model)

한편, 이번 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행됐다. (No. 2020-0-00153, 기계학습 모델 보안 역기능 취약점 자동 탐지 및 방어 기술 개발)

차세대 새로운 패러다임 동영상 인식기술 개발

챗GPT와 같은 거대 언어 모델의 근간이 되는 트랜스포머로 구축된 기존 비디오 모델보다 8배 낮은 연산량과 4배 낮은 메모리 사용량으로도 높은 정확도를 기록했으며, 추론 속도 또한 기존 트랜스포머 기반 모델 대비 4배의 매우 빠른 속도를 달성한 동영상 인식기술이 우리 연구진에 의해 개발됐다.

우리 대학 전기및전자공학부 김창익 교수 연구팀이 초고효율 동영상 인식 모델 ‘비디오맘바(VideoMamba)’를 개발했다고 23일 밝혔다.

비디오맘바는 기존 트랜스포머 기반 모델들이 가지고 있는 높은 계산 복잡성을 해결하기 위해 설계된 새로운 동영상 인식 모델이다. 기존의 트랜스포머 기반 모델들은 셀프-어텐션(self-attention)이라는 메커니즘에 의존해 계산 복잡도가 제곱으로 증가하는 문제를 가지고 있었다.

김창익 교수 연구팀의 비디오맘바는 선택적 상태 공간 모델(Selective State Space Model, Selective SSM)* 메커니즘을 활용해 선형 복잡도**로 효율적인 처리가 가능하다. 이를 통해 비디오맘바는 동영상의 시공간적 정보를 효과적으로 포착해 긴 종속성을 가진 동영상 데이터도 효율적으로 처리할 수 있다.

*선택적 상태 공간 모델(Selective SSM): 입력에 따라 동적으로 매개변수를 조정하여 시퀀스 데이터의 문맥을 더 잘 이해하는 상태 공간 모델

**선형 복잡도:입력 데이터의 크기에 비례하여 계산량이 증가하는 알고리즘 복잡도

김창익 교수 연구팀은 동영상 인식 모델의 효율성을 극대화하기 위해 비디오맘바에 1차원 데이터 처리에 국한된 기존 선택적 상태 공간 메커니즘을 3차원 시공간 데이터 분석이 가능하도록 고도화한 시공간적 전방 및 후방 선택적 상태 공간 모델(spatio-temporal forward and backward SSM)을 도입했다. 이 모델은 순서가 없는 공간 정보와 순차적인 시간 정보를 효과적으로 통합해 인식 성능을 향상한다. 연구팀은 다양한 동영상 인식 벤치마크에서 비디오맘바의 성능을 검증했다.

연구팀이 개발한 비디오맘바는 영상 분석이 필요한 다양한 응용 분야에서 효율적이고 실용적인 솔루션을 제공할 수 있다. 예를 들어, 자율주행에서는 주행 영상을 분석해 도로 상황을 정확하게 파악하고, 보행자와 장애물을 실시간으로 인식해 사고를 예방할 수 있다. 의료 분야에서는 수술 영상을 분석해 환자의 상태를 실시간으로 모니터링하고 긴급 상황 발생 시 신속히 대처할 수 있다. 스포츠 분야에서는 경기 중 선수들의 움직임과 전술을 분석해 전략을 개선하고, 훈련 중 피로도나 부상 가능성을 실시간으로 감지해 예방할 수 있다.

연구를 주도한 김창익 교수는 “비디오맘바의 빠른 처리 속도와 낮은 메모리 사용량, 그리고 뛰어난 성능은 우리 생활에서의 다양한 동영상 활용 분야에 큰 장점을 제공할 것이다”고 연구의 의의를 설명했다.

이번 연구에는 전기및전자공학부 박진영 석박사통합과정, 김희선 박사과정, 고강욱 박사과정이 공동 제1 저자, 김민범 박사과정이 공동 저자, 그리고 전기및전자공학부 김창익 교수가 교신 저자로 참여했다. 연구 결과는 올해 9월 이탈리아 밀라노에서 열리는 컴퓨터 비전 분야 최우수 국제 학회 중 하나인 ‘European Conference on Computer Vision(ECCV) 2024’에서 발표될 예정이다. (논문명: VideoMamba: Spatio-Temporal Selective State Space Model)

한편, 이번 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행됐다. (No. 2020-0-00153, 기계학습 모델 보안 역기능 취약점 자동 탐지 및 방어 기술 개발)

2024.07.23

조회수 462

-

인공지능으로 배터리 원소, 충방전 상태 인식

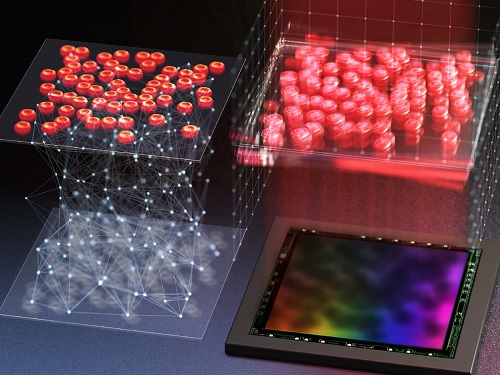

국제공동연구진이 인공지능 학습을 통해 배터리의 표면 형상만 보고 각 원소의 함량 그리고 충·방전 횟수에 대한 정보를 높은 정확도로 알아내는 영상인식 기술을 개발하여 화제다.

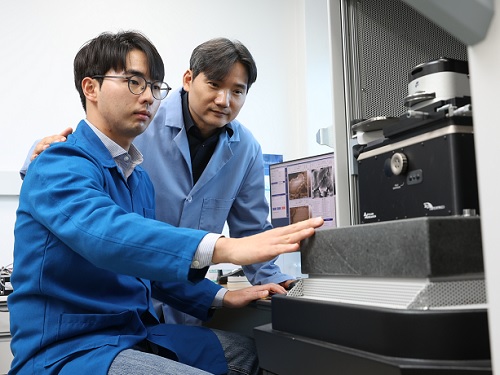

우리 대학 신소재공학과 홍승범 교수가 한국전자통신연구원(ETRI), 미국 드렉셀대학과 공동연구를 통해 다양한 조성과 각기 다른 충·방전 사이클의 NCM 양극재 주사전자현미경 사진을 합성곱 신경망* 기반 인공지능에 학습시켜 주요 원소 함량과 충·방전 상태를 99.6%의 높은 정확도로 맞추는 방법론을 세계 최초로 개발했다고 2일 밝혔다.

*합성곱 신경망(콘볼루션 신경망, Convolutional Neural Network, CNN): 시각적 영상을 분석하는 데 사용되는 다층의 피드-포워드적인 인공신경망의 한 종류이다.

연구팀은 반도체 공정에서는 웨이퍼의 불량 검수를 위해 주사전자현미경(SEM)을 사용하는 반면 배터리 공정에서는 그런 경우가 드물고 연구 현장에서만 입자의 크기 분석을 위해 SEM을 활용하고, 열화된 배터리 소재의 경우 입자가 깨지고 부서지는 형상으로부터 신뢰성을 예측하는 것에 착안했다. 연구팀은 반도체 공정에서와 같이 배터리 공정도 자동화된 SEM으로 양극재 표면을 검수해서 원하는 조성대로 합성이 되었는지 수명은 신뢰성 있게 나올 것인지를 확인해 불량률을 줄일 수 있다면 획기적일 것으로 판단했다.

연구진은 자율주행차에 적용가능한 합성곱 신경망 기반 인공지능에 배터리 소재의 표면 영상을 학습시켜서 양극재의 주 원소 함량과 충·방전 사이클 상태를 예측할 수 있게 했다. 이런 방법론이 첨가제가 들어간 양극재에도 적용가능한 지 확인한 결과 함량은 상당히 정확하게 예측하는 반면 충·방전 상태는 정확도가 낮다는 단점을 알게 됐다. 이에 연구팀은 향후 다양한 공정을 통해서 만든 배터리 소재의 형상을 학습시켜 차세대 배터리의 조성 균일성 검수 및 수명 예측에 활용할 계획이다.

연구를 이끈 홍승범 교수는 “이번 연구는 세계 최초로 마이크론 스케일의 주사전자현미경 사진의 소재 구조 데이터를 통해 주 원소 함량과 충·방전 상태를 빠르고 정확하게 예측할 수 있는 인공지능 기반 방법론을 개발한 데 의의가 있고 이번 연구에서 개발된 현미경 영상 기반 배터리 소재의 함량 및 상태 감별 방법론은 향후 배터리 소재의 성능과 품질을 향상하는 데 중요한 역할을 하게 될 것으로 기대된다”고 전망했다.

한편, 이번 연구는 공동 제1 저자인 신소재공학과 졸업생 오지민 박사와 염지원 박사와 공동저자인 ETRI 김광만 박사와 미국 드렉셀 대학교 아가르(Agar) 교수가 참여하였고, 한국연구재단(2020M3H4A3081880, RS-2023-00247245), KAIST 글로벌특이점 사업의 지원 및 미국 연구진과의 국제공동연구를 통해 수행됐으며, 국제 학술지 ‘엔피제이 컴퓨테이셔날 머티리얼즈(npj computational materials)’에 지난 5월 4일 자 출판됐다. (논문 제목: Composition and state prediction of lithium-ion cathode via convolutional neural network trained on scanning electron microscopy images)

인공지능으로 배터리 원소, 충방전 상태 인식

국제공동연구진이 인공지능 학습을 통해 배터리의 표면 형상만 보고 각 원소의 함량 그리고 충·방전 횟수에 대한 정보를 높은 정확도로 알아내는 영상인식 기술을 개발하여 화제다.

우리 대학 신소재공학과 홍승범 교수가 한국전자통신연구원(ETRI), 미국 드렉셀대학과 공동연구를 통해 다양한 조성과 각기 다른 충·방전 사이클의 NCM 양극재 주사전자현미경 사진을 합성곱 신경망* 기반 인공지능에 학습시켜 주요 원소 함량과 충·방전 상태를 99.6%의 높은 정확도로 맞추는 방법론을 세계 최초로 개발했다고 2일 밝혔다.

*합성곱 신경망(콘볼루션 신경망, Convolutional Neural Network, CNN): 시각적 영상을 분석하는 데 사용되는 다층의 피드-포워드적인 인공신경망의 한 종류이다.

연구팀은 반도체 공정에서는 웨이퍼의 불량 검수를 위해 주사전자현미경(SEM)을 사용하는 반면 배터리 공정에서는 그런 경우가 드물고 연구 현장에서만 입자의 크기 분석을 위해 SEM을 활용하고, 열화된 배터리 소재의 경우 입자가 깨지고 부서지는 형상으로부터 신뢰성을 예측하는 것에 착안했다. 연구팀은 반도체 공정에서와 같이 배터리 공정도 자동화된 SEM으로 양극재 표면을 검수해서 원하는 조성대로 합성이 되었는지 수명은 신뢰성 있게 나올 것인지를 확인해 불량률을 줄일 수 있다면 획기적일 것으로 판단했다.

연구진은 자율주행차에 적용가능한 합성곱 신경망 기반 인공지능에 배터리 소재의 표면 영상을 학습시켜서 양극재의 주 원소 함량과 충·방전 사이클 상태를 예측할 수 있게 했다. 이런 방법론이 첨가제가 들어간 양극재에도 적용가능한 지 확인한 결과 함량은 상당히 정확하게 예측하는 반면 충·방전 상태는 정확도가 낮다는 단점을 알게 됐다. 이에 연구팀은 향후 다양한 공정을 통해서 만든 배터리 소재의 형상을 학습시켜 차세대 배터리의 조성 균일성 검수 및 수명 예측에 활용할 계획이다.

연구를 이끈 홍승범 교수는 “이번 연구는 세계 최초로 마이크론 스케일의 주사전자현미경 사진의 소재 구조 데이터를 통해 주 원소 함량과 충·방전 상태를 빠르고 정확하게 예측할 수 있는 인공지능 기반 방법론을 개발한 데 의의가 있고 이번 연구에서 개발된 현미경 영상 기반 배터리 소재의 함량 및 상태 감별 방법론은 향후 배터리 소재의 성능과 품질을 향상하는 데 중요한 역할을 하게 될 것으로 기대된다”고 전망했다.

한편, 이번 연구는 공동 제1 저자인 신소재공학과 졸업생 오지민 박사와 염지원 박사와 공동저자인 ETRI 김광만 박사와 미국 드렉셀 대학교 아가르(Agar) 교수가 참여하였고, 한국연구재단(2020M3H4A3081880, RS-2023-00247245), KAIST 글로벌특이점 사업의 지원 및 미국 연구진과의 국제공동연구를 통해 수행됐으며, 국제 학술지 ‘엔피제이 컴퓨테이셔날 머티리얼즈(npj computational materials)’에 지난 5월 4일 자 출판됐다. (논문 제목: Composition and state prediction of lithium-ion cathode via convolutional neural network trained on scanning electron microscopy images)

2024.07.02

조회수 691

-

KAIST미술관이 기획한 롯데월드 서울스카이 초청 전시, “다누리의 스펙타클 365”

우리 대학이 이달 20일부터 대한민국 최초의 달 탐사선인 다누리의 달 궤도 임무운영 1주년을 기념하기 위한 전시회를 ㈜롯데월드 서울스카이(SEOUL SKY)에서 개최한다. '다누리의 스펙타클 365'는 KAIST 미술관이 지난 6월부터 8월까지 본교 창의학습관에서 진행했던 '다누리의 스펙타클' 전시의 연장선이다. 대한민국 항공우주산업의 연구성과를 전시해 우주여행에 대한 간접 체험을 제공하고 미디어아트와 다누리 촬영 작품을 통해 우주과학 기술에 대한 관람객의 상상력을 자극하기 위해 기획됐다.

㈜롯데월드 서울스카이의 초청을 받아 규모를 확장해 진행하는 이번 전시는 서울스카이 곳곳에 작품을 설치해 관람객을 맞이하는 것이 가장 큰 특징이다. 120층 메인홀에는 국내 최초로 지구와 달을 동시에 촬영한 작품과 다누리 모형을 배치해 작품을 통해 다누리가 바라본 우주의 모습을 입체적으로 감상할 수 있게 공간을 구성했다. 전시장 안쪽으로는 달 궤도 진입 후 조우한 달의 모습과 미국 아르테미스 유인 미션 착륙 후보지 등의 작품이 전시된다.

120층 전시장으로 향하는 지하 1층 매표소에는 발사체가 우주로 진입하는 영상을 배치해 우주여행을 떠나는 듯한 몰입감을 극대화했다. 지하 2층에는 모션그래픽을 활용한 영상작품을 감상할 수 있는 미디어월이 설치됐다. 다누리가 촬영한 지구와 달을 배치해 관람객에게 공전 및 자전을 관측하는 듯한 경험을 선사하고 통로 측에는 인공위성 관제실 그래픽과 다누리 발사 당시 음향을 활용해 다누리의 발사에 함께하는 듯한 현장감을 더했다.

이외에도 대한민국 우주과학 기술의 여정을 대중에게 소개하기 위해 KAIST 인공위성연구소가 개발한 우리나라 최초 인공위성 우리별 1호도 전시된다. 석현정 KAIST 미술관장은 "이번 전시는 과학기술의 결과물을 감상이 가능한 콘텐츠로 만들어내 관람객들이 예술적 감동을 느낄 수 있도록 공간을 구성했다"라고 전했다. 이어 석 관장은 "다누리의 달 궤도 임무운영 1주년을 기념하는 이 특별한 순간을 함께 나누는 전시 관람을 통해 대한민국 우주과학 기술의 성과를 체감하고 우주를 향한 우리의 도전에도 많은 관심과 응원 부탁드린다"라고 덧붙였다. 한편, '다누리의 스펙타클 365' 전시회는 KAIST 미술관이 한국항공우주연구원, 과학기술정보통신부와 함께 공동 주관·주최한다. KAIST 인공위성연구소, 한국연구재단이 참여하고 ㈜롯데월드 서울스카이가 후원하며, 오는 1월 31일(수)까지 ㈜롯데월드 서울스카이 입장객에게 무료로 공개된다.

KAIST미술관이 기획한 롯데월드 서울스카이 초청 전시, “다누리의 스펙타클 365”

우리 대학이 이달 20일부터 대한민국 최초의 달 탐사선인 다누리의 달 궤도 임무운영 1주년을 기념하기 위한 전시회를 ㈜롯데월드 서울스카이(SEOUL SKY)에서 개최한다. '다누리의 스펙타클 365'는 KAIST 미술관이 지난 6월부터 8월까지 본교 창의학습관에서 진행했던 '다누리의 스펙타클' 전시의 연장선이다. 대한민국 항공우주산업의 연구성과를 전시해 우주여행에 대한 간접 체험을 제공하고 미디어아트와 다누리 촬영 작품을 통해 우주과학 기술에 대한 관람객의 상상력을 자극하기 위해 기획됐다.

㈜롯데월드 서울스카이의 초청을 받아 규모를 확장해 진행하는 이번 전시는 서울스카이 곳곳에 작품을 설치해 관람객을 맞이하는 것이 가장 큰 특징이다. 120층 메인홀에는 국내 최초로 지구와 달을 동시에 촬영한 작품과 다누리 모형을 배치해 작품을 통해 다누리가 바라본 우주의 모습을 입체적으로 감상할 수 있게 공간을 구성했다. 전시장 안쪽으로는 달 궤도 진입 후 조우한 달의 모습과 미국 아르테미스 유인 미션 착륙 후보지 등의 작품이 전시된다.

120층 전시장으로 향하는 지하 1층 매표소에는 발사체가 우주로 진입하는 영상을 배치해 우주여행을 떠나는 듯한 몰입감을 극대화했다. 지하 2층에는 모션그래픽을 활용한 영상작품을 감상할 수 있는 미디어월이 설치됐다. 다누리가 촬영한 지구와 달을 배치해 관람객에게 공전 및 자전을 관측하는 듯한 경험을 선사하고 통로 측에는 인공위성 관제실 그래픽과 다누리 발사 당시 음향을 활용해 다누리의 발사에 함께하는 듯한 현장감을 더했다.

이외에도 대한민국 우주과학 기술의 여정을 대중에게 소개하기 위해 KAIST 인공위성연구소가 개발한 우리나라 최초 인공위성 우리별 1호도 전시된다. 석현정 KAIST 미술관장은 "이번 전시는 과학기술의 결과물을 감상이 가능한 콘텐츠로 만들어내 관람객들이 예술적 감동을 느낄 수 있도록 공간을 구성했다"라고 전했다. 이어 석 관장은 "다누리의 달 궤도 임무운영 1주년을 기념하는 이 특별한 순간을 함께 나누는 전시 관람을 통해 대한민국 우주과학 기술의 성과를 체감하고 우주를 향한 우리의 도전에도 많은 관심과 응원 부탁드린다"라고 덧붙였다. 한편, '다누리의 스펙타클 365' 전시회는 KAIST 미술관이 한국항공우주연구원, 과학기술정보통신부와 함께 공동 주관·주최한다. KAIST 인공위성연구소, 한국연구재단이 참여하고 ㈜롯데월드 서울스카이가 후원하며, 오는 1월 31일(수)까지 ㈜롯데월드 서울스카이 입장객에게 무료로 공개된다.

2023.12.19

조회수 2295

-

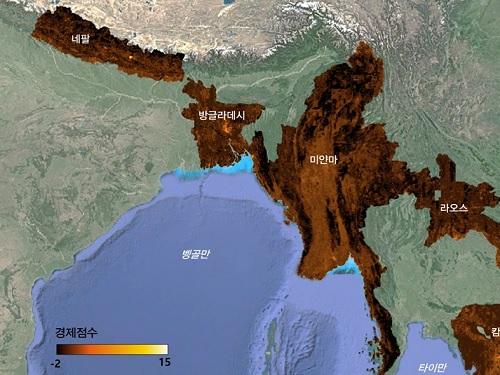

인공지능으로 북한 등 경제지표 추정하다

유엔기구(UN)의 지속가능발전목표(SDGs)에 따르면 하루 2달러 이하로 생활하는 절대빈곤 인구가 7억 명에 달하지만 그 빈곤의 현황을 제대로 파악하기는 쉽지 않다. 전 세계 중 53개국은 지난 15년 동안 농업 관련 현황 조사를 하지 못했으며, 17개국은 인구 센서스(인구주택 총조사)조차 진행하지 못했다. 이러한 데이터 부족을 극복하려는 시도로, 누구나 웹에서 받아볼 수 있는 인공위성 영상을 활용해 경제 지표를 추정하는 기술이 주목받고 있다.

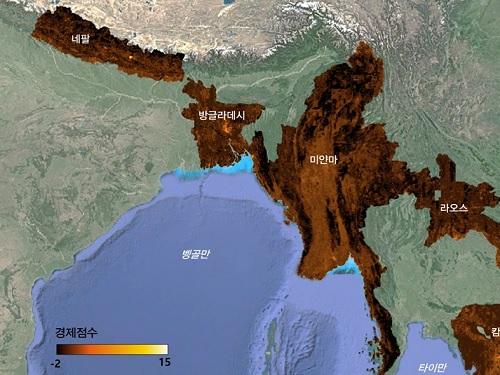

우리 대학 차미영-김지희 교수 연구팀이 기초과학연구원, 서강대, 홍콩과기대(HKUST), 싱가포르국립대(NUS)와 국제공동연구를 통해 주간 위성영상을 활용해 경제 상황을 분석하는 새로운 인공지능(AI) 기법을 개발했다고 21일 밝혔다. 연구팀이 주목한 것은 기존 통계자료를 기반으로 학습하는 일반적인 환경이 아닌, 기초 통계도 미비한 최빈국(最貧國)까지 모니터링할 수 있는 범용적인 모델이다.

연구팀은 유럽우주국(ESA)이 운용하며 무료로 공개하는 센티넬-2(Sentinel-2) 위성영상을 활용했다. 연구팀은 먼저 위성영상을 약 6제곱킬로미터(2.5×2.5㎢)의 작은 구역으로 세밀하게 분할한 후, 각 구역의 경제 지표를 건물, 도로, 녹지 등의 시각적 정보를 기반으로 AI 기법을 통해 수치화했다.

이번 연구 모델이 이전 연구와 차별화된 점은 기초 데이터가 부족한 지역에도 적용할 수 있게끔 인간이 제시하는 정보를 인공지능의 예측에 반영하는 `인간-기계 협업 알고리즘'에 있다. 즉, 인간이 위성영상을 보고 경제 활동의 많고 적음을 비교하면, 기계는 이러한 인간이 제공한 정보를 학습하여 각각의 영상자료에 경제 점수를 부여한다. 검증 결과, 기계학습만 사용했을 때보다 인간과 협업할 경우 성능이 월등히 우수했다.

이번 연구를 통해 연구팀은 기존 통계자료가 부족한 지역까지 경제분석의 범위를 확장하고, 북한 및 아시아 5개국(네팔, 라오스, 미얀마, 방글라데시, 캄보디아)에도 같은 기술을 적용하여 세밀한 경제 지표 점수를 공개했다. (그림 1) 이 연구가 제시한 경제 지표는 기존의 인구밀도, 고용 수, 사업체 수 등의 사회경제지표와 높은 상관관계를 보였으며, 데이터가 부족한 저개발국가에 적용 가능함을 연구팀은 확인했다.

이러한 변화탐지를 북한에 적용한 결과, 대북 경제제재가 심화된 2016년과 2019년 사이에 북한 경제에서 세 가지 경향을 발견할 수 있었다. 첫째, 북한의 경제 발전은 평양과 대도시에 더욱 집중되어 도시와 농촌 간 격차가 심화됐다. 둘째, 경제제재와 달러 외환의 부족을 극복하기 위해 설치한 관광 경제개발구에서는 새로운 건물 건설 등 유의미한 변화가 위성영상 이미지와 연구의 경제 지표 점수 변화에서 드러났다. 셋째, 전통적인 공업 및 수출 경제개발구 유형에서는 반대로 변화가 미미한 것으로 확인됐다.

연구에 참여한 우리 대학 전산학부·IBS 데이터사이언스그룹 CI 차미영 교수는 "전산학, 경제학, 지리학이 융합된 이번 연구는 범지구적 차원의 빈곤 문제를 다룬다는 점에서 중요한 의미가 있으며, 이번에 개발한 인공지능 알고리즘을 앞으로 이산화탄소 배출량, 재해재난 피해 탐지, 기후 변화로 인한 영향 등 다양한 국제사회 문제에 적용해 볼 계획이다ˮ 라고 말했다.

이 연구에는 경제학자인 우리 대학 기술경영학부 김지희 교수, 서강대 경제학과 양현주 교수, 홍콩과기대 박상윤 교수도 함께 참여하였다. 이들은 “이 모델은 저비용으로 개발도상국의 경제 상황을 상세하게 확인할 수 있어 국제개발협력(ODA) 사업에 도움을 줄 수 있을 것으로 예상된다”며 “이번 연구가 선진국과 후진국 간의 데이터 격차를 줄이고 유엔과 국제사회의 공동목표인 지속가능한 발전을 달성하는 데 기여할 수 있기를 바란다ˮ고 밝혔다.

위성영상과 인공지능을 활용한 SDGs 지표의 개발과 이의 정책적 활용은 국제적인 주목을 받고 있는 기술 분야 중 하나이며 한국이 앞으로 주도권을 가지고 이끌 수 있는 연구 분야이다. 이에 연구팀은 개발한 모델 코드를 무료로 공개하며, 측정한 지표가 여러 국가의 정책 설계 및 평가에 유용하게 사용될 수 있도록 앞으로도 기술을 개선하고 매해 새롭게 업데이트되는 인공위성 영상에 적용하여 공개할 계획이다.

한편 이번 연구 결과는 전산학부 안동현 박사과정, 싱가포르 국립대 양재석 박사과정이 공동 1저자로 국제 학술지 네이처 출판 그룹의 `네이처 커뮤니케이션즈(Nature Communications)'에 지난 10월 26일 자 게재됐다. (논문명: A human-machine collaborative approach measures economic development using satellite imagery, 인간-기계 협업과 위성영상 분석에 기반한 경제 발전 측정).

논문링크: https://www.nature.com/articles/s41467-023-42122-8

인공지능으로 북한 등 경제지표 추정하다

유엔기구(UN)의 지속가능발전목표(SDGs)에 따르면 하루 2달러 이하로 생활하는 절대빈곤 인구가 7억 명에 달하지만 그 빈곤의 현황을 제대로 파악하기는 쉽지 않다. 전 세계 중 53개국은 지난 15년 동안 농업 관련 현황 조사를 하지 못했으며, 17개국은 인구 센서스(인구주택 총조사)조차 진행하지 못했다. 이러한 데이터 부족을 극복하려는 시도로, 누구나 웹에서 받아볼 수 있는 인공위성 영상을 활용해 경제 지표를 추정하는 기술이 주목받고 있다.

우리 대학 차미영-김지희 교수 연구팀이 기초과학연구원, 서강대, 홍콩과기대(HKUST), 싱가포르국립대(NUS)와 국제공동연구를 통해 주간 위성영상을 활용해 경제 상황을 분석하는 새로운 인공지능(AI) 기법을 개발했다고 21일 밝혔다. 연구팀이 주목한 것은 기존 통계자료를 기반으로 학습하는 일반적인 환경이 아닌, 기초 통계도 미비한 최빈국(最貧國)까지 모니터링할 수 있는 범용적인 모델이다.

연구팀은 유럽우주국(ESA)이 운용하며 무료로 공개하는 센티넬-2(Sentinel-2) 위성영상을 활용했다. 연구팀은 먼저 위성영상을 약 6제곱킬로미터(2.5×2.5㎢)의 작은 구역으로 세밀하게 분할한 후, 각 구역의 경제 지표를 건물, 도로, 녹지 등의 시각적 정보를 기반으로 AI 기법을 통해 수치화했다.

이번 연구 모델이 이전 연구와 차별화된 점은 기초 데이터가 부족한 지역에도 적용할 수 있게끔 인간이 제시하는 정보를 인공지능의 예측에 반영하는 `인간-기계 협업 알고리즘'에 있다. 즉, 인간이 위성영상을 보고 경제 활동의 많고 적음을 비교하면, 기계는 이러한 인간이 제공한 정보를 학습하여 각각의 영상자료에 경제 점수를 부여한다. 검증 결과, 기계학습만 사용했을 때보다 인간과 협업할 경우 성능이 월등히 우수했다.

이번 연구를 통해 연구팀은 기존 통계자료가 부족한 지역까지 경제분석의 범위를 확장하고, 북한 및 아시아 5개국(네팔, 라오스, 미얀마, 방글라데시, 캄보디아)에도 같은 기술을 적용하여 세밀한 경제 지표 점수를 공개했다. (그림 1) 이 연구가 제시한 경제 지표는 기존의 인구밀도, 고용 수, 사업체 수 등의 사회경제지표와 높은 상관관계를 보였으며, 데이터가 부족한 저개발국가에 적용 가능함을 연구팀은 확인했다.

이러한 변화탐지를 북한에 적용한 결과, 대북 경제제재가 심화된 2016년과 2019년 사이에 북한 경제에서 세 가지 경향을 발견할 수 있었다. 첫째, 북한의 경제 발전은 평양과 대도시에 더욱 집중되어 도시와 농촌 간 격차가 심화됐다. 둘째, 경제제재와 달러 외환의 부족을 극복하기 위해 설치한 관광 경제개발구에서는 새로운 건물 건설 등 유의미한 변화가 위성영상 이미지와 연구의 경제 지표 점수 변화에서 드러났다. 셋째, 전통적인 공업 및 수출 경제개발구 유형에서는 반대로 변화가 미미한 것으로 확인됐다.

연구에 참여한 우리 대학 전산학부·IBS 데이터사이언스그룹 CI 차미영 교수는 "전산학, 경제학, 지리학이 융합된 이번 연구는 범지구적 차원의 빈곤 문제를 다룬다는 점에서 중요한 의미가 있으며, 이번에 개발한 인공지능 알고리즘을 앞으로 이산화탄소 배출량, 재해재난 피해 탐지, 기후 변화로 인한 영향 등 다양한 국제사회 문제에 적용해 볼 계획이다ˮ 라고 말했다.

이 연구에는 경제학자인 우리 대학 기술경영학부 김지희 교수, 서강대 경제학과 양현주 교수, 홍콩과기대 박상윤 교수도 함께 참여하였다. 이들은 “이 모델은 저비용으로 개발도상국의 경제 상황을 상세하게 확인할 수 있어 국제개발협력(ODA) 사업에 도움을 줄 수 있을 것으로 예상된다”며 “이번 연구가 선진국과 후진국 간의 데이터 격차를 줄이고 유엔과 국제사회의 공동목표인 지속가능한 발전을 달성하는 데 기여할 수 있기를 바란다ˮ고 밝혔다.

위성영상과 인공지능을 활용한 SDGs 지표의 개발과 이의 정책적 활용은 국제적인 주목을 받고 있는 기술 분야 중 하나이며 한국이 앞으로 주도권을 가지고 이끌 수 있는 연구 분야이다. 이에 연구팀은 개발한 모델 코드를 무료로 공개하며, 측정한 지표가 여러 국가의 정책 설계 및 평가에 유용하게 사용될 수 있도록 앞으로도 기술을 개선하고 매해 새롭게 업데이트되는 인공위성 영상에 적용하여 공개할 계획이다.

한편 이번 연구 결과는 전산학부 안동현 박사과정, 싱가포르 국립대 양재석 박사과정이 공동 1저자로 국제 학술지 네이처 출판 그룹의 `네이처 커뮤니케이션즈(Nature Communications)'에 지난 10월 26일 자 게재됐다. (논문명: A human-machine collaborative approach measures economic development using satellite imagery, 인간-기계 협업과 위성영상 분석에 기반한 경제 발전 측정).

논문링크: https://www.nature.com/articles/s41467-023-42122-8

2023.11.21

조회수 2842

-

고용량 배터리 수명 증대 영상화하다

전기자동차에서 볼 수 있는 고용량 배터리에 사용되고 있는 실리콘 활물질은 기존 음극 활물질인 흑연 대비 높은 용량 값(4200 mAh/g)을 갖고 있으나, 충전 및 방전 간 400%에 달하는 높은 부피 팽창/수축률이 배터리 수명에 악영향을 미치고 있다. 이를 해결하기 위해서 단일벽 탄소나노튜브를 소량 첨가해 수명 특성이 향상되는 결과를 얻었는데, 이런 향상이 어떻게 가능한지 나노스케일에서 영상화한 연구 결과가 공개됐다.

우리 대학 신소재공학과 홍승범 교수 연구팀이 LG에너지솔루션과 협업해 배터리의 수명 특성 향상 메커니즘 영상화 결과를 국제학술지‘에이씨에스 에너지 레터스(ACS Energy Letters, Impact Factor: 22)’에 게재했다고 19일 밝혔다. (논문명: Spatially Uniform Lithiation Enabled by Single-Walled Carbon Nanotubes)

연구팀은 이전에는 실리콘 활물질이 충·방전을 거치면서 전자 전도 네트워크가 열화되는 과정을 영상화하였는데, 이번 연구에서는 단일벽 탄소나노튜브의 존재로 인해서 그 형태를 유지하고 있는 전자전도 네트워크가 활물질 내에 균일한 충·방전이 가능하도록 기능하고 있음을 보여 수명 증대 메커니즘을 검증했다.

구체적으로 연구팀은 원자간력 현미경(Atomic Force Microscopy) 기반의 켈빈 프루브 현미경(Kelvin Probe Force Microscopy)를 이용해 1회 및 90회 충·방전 싸이클 후의 전극 내 천연흑연과 실리콘 산화물 입자에서의 표면 전위를 측정 및 영상화했다. 이를 통해 단일벽 탄소나노튜브(Single-Walled Carbon Nanotube, SW-CNT)가 첨가된 전극에서는 활물질 내 표면 전위가 균일하게 분포하고 있는 반면, 첨가되지 않은 기존 전극의 경우에는 90회 충·방전 후에 불균일한 표면전위를 보여, 전자 전도 네트워크가 제대로 기능을 발휘하지 않아 불균일한 충·방전이 됨을 연구팀은 확인했다.

이처럼 활물질 내부의 표면 전하를 영상화할 수 있는 기술은 실리콘 활물질 뿐만 아니라, 다양한 전극 시스템에 적용될 수 있으며, 향후 배터리 충전 및 방전 상태 균일성을 확인하고 수명 향상 연구로 발전할 수 있다.

이번 연구의 제1 저자인 신소재공학과 박건 연구원은 “충·방전 시 수반되는 실리콘 계열 활물질의 급격한 부피 변화에도 불구하고 가느다란 탄소나노튜브가 전자 전도 채널을 유지하고 이로 인해 전극 내에 균일한 충·방전을 가능케하는 것이 매우 신기한 일이었는데, 이를 나노스케일에서 직접 영상화해 그 역할을 미시세계에서 이해할 수 있었던 것이 큰 의미가 있다”라고 말했다. 교신 저자인 홍승범 교수는 “원자간력 현미경을 활용해서 나노스케일에서 일어나는 전기화학적인 현상을 영상화하고 이를 통해서 배터리 성능 및 수명을 향상할 수 있는 혁신적인 아이디어를 창출할 수 있게 되어 매우 기쁘다”라고 말했다.

이번 연구는 LG에너지솔루션, LG에너지솔루션-KAIST Frontier Research Lab.과 KAIST 글로벌 특이점 사업의 지원을 받아 수행됐다.

고용량 배터리 수명 증대 영상화하다

전기자동차에서 볼 수 있는 고용량 배터리에 사용되고 있는 실리콘 활물질은 기존 음극 활물질인 흑연 대비 높은 용량 값(4200 mAh/g)을 갖고 있으나, 충전 및 방전 간 400%에 달하는 높은 부피 팽창/수축률이 배터리 수명에 악영향을 미치고 있다. 이를 해결하기 위해서 단일벽 탄소나노튜브를 소량 첨가해 수명 특성이 향상되는 결과를 얻었는데, 이런 향상이 어떻게 가능한지 나노스케일에서 영상화한 연구 결과가 공개됐다.

우리 대학 신소재공학과 홍승범 교수 연구팀이 LG에너지솔루션과 협업해 배터리의 수명 특성 향상 메커니즘 영상화 결과를 국제학술지‘에이씨에스 에너지 레터스(ACS Energy Letters, Impact Factor: 22)’에 게재했다고 19일 밝혔다. (논문명: Spatially Uniform Lithiation Enabled by Single-Walled Carbon Nanotubes)

연구팀은 이전에는 실리콘 활물질이 충·방전을 거치면서 전자 전도 네트워크가 열화되는 과정을 영상화하였는데, 이번 연구에서는 단일벽 탄소나노튜브의 존재로 인해서 그 형태를 유지하고 있는 전자전도 네트워크가 활물질 내에 균일한 충·방전이 가능하도록 기능하고 있음을 보여 수명 증대 메커니즘을 검증했다.

구체적으로 연구팀은 원자간력 현미경(Atomic Force Microscopy) 기반의 켈빈 프루브 현미경(Kelvin Probe Force Microscopy)를 이용해 1회 및 90회 충·방전 싸이클 후의 전극 내 천연흑연과 실리콘 산화물 입자에서의 표면 전위를 측정 및 영상화했다. 이를 통해 단일벽 탄소나노튜브(Single-Walled Carbon Nanotube, SW-CNT)가 첨가된 전극에서는 활물질 내 표면 전위가 균일하게 분포하고 있는 반면, 첨가되지 않은 기존 전극의 경우에는 90회 충·방전 후에 불균일한 표면전위를 보여, 전자 전도 네트워크가 제대로 기능을 발휘하지 않아 불균일한 충·방전이 됨을 연구팀은 확인했다.

이처럼 활물질 내부의 표면 전하를 영상화할 수 있는 기술은 실리콘 활물질 뿐만 아니라, 다양한 전극 시스템에 적용될 수 있으며, 향후 배터리 충전 및 방전 상태 균일성을 확인하고 수명 향상 연구로 발전할 수 있다.

이번 연구의 제1 저자인 신소재공학과 박건 연구원은 “충·방전 시 수반되는 실리콘 계열 활물질의 급격한 부피 변화에도 불구하고 가느다란 탄소나노튜브가 전자 전도 채널을 유지하고 이로 인해 전극 내에 균일한 충·방전을 가능케하는 것이 매우 신기한 일이었는데, 이를 나노스케일에서 직접 영상화해 그 역할을 미시세계에서 이해할 수 있었던 것이 큰 의미가 있다”라고 말했다. 교신 저자인 홍승범 교수는 “원자간력 현미경을 활용해서 나노스케일에서 일어나는 전기화학적인 현상을 영상화하고 이를 통해서 배터리 성능 및 수명을 향상할 수 있는 혁신적인 아이디어를 창출할 수 있게 되어 매우 기쁘다”라고 말했다.

이번 연구는 LG에너지솔루션, LG에너지솔루션-KAIST Frontier Research Lab.과 KAIST 글로벌 특이점 사업의 지원을 받아 수행됐다.

2023.09.19

조회수 2709

-

차세대소형위성 2호 성공적 관측영상 공개

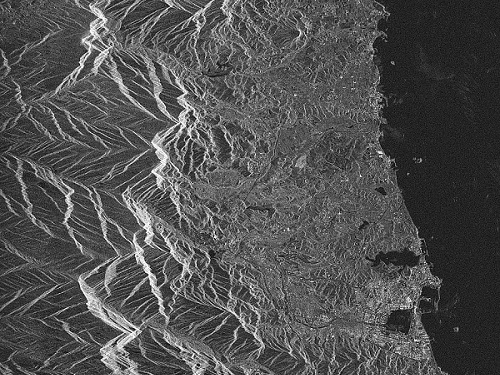

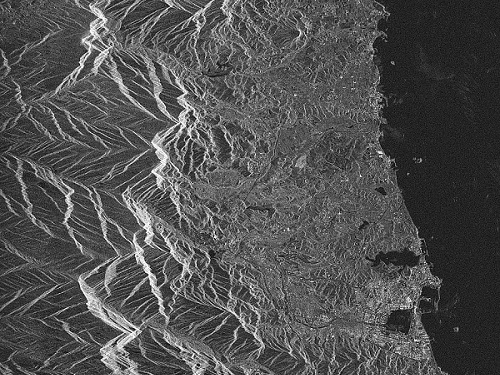

우리 대학은 지난 5월 25일 나로우주센터에서 발사된 누리호 3차 주탑재 위성인 차세대소형위성 2호에 대한 초기 운영을 완수했다고 5일 밝혔다.

차세대소형위성 2호는 2023년 5월 25일 18시 24분에 발사된 후 고도 550km 궤도에 안착했으며, KAIST는 지난 3개월 동안 차세대소형위성 2호에 대한 초기 운영을 통해 위성 본체, 탑재체, 지상국 전반에 걸친 기능 점검과 시스템 안정화 및 탑재체 시험 관측을 모두 수행했다.

초기 운영 기간 중 KAIST 인공위성연구소는 주 탑재체인 ‘영상레이다 (SAR: Synthetic Aperture Radar)’로 전 세계 여러 곳을 시험 촬영하는 데 성공했으며, 초기 운영 종료 시점에 즈음하여 대표적인 시험 관측 영상을 공개했다.

영상레이다는 전파를 지상으로 쏜 후 지상에서 산란되어 되돌아온 전파를 수신하여 신호처리를 통해 영상을 얻기 때문에 주·야간 빛의 영향을 받지 않으며 구름 등 기상 상황과 관계없이 지상관측을 수행할 수 있다. 공개된 시험 관측 영상은 초기 운영 기간 중 영상레이다 탑재체 시험 운영 과정에서 촬영된 영상으로서, 가시광선이 아닌 마이크로파(microwave)로 바라본 세상을 담고 있는 것이 특징이다.

또한 초기 운영 기간 중 과학 탑재체 ‘레오도스 (LEO-DOS)’의 기능을 점검하고 정상적인 작동상태를 확인하였으며, 시험 운영을 통해 우주방사선 관측자료를 확보했다. 한국천문연구원(원장 박영득)이 개발한 근지구궤도 우주방사선 관측장비 ‘레오도스 (LEO-DOS: Low-Earth Orbit space radiation DOSimeter)’가 시험 운영기간 동안 획득한 전 지구 우주방사선 등가선량 지도를 공개했다.

아울러 KAIST 인공위성연구소는 초기 운영 기간 중 산·학·연에서 국산화한 핵심기술검증 탑재체 4종 (① GPS·Galileo 복합 항법 수신기, ② 상변환 물질을 이용한 열 제어장치, ③ X-대역 GaN기반 전력증폭기, ④ 태양전지배열기)에 대한 시험 운영을 통해 모든 탑재체가 정상적으로 작동함도 확인했다.

첫 번째, 항법위성으로부터 신호를 획득해 궤도를 돌고 있는 차세대소형위성 2호의 위치와 속도를 측정하는 ‘GPS·Galileo 복합 항법 수신기((주) 두시텍 개발)’의 모든 기능이 정상적임을 확인하였다. 두 번째, ‘상변환 물질을 이용한 열 제어장치(한국공학대 개발)’에 대한 작동시험 결과 등온 축열 기능을 이용해 열교환을 수행하고 위성 내부 고발열 유닛 온도를 일정하게 유지하는 열제어 기능이 정상 작동함을 확인했다. 세 번째, ‘X-대역 전력증폭기(한국전자통신연구원 개발)’의 상태 정보를 점검하고, 탑재된 전용 안테나를 통해 방사한 X-대역 시험 신호를 지상의 추적안테나로 수신함으로써 전력증폭기가 정상적으로 작동하고 있음을 확인하였다. 네 번째, ‘태양 전지 배열기(KAIST 개발)’가 임무 궤도에서 생성하는 전압과 전류 검침 정보를 통해 우주에서 정상적으로 전력을 생산함을 확인했다.

KAIST 인공위성연구소는 차세대소형위성 2호 발사 후 3개월간의 초기 운영을 완수함에 따라, 이후 영상레이다 탑재체에 대한 기술 검증 임무와 과학 탑재체 및 핵심 기술 검증 탑재체에 대한 정상 임무에 돌입할 예정이다.

영상레이다 탑재체는 향후 8개월간 추가적인 기술 검증을 거친 후 정상 임무를 통해 본격적으로 활용될 예정이다. 추가 기술 검증 기간에는 영상레이다에 대한 기술 시험 운영과 검보정을 수행하게 된다. 기술검증을 최종 완료한 후 정상 임무를 통해 북극 해빙 변화 탐지, 산림변화 탐지 및 해양 환경오염 탐지 등에 활용될 영상레이다 관측 자료를 제공할 예정이다.

KAIST 인공위성연구소 한재흥 소장은 “차세대소형위성 2호의 목표궤도 진입 후 정상적인 위성 관제와 임무 수행을 지속하고 있으며, 영상레이다 탑재체 시험 관측, 과학 탑재체 시험 관측, 핵심기술검증 탑재체 기능 점검을 모두 성공적으로 마쳤다”고 초기 운영 결과를 밝혔다.

한소장은 “KAIST가 개발한 차세대소형위성 2호는 위성 본체와 탑재체 대부분이 국내 독자 기술로 개발됐으며, 공개된 영상은 KAIST가 국내에서는 처음으로 국산화한 우주용 영상레이다를 이용해 촬영한 지구관측 사진이라는 점에서 큰 의미가 있다. 이번에 확보한 귀중한 기술자산과 운영경험이 향후 국산 영상레이다 기술 고도화에 활용되기를 바란다”고 덧붙였다.

차세대소형위성 2호 성공적 관측영상 공개

우리 대학은 지난 5월 25일 나로우주센터에서 발사된 누리호 3차 주탑재 위성인 차세대소형위성 2호에 대한 초기 운영을 완수했다고 5일 밝혔다.

차세대소형위성 2호는 2023년 5월 25일 18시 24분에 발사된 후 고도 550km 궤도에 안착했으며, KAIST는 지난 3개월 동안 차세대소형위성 2호에 대한 초기 운영을 통해 위성 본체, 탑재체, 지상국 전반에 걸친 기능 점검과 시스템 안정화 및 탑재체 시험 관측을 모두 수행했다.

초기 운영 기간 중 KAIST 인공위성연구소는 주 탑재체인 ‘영상레이다 (SAR: Synthetic Aperture Radar)’로 전 세계 여러 곳을 시험 촬영하는 데 성공했으며, 초기 운영 종료 시점에 즈음하여 대표적인 시험 관측 영상을 공개했다.

영상레이다는 전파를 지상으로 쏜 후 지상에서 산란되어 되돌아온 전파를 수신하여 신호처리를 통해 영상을 얻기 때문에 주·야간 빛의 영향을 받지 않으며 구름 등 기상 상황과 관계없이 지상관측을 수행할 수 있다. 공개된 시험 관측 영상은 초기 운영 기간 중 영상레이다 탑재체 시험 운영 과정에서 촬영된 영상으로서, 가시광선이 아닌 마이크로파(microwave)로 바라본 세상을 담고 있는 것이 특징이다.

또한 초기 운영 기간 중 과학 탑재체 ‘레오도스 (LEO-DOS)’의 기능을 점검하고 정상적인 작동상태를 확인하였으며, 시험 운영을 통해 우주방사선 관측자료를 확보했다. 한국천문연구원(원장 박영득)이 개발한 근지구궤도 우주방사선 관측장비 ‘레오도스 (LEO-DOS: Low-Earth Orbit space radiation DOSimeter)’가 시험 운영기간 동안 획득한 전 지구 우주방사선 등가선량 지도를 공개했다.

아울러 KAIST 인공위성연구소는 초기 운영 기간 중 산·학·연에서 국산화한 핵심기술검증 탑재체 4종 (① GPS·Galileo 복합 항법 수신기, ② 상변환 물질을 이용한 열 제어장치, ③ X-대역 GaN기반 전력증폭기, ④ 태양전지배열기)에 대한 시험 운영을 통해 모든 탑재체가 정상적으로 작동함도 확인했다.

첫 번째, 항법위성으로부터 신호를 획득해 궤도를 돌고 있는 차세대소형위성 2호의 위치와 속도를 측정하는 ‘GPS·Galileo 복합 항법 수신기((주) 두시텍 개발)’의 모든 기능이 정상적임을 확인하였다. 두 번째, ‘상변환 물질을 이용한 열 제어장치(한국공학대 개발)’에 대한 작동시험 결과 등온 축열 기능을 이용해 열교환을 수행하고 위성 내부 고발열 유닛 온도를 일정하게 유지하는 열제어 기능이 정상 작동함을 확인했다. 세 번째, ‘X-대역 전력증폭기(한국전자통신연구원 개발)’의 상태 정보를 점검하고, 탑재된 전용 안테나를 통해 방사한 X-대역 시험 신호를 지상의 추적안테나로 수신함으로써 전력증폭기가 정상적으로 작동하고 있음을 확인하였다. 네 번째, ‘태양 전지 배열기(KAIST 개발)’가 임무 궤도에서 생성하는 전압과 전류 검침 정보를 통해 우주에서 정상적으로 전력을 생산함을 확인했다.

KAIST 인공위성연구소는 차세대소형위성 2호 발사 후 3개월간의 초기 운영을 완수함에 따라, 이후 영상레이다 탑재체에 대한 기술 검증 임무와 과학 탑재체 및 핵심 기술 검증 탑재체에 대한 정상 임무에 돌입할 예정이다.

영상레이다 탑재체는 향후 8개월간 추가적인 기술 검증을 거친 후 정상 임무를 통해 본격적으로 활용될 예정이다. 추가 기술 검증 기간에는 영상레이다에 대한 기술 시험 운영과 검보정을 수행하게 된다. 기술검증을 최종 완료한 후 정상 임무를 통해 북극 해빙 변화 탐지, 산림변화 탐지 및 해양 환경오염 탐지 등에 활용될 영상레이다 관측 자료를 제공할 예정이다.

KAIST 인공위성연구소 한재흥 소장은 “차세대소형위성 2호의 목표궤도 진입 후 정상적인 위성 관제와 임무 수행을 지속하고 있으며, 영상레이다 탑재체 시험 관측, 과학 탑재체 시험 관측, 핵심기술검증 탑재체 기능 점검을 모두 성공적으로 마쳤다”고 초기 운영 결과를 밝혔다.

한소장은 “KAIST가 개발한 차세대소형위성 2호는 위성 본체와 탑재체 대부분이 국내 독자 기술로 개발됐으며, 공개된 영상은 KAIST가 국내에서는 처음으로 국산화한 우주용 영상레이다를 이용해 촬영한 지구관측 사진이라는 점에서 큰 의미가 있다. 이번에 확보한 귀중한 기술자산과 운영경험이 향후 국산 영상레이다 기술 고도화에 활용되기를 바란다”고 덧붙였다.

2023.09.05

조회수 2112

-

이창희 교수팀, 인공지능과 서울이 만난 영상 작품 전시

우리 대학이 다음 달 1일부터 두 달간 광화문 광장 해치마당에서 인공지능을 활용한 시각 영상 작품을 전시한다.

산업디자인학과 이창희 교수팀(아트: 송유택, 오주원, 이정아, 김대욱. 보조: 이윤지, 조해나)이 제작한 '서브웨이 시냅스(Subway Synapse)'라는 제목의 작품은 서울시가 주최하는 '하이 에이아이(Hi, Ai)'의 일환으로 전시된다. 첨단 기술을 어려운 매체예술이 아닌 이해하기 쉬운 시민 친화적 미술 작품으로 전시하기 위해 기획된 행사다. 이 교수팀의 작품은 서울의 지하철이 단순한 이동 수단을 넘어 인간의 신경세포를 연결하는 시냅스(Synapse)처럼 우리의 일상을 밀접하게 연결한다는 영감을 바탕으로 만들어졌다. 서울의 여러 공간과 모습을 연결하는 하나의 완전한 시스템으로서의 지하철을 두 개의 영상을 합성하는 크로마키 기법으로 촬영한 후 다양한 생성 인공지능 기술로 상상력을 더해 시각화했다.

자연, 번잡한 거리, 현대적인 스카이라인, 우리나라의 특색있는 문화 예술 등을 담은 서울의 다양한 모습을 하나의 유기적인 흐름으로 재구성했으며, 이를 관람하는 시민들이 서울 여행을 하는 듯한 경험과 동시에 서울이라는 공간을 재발견하게 하려는 의도가 담겨있다.작품을 총괄한 이창희 산업디자인학과 교수는 "서울시민들이 자신들이 살고 있는 도시의 진정한 가치와 아름다움을 다시 한번 느꼈으면 좋겠다는 마음으로 작업했다"라고 밝혔다. 이어, 이 교수는 "인공지능이 예술적 독창성을 파괴한다는 우려와는 다르게 인공지능이 어떻게 예술과 연결될 수 있는지를 보여주는 하나의 예시가 될 수 있길 바란다"라고 전했다.

이 교수팀의 작품은 광화문 광장 이순신 장군과 세종대왕 동상 사이에 설치된 길이 53m 높이 3.25m의 미디어월에서 매일 아침 8시부터 저녁 10시까지 송출된다.

이창희 교수팀, 인공지능과 서울이 만난 영상 작품 전시

우리 대학이 다음 달 1일부터 두 달간 광화문 광장 해치마당에서 인공지능을 활용한 시각 영상 작품을 전시한다.

산업디자인학과 이창희 교수팀(아트: 송유택, 오주원, 이정아, 김대욱. 보조: 이윤지, 조해나)이 제작한 '서브웨이 시냅스(Subway Synapse)'라는 제목의 작품은 서울시가 주최하는 '하이 에이아이(Hi, Ai)'의 일환으로 전시된다. 첨단 기술을 어려운 매체예술이 아닌 이해하기 쉬운 시민 친화적 미술 작품으로 전시하기 위해 기획된 행사다. 이 교수팀의 작품은 서울의 지하철이 단순한 이동 수단을 넘어 인간의 신경세포를 연결하는 시냅스(Synapse)처럼 우리의 일상을 밀접하게 연결한다는 영감을 바탕으로 만들어졌다. 서울의 여러 공간과 모습을 연결하는 하나의 완전한 시스템으로서의 지하철을 두 개의 영상을 합성하는 크로마키 기법으로 촬영한 후 다양한 생성 인공지능 기술로 상상력을 더해 시각화했다.

자연, 번잡한 거리, 현대적인 스카이라인, 우리나라의 특색있는 문화 예술 등을 담은 서울의 다양한 모습을 하나의 유기적인 흐름으로 재구성했으며, 이를 관람하는 시민들이 서울 여행을 하는 듯한 경험과 동시에 서울이라는 공간을 재발견하게 하려는 의도가 담겨있다.작품을 총괄한 이창희 산업디자인학과 교수는 "서울시민들이 자신들이 살고 있는 도시의 진정한 가치와 아름다움을 다시 한번 느꼈으면 좋겠다는 마음으로 작업했다"라고 밝혔다. 이어, 이 교수는 "인공지능이 예술적 독창성을 파괴한다는 우려와는 다르게 인공지능이 어떻게 예술과 연결될 수 있는지를 보여주는 하나의 예시가 될 수 있길 바란다"라고 전했다.

이 교수팀의 작품은 광화문 광장 이순신 장군과 세종대왕 동상 사이에 설치된 길이 53m 높이 3.25m의 미디어월에서 매일 아침 8시부터 저녁 10시까지 송출된다.

2023.08.30

조회수 3348

-

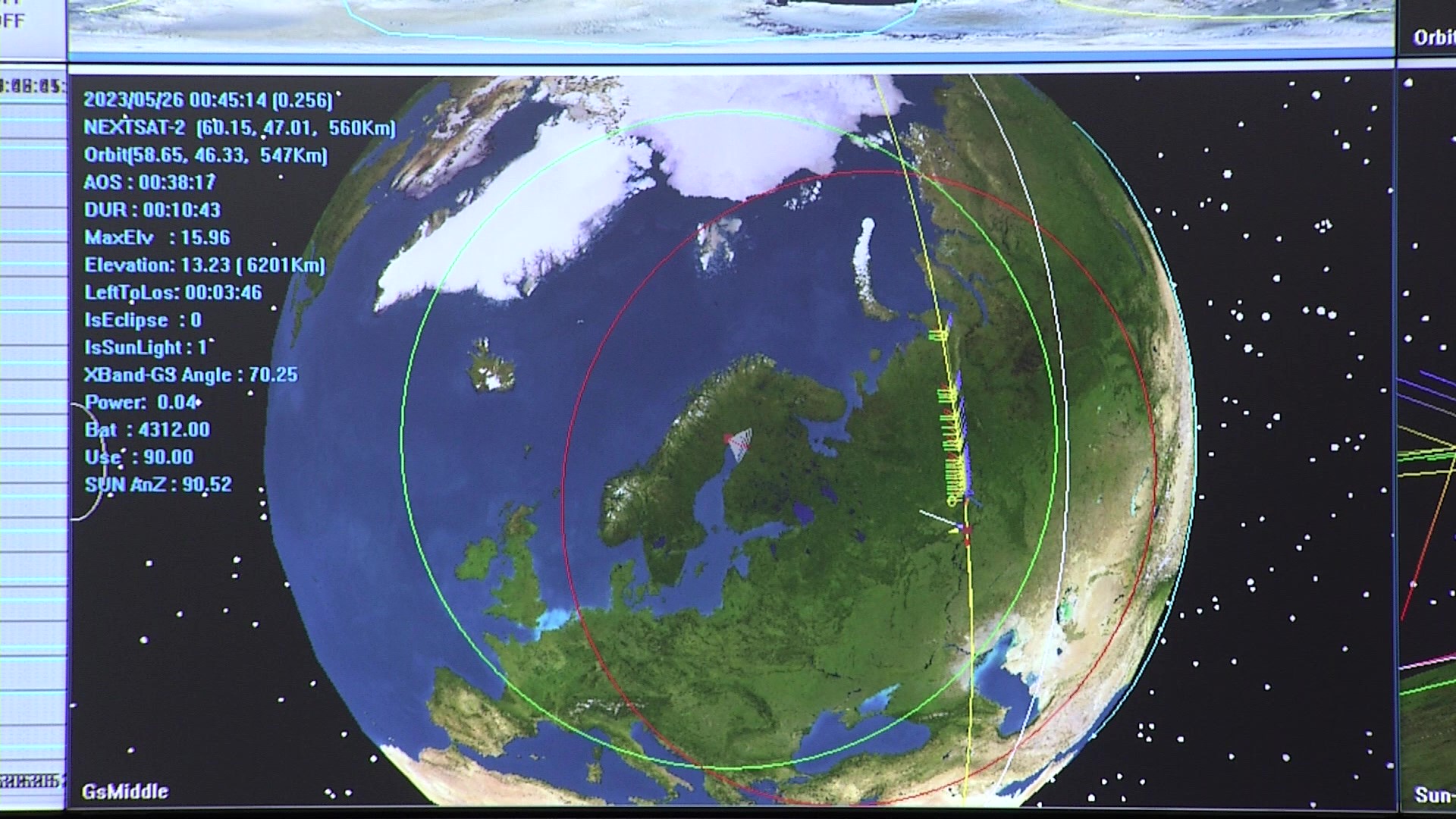

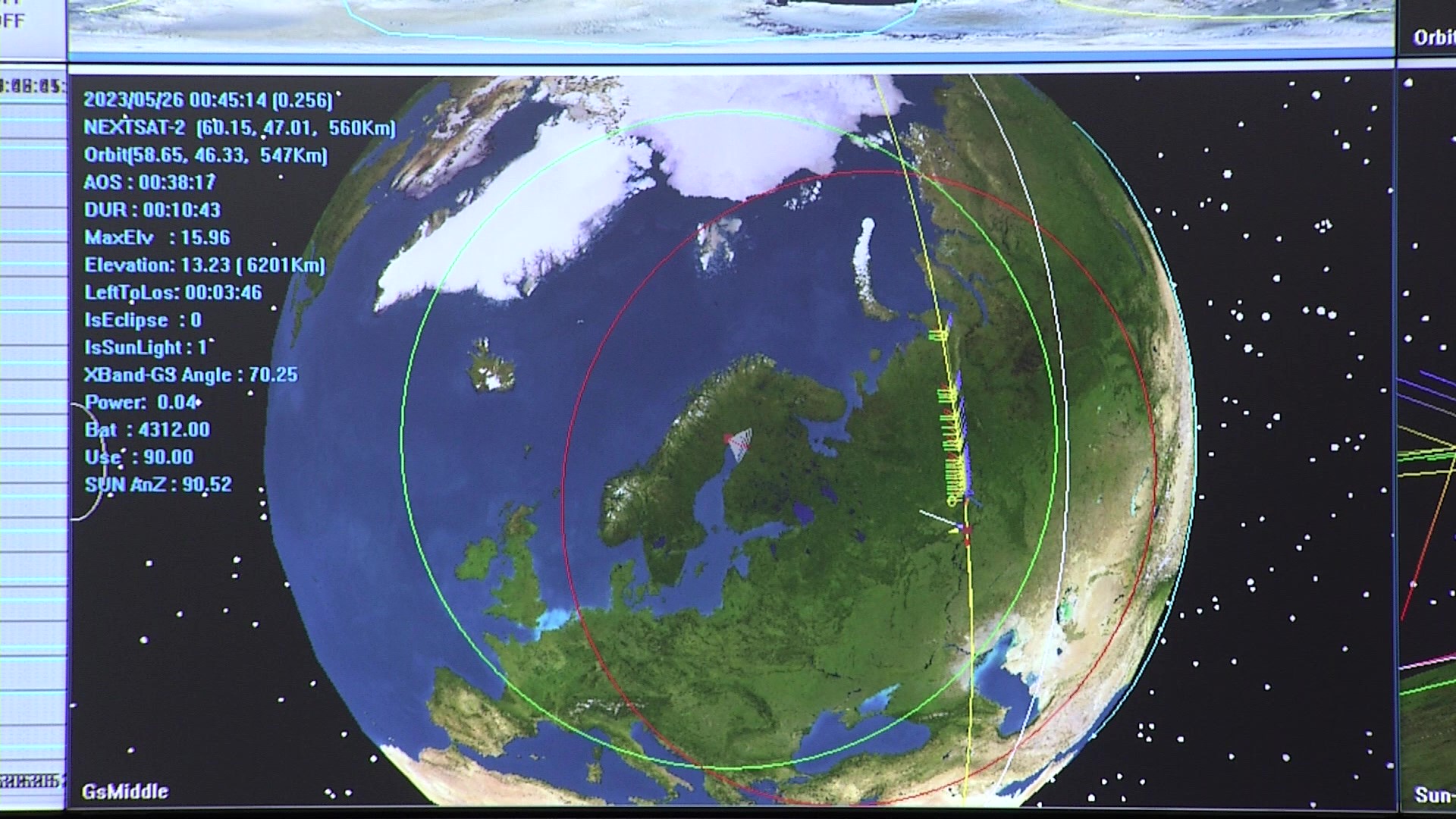

차세대소형위성2호 초기 교신 성공

우리 대학 인공위성연구소(소장 한재흥)에서 개발한 차세대소형위성2호가 지난 5월 25일 18시 24분에 발사된 누리호에서 안전하게 분리되어 목표 궤도에 성공적으로 안착하였으며, 같은날 19시 58분 대전 KAIST 지상국과 최초 교신에 성공했다.

차세대소형위성2호의 최초 비콘 신호는 누리호 발사 후 약 40분 만인 25일 저녁 7시 4분경 항공우주연구원의 남극 세종기지 안테나를 통해 수신할 예정이었으며, 실제로는 7시 7분에 수신이 확인되었다. 위성 발사 후 약 94분 만인 25일 저녁 7시 58분경 대전 KAIST 지상국과 최초 교신에 성공했다.

이후, 남극 세종기지에서 비콘 신호를 2차례 더 확인했고, 스웨덴 보덴 지상국과 대전 KAIST 지상국에서 8차례 교신을 수행하면서 차세대소형위성2호의 통신시스템과 자세제어시스템, 전력시스템, 탑재 컴퓨터 등의 기능을 점검했다.

특히, 국내 우주핵심기술 연구개발 성과물로 차세대소형위성2호의 자세제어시스템에 처음 적용된 반작용휠과 광학자이로의 기능을 점검하고, 차세대소형위성2호 태양전지판이 태양을 바라보는 자세제어와 고속데이터 송신을 위해 안테나를 지상국으로 지향하는 자세제어 기능을 확인했다.

또한, 태양전지판과 태양전력조절기, 리튬이온 배터리 등 차세대소형위성2호의 전력시스템을 점검해, 태양전지판에서 안정적으로 생성된 약 256W의 전력을 통해 위성 배터리가 만충전 상태를 유지하고 있는 것을 확인했다.

차세대소형위성2호는 중점임무인 영상레이더 기술검증과 지구관측, 우주과학임무인 근지구궤도 우주방사선 관측, 그리고 4종의 국내 개발 핵심기술에 대한 우주검증을 수행할 예정이다.

영상레이더는 광학카메라와 달리 빛과 구름의 영향을 받지 않아, 주야간 및 악천후에도 지상 관측이 가능하다. 순수 국내 기술로 개발된 차세대소형위성2호의 X-대역 영상레이더는 해상도 5m, 관측폭 40km의 레이더 영상을 획득을 목표로 한다.

우주방사선 관측기는 근지구 궤도의 중성자·하전입자에 대한 정밀 선량 지도를 작성하고, 태양활동 상승 주기의 우주방사선 변화에 따른 우주환경 영향과 근지구 궤도의 중성자 가중치를 연구하는 데 활용된다.

아울러 산·학·연에서 국산화한 위성핵심기술 4종(①상변환 물질을 이용한 열제어장치, ②X-대역 GaN기반 전력증폭기, ③GPS·Galileo 복합항법수신기, ④태양전지배열기)에 대한 우주검증도 함께 수행된다.

차세대소형위성2호는 약 3개월의 초기 운영 기간 동안 위성 본체 및 탑재체에 대한 기능을 상세히 점검한 후, 계획된 영상레이더에 대한 기술검증•지구관측, 우주방사선 관측 및 핵심기술 검증의 정상적인 임무를 약 2년간 수행할 예정이다.

위성 발사 후 1주일 동안 위성 본체 및 탑재체에 대한 기초적인 상태 점검을 수행하고, 발사 후 1개월까지 위성 본체에 대한 세부 기능을 상세히 점검한 뒤, 발사 후 3개월까지 모든 탑재체에 대한 세부 기능점검을 완료함으로써 향후 정상 임무를 위한 위성 상태 최적화를 수행할 예정이다. 이광형 KAIST 총장은 "우리별 1호부터 30여 년간 축적해온 소형위성 개발과 운영 경험을 바탕으로 차세대소형위성2호의 임무를 성공적으로 완수하여 우리나라 소형위성 기술 수준을 한 단계 높일 수 있을 것으로 기대한다"라고 밝혔다.

차세대소형위성2호 초기 교신 성공

우리 대학 인공위성연구소(소장 한재흥)에서 개발한 차세대소형위성2호가 지난 5월 25일 18시 24분에 발사된 누리호에서 안전하게 분리되어 목표 궤도에 성공적으로 안착하였으며, 같은날 19시 58분 대전 KAIST 지상국과 최초 교신에 성공했다.

차세대소형위성2호의 최초 비콘 신호는 누리호 발사 후 약 40분 만인 25일 저녁 7시 4분경 항공우주연구원의 남극 세종기지 안테나를 통해 수신할 예정이었으며, 실제로는 7시 7분에 수신이 확인되었다. 위성 발사 후 약 94분 만인 25일 저녁 7시 58분경 대전 KAIST 지상국과 최초 교신에 성공했다.

이후, 남극 세종기지에서 비콘 신호를 2차례 더 확인했고, 스웨덴 보덴 지상국과 대전 KAIST 지상국에서 8차례 교신을 수행하면서 차세대소형위성2호의 통신시스템과 자세제어시스템, 전력시스템, 탑재 컴퓨터 등의 기능을 점검했다.

특히, 국내 우주핵심기술 연구개발 성과물로 차세대소형위성2호의 자세제어시스템에 처음 적용된 반작용휠과 광학자이로의 기능을 점검하고, 차세대소형위성2호 태양전지판이 태양을 바라보는 자세제어와 고속데이터 송신을 위해 안테나를 지상국으로 지향하는 자세제어 기능을 확인했다.

또한, 태양전지판과 태양전력조절기, 리튬이온 배터리 등 차세대소형위성2호의 전력시스템을 점검해, 태양전지판에서 안정적으로 생성된 약 256W의 전력을 통해 위성 배터리가 만충전 상태를 유지하고 있는 것을 확인했다.

차세대소형위성2호는 중점임무인 영상레이더 기술검증과 지구관측, 우주과학임무인 근지구궤도 우주방사선 관측, 그리고 4종의 국내 개발 핵심기술에 대한 우주검증을 수행할 예정이다.

영상레이더는 광학카메라와 달리 빛과 구름의 영향을 받지 않아, 주야간 및 악천후에도 지상 관측이 가능하다. 순수 국내 기술로 개발된 차세대소형위성2호의 X-대역 영상레이더는 해상도 5m, 관측폭 40km의 레이더 영상을 획득을 목표로 한다.

우주방사선 관측기는 근지구 궤도의 중성자·하전입자에 대한 정밀 선량 지도를 작성하고, 태양활동 상승 주기의 우주방사선 변화에 따른 우주환경 영향과 근지구 궤도의 중성자 가중치를 연구하는 데 활용된다.

아울러 산·학·연에서 국산화한 위성핵심기술 4종(①상변환 물질을 이용한 열제어장치, ②X-대역 GaN기반 전력증폭기, ③GPS·Galileo 복합항법수신기, ④태양전지배열기)에 대한 우주검증도 함께 수행된다.

차세대소형위성2호는 약 3개월의 초기 운영 기간 동안 위성 본체 및 탑재체에 대한 기능을 상세히 점검한 후, 계획된 영상레이더에 대한 기술검증•지구관측, 우주방사선 관측 및 핵심기술 검증의 정상적인 임무를 약 2년간 수행할 예정이다.

위성 발사 후 1주일 동안 위성 본체 및 탑재체에 대한 기초적인 상태 점검을 수행하고, 발사 후 1개월까지 위성 본체에 대한 세부 기능을 상세히 점검한 뒤, 발사 후 3개월까지 모든 탑재체에 대한 세부 기능점검을 완료함으로써 향후 정상 임무를 위한 위성 상태 최적화를 수행할 예정이다. 이광형 KAIST 총장은 "우리별 1호부터 30여 년간 축적해온 소형위성 개발과 운영 경험을 바탕으로 차세대소형위성2호의 임무를 성공적으로 완수하여 우리나라 소형위성 기술 수준을 한 단계 높일 수 있을 것으로 기대한다"라고 밝혔다.

2023.05.26

조회수 5298

-

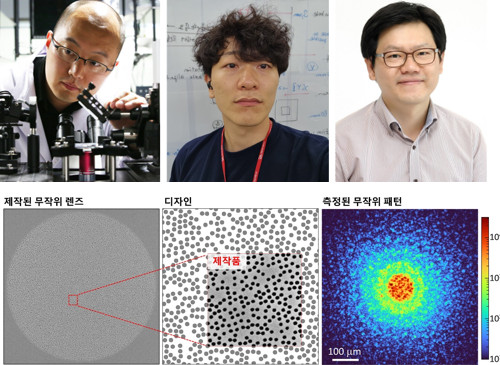

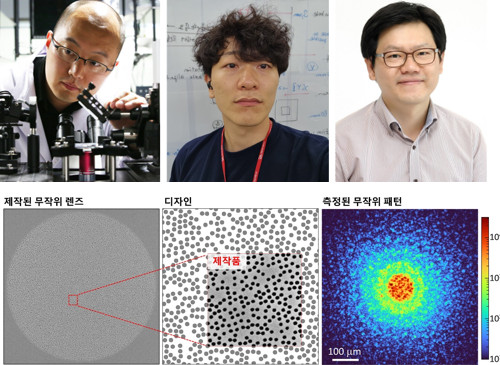

엑스선 현미경 해상도 한계 극복

엑스선 현미경은 대부분 물질을 투과하는 장점이 있어 흉부 엑스선이나 CT 촬영을 통해 신체 내부 장기와 골격을 비침습적으로 관찰할 수 있다. 최근에는 반도체, 배터리의 내부 구조를 나노스케일에서 정밀하게 관찰하기 위해 엑스선 영상 기술의 해상도를 높이려는 연구들이 활발하게 진행되고 있다.

우리 대학 물리학과 박용근 교수 연구팀이 포항가속기연구소 임준 박사 연구팀과 공동연구를 통해 기존 엑스선 현미경의 해상도 한계를 극복할 수 있는 원천 기술 개발에 성공했다고 12일(수) 밝혔다.

물리학과 이겨레 박사가 제1 저자로 참여한 이번 연구는 광학 및 광자학의 세계적인 학술지인 `라이트: 사이언스 앤 어플리케이션 (Light: Science and Application)' 4월 7일 字에 출판됐다. (논문명: Direct high-resolution X-ray imaging exploiting pseudorandomness).

엑스선 나노 현미경은 굴절 렌즈가 없어 렌즈 대용으로 동심원 회절판(zone plate)이라 불리는 원형 모양의 격자를 사용한다. 동심원 회절판을 사용하여 얻어지는 영상의 해상도는 회절판 나노구조의 제작 품질에 의해 결정된다. 이러한 나노구조를 제작하고 유지하는 것은 여러 가지 어려움이 있으며, 이러한 한계가 엑스선 현미경의 해상도 한계를 결정했다.

연구팀은 이 문제를 극복하기 위해 새로운 엑스선 나노 현미경 기술을 개발했다. 연구팀이 제안한 엑스선 렌즈는 얇은 텅스텐 필름에 수많은 구멍을 뚫은 형태로, 입사되는 엑스선을 회절시켜 무작위적인 회절 패턴을 생성한다. 연구팀은 역설적이게도 이러한 무작위적 회절 패턴 속에 시료의 고해상도 정보가 온전히 들어있음을 수학적으로 규명하였으며, 실제 그 시료 정보를 추출하여 영상화하는데 성공하였다.

이러한 무작위 회절의 수학적 성질을 활용한 영상기법은 지난 2016년 이겨레 박사와 박용근 교수가 세계 최초로 제안하고 가시광 대역에서 구현한 기술로서, 당시 네이처 커뮤니케이션즈紙 Lee, KyeoReh, and YongKeun Park. "Exploiting the speckle-correlation scattering matrix for a compact reference-free holographic image sensor." Nature communications 7.1 (2016): 13359. 에 보고된 바 있다. 이번 연구는 해당 선행연구 결과를 엑스선 영역의 난제를 푸는 데 활용한 것이다.

구성된 시료의 영상의 해상도는 사용한 무작위 렌즈에 식각된 패턴의 크기와 직접적인 상관이 없다. 이러한 아이디어를 바탕으로 연구팀은 300 나노미터(nm) 지름의 원형 패턴으로 제작한 무작위 렌즈를 활용해 14 나노미터(nm) 해상도(대략 코로나 바이러스의 7분의 1 크기)의 영상을 취득하는 데 성공했다.

연구팀이 개발한 영상기술은 기존 동심원 회절판 제작상의 문제에 가로막혀 있던 엑스선 나노 현미경 해상도를 그 이상으로 끌어 올릴 수 있는 핵심 기반 기술이다.

제1 저자이자 공동교신저자인 우리 대학 물리학과 이겨레 박사는 “이번 연구에서는 14 나노미터(nm) 해상도에 그쳤지만, 차세대 엑스선 광원과 고성능 엑스선 검출기를 활용한다면, 기존 엑스선 나노 영상의 해상도를 넘어서 전자현미경의 해상도 수준인 1 나노미터 부근까지 근접할 수 있을 것이라 예상한다”라며“전자현미경과는 달리 엑스선은 시료를 훼손하지 않으면서 내부 구조를 관찰할 수 있으므로, 반도체 검수와 같은 비침습적 나노구조 관찰에 새로운 표준을 제시할 수 있을 것이다”라고 말했다.

공동교신저자인 포항가속기연구소 임준 박사는 “같은 맥락에서, 개발된 영상기술은 충북 오창에 신설되는 4세대 다목적방사광가속기에서 크게 성능이 증대될 수 있을 것으로 기대한다”라고 말했다.

이번 연구는 한국연구재단 리더연구사업과 세종과학펠로우십의 지원을 받아 수행됐다.

엑스선 현미경 해상도 한계 극복

엑스선 현미경은 대부분 물질을 투과하는 장점이 있어 흉부 엑스선이나 CT 촬영을 통해 신체 내부 장기와 골격을 비침습적으로 관찰할 수 있다. 최근에는 반도체, 배터리의 내부 구조를 나노스케일에서 정밀하게 관찰하기 위해 엑스선 영상 기술의 해상도를 높이려는 연구들이 활발하게 진행되고 있다.

우리 대학 물리학과 박용근 교수 연구팀이 포항가속기연구소 임준 박사 연구팀과 공동연구를 통해 기존 엑스선 현미경의 해상도 한계를 극복할 수 있는 원천 기술 개발에 성공했다고 12일(수) 밝혔다.

물리학과 이겨레 박사가 제1 저자로 참여한 이번 연구는 광학 및 광자학의 세계적인 학술지인 `라이트: 사이언스 앤 어플리케이션 (Light: Science and Application)' 4월 7일 字에 출판됐다. (논문명: Direct high-resolution X-ray imaging exploiting pseudorandomness).

엑스선 나노 현미경은 굴절 렌즈가 없어 렌즈 대용으로 동심원 회절판(zone plate)이라 불리는 원형 모양의 격자를 사용한다. 동심원 회절판을 사용하여 얻어지는 영상의 해상도는 회절판 나노구조의 제작 품질에 의해 결정된다. 이러한 나노구조를 제작하고 유지하는 것은 여러 가지 어려움이 있으며, 이러한 한계가 엑스선 현미경의 해상도 한계를 결정했다.

연구팀은 이 문제를 극복하기 위해 새로운 엑스선 나노 현미경 기술을 개발했다. 연구팀이 제안한 엑스선 렌즈는 얇은 텅스텐 필름에 수많은 구멍을 뚫은 형태로, 입사되는 엑스선을 회절시켜 무작위적인 회절 패턴을 생성한다. 연구팀은 역설적이게도 이러한 무작위적 회절 패턴 속에 시료의 고해상도 정보가 온전히 들어있음을 수학적으로 규명하였으며, 실제 그 시료 정보를 추출하여 영상화하는데 성공하였다.

이러한 무작위 회절의 수학적 성질을 활용한 영상기법은 지난 2016년 이겨레 박사와 박용근 교수가 세계 최초로 제안하고 가시광 대역에서 구현한 기술로서, 당시 네이처 커뮤니케이션즈紙 Lee, KyeoReh, and YongKeun Park. "Exploiting the speckle-correlation scattering matrix for a compact reference-free holographic image sensor." Nature communications 7.1 (2016): 13359. 에 보고된 바 있다. 이번 연구는 해당 선행연구 결과를 엑스선 영역의 난제를 푸는 데 활용한 것이다.

구성된 시료의 영상의 해상도는 사용한 무작위 렌즈에 식각된 패턴의 크기와 직접적인 상관이 없다. 이러한 아이디어를 바탕으로 연구팀은 300 나노미터(nm) 지름의 원형 패턴으로 제작한 무작위 렌즈를 활용해 14 나노미터(nm) 해상도(대략 코로나 바이러스의 7분의 1 크기)의 영상을 취득하는 데 성공했다.

연구팀이 개발한 영상기술은 기존 동심원 회절판 제작상의 문제에 가로막혀 있던 엑스선 나노 현미경 해상도를 그 이상으로 끌어 올릴 수 있는 핵심 기반 기술이다.

제1 저자이자 공동교신저자인 우리 대학 물리학과 이겨레 박사는 “이번 연구에서는 14 나노미터(nm) 해상도에 그쳤지만, 차세대 엑스선 광원과 고성능 엑스선 검출기를 활용한다면, 기존 엑스선 나노 영상의 해상도를 넘어서 전자현미경의 해상도 수준인 1 나노미터 부근까지 근접할 수 있을 것이라 예상한다”라며“전자현미경과는 달리 엑스선은 시료를 훼손하지 않으면서 내부 구조를 관찰할 수 있으므로, 반도체 검수와 같은 비침습적 나노구조 관찰에 새로운 표준을 제시할 수 있을 것이다”라고 말했다.

공동교신저자인 포항가속기연구소 임준 박사는 “같은 맥락에서, 개발된 영상기술은 충북 오창에 신설되는 4세대 다목적방사광가속기에서 크게 성능이 증대될 수 있을 것으로 기대한다”라고 말했다.

이번 연구는 한국연구재단 리더연구사업과 세종과학펠로우십의 지원을 받아 수행됐다.

2023.04.12

조회수 3969

-

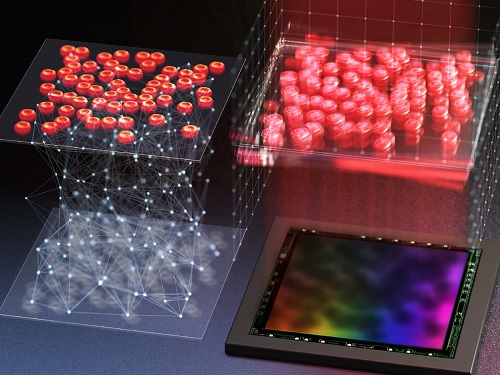

똑똑한 영상 복원 인공지능 기술 개발

딥러닝 기술은 영상 복원 속도가 기존 알고리즘 대비 수백 배 이상 빠를 뿐만 아니라 복원 정확도 역시 높다. 하지만, 주어진 학습 데이터에만 의존하는 딥러닝 기술은 영상 취득 환경상에 변화가 생기면 성능이 급격히 저하되는 치명적인 약점이 있다. 이는 알파고와 이세돌 九단과의 대국 시 `신의 한 수'에 의해 알파고의 성능이 급격하게 저하되었던 사례를 떠올리면 쉽게 이해할 수 있다. 즉, 인공지능이 학습하지 못했던 변수(학습 데이터상에 존재하지 않는 수)가 발생할 때 신뢰도가 급격히 낮아지는 인공지능 기술의 근본적인 문제이기도 하다.

우리 대학 바이오및뇌공학과 장무석 교수 연구팀과 김재철AI 대학원 예종철 교수 연구팀이 공동 연구를 통해 인공 지능의 신뢰도 문제를 해결할 수 있는 물리적 학습 기반의 영상 복원 딥러닝 기술을 개발했다고 6일 밝혔다.

연구팀은 영상 취득 환경에서 발생할 수 있는 변수 대부분이 물리적 법칙을 통해 수학적으로 기술 가능하다는 점에 착안해 물리적 법칙과 심층 신경망이 통합된 학습 기법을 제시했다.

모든 영상 기술은 물리적인 영상 기기를 통해 영상 정보를 취득한다. 연구팀은 이 정보 취득 과정에 대한 물리적인 통찰력을 인공지능에 학습시키는 방법을 개발했다. 예를 들면, `네가 도출한 복원 결과가 물리적으로 합당할까?' 혹은 `이 영상 기기는 물리적으로 이런 변수가 생길 수 있을 것 같은데?'라는 식의 질문을 통해 물리적 통찰력을 인공지능에 이식하는 방법을 제시한 것이다.

연구팀은 변화하는 영상 취득 환경에서도 신뢰도 높은 홀로그래피 영상* 을 복원하는데 성공했다. 홀로그래피 영상 기술은 의료 영상, 군용 감시, 자율 주행용 영상 등 다양한 정밀 영상 기술에 다양하게 활용될 수 있는데, 이번 연구는 의료 진단 분야의 활용성을 집중적으로 검증하였다.

*홀로그래피 영상: 물체의 그림자 패턴(회절 패턴)으로부터 물체의 형태를 복원하는 영상 기법, 일반적인 영상 기술과 달리 위상 변화에 의한 물체의 미세 구조를 감지할 수 있는 영상 기술

연구팀은 먼저 3차원 공간상에서 매우 빠르게 움직이는 적혈구의 회절 영상(확산된 그림자형상)으로부터 적혈구의 형태를 실시간으로 복원하는데 성공했다. 이러한 동적인 영상 환경에서 예상치 못한 변수로는 여러 개의 적혈구 덩어리가 복잡하게 겹쳐진다거나 적혈구가 예상하지 못했던 위치로 흘러가는 경우를 생각해 볼 수 있다. 여기서, 연구팀은 인공 지능이 생성한 영상이 합당한 결과인지 빛 전파 이론을 통해 검산하는 방식으로 물리적으로 유효한 복원 신뢰도를 구현하는데 성공하였다.

연구팀은 암 진단의 표준기술로 자리잡고 있는 생검 조직(생체에서 조직 일부를 메스나 바늘로 채취하는 것)의 영상 복원에도 성공했다. 주목할 점은 특정한 카메라 위치에서 측정된 회절 영상만을 학습했음에도 인공지능의 인지능력이 부가되어 다양한 카메라 위치에서도 물체를 인식하는데 성공했다는 점이다. 이번에 구현된 기술은 세포 염색 과정이나 수 천 만원에 달하는 현미경이 필요하지 않아 생검 조직 검사의 속도와 비용을 크게 개선할 수 있을 것으로 기대된다.

물리적 통찰력을 인공 지능에 이식하는 영상 복원 기술은 의료 진단 분야 뿐만 아니라 광범위한 영상 기술에 활용될 것으로 기대된다. 최근 영상 기술 산업계 (모바일 기기 카메라, 의료 진단용 MRI, CT, 광 기반 반도체 공정 불량 검출 등) 에선 인공지능 솔루션 탑재가 활발히 이루어지고 있다. 영상 취득에 사용되는 센서, 물체의 밝기, 물체까지의 거리와 같은 영상 취득 환경은 사용자마다 다를 수밖에 없어 적응 능력을 갖춘 인공 지능 솔루션에 대한 수요가 큰 상황이다. 현재 대부분의 인공 지능 기술은 적응 능력 부재로 신뢰도가 낮은 문제 때문에 실제 현장에서 활용성이 제한적인 상황이다.

바이오및뇌공학과 이찬석 연구원은 "데이터와 물리 법칙을 동시에 학습하는 적응형 인공지능 기술은 홀로그래피 영상뿐만 아니라 초고해상도 영상, 3차원 영상, 비시선 영상(장애물 뒷면을 보는 영상) 등 다양한 계산 영상 기술에 적용될 수 있을 것으로 기대된다ˮ고 밝혔다.

연구진은 "이번 연구를 통해 인공지능 학습에 있어서 학습 데이터에 대한 강한 의존성(신뢰도 문제)을 물리적 법칙을 결합해 해소했을 뿐만 아니라, 이미지 복원에 있어 매게 변수화된 전방 모델을 기반으로 했기 때문에 신뢰도와 적응성이 크게 향상됐다ˮ며, 이어 "이번 연구에서는 데이터의 다양한 특성 중에서 수학적 혹은 물리적으로 정확히 다룰 수 있는 측면에 집중했고, 향후 무작위적인 잡음이나 데이터의 형태에 대해서도 제약받지 않는 범용 복원 알고리즘을 개발하는 데 주력할 것이다ˮ라고 밝혔다.

바이오및뇌공학과 이찬석 박사과정이 제1 저자로 참여한 이번 연구는 국제 학술지 `네이처 머신 인텔리전스(Nature Machine Intelligence)'에 지난 1월 17일 字 출판됐다. (논문명: Deep learning based on parameterized physical forward model for adaptive holographic imaging with unpaired data)

한편 이번 연구는 삼성미래기술육성사업과 선도연구센터사업의 지원을 받아 수행됐다.

똑똑한 영상 복원 인공지능 기술 개발

딥러닝 기술은 영상 복원 속도가 기존 알고리즘 대비 수백 배 이상 빠를 뿐만 아니라 복원 정확도 역시 높다. 하지만, 주어진 학습 데이터에만 의존하는 딥러닝 기술은 영상 취득 환경상에 변화가 생기면 성능이 급격히 저하되는 치명적인 약점이 있다. 이는 알파고와 이세돌 九단과의 대국 시 `신의 한 수'에 의해 알파고의 성능이 급격하게 저하되었던 사례를 떠올리면 쉽게 이해할 수 있다. 즉, 인공지능이 학습하지 못했던 변수(학습 데이터상에 존재하지 않는 수)가 발생할 때 신뢰도가 급격히 낮아지는 인공지능 기술의 근본적인 문제이기도 하다.

우리 대학 바이오및뇌공학과 장무석 교수 연구팀과 김재철AI 대학원 예종철 교수 연구팀이 공동 연구를 통해 인공 지능의 신뢰도 문제를 해결할 수 있는 물리적 학습 기반의 영상 복원 딥러닝 기술을 개발했다고 6일 밝혔다.

연구팀은 영상 취득 환경에서 발생할 수 있는 변수 대부분이 물리적 법칙을 통해 수학적으로 기술 가능하다는 점에 착안해 물리적 법칙과 심층 신경망이 통합된 학습 기법을 제시했다.

모든 영상 기술은 물리적인 영상 기기를 통해 영상 정보를 취득한다. 연구팀은 이 정보 취득 과정에 대한 물리적인 통찰력을 인공지능에 학습시키는 방법을 개발했다. 예를 들면, `네가 도출한 복원 결과가 물리적으로 합당할까?' 혹은 `이 영상 기기는 물리적으로 이런 변수가 생길 수 있을 것 같은데?'라는 식의 질문을 통해 물리적 통찰력을 인공지능에 이식하는 방법을 제시한 것이다.

연구팀은 변화하는 영상 취득 환경에서도 신뢰도 높은 홀로그래피 영상* 을 복원하는데 성공했다. 홀로그래피 영상 기술은 의료 영상, 군용 감시, 자율 주행용 영상 등 다양한 정밀 영상 기술에 다양하게 활용될 수 있는데, 이번 연구는 의료 진단 분야의 활용성을 집중적으로 검증하였다.

*홀로그래피 영상: 물체의 그림자 패턴(회절 패턴)으로부터 물체의 형태를 복원하는 영상 기법, 일반적인 영상 기술과 달리 위상 변화에 의한 물체의 미세 구조를 감지할 수 있는 영상 기술

연구팀은 먼저 3차원 공간상에서 매우 빠르게 움직이는 적혈구의 회절 영상(확산된 그림자형상)으로부터 적혈구의 형태를 실시간으로 복원하는데 성공했다. 이러한 동적인 영상 환경에서 예상치 못한 변수로는 여러 개의 적혈구 덩어리가 복잡하게 겹쳐진다거나 적혈구가 예상하지 못했던 위치로 흘러가는 경우를 생각해 볼 수 있다. 여기서, 연구팀은 인공 지능이 생성한 영상이 합당한 결과인지 빛 전파 이론을 통해 검산하는 방식으로 물리적으로 유효한 복원 신뢰도를 구현하는데 성공하였다.

연구팀은 암 진단의 표준기술로 자리잡고 있는 생검 조직(생체에서 조직 일부를 메스나 바늘로 채취하는 것)의 영상 복원에도 성공했다. 주목할 점은 특정한 카메라 위치에서 측정된 회절 영상만을 학습했음에도 인공지능의 인지능력이 부가되어 다양한 카메라 위치에서도 물체를 인식하는데 성공했다는 점이다. 이번에 구현된 기술은 세포 염색 과정이나 수 천 만원에 달하는 현미경이 필요하지 않아 생검 조직 검사의 속도와 비용을 크게 개선할 수 있을 것으로 기대된다.

물리적 통찰력을 인공 지능에 이식하는 영상 복원 기술은 의료 진단 분야 뿐만 아니라 광범위한 영상 기술에 활용될 것으로 기대된다. 최근 영상 기술 산업계 (모바일 기기 카메라, 의료 진단용 MRI, CT, 광 기반 반도체 공정 불량 검출 등) 에선 인공지능 솔루션 탑재가 활발히 이루어지고 있다. 영상 취득에 사용되는 센서, 물체의 밝기, 물체까지의 거리와 같은 영상 취득 환경은 사용자마다 다를 수밖에 없어 적응 능력을 갖춘 인공 지능 솔루션에 대한 수요가 큰 상황이다. 현재 대부분의 인공 지능 기술은 적응 능력 부재로 신뢰도가 낮은 문제 때문에 실제 현장에서 활용성이 제한적인 상황이다.

바이오및뇌공학과 이찬석 연구원은 "데이터와 물리 법칙을 동시에 학습하는 적응형 인공지능 기술은 홀로그래피 영상뿐만 아니라 초고해상도 영상, 3차원 영상, 비시선 영상(장애물 뒷면을 보는 영상) 등 다양한 계산 영상 기술에 적용될 수 있을 것으로 기대된다ˮ고 밝혔다.

연구진은 "이번 연구를 통해 인공지능 학습에 있어서 학습 데이터에 대한 강한 의존성(신뢰도 문제)을 물리적 법칙을 결합해 해소했을 뿐만 아니라, 이미지 복원에 있어 매게 변수화된 전방 모델을 기반으로 했기 때문에 신뢰도와 적응성이 크게 향상됐다ˮ며, 이어 "이번 연구에서는 데이터의 다양한 특성 중에서 수학적 혹은 물리적으로 정확히 다룰 수 있는 측면에 집중했고, 향후 무작위적인 잡음이나 데이터의 형태에 대해서도 제약받지 않는 범용 복원 알고리즘을 개발하는 데 주력할 것이다ˮ라고 밝혔다.

바이오및뇌공학과 이찬석 박사과정이 제1 저자로 참여한 이번 연구는 국제 학술지 `네이처 머신 인텔리전스(Nature Machine Intelligence)'에 지난 1월 17일 字 출판됐다. (논문명: Deep learning based on parameterized physical forward model for adaptive holographic imaging with unpaired data)

한편 이번 연구는 삼성미래기술육성사업과 선도연구센터사업의 지원을 받아 수행됐다.

2023.02.06

조회수 4316

-

7개 연구실, '안전관리 우수연구실' 인증 취득

우리 대학 7개 연구실이 과학기술정보통신부가 주관하는 2022 안전관리 우수연구실 인증을 획득했다.

안전관리 우수연구실 인증제는 대학이나 연구기관 등에 설치된 과학기술 분야 연구실이 자율적으로 안전관리 역량을 강화할 수 있도록 정부가 2013년 도입한 제도다. 안전관리 표준모델을 발굴하고 확산하는 것을 목표로 안전관리 수준과 활동이 우수한 연구실에 전문가의 심사를 통한 인증을 부여하고 있다.

이번에 신규 인증을 획득한 연구실은 총 7개로 대전 소재 정부출연연구기관 중 최다 규모다. 생명과학과 ①시스템 및 합성생물학 연구실(조병관 교수), 신소재공학과 ②NanoSF 연구실(강정구 교수), ③바이오신소재연구실(박찬범 교수), ④지속가능에너지재료 연구실(정우철 교수), ⑤신소재 영상화 및 융합 연구실(홍승범 교수), 원자력및양자공학과 ⑥핵융합 및 플라즈마 동역학 연구실(성충기 교수), 화학과 ⑦나노촉매연구실(송현준 교수) 등이다.

해당 연구실들은 ▴연구실 안전 환경 시스템 분야(30점) ▴연구실 안전 환경 활동 수준 분야(50점), ▴연구실 안전관리 관계자 안전의식 분야(20점) 등 세 가지로 구분된 심사 항목에서 각 분야 배점의 80% 이상을 득점하고 80점 이상의 총점을 얻었다. 또한, 안전관리 우수연구실 인증제 운영에 관한 규정에 명시된 필수 이행항목 4종에 대한 평가를 동시에 충족해 우수 연구실로 인증됐다.

이광형 총장은 "최근 중대재해 처벌 등에 관한 법률이 시행되어 공공기관의 사회적 책임에 부응하기 위해 안전보건경영시스템 'ISO45001' 인증을 준비하는 등 연구실 안전관리에 많은 관심을 가지고 있다"라고 전했다. 이어 이 총장은, "KAIST의 우수한 연구자들이 안전하게 연구할 수 있도록 안전관리 우수연구실 인증을 향후 확대하여 시행하는 등 안전관리에 만전을 기하겠다"고 강조했다. 26일 오후 2시부터 진행된 인증서 수여식에는 이승섭 교학부총장, 방진섭 행정처장 등 보직자들과 해당 연구실 관계자들이 참여했다. 또한, 연구실 내 행정적 관리를 평가하는 "안전 환경 시스템 분야"와 구성원의 안전의식을 평가하는 "안전관리 관계자 안전의식 분야"에서 높은 점수를 받은 강정구 신소재공학과 교수 연구실 투어가 진행됐다.

7개 연구실, '안전관리 우수연구실' 인증 취득

우리 대학 7개 연구실이 과학기술정보통신부가 주관하는 2022 안전관리 우수연구실 인증을 획득했다.

안전관리 우수연구실 인증제는 대학이나 연구기관 등에 설치된 과학기술 분야 연구실이 자율적으로 안전관리 역량을 강화할 수 있도록 정부가 2013년 도입한 제도다. 안전관리 표준모델을 발굴하고 확산하는 것을 목표로 안전관리 수준과 활동이 우수한 연구실에 전문가의 심사를 통한 인증을 부여하고 있다.

이번에 신규 인증을 획득한 연구실은 총 7개로 대전 소재 정부출연연구기관 중 최다 규모다. 생명과학과 ①시스템 및 합성생물학 연구실(조병관 교수), 신소재공학과 ②NanoSF 연구실(강정구 교수), ③바이오신소재연구실(박찬범 교수), ④지속가능에너지재료 연구실(정우철 교수), ⑤신소재 영상화 및 융합 연구실(홍승범 교수), 원자력및양자공학과 ⑥핵융합 및 플라즈마 동역학 연구실(성충기 교수), 화학과 ⑦나노촉매연구실(송현준 교수) 등이다.

해당 연구실들은 ▴연구실 안전 환경 시스템 분야(30점) ▴연구실 안전 환경 활동 수준 분야(50점), ▴연구실 안전관리 관계자 안전의식 분야(20점) 등 세 가지로 구분된 심사 항목에서 각 분야 배점의 80% 이상을 득점하고 80점 이상의 총점을 얻었다. 또한, 안전관리 우수연구실 인증제 운영에 관한 규정에 명시된 필수 이행항목 4종에 대한 평가를 동시에 충족해 우수 연구실로 인증됐다.

이광형 총장은 "최근 중대재해 처벌 등에 관한 법률이 시행되어 공공기관의 사회적 책임에 부응하기 위해 안전보건경영시스템 'ISO45001' 인증을 준비하는 등 연구실 안전관리에 많은 관심을 가지고 있다"라고 전했다. 이어 이 총장은, "KAIST의 우수한 연구자들이 안전하게 연구할 수 있도록 안전관리 우수연구실 인증을 향후 확대하여 시행하는 등 안전관리에 만전을 기하겠다"고 강조했다. 26일 오후 2시부터 진행된 인증서 수여식에는 이승섭 교학부총장, 방진섭 행정처장 등 보직자들과 해당 연구실 관계자들이 참여했다. 또한, 연구실 내 행정적 관리를 평가하는 "안전 환경 시스템 분야"와 구성원의 안전의식을 평가하는 "안전관리 관계자 안전의식 분야"에서 높은 점수를 받은 강정구 신소재공학과 교수 연구실 투어가 진행됐다.

2023.01.30

조회수 5211

-

리튬이차전지 실리콘 기반 음극의 수명과 관련된 전자전도도 퇴화를 나노스케일에서 영상화 성공

고에너지 밀도를 갖는 리튬이차전지 개발에 대한 수요가 폭발적으로 증가하면서, 실리콘 기반 음극 개발에 관한 연구가 활발히 이뤄지고 있다. 실리콘 활물질은 기존 음극 활물질인 흑연 대비 높은 용량 값(4200 mAh/g)을 가지고 있어, 고에너지 밀도를 가지는 리튬이차전지용 음극의 유력한 후보로 자리 잡고 있다.

하지만 충전 및 방전 간 400%에 달하는 높은 부피 팽창/수축률이 실리콘 활물질의 상업화를 방해하고 있다. 실리콘 기반 음극의 급격한 부피 변화는 특히 전극 내 전자 전달 시스템에 큰 악영향을 미치고 있으며, 이를 보완하기 위해 다양한 도전재 시스템을 적용하는 연구가 활발히 진행 중이다. 전극 내 전자 전도 채널의 확보는, 활물질 내 균등한 전기화학 반응을 유발하기 위해 필수적이지만, 이를 나노스케일 공간 분해능을 갖고 영상화하는 방법론에 관해서는 많은 연구가 진행되지 않은 실정이다.

우리 대학 신소재공학과 홍승범 교수 연구팀이 LG에너지솔루션과 협업해, 나노스케일 분해능으로 전극 내 전자 전도 채널을 왜곡 신호 없이 정량적으로 추출하는 방법론을 개발하는 데 성공했다고 8일 밝혔다. 연구팀은 전극 소재와 같이 표면 거칠기가 큰 시료에서 전도성 원자간력현미경(Conductive Atomic Force Microscopy, C-AFM) 운용 시 발생하는 왜곡 정보인 용량성 전류(capacitive current)의 원인을 규명하고, 피어슨 상관 분석 방법을 기반으로 해당 왜곡 정보를 제거했다. 이 방법론을 실리콘/흑연 기반 복합 음극에 적용해 도전재 성분에 따른 전자 전도 채널 영상화를 실시했으며, 이를 통해 단일벽 탄소나노튜브(Signle-Walled Carbon Nano Tube, 이하 SWNCT)가 적용된 전극의 전기적, 전기화학적 우수성을 입증하는 데 성공했다.

연구팀은 이번 연구를 통해 실리콘 기반 전극과 같이 활물질의 부피 변화가 큰 시스템에서는 기존의 점형 도전재 대비 선형의 구조적 장점을 갖고 있는 SWCNT가 안정적인 전자 전도 채널을 확보하는 데 유리함을 보였다. 또한 SWCNT가 포함된 복합 전극의 경우, 130 사이클 이후에도 활물질의 분쇄가 보다 억제됐음을 보여주며, 전자 전도 채널의 불균일성이 활물질의 구조적 안정성에도 영향을 미칠 수 있음을 가설을 들어 설명했다.

제1 저자인 신소재공학과 박건 박사과정은 "전자 전도 채널 불균일이 유발한 전극의 전기화학 특성 퇴화라는 주제로 후속 연구를 진행 중이다ˮ라며 "나노스케일 영상화를 기반으로 지금껏 관찰하지 못했던 현상을 탐구할 수 있어 즐겁다ˮ라고 말했다. 교신 저자인 홍승범 교수는 "왜곡 신호의 원인을 규명하고, 이를 정량적으로 제거하는 연구는 영상화 분야에서 매우 중요하다ˮ라며 "이번에 개발한 방법론이 전극 내 전자 전도 채널을 강화하는데 적용돼, 실리콘 기반 복합 음극의 고도화를 앞당기는 데 도움이 되면 좋겠다ˮ라고 말했다.

이번 연구는 국제 학술지 `에이씨에스 어플라이드 머티리얼즈 앤드 인터페이시스(ACS Applied Materials & Interfaces)'에 게재됐다. (논문명: Nanoscale Visualization of the Electron Conduction Channel in the SiO/Graphite Composite Anode)

한편 이번 연구는 LG에너지솔루션-KAIST 프론티어 리서치 랩(Frontier Research Lab)과 KAIST 글로벌 특이점 사업의 지원을 받아 수행됐다.

리튬이차전지 실리콘 기반 음극의 수명과 관련된 전자전도도 퇴화를 나노스케일에서 영상화 성공

고에너지 밀도를 갖는 리튬이차전지 개발에 대한 수요가 폭발적으로 증가하면서, 실리콘 기반 음극 개발에 관한 연구가 활발히 이뤄지고 있다. 실리콘 활물질은 기존 음극 활물질인 흑연 대비 높은 용량 값(4200 mAh/g)을 가지고 있어, 고에너지 밀도를 가지는 리튬이차전지용 음극의 유력한 후보로 자리 잡고 있다.

하지만 충전 및 방전 간 400%에 달하는 높은 부피 팽창/수축률이 실리콘 활물질의 상업화를 방해하고 있다. 실리콘 기반 음극의 급격한 부피 변화는 특히 전극 내 전자 전달 시스템에 큰 악영향을 미치고 있으며, 이를 보완하기 위해 다양한 도전재 시스템을 적용하는 연구가 활발히 진행 중이다. 전극 내 전자 전도 채널의 확보는, 활물질 내 균등한 전기화학 반응을 유발하기 위해 필수적이지만, 이를 나노스케일 공간 분해능을 갖고 영상화하는 방법론에 관해서는 많은 연구가 진행되지 않은 실정이다.

우리 대학 신소재공학과 홍승범 교수 연구팀이 LG에너지솔루션과 협업해, 나노스케일 분해능으로 전극 내 전자 전도 채널을 왜곡 신호 없이 정량적으로 추출하는 방법론을 개발하는 데 성공했다고 8일 밝혔다. 연구팀은 전극 소재와 같이 표면 거칠기가 큰 시료에서 전도성 원자간력현미경(Conductive Atomic Force Microscopy, C-AFM) 운용 시 발생하는 왜곡 정보인 용량성 전류(capacitive current)의 원인을 규명하고, 피어슨 상관 분석 방법을 기반으로 해당 왜곡 정보를 제거했다. 이 방법론을 실리콘/흑연 기반 복합 음극에 적용해 도전재 성분에 따른 전자 전도 채널 영상화를 실시했으며, 이를 통해 단일벽 탄소나노튜브(Signle-Walled Carbon Nano Tube, 이하 SWNCT)가 적용된 전극의 전기적, 전기화학적 우수성을 입증하는 데 성공했다.

연구팀은 이번 연구를 통해 실리콘 기반 전극과 같이 활물질의 부피 변화가 큰 시스템에서는 기존의 점형 도전재 대비 선형의 구조적 장점을 갖고 있는 SWCNT가 안정적인 전자 전도 채널을 확보하는 데 유리함을 보였다. 또한 SWCNT가 포함된 복합 전극의 경우, 130 사이클 이후에도 활물질의 분쇄가 보다 억제됐음을 보여주며, 전자 전도 채널의 불균일성이 활물질의 구조적 안정성에도 영향을 미칠 수 있음을 가설을 들어 설명했다.

제1 저자인 신소재공학과 박건 박사과정은 "전자 전도 채널 불균일이 유발한 전극의 전기화학 특성 퇴화라는 주제로 후속 연구를 진행 중이다ˮ라며 "나노스케일 영상화를 기반으로 지금껏 관찰하지 못했던 현상을 탐구할 수 있어 즐겁다ˮ라고 말했다. 교신 저자인 홍승범 교수는 "왜곡 신호의 원인을 규명하고, 이를 정량적으로 제거하는 연구는 영상화 분야에서 매우 중요하다ˮ라며 "이번에 개발한 방법론이 전극 내 전자 전도 채널을 강화하는데 적용돼, 실리콘 기반 복합 음극의 고도화를 앞당기는 데 도움이 되면 좋겠다ˮ라고 말했다.

이번 연구는 국제 학술지 `에이씨에스 어플라이드 머티리얼즈 앤드 인터페이시스(ACS Applied Materials & Interfaces)'에 게재됐다. (논문명: Nanoscale Visualization of the Electron Conduction Channel in the SiO/Graphite Composite Anode)

한편 이번 연구는 LG에너지솔루션-KAIST 프론티어 리서치 랩(Frontier Research Lab)과 KAIST 글로벌 특이점 사업의 지원을 받아 수행됐다.

2022.11.08

조회수 5502

차세대 새로운 패러다임 동영상 인식기술 개발

챗GPT와 같은 거대 언어 모델의 근간이 되는 트랜스포머로 구축된 기존 비디오 모델보다 8배 낮은 연산량과 4배 낮은 메모리 사용량으로도 높은 정확도를 기록했으며, 추론 속도 또한 기존 트랜스포머 기반 모델 대비 4배의 매우 빠른 속도를 달성한 동영상 인식기술이 우리 연구진에 의해 개발됐다.

우리 대학 전기및전자공학부 김창익 교수 연구팀이 초고효율 동영상 인식 모델 ‘비디오맘바(VideoMamba)’를 개발했다고 23일 밝혔다.

비디오맘바는 기존 트랜스포머 기반 모델들이 가지고 있는 높은 계산 복잡성을 해결하기 위해 설계된 새로운 동영상 인식 모델이다. 기존의 트랜스포머 기반 모델들은 셀프-어텐션(self-attention)이라는 메커니즘에 의존해 계산 복잡도가 제곱으로 증가하는 문제를 가지고 있었다.

김창익 교수 연구팀의 비디오맘바는 선택적 상태 공간 모델(Selective State Space Model, Selective SSM)* 메커니즘을 활용해 선형 복잡도**로 효율적인 처리가 가능하다. 이를 통해 비디오맘바는 동영상의 시공간적 정보를 효과적으로 포착해 긴 종속성을 가진 동영상 데이터도 효율적으로 처리할 수 있다.

*선택적 상태 공간 모델(Selective SSM): 입력에 따라 동적으로 매개변수를 조정하여 시퀀스 데이터의 문맥을 더 잘 이해하는 상태 공간 모델

**선형 복잡도:입력 데이터의 크기에 비례하여 계산량이 증가하는 알고리즘 복잡도

김창익 교수 연구팀은 동영상 인식 모델의 효율성을 극대화하기 위해 비디오맘바에 1차원 데이터 처리에 국한된 기존 선택적 상태 공간 메커니즘을 3차원 시공간 데이터 분석이 가능하도록 고도화한 시공간적 전방 및 후방 선택적 상태 공간 모델(spatio-temporal forward and backward SSM)을 도입했다. 이 모델은 순서가 없는 공간 정보와 순차적인 시간 정보를 효과적으로 통합해 인식 성능을 향상한다. 연구팀은 다양한 동영상 인식 벤치마크에서 비디오맘바의 성능을 검증했다.

연구팀이 개발한 비디오맘바는 영상 분석이 필요한 다양한 응용 분야에서 효율적이고 실용적인 솔루션을 제공할 수 있다. 예를 들어, 자율주행에서는 주행 영상을 분석해 도로 상황을 정확하게 파악하고, 보행자와 장애물을 실시간으로 인식해 사고를 예방할 수 있다. 의료 분야에서는 수술 영상을 분석해 환자의 상태를 실시간으로 모니터링하고 긴급 상황 발생 시 신속히 대처할 수 있다. 스포츠 분야에서는 경기 중 선수들의 움직임과 전술을 분석해 전략을 개선하고, 훈련 중 피로도나 부상 가능성을 실시간으로 감지해 예방할 수 있다.

연구를 주도한 김창익 교수는 “비디오맘바의 빠른 처리 속도와 낮은 메모리 사용량, 그리고 뛰어난 성능은 우리 생활에서의 다양한 동영상 활용 분야에 큰 장점을 제공할 것이다”고 연구의 의의를 설명했다.

이번 연구에는 전기및전자공학부 박진영 석박사통합과정, 김희선 박사과정, 고강욱 박사과정이 공동 제1 저자, 김민범 박사과정이 공동 저자, 그리고 전기및전자공학부 김창익 교수가 교신 저자로 참여했다. 연구 결과는 올해 9월 이탈리아 밀라노에서 열리는 컴퓨터 비전 분야 최우수 국제 학회 중 하나인 ‘European Conference on Computer Vision(ECCV) 2024’에서 발표될 예정이다. (논문명: VideoMamba: Spatio-Temporal Selective State Space Model)

한편, 이번 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행됐다. (No. 2020-0-00153, 기계학습 모델 보안 역기능 취약점 자동 탐지 및 방어 기술 개발)

2024.07.23 조회수 462

차세대 새로운 패러다임 동영상 인식기술 개발

챗GPT와 같은 거대 언어 모델의 근간이 되는 트랜스포머로 구축된 기존 비디오 모델보다 8배 낮은 연산량과 4배 낮은 메모리 사용량으로도 높은 정확도를 기록했으며, 추론 속도 또한 기존 트랜스포머 기반 모델 대비 4배의 매우 빠른 속도를 달성한 동영상 인식기술이 우리 연구진에 의해 개발됐다.

우리 대학 전기및전자공학부 김창익 교수 연구팀이 초고효율 동영상 인식 모델 ‘비디오맘바(VideoMamba)’를 개발했다고 23일 밝혔다.

비디오맘바는 기존 트랜스포머 기반 모델들이 가지고 있는 높은 계산 복잡성을 해결하기 위해 설계된 새로운 동영상 인식 모델이다. 기존의 트랜스포머 기반 모델들은 셀프-어텐션(self-attention)이라는 메커니즘에 의존해 계산 복잡도가 제곱으로 증가하는 문제를 가지고 있었다.

김창익 교수 연구팀의 비디오맘바는 선택적 상태 공간 모델(Selective State Space Model, Selective SSM)* 메커니즘을 활용해 선형 복잡도**로 효율적인 처리가 가능하다. 이를 통해 비디오맘바는 동영상의 시공간적 정보를 효과적으로 포착해 긴 종속성을 가진 동영상 데이터도 효율적으로 처리할 수 있다.

*선택적 상태 공간 모델(Selective SSM): 입력에 따라 동적으로 매개변수를 조정하여 시퀀스 데이터의 문맥을 더 잘 이해하는 상태 공간 모델

**선형 복잡도:입력 데이터의 크기에 비례하여 계산량이 증가하는 알고리즘 복잡도

김창익 교수 연구팀은 동영상 인식 모델의 효율성을 극대화하기 위해 비디오맘바에 1차원 데이터 처리에 국한된 기존 선택적 상태 공간 메커니즘을 3차원 시공간 데이터 분석이 가능하도록 고도화한 시공간적 전방 및 후방 선택적 상태 공간 모델(spatio-temporal forward and backward SSM)을 도입했다. 이 모델은 순서가 없는 공간 정보와 순차적인 시간 정보를 효과적으로 통합해 인식 성능을 향상한다. 연구팀은 다양한 동영상 인식 벤치마크에서 비디오맘바의 성능을 검증했다.

연구팀이 개발한 비디오맘바는 영상 분석이 필요한 다양한 응용 분야에서 효율적이고 실용적인 솔루션을 제공할 수 있다. 예를 들어, 자율주행에서는 주행 영상을 분석해 도로 상황을 정확하게 파악하고, 보행자와 장애물을 실시간으로 인식해 사고를 예방할 수 있다. 의료 분야에서는 수술 영상을 분석해 환자의 상태를 실시간으로 모니터링하고 긴급 상황 발생 시 신속히 대처할 수 있다. 스포츠 분야에서는 경기 중 선수들의 움직임과 전술을 분석해 전략을 개선하고, 훈련 중 피로도나 부상 가능성을 실시간으로 감지해 예방할 수 있다.

연구를 주도한 김창익 교수는 “비디오맘바의 빠른 처리 속도와 낮은 메모리 사용량, 그리고 뛰어난 성능은 우리 생활에서의 다양한 동영상 활용 분야에 큰 장점을 제공할 것이다”고 연구의 의의를 설명했다.

이번 연구에는 전기및전자공학부 박진영 석박사통합과정, 김희선 박사과정, 고강욱 박사과정이 공동 제1 저자, 김민범 박사과정이 공동 저자, 그리고 전기및전자공학부 김창익 교수가 교신 저자로 참여했다. 연구 결과는 올해 9월 이탈리아 밀라노에서 열리는 컴퓨터 비전 분야 최우수 국제 학회 중 하나인 ‘European Conference on Computer Vision(ECCV) 2024’에서 발표될 예정이다. (논문명: VideoMamba: Spatio-Temporal Selective State Space Model)

한편, 이번 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행됐다. (No. 2020-0-00153, 기계학습 모델 보안 역기능 취약점 자동 탐지 및 방어 기술 개발)

2024.07.23 조회수 462 인공지능으로 배터리 원소, 충방전 상태 인식

국제공동연구진이 인공지능 학습을 통해 배터리의 표면 형상만 보고 각 원소의 함량 그리고 충·방전 횟수에 대한 정보를 높은 정확도로 알아내는 영상인식 기술을 개발하여 화제다.

우리 대학 신소재공학과 홍승범 교수가 한국전자통신연구원(ETRI), 미국 드렉셀대학과 공동연구를 통해 다양한 조성과 각기 다른 충·방전 사이클의 NCM 양극재 주사전자현미경 사진을 합성곱 신경망* 기반 인공지능에 학습시켜 주요 원소 함량과 충·방전 상태를 99.6%의 높은 정확도로 맞추는 방법론을 세계 최초로 개발했다고 2일 밝혔다.

*합성곱 신경망(콘볼루션 신경망, Convolutional Neural Network, CNN): 시각적 영상을 분석하는 데 사용되는 다층의 피드-포워드적인 인공신경망의 한 종류이다.

연구팀은 반도체 공정에서는 웨이퍼의 불량 검수를 위해 주사전자현미경(SEM)을 사용하는 반면 배터리 공정에서는 그런 경우가 드물고 연구 현장에서만 입자의 크기 분석을 위해 SEM을 활용하고, 열화된 배터리 소재의 경우 입자가 깨지고 부서지는 형상으로부터 신뢰성을 예측하는 것에 착안했다. 연구팀은 반도체 공정에서와 같이 배터리 공정도 자동화된 SEM으로 양극재 표면을 검수해서 원하는 조성대로 합성이 되었는지 수명은 신뢰성 있게 나올 것인지를 확인해 불량률을 줄일 수 있다면 획기적일 것으로 판단했다.

연구진은 자율주행차에 적용가능한 합성곱 신경망 기반 인공지능에 배터리 소재의 표면 영상을 학습시켜서 양극재의 주 원소 함량과 충·방전 사이클 상태를 예측할 수 있게 했다. 이런 방법론이 첨가제가 들어간 양극재에도 적용가능한 지 확인한 결과 함량은 상당히 정확하게 예측하는 반면 충·방전 상태는 정확도가 낮다는 단점을 알게 됐다. 이에 연구팀은 향후 다양한 공정을 통해서 만든 배터리 소재의 형상을 학습시켜 차세대 배터리의 조성 균일성 검수 및 수명 예측에 활용할 계획이다.

연구를 이끈 홍승범 교수는 “이번 연구는 세계 최초로 마이크론 스케일의 주사전자현미경 사진의 소재 구조 데이터를 통해 주 원소 함량과 충·방전 상태를 빠르고 정확하게 예측할 수 있는 인공지능 기반 방법론을 개발한 데 의의가 있고 이번 연구에서 개발된 현미경 영상 기반 배터리 소재의 함량 및 상태 감별 방법론은 향후 배터리 소재의 성능과 품질을 향상하는 데 중요한 역할을 하게 될 것으로 기대된다”고 전망했다.

한편, 이번 연구는 공동 제1 저자인 신소재공학과 졸업생 오지민 박사와 염지원 박사와 공동저자인 ETRI 김광만 박사와 미국 드렉셀 대학교 아가르(Agar) 교수가 참여하였고, 한국연구재단(2020M3H4A3081880, RS-2023-00247245), KAIST 글로벌특이점 사업의 지원 및 미국 연구진과의 국제공동연구를 통해 수행됐으며, 국제 학술지 ‘엔피제이 컴퓨테이셔날 머티리얼즈(npj computational materials)’에 지난 5월 4일 자 출판됐다. (논문 제목: Composition and state prediction of lithium-ion cathode via convolutional neural network trained on scanning electron microscopy images)

2024.07.02 조회수 691

인공지능으로 배터리 원소, 충방전 상태 인식

국제공동연구진이 인공지능 학습을 통해 배터리의 표면 형상만 보고 각 원소의 함량 그리고 충·방전 횟수에 대한 정보를 높은 정확도로 알아내는 영상인식 기술을 개발하여 화제다.

우리 대학 신소재공학과 홍승범 교수가 한국전자통신연구원(ETRI), 미국 드렉셀대학과 공동연구를 통해 다양한 조성과 각기 다른 충·방전 사이클의 NCM 양극재 주사전자현미경 사진을 합성곱 신경망* 기반 인공지능에 학습시켜 주요 원소 함량과 충·방전 상태를 99.6%의 높은 정확도로 맞추는 방법론을 세계 최초로 개발했다고 2일 밝혔다.

*합성곱 신경망(콘볼루션 신경망, Convolutional Neural Network, CNN): 시각적 영상을 분석하는 데 사용되는 다층의 피드-포워드적인 인공신경망의 한 종류이다.

연구팀은 반도체 공정에서는 웨이퍼의 불량 검수를 위해 주사전자현미경(SEM)을 사용하는 반면 배터리 공정에서는 그런 경우가 드물고 연구 현장에서만 입자의 크기 분석을 위해 SEM을 활용하고, 열화된 배터리 소재의 경우 입자가 깨지고 부서지는 형상으로부터 신뢰성을 예측하는 것에 착안했다. 연구팀은 반도체 공정에서와 같이 배터리 공정도 자동화된 SEM으로 양극재 표면을 검수해서 원하는 조성대로 합성이 되었는지 수명은 신뢰성 있게 나올 것인지를 확인해 불량률을 줄일 수 있다면 획기적일 것으로 판단했다.

연구진은 자율주행차에 적용가능한 합성곱 신경망 기반 인공지능에 배터리 소재의 표면 영상을 학습시켜서 양극재의 주 원소 함량과 충·방전 사이클 상태를 예측할 수 있게 했다. 이런 방법론이 첨가제가 들어간 양극재에도 적용가능한 지 확인한 결과 함량은 상당히 정확하게 예측하는 반면 충·방전 상태는 정확도가 낮다는 단점을 알게 됐다. 이에 연구팀은 향후 다양한 공정을 통해서 만든 배터리 소재의 형상을 학습시켜 차세대 배터리의 조성 균일성 검수 및 수명 예측에 활용할 계획이다.

연구를 이끈 홍승범 교수는 “이번 연구는 세계 최초로 마이크론 스케일의 주사전자현미경 사진의 소재 구조 데이터를 통해 주 원소 함량과 충·방전 상태를 빠르고 정확하게 예측할 수 있는 인공지능 기반 방법론을 개발한 데 의의가 있고 이번 연구에서 개발된 현미경 영상 기반 배터리 소재의 함량 및 상태 감별 방법론은 향후 배터리 소재의 성능과 품질을 향상하는 데 중요한 역할을 하게 될 것으로 기대된다”고 전망했다.

한편, 이번 연구는 공동 제1 저자인 신소재공학과 졸업생 오지민 박사와 염지원 박사와 공동저자인 ETRI 김광만 박사와 미국 드렉셀 대학교 아가르(Agar) 교수가 참여하였고, 한국연구재단(2020M3H4A3081880, RS-2023-00247245), KAIST 글로벌특이점 사업의 지원 및 미국 연구진과의 국제공동연구를 통해 수행됐으며, 국제 학술지 ‘엔피제이 컴퓨테이셔날 머티리얼즈(npj computational materials)’에 지난 5월 4일 자 출판됐다. (논문 제목: Composition and state prediction of lithium-ion cathode via convolutional neural network trained on scanning electron microscopy images)

2024.07.02 조회수 691 KAIST미술관이 기획한 롯데월드 서울스카이 초청 전시, “다누리의 스펙타클 365”

우리 대학이 이달 20일부터 대한민국 최초의 달 탐사선인 다누리의 달 궤도 임무운영 1주년을 기념하기 위한 전시회를 ㈜롯데월드 서울스카이(SEOUL SKY)에서 개최한다. '다누리의 스펙타클 365'는 KAIST 미술관이 지난 6월부터 8월까지 본교 창의학습관에서 진행했던 '다누리의 스펙타클' 전시의 연장선이다. 대한민국 항공우주산업의 연구성과를 전시해 우주여행에 대한 간접 체험을 제공하고 미디어아트와 다누리 촬영 작품을 통해 우주과학 기술에 대한 관람객의 상상력을 자극하기 위해 기획됐다.

㈜롯데월드 서울스카이의 초청을 받아 규모를 확장해 진행하는 이번 전시는 서울스카이 곳곳에 작품을 설치해 관람객을 맞이하는 것이 가장 큰 특징이다. 120층 메인홀에는 국내 최초로 지구와 달을 동시에 촬영한 작품과 다누리 모형을 배치해 작품을 통해 다누리가 바라본 우주의 모습을 입체적으로 감상할 수 있게 공간을 구성했다. 전시장 안쪽으로는 달 궤도 진입 후 조우한 달의 모습과 미국 아르테미스 유인 미션 착륙 후보지 등의 작품이 전시된다.

120층 전시장으로 향하는 지하 1층 매표소에는 발사체가 우주로 진입하는 영상을 배치해 우주여행을 떠나는 듯한 몰입감을 극대화했다. 지하 2층에는 모션그래픽을 활용한 영상작품을 감상할 수 있는 미디어월이 설치됐다. 다누리가 촬영한 지구와 달을 배치해 관람객에게 공전 및 자전을 관측하는 듯한 경험을 선사하고 통로 측에는 인공위성 관제실 그래픽과 다누리 발사 당시 음향을 활용해 다누리의 발사에 함께하는 듯한 현장감을 더했다.

이외에도 대한민국 우주과학 기술의 여정을 대중에게 소개하기 위해 KAIST 인공위성연구소가 개발한 우리나라 최초 인공위성 우리별 1호도 전시된다. 석현정 KAIST 미술관장은 "이번 전시는 과학기술의 결과물을 감상이 가능한 콘텐츠로 만들어내 관람객들이 예술적 감동을 느낄 수 있도록 공간을 구성했다"라고 전했다. 이어 석 관장은 "다누리의 달 궤도 임무운영 1주년을 기념하는 이 특별한 순간을 함께 나누는 전시 관람을 통해 대한민국 우주과학 기술의 성과를 체감하고 우주를 향한 우리의 도전에도 많은 관심과 응원 부탁드린다"라고 덧붙였다. 한편, '다누리의 스펙타클 365' 전시회는 KAIST 미술관이 한국항공우주연구원, 과학기술정보통신부와 함께 공동 주관·주최한다. KAIST 인공위성연구소, 한국연구재단이 참여하고 ㈜롯데월드 서울스카이가 후원하며, 오는 1월 31일(수)까지 ㈜롯데월드 서울스카이 입장객에게 무료로 공개된다.

2023.12.19 조회수 2295

KAIST미술관이 기획한 롯데월드 서울스카이 초청 전시, “다누리의 스펙타클 365”

우리 대학이 이달 20일부터 대한민국 최초의 달 탐사선인 다누리의 달 궤도 임무운영 1주년을 기념하기 위한 전시회를 ㈜롯데월드 서울스카이(SEOUL SKY)에서 개최한다. '다누리의 스펙타클 365'는 KAIST 미술관이 지난 6월부터 8월까지 본교 창의학습관에서 진행했던 '다누리의 스펙타클' 전시의 연장선이다. 대한민국 항공우주산업의 연구성과를 전시해 우주여행에 대한 간접 체험을 제공하고 미디어아트와 다누리 촬영 작품을 통해 우주과학 기술에 대한 관람객의 상상력을 자극하기 위해 기획됐다.

㈜롯데월드 서울스카이의 초청을 받아 규모를 확장해 진행하는 이번 전시는 서울스카이 곳곳에 작품을 설치해 관람객을 맞이하는 것이 가장 큰 특징이다. 120층 메인홀에는 국내 최초로 지구와 달을 동시에 촬영한 작품과 다누리 모형을 배치해 작품을 통해 다누리가 바라본 우주의 모습을 입체적으로 감상할 수 있게 공간을 구성했다. 전시장 안쪽으로는 달 궤도 진입 후 조우한 달의 모습과 미국 아르테미스 유인 미션 착륙 후보지 등의 작품이 전시된다.

120층 전시장으로 향하는 지하 1층 매표소에는 발사체가 우주로 진입하는 영상을 배치해 우주여행을 떠나는 듯한 몰입감을 극대화했다. 지하 2층에는 모션그래픽을 활용한 영상작품을 감상할 수 있는 미디어월이 설치됐다. 다누리가 촬영한 지구와 달을 배치해 관람객에게 공전 및 자전을 관측하는 듯한 경험을 선사하고 통로 측에는 인공위성 관제실 그래픽과 다누리 발사 당시 음향을 활용해 다누리의 발사에 함께하는 듯한 현장감을 더했다.

이외에도 대한민국 우주과학 기술의 여정을 대중에게 소개하기 위해 KAIST 인공위성연구소가 개발한 우리나라 최초 인공위성 우리별 1호도 전시된다. 석현정 KAIST 미술관장은 "이번 전시는 과학기술의 결과물을 감상이 가능한 콘텐츠로 만들어내 관람객들이 예술적 감동을 느낄 수 있도록 공간을 구성했다"라고 전했다. 이어 석 관장은 "다누리의 달 궤도 임무운영 1주년을 기념하는 이 특별한 순간을 함께 나누는 전시 관람을 통해 대한민국 우주과학 기술의 성과를 체감하고 우주를 향한 우리의 도전에도 많은 관심과 응원 부탁드린다"라고 덧붙였다. 한편, '다누리의 스펙타클 365' 전시회는 KAIST 미술관이 한국항공우주연구원, 과학기술정보통신부와 함께 공동 주관·주최한다. KAIST 인공위성연구소, 한국연구재단이 참여하고 ㈜롯데월드 서울스카이가 후원하며, 오는 1월 31일(수)까지 ㈜롯데월드 서울스카이 입장객에게 무료로 공개된다.

2023.12.19 조회수 2295 인공지능으로 북한 등 경제지표 추정하다

유엔기구(UN)의 지속가능발전목표(SDGs)에 따르면 하루 2달러 이하로 생활하는 절대빈곤 인구가 7억 명에 달하지만 그 빈곤의 현황을 제대로 파악하기는 쉽지 않다. 전 세계 중 53개국은 지난 15년 동안 농업 관련 현황 조사를 하지 못했으며, 17개국은 인구 센서스(인구주택 총조사)조차 진행하지 못했다. 이러한 데이터 부족을 극복하려는 시도로, 누구나 웹에서 받아볼 수 있는 인공위성 영상을 활용해 경제 지표를 추정하는 기술이 주목받고 있다.

우리 대학 차미영-김지희 교수 연구팀이 기초과학연구원, 서강대, 홍콩과기대(HKUST), 싱가포르국립대(NUS)와 국제공동연구를 통해 주간 위성영상을 활용해 경제 상황을 분석하는 새로운 인공지능(AI) 기법을 개발했다고 21일 밝혔다. 연구팀이 주목한 것은 기존 통계자료를 기반으로 학습하는 일반적인 환경이 아닌, 기초 통계도 미비한 최빈국(最貧國)까지 모니터링할 수 있는 범용적인 모델이다.

연구팀은 유럽우주국(ESA)이 운용하며 무료로 공개하는 센티넬-2(Sentinel-2) 위성영상을 활용했다. 연구팀은 먼저 위성영상을 약 6제곱킬로미터(2.5×2.5㎢)의 작은 구역으로 세밀하게 분할한 후, 각 구역의 경제 지표를 건물, 도로, 녹지 등의 시각적 정보를 기반으로 AI 기법을 통해 수치화했다.

이번 연구 모델이 이전 연구와 차별화된 점은 기초 데이터가 부족한 지역에도 적용할 수 있게끔 인간이 제시하는 정보를 인공지능의 예측에 반영하는 `인간-기계 협업 알고리즘'에 있다. 즉, 인간이 위성영상을 보고 경제 활동의 많고 적음을 비교하면, 기계는 이러한 인간이 제공한 정보를 학습하여 각각의 영상자료에 경제 점수를 부여한다. 검증 결과, 기계학습만 사용했을 때보다 인간과 협업할 경우 성능이 월등히 우수했다.

이번 연구를 통해 연구팀은 기존 통계자료가 부족한 지역까지 경제분석의 범위를 확장하고, 북한 및 아시아 5개국(네팔, 라오스, 미얀마, 방글라데시, 캄보디아)에도 같은 기술을 적용하여 세밀한 경제 지표 점수를 공개했다. (그림 1) 이 연구가 제시한 경제 지표는 기존의 인구밀도, 고용 수, 사업체 수 등의 사회경제지표와 높은 상관관계를 보였으며, 데이터가 부족한 저개발국가에 적용 가능함을 연구팀은 확인했다.

이러한 변화탐지를 북한에 적용한 결과, 대북 경제제재가 심화된 2016년과 2019년 사이에 북한 경제에서 세 가지 경향을 발견할 수 있었다. 첫째, 북한의 경제 발전은 평양과 대도시에 더욱 집중되어 도시와 농촌 간 격차가 심화됐다. 둘째, 경제제재와 달러 외환의 부족을 극복하기 위해 설치한 관광 경제개발구에서는 새로운 건물 건설 등 유의미한 변화가 위성영상 이미지와 연구의 경제 지표 점수 변화에서 드러났다. 셋째, 전통적인 공업 및 수출 경제개발구 유형에서는 반대로 변화가 미미한 것으로 확인됐다.

연구에 참여한 우리 대학 전산학부·IBS 데이터사이언스그룹 CI 차미영 교수는 "전산학, 경제학, 지리학이 융합된 이번 연구는 범지구적 차원의 빈곤 문제를 다룬다는 점에서 중요한 의미가 있으며, 이번에 개발한 인공지능 알고리즘을 앞으로 이산화탄소 배출량, 재해재난 피해 탐지, 기후 변화로 인한 영향 등 다양한 국제사회 문제에 적용해 볼 계획이다ˮ 라고 말했다.

이 연구에는 경제학자인 우리 대학 기술경영학부 김지희 교수, 서강대 경제학과 양현주 교수, 홍콩과기대 박상윤 교수도 함께 참여하였다. 이들은 “이 모델은 저비용으로 개발도상국의 경제 상황을 상세하게 확인할 수 있어 국제개발협력(ODA) 사업에 도움을 줄 수 있을 것으로 예상된다”며 “이번 연구가 선진국과 후진국 간의 데이터 격차를 줄이고 유엔과 국제사회의 공동목표인 지속가능한 발전을 달성하는 데 기여할 수 있기를 바란다ˮ고 밝혔다.

위성영상과 인공지능을 활용한 SDGs 지표의 개발과 이의 정책적 활용은 국제적인 주목을 받고 있는 기술 분야 중 하나이며 한국이 앞으로 주도권을 가지고 이끌 수 있는 연구 분야이다. 이에 연구팀은 개발한 모델 코드를 무료로 공개하며, 측정한 지표가 여러 국가의 정책 설계 및 평가에 유용하게 사용될 수 있도록 앞으로도 기술을 개선하고 매해 새롭게 업데이트되는 인공위성 영상에 적용하여 공개할 계획이다.

한편 이번 연구 결과는 전산학부 안동현 박사과정, 싱가포르 국립대 양재석 박사과정이 공동 1저자로 국제 학술지 네이처 출판 그룹의 `네이처 커뮤니케이션즈(Nature Communications)'에 지난 10월 26일 자 게재됐다. (논문명: A human-machine collaborative approach measures economic development using satellite imagery, 인간-기계 협업과 위성영상 분석에 기반한 경제 발전 측정).

논문링크: https://www.nature.com/articles/s41467-023-42122-8

2023.11.21 조회수 2842

인공지능으로 북한 등 경제지표 추정하다

유엔기구(UN)의 지속가능발전목표(SDGs)에 따르면 하루 2달러 이하로 생활하는 절대빈곤 인구가 7억 명에 달하지만 그 빈곤의 현황을 제대로 파악하기는 쉽지 않다. 전 세계 중 53개국은 지난 15년 동안 농업 관련 현황 조사를 하지 못했으며, 17개국은 인구 센서스(인구주택 총조사)조차 진행하지 못했다. 이러한 데이터 부족을 극복하려는 시도로, 누구나 웹에서 받아볼 수 있는 인공위성 영상을 활용해 경제 지표를 추정하는 기술이 주목받고 있다.

우리 대학 차미영-김지희 교수 연구팀이 기초과학연구원, 서강대, 홍콩과기대(HKUST), 싱가포르국립대(NUS)와 국제공동연구를 통해 주간 위성영상을 활용해 경제 상황을 분석하는 새로운 인공지능(AI) 기법을 개발했다고 21일 밝혔다. 연구팀이 주목한 것은 기존 통계자료를 기반으로 학습하는 일반적인 환경이 아닌, 기초 통계도 미비한 최빈국(最貧國)까지 모니터링할 수 있는 범용적인 모델이다.

연구팀은 유럽우주국(ESA)이 운용하며 무료로 공개하는 센티넬-2(Sentinel-2) 위성영상을 활용했다. 연구팀은 먼저 위성영상을 약 6제곱킬로미터(2.5×2.5㎢)의 작은 구역으로 세밀하게 분할한 후, 각 구역의 경제 지표를 건물, 도로, 녹지 등의 시각적 정보를 기반으로 AI 기법을 통해 수치화했다.

이번 연구 모델이 이전 연구와 차별화된 점은 기초 데이터가 부족한 지역에도 적용할 수 있게끔 인간이 제시하는 정보를 인공지능의 예측에 반영하는 `인간-기계 협업 알고리즘'에 있다. 즉, 인간이 위성영상을 보고 경제 활동의 많고 적음을 비교하면, 기계는 이러한 인간이 제공한 정보를 학습하여 각각의 영상자료에 경제 점수를 부여한다. 검증 결과, 기계학습만 사용했을 때보다 인간과 협업할 경우 성능이 월등히 우수했다.

이번 연구를 통해 연구팀은 기존 통계자료가 부족한 지역까지 경제분석의 범위를 확장하고, 북한 및 아시아 5개국(네팔, 라오스, 미얀마, 방글라데시, 캄보디아)에도 같은 기술을 적용하여 세밀한 경제 지표 점수를 공개했다. (그림 1) 이 연구가 제시한 경제 지표는 기존의 인구밀도, 고용 수, 사업체 수 등의 사회경제지표와 높은 상관관계를 보였으며, 데이터가 부족한 저개발국가에 적용 가능함을 연구팀은 확인했다.

이러한 변화탐지를 북한에 적용한 결과, 대북 경제제재가 심화된 2016년과 2019년 사이에 북한 경제에서 세 가지 경향을 발견할 수 있었다. 첫째, 북한의 경제 발전은 평양과 대도시에 더욱 집중되어 도시와 농촌 간 격차가 심화됐다. 둘째, 경제제재와 달러 외환의 부족을 극복하기 위해 설치한 관광 경제개발구에서는 새로운 건물 건설 등 유의미한 변화가 위성영상 이미지와 연구의 경제 지표 점수 변화에서 드러났다. 셋째, 전통적인 공업 및 수출 경제개발구 유형에서는 반대로 변화가 미미한 것으로 확인됐다.

연구에 참여한 우리 대학 전산학부·IBS 데이터사이언스그룹 CI 차미영 교수는 "전산학, 경제학, 지리학이 융합된 이번 연구는 범지구적 차원의 빈곤 문제를 다룬다는 점에서 중요한 의미가 있으며, 이번에 개발한 인공지능 알고리즘을 앞으로 이산화탄소 배출량, 재해재난 피해 탐지, 기후 변화로 인한 영향 등 다양한 국제사회 문제에 적용해 볼 계획이다ˮ 라고 말했다.

이 연구에는 경제학자인 우리 대학 기술경영학부 김지희 교수, 서강대 경제학과 양현주 교수, 홍콩과기대 박상윤 교수도 함께 참여하였다. 이들은 “이 모델은 저비용으로 개발도상국의 경제 상황을 상세하게 확인할 수 있어 국제개발협력(ODA) 사업에 도움을 줄 수 있을 것으로 예상된다”며 “이번 연구가 선진국과 후진국 간의 데이터 격차를 줄이고 유엔과 국제사회의 공동목표인 지속가능한 발전을 달성하는 데 기여할 수 있기를 바란다ˮ고 밝혔다.

위성영상과 인공지능을 활용한 SDGs 지표의 개발과 이의 정책적 활용은 국제적인 주목을 받고 있는 기술 분야 중 하나이며 한국이 앞으로 주도권을 가지고 이끌 수 있는 연구 분야이다. 이에 연구팀은 개발한 모델 코드를 무료로 공개하며, 측정한 지표가 여러 국가의 정책 설계 및 평가에 유용하게 사용될 수 있도록 앞으로도 기술을 개선하고 매해 새롭게 업데이트되는 인공위성 영상에 적용하여 공개할 계획이다.

한편 이번 연구 결과는 전산학부 안동현 박사과정, 싱가포르 국립대 양재석 박사과정이 공동 1저자로 국제 학술지 네이처 출판 그룹의 `네이처 커뮤니케이션즈(Nature Communications)'에 지난 10월 26일 자 게재됐다. (논문명: A human-machine collaborative approach measures economic development using satellite imagery, 인간-기계 협업과 위성영상 분석에 기반한 경제 발전 측정).

논문링크: https://www.nature.com/articles/s41467-023-42122-8

2023.11.21 조회수 2842 고용량 배터리 수명 증대 영상화하다

전기자동차에서 볼 수 있는 고용량 배터리에 사용되고 있는 실리콘 활물질은 기존 음극 활물질인 흑연 대비 높은 용량 값(4200 mAh/g)을 갖고 있으나, 충전 및 방전 간 400%에 달하는 높은 부피 팽창/수축률이 배터리 수명에 악영향을 미치고 있다. 이를 해결하기 위해서 단일벽 탄소나노튜브를 소량 첨가해 수명 특성이 향상되는 결과를 얻었는데, 이런 향상이 어떻게 가능한지 나노스케일에서 영상화한 연구 결과가 공개됐다.

우리 대학 신소재공학과 홍승범 교수 연구팀이 LG에너지솔루션과 협업해 배터리의 수명 특성 향상 메커니즘 영상화 결과를 국제학술지‘에이씨에스 에너지 레터스(ACS Energy Letters, Impact Factor: 22)’에 게재했다고 19일 밝혔다. (논문명: Spatially Uniform Lithiation Enabled by Single-Walled Carbon Nanotubes)

연구팀은 이전에는 실리콘 활물질이 충·방전을 거치면서 전자 전도 네트워크가 열화되는 과정을 영상화하였는데, 이번 연구에서는 단일벽 탄소나노튜브의 존재로 인해서 그 형태를 유지하고 있는 전자전도 네트워크가 활물질 내에 균일한 충·방전이 가능하도록 기능하고 있음을 보여 수명 증대 메커니즘을 검증했다.

구체적으로 연구팀은 원자간력 현미경(Atomic Force Microscopy) 기반의 켈빈 프루브 현미경(Kelvin Probe Force Microscopy)를 이용해 1회 및 90회 충·방전 싸이클 후의 전극 내 천연흑연과 실리콘 산화물 입자에서의 표면 전위를 측정 및 영상화했다. 이를 통해 단일벽 탄소나노튜브(Single-Walled Carbon Nanotube, SW-CNT)가 첨가된 전극에서는 활물질 내 표면 전위가 균일하게 분포하고 있는 반면, 첨가되지 않은 기존 전극의 경우에는 90회 충·방전 후에 불균일한 표면전위를 보여, 전자 전도 네트워크가 제대로 기능을 발휘하지 않아 불균일한 충·방전이 됨을 연구팀은 확인했다.

이처럼 활물질 내부의 표면 전하를 영상화할 수 있는 기술은 실리콘 활물질 뿐만 아니라, 다양한 전극 시스템에 적용될 수 있으며, 향후 배터리 충전 및 방전 상태 균일성을 확인하고 수명 향상 연구로 발전할 수 있다.

이번 연구의 제1 저자인 신소재공학과 박건 연구원은 “충·방전 시 수반되는 실리콘 계열 활물질의 급격한 부피 변화에도 불구하고 가느다란 탄소나노튜브가 전자 전도 채널을 유지하고 이로 인해 전극 내에 균일한 충·방전을 가능케하는 것이 매우 신기한 일이었는데, 이를 나노스케일에서 직접 영상화해 그 역할을 미시세계에서 이해할 수 있었던 것이 큰 의미가 있다”라고 말했다. 교신 저자인 홍승범 교수는 “원자간력 현미경을 활용해서 나노스케일에서 일어나는 전기화학적인 현상을 영상화하고 이를 통해서 배터리 성능 및 수명을 향상할 수 있는 혁신적인 아이디어를 창출할 수 있게 되어 매우 기쁘다”라고 말했다.

이번 연구는 LG에너지솔루션, LG에너지솔루션-KAIST Frontier Research Lab.과 KAIST 글로벌 특이점 사업의 지원을 받아 수행됐다.

2023.09.19 조회수 2709

고용량 배터리 수명 증대 영상화하다

전기자동차에서 볼 수 있는 고용량 배터리에 사용되고 있는 실리콘 활물질은 기존 음극 활물질인 흑연 대비 높은 용량 값(4200 mAh/g)을 갖고 있으나, 충전 및 방전 간 400%에 달하는 높은 부피 팽창/수축률이 배터리 수명에 악영향을 미치고 있다. 이를 해결하기 위해서 단일벽 탄소나노튜브를 소량 첨가해 수명 특성이 향상되는 결과를 얻었는데, 이런 향상이 어떻게 가능한지 나노스케일에서 영상화한 연구 결과가 공개됐다.

우리 대학 신소재공학과 홍승범 교수 연구팀이 LG에너지솔루션과 협업해 배터리의 수명 특성 향상 메커니즘 영상화 결과를 국제학술지‘에이씨에스 에너지 레터스(ACS Energy Letters, Impact Factor: 22)’에 게재했다고 19일 밝혔다. (논문명: Spatially Uniform Lithiation Enabled by Single-Walled Carbon Nanotubes)

연구팀은 이전에는 실리콘 활물질이 충·방전을 거치면서 전자 전도 네트워크가 열화되는 과정을 영상화하였는데, 이번 연구에서는 단일벽 탄소나노튜브의 존재로 인해서 그 형태를 유지하고 있는 전자전도 네트워크가 활물질 내에 균일한 충·방전이 가능하도록 기능하고 있음을 보여 수명 증대 메커니즘을 검증했다.

구체적으로 연구팀은 원자간력 현미경(Atomic Force Microscopy) 기반의 켈빈 프루브 현미경(Kelvin Probe Force Microscopy)를 이용해 1회 및 90회 충·방전 싸이클 후의 전극 내 천연흑연과 실리콘 산화물 입자에서의 표면 전위를 측정 및 영상화했다. 이를 통해 단일벽 탄소나노튜브(Single-Walled Carbon Nanotube, SW-CNT)가 첨가된 전극에서는 활물질 내 표면 전위가 균일하게 분포하고 있는 반면, 첨가되지 않은 기존 전극의 경우에는 90회 충·방전 후에 불균일한 표면전위를 보여, 전자 전도 네트워크가 제대로 기능을 발휘하지 않아 불균일한 충·방전이 됨을 연구팀은 확인했다.

이처럼 활물질 내부의 표면 전하를 영상화할 수 있는 기술은 실리콘 활물질 뿐만 아니라, 다양한 전극 시스템에 적용될 수 있으며, 향후 배터리 충전 및 방전 상태 균일성을 확인하고 수명 향상 연구로 발전할 수 있다.

이번 연구의 제1 저자인 신소재공학과 박건 연구원은 “충·방전 시 수반되는 실리콘 계열 활물질의 급격한 부피 변화에도 불구하고 가느다란 탄소나노튜브가 전자 전도 채널을 유지하고 이로 인해 전극 내에 균일한 충·방전을 가능케하는 것이 매우 신기한 일이었는데, 이를 나노스케일에서 직접 영상화해 그 역할을 미시세계에서 이해할 수 있었던 것이 큰 의미가 있다”라고 말했다. 교신 저자인 홍승범 교수는 “원자간력 현미경을 활용해서 나노스케일에서 일어나는 전기화학적인 현상을 영상화하고 이를 통해서 배터리 성능 및 수명을 향상할 수 있는 혁신적인 아이디어를 창출할 수 있게 되어 매우 기쁘다”라고 말했다.

이번 연구는 LG에너지솔루션, LG에너지솔루션-KAIST Frontier Research Lab.과 KAIST 글로벌 특이점 사업의 지원을 받아 수행됐다.

2023.09.19 조회수 2709 차세대소형위성 2호 성공적 관측영상 공개

우리 대학은 지난 5월 25일 나로우주센터에서 발사된 누리호 3차 주탑재 위성인 차세대소형위성 2호에 대한 초기 운영을 완수했다고 5일 밝혔다.

차세대소형위성 2호는 2023년 5월 25일 18시 24분에 발사된 후 고도 550km 궤도에 안착했으며, KAIST는 지난 3개월 동안 차세대소형위성 2호에 대한 초기 운영을 통해 위성 본체, 탑재체, 지상국 전반에 걸친 기능 점검과 시스템 안정화 및 탑재체 시험 관측을 모두 수행했다.

초기 운영 기간 중 KAIST 인공위성연구소는 주 탑재체인 ‘영상레이다 (SAR: Synthetic Aperture Radar)’로 전 세계 여러 곳을 시험 촬영하는 데 성공했으며, 초기 운영 종료 시점에 즈음하여 대표적인 시험 관측 영상을 공개했다.

영상레이다는 전파를 지상으로 쏜 후 지상에서 산란되어 되돌아온 전파를 수신하여 신호처리를 통해 영상을 얻기 때문에 주·야간 빛의 영향을 받지 않으며 구름 등 기상 상황과 관계없이 지상관측을 수행할 수 있다. 공개된 시험 관측 영상은 초기 운영 기간 중 영상레이다 탑재체 시험 운영 과정에서 촬영된 영상으로서, 가시광선이 아닌 마이크로파(microwave)로 바라본 세상을 담고 있는 것이 특징이다.

또한 초기 운영 기간 중 과학 탑재체 ‘레오도스 (LEO-DOS)’의 기능을 점검하고 정상적인 작동상태를 확인하였으며, 시험 운영을 통해 우주방사선 관측자료를 확보했다. 한국천문연구원(원장 박영득)이 개발한 근지구궤도 우주방사선 관측장비 ‘레오도스 (LEO-DOS: Low-Earth Orbit space radiation DOSimeter)’가 시험 운영기간 동안 획득한 전 지구 우주방사선 등가선량 지도를 공개했다.

아울러 KAIST 인공위성연구소는 초기 운영 기간 중 산·학·연에서 국산화한 핵심기술검증 탑재체 4종 (① GPS·Galileo 복합 항법 수신기, ② 상변환 물질을 이용한 열 제어장치, ③ X-대역 GaN기반 전력증폭기, ④ 태양전지배열기)에 대한 시험 운영을 통해 모든 탑재체가 정상적으로 작동함도 확인했다.

첫 번째, 항법위성으로부터 신호를 획득해 궤도를 돌고 있는 차세대소형위성 2호의 위치와 속도를 측정하는 ‘GPS·Galileo 복합 항법 수신기((주) 두시텍 개발)’의 모든 기능이 정상적임을 확인하였다. 두 번째, ‘상변환 물질을 이용한 열 제어장치(한국공학대 개발)’에 대한 작동시험 결과 등온 축열 기능을 이용해 열교환을 수행하고 위성 내부 고발열 유닛 온도를 일정하게 유지하는 열제어 기능이 정상 작동함을 확인했다. 세 번째, ‘X-대역 전력증폭기(한국전자통신연구원 개발)’의 상태 정보를 점검하고, 탑재된 전용 안테나를 통해 방사한 X-대역 시험 신호를 지상의 추적안테나로 수신함으로써 전력증폭기가 정상적으로 작동하고 있음을 확인하였다. 네 번째, ‘태양 전지 배열기(KAIST 개발)’가 임무 궤도에서 생성하는 전압과 전류 검침 정보를 통해 우주에서 정상적으로 전력을 생산함을 확인했다.

KAIST 인공위성연구소는 차세대소형위성 2호 발사 후 3개월간의 초기 운영을 완수함에 따라, 이후 영상레이다 탑재체에 대한 기술 검증 임무와 과학 탑재체 및 핵심 기술 검증 탑재체에 대한 정상 임무에 돌입할 예정이다.

영상레이다 탑재체는 향후 8개월간 추가적인 기술 검증을 거친 후 정상 임무를 통해 본격적으로 활용될 예정이다. 추가 기술 검증 기간에는 영상레이다에 대한 기술 시험 운영과 검보정을 수행하게 된다. 기술검증을 최종 완료한 후 정상 임무를 통해 북극 해빙 변화 탐지, 산림변화 탐지 및 해양 환경오염 탐지 등에 활용될 영상레이다 관측 자료를 제공할 예정이다.

KAIST 인공위성연구소 한재흥 소장은 “차세대소형위성 2호의 목표궤도 진입 후 정상적인 위성 관제와 임무 수행을 지속하고 있으며, 영상레이다 탑재체 시험 관측, 과학 탑재체 시험 관측, 핵심기술검증 탑재체 기능 점검을 모두 성공적으로 마쳤다”고 초기 운영 결과를 밝혔다.

한소장은 “KAIST가 개발한 차세대소형위성 2호는 위성 본체와 탑재체 대부분이 국내 독자 기술로 개발됐으며, 공개된 영상은 KAIST가 국내에서는 처음으로 국산화한 우주용 영상레이다를 이용해 촬영한 지구관측 사진이라는 점에서 큰 의미가 있다. 이번에 확보한 귀중한 기술자산과 운영경험이 향후 국산 영상레이다 기술 고도화에 활용되기를 바란다”고 덧붙였다.

2023.09.05 조회수 2112

차세대소형위성 2호 성공적 관측영상 공개

우리 대학은 지난 5월 25일 나로우주센터에서 발사된 누리호 3차 주탑재 위성인 차세대소형위성 2호에 대한 초기 운영을 완수했다고 5일 밝혔다.

차세대소형위성 2호는 2023년 5월 25일 18시 24분에 발사된 후 고도 550km 궤도에 안착했으며, KAIST는 지난 3개월 동안 차세대소형위성 2호에 대한 초기 운영을 통해 위성 본체, 탑재체, 지상국 전반에 걸친 기능 점검과 시스템 안정화 및 탑재체 시험 관측을 모두 수행했다.

초기 운영 기간 중 KAIST 인공위성연구소는 주 탑재체인 ‘영상레이다 (SAR: Synthetic Aperture Radar)’로 전 세계 여러 곳을 시험 촬영하는 데 성공했으며, 초기 운영 종료 시점에 즈음하여 대표적인 시험 관측 영상을 공개했다.

영상레이다는 전파를 지상으로 쏜 후 지상에서 산란되어 되돌아온 전파를 수신하여 신호처리를 통해 영상을 얻기 때문에 주·야간 빛의 영향을 받지 않으며 구름 등 기상 상황과 관계없이 지상관측을 수행할 수 있다. 공개된 시험 관측 영상은 초기 운영 기간 중 영상레이다 탑재체 시험 운영 과정에서 촬영된 영상으로서, 가시광선이 아닌 마이크로파(microwave)로 바라본 세상을 담고 있는 것이 특징이다.

또한 초기 운영 기간 중 과학 탑재체 ‘레오도스 (LEO-DOS)’의 기능을 점검하고 정상적인 작동상태를 확인하였으며, 시험 운영을 통해 우주방사선 관측자료를 확보했다. 한국천문연구원(원장 박영득)이 개발한 근지구궤도 우주방사선 관측장비 ‘레오도스 (LEO-DOS: Low-Earth Orbit space radiation DOSimeter)’가 시험 운영기간 동안 획득한 전 지구 우주방사선 등가선량 지도를 공개했다.

아울러 KAIST 인공위성연구소는 초기 운영 기간 중 산·학·연에서 국산화한 핵심기술검증 탑재체 4종 (① GPS·Galileo 복합 항법 수신기, ② 상변환 물질을 이용한 열 제어장치, ③ X-대역 GaN기반 전력증폭기, ④ 태양전지배열기)에 대한 시험 운영을 통해 모든 탑재체가 정상적으로 작동함도 확인했다.

첫 번째, 항법위성으로부터 신호를 획득해 궤도를 돌고 있는 차세대소형위성 2호의 위치와 속도를 측정하는 ‘GPS·Galileo 복합 항법 수신기((주) 두시텍 개발)’의 모든 기능이 정상적임을 확인하였다. 두 번째, ‘상변환 물질을 이용한 열 제어장치(한국공학대 개발)’에 대한 작동시험 결과 등온 축열 기능을 이용해 열교환을 수행하고 위성 내부 고발열 유닛 온도를 일정하게 유지하는 열제어 기능이 정상 작동함을 확인했다. 세 번째, ‘X-대역 전력증폭기(한국전자통신연구원 개발)’의 상태 정보를 점검하고, 탑재된 전용 안테나를 통해 방사한 X-대역 시험 신호를 지상의 추적안테나로 수신함으로써 전력증폭기가 정상적으로 작동하고 있음을 확인하였다. 네 번째, ‘태양 전지 배열기(KAIST 개발)’가 임무 궤도에서 생성하는 전압과 전류 검침 정보를 통해 우주에서 정상적으로 전력을 생산함을 확인했다.

KAIST 인공위성연구소는 차세대소형위성 2호 발사 후 3개월간의 초기 운영을 완수함에 따라, 이후 영상레이다 탑재체에 대한 기술 검증 임무와 과학 탑재체 및 핵심 기술 검증 탑재체에 대한 정상 임무에 돌입할 예정이다.

영상레이다 탑재체는 향후 8개월간 추가적인 기술 검증을 거친 후 정상 임무를 통해 본격적으로 활용될 예정이다. 추가 기술 검증 기간에는 영상레이다에 대한 기술 시험 운영과 검보정을 수행하게 된다. 기술검증을 최종 완료한 후 정상 임무를 통해 북극 해빙 변화 탐지, 산림변화 탐지 및 해양 환경오염 탐지 등에 활용될 영상레이다 관측 자료를 제공할 예정이다.

KAIST 인공위성연구소 한재흥 소장은 “차세대소형위성 2호의 목표궤도 진입 후 정상적인 위성 관제와 임무 수행을 지속하고 있으며, 영상레이다 탑재체 시험 관측, 과학 탑재체 시험 관측, 핵심기술검증 탑재체 기능 점검을 모두 성공적으로 마쳤다”고 초기 운영 결과를 밝혔다.

한소장은 “KAIST가 개발한 차세대소형위성 2호는 위성 본체와 탑재체 대부분이 국내 독자 기술로 개발됐으며, 공개된 영상은 KAIST가 국내에서는 처음으로 국산화한 우주용 영상레이다를 이용해 촬영한 지구관측 사진이라는 점에서 큰 의미가 있다. 이번에 확보한 귀중한 기술자산과 운영경험이 향후 국산 영상레이다 기술 고도화에 활용되기를 바란다”고 덧붙였다.

2023.09.05 조회수 2112 이창희 교수팀, 인공지능과 서울이 만난 영상 작품 전시

우리 대학이 다음 달 1일부터 두 달간 광화문 광장 해치마당에서 인공지능을 활용한 시각 영상 작품을 전시한다.

산업디자인학과 이창희 교수팀(아트: 송유택, 오주원, 이정아, 김대욱. 보조: 이윤지, 조해나)이 제작한 '서브웨이 시냅스(Subway Synapse)'라는 제목의 작품은 서울시가 주최하는 '하이 에이아이(Hi, Ai)'의 일환으로 전시된다. 첨단 기술을 어려운 매체예술이 아닌 이해하기 쉬운 시민 친화적 미술 작품으로 전시하기 위해 기획된 행사다. 이 교수팀의 작품은 서울의 지하철이 단순한 이동 수단을 넘어 인간의 신경세포를 연결하는 시냅스(Synapse)처럼 우리의 일상을 밀접하게 연결한다는 영감을 바탕으로 만들어졌다. 서울의 여러 공간과 모습을 연결하는 하나의 완전한 시스템으로서의 지하철을 두 개의 영상을 합성하는 크로마키 기법으로 촬영한 후 다양한 생성 인공지능 기술로 상상력을 더해 시각화했다.

자연, 번잡한 거리, 현대적인 스카이라인, 우리나라의 특색있는 문화 예술 등을 담은 서울의 다양한 모습을 하나의 유기적인 흐름으로 재구성했으며, 이를 관람하는 시민들이 서울 여행을 하는 듯한 경험과 동시에 서울이라는 공간을 재발견하게 하려는 의도가 담겨있다.작품을 총괄한 이창희 산업디자인학과 교수는 "서울시민들이 자신들이 살고 있는 도시의 진정한 가치와 아름다움을 다시 한번 느꼈으면 좋겠다는 마음으로 작업했다"라고 밝혔다. 이어, 이 교수는 "인공지능이 예술적 독창성을 파괴한다는 우려와는 다르게 인공지능이 어떻게 예술과 연결될 수 있는지를 보여주는 하나의 예시가 될 수 있길 바란다"라고 전했다.

이 교수팀의 작품은 광화문 광장 이순신 장군과 세종대왕 동상 사이에 설치된 길이 53m 높이 3.25m의 미디어월에서 매일 아침 8시부터 저녁 10시까지 송출된다.

2023.08.30 조회수 3348

이창희 교수팀, 인공지능과 서울이 만난 영상 작품 전시

우리 대학이 다음 달 1일부터 두 달간 광화문 광장 해치마당에서 인공지능을 활용한 시각 영상 작품을 전시한다.

산업디자인학과 이창희 교수팀(아트: 송유택, 오주원, 이정아, 김대욱. 보조: 이윤지, 조해나)이 제작한 '서브웨이 시냅스(Subway Synapse)'라는 제목의 작품은 서울시가 주최하는 '하이 에이아이(Hi, Ai)'의 일환으로 전시된다. 첨단 기술을 어려운 매체예술이 아닌 이해하기 쉬운 시민 친화적 미술 작품으로 전시하기 위해 기획된 행사다. 이 교수팀의 작품은 서울의 지하철이 단순한 이동 수단을 넘어 인간의 신경세포를 연결하는 시냅스(Synapse)처럼 우리의 일상을 밀접하게 연결한다는 영감을 바탕으로 만들어졌다. 서울의 여러 공간과 모습을 연결하는 하나의 완전한 시스템으로서의 지하철을 두 개의 영상을 합성하는 크로마키 기법으로 촬영한 후 다양한 생성 인공지능 기술로 상상력을 더해 시각화했다.

자연, 번잡한 거리, 현대적인 스카이라인, 우리나라의 특색있는 문화 예술 등을 담은 서울의 다양한 모습을 하나의 유기적인 흐름으로 재구성했으며, 이를 관람하는 시민들이 서울 여행을 하는 듯한 경험과 동시에 서울이라는 공간을 재발견하게 하려는 의도가 담겨있다.작품을 총괄한 이창희 산업디자인학과 교수는 "서울시민들이 자신들이 살고 있는 도시의 진정한 가치와 아름다움을 다시 한번 느꼈으면 좋겠다는 마음으로 작업했다"라고 밝혔다. 이어, 이 교수는 "인공지능이 예술적 독창성을 파괴한다는 우려와는 다르게 인공지능이 어떻게 예술과 연결될 수 있는지를 보여주는 하나의 예시가 될 수 있길 바란다"라고 전했다.

이 교수팀의 작품은 광화문 광장 이순신 장군과 세종대왕 동상 사이에 설치된 길이 53m 높이 3.25m의 미디어월에서 매일 아침 8시부터 저녁 10시까지 송출된다.

2023.08.30 조회수 3348 차세대소형위성2호 초기 교신 성공

우리 대학 인공위성연구소(소장 한재흥)에서 개발한 차세대소형위성2호가 지난 5월 25일 18시 24분에 발사된 누리호에서 안전하게 분리되어 목표 궤도에 성공적으로 안착하였으며, 같은날 19시 58분 대전 KAIST 지상국과 최초 교신에 성공했다.

차세대소형위성2호의 최초 비콘 신호는 누리호 발사 후 약 40분 만인 25일 저녁 7시 4분경 항공우주연구원의 남극 세종기지 안테나를 통해 수신할 예정이었으며, 실제로는 7시 7분에 수신이 확인되었다. 위성 발사 후 약 94분 만인 25일 저녁 7시 58분경 대전 KAIST 지상국과 최초 교신에 성공했다.

이후, 남극 세종기지에서 비콘 신호를 2차례 더 확인했고, 스웨덴 보덴 지상국과 대전 KAIST 지상국에서 8차례 교신을 수행하면서 차세대소형위성2호의 통신시스템과 자세제어시스템, 전력시스템, 탑재 컴퓨터 등의 기능을 점검했다.

특히, 국내 우주핵심기술 연구개발 성과물로 차세대소형위성2호의 자세제어시스템에 처음 적용된 반작용휠과 광학자이로의 기능을 점검하고, 차세대소형위성2호 태양전지판이 태양을 바라보는 자세제어와 고속데이터 송신을 위해 안테나를 지상국으로 지향하는 자세제어 기능을 확인했다.

또한, 태양전지판과 태양전력조절기, 리튬이온 배터리 등 차세대소형위성2호의 전력시스템을 점검해, 태양전지판에서 안정적으로 생성된 약 256W의 전력을 통해 위성 배터리가 만충전 상태를 유지하고 있는 것을 확인했다.

차세대소형위성2호는 중점임무인 영상레이더 기술검증과 지구관측, 우주과학임무인 근지구궤도 우주방사선 관측, 그리고 4종의 국내 개발 핵심기술에 대한 우주검증을 수행할 예정이다.

영상레이더는 광학카메라와 달리 빛과 구름의 영향을 받지 않아, 주야간 및 악천후에도 지상 관측이 가능하다. 순수 국내 기술로 개발된 차세대소형위성2호의 X-대역 영상레이더는 해상도 5m, 관측폭 40km의 레이더 영상을 획득을 목표로 한다.

우주방사선 관측기는 근지구 궤도의 중성자·하전입자에 대한 정밀 선량 지도를 작성하고, 태양활동 상승 주기의 우주방사선 변화에 따른 우주환경 영향과 근지구 궤도의 중성자 가중치를 연구하는 데 활용된다.

아울러 산·학·연에서 국산화한 위성핵심기술 4종(①상변환 물질을 이용한 열제어장치, ②X-대역 GaN기반 전력증폭기, ③GPS·Galileo 복합항법수신기, ④태양전지배열기)에 대한 우주검증도 함께 수행된다.

차세대소형위성2호는 약 3개월의 초기 운영 기간 동안 위성 본체 및 탑재체에 대한 기능을 상세히 점검한 후, 계획된 영상레이더에 대한 기술검증•지구관측, 우주방사선 관측 및 핵심기술 검증의 정상적인 임무를 약 2년간 수행할 예정이다.

위성 발사 후 1주일 동안 위성 본체 및 탑재체에 대한 기초적인 상태 점검을 수행하고, 발사 후 1개월까지 위성 본체에 대한 세부 기능을 상세히 점검한 뒤, 발사 후 3개월까지 모든 탑재체에 대한 세부 기능점검을 완료함으로써 향후 정상 임무를 위한 위성 상태 최적화를 수행할 예정이다. 이광형 KAIST 총장은 "우리별 1호부터 30여 년간 축적해온 소형위성 개발과 운영 경험을 바탕으로 차세대소형위성2호의 임무를 성공적으로 완수하여 우리나라 소형위성 기술 수준을 한 단계 높일 수 있을 것으로 기대한다"라고 밝혔다.

2023.05.26 조회수 5298

차세대소형위성2호 초기 교신 성공

우리 대학 인공위성연구소(소장 한재흥)에서 개발한 차세대소형위성2호가 지난 5월 25일 18시 24분에 발사된 누리호에서 안전하게 분리되어 목표 궤도에 성공적으로 안착하였으며, 같은날 19시 58분 대전 KAIST 지상국과 최초 교신에 성공했다.

차세대소형위성2호의 최초 비콘 신호는 누리호 발사 후 약 40분 만인 25일 저녁 7시 4분경 항공우주연구원의 남극 세종기지 안테나를 통해 수신할 예정이었으며, 실제로는 7시 7분에 수신이 확인되었다. 위성 발사 후 약 94분 만인 25일 저녁 7시 58분경 대전 KAIST 지상국과 최초 교신에 성공했다.

이후, 남극 세종기지에서 비콘 신호를 2차례 더 확인했고, 스웨덴 보덴 지상국과 대전 KAIST 지상국에서 8차례 교신을 수행하면서 차세대소형위성2호의 통신시스템과 자세제어시스템, 전력시스템, 탑재 컴퓨터 등의 기능을 점검했다.

특히, 국내 우주핵심기술 연구개발 성과물로 차세대소형위성2호의 자세제어시스템에 처음 적용된 반작용휠과 광학자이로의 기능을 점검하고, 차세대소형위성2호 태양전지판이 태양을 바라보는 자세제어와 고속데이터 송신을 위해 안테나를 지상국으로 지향하는 자세제어 기능을 확인했다.

또한, 태양전지판과 태양전력조절기, 리튬이온 배터리 등 차세대소형위성2호의 전력시스템을 점검해, 태양전지판에서 안정적으로 생성된 약 256W의 전력을 통해 위성 배터리가 만충전 상태를 유지하고 있는 것을 확인했다.

차세대소형위성2호는 중점임무인 영상레이더 기술검증과 지구관측, 우주과학임무인 근지구궤도 우주방사선 관측, 그리고 4종의 국내 개발 핵심기술에 대한 우주검증을 수행할 예정이다.

영상레이더는 광학카메라와 달리 빛과 구름의 영향을 받지 않아, 주야간 및 악천후에도 지상 관측이 가능하다. 순수 국내 기술로 개발된 차세대소형위성2호의 X-대역 영상레이더는 해상도 5m, 관측폭 40km의 레이더 영상을 획득을 목표로 한다.

우주방사선 관측기는 근지구 궤도의 중성자·하전입자에 대한 정밀 선량 지도를 작성하고, 태양활동 상승 주기의 우주방사선 변화에 따른 우주환경 영향과 근지구 궤도의 중성자 가중치를 연구하는 데 활용된다.

아울러 산·학·연에서 국산화한 위성핵심기술 4종(①상변환 물질을 이용한 열제어장치, ②X-대역 GaN기반 전력증폭기, ③GPS·Galileo 복합항법수신기, ④태양전지배열기)에 대한 우주검증도 함께 수행된다.

차세대소형위성2호는 약 3개월의 초기 운영 기간 동안 위성 본체 및 탑재체에 대한 기능을 상세히 점검한 후, 계획된 영상레이더에 대한 기술검증•지구관측, 우주방사선 관측 및 핵심기술 검증의 정상적인 임무를 약 2년간 수행할 예정이다.

위성 발사 후 1주일 동안 위성 본체 및 탑재체에 대한 기초적인 상태 점검을 수행하고, 발사 후 1개월까지 위성 본체에 대한 세부 기능을 상세히 점검한 뒤, 발사 후 3개월까지 모든 탑재체에 대한 세부 기능점검을 완료함으로써 향후 정상 임무를 위한 위성 상태 최적화를 수행할 예정이다. 이광형 KAIST 총장은 "우리별 1호부터 30여 년간 축적해온 소형위성 개발과 운영 경험을 바탕으로 차세대소형위성2호의 임무를 성공적으로 완수하여 우리나라 소형위성 기술 수준을 한 단계 높일 수 있을 것으로 기대한다"라고 밝혔다.

2023.05.26 조회수 5298 엑스선 현미경 해상도 한계 극복

엑스선 현미경은 대부분 물질을 투과하는 장점이 있어 흉부 엑스선이나 CT 촬영을 통해 신체 내부 장기와 골격을 비침습적으로 관찰할 수 있다. 최근에는 반도체, 배터리의 내부 구조를 나노스케일에서 정밀하게 관찰하기 위해 엑스선 영상 기술의 해상도를 높이려는 연구들이 활발하게 진행되고 있다.

우리 대학 물리학과 박용근 교수 연구팀이 포항가속기연구소 임준 박사 연구팀과 공동연구를 통해 기존 엑스선 현미경의 해상도 한계를 극복할 수 있는 원천 기술 개발에 성공했다고 12일(수) 밝혔다.

물리학과 이겨레 박사가 제1 저자로 참여한 이번 연구는 광학 및 광자학의 세계적인 학술지인 `라이트: 사이언스 앤 어플리케이션 (Light: Science and Application)' 4월 7일 字에 출판됐다. (논문명: Direct high-resolution X-ray imaging exploiting pseudorandomness).

엑스선 나노 현미경은 굴절 렌즈가 없어 렌즈 대용으로 동심원 회절판(zone plate)이라 불리는 원형 모양의 격자를 사용한다. 동심원 회절판을 사용하여 얻어지는 영상의 해상도는 회절판 나노구조의 제작 품질에 의해 결정된다. 이러한 나노구조를 제작하고 유지하는 것은 여러 가지 어려움이 있으며, 이러한 한계가 엑스선 현미경의 해상도 한계를 결정했다.

연구팀은 이 문제를 극복하기 위해 새로운 엑스선 나노 현미경 기술을 개발했다. 연구팀이 제안한 엑스선 렌즈는 얇은 텅스텐 필름에 수많은 구멍을 뚫은 형태로, 입사되는 엑스선을 회절시켜 무작위적인 회절 패턴을 생성한다. 연구팀은 역설적이게도 이러한 무작위적 회절 패턴 속에 시료의 고해상도 정보가 온전히 들어있음을 수학적으로 규명하였으며, 실제 그 시료 정보를 추출하여 영상화하는데 성공하였다.

이러한 무작위 회절의 수학적 성질을 활용한 영상기법은 지난 2016년 이겨레 박사와 박용근 교수가 세계 최초로 제안하고 가시광 대역에서 구현한 기술로서, 당시 네이처 커뮤니케이션즈紙 Lee, KyeoReh, and YongKeun Park. "Exploiting the speckle-correlation scattering matrix for a compact reference-free holographic image sensor." Nature communications 7.1 (2016): 13359. 에 보고된 바 있다. 이번 연구는 해당 선행연구 결과를 엑스선 영역의 난제를 푸는 데 활용한 것이다.

구성된 시료의 영상의 해상도는 사용한 무작위 렌즈에 식각된 패턴의 크기와 직접적인 상관이 없다. 이러한 아이디어를 바탕으로 연구팀은 300 나노미터(nm) 지름의 원형 패턴으로 제작한 무작위 렌즈를 활용해 14 나노미터(nm) 해상도(대략 코로나 바이러스의 7분의 1 크기)의 영상을 취득하는 데 성공했다.

연구팀이 개발한 영상기술은 기존 동심원 회절판 제작상의 문제에 가로막혀 있던 엑스선 나노 현미경 해상도를 그 이상으로 끌어 올릴 수 있는 핵심 기반 기술이다.

제1 저자이자 공동교신저자인 우리 대학 물리학과 이겨레 박사는 “이번 연구에서는 14 나노미터(nm) 해상도에 그쳤지만, 차세대 엑스선 광원과 고성능 엑스선 검출기를 활용한다면, 기존 엑스선 나노 영상의 해상도를 넘어서 전자현미경의 해상도 수준인 1 나노미터 부근까지 근접할 수 있을 것이라 예상한다”라며“전자현미경과는 달리 엑스선은 시료를 훼손하지 않으면서 내부 구조를 관찰할 수 있으므로, 반도체 검수와 같은 비침습적 나노구조 관찰에 새로운 표준을 제시할 수 있을 것이다”라고 말했다.

공동교신저자인 포항가속기연구소 임준 박사는 “같은 맥락에서, 개발된 영상기술은 충북 오창에 신설되는 4세대 다목적방사광가속기에서 크게 성능이 증대될 수 있을 것으로 기대한다”라고 말했다.

이번 연구는 한국연구재단 리더연구사업과 세종과학펠로우십의 지원을 받아 수행됐다.

2023.04.12 조회수 3969

엑스선 현미경 해상도 한계 극복

엑스선 현미경은 대부분 물질을 투과하는 장점이 있어 흉부 엑스선이나 CT 촬영을 통해 신체 내부 장기와 골격을 비침습적으로 관찰할 수 있다. 최근에는 반도체, 배터리의 내부 구조를 나노스케일에서 정밀하게 관찰하기 위해 엑스선 영상 기술의 해상도를 높이려는 연구들이 활발하게 진행되고 있다.

우리 대학 물리학과 박용근 교수 연구팀이 포항가속기연구소 임준 박사 연구팀과 공동연구를 통해 기존 엑스선 현미경의 해상도 한계를 극복할 수 있는 원천 기술 개발에 성공했다고 12일(수) 밝혔다.

물리학과 이겨레 박사가 제1 저자로 참여한 이번 연구는 광학 및 광자학의 세계적인 학술지인 `라이트: 사이언스 앤 어플리케이션 (Light: Science and Application)' 4월 7일 字에 출판됐다. (논문명: Direct high-resolution X-ray imaging exploiting pseudorandomness).

엑스선 나노 현미경은 굴절 렌즈가 없어 렌즈 대용으로 동심원 회절판(zone plate)이라 불리는 원형 모양의 격자를 사용한다. 동심원 회절판을 사용하여 얻어지는 영상의 해상도는 회절판 나노구조의 제작 품질에 의해 결정된다. 이러한 나노구조를 제작하고 유지하는 것은 여러 가지 어려움이 있으며, 이러한 한계가 엑스선 현미경의 해상도 한계를 결정했다.

연구팀은 이 문제를 극복하기 위해 새로운 엑스선 나노 현미경 기술을 개발했다. 연구팀이 제안한 엑스선 렌즈는 얇은 텅스텐 필름에 수많은 구멍을 뚫은 형태로, 입사되는 엑스선을 회절시켜 무작위적인 회절 패턴을 생성한다. 연구팀은 역설적이게도 이러한 무작위적 회절 패턴 속에 시료의 고해상도 정보가 온전히 들어있음을 수학적으로 규명하였으며, 실제 그 시료 정보를 추출하여 영상화하는데 성공하였다.

이러한 무작위 회절의 수학적 성질을 활용한 영상기법은 지난 2016년 이겨레 박사와 박용근 교수가 세계 최초로 제안하고 가시광 대역에서 구현한 기술로서, 당시 네이처 커뮤니케이션즈紙 Lee, KyeoReh, and YongKeun Park. "Exploiting the speckle-correlation scattering matrix for a compact reference-free holographic image sensor." Nature communications 7.1 (2016): 13359. 에 보고된 바 있다. 이번 연구는 해당 선행연구 결과를 엑스선 영역의 난제를 푸는 데 활용한 것이다.

구성된 시료의 영상의 해상도는 사용한 무작위 렌즈에 식각된 패턴의 크기와 직접적인 상관이 없다. 이러한 아이디어를 바탕으로 연구팀은 300 나노미터(nm) 지름의 원형 패턴으로 제작한 무작위 렌즈를 활용해 14 나노미터(nm) 해상도(대략 코로나 바이러스의 7분의 1 크기)의 영상을 취득하는 데 성공했다.

연구팀이 개발한 영상기술은 기존 동심원 회절판 제작상의 문제에 가로막혀 있던 엑스선 나노 현미경 해상도를 그 이상으로 끌어 올릴 수 있는 핵심 기반 기술이다.

제1 저자이자 공동교신저자인 우리 대학 물리학과 이겨레 박사는 “이번 연구에서는 14 나노미터(nm) 해상도에 그쳤지만, 차세대 엑스선 광원과 고성능 엑스선 검출기를 활용한다면, 기존 엑스선 나노 영상의 해상도를 넘어서 전자현미경의 해상도 수준인 1 나노미터 부근까지 근접할 수 있을 것이라 예상한다”라며“전자현미경과는 달리 엑스선은 시료를 훼손하지 않으면서 내부 구조를 관찰할 수 있으므로, 반도체 검수와 같은 비침습적 나노구조 관찰에 새로운 표준을 제시할 수 있을 것이다”라고 말했다.

공동교신저자인 포항가속기연구소 임준 박사는 “같은 맥락에서, 개발된 영상기술은 충북 오창에 신설되는 4세대 다목적방사광가속기에서 크게 성능이 증대될 수 있을 것으로 기대한다”라고 말했다.

이번 연구는 한국연구재단 리더연구사업과 세종과학펠로우십의 지원을 받아 수행됐다.

2023.04.12 조회수 3969 똑똑한 영상 복원 인공지능 기술 개발

딥러닝 기술은 영상 복원 속도가 기존 알고리즘 대비 수백 배 이상 빠를 뿐만 아니라 복원 정확도 역시 높다. 하지만, 주어진 학습 데이터에만 의존하는 딥러닝 기술은 영상 취득 환경상에 변화가 생기면 성능이 급격히 저하되는 치명적인 약점이 있다. 이는 알파고와 이세돌 九단과의 대국 시 `신의 한 수'에 의해 알파고의 성능이 급격하게 저하되었던 사례를 떠올리면 쉽게 이해할 수 있다. 즉, 인공지능이 학습하지 못했던 변수(학습 데이터상에 존재하지 않는 수)가 발생할 때 신뢰도가 급격히 낮아지는 인공지능 기술의 근본적인 문제이기도 하다.

우리 대학 바이오및뇌공학과 장무석 교수 연구팀과 김재철AI 대학원 예종철 교수 연구팀이 공동 연구를 통해 인공 지능의 신뢰도 문제를 해결할 수 있는 물리적 학습 기반의 영상 복원 딥러닝 기술을 개발했다고 6일 밝혔다.

연구팀은 영상 취득 환경에서 발생할 수 있는 변수 대부분이 물리적 법칙을 통해 수학적으로 기술 가능하다는 점에 착안해 물리적 법칙과 심층 신경망이 통합된 학습 기법을 제시했다.

모든 영상 기술은 물리적인 영상 기기를 통해 영상 정보를 취득한다. 연구팀은 이 정보 취득 과정에 대한 물리적인 통찰력을 인공지능에 학습시키는 방법을 개발했다. 예를 들면, `네가 도출한 복원 결과가 물리적으로 합당할까?' 혹은 `이 영상 기기는 물리적으로 이런 변수가 생길 수 있을 것 같은데?'라는 식의 질문을 통해 물리적 통찰력을 인공지능에 이식하는 방법을 제시한 것이다.

연구팀은 변화하는 영상 취득 환경에서도 신뢰도 높은 홀로그래피 영상* 을 복원하는데 성공했다. 홀로그래피 영상 기술은 의료 영상, 군용 감시, 자율 주행용 영상 등 다양한 정밀 영상 기술에 다양하게 활용될 수 있는데, 이번 연구는 의료 진단 분야의 활용성을 집중적으로 검증하였다.

*홀로그래피 영상: 물체의 그림자 패턴(회절 패턴)으로부터 물체의 형태를 복원하는 영상 기법, 일반적인 영상 기술과 달리 위상 변화에 의한 물체의 미세 구조를 감지할 수 있는 영상 기술

연구팀은 먼저 3차원 공간상에서 매우 빠르게 움직이는 적혈구의 회절 영상(확산된 그림자형상)으로부터 적혈구의 형태를 실시간으로 복원하는데 성공했다. 이러한 동적인 영상 환경에서 예상치 못한 변수로는 여러 개의 적혈구 덩어리가 복잡하게 겹쳐진다거나 적혈구가 예상하지 못했던 위치로 흘러가는 경우를 생각해 볼 수 있다. 여기서, 연구팀은 인공 지능이 생성한 영상이 합당한 결과인지 빛 전파 이론을 통해 검산하는 방식으로 물리적으로 유효한 복원 신뢰도를 구현하는데 성공하였다.

연구팀은 암 진단의 표준기술로 자리잡고 있는 생검 조직(생체에서 조직 일부를 메스나 바늘로 채취하는 것)의 영상 복원에도 성공했다. 주목할 점은 특정한 카메라 위치에서 측정된 회절 영상만을 학습했음에도 인공지능의 인지능력이 부가되어 다양한 카메라 위치에서도 물체를 인식하는데 성공했다는 점이다. 이번에 구현된 기술은 세포 염색 과정이나 수 천 만원에 달하는 현미경이 필요하지 않아 생검 조직 검사의 속도와 비용을 크게 개선할 수 있을 것으로 기대된다.

물리적 통찰력을 인공 지능에 이식하는 영상 복원 기술은 의료 진단 분야 뿐만 아니라 광범위한 영상 기술에 활용될 것으로 기대된다. 최근 영상 기술 산업계 (모바일 기기 카메라, 의료 진단용 MRI, CT, 광 기반 반도체 공정 불량 검출 등) 에선 인공지능 솔루션 탑재가 활발히 이루어지고 있다. 영상 취득에 사용되는 센서, 물체의 밝기, 물체까지의 거리와 같은 영상 취득 환경은 사용자마다 다를 수밖에 없어 적응 능력을 갖춘 인공 지능 솔루션에 대한 수요가 큰 상황이다. 현재 대부분의 인공 지능 기술은 적응 능력 부재로 신뢰도가 낮은 문제 때문에 실제 현장에서 활용성이 제한적인 상황이다.

바이오및뇌공학과 이찬석 연구원은 "데이터와 물리 법칙을 동시에 학습하는 적응형 인공지능 기술은 홀로그래피 영상뿐만 아니라 초고해상도 영상, 3차원 영상, 비시선 영상(장애물 뒷면을 보는 영상) 등 다양한 계산 영상 기술에 적용될 수 있을 것으로 기대된다ˮ고 밝혔다.

연구진은 "이번 연구를 통해 인공지능 학습에 있어서 학습 데이터에 대한 강한 의존성(신뢰도 문제)을 물리적 법칙을 결합해 해소했을 뿐만 아니라, 이미지 복원에 있어 매게 변수화된 전방 모델을 기반으로 했기 때문에 신뢰도와 적응성이 크게 향상됐다ˮ며, 이어 "이번 연구에서는 데이터의 다양한 특성 중에서 수학적 혹은 물리적으로 정확히 다룰 수 있는 측면에 집중했고, 향후 무작위적인 잡음이나 데이터의 형태에 대해서도 제약받지 않는 범용 복원 알고리즘을 개발하는 데 주력할 것이다ˮ라고 밝혔다.

바이오및뇌공학과 이찬석 박사과정이 제1 저자로 참여한 이번 연구는 국제 학술지 `네이처 머신 인텔리전스(Nature Machine Intelligence)'에 지난 1월 17일 字 출판됐다. (논문명: Deep learning based on parameterized physical forward model for adaptive holographic imaging with unpaired data)

한편 이번 연구는 삼성미래기술육성사업과 선도연구센터사업의 지원을 받아 수행됐다.

2023.02.06 조회수 4316

똑똑한 영상 복원 인공지능 기술 개발

딥러닝 기술은 영상 복원 속도가 기존 알고리즘 대비 수백 배 이상 빠를 뿐만 아니라 복원 정확도 역시 높다. 하지만, 주어진 학습 데이터에만 의존하는 딥러닝 기술은 영상 취득 환경상에 변화가 생기면 성능이 급격히 저하되는 치명적인 약점이 있다. 이는 알파고와 이세돌 九단과의 대국 시 `신의 한 수'에 의해 알파고의 성능이 급격하게 저하되었던 사례를 떠올리면 쉽게 이해할 수 있다. 즉, 인공지능이 학습하지 못했던 변수(학습 데이터상에 존재하지 않는 수)가 발생할 때 신뢰도가 급격히 낮아지는 인공지능 기술의 근본적인 문제이기도 하다.

우리 대학 바이오및뇌공학과 장무석 교수 연구팀과 김재철AI 대학원 예종철 교수 연구팀이 공동 연구를 통해 인공 지능의 신뢰도 문제를 해결할 수 있는 물리적 학습 기반의 영상 복원 딥러닝 기술을 개발했다고 6일 밝혔다.

연구팀은 영상 취득 환경에서 발생할 수 있는 변수 대부분이 물리적 법칙을 통해 수학적으로 기술 가능하다는 점에 착안해 물리적 법칙과 심층 신경망이 통합된 학습 기법을 제시했다.

모든 영상 기술은 물리적인 영상 기기를 통해 영상 정보를 취득한다. 연구팀은 이 정보 취득 과정에 대한 물리적인 통찰력을 인공지능에 학습시키는 방법을 개발했다. 예를 들면, `네가 도출한 복원 결과가 물리적으로 합당할까?' 혹은 `이 영상 기기는 물리적으로 이런 변수가 생길 수 있을 것 같은데?'라는 식의 질문을 통해 물리적 통찰력을 인공지능에 이식하는 방법을 제시한 것이다.

연구팀은 변화하는 영상 취득 환경에서도 신뢰도 높은 홀로그래피 영상* 을 복원하는데 성공했다. 홀로그래피 영상 기술은 의료 영상, 군용 감시, 자율 주행용 영상 등 다양한 정밀 영상 기술에 다양하게 활용될 수 있는데, 이번 연구는 의료 진단 분야의 활용성을 집중적으로 검증하였다.

*홀로그래피 영상: 물체의 그림자 패턴(회절 패턴)으로부터 물체의 형태를 복원하는 영상 기법, 일반적인 영상 기술과 달리 위상 변화에 의한 물체의 미세 구조를 감지할 수 있는 영상 기술

연구팀은 먼저 3차원 공간상에서 매우 빠르게 움직이는 적혈구의 회절 영상(확산된 그림자형상)으로부터 적혈구의 형태를 실시간으로 복원하는데 성공했다. 이러한 동적인 영상 환경에서 예상치 못한 변수로는 여러 개의 적혈구 덩어리가 복잡하게 겹쳐진다거나 적혈구가 예상하지 못했던 위치로 흘러가는 경우를 생각해 볼 수 있다. 여기서, 연구팀은 인공 지능이 생성한 영상이 합당한 결과인지 빛 전파 이론을 통해 검산하는 방식으로 물리적으로 유효한 복원 신뢰도를 구현하는데 성공하였다.

연구팀은 암 진단의 표준기술로 자리잡고 있는 생검 조직(생체에서 조직 일부를 메스나 바늘로 채취하는 것)의 영상 복원에도 성공했다. 주목할 점은 특정한 카메라 위치에서 측정된 회절 영상만을 학습했음에도 인공지능의 인지능력이 부가되어 다양한 카메라 위치에서도 물체를 인식하는데 성공했다는 점이다. 이번에 구현된 기술은 세포 염색 과정이나 수 천 만원에 달하는 현미경이 필요하지 않아 생검 조직 검사의 속도와 비용을 크게 개선할 수 있을 것으로 기대된다.

물리적 통찰력을 인공 지능에 이식하는 영상 복원 기술은 의료 진단 분야 뿐만 아니라 광범위한 영상 기술에 활용될 것으로 기대된다. 최근 영상 기술 산업계 (모바일 기기 카메라, 의료 진단용 MRI, CT, 광 기반 반도체 공정 불량 검출 등) 에선 인공지능 솔루션 탑재가 활발히 이루어지고 있다. 영상 취득에 사용되는 센서, 물체의 밝기, 물체까지의 거리와 같은 영상 취득 환경은 사용자마다 다를 수밖에 없어 적응 능력을 갖춘 인공 지능 솔루션에 대한 수요가 큰 상황이다. 현재 대부분의 인공 지능 기술은 적응 능력 부재로 신뢰도가 낮은 문제 때문에 실제 현장에서 활용성이 제한적인 상황이다.

바이오및뇌공학과 이찬석 연구원은 "데이터와 물리 법칙을 동시에 학습하는 적응형 인공지능 기술은 홀로그래피 영상뿐만 아니라 초고해상도 영상, 3차원 영상, 비시선 영상(장애물 뒷면을 보는 영상) 등 다양한 계산 영상 기술에 적용될 수 있을 것으로 기대된다ˮ고 밝혔다.