%EC%8B%9C%EB%AE%AC%EB%A0%88%EC%9D%B4%EC%85%98

-

챗GPT 등 대형 AI모델 학습 최적화 시뮬레이션 개발

최근 챗GPT, 딥시크(DeepSeek) 등 초거대 인공지능(AI) 모델이 다양한 분야에서 활용되며 주목받고 있다. 이러한 대형 언어 모델은 수만 개의 데이터센터용 GPU를 갖춘 대규모 분산 시스템에서 학습되는데, GPT-4의 경우 모델을 학습하는 데 소모되는 비용은 약 1,400억 원에 육박하는 것으로 추산된다. 한국 연구진이 GPU 사용률을 높이고 학습 비용을 절감할 수 있는 최적의 병렬화 구성을 도출하도록 돕는 기술을 개발했다.

우리 대학 전기및전자공학부 유민수 교수 연구팀은 삼성전자 삼성종합기술원과 공동연구를 통해, 대규모 분산 시스템에서 대형 언어 모델(LLM)의 학습 시간을 예측하고 최적화할 수 있는 시뮬레이션 프레임워크(이하 vTrain)를 개발했다고 13일 밝혔다.

대형 언어 모델 학습 효율을 높이려면 최적의 분산 학습 전략을 찾는 것이 필수적이다. 그러나 가능한 전략의 경우의 수가 방대할 뿐 아니라 실제 환경에서 각 전략의 성능을 테스트하는 데는 막대한 비용과 시간이 들어간다.

이에 따라 현재 대형 언어 모델을 학습하는 기업들은 일부 경험적으로 검증된 소수의 전략만을 사용하고 있다. 이는 GPU 활용의 비효율성과 불필요한 비용 증가를 초래하지만, 대규모 시스템을 위한 시뮬레이션 기술이 부족해 기업들이 문제를 효과적으로 해결하지 못하고 있는 상황이다.

이에 유민수 교수 연구팀은 vTrain을 개발해 대형 언어 모델의 학습 시간을 정확히 예측하고, 다양한 분산 병렬화 전략을 빠르게 탐색할 수 있도록 했다.

연구팀은 실제 다중 GPU 환경에서 다양한 대형 언어 모델 학습 시간 실측값과 vTrain의 예측값을 비교한 결과, 단일 노드에서 평균 절대 오차(MAPE) 8.37%, 다중 노드에서 14.73%의 정확도로 학습 시간을 예측할 수 있음을 검증했다.

연구팀은 삼성전자 삼성종합기술원와 공동연구를 진행하여 vTrain 프레임워크와 1,500개 이상의 실제 학습 시간 측정 데이터를 오픈소스로 공개(https://github.com/VIA-Research/vTrain)하여 AI 연구자와 기업이 이를 자유롭게 활용할 수 있도록 했다.

유민수 교수는 “vTrain은 프로파일링 기반 시뮬레이션 기법으로 기존 경험적 방식 대비 GPU 사용률을 높이고 학습 비용을 절감할 수 있는 학습 전략을 탐색하였으며 오픈소스를 공개하였다. 이를 통해 기업들은 초거대 인공지능 모델 학습 비용을 효율적으로 절감할 것이다”라고 말했다.

이 연구 결과는 방제현 박사과정이 제1 저자로 참여하였고 컴퓨터 아키텍처 분야의 최우수 학술대회 중 하나인 미국 전기전자공학회(IEEE)·전산공학회(ACM) 공동 마이크로아키텍처 국제 학술대회(MICRO)에서 지난 11월 발표됐다. (논문제목: vTrain: A Simulation Framework for Evaluating Cost-Effective and Compute-Optimal Large Language Model Training, https://doi.org/10.1109/MICRO61859.2024.00021)

이번 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단, 정보통신기획평가원, 그리고 삼성전자의 지원을 받아 수행되었으며, 과학기술정보통신부 및 정보통신기획평가원의 SW컴퓨팅산업원천기술개발(SW스타랩) 사업으로 연구개발한 결과물이다.

2025.03.13 조회수 3224

챗GPT 등 대형 AI모델 학습 최적화 시뮬레이션 개발

최근 챗GPT, 딥시크(DeepSeek) 등 초거대 인공지능(AI) 모델이 다양한 분야에서 활용되며 주목받고 있다. 이러한 대형 언어 모델은 수만 개의 데이터센터용 GPU를 갖춘 대규모 분산 시스템에서 학습되는데, GPT-4의 경우 모델을 학습하는 데 소모되는 비용은 약 1,400억 원에 육박하는 것으로 추산된다. 한국 연구진이 GPU 사용률을 높이고 학습 비용을 절감할 수 있는 최적의 병렬화 구성을 도출하도록 돕는 기술을 개발했다.

우리 대학 전기및전자공학부 유민수 교수 연구팀은 삼성전자 삼성종합기술원과 공동연구를 통해, 대규모 분산 시스템에서 대형 언어 모델(LLM)의 학습 시간을 예측하고 최적화할 수 있는 시뮬레이션 프레임워크(이하 vTrain)를 개발했다고 13일 밝혔다.

대형 언어 모델 학습 효율을 높이려면 최적의 분산 학습 전략을 찾는 것이 필수적이다. 그러나 가능한 전략의 경우의 수가 방대할 뿐 아니라 실제 환경에서 각 전략의 성능을 테스트하는 데는 막대한 비용과 시간이 들어간다.

이에 따라 현재 대형 언어 모델을 학습하는 기업들은 일부 경험적으로 검증된 소수의 전략만을 사용하고 있다. 이는 GPU 활용의 비효율성과 불필요한 비용 증가를 초래하지만, 대규모 시스템을 위한 시뮬레이션 기술이 부족해 기업들이 문제를 효과적으로 해결하지 못하고 있는 상황이다.

이에 유민수 교수 연구팀은 vTrain을 개발해 대형 언어 모델의 학습 시간을 정확히 예측하고, 다양한 분산 병렬화 전략을 빠르게 탐색할 수 있도록 했다.

연구팀은 실제 다중 GPU 환경에서 다양한 대형 언어 모델 학습 시간 실측값과 vTrain의 예측값을 비교한 결과, 단일 노드에서 평균 절대 오차(MAPE) 8.37%, 다중 노드에서 14.73%의 정확도로 학습 시간을 예측할 수 있음을 검증했다.

연구팀은 삼성전자 삼성종합기술원와 공동연구를 진행하여 vTrain 프레임워크와 1,500개 이상의 실제 학습 시간 측정 데이터를 오픈소스로 공개(https://github.com/VIA-Research/vTrain)하여 AI 연구자와 기업이 이를 자유롭게 활용할 수 있도록 했다.

유민수 교수는 “vTrain은 프로파일링 기반 시뮬레이션 기법으로 기존 경험적 방식 대비 GPU 사용률을 높이고 학습 비용을 절감할 수 있는 학습 전략을 탐색하였으며 오픈소스를 공개하였다. 이를 통해 기업들은 초거대 인공지능 모델 학습 비용을 효율적으로 절감할 것이다”라고 말했다.

이 연구 결과는 방제현 박사과정이 제1 저자로 참여하였고 컴퓨터 아키텍처 분야의 최우수 학술대회 중 하나인 미국 전기전자공학회(IEEE)·전산공학회(ACM) 공동 마이크로아키텍처 국제 학술대회(MICRO)에서 지난 11월 발표됐다. (논문제목: vTrain: A Simulation Framework for Evaluating Cost-Effective and Compute-Optimal Large Language Model Training, https://doi.org/10.1109/MICRO61859.2024.00021)

이번 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단, 정보통신기획평가원, 그리고 삼성전자의 지원을 받아 수행되었으며, 과학기술정보통신부 및 정보통신기획평가원의 SW컴퓨팅산업원천기술개발(SW스타랩) 사업으로 연구개발한 결과물이다.

2025.03.13 조회수 3224 -

기계공학과 구승범 교수팀, NeurIPS 2024 MyoChallenge 대회 보행 부문 우승

우리 대학 기계공학과 구승범 교수 연구팀(박건우 박사과정, 신범수 박사과정, 박종현 박사과정)은 2024년 12월 캐나다 밴쿠버에서 열린 NeurIPS 학회의 경쟁 대회 중 하나인 MyoChallenge 대회에 참가하여, 15개국에서 54팀이 참여한 가운데, 보행 운동 부문 1위를 차지하였다. 이 대회는 Google Deepmind, Google Cloud와 Össur가 후원하였다.

이 대회에서는 인체의 신경근육제어 원리를 연구하기 위한 다물체 동역학 기반의 인체 근골격 시뮬레이션 환경이 제시되었다. 자체 알고리즘으로 작동하는 의족/의수 (Prosthetic limb)가 결합된 인체 모델이 일상 생활 동작(상지 운동, 보행 운동)을 할 수 있도록 인체 근육 제어기를 학습하고, 그 성능을 경쟁하였다. 보행 운동 부문에서는 의족을 장착한 인체 모델이 주어진 트랙(평지, 거친길, 언덕, 계단)에 맞춰 보행할 수 있도록 인체 제어기를 학습하고, 그 안정성과 속도를 평가하였다.

하지에 54개 근육과 오른 다리 의족이 장착된 인체 모델의 근육 활성도를 제어하여, 지면이 고르지 않은 5m x 120m 경기장에서 넘어지지 않고 앞으로 나아가는 경기가 진행되었다. 구승범 교수 연구팀은 심층강화학습 기술과 인체 운동 데이터 기반 동작 생성 기술을 적용하여, 실제 사람이 근육을 제어하여 운동하는 모습을 모방할 수 있는 고성능 인체 운동 제어기를 학습하였다. 특히, 올해는 연구실에서 자체 구축한 120명의 평지, 계단 및 경사로 보행 동작 데이터셋을 사용해서, 인체 모델이 계단 및 경사로 지형에서도 안정적으로 보행할 수 있도록 학습하였다.

이 기술은 인체의 신경운동제어를 모방하여 다양한 상황에서의 보행 동작을 생성할 수 있다. 또한 이번 대회와 같이 인체에 착용하는 보조 장비와 상호 작용 시뮬레이션이 가능하여, 장비/기구의 개발 및 성능 개선에 사용 가능하다.

이번 대회에는 과학기술정보통신부(IITP ETRI 연구개발지원사업, 연구재단 미래유망융합기술파이오니어사업, 연구재단 중견연구자지원사업)의 지원을 받아 참여하였다.

2024.12.24 조회수 3834

기계공학과 구승범 교수팀, NeurIPS 2024 MyoChallenge 대회 보행 부문 우승

우리 대학 기계공학과 구승범 교수 연구팀(박건우 박사과정, 신범수 박사과정, 박종현 박사과정)은 2024년 12월 캐나다 밴쿠버에서 열린 NeurIPS 학회의 경쟁 대회 중 하나인 MyoChallenge 대회에 참가하여, 15개국에서 54팀이 참여한 가운데, 보행 운동 부문 1위를 차지하였다. 이 대회는 Google Deepmind, Google Cloud와 Össur가 후원하였다.

이 대회에서는 인체의 신경근육제어 원리를 연구하기 위한 다물체 동역학 기반의 인체 근골격 시뮬레이션 환경이 제시되었다. 자체 알고리즘으로 작동하는 의족/의수 (Prosthetic limb)가 결합된 인체 모델이 일상 생활 동작(상지 운동, 보행 운동)을 할 수 있도록 인체 근육 제어기를 학습하고, 그 성능을 경쟁하였다. 보행 운동 부문에서는 의족을 장착한 인체 모델이 주어진 트랙(평지, 거친길, 언덕, 계단)에 맞춰 보행할 수 있도록 인체 제어기를 학습하고, 그 안정성과 속도를 평가하였다.

하지에 54개 근육과 오른 다리 의족이 장착된 인체 모델의 근육 활성도를 제어하여, 지면이 고르지 않은 5m x 120m 경기장에서 넘어지지 않고 앞으로 나아가는 경기가 진행되었다. 구승범 교수 연구팀은 심층강화학습 기술과 인체 운동 데이터 기반 동작 생성 기술을 적용하여, 실제 사람이 근육을 제어하여 운동하는 모습을 모방할 수 있는 고성능 인체 운동 제어기를 학습하였다. 특히, 올해는 연구실에서 자체 구축한 120명의 평지, 계단 및 경사로 보행 동작 데이터셋을 사용해서, 인체 모델이 계단 및 경사로 지형에서도 안정적으로 보행할 수 있도록 학습하였다.

이 기술은 인체의 신경운동제어를 모방하여 다양한 상황에서의 보행 동작을 생성할 수 있다. 또한 이번 대회와 같이 인체에 착용하는 보조 장비와 상호 작용 시뮬레이션이 가능하여, 장비/기구의 개발 및 성능 개선에 사용 가능하다.

이번 대회에는 과학기술정보통신부(IITP ETRI 연구개발지원사업, 연구재단 미래유망융합기술파이오니어사업, 연구재단 중견연구자지원사업)의 지원을 받아 참여하였다.

2024.12.24 조회수 3834 -

암세포를 정상세포로 되돌려 치료하는 원천기술 개발

지금까지 다양한 항암 치료 기술이 개발됐음에도 현재 시행되고 있는 모든 항암치료의 공통점은 암세포를 사멸시켜서 치료하는 것을 목표로 하고 있다. 이로 인해 암세포가 내성을 획득해 재발하거나 정상세포까지 사멸시켜 큰 부작용을 유발하는 등 근본적인 한계를 지니고 있다.

우리 대학 바이오및뇌공학과 조광현 교수 연구팀이 대장암세포를 죽이지 않고 그 상태만을 변환시켜 정상 대장세포와 유사한 상태로 되돌림으로써 부작용 없이 치료할 수 있는 대장암 가역 치료를 위한 원천기술을 개발하였다고 22일 밝혔다.

연구팀은 정상세포의 암화 과정에서 정상적인 세포분화 궤적을 역행한다는 관찰 결과에 주목하고, 이를 기반으로 정상세포의 분화궤적에 대한 유전자네트워크의 디지털트윈을 제작하는 기술을 개발했다.

그리고 이를 시뮬레이션 분석해 정상세포 분화를 유도하는 마스터 분자스위치를 체계적으로 탐색해 발굴한 뒤 대장암세포에 적용했을 때 대장암세포의 상태가 정상화된다는 것을 분자세포 실험과 동물실험을 통해 입증했다.

이번 연구성과는 암세포를 정상세포로 가역화 하는 것이 우연한 현상적 발견에 의존하는 것이 아니라 암세포 유전자 네트워크의 디지털 트윈을 제작하고 분석함으로써 체계적으로 접근해 이루어낼 수 있음을 보인 원천기술 개발이며 이 기술을 다른 다양한 암종에 응용하여 암 가역 치료제 개발이 가능함을 제시한 것에 큰 의미가 있다.

조광현 교수는 "암세포가 정상세포로 변환될 수 있다는 것은 놀라운 현상이다. 이번 성과는 이를 체계적으로 유도해낼 수 있음을 증명한 것이다ˮ라고 말했다.

이어 “이번 연구 결과는 암세포를 정상세포로 되돌리는 가역 치료 개념을 최초로 제시한 성과들을 바탕으로 정상세포의 분화궤적을 체계적으로 분석해 암 가역화 치료타겟을 발굴하는 원천기술을 개발한 것이다”라고 강조했다.

우리 대학 공정렬 박사, 이춘경 박사과정 학생, 김훈민 박사과정 학생, 김주희 박사과정 학생 등이 참여한 이번 연구 결과는 와일리(Wiley)에서 출간하는 국제저널 `어드밴스드 사이언스(Advanced Science)' 12월 11일 字 온라인판 논문으로 출판됐다. (논문명: Control of cellular differentiation trajectories for cancer reversion) DOI: https://doi.org/10.1002/advs.202402132

한편 이번 연구는 과학기술정보통신부와 한국연구재단의 중견연구사업 및 기초연구실사업의 지원을 통해 수행되었으며 연구 성과는 바이오리버트(주)로 기술이전 되어 실제 암 가역치료제 개발에 활용될 예정이다.

2024.12.23 조회수 10085

암세포를 정상세포로 되돌려 치료하는 원천기술 개발

지금까지 다양한 항암 치료 기술이 개발됐음에도 현재 시행되고 있는 모든 항암치료의 공통점은 암세포를 사멸시켜서 치료하는 것을 목표로 하고 있다. 이로 인해 암세포가 내성을 획득해 재발하거나 정상세포까지 사멸시켜 큰 부작용을 유발하는 등 근본적인 한계를 지니고 있다.

우리 대학 바이오및뇌공학과 조광현 교수 연구팀이 대장암세포를 죽이지 않고 그 상태만을 변환시켜 정상 대장세포와 유사한 상태로 되돌림으로써 부작용 없이 치료할 수 있는 대장암 가역 치료를 위한 원천기술을 개발하였다고 22일 밝혔다.

연구팀은 정상세포의 암화 과정에서 정상적인 세포분화 궤적을 역행한다는 관찰 결과에 주목하고, 이를 기반으로 정상세포의 분화궤적에 대한 유전자네트워크의 디지털트윈을 제작하는 기술을 개발했다.

그리고 이를 시뮬레이션 분석해 정상세포 분화를 유도하는 마스터 분자스위치를 체계적으로 탐색해 발굴한 뒤 대장암세포에 적용했을 때 대장암세포의 상태가 정상화된다는 것을 분자세포 실험과 동물실험을 통해 입증했다.

이번 연구성과는 암세포를 정상세포로 가역화 하는 것이 우연한 현상적 발견에 의존하는 것이 아니라 암세포 유전자 네트워크의 디지털 트윈을 제작하고 분석함으로써 체계적으로 접근해 이루어낼 수 있음을 보인 원천기술 개발이며 이 기술을 다른 다양한 암종에 응용하여 암 가역 치료제 개발이 가능함을 제시한 것에 큰 의미가 있다.

조광현 교수는 "암세포가 정상세포로 변환될 수 있다는 것은 놀라운 현상이다. 이번 성과는 이를 체계적으로 유도해낼 수 있음을 증명한 것이다ˮ라고 말했다.

이어 “이번 연구 결과는 암세포를 정상세포로 되돌리는 가역 치료 개념을 최초로 제시한 성과들을 바탕으로 정상세포의 분화궤적을 체계적으로 분석해 암 가역화 치료타겟을 발굴하는 원천기술을 개발한 것이다”라고 강조했다.

우리 대학 공정렬 박사, 이춘경 박사과정 학생, 김훈민 박사과정 학생, 김주희 박사과정 학생 등이 참여한 이번 연구 결과는 와일리(Wiley)에서 출간하는 국제저널 `어드밴스드 사이언스(Advanced Science)' 12월 11일 字 온라인판 논문으로 출판됐다. (논문명: Control of cellular differentiation trajectories for cancer reversion) DOI: https://doi.org/10.1002/advs.202402132

한편 이번 연구는 과학기술정보통신부와 한국연구재단의 중견연구사업 및 기초연구실사업의 지원을 통해 수행되었으며 연구 성과는 바이오리버트(주)로 기술이전 되어 실제 암 가역치료제 개발에 활용될 예정이다.

2024.12.23 조회수 10085 -

양자 컴퓨터로 새로운 물성 연구 성공

양자 물질을 연구하거나 설계할 때 기존의 폰노이만식 전자컴퓨터를 이용한 계산은 근본적인 한계를 가진다. 양자계의 경우 양자 얽힘 등의 효과로 인해 계산량이 기하급수적으로 증가하기 때문이다. 따라서 양자물질 설계를 위해 물질의 특성을 알아내고자 할 때, 양자컴퓨터를 이용하는 양자 시뮬레이션이 필요하다.

우리 대학 물리학과 안재욱 교수 연구팀이 코펜하겐 대학 클라우스 뭴머(Klaus MØlmer) 교수 연구팀과 함께 양자 시뮬레이션을 수행하는 양자 컴퓨터 플랫폼으로 최근 가장 주목을 받는 리드버그 원자 양자 컴퓨터를 이용해 양자 자성체의 극단적 특성을 구현하는데 성공했다고 11일 밝혔다.

자성체 물질은 하드 디스크와 같은 전자제품을 비롯해 전력 발전 등에도 사용되는 등 현대 기술의 핵심 요소다. 최근에는 상온 자성체를 넘어서 양자적 특성이 두드러지는 초저온에서 양자 자성체 특성에 관한 연구가 활발히 이뤄지고 있다. 초저온에서 수행되는 물성 분석 및 계측 연구는 MRI 등의 의학 기기 등에 응용될 뿐만 아니라, 차세대 초정밀 제어계측공학을 촉발할 것으로 기대된다.

유명 물리학자 리처드 파인만은 1983년 양자계의 특성을 인공적인 양자계로 모방해 연구하는 양자 시뮬레이션을 제안하였다. 인공적으로 모방한 양자계의 특성을 연구하면 기존 양자계의 특성을 알아낼 수 있다.

양자 시뮬레이션을 이용한 양자 자성체의 연구는 지난 10년간 세계 유수의 대학과 연구소에서 이뤄지고 있으며 이전까지 알려지지 않은 양자 물질의 특성들을 실험적으로 확인하는 성과를 보였다. 현재 양자 물질을 시뮬레이션하는 데 있어 중요한 이슈 중 하나는 극단적인 상황 속 양자 물질의 현상을 관찰하는 것이다.

한편 이와 같은 양자 시뮬레이션을 수행하는 양자 컴퓨터 플랫폼으로 최근 가장 주목을 받는 것은 리드버그 원자다. 리드버그 원자는 최외각 전자가 이온화되어 떨어지기 직전의 매우 높은 에너지를 머금고 있는 원자로, 일반 원자의 만 배 정도의 지름을 가지며 (10의 24제곱)배 정도 더 큰 상호작용을 한다. 우리 대학 물리학과 안재욱 교수 연구팀은 최근 리드버그 원자를 이용해 최대 156큐비트급의 양자 컴퓨터 계산을 선보인 바 있다.

이번 연구에서 글로벌 공동연구팀은 리드버그 원자를 이용한 양자 컴퓨터를 이용해 양자 자성체를 설명하는 모형 중 하나인 하이젠베르크 모형*을 양자 컴퓨터로 모방해 구현했다. 특히 이전의 하이젠베르크 모형의 구현과 다르게, 이번 연구에서는 리드버그 원자의 강한 상호작용을 이용한 극단적 이방성 (3차원 중 특정 방향이 다른 방향 대비 1000배 이상 강하게 상호작용하는 특성으로 새로운 연구영역이 확보됨)을 구현하는 데 성공했다.

*하이젠베르크 모형: 하이젠베르크 자성체 모형은 자성체 스핀 간의 모든 방향 (x, y, z 방향) 상호작용을 가정한 모형으로 양자 자성체의 대표적 모델 중 하나임.

연구를 주도한 안 교수는 “이번 연구는 리드버그 양자컴퓨터를 이용해 새로운 양자 물성을 연구할 수 있음을 보였다”라고 밝히고 “양자컴퓨터를 이용하는 물성 연구가 활발해질 것”이라고 기대했다.

우리 대학 물리학과 김강흔 대학원생 연구원과 덴마크 오르후스 대학의 팬 양(Fan Yang) 박사후 연구원이 참여한 이번 연구는 국제 학술지 `피지컬 리뷰 X (Physical Review X)' 2월 14권에 출판됐다. (논문명 : Realization of an Extremely Anisotropic Heisenberg Magnet in Rydberg Atom Arrays).

한편 이번 연구는 삼성미래기술재단과 한국연구재단의 지원으로 수행됐다.

2024.03.11 조회수 6896

양자 컴퓨터로 새로운 물성 연구 성공

양자 물질을 연구하거나 설계할 때 기존의 폰노이만식 전자컴퓨터를 이용한 계산은 근본적인 한계를 가진다. 양자계의 경우 양자 얽힘 등의 효과로 인해 계산량이 기하급수적으로 증가하기 때문이다. 따라서 양자물질 설계를 위해 물질의 특성을 알아내고자 할 때, 양자컴퓨터를 이용하는 양자 시뮬레이션이 필요하다.

우리 대학 물리학과 안재욱 교수 연구팀이 코펜하겐 대학 클라우스 뭴머(Klaus MØlmer) 교수 연구팀과 함께 양자 시뮬레이션을 수행하는 양자 컴퓨터 플랫폼으로 최근 가장 주목을 받는 리드버그 원자 양자 컴퓨터를 이용해 양자 자성체의 극단적 특성을 구현하는데 성공했다고 11일 밝혔다.

자성체 물질은 하드 디스크와 같은 전자제품을 비롯해 전력 발전 등에도 사용되는 등 현대 기술의 핵심 요소다. 최근에는 상온 자성체를 넘어서 양자적 특성이 두드러지는 초저온에서 양자 자성체 특성에 관한 연구가 활발히 이뤄지고 있다. 초저온에서 수행되는 물성 분석 및 계측 연구는 MRI 등의 의학 기기 등에 응용될 뿐만 아니라, 차세대 초정밀 제어계측공학을 촉발할 것으로 기대된다.

유명 물리학자 리처드 파인만은 1983년 양자계의 특성을 인공적인 양자계로 모방해 연구하는 양자 시뮬레이션을 제안하였다. 인공적으로 모방한 양자계의 특성을 연구하면 기존 양자계의 특성을 알아낼 수 있다.

양자 시뮬레이션을 이용한 양자 자성체의 연구는 지난 10년간 세계 유수의 대학과 연구소에서 이뤄지고 있으며 이전까지 알려지지 않은 양자 물질의 특성들을 실험적으로 확인하는 성과를 보였다. 현재 양자 물질을 시뮬레이션하는 데 있어 중요한 이슈 중 하나는 극단적인 상황 속 양자 물질의 현상을 관찰하는 것이다.

한편 이와 같은 양자 시뮬레이션을 수행하는 양자 컴퓨터 플랫폼으로 최근 가장 주목을 받는 것은 리드버그 원자다. 리드버그 원자는 최외각 전자가 이온화되어 떨어지기 직전의 매우 높은 에너지를 머금고 있는 원자로, 일반 원자의 만 배 정도의 지름을 가지며 (10의 24제곱)배 정도 더 큰 상호작용을 한다. 우리 대학 물리학과 안재욱 교수 연구팀은 최근 리드버그 원자를 이용해 최대 156큐비트급의 양자 컴퓨터 계산을 선보인 바 있다.

이번 연구에서 글로벌 공동연구팀은 리드버그 원자를 이용한 양자 컴퓨터를 이용해 양자 자성체를 설명하는 모형 중 하나인 하이젠베르크 모형*을 양자 컴퓨터로 모방해 구현했다. 특히 이전의 하이젠베르크 모형의 구현과 다르게, 이번 연구에서는 리드버그 원자의 강한 상호작용을 이용한 극단적 이방성 (3차원 중 특정 방향이 다른 방향 대비 1000배 이상 강하게 상호작용하는 특성으로 새로운 연구영역이 확보됨)을 구현하는 데 성공했다.

*하이젠베르크 모형: 하이젠베르크 자성체 모형은 자성체 스핀 간의 모든 방향 (x, y, z 방향) 상호작용을 가정한 모형으로 양자 자성체의 대표적 모델 중 하나임.

연구를 주도한 안 교수는 “이번 연구는 리드버그 양자컴퓨터를 이용해 새로운 양자 물성을 연구할 수 있음을 보였다”라고 밝히고 “양자컴퓨터를 이용하는 물성 연구가 활발해질 것”이라고 기대했다.

우리 대학 물리학과 김강흔 대학원생 연구원과 덴마크 오르후스 대학의 팬 양(Fan Yang) 박사후 연구원이 참여한 이번 연구는 국제 학술지 `피지컬 리뷰 X (Physical Review X)' 2월 14권에 출판됐다. (논문명 : Realization of an Extremely Anisotropic Heisenberg Magnet in Rydberg Atom Arrays).

한편 이번 연구는 삼성미래기술재단과 한국연구재단의 지원으로 수행됐다.

2024.03.11 조회수 6896 -

산업및시스템공학과 김현정 교수 연구팀, 2023 Winter Simulation Conference, Simulation Challenge 대회 우승

세계 최대 시뮬레이션 학회인 Winter Simulation Conference(2023년 12월 10일 – 13일, San Antonio, USA)에서 주최한 Simulation Challenge 대회에서 우리 대학 산업및시스템공학과 김현정 교수 연구팀이 우승을 차지하였다. 올해 대회는 반도체 생산 기업인 Micron Technology의 후원으로 개최되었으며 시뮬레이션 모델링 및 분석 도구를 사용하여 반도체 제조의 병목 문제를 해결하고 생산성을 향상시키기 위한 스케줄링 알고리즘을 개발하는 것이 목표로 세워졌다.

대회는 2023년 8월부터 11월까지 총 4라운드에 걸쳐 진행되었으며 각 라운드에서는 시나리오에 기반한 반도체 생산 재고(WIP) 최소화와 공정 간 시간 제약 충족을 목표로 하는 시뮬레이션 기반의 스케줄링을 수행하였다. 특히, 마지막 4라운드에서는 시나리오를 사전에 알지 못하는 조건에서도 우수한 스케줄을 도출하는 방법론을 개발하는 것이 도전 과제였다. 대회에는 전 세계 21개 팀이 참가하였고, 김현정 교수 연구팀은 1, 3, 4라운드에서 1등을 차지하여 최종적으로 대회에서 우승을 차지하였다.

김현정 교수 연구팀은 변화하는 제조 상황에 맞게 반도체 웨이퍼의 공정 흐름을 적절히 제어할 수 있는 시뮬레이션을 활용한 Ensemble-based Adaptive Search 방법을 개발하였다. 이를 통해 김현정 교수 연구팀은 다른 팀에 비해 압도적으로 재고를 감소시키면서 동시에 시간 제약을 효과적으로 충족시키는 결과를 도출할 수 있었다. 김현정 교수 연구팀은 반도체 및 다양한 제조 시스템의 스케줄링 연구를 수행하고 있으며 기존의 연구 결과를 바탕으로 새로운 방법을 탐구하여 우수한 성과를 이뤄냈다. 김현정 교수 연구팀은 이제훈 박사과정, 김두연 박사과정, 안정선 박사과정, 신우진 박사과정으로 구성되었다.

2023.12.26 조회수 5603

산업및시스템공학과 김현정 교수 연구팀, 2023 Winter Simulation Conference, Simulation Challenge 대회 우승

세계 최대 시뮬레이션 학회인 Winter Simulation Conference(2023년 12월 10일 – 13일, San Antonio, USA)에서 주최한 Simulation Challenge 대회에서 우리 대학 산업및시스템공학과 김현정 교수 연구팀이 우승을 차지하였다. 올해 대회는 반도체 생산 기업인 Micron Technology의 후원으로 개최되었으며 시뮬레이션 모델링 및 분석 도구를 사용하여 반도체 제조의 병목 문제를 해결하고 생산성을 향상시키기 위한 스케줄링 알고리즘을 개발하는 것이 목표로 세워졌다.

대회는 2023년 8월부터 11월까지 총 4라운드에 걸쳐 진행되었으며 각 라운드에서는 시나리오에 기반한 반도체 생산 재고(WIP) 최소화와 공정 간 시간 제약 충족을 목표로 하는 시뮬레이션 기반의 스케줄링을 수행하였다. 특히, 마지막 4라운드에서는 시나리오를 사전에 알지 못하는 조건에서도 우수한 스케줄을 도출하는 방법론을 개발하는 것이 도전 과제였다. 대회에는 전 세계 21개 팀이 참가하였고, 김현정 교수 연구팀은 1, 3, 4라운드에서 1등을 차지하여 최종적으로 대회에서 우승을 차지하였다.

김현정 교수 연구팀은 변화하는 제조 상황에 맞게 반도체 웨이퍼의 공정 흐름을 적절히 제어할 수 있는 시뮬레이션을 활용한 Ensemble-based Adaptive Search 방법을 개발하였다. 이를 통해 김현정 교수 연구팀은 다른 팀에 비해 압도적으로 재고를 감소시키면서 동시에 시간 제약을 효과적으로 충족시키는 결과를 도출할 수 있었다. 김현정 교수 연구팀은 반도체 및 다양한 제조 시스템의 스케줄링 연구를 수행하고 있으며 기존의 연구 결과를 바탕으로 새로운 방법을 탐구하여 우수한 성과를 이뤄냈다. 김현정 교수 연구팀은 이제훈 박사과정, 김두연 박사과정, 안정선 박사과정, 신우진 박사과정으로 구성되었다.

2023.12.26 조회수 5603 -

화학공장 대체 방안 ‘아이브릿지’에서 찾다

기후 변화와 환경 문제가 심각하게 대두됨에 따라 현재의 화학 공장을 대체할 수 있는 지속가능한 미생물 세포공장이 크게 주목받고 있다. 미생물 세포공장으로 활용할 미생물을 개량하기 위해선 미생물이 가진 유전자들의 발현을 증폭 또는 억제해 유용한 화합물을 생산하도록 미생물 대사 메커니즘을 개량해야 하지만, 어떠한 유전자를 증폭하고 억제할 것인지 결정하는 것은 지금까지 어려운 문제로 남아있다.

우리 대학 이상엽 특훈교수 연구팀이 아이브릿지(iBridge)라는 시뮬레이션 프로그램을 개발하여 생산하고자 하는 화합물에 맞춤형 미생물 공장을 구축할 수 있도록 과발현 및 억제 유전자들을 예측함으로써 미생물 공장을 적은 비용으로 빠르고 효율적으로 구축하는 방법을 제시했다고 9일 밝혔다.

이상엽 특훈교수가 창시한 시스템 대사공학은 유전공학, 합성생물학, 시스템생물학, 발효공학 등을 접목해 개량한 미생물을 이용해 유용한 화합물들을 생산하는 분야다. 미생물을 목표로 하는 유용한 화합물을 생산하도록 개량하기 위해선 미생물의 유전자들을 삭제, 발현억제, 과발현 등이 필수적이지만, 이를 일일이 실험적으로 확인하지 않고서는 여전히 전문가들조차 판별하기 어려워 많은 시간과 자원이 소모된다.

연구팀은 신규 개발된 아이브릿지(iBridge) 시뮬레이션을 활용해 세 가지의 유용한 화합물을 세계 최고 수준으로 생산하는 대장균 미생물 세포공장을 구축하는 데 성공했다. 연구팀은 많은 화장품에서 보습제 역할을 하는 판테놀, 나일론의 원료인 퓨트레신, 항균성 식품첨가제인 4-하이드록시페닐젖산 등을 생산하는 대장균 균주를 개발하고, 신규 개발된 시뮬레이션 아이브릿지(iBridge)를 활용해 세계 최고 농도로 이들 화합물을 생산하는 공정을 개발했다. 그뿐만 아니라 연구팀은 이들 세 가지 외에도 산업적으로 유용한 화합물 298 여종의 미생물 공장을 구축하기 위한 과발현 및 억제 유전자들을 예측해 제시했다.

이번 논문의 공동 제1 저자인 우리 대학 이영준 박사는 “이번에 개발된 시뮬레이션을 이용하니 여러 가지 미생물 공장들이 기존방법보다 월등히 빠른 속도로 구축됐다”며 “더 다양한 유용한 화합물들을 생산하는 미생물 세포공장들이 이 기술을 활용해 빠르게 구축될 수 있을 것”이라고 말했다.

또한 이상엽 특훈교수는 “시스템 대사공학은 현재 우리가 해결해야 할 기후변화문제에 접근하는 매우 중요한 기술”이라며 “이 시뮬레이션은 기존의 화학 공장을 친환경 미생물 공장으로 대체하는 시기를 앞당기는 데 크게 기여할 수 있을 것”이라고 밝혔다.

생물공정연구센터 김원준 박사, 이영준 박사, 생명화학공학과 김현욱 교수와 이상엽 특훈교수가 참여한 이번 논문은 셀 (Cell) 誌가 발행하는 `셀 시스템즈 (Cell Systems)'에 동료심사를 거쳐 11월 6일 온라인판에 게재됐다.

※ 논문명 : 세포 내 화학반응 속도의 공분산의 합을 활용한 게놈 수준 과발현 및 억제 유전자 예측 (Genome-Wide Identification of Overexpression and Downregulation Gene Targets Based on the Sum of Covariances of the Outgoing Reaction Fluxes)

※ 저자 정보 : 김원준 (한국과학기술원, 공동 제1 저자), 이영준 (한국과학기술원, 공동 제1 저자), 김현욱 (한국과학기술원, 공동 제1 저자) 및 이상엽(한국과학기술원, 교신저자) 포함 총 6 명

한편, 이번 연구는 과기정통부가 지원하는 ‘석유대체 친환경 화학기술개발사업의 ‘바이오화학산업 선도를 위한 차세대 바이오리파이너리 원천기술 개발’ 과제(과제책임자 KAIST 이상엽 특훈교수) 및 바이오매스기반 탄소중립형 바이오플라스틱 제품기술개발사업’ 과제(과제책임자 KAIST 최소영 연구교수)의 지원을 받아 수행됐다.

아이브릿지 사이트: https://github.com/kaistsystemsbiology/iBridge.git

2023.11.09 조회수 7431

화학공장 대체 방안 ‘아이브릿지’에서 찾다

기후 변화와 환경 문제가 심각하게 대두됨에 따라 현재의 화학 공장을 대체할 수 있는 지속가능한 미생물 세포공장이 크게 주목받고 있다. 미생물 세포공장으로 활용할 미생물을 개량하기 위해선 미생물이 가진 유전자들의 발현을 증폭 또는 억제해 유용한 화합물을 생산하도록 미생물 대사 메커니즘을 개량해야 하지만, 어떠한 유전자를 증폭하고 억제할 것인지 결정하는 것은 지금까지 어려운 문제로 남아있다.

우리 대학 이상엽 특훈교수 연구팀이 아이브릿지(iBridge)라는 시뮬레이션 프로그램을 개발하여 생산하고자 하는 화합물에 맞춤형 미생물 공장을 구축할 수 있도록 과발현 및 억제 유전자들을 예측함으로써 미생물 공장을 적은 비용으로 빠르고 효율적으로 구축하는 방법을 제시했다고 9일 밝혔다.

이상엽 특훈교수가 창시한 시스템 대사공학은 유전공학, 합성생물학, 시스템생물학, 발효공학 등을 접목해 개량한 미생물을 이용해 유용한 화합물들을 생산하는 분야다. 미생물을 목표로 하는 유용한 화합물을 생산하도록 개량하기 위해선 미생물의 유전자들을 삭제, 발현억제, 과발현 등이 필수적이지만, 이를 일일이 실험적으로 확인하지 않고서는 여전히 전문가들조차 판별하기 어려워 많은 시간과 자원이 소모된다.

연구팀은 신규 개발된 아이브릿지(iBridge) 시뮬레이션을 활용해 세 가지의 유용한 화합물을 세계 최고 수준으로 생산하는 대장균 미생물 세포공장을 구축하는 데 성공했다. 연구팀은 많은 화장품에서 보습제 역할을 하는 판테놀, 나일론의 원료인 퓨트레신, 항균성 식품첨가제인 4-하이드록시페닐젖산 등을 생산하는 대장균 균주를 개발하고, 신규 개발된 시뮬레이션 아이브릿지(iBridge)를 활용해 세계 최고 농도로 이들 화합물을 생산하는 공정을 개발했다. 그뿐만 아니라 연구팀은 이들 세 가지 외에도 산업적으로 유용한 화합물 298 여종의 미생물 공장을 구축하기 위한 과발현 및 억제 유전자들을 예측해 제시했다.

이번 논문의 공동 제1 저자인 우리 대학 이영준 박사는 “이번에 개발된 시뮬레이션을 이용하니 여러 가지 미생물 공장들이 기존방법보다 월등히 빠른 속도로 구축됐다”며 “더 다양한 유용한 화합물들을 생산하는 미생물 세포공장들이 이 기술을 활용해 빠르게 구축될 수 있을 것”이라고 말했다.

또한 이상엽 특훈교수는 “시스템 대사공학은 현재 우리가 해결해야 할 기후변화문제에 접근하는 매우 중요한 기술”이라며 “이 시뮬레이션은 기존의 화학 공장을 친환경 미생물 공장으로 대체하는 시기를 앞당기는 데 크게 기여할 수 있을 것”이라고 밝혔다.

생물공정연구센터 김원준 박사, 이영준 박사, 생명화학공학과 김현욱 교수와 이상엽 특훈교수가 참여한 이번 논문은 셀 (Cell) 誌가 발행하는 `셀 시스템즈 (Cell Systems)'에 동료심사를 거쳐 11월 6일 온라인판에 게재됐다.

※ 논문명 : 세포 내 화학반응 속도의 공분산의 합을 활용한 게놈 수준 과발현 및 억제 유전자 예측 (Genome-Wide Identification of Overexpression and Downregulation Gene Targets Based on the Sum of Covariances of the Outgoing Reaction Fluxes)

※ 저자 정보 : 김원준 (한국과학기술원, 공동 제1 저자), 이영준 (한국과학기술원, 공동 제1 저자), 김현욱 (한국과학기술원, 공동 제1 저자) 및 이상엽(한국과학기술원, 교신저자) 포함 총 6 명

한편, 이번 연구는 과기정통부가 지원하는 ‘석유대체 친환경 화학기술개발사업의 ‘바이오화학산업 선도를 위한 차세대 바이오리파이너리 원천기술 개발’ 과제(과제책임자 KAIST 이상엽 특훈교수) 및 바이오매스기반 탄소중립형 바이오플라스틱 제품기술개발사업’ 과제(과제책임자 KAIST 최소영 연구교수)의 지원을 받아 수행됐다.

아이브릿지 사이트: https://github.com/kaistsystemsbiology/iBridge.git

2023.11.09 조회수 7431 -

그래핀 기반 2차원 반도체 소자 시뮬레이션의 양자 도약 달성

반도체 연구 개발에서 소자의 미세화에 따라 원자 수준에서 전류의 흐름을 이해하고 제어하는 것이 핵심적 요소가 되고 있는 상황에서, 우리 연구진이 기존에는 불가능했던 원자만큼 얇은 2차원 반도체 소자의 엄밀한 양자 역학적 컴퓨터 시뮬레이션을 성공적으로 구현하고 이를 기반으로 원자 결함에 의해 발생하는 특이한 소자 특성을 세계 최초로 보고했다.

우리 대학 전기및전자공학부 김용훈 교수 연구팀이 자체적으로 개발한 양자 수송 이론을 통해 세계 최초로 그래핀 전극 간 전자의 터널링 현상(전자가 포텐셜 장벽을 투과하는 현상)으로 작동하는 *2차원 터널링 트랜지스터의 **제1 원리 시뮬레이션을 수행하는 데 성공했다고 4일 밝혔다.

* 2차원 터널링 트랜지스터: 그래핀을 전극으로 하여 전극 간 전자의 터널링(tunneling) 현상을 통해 소자가 작동하는 반도체 소자이다. 소자의 동작 특성을 결정하는 그래핀 전극간 전자의 터널링 현상은 소스-드레인(source-drain) 전극 및 게이트(gate) 전압에 의해 결정된다.

**제1 원리 시뮬레이션: 제1원리 계산은 물질 내 전자들의 거동을 해석할 때 실험적 데이터나 경험적 모델을 도입하지 않고 지배방정식인 슈뢰딩거 방정식을 원자 정보를 포함시켜 직접 푸는 양자역학적 물질 시뮬레이션 방법으로 대표적인 방법론은 밀도 범함수론(density functional theory, DFT)이 있음

전기및전자공학부 김태형 박사과정과 이주호 박사가 공동 제1 저자로 참여한 이번 연구는 소재 계산 분야의 권위 있는 학술지 `네이쳐 파트너 저널 컴퓨테이셔널 머터리얼즈(Npj Computational Materials)' (IF 13.20) 3월 25일 字 온라인판에 게재됐다. (논문명: Gate-versus defect-induced voltage drop and negative differential resistance in vertical graphene heterostructures)

제1 원리 시뮬레이션이란 슈퍼컴퓨터에서 원자 수준의 양자역학 계산을 수행해 실험적 데이터나 경험적 모델의 도움 없이 물질의 특성을 도출하는 방법으로 제1 원리 계산을 통한 평형 상태의 소재 연구는 1998년 월터 콘(Walter Khon) 교수가 노벨상을 받은 `밀도 범함수론(density functional theory: DFT)'을 기반으로 다방면으로 수행돼왔다.

반면 전압 인가에 따른 비평형 상태에서 작동하는 나노 소자의 제1 원리 계산은 DFT 이론을 적용하기 어렵고 그 대안으로 제시된 이론들에도 한계가 있어 현재 그래핀 기반 2차원 반도체 소자의 엄밀한 양자역학적 시뮬레이션은 불가능한 상황이었다.

연구팀은 먼저 이러한 어려움을 극복하기 위해 자체적으로 수립한 새로운 양자 수송 계산 체계인 다공간 DFT 이론을 발전시켜 그래핀 기반 2차원 터널링 트랜지스터의 제1 원리 시뮬레이션을 가능하게 했다.

다음으로 이를 그래핀 전극-육각형 질화붕소 채널-그래핀 전극 소자 구조에 적용해 질화붕소 층에 존재하는 원자 결함이 다양한 비선형 소자 특성들을 도출시킬 수 있음을 보여 원자 결함의 종류와 위치에 대한 정보가 신뢰성 있는 2차원 소자의 구현에 매우 중요함 요소을 입증했다.

한편 이러한 비선형 소자 특성은 연구진이 기존에 세계 최초로 제안했던 양자 혼성화(quantum hybridization) 소자 원리(device principle)에 따라 발현됨을 보여 2차원 소자의 양자적 특성을 활용하는 한 방향을 제시했다.

김 교수는 "나날이 치열해지는 반도체 연구/개발 분야에서 세계적으로 경쟁력 있는 나노 소자 전산 설계 원천기술을 확보했다ˮ고 연구의 의미를 소개하며 "양자 효과가 극대화될 수밖에 없는 차세대 반도체 연구/개발에서 양자역학적 제1 원리 컴퓨터 시뮬레이션의 역할이 더욱 중요해질 것”이라고 강조했다.

한편 이번 연구는 삼성전자 미래기술 육성센터의 지원을 받아 수행됐다.

2022.04.04 조회수 14239

그래핀 기반 2차원 반도체 소자 시뮬레이션의 양자 도약 달성

반도체 연구 개발에서 소자의 미세화에 따라 원자 수준에서 전류의 흐름을 이해하고 제어하는 것이 핵심적 요소가 되고 있는 상황에서, 우리 연구진이 기존에는 불가능했던 원자만큼 얇은 2차원 반도체 소자의 엄밀한 양자 역학적 컴퓨터 시뮬레이션을 성공적으로 구현하고 이를 기반으로 원자 결함에 의해 발생하는 특이한 소자 특성을 세계 최초로 보고했다.

우리 대학 전기및전자공학부 김용훈 교수 연구팀이 자체적으로 개발한 양자 수송 이론을 통해 세계 최초로 그래핀 전극 간 전자의 터널링 현상(전자가 포텐셜 장벽을 투과하는 현상)으로 작동하는 *2차원 터널링 트랜지스터의 **제1 원리 시뮬레이션을 수행하는 데 성공했다고 4일 밝혔다.

* 2차원 터널링 트랜지스터: 그래핀을 전극으로 하여 전극 간 전자의 터널링(tunneling) 현상을 통해 소자가 작동하는 반도체 소자이다. 소자의 동작 특성을 결정하는 그래핀 전극간 전자의 터널링 현상은 소스-드레인(source-drain) 전극 및 게이트(gate) 전압에 의해 결정된다.

**제1 원리 시뮬레이션: 제1원리 계산은 물질 내 전자들의 거동을 해석할 때 실험적 데이터나 경험적 모델을 도입하지 않고 지배방정식인 슈뢰딩거 방정식을 원자 정보를 포함시켜 직접 푸는 양자역학적 물질 시뮬레이션 방법으로 대표적인 방법론은 밀도 범함수론(density functional theory, DFT)이 있음

전기및전자공학부 김태형 박사과정과 이주호 박사가 공동 제1 저자로 참여한 이번 연구는 소재 계산 분야의 권위 있는 학술지 `네이쳐 파트너 저널 컴퓨테이셔널 머터리얼즈(Npj Computational Materials)' (IF 13.20) 3월 25일 字 온라인판에 게재됐다. (논문명: Gate-versus defect-induced voltage drop and negative differential resistance in vertical graphene heterostructures)

제1 원리 시뮬레이션이란 슈퍼컴퓨터에서 원자 수준의 양자역학 계산을 수행해 실험적 데이터나 경험적 모델의 도움 없이 물질의 특성을 도출하는 방법으로 제1 원리 계산을 통한 평형 상태의 소재 연구는 1998년 월터 콘(Walter Khon) 교수가 노벨상을 받은 `밀도 범함수론(density functional theory: DFT)'을 기반으로 다방면으로 수행돼왔다.

반면 전압 인가에 따른 비평형 상태에서 작동하는 나노 소자의 제1 원리 계산은 DFT 이론을 적용하기 어렵고 그 대안으로 제시된 이론들에도 한계가 있어 현재 그래핀 기반 2차원 반도체 소자의 엄밀한 양자역학적 시뮬레이션은 불가능한 상황이었다.

연구팀은 먼저 이러한 어려움을 극복하기 위해 자체적으로 수립한 새로운 양자 수송 계산 체계인 다공간 DFT 이론을 발전시켜 그래핀 기반 2차원 터널링 트랜지스터의 제1 원리 시뮬레이션을 가능하게 했다.

다음으로 이를 그래핀 전극-육각형 질화붕소 채널-그래핀 전극 소자 구조에 적용해 질화붕소 층에 존재하는 원자 결함이 다양한 비선형 소자 특성들을 도출시킬 수 있음을 보여 원자 결함의 종류와 위치에 대한 정보가 신뢰성 있는 2차원 소자의 구현에 매우 중요함 요소을 입증했다.

한편 이러한 비선형 소자 특성은 연구진이 기존에 세계 최초로 제안했던 양자 혼성화(quantum hybridization) 소자 원리(device principle)에 따라 발현됨을 보여 2차원 소자의 양자적 특성을 활용하는 한 방향을 제시했다.

김 교수는 "나날이 치열해지는 반도체 연구/개발 분야에서 세계적으로 경쟁력 있는 나노 소자 전산 설계 원천기술을 확보했다ˮ고 연구의 의미를 소개하며 "양자 효과가 극대화될 수밖에 없는 차세대 반도체 연구/개발에서 양자역학적 제1 원리 컴퓨터 시뮬레이션의 역할이 더욱 중요해질 것”이라고 강조했다.

한편 이번 연구는 삼성전자 미래기술 육성센터의 지원을 받아 수행됐다.

2022.04.04 조회수 14239 -

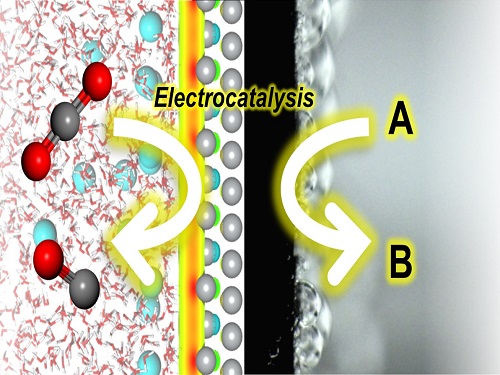

전기화학 분야의 오랜 난제인 전기 이중층 구조 규명

우리 대학 화학과 김형준 교수 연구팀이 GIST 신소재공학부 최창혁 교수 연구팀과 공동 연구를 통해 전기화학 분야의 오랜 난제 중 하나인 전기 이중층 구조를 이론적으로 규명하는 데 성공했다고 27일 밝혔다.

태양광 발전 등 친환경적으로 생산된 전기를 화학연료의 형태로 변환 및 저장하는 기술은 현재 인류가 직면하고 있는 에너지-환경 문제를 해결할 수 있는 가장 효율적인 미래전략이다. 2019년 리튬이온 배터리의 노벨 화학상 수상에서도 볼 수 있듯이, 전기화학 기술은 이러한 지속 가능한 탄소 중립 사회의 구축에 있어 가장 중요한 코어 기술로 여겨진다. 그러나 전기화학 분야에서 교과서에도 등장하는 100년 가까운 오래된 난제 중 하나가 있는데, 이는 바로 `전기 이중층'이라 불리는 특별한 액체 구조를 밝혀내는 것이다.

전기 이중층은 전기를 가한 금속 전극 주변에 액체 속의 이온이 쌓이면서 생성되는 특이한 층 구조를 의미한다. 이 구조적 특성에 따라 에너지 변환/저장 성능이 결정되기 때문에, 전기 이중층의 구조를 밝히려는 노력이 오랫동안 이어져 왔다. 그러나 전기 이중층은 금속 전극과 액체 전해질 사이 계면에 파묻혀 생성되는 나노 크기 정도 공간 속, 물과 이온들의 복잡한 배열을 가지는 구조이기 때문에 이를 직접 관측하기란 거의 불가능에 가까웠으며 지난 수십 년간 난제의 풀이에 대한 뚜렷한 진보를 이룰 수 없었다.

김형준 교수 연구팀은 컴퓨터 속 디지털 세상에 전기 이중층을 구현해 이러한 실험적 한계를 돌파하고자 했다. 양자 역학 및 분자동역학에 기반한 높은 정확도의 컴퓨터 시뮬레이션 방법을 개발해 그동안 베일에 싸여있던 전기 이중층 구조를 규명하는 데 성공했다. 이러한 가상공간에서의 결과는 GIST 최창혁 교수 연구팀이 실제로 실험에서 측정한 전기 이중층의 물리적 특성을 정확하게 예측할 수 있었다. 더 나아가 이러한 지식의 진보를 바탕으로, `주인-손님 화학' (특정 `손님' 분자만을 선택적으로 받아들이는 `주인' 분자의 특이한 화학적 성질을 의미)이라는 특별한 화학 반응을 활용해 전기 이중층 구조를 실제로 제어할 수 있는 전략을 도출했으며, 이를 통해 탄소 저감에 중요한 전기화학적 이산화탄소의 연료화 반응 효율 제어에 성공했다.

연구진은 "이번 연구를 통해 전기화학 분야의 오래된 난제인 전기 이중층 구조를 규명하는 데 성공했을 뿐만 아니라, 궁극적으로 이를 제어해 친환경 전기 에너지의 변환 및 저장 성능을 획기적으로 높일 가능성에 첫 단추를 끼웠다ˮ며, 이어 "이번 연구를 시발점으로 연료전지, 배터리, 질소 고정화 등 인류의 생존에 꼭 필요한 신 전기화학 기술 개발을 위한 연구를 지속하겠다ˮ고 소감을 밝혔다.

우리 대학 화학과 신승재 박사과정 학생과 GIST 신소재공학부 김동현, 배근수 박사과정 학생이 공동 제1 저자로 참여한 이번 연구 결과는 국제 학술지 `네이처 커뮤니케이션즈(Nature Communications)' 에 1월 10일 字 게재됐다. (논문명: On the importance of the electric double layer structure in aqueous electrocatalysis)

한편 이번 연구는 삼성전자 미래기술육성사업 및 한국연구재단(NRF)의 지원으로 진행됐다.

2022.01.27 조회수 15807

전기화학 분야의 오랜 난제인 전기 이중층 구조 규명

우리 대학 화학과 김형준 교수 연구팀이 GIST 신소재공학부 최창혁 교수 연구팀과 공동 연구를 통해 전기화학 분야의 오랜 난제 중 하나인 전기 이중층 구조를 이론적으로 규명하는 데 성공했다고 27일 밝혔다.

태양광 발전 등 친환경적으로 생산된 전기를 화학연료의 형태로 변환 및 저장하는 기술은 현재 인류가 직면하고 있는 에너지-환경 문제를 해결할 수 있는 가장 효율적인 미래전략이다. 2019년 리튬이온 배터리의 노벨 화학상 수상에서도 볼 수 있듯이, 전기화학 기술은 이러한 지속 가능한 탄소 중립 사회의 구축에 있어 가장 중요한 코어 기술로 여겨진다. 그러나 전기화학 분야에서 교과서에도 등장하는 100년 가까운 오래된 난제 중 하나가 있는데, 이는 바로 `전기 이중층'이라 불리는 특별한 액체 구조를 밝혀내는 것이다.

전기 이중층은 전기를 가한 금속 전극 주변에 액체 속의 이온이 쌓이면서 생성되는 특이한 층 구조를 의미한다. 이 구조적 특성에 따라 에너지 변환/저장 성능이 결정되기 때문에, 전기 이중층의 구조를 밝히려는 노력이 오랫동안 이어져 왔다. 그러나 전기 이중층은 금속 전극과 액체 전해질 사이 계면에 파묻혀 생성되는 나노 크기 정도 공간 속, 물과 이온들의 복잡한 배열을 가지는 구조이기 때문에 이를 직접 관측하기란 거의 불가능에 가까웠으며 지난 수십 년간 난제의 풀이에 대한 뚜렷한 진보를 이룰 수 없었다.

김형준 교수 연구팀은 컴퓨터 속 디지털 세상에 전기 이중층을 구현해 이러한 실험적 한계를 돌파하고자 했다. 양자 역학 및 분자동역학에 기반한 높은 정확도의 컴퓨터 시뮬레이션 방법을 개발해 그동안 베일에 싸여있던 전기 이중층 구조를 규명하는 데 성공했다. 이러한 가상공간에서의 결과는 GIST 최창혁 교수 연구팀이 실제로 실험에서 측정한 전기 이중층의 물리적 특성을 정확하게 예측할 수 있었다. 더 나아가 이러한 지식의 진보를 바탕으로, `주인-손님 화학' (특정 `손님' 분자만을 선택적으로 받아들이는 `주인' 분자의 특이한 화학적 성질을 의미)이라는 특별한 화학 반응을 활용해 전기 이중층 구조를 실제로 제어할 수 있는 전략을 도출했으며, 이를 통해 탄소 저감에 중요한 전기화학적 이산화탄소의 연료화 반응 효율 제어에 성공했다.

연구진은 "이번 연구를 통해 전기화학 분야의 오래된 난제인 전기 이중층 구조를 규명하는 데 성공했을 뿐만 아니라, 궁극적으로 이를 제어해 친환경 전기 에너지의 변환 및 저장 성능을 획기적으로 높일 가능성에 첫 단추를 끼웠다ˮ며, 이어 "이번 연구를 시발점으로 연료전지, 배터리, 질소 고정화 등 인류의 생존에 꼭 필요한 신 전기화학 기술 개발을 위한 연구를 지속하겠다ˮ고 소감을 밝혔다.

우리 대학 화학과 신승재 박사과정 학생과 GIST 신소재공학부 김동현, 배근수 박사과정 학생이 공동 제1 저자로 참여한 이번 연구 결과는 국제 학술지 `네이처 커뮤니케이션즈(Nature Communications)' 에 1월 10일 字 게재됐다. (논문명: On the importance of the electric double layer structure in aqueous electrocatalysis)

한편 이번 연구는 삼성전자 미래기술육성사업 및 한국연구재단(NRF)의 지원으로 진행됐다.

2022.01.27 조회수 15807 -

초대규모 그래프 프로세싱 시뮬레이션 기술 개발

우리 대학 연구진이 오늘날 정보통신(IT) 분야에서 광범위하게 사용되는 그래프 타입의 데이터를 실제로 저장하지 않고도 알고리즘을 계산할 수 있는 `그래프 프로세싱 시뮬레이션'이라는 신개념 기술을 세계 최초로 개발하는 데 성공했다. 데이터를 저장할 필요가 없어 1조 개 간선의 초대규모 그래프도 PC 한 대로 처리가 가능하다.

우리 대학 전산학부 김민수 교수 연구팀은 1조 개 간선의 초대규모 그래프에 대해 데이터 저장 없이 알고리즘을 계산할 수 있는 신개념 기술을 세계 최초로 개발했다고 23일 밝혔다.

오늘날 웹, SNS, 인공지능, 블록체인 등의 광범위한 분야들에서 그래프 타입의 데이터에 대한 다양한 알고리즘들의 연구가 매우 중요하다. 그러나 그래프 데이터의 복잡성으로 인해 그 크기가 커질 때 막대한 규모의 컴퓨터 클러스터가 있어야만 알고리즘 계산이 가능하다는 문제가 있다.

김 교수 연구팀은 이를 근본적으로 해결하는 T-GPS(Trillion-scale Graph Processing Simulation)라는 기술을 개발했다. 이 T-GPS 기술은 그래프 데이터를 실제로 디스크에 저장하지 않고도 마치 그래프 데이터가 저장돼 있는 것처럼 알고리즘을 계산할 수 있고, 계산 결과도 실제 저장된 그래프에 대한 알고리즘 계산과 완전히 동일하다는 장점이 있다.

그래프 알고리즘은 그래프 처리 엔진 상에서 개발되고 실행된다. 이는 산업적으로 널리 사용되는 SQL 질의를 데이터베이스 관리 시스템(DBMS) 엔진 상에서 개발하고 실행하는 것과 유사한 방식이다.

지금까지는 그래프 알고리즘을 개발하기 위해 먼저 합성 그래프를 생성 및 저장한 후, 이를 다시 그래프 처리 엔진에서 메모리로 적재해 알고리즘을 계산하는 2단계 방법을 사용했다. 그래프 데이터는 그 복잡성으로 인해 전체를 메모리로 적재하는 것이 요구되며, 그래프의 규모가 커지면 대규모 컴퓨터 클러스터 장비가 있어야만 알고리즘을 개발하고 실행할 수 있다는 커다란 단점이 있었다.

김 교수팀은 합성 그래프와 그래프 처리 엔진 분야에서 국제 최고 권위의 학술대회에 매년 논문을 발표하는 등 세계 최고의 기술력을 보유하고 있으며, 그 기술들을 바탕으로 기존 2단계 방법의 문제를 해결했다.

그래프 데이터상에서 그래프 알고리즘이 계산을 위해 접근하는 부분을 짧은 순간 동안 실시간으로 생성해, 마치 그래프 데이터가 존재하는 것처럼 알고리즘을 계산하는 것이다. 이때 그래프 데이터를 아무렇게 실시간 생성하는 것이 아니라 합성 그래프 모델에 따라 생성하고 저장한 것과 동일하도록 실시간 생성하는 것이 핵심 기술 중 하나다.

또한, 그래프 처리 엔진이 실시간으로 생성되는 그래프를 실제 그래프처럼 인식하고 알고리즘을 완전히 동일하게 계산하도록 엔진을 수정한 것이 또 다른 핵심 기술이다.

김민수 교수 연구팀은 T-GPS 기술을 종래의 2단계 방법과 성능을 비교한 결과, 종래의 2단계 방법이 11대의 컴퓨터로 구성된 클러스터에서 10억 개 간선 규모의 그래프를 계산할 수 있었던 반면, T-GPS 기술은 1대의 컴퓨터에서 1조 개 간선 규모의 그래프를 계산할 수 있어 컴퓨터 자원 대비 10,000배 더 큰 규모의 데이터를 처리를 할 수 있음을 확인했다. 또한, 알고리즘 계산 시간도 최대 43배 더 빠름을 확인했다.

교신저자로 참여한 김민수 교수는 "오늘날 거의 모든 IT 분야에서 그래프 데이터를 활용하고 있는바, 연구팀이 개발한 새로운 기술은 그래프 알고리즘의 개발 규모와 효율을 획기적으로 높일 수 있어 산업적 측면에서 파급 효과가 매우 클 것으로 기대한다ˮ 라고 말했다.

이번 연구에는 김 교수의 제자이자 캐나다 워털루 대학에 박사후 연구원으로 재직 중인 박힘찬 박사가 제1 저자로, 김 교수가 교신저자로 참여했으며 지난 22일 그리스 차니아에서 온라인으로 열린 데이터베이스 분야 최고 국제학술대회 중 하나인 IEEE ICDE에서 발표됐다. (논문명 : Trillion-scale Graph Processing Simulation based on Top-Down Graph Upscaling).

한편, 이 연구는 한국연구재단 선도연구센터 사업 및 중견연구자 지원사업, 과기정통부 IITP SW스타랩 사업의 지원을 받아 수행됐다.

2021.04.23 조회수 26939

초대규모 그래프 프로세싱 시뮬레이션 기술 개발

우리 대학 연구진이 오늘날 정보통신(IT) 분야에서 광범위하게 사용되는 그래프 타입의 데이터를 실제로 저장하지 않고도 알고리즘을 계산할 수 있는 `그래프 프로세싱 시뮬레이션'이라는 신개념 기술을 세계 최초로 개발하는 데 성공했다. 데이터를 저장할 필요가 없어 1조 개 간선의 초대규모 그래프도 PC 한 대로 처리가 가능하다.

우리 대학 전산학부 김민수 교수 연구팀은 1조 개 간선의 초대규모 그래프에 대해 데이터 저장 없이 알고리즘을 계산할 수 있는 신개념 기술을 세계 최초로 개발했다고 23일 밝혔다.

오늘날 웹, SNS, 인공지능, 블록체인 등의 광범위한 분야들에서 그래프 타입의 데이터에 대한 다양한 알고리즘들의 연구가 매우 중요하다. 그러나 그래프 데이터의 복잡성으로 인해 그 크기가 커질 때 막대한 규모의 컴퓨터 클러스터가 있어야만 알고리즘 계산이 가능하다는 문제가 있다.

김 교수 연구팀은 이를 근본적으로 해결하는 T-GPS(Trillion-scale Graph Processing Simulation)라는 기술을 개발했다. 이 T-GPS 기술은 그래프 데이터를 실제로 디스크에 저장하지 않고도 마치 그래프 데이터가 저장돼 있는 것처럼 알고리즘을 계산할 수 있고, 계산 결과도 실제 저장된 그래프에 대한 알고리즘 계산과 완전히 동일하다는 장점이 있다.

그래프 알고리즘은 그래프 처리 엔진 상에서 개발되고 실행된다. 이는 산업적으로 널리 사용되는 SQL 질의를 데이터베이스 관리 시스템(DBMS) 엔진 상에서 개발하고 실행하는 것과 유사한 방식이다.

지금까지는 그래프 알고리즘을 개발하기 위해 먼저 합성 그래프를 생성 및 저장한 후, 이를 다시 그래프 처리 엔진에서 메모리로 적재해 알고리즘을 계산하는 2단계 방법을 사용했다. 그래프 데이터는 그 복잡성으로 인해 전체를 메모리로 적재하는 것이 요구되며, 그래프의 규모가 커지면 대규모 컴퓨터 클러스터 장비가 있어야만 알고리즘을 개발하고 실행할 수 있다는 커다란 단점이 있었다.

김 교수팀은 합성 그래프와 그래프 처리 엔진 분야에서 국제 최고 권위의 학술대회에 매년 논문을 발표하는 등 세계 최고의 기술력을 보유하고 있으며, 그 기술들을 바탕으로 기존 2단계 방법의 문제를 해결했다.

그래프 데이터상에서 그래프 알고리즘이 계산을 위해 접근하는 부분을 짧은 순간 동안 실시간으로 생성해, 마치 그래프 데이터가 존재하는 것처럼 알고리즘을 계산하는 것이다. 이때 그래프 데이터를 아무렇게 실시간 생성하는 것이 아니라 합성 그래프 모델에 따라 생성하고 저장한 것과 동일하도록 실시간 생성하는 것이 핵심 기술 중 하나다.

또한, 그래프 처리 엔진이 실시간으로 생성되는 그래프를 실제 그래프처럼 인식하고 알고리즘을 완전히 동일하게 계산하도록 엔진을 수정한 것이 또 다른 핵심 기술이다.

김민수 교수 연구팀은 T-GPS 기술을 종래의 2단계 방법과 성능을 비교한 결과, 종래의 2단계 방법이 11대의 컴퓨터로 구성된 클러스터에서 10억 개 간선 규모의 그래프를 계산할 수 있었던 반면, T-GPS 기술은 1대의 컴퓨터에서 1조 개 간선 규모의 그래프를 계산할 수 있어 컴퓨터 자원 대비 10,000배 더 큰 규모의 데이터를 처리를 할 수 있음을 확인했다. 또한, 알고리즘 계산 시간도 최대 43배 더 빠름을 확인했다.

교신저자로 참여한 김민수 교수는 "오늘날 거의 모든 IT 분야에서 그래프 데이터를 활용하고 있는바, 연구팀이 개발한 새로운 기술은 그래프 알고리즘의 개발 규모와 효율을 획기적으로 높일 수 있어 산업적 측면에서 파급 효과가 매우 클 것으로 기대한다ˮ 라고 말했다.

이번 연구에는 김 교수의 제자이자 캐나다 워털루 대학에 박사후 연구원으로 재직 중인 박힘찬 박사가 제1 저자로, 김 교수가 교신저자로 참여했으며 지난 22일 그리스 차니아에서 온라인으로 열린 데이터베이스 분야 최고 국제학술대회 중 하나인 IEEE ICDE에서 발표됐다. (논문명 : Trillion-scale Graph Processing Simulation based on Top-Down Graph Upscaling).

한편, 이 연구는 한국연구재단 선도연구센터 사업 및 중견연구자 지원사업, 과기정통부 IITP SW스타랩 사업의 지원을 받아 수행됐다.

2021.04.23 조회수 26939 -

조광현 교수, 섬유아세포 과활성 유발 분자피드백 회로 규명

〈 조 광 현 교수 〉

우리 대학 바이오및뇌공학과 조광현 교수 연구팀이 삼성병원 김석형 교수 연구팀과 공동연구를 통해 섬유증 및 암 악성화의 원인이 되는 섬유아세포 과활성을 유발하는 분자피드백 회로를 최초로 규명했다.

신동관 박사와 안수균 학생 등이 함께 참여한 이번 연구는 ‘네이처 커뮤니케이션즈(Nature Communications)’ 8월 1일자 온라인 판에 게재됐다.

( https://www.nature.com/articles/s41467-018-05274-6 )

인간의 섬유아세포는 대부분의 정상조직에 비활성화된 상태로 존재하다가 상처회복을 위해 필요할 때 급진적으로 활성화된다. 하지만 이러한 급진적 활성화가 유발되는 원리는 아직 밝혀지지 않았다.

조광현 교수 연구팀은 삼성병원 김석형 교수팀과 공동연구를 통해 Twist1, Prrx1, TNC 분자들이 연쇄적으로 활성을 유발하는 양성피드백회로를 구성함으로서 그와 같은 급진적인 섬유아세포의 활성을 유발한다는 것을 분자생물학실험과 수학모델링, 컴퓨터시뮬레이션 분석, 그리고 동물실험과 임상데이터 분석을 통해 밝혔다.

활성화된 섬유아세포는 상처가 치유된 뒤 다시 비활성화된 상태로 전환돼야 하는데 이 때 피드백회로가 계속 작동하면 섬유증의 발생이나 암 악성화의 원인이 된다.

따라서 이번에 밝혀낸 Twist1-Prrx1-TNC 분자피드백회로는 섬유증과 암의 새로운 치료 타겟으로 활용될 수 있을 것으로 기대된다.

□ 그림 설명

그림1. 섬유아세포의 급진적 활성화를 유발하는 Twist1-Prrx1-TNC 분자피드백회로 규명 과정

그림2. 정상적인 섬유아세포의 활성화 조절과 피드백회로의 비가역적 활성화에 따른 비정상적인 섬유아세포 활성화 조절과정의 비교

2018.08.10 조회수 13389

조광현 교수, 섬유아세포 과활성 유발 분자피드백 회로 규명

〈 조 광 현 교수 〉

우리 대학 바이오및뇌공학과 조광현 교수 연구팀이 삼성병원 김석형 교수 연구팀과 공동연구를 통해 섬유증 및 암 악성화의 원인이 되는 섬유아세포 과활성을 유발하는 분자피드백 회로를 최초로 규명했다.

신동관 박사와 안수균 학생 등이 함께 참여한 이번 연구는 ‘네이처 커뮤니케이션즈(Nature Communications)’ 8월 1일자 온라인 판에 게재됐다.

( https://www.nature.com/articles/s41467-018-05274-6 )

인간의 섬유아세포는 대부분의 정상조직에 비활성화된 상태로 존재하다가 상처회복을 위해 필요할 때 급진적으로 활성화된다. 하지만 이러한 급진적 활성화가 유발되는 원리는 아직 밝혀지지 않았다.

조광현 교수 연구팀은 삼성병원 김석형 교수팀과 공동연구를 통해 Twist1, Prrx1, TNC 분자들이 연쇄적으로 활성을 유발하는 양성피드백회로를 구성함으로서 그와 같은 급진적인 섬유아세포의 활성을 유발한다는 것을 분자생물학실험과 수학모델링, 컴퓨터시뮬레이션 분석, 그리고 동물실험과 임상데이터 분석을 통해 밝혔다.

활성화된 섬유아세포는 상처가 치유된 뒤 다시 비활성화된 상태로 전환돼야 하는데 이 때 피드백회로가 계속 작동하면 섬유증의 발생이나 암 악성화의 원인이 된다.

따라서 이번에 밝혀낸 Twist1-Prrx1-TNC 분자피드백회로는 섬유증과 암의 새로운 치료 타겟으로 활용될 수 있을 것으로 기대된다.

□ 그림 설명

그림1. 섬유아세포의 급진적 활성화를 유발하는 Twist1-Prrx1-TNC 분자피드백회로 규명 과정

그림2. 정상적인 섬유아세포의 활성화 조절과 피드백회로의 비가역적 활성화에 따른 비정상적인 섬유아세포 활성화 조절과정의 비교

2018.08.10 조회수 13389 -

올 11월부터 세계 최초로 'AI(인공지능) World Cup 2017' 행사 연다

우리대학이 전국 각 대학의 학부생과 석·박사과정 대학원생을 대상으로 ‘AI 월드컵(World Cup) 2017’을 오는 11월 첫 개최한다. 특히 이 대회는 인공지능(AI) 경기로는 세계 최초로 열리는 공식대회다. 우리대학은 최근 세계적으로 관심이 높아지고 있는 4차 산업혁명을 국가성장 엔진창출의 기회로 적극 홍보하고 인공지능 관련 기술 활용 및 연구 개발에 대한 관심을 높이기 위해 전국 학부생과 석·박사 과정 대학원생을 대상으로 세계 최초로 ‘AI World Cup 2017’을 개최한다고 밝혔다.

우리대학은 이번 대회의 성공적인 개최와 운영을 위해 7월 28일 오후 2시부터 정보전자동 3228호실에서 인공지능에 관심 있는 전국 대학(원)생을 대상으로 시스템 사용법 및 참여방법 등에 관한 사전설명회를 개최할 예정이다. 또 지난 6월부터는 ‘AI World Cup 조직위원회(위원장 김종환 공과대학장)’를 구성하고 산하조직으로 운영위원회 · 경기위원회 · 홍보위원회 · 국제협력위원회 · 시스템 관리위원회 · 교육위원회 등 6개 분과위원회를 설치, 운영하는 등 대회를 완벽히 치룰 수 있도록 행사준비에 만전을 기하고 있다.

‘AI World Cup 조직위’에는 전기 및 전자공학부 · 전산학부 · 산업 및 시스템공학과 · 항공우주공학과 · 조천식녹색교통대학원 · 건설및환경공학과 · 문화기술대학원 · 과학기술정책대학원 등 우리대학을 대표하는 교수들이 대거 참여하고 있다. 우리대학이 이 대회를 만든 배경에는 1996년부터 시작된 ‘국제로봇 축구대회’를 세계 최초로 제안하고 대회를 직접 운영해 온 김종환 공대학장을 비롯해 공과대학 교수진이 그동안 축적해 온 인공지능 관련 지식과 노하우가 있기에 가능했다. 우리대학은 실무진들이 그동안 ‘국제로봇 축구대회’ 개최·운영을 통해 구축한 풍부하고도 다양한 운영경험이 ‘AI World Cup 2017’을 성공적으로 개최하는데 큰 역할을 할 것으로 기대하고 있다.

아울러 인공지능 기반의 융합연구와 바이오 · 나노 · IT · 로보틱스 간 융합연구를 위한 ‘NExFIRE 프로그램’ 운영 등 융합연구 혁신에서부터 융합형 창의인재 양성을 위한 전뇌교육 중심의 교육혁신에 이르기까지, 신성철 총장 취임 이후 우리나라 4차 산업혁명 성공을 위해 선도적 역할을 수행하고 있다는 우리대학만의 자신감과 도전정신도 이번 대회가 출범하는데 큰 몫을 했다.

우리대학 기계지능 및 로봇공학 다기관 지원연구단(MIR-MSREP, 단장 김종환 공과대학장)이 주관하는 이번 ‘AI World Cup 2017’에는 국내 대학(원)생 팀이면 누구나 참여가 가능하다. 대회종목은 온라인 시뮬레이션 환경에서 인공지능 기술로 스스로 학습한 5명의 선수가 한 팀을 이뤄 상대팀 골대에 골을 넣어 득점하는 ▲AI 축구와 온라인 경기영상을 분석하고 해설하는 ▲AI 경기해설, 그리고 온라인 경기결과를 기사로 작성하는 ▲AI 기자 등 모두 3개 종목으로 구성된다.

참가자들은 10월 한 달간 온라인 연습기간을 거친 후 11월1일부터 24일까지 예선을 치르는데, 누적 경기실적에서 고득점을 획득한 상위 팀들은 12월1일 KI빌딩에서 치루는 본선경기에 참여하게 된다. 본선 당일에는 인공지능 기술 구현방법 발표평가를 시행한 후 종합평가를 통해 최종 우승팀을 선정한다.

김종환 대회 조직위원장은 “이번 대회 성적우수 팀에게는 상장과 소정의 상품을 지급할 예정이며 2018년 상반기에는 대전시 등 여러 기관들과의 협력을 통해 외국 팀들에게도 출전 기회를 개방하는 등 대회규모를 국제행사로 크게 확대할 방침”이라고 밝혔다.

우리대학은 참가학생들의 이해를 돕기 위해 우선 11월2일과 3일 이틀간 개최예정인 ‘오픈 카이스트(Open KAIST)’ 행사기간 중에 공개 시범경기를 가질 계획이다. '오픈 카이스트(Open KAIST)’는 일반인이 우리대학 공과대학 산하 각 학과와 연구실을 직접 둘러보고 체험할 수 있는 행사로 공과대학이 2년마다 여는데 우리대학이 개최하는 행사 중 가장 규모가 큰 행사로 소문이 나있다.

‘AI World Cup 2017’에 참가를 원하는 국내 대학(원)생들은 팀 구성(안)을 마련해 홈페이지( http://mir.kaist.ac.kr )에서 참가신청서와 참가종목 등을 직접 입력해 접수기간인 7월11일부터 9월30일까지 제출하면 된다. 문의 042-350-8877(사무국).

2017.07.11 조회수 19991

올 11월부터 세계 최초로 'AI(인공지능) World Cup 2017' 행사 연다

우리대학이 전국 각 대학의 학부생과 석·박사과정 대학원생을 대상으로 ‘AI 월드컵(World Cup) 2017’을 오는 11월 첫 개최한다. 특히 이 대회는 인공지능(AI) 경기로는 세계 최초로 열리는 공식대회다. 우리대학은 최근 세계적으로 관심이 높아지고 있는 4차 산업혁명을 국가성장 엔진창출의 기회로 적극 홍보하고 인공지능 관련 기술 활용 및 연구 개발에 대한 관심을 높이기 위해 전국 학부생과 석·박사 과정 대학원생을 대상으로 세계 최초로 ‘AI World Cup 2017’을 개최한다고 밝혔다.

우리대학은 이번 대회의 성공적인 개최와 운영을 위해 7월 28일 오후 2시부터 정보전자동 3228호실에서 인공지능에 관심 있는 전국 대학(원)생을 대상으로 시스템 사용법 및 참여방법 등에 관한 사전설명회를 개최할 예정이다. 또 지난 6월부터는 ‘AI World Cup 조직위원회(위원장 김종환 공과대학장)’를 구성하고 산하조직으로 운영위원회 · 경기위원회 · 홍보위원회 · 국제협력위원회 · 시스템 관리위원회 · 교육위원회 등 6개 분과위원회를 설치, 운영하는 등 대회를 완벽히 치룰 수 있도록 행사준비에 만전을 기하고 있다.

‘AI World Cup 조직위’에는 전기 및 전자공학부 · 전산학부 · 산업 및 시스템공학과 · 항공우주공학과 · 조천식녹색교통대학원 · 건설및환경공학과 · 문화기술대학원 · 과학기술정책대학원 등 우리대학을 대표하는 교수들이 대거 참여하고 있다. 우리대학이 이 대회를 만든 배경에는 1996년부터 시작된 ‘국제로봇 축구대회’를 세계 최초로 제안하고 대회를 직접 운영해 온 김종환 공대학장을 비롯해 공과대학 교수진이 그동안 축적해 온 인공지능 관련 지식과 노하우가 있기에 가능했다. 우리대학은 실무진들이 그동안 ‘국제로봇 축구대회’ 개최·운영을 통해 구축한 풍부하고도 다양한 운영경험이 ‘AI World Cup 2017’을 성공적으로 개최하는데 큰 역할을 할 것으로 기대하고 있다.

아울러 인공지능 기반의 융합연구와 바이오 · 나노 · IT · 로보틱스 간 융합연구를 위한 ‘NExFIRE 프로그램’ 운영 등 융합연구 혁신에서부터 융합형 창의인재 양성을 위한 전뇌교육 중심의 교육혁신에 이르기까지, 신성철 총장 취임 이후 우리나라 4차 산업혁명 성공을 위해 선도적 역할을 수행하고 있다는 우리대학만의 자신감과 도전정신도 이번 대회가 출범하는데 큰 몫을 했다.

우리대학 기계지능 및 로봇공학 다기관 지원연구단(MIR-MSREP, 단장 김종환 공과대학장)이 주관하는 이번 ‘AI World Cup 2017’에는 국내 대학(원)생 팀이면 누구나 참여가 가능하다. 대회종목은 온라인 시뮬레이션 환경에서 인공지능 기술로 스스로 학습한 5명의 선수가 한 팀을 이뤄 상대팀 골대에 골을 넣어 득점하는 ▲AI 축구와 온라인 경기영상을 분석하고 해설하는 ▲AI 경기해설, 그리고 온라인 경기결과를 기사로 작성하는 ▲AI 기자 등 모두 3개 종목으로 구성된다.

참가자들은 10월 한 달간 온라인 연습기간을 거친 후 11월1일부터 24일까지 예선을 치르는데, 누적 경기실적에서 고득점을 획득한 상위 팀들은 12월1일 KI빌딩에서 치루는 본선경기에 참여하게 된다. 본선 당일에는 인공지능 기술 구현방법 발표평가를 시행한 후 종합평가를 통해 최종 우승팀을 선정한다.

김종환 대회 조직위원장은 “이번 대회 성적우수 팀에게는 상장과 소정의 상품을 지급할 예정이며 2018년 상반기에는 대전시 등 여러 기관들과의 협력을 통해 외국 팀들에게도 출전 기회를 개방하는 등 대회규모를 국제행사로 크게 확대할 방침”이라고 밝혔다.

우리대학은 참가학생들의 이해를 돕기 위해 우선 11월2일과 3일 이틀간 개최예정인 ‘오픈 카이스트(Open KAIST)’ 행사기간 중에 공개 시범경기를 가질 계획이다. '오픈 카이스트(Open KAIST)’는 일반인이 우리대학 공과대학 산하 각 학과와 연구실을 직접 둘러보고 체험할 수 있는 행사로 공과대학이 2년마다 여는데 우리대학이 개최하는 행사 중 가장 규모가 큰 행사로 소문이 나있다.

‘AI World Cup 2017’에 참가를 원하는 국내 대학(원)생들은 팀 구성(안)을 마련해 홈페이지( http://mir.kaist.ac.kr )에서 참가신청서와 참가종목 등을 직접 입력해 접수기간인 7월11일부터 9월30일까지 제출하면 된다. 문의 042-350-8877(사무국).

2017.07.11 조회수 19991 -

박진아 교수, 제50회 과학의날 기념 국무총리표창 수상

〈 박 진 아 교수 〉

우리 대학 전산학부 박진아 교수가 4월 21일 서울 동대문디자인플라자에서 열린 2017년 과학·정보통신의 날 기념식에서 표창장과 국무총리표창수장(Prime Minister’s Citation Ribbon)을 받았다.

2017 과학·정보통신의 날은 미래창조과학부와 방송통신위원회가 공동 주최하고 한국정보방송통신대연합 및 한국과학기술단체총연합회가 주관한 기념식이다.

산학연을 비롯해 과학기술 및 정보통신, 국가정보화, ICT융합 분야 발전에 공헌한 자를 대상으로 상이 수여됐다. 각 부문의 포상자 선정은 관련 기관·단체 및 추천위원회로부터 추천을 받아 공적 사항에 대한 전문가 심사를 거쳐 진행됐다.

박진아 교수는 전산학을 의료분야에 접목해 임상에 유용한 3차원 모델링기법을 제안하고 가상현실 기반 의료시뮬레이션을 연구해 융합학문 발전에 기여한 공을 인정받았다.

박 교수는 “20여 년 동안 전산학 연구를 의료분야에서도 유용하게 활용 할 수 있는 기술로 연구 개발하고자 했던 노력을 인정받아 기쁘다”며 “컴퓨터와 프로그래밍이 좋아서 저희 연구실에 온 학생들이 생소할 수밖에 없는 의학용어들을 스스로 익히며 각자 해당 분야의 의학전문가들과 거리낌 없이 소통하고 결과를 도출해낸 성과들이 모여 가능했다는 생각에 저희 컴퓨터그래픽스 및 가시화 (CGV) 연구실의 졸업생들과 재학생들에게 감사의 마음을 전한다” 고 말했다.

2017.04.25 조회수 18717

박진아 교수, 제50회 과학의날 기념 국무총리표창 수상

〈 박 진 아 교수 〉

우리 대학 전산학부 박진아 교수가 4월 21일 서울 동대문디자인플라자에서 열린 2017년 과학·정보통신의 날 기념식에서 표창장과 국무총리표창수장(Prime Minister’s Citation Ribbon)을 받았다.

2017 과학·정보통신의 날은 미래창조과학부와 방송통신위원회가 공동 주최하고 한국정보방송통신대연합 및 한국과학기술단체총연합회가 주관한 기념식이다.

산학연을 비롯해 과학기술 및 정보통신, 국가정보화, ICT융합 분야 발전에 공헌한 자를 대상으로 상이 수여됐다. 각 부문의 포상자 선정은 관련 기관·단체 및 추천위원회로부터 추천을 받아 공적 사항에 대한 전문가 심사를 거쳐 진행됐다.

박진아 교수는 전산학을 의료분야에 접목해 임상에 유용한 3차원 모델링기법을 제안하고 가상현실 기반 의료시뮬레이션을 연구해 융합학문 발전에 기여한 공을 인정받았다.

박 교수는 “20여 년 동안 전산학 연구를 의료분야에서도 유용하게 활용 할 수 있는 기술로 연구 개발하고자 했던 노력을 인정받아 기쁘다”며 “컴퓨터와 프로그래밍이 좋아서 저희 연구실에 온 학생들이 생소할 수밖에 없는 의학용어들을 스스로 익히며 각자 해당 분야의 의학전문가들과 거리낌 없이 소통하고 결과를 도출해낸 성과들이 모여 가능했다는 생각에 저희 컴퓨터그래픽스 및 가시화 (CGV) 연구실의 졸업생들과 재학생들에게 감사의 마음을 전한다” 고 말했다.

2017.04.25 조회수 18717