%EA%B7%B8%EB%9E%98%ED%94%84

-

엔비디아 쿠다 통합메모리 없이 세계 최고 그래프 연산 혁신

인공지능 분야에서 지식 체계나 데이터베이스를 그래프로 저장하고 활용하는 사례가 급증하지만, 일반적으로 복잡도가 높은 그래프 연산은 GPU 메모리의 제한으로 인해 매우 작은 규모의 그래프 등 비교적 단순한 연산만 처리할 수 있다는 한계가 있다. 우리 연구진이 25대의 컴퓨터로 2,000초가 걸리던 연산을 한 대의 GPU 컴퓨터로 처리할 수 있는 세계 최고 성능의 연산 프레임워크를 개발하는데 성공했다.

우리 대학 전산학부 김민수 교수 연구팀이 한정된 크기의 메모리를 지닌 GPU를 이용해 1조 간선 규모의 초대규모 그래프에 대해 다양한 연산을 고속으로 처리할 수 있는 스케줄러 및 메모리 관리 기술들을 갖춘 일반 연산 프레임워크(일명 GFlux, 지플럭스)를 개발했다고 27일 밝혔다.

연구팀이 개발한 지플럭스 프레임워크는 그래프 연산을 GPU에 최적화된 단위 작업인 ‘지테스크(GTask)’로 나누고, 이를 효율적으로 GPU에 배분 및 처리하는 특수한 스케줄링 기법을 핵심 기술로 한다. 그래프를 GPU 처리에 최적화된 자체 개발 압축 포맷인 HGF로 변환해 SSD와 같은 저장장치에 저장 및 관리한다.

기존 표준 포맷인 CSR로 저장할 경우, 1조 간선 규모의 그래프 크기가 9테라바이트(TB)에 이르지만, HGF 포맷을 활용하면 이 크기를 4.6테라바이트(TB)로 절반 가까이 줄일 수 있다. 또한 GPU에서는 메모리 정렬 문제로 그간 사용되지 않았던 3바이트의 주소 체계를 최초로 활용, GPU 메모리 사용량을 약 25% 절감했다.

또한, 엔비디아(NVIDIA) 쿠다(CUDA)의 통합 메모리(Unified Memory)에 전혀 의존하지 않고, 메모리 부족으로 인한 연산 실패를 방지할 수 있도록 메인 메모리와 GPU 메모리를 통합적으로 관리하는 GTask 전용 메모리 관리 기술을 주요 핵심 기술로 포함하고 있다.

김민수 교수 연구팀은 삼각형 개수 세기*와 같은 고난도 그래프 연산을 통해 지플럭스 기술의 성능을 검증했다.

*삼각형 개수 세기: 그래프에서 서로 연결된 세 개의 정점이 이루는 삼각형 형태의 관계를 모두 찾고 개수를 세는 연산으로 데이터 분석 및 인공지능에서 널리 활용됨

약 700억 간선 규모의 그래프를 대상으로 한 실험에서, 기존의 최고 성능 기술은 고속 네트워크로 연결된 컴퓨터 25대를 이용해 약 2,000초가 걸리던 삼각형 개수 세기 연산을 지플럭스는 GPU가 장착된 단일 컴퓨터만으로 약 두배 빠른 1,184초 만에 처리하는 데 성공했다.

이는 단일 컴퓨터로 삼각형 개수 세기 연산을 성공적으로 처리한 현재까지 알려진 최대 규모의 그래프다.

김민수 교수는 “최근 그래프 RAG(검색증강생성), 지식 그래프, 그래프 벡터 색인 등 대규모 그래프에 대한 고속 연산 처리 기술의 중요성이 점점 커지고 있다”며, “지플럭스 기술이 이러한 문제를 효과적으로 해결할 것으로 기대한다”고 말했다.

이번 연구에는 전산학부 오세연, 윤희용 박사과정이 각각 제 1, 2 저자로, 김 교수가 창업한 그래프 딥테크 기업인 (주)그래파이 소속 한동형 연구원이 제3 저자로, 김 교수가 교신저자로 참여했고. 연구 결과는 IEEE 주최 국제데이터공학학술대회(ICDE, International Conference on Data Engineering)에서 지난 5월 22일에 발표됐다.

※ 논문제목: GFlux: A fast GPU-based out-of-memory multi-hop query processing framework for trillion-edge graphs

※ DOI: https://doi.ieeecomputersociety.org/10.1109/ICDE65448.2025.00075

한편, 이번 연구는 과기정통부 IITP SW스타랩과 한국연구재단 중견과제의 지원을 받아 수행됐다.

2025.05.27 조회수 2210

엔비디아 쿠다 통합메모리 없이 세계 최고 그래프 연산 혁신

인공지능 분야에서 지식 체계나 데이터베이스를 그래프로 저장하고 활용하는 사례가 급증하지만, 일반적으로 복잡도가 높은 그래프 연산은 GPU 메모리의 제한으로 인해 매우 작은 규모의 그래프 등 비교적 단순한 연산만 처리할 수 있다는 한계가 있다. 우리 연구진이 25대의 컴퓨터로 2,000초가 걸리던 연산을 한 대의 GPU 컴퓨터로 처리할 수 있는 세계 최고 성능의 연산 프레임워크를 개발하는데 성공했다.

우리 대학 전산학부 김민수 교수 연구팀이 한정된 크기의 메모리를 지닌 GPU를 이용해 1조 간선 규모의 초대규모 그래프에 대해 다양한 연산을 고속으로 처리할 수 있는 스케줄러 및 메모리 관리 기술들을 갖춘 일반 연산 프레임워크(일명 GFlux, 지플럭스)를 개발했다고 27일 밝혔다.

연구팀이 개발한 지플럭스 프레임워크는 그래프 연산을 GPU에 최적화된 단위 작업인 ‘지테스크(GTask)’로 나누고, 이를 효율적으로 GPU에 배분 및 처리하는 특수한 스케줄링 기법을 핵심 기술로 한다. 그래프를 GPU 처리에 최적화된 자체 개발 압축 포맷인 HGF로 변환해 SSD와 같은 저장장치에 저장 및 관리한다.

기존 표준 포맷인 CSR로 저장할 경우, 1조 간선 규모의 그래프 크기가 9테라바이트(TB)에 이르지만, HGF 포맷을 활용하면 이 크기를 4.6테라바이트(TB)로 절반 가까이 줄일 수 있다. 또한 GPU에서는 메모리 정렬 문제로 그간 사용되지 않았던 3바이트의 주소 체계를 최초로 활용, GPU 메모리 사용량을 약 25% 절감했다.

또한, 엔비디아(NVIDIA) 쿠다(CUDA)의 통합 메모리(Unified Memory)에 전혀 의존하지 않고, 메모리 부족으로 인한 연산 실패를 방지할 수 있도록 메인 메모리와 GPU 메모리를 통합적으로 관리하는 GTask 전용 메모리 관리 기술을 주요 핵심 기술로 포함하고 있다.

김민수 교수 연구팀은 삼각형 개수 세기*와 같은 고난도 그래프 연산을 통해 지플럭스 기술의 성능을 검증했다.

*삼각형 개수 세기: 그래프에서 서로 연결된 세 개의 정점이 이루는 삼각형 형태의 관계를 모두 찾고 개수를 세는 연산으로 데이터 분석 및 인공지능에서 널리 활용됨

약 700억 간선 규모의 그래프를 대상으로 한 실험에서, 기존의 최고 성능 기술은 고속 네트워크로 연결된 컴퓨터 25대를 이용해 약 2,000초가 걸리던 삼각형 개수 세기 연산을 지플럭스는 GPU가 장착된 단일 컴퓨터만으로 약 두배 빠른 1,184초 만에 처리하는 데 성공했다.

이는 단일 컴퓨터로 삼각형 개수 세기 연산을 성공적으로 처리한 현재까지 알려진 최대 규모의 그래프다.

김민수 교수는 “최근 그래프 RAG(검색증강생성), 지식 그래프, 그래프 벡터 색인 등 대규모 그래프에 대한 고속 연산 처리 기술의 중요성이 점점 커지고 있다”며, “지플럭스 기술이 이러한 문제를 효과적으로 해결할 것으로 기대한다”고 말했다.

이번 연구에는 전산학부 오세연, 윤희용 박사과정이 각각 제 1, 2 저자로, 김 교수가 창업한 그래프 딥테크 기업인 (주)그래파이 소속 한동형 연구원이 제3 저자로, 김 교수가 교신저자로 참여했고. 연구 결과는 IEEE 주최 국제데이터공학학술대회(ICDE, International Conference on Data Engineering)에서 지난 5월 22일에 발표됐다.

※ 논문제목: GFlux: A fast GPU-based out-of-memory multi-hop query processing framework for trillion-edge graphs

※ DOI: https://doi.ieeecomputersociety.org/10.1109/ICDE65448.2025.00075

한편, 이번 연구는 과기정통부 IITP SW스타랩과 한국연구재단 중견과제의 지원을 받아 수행됐다.

2025.05.27 조회수 2210 -

‘로봇스케치’ 도쿄 데뷔, 최우수 심사위원상 수상

VR 헤드셋을 쓴 디자이너(산업디자인학과 이준협 박사)가 태블릿과 펜으로 아무 것도 없는 가상 공간 속에서 유려한 입체 형태와 복잡한 관절 구조를 가지는 4족 거미 로봇을 단 몇 분 만에 그려서 완성했다. 디자이너가 컨트롤러를 조작하자 움직이던 거미 로봇이 일어나 2족 휴머노이드 로봇으로 자세를 수정하고 두 발을 짚고 걸음을 내딛기 시작했다. (2024 시그래프 아시아 리얼타임 라이브의 KAIST 로봇스케치 시연 장면)

우리 대학 12월 6일 도쿄 국제 포럼에서 열린 ‘시그래프 아시아 2024’의 하이라이트인 리얼타임 라이브(Real-Time Live!)에서 산업디자인학과 배석형 교수팀이 기계공학과 황보제민 교수팀과 협업하여 개발한 ‘로봇스케치(RobostSketch)’ 기술이 최우수 심사위원상(Jury’s Choice)을 수상했다고 9일 밝혔다.

‘시그래프 리얼타임 라이브’는 컴퓨터 그래픽스 및 상호작용 분야에서 ‘꿈의 무대’로 알려져 있다. 매년 전 세계에서 엄선된 10여 개의 혁신적인 기술만이 무대에 오른다.

모든 시연은 사전 녹화 없이 실시간으로 이루어지며, 6분이라는 제한된 시간 안에 기술의 독창성과 가능성을 선보여야 한다. KAIST의 로봇스케치는 이러한 무대에서 새로운 로봇 디자인 프로세스의 가능성을 보이며 큰 주목을 받았으며, 단 하나의 기술에만 수여되는 최우수 심사위원상을 수상했다.

로봇스케치는 단순히 외형과 구조를 시각적으로 표현하는 설계 도구를 넘어, 3D 스케칭에 생성형 AI와 몰입형 VR을 접목해 로봇 디자인의 개념을 새롭게 정의한 혁신적 기술이다.

디자이너는 VR 환경에서 태블릿과 펜을 사용해 복잡한 관절형 구조를 직관적으로 표현하고, 이를 실제 크기로 확인할 수 있다. 디자이너가 그린 로봇은 강화학습을 통해 현실 세계의 물리 법칙을 따르는 시뮬레이션 속에서 보행법과 움직임을 학습한다.

이를 통해 디자이너는 실제 세계에서 작동 가능한 로봇 디자인을 VR 공간 안에서 만들고, 로봇을 직접 움직이며 로봇이 가질 동작의 자연스러움과 안정성을 실시간으로 확인할 수 있다.

로봇스케치는 3D 스케칭 전문가인 산업디자인학과 배석형 교수 연구팀과 로봇 강화학습 전문가인 기계공학과 황보제민 교수 연구팀의 협업으로 완성됐다.

배석형 교수는 “기존 로봇 디자인의 한계를 극복하고, 로봇 디자이너가 상상하는 모든 것을 실시간으로 표현할 수 있는 도구를 만들고 싶었다”고 밝혔다.

이어 “로봇 디자인은 단순히 외형뿐 아니라 로봇의 움직임과 기능, 더 나아가 사용자와의 상호작용까지 모두 포함하는 과정이며 로봇 디자이너와 로봇 엔지니어의 원활한 소통을 촉진하고 현실 프로토타이핑에 소모되는 시간과 비용을 크게 줄일 수 있는 로봇스케치는 앞으로 로봇 개발과 제품화 과정에서 중요한 도구가 될 것”이라고 덧붙였다.

이 연구는 ‘DRB-KAIST 스케치더퓨처 연구센터’의 지원 아래 이루어진 결과로, 해당 센터는 3D 스케칭, AI, VR 기술을 결합해 전문가의 창의성과 생산성을 극대화하는 도구를 연구하며 첨단 기술과 디자인의 융합 가능성을 탐구하고 있다. 앞으로 로봇 디자인뿐 아니라 미래 산업 전반에서 고도화된 디자인 도구의 발전이 기대된다.

ACM SIGGRAPH Asia 2024 리얼타임 라이브 <로봇 스케치> 시연 영상: https://youtu.be/5wi53Z2_sAk

2024.12.09 조회수 5807

‘로봇스케치’ 도쿄 데뷔, 최우수 심사위원상 수상

VR 헤드셋을 쓴 디자이너(산업디자인학과 이준협 박사)가 태블릿과 펜으로 아무 것도 없는 가상 공간 속에서 유려한 입체 형태와 복잡한 관절 구조를 가지는 4족 거미 로봇을 단 몇 분 만에 그려서 완성했다. 디자이너가 컨트롤러를 조작하자 움직이던 거미 로봇이 일어나 2족 휴머노이드 로봇으로 자세를 수정하고 두 발을 짚고 걸음을 내딛기 시작했다. (2024 시그래프 아시아 리얼타임 라이브의 KAIST 로봇스케치 시연 장면)

우리 대학 12월 6일 도쿄 국제 포럼에서 열린 ‘시그래프 아시아 2024’의 하이라이트인 리얼타임 라이브(Real-Time Live!)에서 산업디자인학과 배석형 교수팀이 기계공학과 황보제민 교수팀과 협업하여 개발한 ‘로봇스케치(RobostSketch)’ 기술이 최우수 심사위원상(Jury’s Choice)을 수상했다고 9일 밝혔다.

‘시그래프 리얼타임 라이브’는 컴퓨터 그래픽스 및 상호작용 분야에서 ‘꿈의 무대’로 알려져 있다. 매년 전 세계에서 엄선된 10여 개의 혁신적인 기술만이 무대에 오른다.

모든 시연은 사전 녹화 없이 실시간으로 이루어지며, 6분이라는 제한된 시간 안에 기술의 독창성과 가능성을 선보여야 한다. KAIST의 로봇스케치는 이러한 무대에서 새로운 로봇 디자인 프로세스의 가능성을 보이며 큰 주목을 받았으며, 단 하나의 기술에만 수여되는 최우수 심사위원상을 수상했다.

로봇스케치는 단순히 외형과 구조를 시각적으로 표현하는 설계 도구를 넘어, 3D 스케칭에 생성형 AI와 몰입형 VR을 접목해 로봇 디자인의 개념을 새롭게 정의한 혁신적 기술이다.

디자이너는 VR 환경에서 태블릿과 펜을 사용해 복잡한 관절형 구조를 직관적으로 표현하고, 이를 실제 크기로 확인할 수 있다. 디자이너가 그린 로봇은 강화학습을 통해 현실 세계의 물리 법칙을 따르는 시뮬레이션 속에서 보행법과 움직임을 학습한다.

이를 통해 디자이너는 실제 세계에서 작동 가능한 로봇 디자인을 VR 공간 안에서 만들고, 로봇을 직접 움직이며 로봇이 가질 동작의 자연스러움과 안정성을 실시간으로 확인할 수 있다.

로봇스케치는 3D 스케칭 전문가인 산업디자인학과 배석형 교수 연구팀과 로봇 강화학습 전문가인 기계공학과 황보제민 교수 연구팀의 협업으로 완성됐다.

배석형 교수는 “기존 로봇 디자인의 한계를 극복하고, 로봇 디자이너가 상상하는 모든 것을 실시간으로 표현할 수 있는 도구를 만들고 싶었다”고 밝혔다.

이어 “로봇 디자인은 단순히 외형뿐 아니라 로봇의 움직임과 기능, 더 나아가 사용자와의 상호작용까지 모두 포함하는 과정이며 로봇 디자이너와 로봇 엔지니어의 원활한 소통을 촉진하고 현실 프로토타이핑에 소모되는 시간과 비용을 크게 줄일 수 있는 로봇스케치는 앞으로 로봇 개발과 제품화 과정에서 중요한 도구가 될 것”이라고 덧붙였다.

이 연구는 ‘DRB-KAIST 스케치더퓨처 연구센터’의 지원 아래 이루어진 결과로, 해당 센터는 3D 스케칭, AI, VR 기술을 결합해 전문가의 창의성과 생산성을 극대화하는 도구를 연구하며 첨단 기술과 디자인의 융합 가능성을 탐구하고 있다. 앞으로 로봇 디자인뿐 아니라 미래 산업 전반에서 고도화된 디자인 도구의 발전이 기대된다.

ACM SIGGRAPH Asia 2024 리얼타임 라이브 <로봇 스케치> 시연 영상: https://youtu.be/5wi53Z2_sAk

2024.12.09 조회수 5807 -

뉴로모픽 신경망으로 컴퓨팅 난제 해결하다

우리 연구진이 현재 반도체 산업체에서 사용되는 실리콘 소재 및 공정만을 사용해 초소형 진동 신경망을 구축하여 경계선 인식 기능을 구현했으며 난제 중 하나인 그래프 색칠 문제*를 해결했다.

*그래프 색칠 문제: 그래프 이론에서 사용되는 용어로, 그래프의 각 정점에 서로 다른 색을 할당해야 하며, 이러한 색깔 구분 문제는 방송국 주파수가 겹쳐 난시청 지역이 발생하지 않도록 주파수를 할당하는 문제 등과도 유사해 다양하게 응용되고 있음

우리 대학 전기및전자공학부 최양규 교수 연구팀이 실리콘 바이리스터 소자로 생물학적 뉴런의 상호작용을 모방한 뉴로모픽 진동 신경망을 개발했다고 3일 밝혔다.

빅데이터 시대가 도래하면서 인공지능 기술이 예전과 비교할 수 없을 만큼 비약적으로 발전하고 있다. 인간의 뇌 기능을 모사하는 뉴로모픽 컴퓨팅 중 하나인 상호 간 결합된 진동 신경망(oscillatory neural network)은 뉴런의 상호작용을 모방한 인공 신경망이다. 진동 신경망은 기본단위에 해당하는 진동자의 연결 동작을 이용하며 신호의 크기가 아닌 진동을 이용해 연산을 수행하므로 소모 전력 측면에서 이점을 가지고 있다.

연구팀은 실리콘 기반 진동자를 이용해 진동 신경망을 개발했다. 축전기를 이용해 두 개 이상의 실리콘 진동자를 연결하면, 각각의 진동 신호가 상호작용해 시간이 경과하면서 동기화(synchronization) 된다. 연구팀은 진동 신경망으로 영상 처리에 사용되는 경계선 인식(edge detection) 기능을 구현했으며 난제 중 하나인 그래프 색칠 문제(vertex coloring problem)를 해결했다.

또한 이번 연구는 제조 관점에서, 복잡한 회로나 기존 반도체 공정과 호환성이 낮은 소재 및 구조 대신, 현재 반도체 산업체에서 사용되는 실리콘 관련 소재 및 공정만으로 진동 신경망을 구축했기 때문에, 양산에 바로 적용 가능하다는 장점이 있다.

연구를 주도한 윤성윤 박사과정, 서강대학교 한준규 교수는 "개발된 진동 신경망은 복잡한 컴퓨팅 난제를 계산할 수 있는 뉴로모픽 컴퓨팅 하드웨어로, 자원 분배, 신약 개발, 반도체 회로 설계 및 스케줄링 등에 유용하게 사용될 수 있을 것으로 기대된다ˮ고 연구의 의의를 설명했다.

윤성윤 박사과정과 한준규 교수가 공동 제1 저자로 참여한 이번 연구는 나노과학 분야 저명 국제 학술지 ‘나노 레터스(Nano Letters)’에 2024년 3월 24권 9호에 출판되었으며, 추가 표지 논문(Supplementary Cover)으로 선정됐다.

(논문명 : A Nanoscale Bistable Resistor for an Oscillatory Neural Network)

(https://pubs.acs.org/doi/full/10.1021/acs.nanolett.3c04539).

한편 이번 연구는 한국연구재단 차세대지능형반도체기술개발사업 및 국가반도체연구실지원핵심기술개발사업의 지원을 받아 수행됐다.

2024.04.03 조회수 8612

뉴로모픽 신경망으로 컴퓨팅 난제 해결하다

우리 연구진이 현재 반도체 산업체에서 사용되는 실리콘 소재 및 공정만을 사용해 초소형 진동 신경망을 구축하여 경계선 인식 기능을 구현했으며 난제 중 하나인 그래프 색칠 문제*를 해결했다.

*그래프 색칠 문제: 그래프 이론에서 사용되는 용어로, 그래프의 각 정점에 서로 다른 색을 할당해야 하며, 이러한 색깔 구분 문제는 방송국 주파수가 겹쳐 난시청 지역이 발생하지 않도록 주파수를 할당하는 문제 등과도 유사해 다양하게 응용되고 있음

우리 대학 전기및전자공학부 최양규 교수 연구팀이 실리콘 바이리스터 소자로 생물학적 뉴런의 상호작용을 모방한 뉴로모픽 진동 신경망을 개발했다고 3일 밝혔다.

빅데이터 시대가 도래하면서 인공지능 기술이 예전과 비교할 수 없을 만큼 비약적으로 발전하고 있다. 인간의 뇌 기능을 모사하는 뉴로모픽 컴퓨팅 중 하나인 상호 간 결합된 진동 신경망(oscillatory neural network)은 뉴런의 상호작용을 모방한 인공 신경망이다. 진동 신경망은 기본단위에 해당하는 진동자의 연결 동작을 이용하며 신호의 크기가 아닌 진동을 이용해 연산을 수행하므로 소모 전력 측면에서 이점을 가지고 있다.

연구팀은 실리콘 기반 진동자를 이용해 진동 신경망을 개발했다. 축전기를 이용해 두 개 이상의 실리콘 진동자를 연결하면, 각각의 진동 신호가 상호작용해 시간이 경과하면서 동기화(synchronization) 된다. 연구팀은 진동 신경망으로 영상 처리에 사용되는 경계선 인식(edge detection) 기능을 구현했으며 난제 중 하나인 그래프 색칠 문제(vertex coloring problem)를 해결했다.

또한 이번 연구는 제조 관점에서, 복잡한 회로나 기존 반도체 공정과 호환성이 낮은 소재 및 구조 대신, 현재 반도체 산업체에서 사용되는 실리콘 관련 소재 및 공정만으로 진동 신경망을 구축했기 때문에, 양산에 바로 적용 가능하다는 장점이 있다.

연구를 주도한 윤성윤 박사과정, 서강대학교 한준규 교수는 "개발된 진동 신경망은 복잡한 컴퓨팅 난제를 계산할 수 있는 뉴로모픽 컴퓨팅 하드웨어로, 자원 분배, 신약 개발, 반도체 회로 설계 및 스케줄링 등에 유용하게 사용될 수 있을 것으로 기대된다ˮ고 연구의 의의를 설명했다.

윤성윤 박사과정과 한준규 교수가 공동 제1 저자로 참여한 이번 연구는 나노과학 분야 저명 국제 학술지 ‘나노 레터스(Nano Letters)’에 2024년 3월 24권 9호에 출판되었으며, 추가 표지 논문(Supplementary Cover)으로 선정됐다.

(논문명 : A Nanoscale Bistable Resistor for an Oscillatory Neural Network)

(https://pubs.acs.org/doi/full/10.1021/acs.nanolett.3c04539).

한편 이번 연구는 한국연구재단 차세대지능형반도체기술개발사업 및 국가반도체연구실지원핵심기술개발사업의 지원을 받아 수행됐다.

2024.04.03 조회수 8612 -

신기정 교수 연구팀, 정보검색 분야 최우수 학술대회 ACM CIKM 2022 튜토리얼 강연

우리 대학 김재철AI대학원 신기정 교수가 이끄는 연구팀이 지난 10월 17일부터 10월 21일까지 미국 애틀랜타에서 진행된 미 컴퓨터협회 정보 및 지식 관리 학술대회(이하 ACM CIKM 2022)에서 튜토리얼 강연을 진행했다고 1일 밝혔다.

올해 31회를 맞은 ACM CIKM은, 정보 검색(Information Retrieval) 분야 세계 최고 권위 학회 중 하나로, 전 세계에서 해당 분야 전문가들이 참석해 최신 연구 성과를 공유한다. ACM CIKM에서는 매년 강연자의 전문성 그리고 강연 주제의 깊이와 다양성 등을 고려해 강연자를 선정해 튜토리얼 강연을 열고 있다.

김재철AI대학원 이건 석박통합과정과 유재민 박사(미국 카네기멜론대학교 박사 후 연구원)로 구성된 신기정 교수 연구팀은 `Mining of Real-world Hypergraphs: Concepts, Patterns, and Generators'라는 제목으로 ACM CIKM 2022 학술대회에서 튜토리얼 강연을 진행했다.

사회, 뇌, 웹 등의 다양한 복잡계는 구성요소끼리 상호작용하는 특징이 있다. 이러한 상호작용 중 다수는 셋 이상의 구성요소가 참여하는 `그룹 상호작용'이나 분석의 용이성을 위해 두 개의 구성요소가 참여하는 `쌍 상호작용'을 가정하는 경우가 많았다. 하지만, 하이퍼그래프를 활용해 그룹 상호작용을 쉽고 효과적으로 모델링하고 분석할 수 있다는 사실이 최근 많은 주목을 받았다. 하이퍼그래프는 정점(Vertex)들과 초간선(Hyperedge)들로 구성되며, 하나의 초간선은 임의의 수의 정점을 포함하는 집합이다. 복잡계의 구성요소들을 표현하기 위해 정점이 사용되며, 그룹 상호작용들을 표현하기 초간선이 사용된다.

튜토리얼 강연에서 신기정 교수는 다양한 복잡계를 구성하는 요소들 사이의 그룹 상호작용으로 인해 발생하는 패턴을 발견하고 이에 대한 설명을 제공하기 위한 하이퍼그래프 기반 최신 인공지능 및 빅데이터 기술들을 소개했다. 강연은 정적인 패턴, 동적인 패턴, 그리고 패턴들에 대한 설명을 제공하기 위한 생성 모형 세 부분으로 나뉘어서 3시간 동안 진행됐다. 스탠퍼드 대학교, 코넬 대학교 등 세계 유수 대학의 연구 논문과 함께, 신기정 교수 연구팀의 연구 논문 7편도 소개됐다.

신기정 교수는 "하이퍼그래프에 대한 이론적인 연구는 많지만, 하이퍼그래프를 활용해 실제 복잡계를 분석하는 실증적인 연구는 걸음마 단계다ˮ라며, "튜토리얼을 통해 더 많은 사람이 이 주제에 관심을 갖기를 기대하며, 다양한 후속 연구를 통해 복잡계에 대한 인류의 이해를 크게 증진시킬 것을 기대한다ˮ라고 설명했다.

신기정 교수 연구팀은 올해 11월 28일부터 진행되는 전기전자공학자협회 데이터 마이닝 학술대회(IEEE ICDM 2022)에서도 튜토리얼 강연자로 선정됐다. 올해 22회를 맞는 IEEE ICDM은, 데이터 마이닝(Data Mining) 분야의 세계 최고 권위 학회 중 하나로, 올해 12월 1일까지 미국 올랜도에서 개최될 예정이다.

한편 이번 튜토리얼은 과학기술정보통신부 재원으로 한국연구재단의 지원을 받은 대용량 하이퍼그래프 마이닝: 패턴, 아웃라이어, 학습, 및 요약 과제와 정보통신기획평가원의 지원을 받은 강건하고 공정하며 확장 가능한 데이터 중심의 연속 학습 과제의 성과이다.

2022.11.01 조회수 7441

신기정 교수 연구팀, 정보검색 분야 최우수 학술대회 ACM CIKM 2022 튜토리얼 강연

우리 대학 김재철AI대학원 신기정 교수가 이끄는 연구팀이 지난 10월 17일부터 10월 21일까지 미국 애틀랜타에서 진행된 미 컴퓨터협회 정보 및 지식 관리 학술대회(이하 ACM CIKM 2022)에서 튜토리얼 강연을 진행했다고 1일 밝혔다.

올해 31회를 맞은 ACM CIKM은, 정보 검색(Information Retrieval) 분야 세계 최고 권위 학회 중 하나로, 전 세계에서 해당 분야 전문가들이 참석해 최신 연구 성과를 공유한다. ACM CIKM에서는 매년 강연자의 전문성 그리고 강연 주제의 깊이와 다양성 등을 고려해 강연자를 선정해 튜토리얼 강연을 열고 있다.

김재철AI대학원 이건 석박통합과정과 유재민 박사(미국 카네기멜론대학교 박사 후 연구원)로 구성된 신기정 교수 연구팀은 `Mining of Real-world Hypergraphs: Concepts, Patterns, and Generators'라는 제목으로 ACM CIKM 2022 학술대회에서 튜토리얼 강연을 진행했다.

사회, 뇌, 웹 등의 다양한 복잡계는 구성요소끼리 상호작용하는 특징이 있다. 이러한 상호작용 중 다수는 셋 이상의 구성요소가 참여하는 `그룹 상호작용'이나 분석의 용이성을 위해 두 개의 구성요소가 참여하는 `쌍 상호작용'을 가정하는 경우가 많았다. 하지만, 하이퍼그래프를 활용해 그룹 상호작용을 쉽고 효과적으로 모델링하고 분석할 수 있다는 사실이 최근 많은 주목을 받았다. 하이퍼그래프는 정점(Vertex)들과 초간선(Hyperedge)들로 구성되며, 하나의 초간선은 임의의 수의 정점을 포함하는 집합이다. 복잡계의 구성요소들을 표현하기 위해 정점이 사용되며, 그룹 상호작용들을 표현하기 초간선이 사용된다.

튜토리얼 강연에서 신기정 교수는 다양한 복잡계를 구성하는 요소들 사이의 그룹 상호작용으로 인해 발생하는 패턴을 발견하고 이에 대한 설명을 제공하기 위한 하이퍼그래프 기반 최신 인공지능 및 빅데이터 기술들을 소개했다. 강연은 정적인 패턴, 동적인 패턴, 그리고 패턴들에 대한 설명을 제공하기 위한 생성 모형 세 부분으로 나뉘어서 3시간 동안 진행됐다. 스탠퍼드 대학교, 코넬 대학교 등 세계 유수 대학의 연구 논문과 함께, 신기정 교수 연구팀의 연구 논문 7편도 소개됐다.

신기정 교수는 "하이퍼그래프에 대한 이론적인 연구는 많지만, 하이퍼그래프를 활용해 실제 복잡계를 분석하는 실증적인 연구는 걸음마 단계다ˮ라며, "튜토리얼을 통해 더 많은 사람이 이 주제에 관심을 갖기를 기대하며, 다양한 후속 연구를 통해 복잡계에 대한 인류의 이해를 크게 증진시킬 것을 기대한다ˮ라고 설명했다.

신기정 교수 연구팀은 올해 11월 28일부터 진행되는 전기전자공학자협회 데이터 마이닝 학술대회(IEEE ICDM 2022)에서도 튜토리얼 강연자로 선정됐다. 올해 22회를 맞는 IEEE ICDM은, 데이터 마이닝(Data Mining) 분야의 세계 최고 권위 학회 중 하나로, 올해 12월 1일까지 미국 올랜도에서 개최될 예정이다.

한편 이번 튜토리얼은 과학기술정보통신부 재원으로 한국연구재단의 지원을 받은 대용량 하이퍼그래프 마이닝: 패턴, 아웃라이어, 학습, 및 요약 과제와 정보통신기획평가원의 지원을 받은 강건하고 공정하며 확장 가능한 데이터 중심의 연속 학습 과제의 성과이다.

2022.11.01 조회수 7441 -

레이블 없이 훈련 가능한 그래프 신경망 모델 기술 개발

최근 다양한 분야 (소셜 네트워크 분석, 추천시스템 등)에서 그래프 데이터 (그림 1) 의 중요성이 대두되고 있으며, 이에 따라 그래프 신경망(Graph Neural Network) 기술을 활용한 서비스가 급속히 증가하고 있다. 서비스 구축을 위해서는 심층 학습 모델을 훈련해야 하며, 이를 위해서는 충분한 훈련 데이터를 준비해야 한다. 특히 훈련 데이터에 정답지를 만드는 레이블링(labeling) 과정이 필요한데 (예를 들어, 소셜 네트워크의 특정 사용자에 `20대'라는 레이블을 부여하는 행위), 이 과정은 일반적으로 수작업으로 진행되므로 노동력과 시간이 소요된다. 따라서 그래프 신경망 모델 훈련 시 데이터가 충분하지 않은 상황을 효과적으로 타개하는 방법의 필요성이 대두되고 있다.

우리 대학 산업및시스템공학과 박찬영 교수 연구팀이 데이터의 레이블이 없는 상황에서도 높은 예측 정확도를 달성할 수 있는 새로운 그래프 신경망 모델 훈련 기술을 개발했다고 25일 밝혔다.

정점의 레이블이 없는 상황에서 그래프 신경망 모델의 훈련은 데이터 증강을 통해 생성된 정점들의 공통된 특성을 학습하는 과정으로 볼 수 있다. 하지만 이러한 정점의 공통된 특성을 학습하는 과정에서, 기존 훈련 방법은 표상 공간에서 자신을 제외한 다른 정점들과의 유사도가 작아지도록 훈련을 한다. 하지만 그래프 데이터가 정점들 사이의 관계를 나타내는 데이터 구조라는 점을 고려했을 때, 이런 일차원적인 방법론은 정점 간의 관계를 정확히 반영하지 못하게 된다.

박 교수팀이 개발한 기술은 그래프 신경망 모델에서 정점들 사이의 관계를 보존해 정점의 레이블이 없는 상황에서 모델을 훈련시켜 높은 예측 정확도를 달성할 수 있게 해준다.

KAIST 산업및시스템공학과 이남경 석사과정이 제1 저자, 현동민 박사, 이준석 석사과정 학생이 제2, 제3 저자로 참여한 이번 연구는 최고권위 국제학술대회 `정보지식관리 콘퍼런스(CIKM) 2022'에서 올 10월 발표될 예정이다. (논문명: Relational Self-Supervised Learning on Graphs)

기존 연구에서는 정점의 레이블이 없는 상황에서 정점에 대한 표상을 훈련하기 위해 표상 공간 내에서 자기 자신을 제외한 다른 정점들과의 유사도가 작아지도록 훈련을 한다. 예를 들어서, 소셜 네트워크에 A, B, C 라는 사용자가 존재할 때, A, B와 C가 표상 공간에서 서로 간의 유사도가 모두 작아지도록 모델을 훈련하는 것이다. 이때 박 교수팀이 착안한 점은 그래프 데이터가 정점 간의 관계를 나타내는 데이터이므로 정점 간의 관계를 포착하도록 정점의 표상을 훈련할 필요가 있다는 점이었다.

즉, A, B와 C 서로 간의 유사도가 모두 작아지게 하는 훈련 메커니즘과는 달리, 실제 그래프상에서는 이들이 연관이 있을 수 있다는 점이다. 따라서 A, B와 C 사이의 관계를 긍정/부정의 이진 분류를 통해 표상 공간에서 유사도가 작아지도록 훈련을 하는 것이 아닌, 이들의 관계를 정의해 그 관계를 보존하도록 학습하는 모델을 연구팀은 개발했다(그림 2). 연구팀은 정점 간의 관계를 기반으로 정점의 표상을 훈련함으로써, 기존 연구가 갖는 엄격한 규제들을 완화해 그래프 데이터를 더 유연하게 모델링했다.

연구팀은 이 학습 방법론을 `관계 보존 학습'이라고 명명했으며, 그래프 데이터 분석의 주요 문제(정점 분류, 간선 예측)에 적용했다(그림 3). 그 결과 최신 연구 방법론과 비교했을 때, 정점 분류 문제에서 최대 3% 예측 정확도를 향상했고, 간선 예측 문제에서 6%의 성능 향상, 다중 연결 네트워크 (Multiplex network)의 정점 분류 문제에서 3%의 성능 향상을 보였다.

제1 저자인 이남경 석사과정은 "이번 기술은 데이터의 레이블이 부재한 상황에서도 그래프 신경망을 학습할 수 있는 새로운 방법ˮ 이라면서 "그래프 기반의 데이터뿐만이 아닌 이미지 텍스트 음성 데이터 등에 폭넓게 적용될 수 있어, 심층 학습 전반적인 성능 개선에 기여할 수 있다ˮ고 밝혔다.

연구팀을 지도한 박찬영 교수도 "이번 기술은 그래프 데이터상에 레이블이 부재한 상황에서 표상 학습 모델을 훈련하는 기존 모델들의 단점들을 `관계 보존`이라는 개념을 통해 보완해 새로운 학습 패러다임을 제시하여 학계에 큰 파급효과를 낼 수 있다ˮ라고 말했다.

한편, 이번 연구는 과학기술정보통신부 재원으로 정보통신기획평가원의 지원을 받아 사람중심인공지능핵심원천기술개발 과제로 개발한 연구성과 결과물(No. 2022-0-00157, 강건하고 공정하며 확장 가능한 데이터 중심의 연속 학습)이다.

2022.10.25 조회수 8675

레이블 없이 훈련 가능한 그래프 신경망 모델 기술 개발

최근 다양한 분야 (소셜 네트워크 분석, 추천시스템 등)에서 그래프 데이터 (그림 1) 의 중요성이 대두되고 있으며, 이에 따라 그래프 신경망(Graph Neural Network) 기술을 활용한 서비스가 급속히 증가하고 있다. 서비스 구축을 위해서는 심층 학습 모델을 훈련해야 하며, 이를 위해서는 충분한 훈련 데이터를 준비해야 한다. 특히 훈련 데이터에 정답지를 만드는 레이블링(labeling) 과정이 필요한데 (예를 들어, 소셜 네트워크의 특정 사용자에 `20대'라는 레이블을 부여하는 행위), 이 과정은 일반적으로 수작업으로 진행되므로 노동력과 시간이 소요된다. 따라서 그래프 신경망 모델 훈련 시 데이터가 충분하지 않은 상황을 효과적으로 타개하는 방법의 필요성이 대두되고 있다.

우리 대학 산업및시스템공학과 박찬영 교수 연구팀이 데이터의 레이블이 없는 상황에서도 높은 예측 정확도를 달성할 수 있는 새로운 그래프 신경망 모델 훈련 기술을 개발했다고 25일 밝혔다.

정점의 레이블이 없는 상황에서 그래프 신경망 모델의 훈련은 데이터 증강을 통해 생성된 정점들의 공통된 특성을 학습하는 과정으로 볼 수 있다. 하지만 이러한 정점의 공통된 특성을 학습하는 과정에서, 기존 훈련 방법은 표상 공간에서 자신을 제외한 다른 정점들과의 유사도가 작아지도록 훈련을 한다. 하지만 그래프 데이터가 정점들 사이의 관계를 나타내는 데이터 구조라는 점을 고려했을 때, 이런 일차원적인 방법론은 정점 간의 관계를 정확히 반영하지 못하게 된다.

박 교수팀이 개발한 기술은 그래프 신경망 모델에서 정점들 사이의 관계를 보존해 정점의 레이블이 없는 상황에서 모델을 훈련시켜 높은 예측 정확도를 달성할 수 있게 해준다.

KAIST 산업및시스템공학과 이남경 석사과정이 제1 저자, 현동민 박사, 이준석 석사과정 학생이 제2, 제3 저자로 참여한 이번 연구는 최고권위 국제학술대회 `정보지식관리 콘퍼런스(CIKM) 2022'에서 올 10월 발표될 예정이다. (논문명: Relational Self-Supervised Learning on Graphs)

기존 연구에서는 정점의 레이블이 없는 상황에서 정점에 대한 표상을 훈련하기 위해 표상 공간 내에서 자기 자신을 제외한 다른 정점들과의 유사도가 작아지도록 훈련을 한다. 예를 들어서, 소셜 네트워크에 A, B, C 라는 사용자가 존재할 때, A, B와 C가 표상 공간에서 서로 간의 유사도가 모두 작아지도록 모델을 훈련하는 것이다. 이때 박 교수팀이 착안한 점은 그래프 데이터가 정점 간의 관계를 나타내는 데이터이므로 정점 간의 관계를 포착하도록 정점의 표상을 훈련할 필요가 있다는 점이었다.

즉, A, B와 C 서로 간의 유사도가 모두 작아지게 하는 훈련 메커니즘과는 달리, 실제 그래프상에서는 이들이 연관이 있을 수 있다는 점이다. 따라서 A, B와 C 사이의 관계를 긍정/부정의 이진 분류를 통해 표상 공간에서 유사도가 작아지도록 훈련을 하는 것이 아닌, 이들의 관계를 정의해 그 관계를 보존하도록 학습하는 모델을 연구팀은 개발했다(그림 2). 연구팀은 정점 간의 관계를 기반으로 정점의 표상을 훈련함으로써, 기존 연구가 갖는 엄격한 규제들을 완화해 그래프 데이터를 더 유연하게 모델링했다.

연구팀은 이 학습 방법론을 `관계 보존 학습'이라고 명명했으며, 그래프 데이터 분석의 주요 문제(정점 분류, 간선 예측)에 적용했다(그림 3). 그 결과 최신 연구 방법론과 비교했을 때, 정점 분류 문제에서 최대 3% 예측 정확도를 향상했고, 간선 예측 문제에서 6%의 성능 향상, 다중 연결 네트워크 (Multiplex network)의 정점 분류 문제에서 3%의 성능 향상을 보였다.

제1 저자인 이남경 석사과정은 "이번 기술은 데이터의 레이블이 부재한 상황에서도 그래프 신경망을 학습할 수 있는 새로운 방법ˮ 이라면서 "그래프 기반의 데이터뿐만이 아닌 이미지 텍스트 음성 데이터 등에 폭넓게 적용될 수 있어, 심층 학습 전반적인 성능 개선에 기여할 수 있다ˮ고 밝혔다.

연구팀을 지도한 박찬영 교수도 "이번 기술은 그래프 데이터상에 레이블이 부재한 상황에서 표상 학습 모델을 훈련하는 기존 모델들의 단점들을 `관계 보존`이라는 개념을 통해 보완해 새로운 학습 패러다임을 제시하여 학계에 큰 파급효과를 낼 수 있다ˮ라고 말했다.

한편, 이번 연구는 과학기술정보통신부 재원으로 정보통신기획평가원의 지원을 받아 사람중심인공지능핵심원천기술개발 과제로 개발한 연구성과 결과물(No. 2022-0-00157, 강건하고 공정하며 확장 가능한 데이터 중심의 연속 학습)이다.

2022.10.25 조회수 8675 -

인공지능으로 화학반응을 예측하다

우리 대학 생명화학공학과 정유성 교수 연구팀이 화학자처럼 생각하는 인공지능을 개발했다고 4일 밝혔다. 연구팀이 개발한 인공지능은 유기 반응의 결과를 정확하게 예측한다.

유기 화학자는 반응물을 보고 유기 화학반응의 결과를 예상해 약물이나 유기발광다이오드(OLED)와 같이 원하는 물성을 갖는 분자를 합성한다. 하지만 실험을 통해 화학반응의 생성물을 직접 확인하는 작업은 일반적으로 시간과 비용이 많이 소모된다. 게다가 유기 화학 반응은 같은 반응물에서 다양한 생성물이 생길 수 있어 숙련된 유기 화학자라도 모든 화학반응을 정확하게 예측하지 못한다.

이런 한계를 극복하고자 인공지능을 이용해 유기 반응을 예측하는 연구가 활발하게 일어나고 있다. 대부분의 연구는 반응물과 생성물을 서로 다른 두 개의 언어로 생각하고 한 언어에서 다른 언어로 번역하는 언어 번역 모델을 사용하는 방법에 집중하고 있다. 이 방법은 예측 정확도는 높지만, 인공지능이 화학을 이해하고 생성물을 예측했다고 해석하기 어려워 모델이 예측한 결과를 신뢰하기 어렵다.

정 교수팀은 화학적 직관을 바탕으로 모델을 설계해서 모델이 예측한 결과를 화학적으로 설명을 할 수 있을 뿐 아니라, 공개 데이터베이스에서 매우 우수한 예측 정확도를 달성했다.

정 교수팀은 화학자가 반응 결과를 예측하는 방법에서 아이디어를 얻었다. 화학자는 반응 중심을 파악하고 화학반응 규칙을 적용해 가능한 생성물을 예측한다. 이 과정을 본떠서 공개 화학반응 데이터베이스로부터 화학반응 규칙을 도출했다. 화학반응 규칙을 바탕으로 분자의 화학 반응성을 예측하기 위해서, 분자를 그래프로 취급하는 그래프 신경망(Graph Neural Network, GNN) 모델을 개발했다. 이 모델에 반응물들을 넣으면 화학반응 규칙과 반응 중심을 식별해 생성물을 성공적으로 예측한다.

정 교수팀은 화학반응에서 널리 사용되는 미국 특허무역청(USPTO) 데이터를 이용해 유기 반응을 90% 이상의 정확도로 예측하는 데 성공했다. 개발된 모델은 실제 사용 시 모델에 높은 신뢰성을 제공하는 `예측의 불확실성'을 말할 수 있다. 예를 들어, 불확실성이 낮다고 간주되는 모델의 정확도는 98.6%로 증가한다. 모델은 무작위로 샘플링된 일련의 유기 반응을 예측하는 데 있어 소규모의 합성 전문가보다 더 정확한 것으로 나타났다.

이번 연구의 성공으로 연구팀은 다른 분야에서 좋은 성능을 보인 모델을 그대로 사용하던 기존 방법보다, 화학자가 생각하는 방법과 동일하게 신경망을 설계하는 전략이 더 합리적이고 우수한 성능을 보인다는 것을 입증했다. 연구팀은 이 연구를 활용하면 분자 설계 과정이 비약적으로 빨라질 것으로 기대하며, 새로운 화합물 개발에 실용적인 응용을 기대하고 있다. 정유성 교수팀은 현재 연구 성과의 특허 출원을 준비하고 있다.

우리 대학 생명화학공학과 첸수안(Shuan Chen) 박사과정이 제1 저자로 참여한 이번 연구 결과는 국제 학술지 '네이처 머신 인텔리전스(Nature Machine Intelligence)'에 9월호 표지논문으로 선정돼 출판됐다.

한편 이번 연구는 산업통상자원부와 한국연구재단의 지원을 받아 수행됐다.

2022.10.04 조회수 27444

인공지능으로 화학반응을 예측하다

우리 대학 생명화학공학과 정유성 교수 연구팀이 화학자처럼 생각하는 인공지능을 개발했다고 4일 밝혔다. 연구팀이 개발한 인공지능은 유기 반응의 결과를 정확하게 예측한다.

유기 화학자는 반응물을 보고 유기 화학반응의 결과를 예상해 약물이나 유기발광다이오드(OLED)와 같이 원하는 물성을 갖는 분자를 합성한다. 하지만 실험을 통해 화학반응의 생성물을 직접 확인하는 작업은 일반적으로 시간과 비용이 많이 소모된다. 게다가 유기 화학 반응은 같은 반응물에서 다양한 생성물이 생길 수 있어 숙련된 유기 화학자라도 모든 화학반응을 정확하게 예측하지 못한다.

이런 한계를 극복하고자 인공지능을 이용해 유기 반응을 예측하는 연구가 활발하게 일어나고 있다. 대부분의 연구는 반응물과 생성물을 서로 다른 두 개의 언어로 생각하고 한 언어에서 다른 언어로 번역하는 언어 번역 모델을 사용하는 방법에 집중하고 있다. 이 방법은 예측 정확도는 높지만, 인공지능이 화학을 이해하고 생성물을 예측했다고 해석하기 어려워 모델이 예측한 결과를 신뢰하기 어렵다.

정 교수팀은 화학적 직관을 바탕으로 모델을 설계해서 모델이 예측한 결과를 화학적으로 설명을 할 수 있을 뿐 아니라, 공개 데이터베이스에서 매우 우수한 예측 정확도를 달성했다.

정 교수팀은 화학자가 반응 결과를 예측하는 방법에서 아이디어를 얻었다. 화학자는 반응 중심을 파악하고 화학반응 규칙을 적용해 가능한 생성물을 예측한다. 이 과정을 본떠서 공개 화학반응 데이터베이스로부터 화학반응 규칙을 도출했다. 화학반응 규칙을 바탕으로 분자의 화학 반응성을 예측하기 위해서, 분자를 그래프로 취급하는 그래프 신경망(Graph Neural Network, GNN) 모델을 개발했다. 이 모델에 반응물들을 넣으면 화학반응 규칙과 반응 중심을 식별해 생성물을 성공적으로 예측한다.

정 교수팀은 화학반응에서 널리 사용되는 미국 특허무역청(USPTO) 데이터를 이용해 유기 반응을 90% 이상의 정확도로 예측하는 데 성공했다. 개발된 모델은 실제 사용 시 모델에 높은 신뢰성을 제공하는 `예측의 불확실성'을 말할 수 있다. 예를 들어, 불확실성이 낮다고 간주되는 모델의 정확도는 98.6%로 증가한다. 모델은 무작위로 샘플링된 일련의 유기 반응을 예측하는 데 있어 소규모의 합성 전문가보다 더 정확한 것으로 나타났다.

이번 연구의 성공으로 연구팀은 다른 분야에서 좋은 성능을 보인 모델을 그대로 사용하던 기존 방법보다, 화학자가 생각하는 방법과 동일하게 신경망을 설계하는 전략이 더 합리적이고 우수한 성능을 보인다는 것을 입증했다. 연구팀은 이 연구를 활용하면 분자 설계 과정이 비약적으로 빨라질 것으로 기대하며, 새로운 화합물 개발에 실용적인 응용을 기대하고 있다. 정유성 교수팀은 현재 연구 성과의 특허 출원을 준비하고 있다.

우리 대학 생명화학공학과 첸수안(Shuan Chen) 박사과정이 제1 저자로 참여한 이번 연구 결과는 국제 학술지 '네이처 머신 인텔리전스(Nature Machine Intelligence)'에 9월호 표지논문으로 선정돼 출판됐다.

한편 이번 연구는 산업통상자원부와 한국연구재단의 지원을 받아 수행됐다.

2022.10.04 조회수 27444 -

세계 최초 그래프 기반 인공지능 추론 가능한 SSD 개발

우리 대학 전기및전자공학부 정명수 교수 연구팀(컴퓨터 아키텍처 및 메모리 시스템 연구실)이 세계 최초로 그래프 기계학습 추론의 그래프처리, 그래프 샘플링 그리고 신경망 가속을 스토리지/SSD 장치 근처에서 수행하는 `전체론적 그래프 기반 신경망 기계학습 기술(이하 홀리스틱 GNN)'을 개발하는데 성공했다고 10일 밝혔다.

연구팀은 자체 제작한 프로그래밍 가능 반도체(FPGA)를 동반한 새로운 형태의 계산형 스토리지/SSD 시스템에 기계학습 전용 신경망 가속 하드웨어와 그래프 전용 처리 컨트롤러/소프트웨어를 시제작했다. 이는 이상적 상황에서 최신 고성능 엔비디아 GPU를 이용한 기계학습 가속 컴퓨팅 대비 7배의 속도 향상과 33배의 에너지 절약을 가져올 수 있다고 밝혔다.

그래프 자료구조가 적용된 새로운 기계학습 모델은 기존 신경망 기반 기계학습 기법들과 달리, 데이터 사이의 연관 관계를 표현할 수 있어 페이스북, 구글, 링크드인, 우버 등, 대규모 소셜 네트워크 서비스(SNS)부터, 내비게이션, 신약개발 등 광범위한 분야와 응용에서 사용된다. 예를 들면 그래프 구조로 저장된 사용자 네트워크를 분석하는 경우 일반적인 기계학습으로는 불가능했던 현실적인 상품 및 아이템 추천, 사람이 추론한 것 같은 친구 추천 등이 가능하다. 이러한 신흥 그래프 기반 신경망 기계학습은 그간 GPU와 같은 일반 기계학습의 가속 시스템을 재이용해 연산 되어왔는데, 이는 그래프 데이터를 스토리지로부터 메모리로 적재하고 샘플링하는 등의 데이터 전처리 과정에서 심각한 성능 병목현상과 함께 장치 메모리 부족 현상으로 실제 시스템 적용에 한계를 보여 왔다.

정명수 교수 연구팀이 개발한 홀리스틱 GNN 기술은 그래프 데이터 자체가 저장된 스토리지 근처에서 사용자 요청에 따른 추론의 모든 과정을 직접 가속한다. 구체적으로는 프로그래밍 가능한 반도체를 스토리지 근처에 배치한 새로운 계산형 스토리지(Computational SSD) 구조를 활용해 대규모 그래프 데이터의 이동을 제거하고 데이터 근처(Near Storage)에서 그래프처리 및 그래프 샘플링 등을 가속해 그래프 기계학습 전처리 과정에서의 병목현상을 해결했다.

일반적인 계산형 스토리지는 장치 내 고정된 펌웨어와 하드웨어 구성을 통해서 데이터를 처리해야 했기 때문에 그 사용에 제한이 있었다. 그래프처리 및 그래프샘플링 외에도, 연구팀의 홀리스틱 GNN 기술은 인공지능 추론 가속에 필요한 다양한 하드웨어 구조, 그리고 소프트웨어를 후원할 수 있도록 다수 그래프 기계학습 모델을 프로그래밍할 수 있는 장치수준의 소프트웨어와 사용자가 자유롭게 변경할 수 있는 신경망 가속 하드웨어 프레임워크 구조를 제공한다.

연구팀은 홀리스틱 GNN 기술의 실효성을 검증하기 위해 계산형 스토리지의 프로토타입을 자체 제작한 후, 그 위에 개발된 그래프 기계학습용 하드웨어 *RTL과 소프트웨어 프레임워크를 구현해 탑재했다. 그래프 기계학습 추론 성능을 제작된 계산형 스토리지 가속기 프로토타입과 최신 고성능 엔비디아 GPU 가속 시스템(RTX 3090)에서 평가한 결과, 홀리스틱 GNN 기술이 이상적인 상황에서 기존 엔비디아 GPU를 이용해 그래프 기계학습을 가속하는 시스템의 경우에 비해 평균 7배 빠르고 33배 에너지를 감소시킴을 확인했다. 특히, 그래프 규모가 점차 커질수록 전처리 병목현상 완화 효과가 증가해 기존 GPU 대비 최대 201배 향상된 속도와 453배 에너지를 감소할 수 있었다.

☞ RTL (Registor Transistor Logic): 저항과 트랜지스터로 구성한 컴퓨터에 사용되는 회로

정명수 교수는 "대규모 그래프에 대해 스토리지 근처에서 그래프 기계학습을 고속으로 추론할 뿐만 아니라 에너지 절약에 최적화된 계산형 스토리지 가속 시스템을 확보했다ˮ며 "기존 고성능 가속 시스템을 대체해 초대형 추천시스템, 교통 예측 시스템, 신약 개발 등의 광범위한 실제 응용에 적용될 수 있을 것ˮ이라고 말했다.

한편 이번 연구는 미국 산호세에서 오는 2월에 열릴 스토리지 시스템 분야 최우수 학술대회인 `유즈닉스 패스트(USENIX Conference on File and Storage Technologies, FAST), 2022'에 관련 논문(논문명: Hardware/Software Co-Programmable Framework for Computational SSDs to Accelerate Deep Learning Service on Large-Scale Graphs)으로 발표될 예정이다.

해당 연구는 삼성미래기술육성사업 지원을 받아 진행됐고 자세한 내용은 연구실 웹사이트(http://camelab.org)에서 확인할 수 있다.

2022.01.10 조회수 11636

세계 최초 그래프 기반 인공지능 추론 가능한 SSD 개발

우리 대학 전기및전자공학부 정명수 교수 연구팀(컴퓨터 아키텍처 및 메모리 시스템 연구실)이 세계 최초로 그래프 기계학습 추론의 그래프처리, 그래프 샘플링 그리고 신경망 가속을 스토리지/SSD 장치 근처에서 수행하는 `전체론적 그래프 기반 신경망 기계학습 기술(이하 홀리스틱 GNN)'을 개발하는데 성공했다고 10일 밝혔다.

연구팀은 자체 제작한 프로그래밍 가능 반도체(FPGA)를 동반한 새로운 형태의 계산형 스토리지/SSD 시스템에 기계학습 전용 신경망 가속 하드웨어와 그래프 전용 처리 컨트롤러/소프트웨어를 시제작했다. 이는 이상적 상황에서 최신 고성능 엔비디아 GPU를 이용한 기계학습 가속 컴퓨팅 대비 7배의 속도 향상과 33배의 에너지 절약을 가져올 수 있다고 밝혔다.

그래프 자료구조가 적용된 새로운 기계학습 모델은 기존 신경망 기반 기계학습 기법들과 달리, 데이터 사이의 연관 관계를 표현할 수 있어 페이스북, 구글, 링크드인, 우버 등, 대규모 소셜 네트워크 서비스(SNS)부터, 내비게이션, 신약개발 등 광범위한 분야와 응용에서 사용된다. 예를 들면 그래프 구조로 저장된 사용자 네트워크를 분석하는 경우 일반적인 기계학습으로는 불가능했던 현실적인 상품 및 아이템 추천, 사람이 추론한 것 같은 친구 추천 등이 가능하다. 이러한 신흥 그래프 기반 신경망 기계학습은 그간 GPU와 같은 일반 기계학습의 가속 시스템을 재이용해 연산 되어왔는데, 이는 그래프 데이터를 스토리지로부터 메모리로 적재하고 샘플링하는 등의 데이터 전처리 과정에서 심각한 성능 병목현상과 함께 장치 메모리 부족 현상으로 실제 시스템 적용에 한계를 보여 왔다.

정명수 교수 연구팀이 개발한 홀리스틱 GNN 기술은 그래프 데이터 자체가 저장된 스토리지 근처에서 사용자 요청에 따른 추론의 모든 과정을 직접 가속한다. 구체적으로는 프로그래밍 가능한 반도체를 스토리지 근처에 배치한 새로운 계산형 스토리지(Computational SSD) 구조를 활용해 대규모 그래프 데이터의 이동을 제거하고 데이터 근처(Near Storage)에서 그래프처리 및 그래프 샘플링 등을 가속해 그래프 기계학습 전처리 과정에서의 병목현상을 해결했다.

일반적인 계산형 스토리지는 장치 내 고정된 펌웨어와 하드웨어 구성을 통해서 데이터를 처리해야 했기 때문에 그 사용에 제한이 있었다. 그래프처리 및 그래프샘플링 외에도, 연구팀의 홀리스틱 GNN 기술은 인공지능 추론 가속에 필요한 다양한 하드웨어 구조, 그리고 소프트웨어를 후원할 수 있도록 다수 그래프 기계학습 모델을 프로그래밍할 수 있는 장치수준의 소프트웨어와 사용자가 자유롭게 변경할 수 있는 신경망 가속 하드웨어 프레임워크 구조를 제공한다.

연구팀은 홀리스틱 GNN 기술의 실효성을 검증하기 위해 계산형 스토리지의 프로토타입을 자체 제작한 후, 그 위에 개발된 그래프 기계학습용 하드웨어 *RTL과 소프트웨어 프레임워크를 구현해 탑재했다. 그래프 기계학습 추론 성능을 제작된 계산형 스토리지 가속기 프로토타입과 최신 고성능 엔비디아 GPU 가속 시스템(RTX 3090)에서 평가한 결과, 홀리스틱 GNN 기술이 이상적인 상황에서 기존 엔비디아 GPU를 이용해 그래프 기계학습을 가속하는 시스템의 경우에 비해 평균 7배 빠르고 33배 에너지를 감소시킴을 확인했다. 특히, 그래프 규모가 점차 커질수록 전처리 병목현상 완화 효과가 증가해 기존 GPU 대비 최대 201배 향상된 속도와 453배 에너지를 감소할 수 있었다.

☞ RTL (Registor Transistor Logic): 저항과 트랜지스터로 구성한 컴퓨터에 사용되는 회로

정명수 교수는 "대규모 그래프에 대해 스토리지 근처에서 그래프 기계학습을 고속으로 추론할 뿐만 아니라 에너지 절약에 최적화된 계산형 스토리지 가속 시스템을 확보했다ˮ며 "기존 고성능 가속 시스템을 대체해 초대형 추천시스템, 교통 예측 시스템, 신약 개발 등의 광범위한 실제 응용에 적용될 수 있을 것ˮ이라고 말했다.

한편 이번 연구는 미국 산호세에서 오는 2월에 열릴 스토리지 시스템 분야 최우수 학술대회인 `유즈닉스 패스트(USENIX Conference on File and Storage Technologies, FAST), 2022'에 관련 논문(논문명: Hardware/Software Co-Programmable Framework for Computational SSDs to Accelerate Deep Learning Service on Large-Scale Graphs)으로 발표될 예정이다.

해당 연구는 삼성미래기술육성사업 지원을 받아 진행됐고 자세한 내용은 연구실 웹사이트(http://camelab.org)에서 확인할 수 있다.

2022.01.10 조회수 11636 -

초대규모 그래프 프로세싱 시뮬레이션 기술 개발

우리 대학 연구진이 오늘날 정보통신(IT) 분야에서 광범위하게 사용되는 그래프 타입의 데이터를 실제로 저장하지 않고도 알고리즘을 계산할 수 있는 `그래프 프로세싱 시뮬레이션'이라는 신개념 기술을 세계 최초로 개발하는 데 성공했다. 데이터를 저장할 필요가 없어 1조 개 간선의 초대규모 그래프도 PC 한 대로 처리가 가능하다.

우리 대학 전산학부 김민수 교수 연구팀은 1조 개 간선의 초대규모 그래프에 대해 데이터 저장 없이 알고리즘을 계산할 수 있는 신개념 기술을 세계 최초로 개발했다고 23일 밝혔다.

오늘날 웹, SNS, 인공지능, 블록체인 등의 광범위한 분야들에서 그래프 타입의 데이터에 대한 다양한 알고리즘들의 연구가 매우 중요하다. 그러나 그래프 데이터의 복잡성으로 인해 그 크기가 커질 때 막대한 규모의 컴퓨터 클러스터가 있어야만 알고리즘 계산이 가능하다는 문제가 있다.

김 교수 연구팀은 이를 근본적으로 해결하는 T-GPS(Trillion-scale Graph Processing Simulation)라는 기술을 개발했다. 이 T-GPS 기술은 그래프 데이터를 실제로 디스크에 저장하지 않고도 마치 그래프 데이터가 저장돼 있는 것처럼 알고리즘을 계산할 수 있고, 계산 결과도 실제 저장된 그래프에 대한 알고리즘 계산과 완전히 동일하다는 장점이 있다.

그래프 알고리즘은 그래프 처리 엔진 상에서 개발되고 실행된다. 이는 산업적으로 널리 사용되는 SQL 질의를 데이터베이스 관리 시스템(DBMS) 엔진 상에서 개발하고 실행하는 것과 유사한 방식이다.

지금까지는 그래프 알고리즘을 개발하기 위해 먼저 합성 그래프를 생성 및 저장한 후, 이를 다시 그래프 처리 엔진에서 메모리로 적재해 알고리즘을 계산하는 2단계 방법을 사용했다. 그래프 데이터는 그 복잡성으로 인해 전체를 메모리로 적재하는 것이 요구되며, 그래프의 규모가 커지면 대규모 컴퓨터 클러스터 장비가 있어야만 알고리즘을 개발하고 실행할 수 있다는 커다란 단점이 있었다.

김 교수팀은 합성 그래프와 그래프 처리 엔진 분야에서 국제 최고 권위의 학술대회에 매년 논문을 발표하는 등 세계 최고의 기술력을 보유하고 있으며, 그 기술들을 바탕으로 기존 2단계 방법의 문제를 해결했다.

그래프 데이터상에서 그래프 알고리즘이 계산을 위해 접근하는 부분을 짧은 순간 동안 실시간으로 생성해, 마치 그래프 데이터가 존재하는 것처럼 알고리즘을 계산하는 것이다. 이때 그래프 데이터를 아무렇게 실시간 생성하는 것이 아니라 합성 그래프 모델에 따라 생성하고 저장한 것과 동일하도록 실시간 생성하는 것이 핵심 기술 중 하나다.

또한, 그래프 처리 엔진이 실시간으로 생성되는 그래프를 실제 그래프처럼 인식하고 알고리즘을 완전히 동일하게 계산하도록 엔진을 수정한 것이 또 다른 핵심 기술이다.

김민수 교수 연구팀은 T-GPS 기술을 종래의 2단계 방법과 성능을 비교한 결과, 종래의 2단계 방법이 11대의 컴퓨터로 구성된 클러스터에서 10억 개 간선 규모의 그래프를 계산할 수 있었던 반면, T-GPS 기술은 1대의 컴퓨터에서 1조 개 간선 규모의 그래프를 계산할 수 있어 컴퓨터 자원 대비 10,000배 더 큰 규모의 데이터를 처리를 할 수 있음을 확인했다. 또한, 알고리즘 계산 시간도 최대 43배 더 빠름을 확인했다.

교신저자로 참여한 김민수 교수는 "오늘날 거의 모든 IT 분야에서 그래프 데이터를 활용하고 있는바, 연구팀이 개발한 새로운 기술은 그래프 알고리즘의 개발 규모와 효율을 획기적으로 높일 수 있어 산업적 측면에서 파급 효과가 매우 클 것으로 기대한다ˮ 라고 말했다.

이번 연구에는 김 교수의 제자이자 캐나다 워털루 대학에 박사후 연구원으로 재직 중인 박힘찬 박사가 제1 저자로, 김 교수가 교신저자로 참여했으며 지난 22일 그리스 차니아에서 온라인으로 열린 데이터베이스 분야 최고 국제학술대회 중 하나인 IEEE ICDE에서 발표됐다. (논문명 : Trillion-scale Graph Processing Simulation based on Top-Down Graph Upscaling).

한편, 이 연구는 한국연구재단 선도연구센터 사업 및 중견연구자 지원사업, 과기정통부 IITP SW스타랩 사업의 지원을 받아 수행됐다.

2021.04.23 조회수 27251

초대규모 그래프 프로세싱 시뮬레이션 기술 개발

우리 대학 연구진이 오늘날 정보통신(IT) 분야에서 광범위하게 사용되는 그래프 타입의 데이터를 실제로 저장하지 않고도 알고리즘을 계산할 수 있는 `그래프 프로세싱 시뮬레이션'이라는 신개념 기술을 세계 최초로 개발하는 데 성공했다. 데이터를 저장할 필요가 없어 1조 개 간선의 초대규모 그래프도 PC 한 대로 처리가 가능하다.

우리 대학 전산학부 김민수 교수 연구팀은 1조 개 간선의 초대규모 그래프에 대해 데이터 저장 없이 알고리즘을 계산할 수 있는 신개념 기술을 세계 최초로 개발했다고 23일 밝혔다.

오늘날 웹, SNS, 인공지능, 블록체인 등의 광범위한 분야들에서 그래프 타입의 데이터에 대한 다양한 알고리즘들의 연구가 매우 중요하다. 그러나 그래프 데이터의 복잡성으로 인해 그 크기가 커질 때 막대한 규모의 컴퓨터 클러스터가 있어야만 알고리즘 계산이 가능하다는 문제가 있다.

김 교수 연구팀은 이를 근본적으로 해결하는 T-GPS(Trillion-scale Graph Processing Simulation)라는 기술을 개발했다. 이 T-GPS 기술은 그래프 데이터를 실제로 디스크에 저장하지 않고도 마치 그래프 데이터가 저장돼 있는 것처럼 알고리즘을 계산할 수 있고, 계산 결과도 실제 저장된 그래프에 대한 알고리즘 계산과 완전히 동일하다는 장점이 있다.

그래프 알고리즘은 그래프 처리 엔진 상에서 개발되고 실행된다. 이는 산업적으로 널리 사용되는 SQL 질의를 데이터베이스 관리 시스템(DBMS) 엔진 상에서 개발하고 실행하는 것과 유사한 방식이다.

지금까지는 그래프 알고리즘을 개발하기 위해 먼저 합성 그래프를 생성 및 저장한 후, 이를 다시 그래프 처리 엔진에서 메모리로 적재해 알고리즘을 계산하는 2단계 방법을 사용했다. 그래프 데이터는 그 복잡성으로 인해 전체를 메모리로 적재하는 것이 요구되며, 그래프의 규모가 커지면 대규모 컴퓨터 클러스터 장비가 있어야만 알고리즘을 개발하고 실행할 수 있다는 커다란 단점이 있었다.

김 교수팀은 합성 그래프와 그래프 처리 엔진 분야에서 국제 최고 권위의 학술대회에 매년 논문을 발표하는 등 세계 최고의 기술력을 보유하고 있으며, 그 기술들을 바탕으로 기존 2단계 방법의 문제를 해결했다.

그래프 데이터상에서 그래프 알고리즘이 계산을 위해 접근하는 부분을 짧은 순간 동안 실시간으로 생성해, 마치 그래프 데이터가 존재하는 것처럼 알고리즘을 계산하는 것이다. 이때 그래프 데이터를 아무렇게 실시간 생성하는 것이 아니라 합성 그래프 모델에 따라 생성하고 저장한 것과 동일하도록 실시간 생성하는 것이 핵심 기술 중 하나다.

또한, 그래프 처리 엔진이 실시간으로 생성되는 그래프를 실제 그래프처럼 인식하고 알고리즘을 완전히 동일하게 계산하도록 엔진을 수정한 것이 또 다른 핵심 기술이다.

김민수 교수 연구팀은 T-GPS 기술을 종래의 2단계 방법과 성능을 비교한 결과, 종래의 2단계 방법이 11대의 컴퓨터로 구성된 클러스터에서 10억 개 간선 규모의 그래프를 계산할 수 있었던 반면, T-GPS 기술은 1대의 컴퓨터에서 1조 개 간선 규모의 그래프를 계산할 수 있어 컴퓨터 자원 대비 10,000배 더 큰 규모의 데이터를 처리를 할 수 있음을 확인했다. 또한, 알고리즘 계산 시간도 최대 43배 더 빠름을 확인했다.

교신저자로 참여한 김민수 교수는 "오늘날 거의 모든 IT 분야에서 그래프 데이터를 활용하고 있는바, 연구팀이 개발한 새로운 기술은 그래프 알고리즘의 개발 규모와 효율을 획기적으로 높일 수 있어 산업적 측면에서 파급 효과가 매우 클 것으로 기대한다ˮ 라고 말했다.

이번 연구에는 김 교수의 제자이자 캐나다 워털루 대학에 박사후 연구원으로 재직 중인 박힘찬 박사가 제1 저자로, 김 교수가 교신저자로 참여했으며 지난 22일 그리스 차니아에서 온라인으로 열린 데이터베이스 분야 최고 국제학술대회 중 하나인 IEEE ICDE에서 발표됐다. (논문명 : Trillion-scale Graph Processing Simulation based on Top-Down Graph Upscaling).

한편, 이 연구는 한국연구재단 선도연구센터 사업 및 중견연구자 지원사업, 과기정통부 IITP SW스타랩 사업의 지원을 받아 수행됐다.

2021.04.23 조회수 27251 -

딥러닝으로 소재 합성 가능성 예측 기술 개발

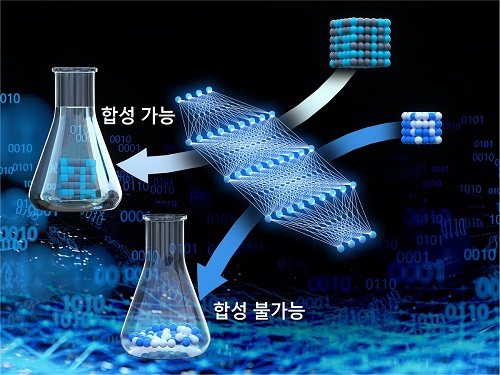

우리 대학 생명화학공학과 정유성 교수 연구팀이 딥러닝을 활용해 소재의 합성 가능성을 높은 정확도로 예측하는 기술을 개발했다고 22일 밝혔다.

신소재 설계의 궁극적인 목표는 소재를 설계하고 그것을 실험적으로 합성하는 것이지만 현실적으로는 새롭게 설계된 대부분의 소재가 실제 합성 단계에서 성공하지 못하고 버려지는 경우가 많다. 이는 불필요한 시간과 자원의 낭비를 초래한다. 소재의 합성 여부는 반응 조건, 열역학, 반응 속도, 소재 구조 등 다양한 요인에 의해서 결정되기 때문에, 소재의 합성 가능성을 예측하는 것은 매우 도전적인 과제로 여겨져 왔다.

이런 문제 해결을 위한 방안으로 간단한 열역학적 안정성만을 고려해 고체 소재의 합성 가능성을 추정하지만 정확도는 매우 떨어지는 편이다. 일례로 에너지적으로 안정된 물질이라 하더라도 합성이 안 되는 경우가 아주 빈번하고, 또 반대로 *준안정 상태의 물질들도 합성되는 경우가 많기 때문이다. 따라서, 합성 가능성에 대한 예측 정확도를 획기적으로 높일 수 있는 방법론의 개발이 시급한 과제로 여겨져 왔다.

☞ 준안정(metastable) 상태 : 어떤 물질이 열역학적으로 안정된 ‘바닥 상태’가 아닌 상태

정유성 교수 연구팀이 개발한 소재 합성 가능성 예측기술은, 기존 합성이 보고된 고체 소재들의 구조적 유사성을 그래프 합성 곱 신경망(GCN, Graph Convolutional Neural Network)으로 학습해 새로운 소재의 합성 가능성을 예측할 수 있다. 특히, 현재까지 합성이 안 된 물질이라 하더라도 합성이 성공할 가능성은 여전히 존재하기 때문에 참값(레이블)을 이미 알고 학습을 진행하는 일반적인 지도학습과는 달리 양의 레이블(+)을 가진 데이터와 레이블이 없는 데이터(Positive-Unlabeled, P-U)를 이용한 분류 모델 기반의 준 지도학습을 사용했다.

정 교수팀은 5만여 종에 달하는 이미 합성이 보고된 물질과 8만여 종의 *가상 물질로 이뤄진 `머터리얼스 프로젝트(Materials Project, MP)'라는 소재 관련 데이터베이스를 이용해 모델을 구축했다. 연구팀 관계자는 이 신기술을 활용한 결과, 소재들의 합성 가능성을 약 87% 정확하게 예측할 수 있다고 설명했다. 정 교수팀은 또 이미 합성된 소재들의 열역학적 특성을 분석한 결과, 열역학적 안정성만으로는 실제 소재의 합성 가능성을 예측할 수 없다는 사실도 알아냈다.

☞ 가상 물질(hypothetical materials) : 기존에 합성되어 보고된 물질들을 원소 치환해서 얻어지는 가상의 물질들로 아직 실험적으로 합성 보고가 이루어지지 않은 물질

이와 함께 머터리얼스 프로젝트(MP) 데이터베이스 내에 합성 가능성 점수가 가장 높은 100개의 가상 물질에 대해 문헌조사를 실시한 결과, 이들 중 머터리얼스 프로젝트(MP) 데이터베이스에는 합성 여부가 아직 알려지지 않았지만 실제로 합성돼 논문에 보고된 소재만도 71개에 달하는 것을 확인했고 이를 통해 모델의 높은 정확도를 추가로 입증했다.

정유성 교수는 "빠른 신소재 발견을 위해 다양한 소재 설계 프레임워크가 존재하지만 정작 설계된 소재의 합성 가능성에 관한 판단은 전문가 직관의 영역으로 남아 있다ˮ면서 "이번에 개발한 합성 가능성 예측 모델은 새로운 소재를 설계할 때 실제로 합성 가능성을 실험 전에 미리 판단할 수 있어 새로운 소재의 개발시간을 단축하는 데 큰 도움이 될 것ˮ이라고 말했다.

생명화학공학과 장지돈 박사과정과 구근호 박사후연구원이 공동 제1 저자로 참여한 이번 연구결과는 미국화학회가 발행하는 국제학술지 미국화학회지(Journal of the American Chemical Society) 온라인 10월 26일 자에 실렸다. (논문명: Structure-Based Synthesizability Prediction of Crystals Using Partially Supervised Learing)

한편 이번 연구는 과학기술정보통신부 산하 한국연구재단의 기초연구사업(중견연구)과 미래소재 디스커버리 사업 지원을 받아 수행됐고, 연구에 KISTI의 슈퍼컴퓨터를 활용했다.

2020.12.22 조회수 54826

딥러닝으로 소재 합성 가능성 예측 기술 개발

우리 대학 생명화학공학과 정유성 교수 연구팀이 딥러닝을 활용해 소재의 합성 가능성을 높은 정확도로 예측하는 기술을 개발했다고 22일 밝혔다.

신소재 설계의 궁극적인 목표는 소재를 설계하고 그것을 실험적으로 합성하는 것이지만 현실적으로는 새롭게 설계된 대부분의 소재가 실제 합성 단계에서 성공하지 못하고 버려지는 경우가 많다. 이는 불필요한 시간과 자원의 낭비를 초래한다. 소재의 합성 여부는 반응 조건, 열역학, 반응 속도, 소재 구조 등 다양한 요인에 의해서 결정되기 때문에, 소재의 합성 가능성을 예측하는 것은 매우 도전적인 과제로 여겨져 왔다.

이런 문제 해결을 위한 방안으로 간단한 열역학적 안정성만을 고려해 고체 소재의 합성 가능성을 추정하지만 정확도는 매우 떨어지는 편이다. 일례로 에너지적으로 안정된 물질이라 하더라도 합성이 안 되는 경우가 아주 빈번하고, 또 반대로 *준안정 상태의 물질들도 합성되는 경우가 많기 때문이다. 따라서, 합성 가능성에 대한 예측 정확도를 획기적으로 높일 수 있는 방법론의 개발이 시급한 과제로 여겨져 왔다.

☞ 준안정(metastable) 상태 : 어떤 물질이 열역학적으로 안정된 ‘바닥 상태’가 아닌 상태

정유성 교수 연구팀이 개발한 소재 합성 가능성 예측기술은, 기존 합성이 보고된 고체 소재들의 구조적 유사성을 그래프 합성 곱 신경망(GCN, Graph Convolutional Neural Network)으로 학습해 새로운 소재의 합성 가능성을 예측할 수 있다. 특히, 현재까지 합성이 안 된 물질이라 하더라도 합성이 성공할 가능성은 여전히 존재하기 때문에 참값(레이블)을 이미 알고 학습을 진행하는 일반적인 지도학습과는 달리 양의 레이블(+)을 가진 데이터와 레이블이 없는 데이터(Positive-Unlabeled, P-U)를 이용한 분류 모델 기반의 준 지도학습을 사용했다.

정 교수팀은 5만여 종에 달하는 이미 합성이 보고된 물질과 8만여 종의 *가상 물질로 이뤄진 `머터리얼스 프로젝트(Materials Project, MP)'라는 소재 관련 데이터베이스를 이용해 모델을 구축했다. 연구팀 관계자는 이 신기술을 활용한 결과, 소재들의 합성 가능성을 약 87% 정확하게 예측할 수 있다고 설명했다. 정 교수팀은 또 이미 합성된 소재들의 열역학적 특성을 분석한 결과, 열역학적 안정성만으로는 실제 소재의 합성 가능성을 예측할 수 없다는 사실도 알아냈다.

☞ 가상 물질(hypothetical materials) : 기존에 합성되어 보고된 물질들을 원소 치환해서 얻어지는 가상의 물질들로 아직 실험적으로 합성 보고가 이루어지지 않은 물질

이와 함께 머터리얼스 프로젝트(MP) 데이터베이스 내에 합성 가능성 점수가 가장 높은 100개의 가상 물질에 대해 문헌조사를 실시한 결과, 이들 중 머터리얼스 프로젝트(MP) 데이터베이스에는 합성 여부가 아직 알려지지 않았지만 실제로 합성돼 논문에 보고된 소재만도 71개에 달하는 것을 확인했고 이를 통해 모델의 높은 정확도를 추가로 입증했다.

정유성 교수는 "빠른 신소재 발견을 위해 다양한 소재 설계 프레임워크가 존재하지만 정작 설계된 소재의 합성 가능성에 관한 판단은 전문가 직관의 영역으로 남아 있다ˮ면서 "이번에 개발한 합성 가능성 예측 모델은 새로운 소재를 설계할 때 실제로 합성 가능성을 실험 전에 미리 판단할 수 있어 새로운 소재의 개발시간을 단축하는 데 큰 도움이 될 것ˮ이라고 말했다.

생명화학공학과 장지돈 박사과정과 구근호 박사후연구원이 공동 제1 저자로 참여한 이번 연구결과는 미국화학회가 발행하는 국제학술지 미국화학회지(Journal of the American Chemical Society) 온라인 10월 26일 자에 실렸다. (논문명: Structure-Based Synthesizability Prediction of Crystals Using Partially Supervised Learing)

한편 이번 연구는 과학기술정보통신부 산하 한국연구재단의 기초연구사업(중견연구)과 미래소재 디스커버리 사업 지원을 받아 수행됐고, 연구에 KISTI의 슈퍼컴퓨터를 활용했다.

2020.12.22 조회수 54826 -

조광현 교수, 뇌의 제어구조 규명

〈 조광현 교수 연구팀 〉

우리 대학 바이오및뇌공학과 조광현 교수 연구팀이 뇌 영역 간 복잡한 연결 네트워크에 내재된 뇌의 제어구조를 규명했다.

이번 연구를 통해 뇌의 동작 원리에 대한 이해를 높이고, 뇌의 제어구조 분석을 통해 뇌 질환 연구 및 치료에 응용될 수 있을 것으로 기대된다. 또한 4차 산업혁명의 핵심기술로 주목받는 IT와 BT의 융합연구인 시스템생물학을 통해 규명했다는 의의가 있다.

이병욱 박사, 강의룡, 장홍준 박사과정이 참여한 이번 연구는 셀(Cell) 출판사가 펴내는 융합과학 국제학술지 ‘아이사이언스(iScience)’ 3월 29일 자에 게재됐다.

뇌의 다양한 인지기능은 뇌 영역들 사이의 복잡한 연결을 통한 영역 간 상호작용으로 이뤄진다. 최근 뇌의 연결성에 대한 정보가 뇌의 동작 원리를 파악하는 핵심이라는 의견이 대두되면서 세계적으로 뇌 연결성을 파악하기 위한 커넥톰(Connectome) 연구가 활발히 이뤄지고 있다.

이를 통해 뇌 영역 사이의 구체적 연결성이 파악되고 있지만 복잡한 연결성에 내재된 뇌의 동작 원리에 대한 이해는 아직 매우 부족한 상황이다. 특히 뇌의 강건하면서 효율적 정보처리 능력의 기반이 되는 뇌의 숨겨진 제어구조는 파악된 내용이 없다.

조 교수 연구팀은 뇌의 제어구조 분석을 위해 ‘미국국립보건원(NIH) 휴먼 커넥톰 프로젝트(Human Connectome Project)’에서 제공하는 정상인의 뇌 영상 이미지 데이터를 활용해 뇌 영영 간 네트워크를 구축했다.

이후 연구팀은 그래프 이론의 최소지배집합(minimum dominating set) 개념을 활용해 뇌 영역 간 복잡한 연결 네트워크의 제어구조를 분석했다.

최소지배집합이란 네트워크의 각 노드(뇌의 각 영역)가 링크(뇌의 서로 다른 영역간의 연결)로 연결된 이웃 노드에 직접적 영향을 줘 기능을 제어할 수 있다고 가정할 때, 네트워크를 구성하는 모든 노드를 제어하는 데 필요한 최소한의 노드 집합을 말한다.

기존 여러 연구를 통해 다양한 생체 네트워크 및 통신망, 전력망 등의 복잡계 네트워크를 제어하는 데 있어서 최소지배집합이 핵심적인 역할을 한다는 것이 보고된 바 있다.

연구팀은 최소지배집합을 기반으로 ‘제어영역의 분포(distribution of control)’와 ‘제어영역의 중첩(overlap in control area)’이라는 두 가지 지표를 정의한 뒤 이를 기준으로 총 네 종류의 제어구조를 정의했다.

이후 연구팀은 브레인 네트워크를 비롯해 도로망, 통신망, 소셜 네트워크 등 실존하는 다양한 복잡계 네트워크가 어떤 제어구조를 갖는지 분석했다. 분석 결과 뇌는 다른 대부분 네트워크와는 달리 제어영역이 분산된 동시에 서로 중첩된 특이한 구조로 이뤄짐을 밝혀냈다.

뇌의 이러한 제어구조는 외부 섭동에 의한 네트워크의 높은 강건성을 유지하면서 동시에 여러 인지기능을 효율적으로 수행하기 위한 영역들의 상호 활성화를 다양하게 하기 위한 것임을 밝혔다.

IT와 BT가 융합된 시스템생물학 접근을 통한 브레인 네트워크의 구조분석은 인공지능의 발전에도 기여할 것으로 보인다. 브레인 네트워크의 진화적 설계원리에 대한 이해를 높인다면 컴퓨터 과학자들이 이를 이용해 새로운 인공지능 기술을 개발할 수 있다.

조 교수는 “지금껏 뇌의 제어구조가 밝혀진 바가 없었다”라며 “복잡한 연결성에 숨겨진 브레인 네트워크의 진화적 설계원리를 시스템생물학 연구를 통해 찾아냄으로써 뇌의 동작 원리를 파악할 수 있는 새로운 가능성을 제시했다”라고 말했다.

이번 연구는 과학기술정보통신부와 한국연구재단의 중견연구자지원사업과 바이오의료기술개발사업의 지원을 받아 수행됐다.

□ 그림 설명

그림1. 뇌의 제어구조 규명

그림2. 뇌 영역 간 네트워크 구축

2019.04.10 조회수 24681

조광현 교수, 뇌의 제어구조 규명

〈 조광현 교수 연구팀 〉

우리 대학 바이오및뇌공학과 조광현 교수 연구팀이 뇌 영역 간 복잡한 연결 네트워크에 내재된 뇌의 제어구조를 규명했다.

이번 연구를 통해 뇌의 동작 원리에 대한 이해를 높이고, 뇌의 제어구조 분석을 통해 뇌 질환 연구 및 치료에 응용될 수 있을 것으로 기대된다. 또한 4차 산업혁명의 핵심기술로 주목받는 IT와 BT의 융합연구인 시스템생물학을 통해 규명했다는 의의가 있다.

이병욱 박사, 강의룡, 장홍준 박사과정이 참여한 이번 연구는 셀(Cell) 출판사가 펴내는 융합과학 국제학술지 ‘아이사이언스(iScience)’ 3월 29일 자에 게재됐다.

뇌의 다양한 인지기능은 뇌 영역들 사이의 복잡한 연결을 통한 영역 간 상호작용으로 이뤄진다. 최근 뇌의 연결성에 대한 정보가 뇌의 동작 원리를 파악하는 핵심이라는 의견이 대두되면서 세계적으로 뇌 연결성을 파악하기 위한 커넥톰(Connectome) 연구가 활발히 이뤄지고 있다.

이를 통해 뇌 영역 사이의 구체적 연결성이 파악되고 있지만 복잡한 연결성에 내재된 뇌의 동작 원리에 대한 이해는 아직 매우 부족한 상황이다. 특히 뇌의 강건하면서 효율적 정보처리 능력의 기반이 되는 뇌의 숨겨진 제어구조는 파악된 내용이 없다.

조 교수 연구팀은 뇌의 제어구조 분석을 위해 ‘미국국립보건원(NIH) 휴먼 커넥톰 프로젝트(Human Connectome Project)’에서 제공하는 정상인의 뇌 영상 이미지 데이터를 활용해 뇌 영영 간 네트워크를 구축했다.

이후 연구팀은 그래프 이론의 최소지배집합(minimum dominating set) 개념을 활용해 뇌 영역 간 복잡한 연결 네트워크의 제어구조를 분석했다.

최소지배집합이란 네트워크의 각 노드(뇌의 각 영역)가 링크(뇌의 서로 다른 영역간의 연결)로 연결된 이웃 노드에 직접적 영향을 줘 기능을 제어할 수 있다고 가정할 때, 네트워크를 구성하는 모든 노드를 제어하는 데 필요한 최소한의 노드 집합을 말한다.

기존 여러 연구를 통해 다양한 생체 네트워크 및 통신망, 전력망 등의 복잡계 네트워크를 제어하는 데 있어서 최소지배집합이 핵심적인 역할을 한다는 것이 보고된 바 있다.

연구팀은 최소지배집합을 기반으로 ‘제어영역의 분포(distribution of control)’와 ‘제어영역의 중첩(overlap in control area)’이라는 두 가지 지표를 정의한 뒤 이를 기준으로 총 네 종류의 제어구조를 정의했다.

이후 연구팀은 브레인 네트워크를 비롯해 도로망, 통신망, 소셜 네트워크 등 실존하는 다양한 복잡계 네트워크가 어떤 제어구조를 갖는지 분석했다. 분석 결과 뇌는 다른 대부분 네트워크와는 달리 제어영역이 분산된 동시에 서로 중첩된 특이한 구조로 이뤄짐을 밝혀냈다.

뇌의 이러한 제어구조는 외부 섭동에 의한 네트워크의 높은 강건성을 유지하면서 동시에 여러 인지기능을 효율적으로 수행하기 위한 영역들의 상호 활성화를 다양하게 하기 위한 것임을 밝혔다.

IT와 BT가 융합된 시스템생물학 접근을 통한 브레인 네트워크의 구조분석은 인공지능의 발전에도 기여할 것으로 보인다. 브레인 네트워크의 진화적 설계원리에 대한 이해를 높인다면 컴퓨터 과학자들이 이를 이용해 새로운 인공지능 기술을 개발할 수 있다.

조 교수는 “지금껏 뇌의 제어구조가 밝혀진 바가 없었다”라며 “복잡한 연결성에 숨겨진 브레인 네트워크의 진화적 설계원리를 시스템생물학 연구를 통해 찾아냄으로써 뇌의 동작 원리를 파악할 수 있는 새로운 가능성을 제시했다”라고 말했다.

이번 연구는 과학기술정보통신부와 한국연구재단의 중견연구자지원사업과 바이오의료기술개발사업의 지원을 받아 수행됐다.

□ 그림 설명

그림1. 뇌의 제어구조 규명

그림2. 뇌 영역 간 네트워크 구축

2019.04.10 조회수 24681 -

엄상일·차미영·김호민 교수, 기초과학연구원(IBS) CI로 선정돼

〈기초과학연구원 CI로 선정된 엄상일·차미영·김호민 교수(왼쪽부터)〉

우리대학 엄상일(42세)·차미영(39세)·김호민(40세) 교수가 최근 기초과학연구원이 출범한 2개 연구단의 연구책임자격인 CI(Chief Investigator)에 선정됐다. 이들은 새로운 형태의 연구단인 'PRC'(Pioneer Research Center)에서 독립적인 연구 그룹을 구성한다.

PRC는 IBS 연구단의 한 종류로, 최대 다섯 명의 CI가 각 연구그룹을 이끌 수 있는데 그룹별로 5년간 10∼15억 원의 연구비가 지원된다. 엄상일·차미영 교수는 수리 및 계산과학 연구단 내의 이산수학 그룹과 데이터 사이언스 연구그룹을 각각 이끈다.

엄상일 교수는 한국인 전공자가 많지 않은 그래프 이론 분야에서 국제적 인지도를 쌓아왔다.

그래프 이론은 컴퓨터와 더불어 발전한 수학의 연구 분야다. 산업 현장에 필요한 효율적인 일정 짜기, 일상에서 흔히 사용되는 내비게이션 최단거리 알고리즘 등에 활용한다.

차미영 교수는 아시아 최초로 페이스북 데이터사이언스팀 초빙교수로 근무한 경력을 갖고 있다. 피인용 지수가 1만1천회(구글 집계 기준)를 넘어서는 등 인지도도 높다. 차 교수는 "빅데이터에 기반을 둔 가짜 뉴스 탐지를 비롯해 중요한 미래예측기술을 개발할 방침"이라고 말했다. 이밖에 김호민 교수는 바이오 분자 및 세포구조 연구단 안에서 연구를 진행한다. 구조 생물학 분야에서 혁신적 성과를 창출해온 김 교수는 단백질 구조와 작동원리를 밝혀 다양한 치료제 후보 물질을 개발하는 데 도전할 방침이다.

2개 연구단이 새롭게 출범함으로써 IBS 연구단은 모두 30개(본원 7개·캠퍼스 14개·외부 9개)로 늘어나게 됐다. 분야별로는 수학 2개, 물리 9개, 화학 6개, 생명과학 7개, 지구과학 1개, 융합 5개 등이다.

2018.12.03 조회수 13534

엄상일·차미영·김호민 교수, 기초과학연구원(IBS) CI로 선정돼

〈기초과학연구원 CI로 선정된 엄상일·차미영·김호민 교수(왼쪽부터)〉

우리대학 엄상일(42세)·차미영(39세)·김호민(40세) 교수가 최근 기초과학연구원이 출범한 2개 연구단의 연구책임자격인 CI(Chief Investigator)에 선정됐다. 이들은 새로운 형태의 연구단인 'PRC'(Pioneer Research Center)에서 독립적인 연구 그룹을 구성한다.

PRC는 IBS 연구단의 한 종류로, 최대 다섯 명의 CI가 각 연구그룹을 이끌 수 있는데 그룹별로 5년간 10∼15억 원의 연구비가 지원된다. 엄상일·차미영 교수는 수리 및 계산과학 연구단 내의 이산수학 그룹과 데이터 사이언스 연구그룹을 각각 이끈다.

엄상일 교수는 한국인 전공자가 많지 않은 그래프 이론 분야에서 국제적 인지도를 쌓아왔다.

그래프 이론은 컴퓨터와 더불어 발전한 수학의 연구 분야다. 산업 현장에 필요한 효율적인 일정 짜기, 일상에서 흔히 사용되는 내비게이션 최단거리 알고리즘 등에 활용한다.

차미영 교수는 아시아 최초로 페이스북 데이터사이언스팀 초빙교수로 근무한 경력을 갖고 있다. 피인용 지수가 1만1천회(구글 집계 기준)를 넘어서는 등 인지도도 높다. 차 교수는 "빅데이터에 기반을 둔 가짜 뉴스 탐지를 비롯해 중요한 미래예측기술을 개발할 방침"이라고 말했다. 이밖에 김호민 교수는 바이오 분자 및 세포구조 연구단 안에서 연구를 진행한다. 구조 생물학 분야에서 혁신적 성과를 창출해온 김 교수는 단백질 구조와 작동원리를 밝혀 다양한 치료제 후보 물질을 개발하는 데 도전할 방침이다.

2개 연구단이 새롭게 출범함으로써 IBS 연구단은 모두 30개(본원 7개·캠퍼스 14개·외부 9개)로 늘어나게 됐다. 분야별로는 수학 2개, 물리 9개, 화학 6개, 생명과학 7개, 지구과학 1개, 융합 5개 등이다.

2018.12.03 조회수 13534 -

투명한 유리벽을 양면 터치 게임 미디어로

- 지난 7월 시그래프 이머징 테크놀로지서 선보여 ‘가장 돋보인 작품’ 선정 -- “투명 디스플레이 패널의 실생활에 적용된 좋은 사례” -

우리 학교 산업디자인학과 이우훈 교수와 전산학과 이기혁 교수 공동연구팀은 투명한 유리의 양면을 터치해 게임을 즐길 수 있는 신개념 게임 미디어 ‘트랜스월(TransWall)’을 개발했다.

이 기술은 지난 7월 21일~25일 미국 애너하임에서 개최된 컴퓨터 그래픽 및 상호작용기술 분야에서 세계적인 학회인 시그래프(SIGGRAPH) 이머징 테크놀로지(Eerging Technologies)에 전시돼 ‘가장 돋보인 작품(Highlight)’으로 선정됐다.

연구팀은 ‘우리 주변의 유리벽을 오락과 커뮤니케이션 매체로 바꿀 수 없을까?’ 라는 생각에서 이번 프로젝트를 시작했다.

‘트랜스월’은 멀티터치가 가능한 두 장의 유리 사이에 홀로그래픽 스크린 필름을 삽입하고 양쪽에서 빔 프로젝터로 유리에 영상을 투영하는 방식이다. 또 유리에 서피스 트랜스듀서(Surface Transducer)를 부착해 터치하면 화면을 통해 직접 소리와 진동을 느낄 수 있다.

이처럼 ‘트랜스월’은 단순한 유리벽처럼 보이지만 사용자들은 시각, 청각, 촉각 정보를 주고받을 수 있는 다감각적 미디어다.

테마파크, 대형 쇼핑몰, 지하철 역사 등과 같은 공공장소에 설치하면 기다리는 지루한 시간에 양쪽에서 콘텐츠를 조작해 게임을 즐길 수 있다.

이와 함께 향후 이러한 양면 터치 상호작용 방식의 장점을 활용하는 다양한 문화적 콘텐츠 개발도 가능할 것으로 전망된다.

이우훈 교수는 “사람들에게 새로운 경험을 제공하는 오락과 소통의 미디어로서 트랜스월을 개발했다”며 “양면 터치 상호작용 방식을 통해 가까운 미래에 상용화될 대형 투명 디스플레이 패널이 실생활에 어떻게 활용될 수 있을지에 대한 하나의 비전을 보여주는 사례”라고 연구의 의의를 밝혔다.

https://vimeo.com/70391422 (트랜스월 소개 동영상)https://vimeo.com/71718874 (SIGGRAPH 2013 전시장면)

□ 그림설명

그림1.트랜스월의 구조

그림2. 트랜스월 옆면

그림3. 유리벽의 양쪽 면을 터치해 게임 등 다양한 미디어로 활용할 수 있다.

그림4. 트랜스월이 시그래프 이머징 테크놀로지에 전시돼 참가자들로부터 뜨거운 관심을 받고 있다

2013.09.12 조회수 17603

투명한 유리벽을 양면 터치 게임 미디어로

- 지난 7월 시그래프 이머징 테크놀로지서 선보여 ‘가장 돋보인 작품’ 선정 -- “투명 디스플레이 패널의 실생활에 적용된 좋은 사례” -

우리 학교 산업디자인학과 이우훈 교수와 전산학과 이기혁 교수 공동연구팀은 투명한 유리의 양면을 터치해 게임을 즐길 수 있는 신개념 게임 미디어 ‘트랜스월(TransWall)’을 개발했다.

이 기술은 지난 7월 21일~25일 미국 애너하임에서 개최된 컴퓨터 그래픽 및 상호작용기술 분야에서 세계적인 학회인 시그래프(SIGGRAPH) 이머징 테크놀로지(Eerging Technologies)에 전시돼 ‘가장 돋보인 작품(Highlight)’으로 선정됐다.

연구팀은 ‘우리 주변의 유리벽을 오락과 커뮤니케이션 매체로 바꿀 수 없을까?’ 라는 생각에서 이번 프로젝트를 시작했다.

‘트랜스월’은 멀티터치가 가능한 두 장의 유리 사이에 홀로그래픽 스크린 필름을 삽입하고 양쪽에서 빔 프로젝터로 유리에 영상을 투영하는 방식이다. 또 유리에 서피스 트랜스듀서(Surface Transducer)를 부착해 터치하면 화면을 통해 직접 소리와 진동을 느낄 수 있다.

이처럼 ‘트랜스월’은 단순한 유리벽처럼 보이지만 사용자들은 시각, 청각, 촉각 정보를 주고받을 수 있는 다감각적 미디어다.

테마파크, 대형 쇼핑몰, 지하철 역사 등과 같은 공공장소에 설치하면 기다리는 지루한 시간에 양쪽에서 콘텐츠를 조작해 게임을 즐길 수 있다.

이와 함께 향후 이러한 양면 터치 상호작용 방식의 장점을 활용하는 다양한 문화적 콘텐츠 개발도 가능할 것으로 전망된다.

이우훈 교수는 “사람들에게 새로운 경험을 제공하는 오락과 소통의 미디어로서 트랜스월을 개발했다”며 “양면 터치 상호작용 방식을 통해 가까운 미래에 상용화될 대형 투명 디스플레이 패널이 실생활에 어떻게 활용될 수 있을지에 대한 하나의 비전을 보여주는 사례”라고 연구의 의의를 밝혔다.

https://vimeo.com/70391422 (트랜스월 소개 동영상)https://vimeo.com/71718874 (SIGGRAPH 2013 전시장면)

□ 그림설명

그림1.트랜스월의 구조

그림2. 트랜스월 옆면

그림3. 유리벽의 양쪽 면을 터치해 게임 등 다양한 미디어로 활용할 수 있다.

그림4. 트랜스월이 시그래프 이머징 테크놀로지에 전시돼 참가자들로부터 뜨거운 관심을 받고 있다

2013.09.12 조회수 17603