연구

< 사진 1. (왼쪽부터) 기계공학과 윤국진 교수, 김태우 박사과정 >

비디오 보간은 비디오 사이의 새로운 프레임을 생성하여 프레임률을 높이고 비디오 내 부드러운 모션을 구현하는 기술이다. 전 세계적으로 많은 연구진이 RGB 카메라만을 사용하여 비디오 보간을 수행하였다. 하지만, 프레임 사이의 움직임 정보의 부재로 인하여 복잡한 상황에서 비디오 보간 성능의 한계를 지닌다. 특히, 현실적인 상황에서 발생하는 비선형적인 움직임에 대해서는 비디오 보간 성능이 크게 하락하는 문제점이 존재한다.

우리 대학 기계공학과 윤국진 교수팀은 인간의 시신경을 모방한 이벤트 카메라와 RGB 카메라를 동시에 사용할 수 있는 하이브리드 카메라 시스템을 구축하고 세계 최고 수준의 이벤트 카메라 기반 초고속 비디오 보간 기술을 개발했다. 본 연구는 기존의 비디오 보간 방법 대비 35% 이상의 세계 최고 성능을 달성하였고, 복잡하고 극심한 움직임 속에서도 높은 성능으로 30FPS 비디오를 10000FPS 이상의 초고속 비디오로 합성할 수 있다.

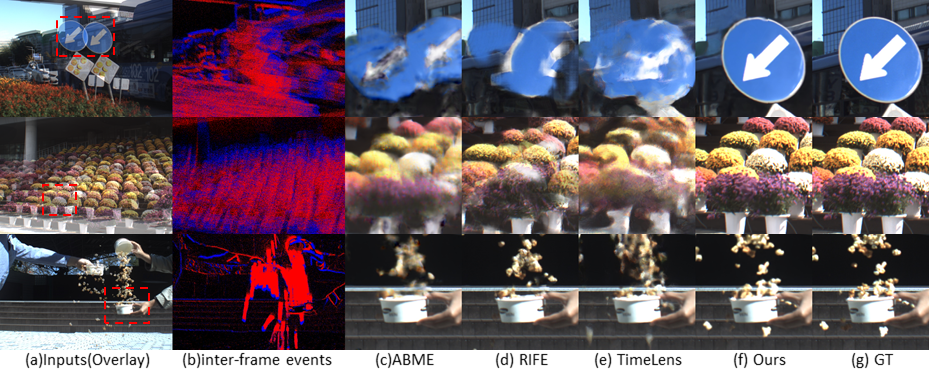

< 그림 1. 제안된 방법의 정성적 평가결과 예시 >

이벤트 카메라는 인간의 시신경을 모방한 카메라로서, 영상의 밝기 변화만을 감지한다. 이러한 특성으로 인하여 이벤트 카메라는 micro 초 단위의 시간 해상도와 높은 dynamic range의 정보를 제공하여 기존의 RGB 카메라가 가지지 못하는 장점을 가지고 있다. 따라서, 이벤트 카메라는 RGB video 프레임 사이의 정확한 움직임 정보를 포착할 수 있어 일반 RGB 카메라와 이벤트 카메라를 동시적으로 사용하면 정확도 높은 초고속 비디오를 생성할 수 있다.

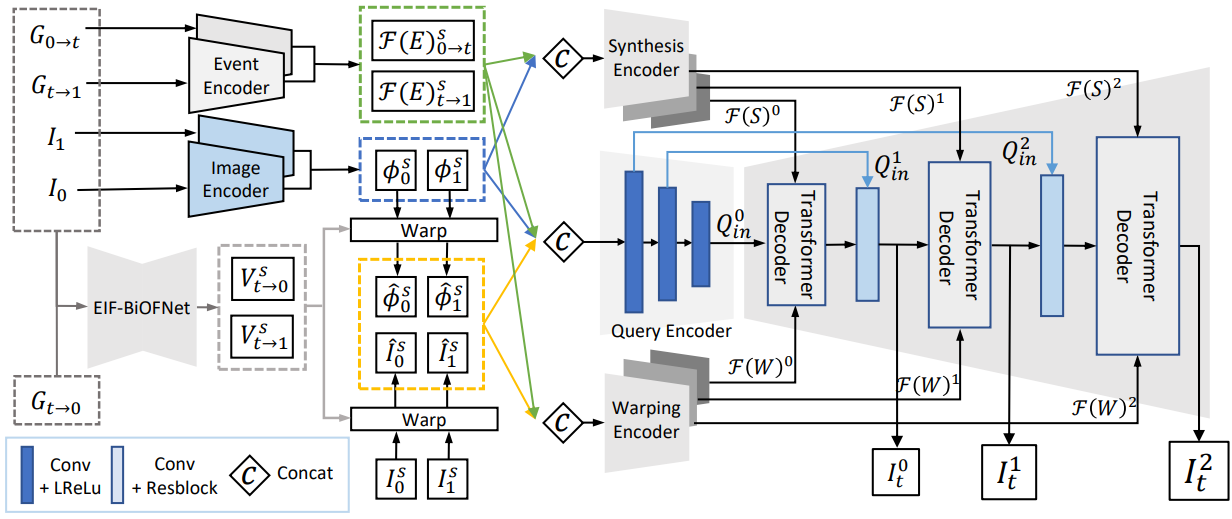

기존의 이벤트 카메라 기반 비디오 보간 연구는 이벤트 카메라에서 나오는 이벤트 정보만을 사용하여 프레임 사이의 광학 흐름을 추정하거나 프레임 사이의 움직임을 근사하는 방법을 사용하였다. 하지만, 이벤트 정보는 공간적으로 희박하고 밝기 정보만을 기록하기 때문에 이벤트만을 사용한 광학 흐름 추정 방법의 결과가 좋지 못한 점을 연구팀은 주목했다. 이를 극복하기 위해 연구팀은 기존의 RGB 이미지와 이벤트 정보를 동시적으로 사용하는 이미지-이벤트 비대칭 양방향 움직임 추정 기법을 제안하였다. 이벤트는 풍부한 움직임의 궤적정보를 제공하는 장점과 이미지의 풍부한 시각 정보의 각 장점을 잘 융합하여 서로 다른 정보의 장단점을 보완 및 융합한 광학 흐름 추정 방법을 제안하여 그 우수성을 입증하였다.

< 그림 2. 개발한 비디오 보간 프레임워크 모식도 >

또한, 설계 및 제작한 빔 스플리터 기반 이벤트-RGB 하이브리드 카메라 시스템을 사용하여 이벤트 카메라를 이용한 모션-기반 비디오 보간 기술 데이터셋을 구축하였다. 기존의 이벤트 카메라를 이용한 비디오 보간 데이터셋의 경우, 카메라 움직임이 존재하지 않는 문제와 낮은 프레임 레이트/해상도로 인하여 딥러닝 알고리즘의 학습 및 이벤트 카메라 기반 비디오 보간 기술 개발 및 평가에 한계점을 지닌다. 제안된 데이터셋의 경우 이벤트 카메라 기반 비디오 향상 연구 커뮤니티에 큰 기여를 할 수 있을 것으로 예상된다.

< 그림 3. 이벤트-RGB 카메라 비디오 보간 데이터셋 예시 >

이번 연구는 고품질의 높은 프레임률을 가지는 비디오 생성이 가능하여, 기존의 초고속 카메라로 비디오 촬영이 어려운 광량이 부족한 환경 및 아주 빠른 물체의 움직임을 분석이 필요한 여러 상황 등에서 널리 사용될 수 있을 것으로 기대된다.

이번 연구는 윤국진 교수 연구실의 김태우 박사과정(제1 저자), 채유정 박사과정(제2 저자), 장현걸 석사과정(제3 저자)이 참여하였고, 올해 캐나다 밴쿠버에서 6월 18일에 열릴 컴퓨터 비전 및 패턴인식 분야의 국제 저명학술지인 CVPR 2023(IEEE Conference on Computer Vision and Pattern Recognition)에 highlight 논문(2.5% acceptance rate)으로 게재될 예정이다.

이 연구는 중견 연구자개발 과제의 지원을 받아 수행되었다. 윤국진 교수 연구팀은 다년간 이벤트 카메라에 관련된 연구를 수행해오면서 이벤트 카메라를 이용한 여러 가지 컴퓨터 비전 분야에 핵심 연구 들을 수행하여 오고 있으며, 앞으로도 이벤트 카메라 연구 커뮤니티에 이바지하기 위하여 지속적인 연구를 수행할 예정이다.

※ 논문명 : Event-based Video Frame Interpolation with Cross-Modal Asymmetric Bidirectional Motion Fields

※ 저자 정보 : 윤국진 (KAIST, 교신저자), 김태우(KAIST, 제1 저자), 채유정(KAIST, 제2 저자), 장현걸(KAIST, 제3 저자) - 총 4명

- No Data