연구

< 사진 1. 전산학부 안성진 교수 >

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스(Rutgers) 대학교와 공동연구를 통해 사람의 라벨링 없이 스스로 영상 속 객체를 식별할 수 있는 인공지능 기술을 개발했다고 1일 밝혔다. 이 모델은 복잡한 영상에서 각 장면의 객체들에 대한 명시적인 라벨링 없이도 객체를 식별하는 최초의 인공지능 모델이다.

기계가 주변 환경을 지능적으로 인지하고 추론하기 위해서는 시각적 장면을 구성하는 객체들과 그들의 관계를 파악하는 능력이 필수적이다. 하지만 이 분야의 연구는 대부분 영상의 각 픽셀에 대응하는 객체의 라벨을 사람이 일일이 표시해야 하는 지도적 학습 방식을 사용했다. 이 같은 수작업은 오류가 발생하기 쉽고 많은 시간과 비용을 요구한다는 단점이 있다.

이에 반해 이번에 연구팀이 개발한 기술은 인간과 유사하게 환경에 대한 관측만으로 객체의 개념을 스스로 자가 학습하는 방식을 취한다. 이렇게 인간의 지도 없이 스스로 객체의 개념을 학습할 수 있는 인공지능은 차세대 인지 기술의 핵심으로 기대돼왔다.

비지도 학습을 이용한 이전 연구들은 단순한 객체 형태와 배경이 명확히 구분될 수 있는 단순한 장면에서만 객체를 식별하는 단점이 있었다. 이와 달리 이번에 안성진 교수 연구팀이 개발한 기술은 복잡한 형태의 많은 객체가 존재하는 사실적인 장면에도 적용될 수 있는 최초의 모델이다.

이 연구는 그림 인공지능 소프트웨어인 DALL-E와 같이 텍스트 입력을 통해 사실적인 이미지를 생성할 수 있는 이미지 생성 연구에서 영감을 얻었다. 연구팀은 텍스트를 입력하는 대신, 모델이 장면에서 객체를 감지하고 그 객체의 표상(representation)으로부터 이미지를 생성하는 방식으로 모델을 학습시켰다. 또한, 모델에 DALL-E와 유사한 트랜스포머 디코더를 사용하는 것이 사실적이고 복잡한 영상을 처리할 수 있게 한 주요 요인이라고 밝혔다.

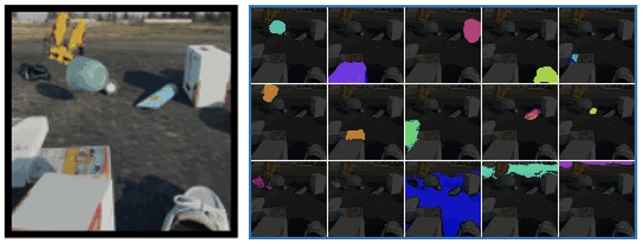

< 그림 1. 안성진 교수 연구팀이 개발한 기술이 복잡한 상황에서 객체의 개념을 스스로 학습하는 장면 >

연구팀은 복잡하고 정제되지 않은 영상뿐만 아니라, 많은 물고기가 있는 수족관과 교통이 혼잡한 도로의 상황을 담은 유튜브 영상과 같이 복잡한 실제 영상에서도 모델의 성능을 측정했다. 그 결과, 제시된 모델이 기존 모델보다 객체를 훨씬 더 정확하게 분할하고 일반화하는 것을 확인할 수 있었다.

연구팀을 이끈 안성진 교수는 "인간과 유사한 자가 학습 방식으로 상황을 인지하고 해석하는 혁신적인 기술ˮ이라며 "시각적 상황인지 능력을 획기적으로 개선해 지능형 로봇 분야, 자율 주행 분야뿐만 아니라 시각적 인공지능 기술 전반에 비용 절감과 성능향상을 가져올 수 있다ˮ고 말했다.

이번 연구는 미국 뉴올리언스에서 지난 11월 28일부터 개최되어 12월 9일까지 진행 예정인 세계 최고 수준의 기계학습(머신러닝) 학회인 제36회 신경정보처리학회(NeurIPS)에서 발표됐다.

-

연구 고온 실험 없이 AI로 '최적 합금' 예측 시대 연다

자동차와 기계 부품 등에 사용되는 강철 합금은 일반적으로 고온에서 녹이는(융해) 공정을 거쳐 제조된다. 이때 성분이 변하지 않고 그대로 녹는 현상을 ‘합치 융해(congruent melting)’라고 한다. 우리 연구진은 이처럼 고온 실험을 통해서만 가능했던 합금의 융해 특성을 인공지능(AI)으로 해결했다. 이번 연구는 고질적인 난제였던 합금이 녹을 때 서로 얼마나 잘 섞이는지를 미리 예측함으로써, 미래 합금 개발의 방향성을 제시한다는 점에서 주목받고 있다. 우리 대학 신소재공학과 홍승범 교수 연구팀이 미국 노스웨스턴대 크리스 울버튼(Chris Wolverton) 교수팀과 국제 공동연구를 통해, 밀도범함수이론(DFT)* 기반의 형성에너지(합금이 얼마나 안정적인지를 나타내는 값) 데이터를 활용해 합금이 녹을 때 성분이 유지되는지를 예측하는 고정확도 머신러닝 모델을 개발했다고 14일 밝혔다. *밀도범함수이론(Density Functional Theory,

2025-07-14 -

연구 최정우 교수팀, 세계 최고 음향 AI 챌린지 세계 1위 쾌거

‘음향 분리 및 분류 기술’은 드론, 공장 배관, 국경 감시 시스템 등에서 이상 음향을 조기에 탐지하거나, AR/VR 콘텐츠 제작 시 공간 음향(Spatial Audio)을 음원별로 분리해 편집할 수 있도록 하는 차세대 인공지능(AI) 핵심 기술이다. 우리 대학 전기및전자공학부 최정우 교수 연구팀이 세계 최고 권위의 음향 탐지 및 분석 대회인 ‘IEEE DCASE 챌린지 2025’에서 ‘공간 의미 기반 음향 장면 분할(Spatial Semantic Segmentation of Sound Scenes)’ 분야에서 우승을 차지했다고 11일 밝혔다. 이번 대회에서 연구팀은 전 세계 86개 참가팀과 총 6개 분야에서 경쟁 끝에 최초 참가임에도 세계 1위 성과를 거두었다. KAIST 최정우 교수 연구팀은 이동헌 박사, 권영후 석박통합과정생, 김도환 석사과정생으로 구성되었다. 연구팀이 참가한 ‘공간 의미 기

2025-07-11 -

연구 AI로 방사성 오염 '아이오딘' 제거용 최적 신소재 발굴

원자력 에너지 활용에 있어 방사성 폐기물 관리는 핵심적인 과제 중 하나다. 특히 방사성 ‘아이오딘(요오드)’는 반감기가 길고(I-129의 경우 1,570만 년), 이동성 및 생체 유독성이 높아 환경 및 인체에 심각한 위험을 초래할 수 있다. 한국 연구진이 인공지능을 활용해 아이오딘을 제거할 원자력 환경 정화용 신소재 발굴에 성공했다. 연구팀은 향후 방사성 오염 흡착용 분말부터 오염수 처리 필터까지 다양한 산학협력을 통해 상용화를 추진할 예정이다. 우리 대학 원자력및양자공학과 류호진 교수 연구팀이 한국화학연구원 디지털화학연구센터 노주환 박사가 협력하여, 인공지능을 활용해 방사성 오염 물질이 될 수 있는 아이오딘을 효과적으로 제거하는 신소재를 발굴하는 기술을 개발했다고 2일 밝혔다. 최근 보고에 따르면 방사능 오염 물질인 아이오딘이 수용액 환경에서 아이오딘산염(IO3-) 형태로 존재하는 것으로 밝혀졌으나, 기존의 은 기반 흡착제는 이에 대해 낮은 화학적

2025-07-02 -

연구 기계공학과 윤국진 교수 연구팀, 세계 최고 권위 컴퓨터비전 국제학술대회 ICCV 2025에 논문 12편 채택

우리 대학 기계공학과 윤국진 교수 연구팀의 논문 12편이 세계 최고 권위 컴퓨터비전 국제 학술 대회 중 하나인 IEEE/CVF International Conference on Computer Vision 2025(ICCV 2025)에 채택되어, 연구팀의 독보적인 연구 역량을 다시 한번 국제적으로 인정받았다. ICCV는 CVPR, ECCV와 함께 컴퓨터비전 및 인공지능 분야에서 가장 영향력 있는 국제 학술대회 중 하나로, 1987년부터 격년으로 개최되어 왔다. 이번 ICCV 2025에는 총 11,152편의 논문이 제출되었고, 이 중 2,698편이 채택되어 약 24.19%의 낮은 채택률을 기록하였다. 학술대회에 제출할 수 있는 논문 편수에 대한 제한이 있음에도 불구하고 단일 연구실에서 12편의 논문이 동시 채택되는 것은 매우 드문 성과다. 윤국진 교수 연구팀은 학습 기반의 시각 지능 구현을 목표로 연구를 진행하고 있으며, 이번에 발표된 12편의 논문들은 3D 객체 탐지 및

2025-06-30 -

연구 이산화탄소만 잡아내는 유망 소재를 AI로 쉽게 찾는다

기후 위기를 막기 위해 이미 배출된 이산화탄소를 적극적으로 줄이는 것이 필수적이며, 이를 위해 공기 중 이산화탄소만 직접 포집하는 기술(Direct Air Capture, 이하 DAC)이 주목받고 있다. 하지만 공기 중에 존재하는 수증기(H₂O)로 인해 이산화탄소만 효과적으로 포집하는 것이 쉽지 않다. 이 기술의 핵심 소재로 연구되는 금속–유기 구조체(Metal-Organic Frameworks, 이하 MOF)를 활용해 우리 연구진이 AI 기반 기계학습 기술을 적용, MOF 중에서 가장 유망한 탄소 포집 후보 소재들을 찾아내는 데 성공했다. 우리 대학 생명화학공학과 김지한 교수 연구팀이 임페리얼 칼리지 런던(Imperial College London) 연구팀과 공동 연구를 통해 대기 중 이산화탄소 포집에 적합한 MOF를 빠르고 정확하게 선별할 수 있는 기계학습 기반 시뮬레이션 기법을 개발했다고 29일 밝혔다. 복잡한 구조와 분자 간 상호작용의 예측 한계로 인해

2025-06-30