연구

< (왼쪽부터) 물리학과 박용근 교수, 김건 석박사통합과정, 삼성서울병원 이남용 교수 >

우리 대학 물리학과 박용근 교수 연구팀이 홀로그래피 현미경과 인공지능을 이용한 신속 박테리아 병원균 식별 기술을 개발했다고 27일 밝혔다.

병원균의 조기 식별은 감염질환 치료에 필수적이다. 치명적인 상태로 진행되기 전에 감염균에 맞는 효과적인 항생제의 선택과 투여가 가능해지기 때문이다. 하지만 현재의 일상적 병원균 식별은 통상 수일이 소요된다. 이로 인해 감염 초기 식별 결과 없이 실증적인 처방으로 항생제를 투여하는 사례가 빈번하며, 이로 인해 패혈증의 경우 치명률이 50%에 달하며 항생제 남용으로 인한 슈퍼박테리아 문제도 발생한다.

기존 방법으로 병원균 식별이 오래 걸리는 원인은 긴 박테리아 배양 시간이다. 질량 분석기로 대표되는 식별 기술들은 일정량 이상의 박테리아 표본이 확보되어야 균종과 관련된 분자적 신호를 검출할 수 있다. 이로 인해, 환자에서 추출한 시편을 하루 이상 배양해야만 검출이 될 정도의 박테리아 개수가 확보된다.

광학 분야의 저명 학술지인 `빛: 과학과 응용(Light: Science & Applications), (IF = 17.782)'에 게재된 이번 연구(논문명: Rapid species identification of pathogenic bacteria from a minute quantity exploiting three-dimensional quantitative phase imaging and artificial neural network)에서 박용근 교수 연구팀은 3차원 홀로그래피 현미경과 인공지능 알고리즘을 활용해서 단일 세포 수준의 표본으로도 병원균의 균종을 정확히 알아낼 수 있음을 입증했다.

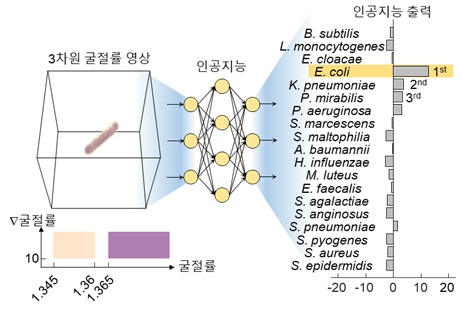

< 그림 1. 아이디어 모식도 >

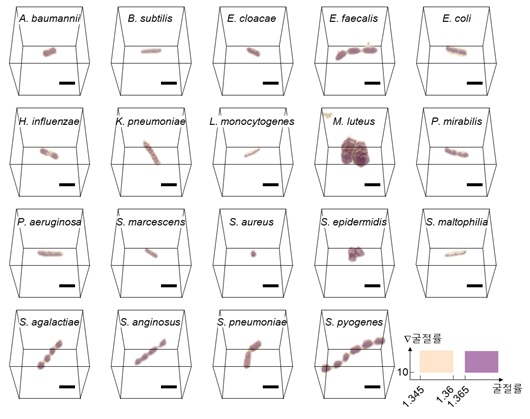

< 그림 2. 총 19가지 주요 혈액감염균의 균종별 대표적인 굴절률 영상 >

홀로그래피 현미경으로 측정되는 3차원 굴절률 영상 정보에 내재된 균종과 관련된 특성을 인공지능 알고리즘으로 학습해 종을 구분하는 것이 핵심 아이디어다. 연구팀은 종별로 500개 이상의 박테리아의 3차원 굴절률 영상을 측정했고, 이를 인공지능 신경망을 통해 학습시켰다.

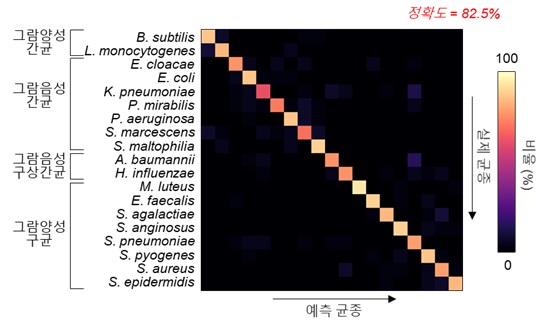

연구팀은 개발한 방법을 이용해 주요한 혈액 감염균을 신속하게 식별함으로써 실제 진단에도 응용될 가능성을 검증했다. 구체적으로 그람 음성 및 양성, 구균 및 간균을 모두 포함한 총 19가지 균종으로 혈액 감염 사례의 90% 이상의 원인이 되는 균들이다. 한 개의 병원균 혹은 병원균 덩어리를 측정한 단일 3차원 굴절률 영상에서는 약 82.5%의 정확도로 균종 판별이 가능했다. 연구팀은 또한 여러 영상을 확보할 수 있을 때 정확도가 증가해, 7개의 박테리아 영상이 확보된다면 99.9%의 정확도를 얻을 수 있었다.

연구진의 책임자이자 논문의 교신저자인 박용근 교수는 "홀로그래피 현미경의 세포 감별 능력을 인공지능으로 극대화해 감염 진단 기술로서의 가능성을 확인한 것이 의미ˮ라고 말했다. 제1 저자인 물리학과 김건 박사과정 학생은 "100,000분의 1 수준의 표본량으로도 질량 분석기의 균종 검출률과 비슷한 정확도를 얻었고 환자 시편에서 다양한 병원균을 식별하는 플랫폼 기술이 될 것으로 기대된다ˮ라고 덧붙였다.

< 그림 3. 19가지 혈액감염균 식별의 단일 영상 기반 맹검 결과 >

< 그림 4. 연구 개념도 >

이번 연구는 KAIST-삼성서울병원-토모큐브 팀의 수년간의 공동 연구를 통해 진행됐다. 물리학과 박용근 교수 연구팀의 기술에 다양한 기관의 경험과 비전을 반영함으로써 완성할 수 있었다. 삼성서울병원 진단검사의학과 이남용 교수, 진단검사의학과 허희재 교수, 감염내과 정두련 교수 연구팀, 서울성모병원 진단검사의학과 유인영 교수, 분당 차병원 응급의학과 김규석 교수, 우리 대학 나노과학기술대학원 정현정 교수 등 다양한 분야와 기관이 모여, 실험적 검증을 효과적으로 진행할 수 있었다. 또한 KAIST 교원 창업 기업인 ㈜토모큐브의 3차원 홀로그래피 기술 지원도 필수적인 역할을 했다.

한편 이번 연구는 한국연구재단 창의연구사업, 과학기술일자리진흥원의 지원을 받아 수행됐다.

-

연구 기계공학과 윤국진 교수 연구팀, 세계 최고 권위 컴퓨터비전 국제학술대회 ICCV 2025에 논문 12편 채택

우리 대학 기계공학과 윤국진 교수 연구팀의 논문 12편이 세계 최고 권위 컴퓨터비전 국제 학술 대회 중 하나인 IEEE/CVF International Conference on Computer Vision 2025(ICCV 2025)에 채택되어, 연구팀의 독보적인 연구 역량을 다시 한번 국제적으로 인정받았다. ICCV는 CVPR, ECCV와 함께 컴퓨터비전 및 인공지능 분야에서 가장 영향력 있는 국제 학술대회 중 하나로, 1987년부터 격년으로 개최되어 왔다. 이번 ICCV 2025에는 총 11,152편의 논문이 제출되었고, 이 중 2,698편이 채택되어 약 24.19%의 낮은 채택률을 기록하였다. 학술대회에 제출할 수 있는 논문 편수에 대한 제한이 있음에도 불구하고 단일 연구실에서 12편의 논문이 동시 채택되는 것은 매우 드문 성과다. 윤국진 교수 연구팀은 학습 기반의 시각 지능 구현을 목표로 연구를 진행하고 있으며, 이번에 발표된 12편의 논문들은 3D 객체 탐지 및

2025-06-30 -

연구 이산화탄소만 잡아내는 유망 소재를 AI로 쉽게 찾는다

기후 위기를 막기 위해 이미 배출된 이산화탄소를 적극적으로 줄이는 것이 필수적이며, 이를 위해 공기 중 이산화탄소만 직접 포집하는 기술(Direct Air Capture, 이하 DAC)이 주목받고 있다. 하지만 공기 중에 존재하는 수증기(H₂O)로 인해 이산화탄소만 효과적으로 포집하는 것이 쉽지 않다. 이 기술의 핵심 소재로 연구되는 금속–유기 구조체(Metal-Organic Frameworks, 이하 MOF)를 활용해 우리 연구진이 AI 기반 기계학습 기술을 적용, MOF 중에서 가장 유망한 탄소 포집 후보 소재들을 찾아내는 데 성공했다. 우리 대학 생명화학공학과 김지한 교수 연구팀이 임페리얼 칼리지 런던(Imperial College London) 연구팀과 공동 연구를 통해 대기 중 이산화탄소 포집에 적합한 MOF를 빠르고 정확하게 선별할 수 있는 기계학습 기반 시뮬레이션 기법을 개발했다고 29일 밝혔다. 복잡한 구조와 분자 간 상호작용의 예측 한계로 인해

2025-06-30 -

행사 G3 AI 강국 위한 인재 양성과 과학기술 혁신 나선다

새 정부 출범과 함께 AI 및 과학기술 분야에 대한 사회적 관심이 크게 높아진 가운데, 우리 대학은 과학기술을 기반으로 국가 혁신을 주도하고 인류의 문제 해결에 앞장서는‘AI 중심 가치 창출형 과학기술특성화대학’으로 거듭날 계획임을 24일 밝혔다. 대한민국이 기술 주도형 사회로 대전환을 맞이하는 시점에서 KAIST는 지난 반세기 동안 국가 발전사의 '스타터킷(Starter Kit)' 역할을 수행해온 경험을 토대로, 단순한 교육·연구기관을 넘어 새로운 사회적 가치를 창출하는 글로벌 혁신 허브로의 도약을 준비하고 있다. 특히 우리 대학은 대한민국이 인공지능 주요 3개국(G3)에 도약할 수 있도록 전 국민이 소외 없이 AI를 활용할 수 있는 'AI 기본사회' 실현을 비전으로 제시했다. 이를 위해 KAIST가 주관하는 대한민국을 대표하는 ‘국가AI연구거점’사업(책임자 김기응)을 통해 AI 기술을 기반으로 산업 경쟁력을 제고하고 사회

2025-06-24 -

연구 21개 화학반응 동시 분석..AI 신약 개발 판 바꾼다

임산부의 입덧 완화 목적으로 사용됐던 약물인 탈리도마이드(Thalidomide)는 생체 내에서는 광학 이성질체*의 특성으로 한쪽 이성질체는 진정 효과를 나타내지만, 다른 쪽은 기형 유발이라는 심각한 부작용을 일으킨다. 이런 예처럼, 신약 개발에서는 원하는 광학 이성질체만을 선택적으로 합성하는 정밀 유기합성 기술이 중요하다. 하지만, 여러 반응물을 동시에 분석하는 것 자체가 어려웠던 기존 방식을 극복하고, 우리 연구진이 세계 최초로 21종의 반응물을 동시에 정밀 분석하는 기술을 개발해, AI와 로봇을 활용하는 신약 개발에 획기적인 기여가 기대된다. *광학 이성질체: 동일한 화학식을 가지며 거울상 관계에 있으면서 서로 겹칠 수 없는 비대칭 구조로 존재하는 분자 쌍을 말한다. 이는 왼손과 오른손처럼 형태는 유사하지만 포개어지지 않는 관계와 유사하다. 우리 대학 화학과 김현우 교수 연구팀이 인공지능 기반 자율합성* 시대에 적합한 혁신적인 광학이성질체 분석 기술을 개발했다고 16일

2025-06-16 -

연구 새벽에도 답해주는 ‘인공지능 조교’ 강의 첫 도입·성공

“처음에는 인공지능 조교(VTA)에 대한 기대가 크지 않았지만, 밤늦게 갑자기 궁금해진 개념을 질문했을 때도 즉각적으로 답을 받을 수 있어서 매우 유용했다”며 “특히 인간 조교에게 질문하기 망설여졌던 부분들도 부담 없이 물어볼 수 있었고, 오히려 더 많이 질문하면서 수업 이해도가 높아졌다”(수강생 양지원 박사과정 학생) 우리 대학 김재철AI대학원 최윤재 교수와 산업디자인학과 홍화정 교수 공동 연구팀이 대형 강의에서도 학생 개개인에게 맞춤형 피드백을 제공할 수 있는 ‘인공지능 조교(Virtual Teaching Assistant, 이하 VTA)’를 개발해 실제 강의에 성공적으로 적용했다고 5일 밝혔다. 이번 연구는 2024년 가을학기 석·박사과정 학생 477명이 수강한 김재철AI대학원의 ‘인공지능을 위한 프로그래밍’ 교과목에 VTA를 도입해, 그 효과와 실용 가능성을 실제 교육

2025-06-05