연구

< (왼쪽부터) 전산학부 김민수 교수, 박힘찬 박사 >

우리 대학 연구진이 오늘날 정보통신(IT) 분야에서 광범위하게 사용되는 그래프 타입의 데이터를 실제로 저장하지 않고도 알고리즘을 계산할 수 있는 `그래프 프로세싱 시뮬레이션'이라는 신개념 기술을 세계 최초로 개발하는 데 성공했다. 데이터를 저장할 필요가 없어 1조 개 간선의 초대규모 그래프도 PC 한 대로 처리가 가능하다.

우리 대학 전산학부 김민수 교수 연구팀은 1조 개 간선의 초대규모 그래프에 대해 데이터 저장 없이 알고리즘을 계산할 수 있는 신개념 기술을 세계 최초로 개발했다고 23일 밝혔다.

오늘날 웹, SNS, 인공지능, 블록체인 등의 광범위한 분야들에서 그래프 타입의 데이터에 대한 다양한 알고리즘들의 연구가 매우 중요하다. 그러나 그래프 데이터의 복잡성으로 인해 그 크기가 커질 때 막대한 규모의 컴퓨터 클러스터가 있어야만 알고리즘 계산이 가능하다는 문제가 있다.

김 교수 연구팀은 이를 근본적으로 해결하는 T-GPS(Trillion-scale Graph Processing Simulation)라는 기술을 개발했다. 이 T-GPS 기술은 그래프 데이터를 실제로 디스크에 저장하지 않고도 마치 그래프 데이터가 저장돼 있는 것처럼 알고리즘을 계산할 수 있고, 계산 결과도 실제 저장된 그래프에 대한 알고리즘 계산과 완전히 동일하다는 장점이 있다.

그래프 알고리즘은 그래프 처리 엔진 상에서 개발되고 실행된다. 이는 산업적으로 널리 사용되는 SQL 질의를 데이터베이스 관리 시스템(DBMS) 엔진 상에서 개발하고 실행하는 것과 유사한 방식이다.

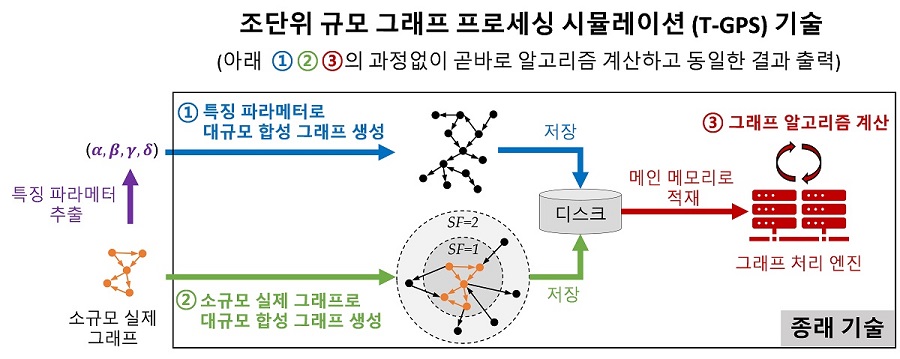

지금까지는 그래프 알고리즘을 개발하기 위해 먼저 합성 그래프를 생성 및 저장한 후, 이를 다시 그래프 처리 엔진에서 메모리로 적재해 알고리즘을 계산하는 2단계 방법을 사용했다. 그래프 데이터는 그 복잡성으로 인해 전체를 메모리로 적재하는 것이 요구되며, 그래프의 규모가 커지면 대규모 컴퓨터 클러스터 장비가 있어야만 알고리즘을 개발하고 실행할 수 있다는 커다란 단점이 있었다.

김 교수팀은 합성 그래프와 그래프 처리 엔진 분야에서 국제 최고 권위의 학술대회에 매년 논문을 발표하는 등 세계 최고의 기술력을 보유하고 있으며, 그 기술들을 바탕으로 기존 2단계 방법의 문제를 해결했다.

그래프 데이터상에서 그래프 알고리즘이 계산을 위해 접근하는 부분을 짧은 순간 동안 실시간으로 생성해, 마치 그래프 데이터가 존재하는 것처럼 알고리즘을 계산하는 것이다. 이때 그래프 데이터를 아무렇게 실시간 생성하는 것이 아니라 합성 그래프 모델에 따라 생성하고 저장한 것과 동일하도록 실시간 생성하는 것이 핵심 기술 중 하나다.

또한, 그래프 처리 엔진이 실시간으로 생성되는 그래프를 실제 그래프처럼 인식하고 알고리즘을 완전히 동일하게 계산하도록 엔진을 수정한 것이 또 다른 핵심 기술이다.

김민수 교수 연구팀은 T-GPS 기술을 종래의 2단계 방법과 성능을 비교한 결과, 종래의 2단계 방법이 11대의 컴퓨터로 구성된 클러스터에서 10억 개 간선 규모의 그래프를 계산할 수 있었던 반면, T-GPS 기술은 1대의 컴퓨터에서 1조 개 간선 규모의 그래프를 계산할 수 있어 컴퓨터 자원 대비 10,000배 더 큰 규모의 데이터를 처리를 할 수 있음을 확인했다. 또한, 알고리즘 계산 시간도 최대 43배 더 빠름을 확인했다.

< 그림 1. 종래의 2단계 방식 기술 개념도 >

교신저자로 참여한 김민수 교수는 "오늘날 거의 모든 IT 분야에서 그래프 데이터를 활용하고 있는바, 연구팀이 개발한 새로운 기술은 그래프 알고리즘의 개발 규모와 효율을 획기적으로 높일 수 있어 산업적 측면에서 파급 효과가 매우 클 것으로 기대한다ˮ 라고 말했다.

이번 연구에는 김 교수의 제자이자 캐나다 워털루 대학에 박사후 연구원으로 재직 중인 박힘찬 박사가 제1 저자로, 김 교수가 교신저자로 참여했으며 지난 22일 그리스 차니아에서 온라인으로 열린 데이터베이스 분야 최고 국제학술대회 중 하나인 IEEE ICDE에서 발표됐다. (논문명 : Trillion-scale Graph Processing Simulation based on Top-Down Graph Upscaling).

한편, 이 연구는 한국연구재단 선도연구센터 사업 및 중견연구자 지원사업, 과기정통부 IITP SW스타랩 사업의 지원을 받아 수행됐다.

-

연구 뉴로모픽 신경망으로 컴퓨팅 난제 해결하다

우리 연구진이 현재 반도체 산업체에서 사용되는 실리콘 소재 및 공정만을 사용해 초소형 진동 신경망을 구축하여 경계선 인식 기능을 구현했으며 난제 중 하나인 그래프 색칠 문제*를 해결했다. *그래프 색칠 문제: 그래프 이론에서 사용되는 용어로, 그래프의 각 정점에 서로 다른 색을 할당해야 하며, 이러한 색깔 구분 문제는 방송국 주파수가 겹쳐 난시청 지역이 발생하지 않도록 주파수를 할당하는 문제 등과도 유사해 다양하게 응용되고 있음 우리 대학 전기및전자공학부 최양규 교수 연구팀이 실리콘 바이리스터 소자로 생물학적 뉴런의 상호작용을 모방한 뉴로모픽 진동 신경망을 개발했다고 3일 밝혔다. 빅데이터 시대가 도래하면서 인공지능 기술이 예전과 비교할 수 없을 만큼 비약적으로 발전하고 있다. 인간의 뇌 기능을 모사하는 뉴로모픽 컴퓨팅 중 하나인 상호 간 결합된 진동 신경망(oscillatory neural network)은 뉴런의 상호작용을 모방한 인공 신경망이다. 진동 신경망은 기

2024-04-03 -

연구 양자 컴퓨터로 새로운 물성 연구 성공

양자 물질을 연구하거나 설계할 때 기존의 폰노이만식 전자컴퓨터를 이용한 계산은 근본적인 한계를 가진다. 양자계의 경우 양자 얽힘 등의 효과로 인해 계산량이 기하급수적으로 증가하기 때문이다. 따라서 양자물질 설계를 위해 물질의 특성을 알아내고자 할 때, 양자컴퓨터를 이용하는 양자 시뮬레이션이 필요하다. 우리 대학 물리학과 안재욱 교수 연구팀이 코펜하겐 대학 클라우스 뭴머(Klaus MØlmer) 교수 연구팀과 함께 양자 시뮬레이션을 수행하는 양자 컴퓨터 플랫폼으로 최근 가장 주목을 받는 리드버그 원자 양자 컴퓨터를 이용해 양자 자성체의 극단적 특성을 구현하는데 성공했다고 11일 밝혔다. 자성체 물질은 하드 디스크와 같은 전자제품을 비롯해 전력 발전 등에도 사용되는 등 현대 기술의 핵심 요소다. 최근에는 상온 자성체를 넘어서 양자적 특성이 두드러지는 초저온에서 양자 자성체 특성에 관한 연구가 활발히 이뤄지고 있다. 초저온에서 수행되는 물성 분석 및 계측 연구는 MRI

2024-03-11 -

인물 산업및시스템공학과 김현정 교수 연구팀, 2023 Winter Simulation Conference, Simulation Challenge 대회 우승

세계 최대 시뮬레이션 학회인 Winter Simulation Conference(2023년 12월 10일 – 13일, San Antonio, USA)에서 주최한 Simulation Challenge 대회에서 우리 대학 산업및시스템공학과 김현정 교수 연구팀이 우승을 차지하였다. 올해 대회는 반도체 생산 기업인 Micron Technology의 후원으로 개최되었으며 시뮬레이션 모델링 및 분석 도구를 사용하여 반도체 제조의 병목 문제를 해결하고 생산성을 향상시키기 위한 스케줄링 알고리즘을 개발하는 것이 목표로 세워졌다. 대회는 2023년 8월부터 11월까지 총 4라운드에 걸쳐 진행되었으며 각 라운드에서는 시나리오에 기반한 반도체 생산 재고(WIP) 최소화와 공정 간 시간 제약 충족을 목표로 하는 시뮬레이션 기반의 스케줄링을 수행하였다. 특히, 마지막 4라운드에서는 시나리오를 사전에 알지 못하는 조건에서도 우수한 스케줄을 도출하는 방법론을 개발하는 것이 도전 과제였다. 대회

2023-12-26 -

연구 화학공장 대체 방안 ‘아이브릿지’에서 찾다

기후 변화와 환경 문제가 심각하게 대두됨에 따라 현재의 화학 공장을 대체할 수 있는 지속가능한 미생물 세포공장이 크게 주목받고 있다. 미생물 세포공장으로 활용할 미생물을 개량하기 위해선 미생물이 가진 유전자들의 발현을 증폭 또는 억제해 유용한 화합물을 생산하도록 미생물 대사 메커니즘을 개량해야 하지만, 어떠한 유전자를 증폭하고 억제할 것인지 결정하는 것은 지금까지 어려운 문제로 남아있다. 우리 대학 이상엽 특훈교수 연구팀이 아이브릿지(iBridge)라는 시뮬레이션 프로그램을 개발하여 생산하고자 하는 화합물에 맞춤형 미생물 공장을 구축할 수 있도록 과발현 및 억제 유전자들을 예측함으로써 미생물 공장을 적은 비용으로 빠르고 효율적으로 구축하는 방법을 제시했다고 9일 밝혔다. 이상엽 특훈교수가 창시한 시스템 대사공학은 유전공학, 합성생물학, 시스템생물학, 발효공학 등을 접목해 개량한 미생물을 이용해 유용한 화합물들을 생산하는 분야다. 미생물을 목표로 하는 유용한 화합물을 생산하

2023-11-09 -

인물 신기정 교수 연구팀, 정보검색 분야 최우수 학술대회 ACM CIKM 2022 튜토리얼 강연

우리 대학 김재철AI대학원 신기정 교수가 이끄는 연구팀이 지난 10월 17일부터 10월 21일까지 미국 애틀랜타에서 진행된 미 컴퓨터협회 정보 및 지식 관리 학술대회(이하 ACM CIKM 2022)에서 튜토리얼 강연을 진행했다고 1일 밝혔다. 올해 31회를 맞은 ACM CIKM은, 정보 검색(Information Retrieval) 분야 세계 최고 권위 학회 중 하나로, 전 세계에서 해당 분야 전문가들이 참석해 최신 연구 성과를 공유한다. ACM CIKM에서는 매년 강연자의 전문성 그리고 강연 주제의 깊이와 다양성 등을 고려해 강연자를 선정해 튜토리얼 강연을 열고 있다. 김재철AI대학원 이건 석박통합과정과 유재민 박사(미국 카네기멜론대학교 박사 후 연구원)로 구성된 신기정 교수 연구팀은 `Mining of Real-world Hypergraphs: Concepts, Patterns, and Generators'라는 제목으로 ACM CIKM 2022 학술대회에서 튜토리얼 강

2022-11-01