행사

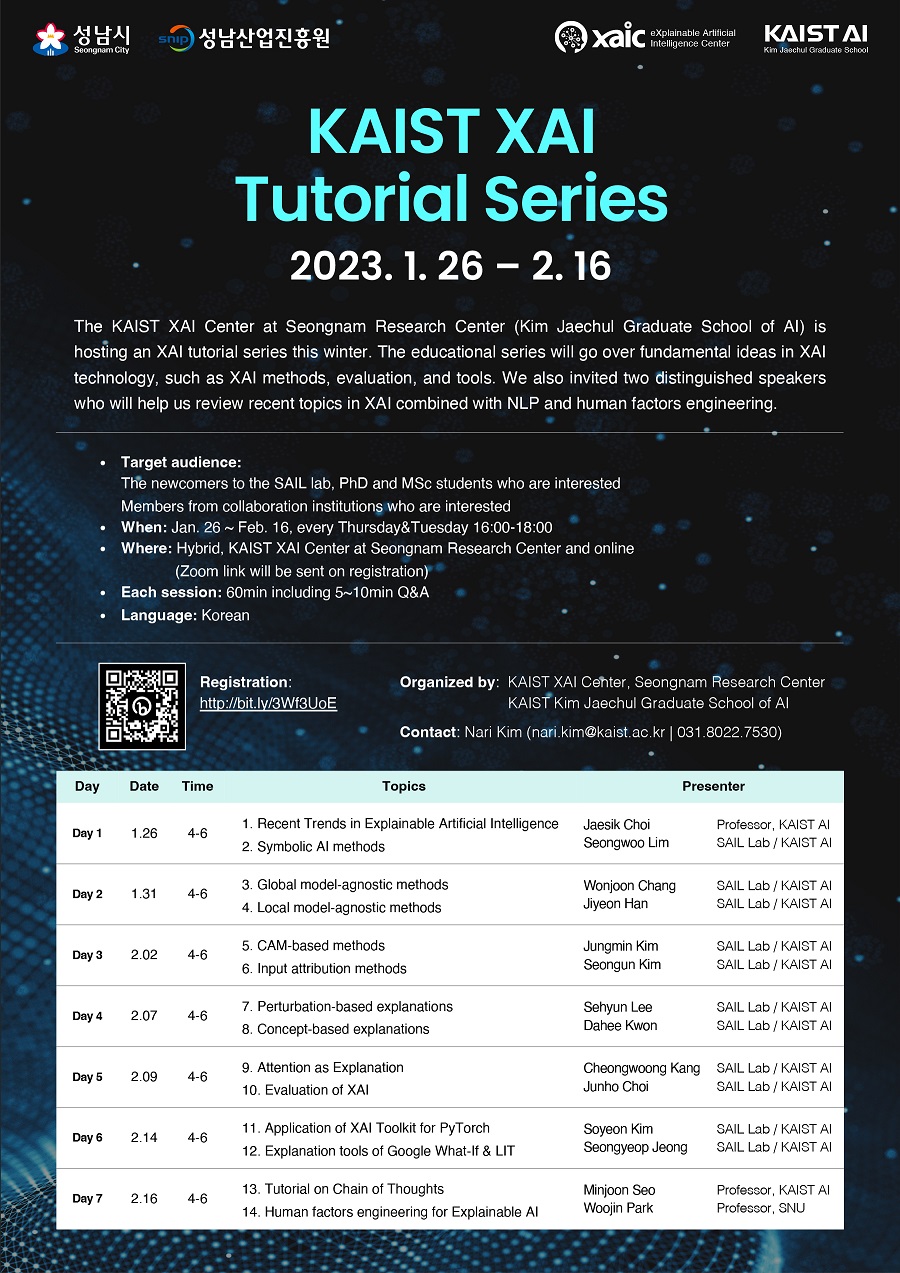

< 설명가능 인공지능 튜토리얼 포스터 >

인공지능(AI) 기술 발전과 활용 분야가 확대되면서 다양한 AI 기반 서비스들이 등장하고 있다. 하지만 실제로는 어떤 원리로 작동하는지 이해하기 어려워 이용자 입장에서는 막연하게 느껴질 때가 많다. 이 같은 상황에서 국내 대표적인 설명가능 인공지능 연구그룹인 KAIST 설명가능 인공지능연구센터 (센터장 최재식 교수) 연구진이 지난 1월 26일부터 2월 16일까지 7회에 걸쳐 ‘설명가능 인공지능 (XAI, Explainable Artificial Intelligence)’ 알고리즘, 평가기법, 툴 등 XAI 분야의 주요 기술을 총망라하여 소개하는 튜토리얼 시리즈를 개최했다. 이 행사에는 관련 분야 연구자뿐만 아니라 AI 기술기반 제품을 개발 중인 기업(성남시 소재) 관계자 약 130여명이 신청하여 XAI에 대해 높아진 관심을 알 수 있었다. 센터장 최재식 교수는 “AI기술을 활용하는 산업에서 필수로 자리잡게 될 XAI 분야 기반 기술에 대한 교육 프로그램을 제공하여 유관 연구기관 및 기업들이 성과를 높이는 데에 기여하고자 한다”고 행사 취지를 밝혔다.

이번 KAIST XAI 튜토리얼 시리즈엔 KAIST 설명가능 인공지능연구센터 소속 석박사과정 연구원 총 11명과 센터장 최재식 교수, 그리고 초청 연사로서 박우진 교수(서울대 산업공학과), 서민준 교수(KAIST 김재철AI대학원) 등 국내외 전문가들이 강연을 담당해 △다양한 XAI 알고리즘 △XAI 알고리즘의 평가기법과 툴 △사용자 중심 XAI 인터페이스 △대규모 언어모델 기반 추론 기술로 최근 주목을 받고 있는 Chain of Thoughts 등을 주제로 발표했다.

‘설명가능 인공지능’이란 기계학습 및 딥러닝 모델이 내놓은 결과에 대해 왜 그런 결과가 나온 것인지를 사람이 이해할 수 있는 방식으로 설명해주는 기술이다. 예를 들어, 자율주행차가 주행 중 장애물을 발견하여 급정거를 했을 때 왜 그런 판단을 했는지 사람에게 설명할 수 있어야 한다. 그래야 사고 위험을 줄일 수 있고 오작동 시 책임 소재도 가릴 수 있다. 최근 딥러닝 알고리즘의 성능이 향상되고 있지만 아직까지는 사용자들이 내부 로직에 대해 이해할 수 있는 설명을 제공하는 기술까지 적용된 사례는 많지 않다. 앞으로 다양한 산업분야에서 인공지능 기술을 도입함에 따라 적용된 AI기술에 대한 신뢰성과 투명성을 담보하기 위해서 반드시 함께 제공되어야 하는 것이 설명가능 인공지능 기술이라고 볼 수 있다.

KAIST 설명가능 인공지능연구센터 (http://xai.kaist.ac.kr)는 사람중심인공지능 핵심원천기술개발(R&D)사업의 일환으로 과학기술정보통신부와 정보통신기획평가원(IITP)의 후원으로 설립된 연구조직으로서 현재 KAIST 김재철AI대학원 성남연구센터에 자리잡고 있다. 튜토리얼 자료와 동영상은 KAIST 설명가능 인공지능연구센터 홈페이지에서 제공될 예정이다. (관련 문의: 김나리 교수(nari.kim@kaist.ac.kr))

-

연구 KAIST 설명가능 인공지능연구센터, 플러그앤플레이 방식의 설명가능 인공지능 프레임워크 공개

KAIST 설명가능 인공지능연구센터(센터장 최재식 교수)는 별도의 복잡한 설정이나 전문 지식 없이도 손쉽게 AI모델에 대한 설명성을 제공할 수 있는 플러그앤플레이(Plug-and-Play) 방식의 설명가능 인공지능 프레임워크를 개발해, 이를 27일 오픈소스로 공개했다. 설명가능 인공지능(Explainable AI, 이하 XAI)이란 AI 시스템의 결과에 영향을 미치는 주요 요소를 사람이 이해할 수 있는 형태로 설명해주는 제반 기술을 말한다. 최근 딥러닝 모델과 같이 내부 의사 결정 프로세스가 불투명한 블랙박스 AI 모델에 대한 의존도가 커지면서 설명가능 인공지능 분야에 대한 관심과 연구가 증가했다. 그러나 지금까지는 연구자와 기업 실무자들이 설명가능 인공지능 기술을 활용하는 것이 몇 가지 이유로 쉽지 않았다. 우선, 딥러닝 모델의 유형별로 적용 가능한 설명 알고리즘들이 서로 달라서 해당 모델에 적용할 수 있는 설명 알고리즘이 무엇인지 알기 위해서는 XAI에 대해 어느 정도 사

2024-12-27 -

행사 KAIST 설명가능 인공지능연구센터, 2024 XAI 튜토리얼 시리즈 성황리 종료

국내 최대의 설명가능 인공지능(XAI) 연구조직인 KAIST 설명가능 인공지능연구센터(센터장 KAIST 최재식 교수)는 11월 5일부터 22일까지 7회에 걸쳐 설명가능 인공지능 튜토리얼 시리즈를 성공적으로 개최했다. 이번 튜토리얼에는 학생, 연구자, 기업 실무자 등 누적인원 총 530여 명이 참여하여 설명가능 인공지능 기술에 대한 높은 관심과 수요를 보여주었다. 행사는 XAI의 주요 알고리즘부터 최신 연구 주제까지, 총 16개 세션 발표로 진행되었다. 개회 강연으로 ‘설명가능 인공지능 최신 연구 동향’에 대해 최재식 교수가 발표하였고, 이어서 KAIST 설명가능 인공지능연구센터 소속 석·박사 과정 연구원들이 △주요 XAI 알고리즘 △XAI 알고리즘의 평가기법 △거대 언어모델(LLM), 이미지 생성모델, 시계열 데이터에 대한 설명성 △ XAI Framework, 의료 도메인 적용 사례를 주제로 발표했다. 튜토리얼 마지막날에는 독일 Fraunho

2024-11-29 -

인물 전우정 교수, 한국 법학자 최초 군사 AI통제 과학적 도전 밝혀

우리 대학 문술미래전략대학원 전우정 교수가 우리나라 법학자 최초로 세계 최고 과학 학술지인 네이처(Nature)의 자매지 ‘네이처 일렉트로닉스(Nature Electronics)'의 코리스판던스(Correspondance) 섹션에 군사 AI 통제의 과학적 도전에 관한 기고문을 게재했다고 8일 밝혔다. 지난 9월 9일부터 10일까지 서울에서 개최된 ‘2024 인공지능(AI)의 책임 있는 군사적 이용에 관한 고위급 회의(REAIM 2024)'에서 군사 AI 거버넌스에 중요한 진전이 이뤄졌다. 우리나라 뿐만 아니라 네덜란드, 싱가포르, 케냐, 영국이 공동 주최국으로 참여한 이 회의에서 미국, 독일, 프랑스, 일본 등 61개국이 ‘행동을 위한 청사진(Blueprint for Action)'을 채택했다. 이후 두 개 국가가 추가로 동참해 현재 총 63개국이 채택하고 있다. 전우정 교수는 이번 기고문에서 군사 분야의 AI 활용에 대한 이러한 원칙들을

2024-11-08 -

행사 KCC 설명가능 인공지능(XAI) 워크숍 2024 개최

우리 대학 설명가능 인공지능연구센터(센터장 최재식)가 'KCC 설명가능 인공지능(XAI) 워크숍 2024'를 지난달 27일 제주 국제컨벤션센터에서 개최했다.올해 3월 EU의 인공지능법이 최종 통과된 후 인공지능 시스템에 대한 글로벌 규제가 현실화 되고 인공지능 모델의 투명성 향상과 규제 준수를 지원할 수 있는 설명가능 인공지능(eXplainable Artificial Intelligence, 약칭 XAI) 기술에 대한 관심이 높아지고 있다. 이와 같은 시대적 흐름에 대응하기 위해 개최된 이번 워크숍에는 관련 분야에서 활발히 연구 중인 국내 연구기관과 기업 관계자들이 교류하며 최신 연구 동향을 공유했다.서홍석 교수(고려대)와 박천음 교수(한밭대)는 각각 '멀티모달 대화형 인공지능 관련 연구 동향'과 'Multimodal Counterfactual reasoning을 이용한 자연어 해석 연구 동향'을 주제로 최근 활발한 연구가 진행 중인 멀티모달 인공지능 모델 연구 및 해석 동향을

2024-07-08 -

연구 설명해주는 인공지능 구현을 위한 초저전력 하드웨어 기술 개발

우리 대학 신소재공학과 김경민 교수 연구팀이 다양한 멤리스터* 소자를 이용한 설명 가능한 인공지능 (XAI) 시스템을 구현하는데 성공했다고 25일 밝혔다. *멤리스터 (Memristor): 메모리 (Memory)와 저항 (Resistor)의 합성어로, 입력 신호에 따라 소자의 저항 상태가 변하는 소자 최근 인공지능 (AI) 기술의 급속한 발전이 다양한 분야에서 성과를 이루고 있다. 이미지 인식, 음성 인식, 자연어 처리 등에서 AI의 적용 범위가 확대되며 우리의 일상생활에 깊숙이 자리 잡고 있다. AI는 인간의 뉴런 구조를 모방해 만든 ‘인공신경망’을 기반으로, 적게는 수백만 개에서 많게는 수조 개에 달하는 매개변수를 통해 데이터를 분석하고 의사 결정을 내린다. 그러나 이 많은 매개변수로 인해 AI 모델의 동작 원리를 정확하게 이해하기 어렵고, 이는 통상적으로 블랙박스에 비유되곤 한다. AI가 어떤 기준으로 결정을 내는지 알 수 없다면, AI에 결함이나

2024-03-25