-

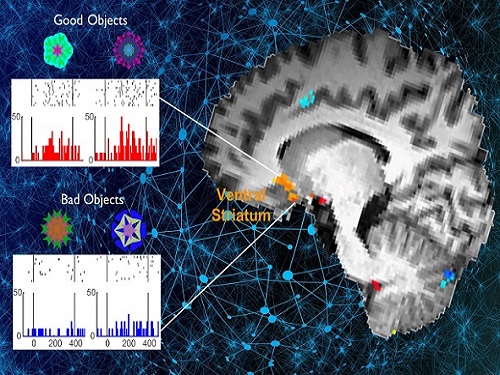

이수현 교수팀, 뇌 복부선조영역의 새로운 기억관련 기능 규명

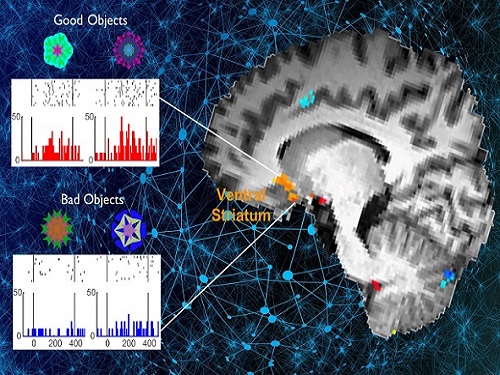

우리 대학 바이오및뇌공학과 이수현 교수 연구팀과 서울대학교 생명과학부 김형 교수 연구팀이 공동연구를 통해 복부선조영역(ventral striatum)에서 습관행동을 제어하는데 필요한 장기기억이 자동적으로 인출된다는 사실을 밝혔다. 이러한 복부선조영역의 기능을 그 영역과 회로별로 규명하는 것은 인간에게 직접 적용할 수 있는 뇌질환 치료방법 개발과 뇌영역 맞춤형 치료의 이론적 기반이 될 수 있다.

뇌의 복부선조영역은 새로운 가치학습에 중요하며, 중독행동과 조현병 관련 행동에도 연관된 것으로 알려져 왔지만 이러한 행동에 기반이 될 수 있는 기억정보를 처리하고 있는지에 대해서는 불분명했다.

이에 연구팀은 기능적 자기공명뇌영상과 전기생리학적 뇌세포 활성측정법을 모두 이용해 과거에 학습한 물체를 의식적으로 인지하고 있지 않는 상황에서도 복부선조에서 과거에 배운 좋은 물체에 대한 장기기억정보가 활발하게 처리되고 있다는 사실을 밝혀냈다.

또한 자동적으로 인출된 좋은 물체에 대한 기억은 무의식적이며 자동적인 행동, 즉 습관행동을 제어하고, 이를 통해 동물이 장기기억을 기반으로 최대이익을 얻을 수 있는 자동적 의사결정(automatic decision-making) 과정에 사용된다는 실험적 증거를 제시했다.

바이오및뇌공학과 뇌인지공학프로그램 강준영 석박사통합과정 학생이 제1 저자로 참여한 이번 연구는 국제학술지 네이쳐 커뮤니케이션즈(Nature Communications)에 4월 8일(목) 게재됐다.

복부선조영역에서 기억의 자동적 인출과정을 이해함으로써 자동적 행동인 습관과 중독행동 제어의 이론적 기반을 다지고, 나아가 기억의 자동인출(automatic retrieval)과 연관된 현저성(salience) 이상으로 조현병을 이해할 수 있는 이론적 발판을 마련한 것에 이번 연구의 의의가 있다고 볼 수 있다.

이번 연구는 한국연구재단 뇌질환극복사업 및 개인기초연구지원사업 등의 지원을 받아 수행됐다.

이수현 교수팀, 뇌 복부선조영역의 새로운 기억관련 기능 규명

우리 대학 바이오및뇌공학과 이수현 교수 연구팀과 서울대학교 생명과학부 김형 교수 연구팀이 공동연구를 통해 복부선조영역(ventral striatum)에서 습관행동을 제어하는데 필요한 장기기억이 자동적으로 인출된다는 사실을 밝혔다. 이러한 복부선조영역의 기능을 그 영역과 회로별로 규명하는 것은 인간에게 직접 적용할 수 있는 뇌질환 치료방법 개발과 뇌영역 맞춤형 치료의 이론적 기반이 될 수 있다.

뇌의 복부선조영역은 새로운 가치학습에 중요하며, 중독행동과 조현병 관련 행동에도 연관된 것으로 알려져 왔지만 이러한 행동에 기반이 될 수 있는 기억정보를 처리하고 있는지에 대해서는 불분명했다.

이에 연구팀은 기능적 자기공명뇌영상과 전기생리학적 뇌세포 활성측정법을 모두 이용해 과거에 학습한 물체를 의식적으로 인지하고 있지 않는 상황에서도 복부선조에서 과거에 배운 좋은 물체에 대한 장기기억정보가 활발하게 처리되고 있다는 사실을 밝혀냈다.

또한 자동적으로 인출된 좋은 물체에 대한 기억은 무의식적이며 자동적인 행동, 즉 습관행동을 제어하고, 이를 통해 동물이 장기기억을 기반으로 최대이익을 얻을 수 있는 자동적 의사결정(automatic decision-making) 과정에 사용된다는 실험적 증거를 제시했다.

바이오및뇌공학과 뇌인지공학프로그램 강준영 석박사통합과정 학생이 제1 저자로 참여한 이번 연구는 국제학술지 네이쳐 커뮤니케이션즈(Nature Communications)에 4월 8일(목) 게재됐다.

복부선조영역에서 기억의 자동적 인출과정을 이해함으로써 자동적 행동인 습관과 중독행동 제어의 이론적 기반을 다지고, 나아가 기억의 자동인출(automatic retrieval)과 연관된 현저성(salience) 이상으로 조현병을 이해할 수 있는 이론적 발판을 마련한 것에 이번 연구의 의의가 있다고 볼 수 있다.

이번 연구는 한국연구재단 뇌질환극복사업 및 개인기초연구지원사업 등의 지원을 받아 수행됐다.

2021.04.09

조회수 73272

-

인공지능으로 3차원 고해상도 나노입자 영상화 기술 개발

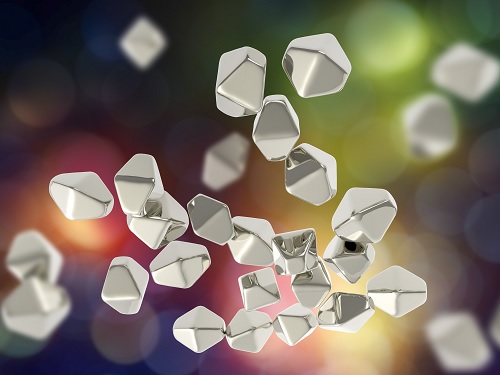

우리 대학 바이오및뇌공학과 예종철 교수 연구팀이 삼성전자 종합기술원과 공동연구를 통해 나노입자의 3차원 형상과 조성 분포의 복원 성능을 획기적으로 향상한 인공지능 기술을 개발했다고 16일 밝혔다. 공동연구팀은 에너지 분산형 X선 분광법(EDX)을 주사 투과전자현미경(STEM)과 결합한 시스템을 활용했다.

이번 연구를 통해 나노입자를 형성하고 있는 물질의 형상과 조성 분포를 정확하게 재구성함으로써, 실제 상용 디스플레이를 구성하는 양자점(퀀텀닷)과 같은 반도체 입자의 정확한 분석에 도움을 줄 것으로 기대된다.

예종철 교수 연구팀의 한요섭 박사, 차은주 박사과정, 정형진 석사과정과 삼성종합기술원의 이은하 전문연구원팀의 장재덕, 이준호 전문연구원이 공동 제1 저자로 참여한 이번 연구 결과는 국제 학술지 `네이처 머신 인텔리전스(Nature Machine Intelligence)' 2월 8일 字 온라인판에 게재됐다. (논문명 : Deep learning STEM-EDX tomography of nanocrystals)

에너지 분산형 X선 분광법(이하 EDX)은 나노입자의 성분 분석에 주로 이용되며, X선과 반응한 물체의 성분에 따라 고유한 방출 스펙트럼을 보인다는 점에서 화학적인 분석이 가능하다. 퀀텀닷 및 배터리 등 다양한 나노 소재의 열화 메커니즘과 결함을 해석하기 위해 형상 및 조성 분포 분석이 가능한 이 분광법의 필요성과 중요도가 급증하고 있다.

그러나 EDX 측정 신호의 해상도를 향상하기 위해, 나노 소재를 오랜 시간 전자빔에 노출하면 소재의 영구적인 피해가 발생한다. 이로 인해 나노입자의 3차원 영상화를 위한 투사(projection) 데이터 획득 시간이 제한되며, 한 각도에서의 스캔 시간을 단축하거나 측정하는 각도를 줄이는 방식이 사용된다. 기존의 방식으로 획득된 투사 데이터를 이용해 3차원 영상을 복원할 시, 미량 존재하는 원자 신호의 측정이 불가능하거나 복원 영상의 정밀도와 해상도가 매우 낮다.

그러나 공동 연구팀이 자체 개발한 인공지능 기반의 커널 회귀(kernel regression)와 투사 데이터 향상(projection enhancement)은 정밀도와 해상도를 획기적으로 발전시켰다. 연구팀은 측정된 데이터의 분포를 네트워크가 스스로 학습하는 인공지능 기반의 커널 회귀를 통해 스캔 시간이 단축된 투사 데이터의 신호 대 잡음비(SNR)를 높인 데이터를 제공하는 네트워크를 개발했다. 그리고 개선된 고화질의 EDX 투사 데이터를 기반으로 기존의 방법으로는 불가능했던 적은 수의 투사 데이터로부터 더욱 정확한 3차원 복원 영상을 제공하는 데 성공했다.

연구팀이 개발한 알고리즘은 기존의 EDX 측정 신호 기반 3차원 재구성 기법과 비교해 나노입자를 형성하고 있는 원자의 형상과 경계를 뚜렷하게 구별했으며, 복원된 다양한 코어-쉘(core-shell) 구조의 퀀텀닷 3차원 영상이 샘플의 광학적 특성과 높은 상관관계를 나타내는 것이 확인됐다.

예종철 교수는 "연구에서 개발한 인공지능 기술을 통해 상용 디스플레이의 핵심 기반이 되는 퀀텀닷 및 반도체 소자의 양자 효율과 화학적 안정성을 더욱 정밀하게 분석할 수 있다ˮ고 말했다.

인공지능으로 3차원 고해상도 나노입자 영상화 기술 개발

우리 대학 바이오및뇌공학과 예종철 교수 연구팀이 삼성전자 종합기술원과 공동연구를 통해 나노입자의 3차원 형상과 조성 분포의 복원 성능을 획기적으로 향상한 인공지능 기술을 개발했다고 16일 밝혔다. 공동연구팀은 에너지 분산형 X선 분광법(EDX)을 주사 투과전자현미경(STEM)과 결합한 시스템을 활용했다.

이번 연구를 통해 나노입자를 형성하고 있는 물질의 형상과 조성 분포를 정확하게 재구성함으로써, 실제 상용 디스플레이를 구성하는 양자점(퀀텀닷)과 같은 반도체 입자의 정확한 분석에 도움을 줄 것으로 기대된다.

예종철 교수 연구팀의 한요섭 박사, 차은주 박사과정, 정형진 석사과정과 삼성종합기술원의 이은하 전문연구원팀의 장재덕, 이준호 전문연구원이 공동 제1 저자로 참여한 이번 연구 결과는 국제 학술지 `네이처 머신 인텔리전스(Nature Machine Intelligence)' 2월 8일 字 온라인판에 게재됐다. (논문명 : Deep learning STEM-EDX tomography of nanocrystals)

에너지 분산형 X선 분광법(이하 EDX)은 나노입자의 성분 분석에 주로 이용되며, X선과 반응한 물체의 성분에 따라 고유한 방출 스펙트럼을 보인다는 점에서 화학적인 분석이 가능하다. 퀀텀닷 및 배터리 등 다양한 나노 소재의 열화 메커니즘과 결함을 해석하기 위해 형상 및 조성 분포 분석이 가능한 이 분광법의 필요성과 중요도가 급증하고 있다.

그러나 EDX 측정 신호의 해상도를 향상하기 위해, 나노 소재를 오랜 시간 전자빔에 노출하면 소재의 영구적인 피해가 발생한다. 이로 인해 나노입자의 3차원 영상화를 위한 투사(projection) 데이터 획득 시간이 제한되며, 한 각도에서의 스캔 시간을 단축하거나 측정하는 각도를 줄이는 방식이 사용된다. 기존의 방식으로 획득된 투사 데이터를 이용해 3차원 영상을 복원할 시, 미량 존재하는 원자 신호의 측정이 불가능하거나 복원 영상의 정밀도와 해상도가 매우 낮다.

그러나 공동 연구팀이 자체 개발한 인공지능 기반의 커널 회귀(kernel regression)와 투사 데이터 향상(projection enhancement)은 정밀도와 해상도를 획기적으로 발전시켰다. 연구팀은 측정된 데이터의 분포를 네트워크가 스스로 학습하는 인공지능 기반의 커널 회귀를 통해 스캔 시간이 단축된 투사 데이터의 신호 대 잡음비(SNR)를 높인 데이터를 제공하는 네트워크를 개발했다. 그리고 개선된 고화질의 EDX 투사 데이터를 기반으로 기존의 방법으로는 불가능했던 적은 수의 투사 데이터로부터 더욱 정확한 3차원 복원 영상을 제공하는 데 성공했다.

연구팀이 개발한 알고리즘은 기존의 EDX 측정 신호 기반 3차원 재구성 기법과 비교해 나노입자를 형성하고 있는 원자의 형상과 경계를 뚜렷하게 구별했으며, 복원된 다양한 코어-쉘(core-shell) 구조의 퀀텀닷 3차원 영상이 샘플의 광학적 특성과 높은 상관관계를 나타내는 것이 확인됐다.

예종철 교수는 "연구에서 개발한 인공지능 기술을 통해 상용 디스플레이의 핵심 기반이 되는 퀀텀닷 및 반도체 소자의 양자 효율과 화학적 안정성을 더욱 정밀하게 분석할 수 있다ˮ고 말했다.

2021.02.16

조회수 85901

-

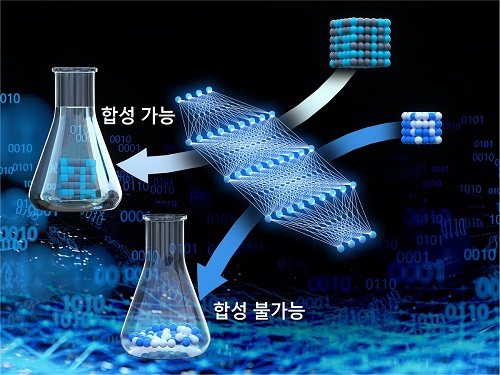

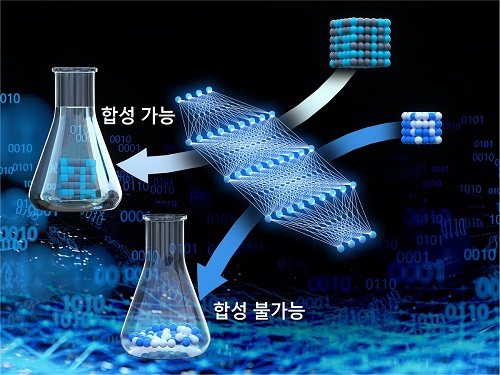

딥러닝으로 소재 합성 가능성 예측 기술 개발

우리 대학 생명화학공학과 정유성 교수 연구팀이 딥러닝을 활용해 소재의 합성 가능성을 높은 정확도로 예측하는 기술을 개발했다고 22일 밝혔다.

신소재 설계의 궁극적인 목표는 소재를 설계하고 그것을 실험적으로 합성하는 것이지만 현실적으로는 새롭게 설계된 대부분의 소재가 실제 합성 단계에서 성공하지 못하고 버려지는 경우가 많다. 이는 불필요한 시간과 자원의 낭비를 초래한다. 소재의 합성 여부는 반응 조건, 열역학, 반응 속도, 소재 구조 등 다양한 요인에 의해서 결정되기 때문에, 소재의 합성 가능성을 예측하는 것은 매우 도전적인 과제로 여겨져 왔다.

이런 문제 해결을 위한 방안으로 간단한 열역학적 안정성만을 고려해 고체 소재의 합성 가능성을 추정하지만 정확도는 매우 떨어지는 편이다. 일례로 에너지적으로 안정된 물질이라 하더라도 합성이 안 되는 경우가 아주 빈번하고, 또 반대로 *준안정 상태의 물질들도 합성되는 경우가 많기 때문이다. 따라서, 합성 가능성에 대한 예측 정확도를 획기적으로 높일 수 있는 방법론의 개발이 시급한 과제로 여겨져 왔다.

☞ 준안정(metastable) 상태 : 어떤 물질이 열역학적으로 안정된 ‘바닥 상태’가 아닌 상태

정유성 교수 연구팀이 개발한 소재 합성 가능성 예측기술은, 기존 합성이 보고된 고체 소재들의 구조적 유사성을 그래프 합성 곱 신경망(GCN, Graph Convolutional Neural Network)으로 학습해 새로운 소재의 합성 가능성을 예측할 수 있다. 특히, 현재까지 합성이 안 된 물질이라 하더라도 합성이 성공할 가능성은 여전히 존재하기 때문에 참값(레이블)을 이미 알고 학습을 진행하는 일반적인 지도학습과는 달리 양의 레이블(+)을 가진 데이터와 레이블이 없는 데이터(Positive-Unlabeled, P-U)를 이용한 분류 모델 기반의 준 지도학습을 사용했다.

정 교수팀은 5만여 종에 달하는 이미 합성이 보고된 물질과 8만여 종의 *가상 물질로 이뤄진 `머터리얼스 프로젝트(Materials Project, MP)'라는 소재 관련 데이터베이스를 이용해 모델을 구축했다. 연구팀 관계자는 이 신기술을 활용한 결과, 소재들의 합성 가능성을 약 87% 정확하게 예측할 수 있다고 설명했다. 정 교수팀은 또 이미 합성된 소재들의 열역학적 특성을 분석한 결과, 열역학적 안정성만으로는 실제 소재의 합성 가능성을 예측할 수 없다는 사실도 알아냈다.

☞ 가상 물질(hypothetical materials) : 기존에 합성되어 보고된 물질들을 원소 치환해서 얻어지는 가상의 물질들로 아직 실험적으로 합성 보고가 이루어지지 않은 물질

이와 함께 머터리얼스 프로젝트(MP) 데이터베이스 내에 합성 가능성 점수가 가장 높은 100개의 가상 물질에 대해 문헌조사를 실시한 결과, 이들 중 머터리얼스 프로젝트(MP) 데이터베이스에는 합성 여부가 아직 알려지지 않았지만 실제로 합성돼 논문에 보고된 소재만도 71개에 달하는 것을 확인했고 이를 통해 모델의 높은 정확도를 추가로 입증했다.

정유성 교수는 "빠른 신소재 발견을 위해 다양한 소재 설계 프레임워크가 존재하지만 정작 설계된 소재의 합성 가능성에 관한 판단은 전문가 직관의 영역으로 남아 있다ˮ면서 "이번에 개발한 합성 가능성 예측 모델은 새로운 소재를 설계할 때 실제로 합성 가능성을 실험 전에 미리 판단할 수 있어 새로운 소재의 개발시간을 단축하는 데 큰 도움이 될 것ˮ이라고 말했다.

생명화학공학과 장지돈 박사과정과 구근호 박사후연구원이 공동 제1 저자로 참여한 이번 연구결과는 미국화학회가 발행하는 국제학술지 미국화학회지(Journal of the American Chemical Society) 온라인 10월 26일 자에 실렸다. (논문명: Structure-Based Synthesizability Prediction of Crystals Using Partially Supervised Learing)

한편 이번 연구는 과학기술정보통신부 산하 한국연구재단의 기초연구사업(중견연구)과 미래소재 디스커버리 사업 지원을 받아 수행됐고, 연구에 KISTI의 슈퍼컴퓨터를 활용했다.

딥러닝으로 소재 합성 가능성 예측 기술 개발

우리 대학 생명화학공학과 정유성 교수 연구팀이 딥러닝을 활용해 소재의 합성 가능성을 높은 정확도로 예측하는 기술을 개발했다고 22일 밝혔다.

신소재 설계의 궁극적인 목표는 소재를 설계하고 그것을 실험적으로 합성하는 것이지만 현실적으로는 새롭게 설계된 대부분의 소재가 실제 합성 단계에서 성공하지 못하고 버려지는 경우가 많다. 이는 불필요한 시간과 자원의 낭비를 초래한다. 소재의 합성 여부는 반응 조건, 열역학, 반응 속도, 소재 구조 등 다양한 요인에 의해서 결정되기 때문에, 소재의 합성 가능성을 예측하는 것은 매우 도전적인 과제로 여겨져 왔다.

이런 문제 해결을 위한 방안으로 간단한 열역학적 안정성만을 고려해 고체 소재의 합성 가능성을 추정하지만 정확도는 매우 떨어지는 편이다. 일례로 에너지적으로 안정된 물질이라 하더라도 합성이 안 되는 경우가 아주 빈번하고, 또 반대로 *준안정 상태의 물질들도 합성되는 경우가 많기 때문이다. 따라서, 합성 가능성에 대한 예측 정확도를 획기적으로 높일 수 있는 방법론의 개발이 시급한 과제로 여겨져 왔다.

☞ 준안정(metastable) 상태 : 어떤 물질이 열역학적으로 안정된 ‘바닥 상태’가 아닌 상태

정유성 교수 연구팀이 개발한 소재 합성 가능성 예측기술은, 기존 합성이 보고된 고체 소재들의 구조적 유사성을 그래프 합성 곱 신경망(GCN, Graph Convolutional Neural Network)으로 학습해 새로운 소재의 합성 가능성을 예측할 수 있다. 특히, 현재까지 합성이 안 된 물질이라 하더라도 합성이 성공할 가능성은 여전히 존재하기 때문에 참값(레이블)을 이미 알고 학습을 진행하는 일반적인 지도학습과는 달리 양의 레이블(+)을 가진 데이터와 레이블이 없는 데이터(Positive-Unlabeled, P-U)를 이용한 분류 모델 기반의 준 지도학습을 사용했다.

정 교수팀은 5만여 종에 달하는 이미 합성이 보고된 물질과 8만여 종의 *가상 물질로 이뤄진 `머터리얼스 프로젝트(Materials Project, MP)'라는 소재 관련 데이터베이스를 이용해 모델을 구축했다. 연구팀 관계자는 이 신기술을 활용한 결과, 소재들의 합성 가능성을 약 87% 정확하게 예측할 수 있다고 설명했다. 정 교수팀은 또 이미 합성된 소재들의 열역학적 특성을 분석한 결과, 열역학적 안정성만으로는 실제 소재의 합성 가능성을 예측할 수 없다는 사실도 알아냈다.

☞ 가상 물질(hypothetical materials) : 기존에 합성되어 보고된 물질들을 원소 치환해서 얻어지는 가상의 물질들로 아직 실험적으로 합성 보고가 이루어지지 않은 물질

이와 함께 머터리얼스 프로젝트(MP) 데이터베이스 내에 합성 가능성 점수가 가장 높은 100개의 가상 물질에 대해 문헌조사를 실시한 결과, 이들 중 머터리얼스 프로젝트(MP) 데이터베이스에는 합성 여부가 아직 알려지지 않았지만 실제로 합성돼 논문에 보고된 소재만도 71개에 달하는 것을 확인했고 이를 통해 모델의 높은 정확도를 추가로 입증했다.

정유성 교수는 "빠른 신소재 발견을 위해 다양한 소재 설계 프레임워크가 존재하지만 정작 설계된 소재의 합성 가능성에 관한 판단은 전문가 직관의 영역으로 남아 있다ˮ면서 "이번에 개발한 합성 가능성 예측 모델은 새로운 소재를 설계할 때 실제로 합성 가능성을 실험 전에 미리 판단할 수 있어 새로운 소재의 개발시간을 단축하는 데 큰 도움이 될 것ˮ이라고 말했다.

생명화학공학과 장지돈 박사과정과 구근호 박사후연구원이 공동 제1 저자로 참여한 이번 연구결과는 미국화학회가 발행하는 국제학술지 미국화학회지(Journal of the American Chemical Society) 온라인 10월 26일 자에 실렸다. (논문명: Structure-Based Synthesizability Prediction of Crystals Using Partially Supervised Learing)

한편 이번 연구는 과학기술정보통신부 산하 한국연구재단의 기초연구사업(중견연구)과 미래소재 디스커버리 사업 지원을 받아 수행됐고, 연구에 KISTI의 슈퍼컴퓨터를 활용했다.

2020.12.22

조회수 54239

-

전산학부 공태식 박사과정, Google Ph.D Fellowship 2020선정

구글은 지난 10월 8일 2020년도 Google Ph.D Fellowship 수혜자 목록을 발표했다. Google Ph.D Fellowship 프로그램은 컴퓨터과학 및 관련 분야의 뛰어나고 촉망받는 대학원생들을 지원하기 위한 프로그램으로, 이번 년도에는 전 세계 대학에서 12개 분야에 총 53명이 선정됐다. 우리 대학 공태식 학생은 기계학습(Machine Learning) 부문에 이름을 올리는 영예를 안았다.

공태식 연구원은 KAIST 네트워킹 및 모바일 시스템 연구실 (지도교수: 전기및전자공학부 이성주 교수) 박사과정이다. 주 연구 분야는 기계학습을 활용한 모바일 센싱으로, “환경 독립적 모바일 센싱 (Condition-independent mobile sensing)” 연구에 대한 연구 업적과 가능성을 인정받아 이번 Google Ph.D. Fellowship 2020에 선정됐다.

한편, 공태식 연구원은 센서 및 유비쿼터스 컴퓨팅 분야 최고 학회인 ACM SenSys, ACM UbiComp 등에 주 저자로 논문을 발표했고 Microsoft Research Asia 및 Nokia Bell Labs에서 research intern으로 활동하였다. 또한 연구 성과를 인정받아 2018년 NAVER Ph.D. Fellowship에도 선정된 바 있다.

전산학부 공태식 박사과정, Google Ph.D Fellowship 2020선정

구글은 지난 10월 8일 2020년도 Google Ph.D Fellowship 수혜자 목록을 발표했다. Google Ph.D Fellowship 프로그램은 컴퓨터과학 및 관련 분야의 뛰어나고 촉망받는 대학원생들을 지원하기 위한 프로그램으로, 이번 년도에는 전 세계 대학에서 12개 분야에 총 53명이 선정됐다. 우리 대학 공태식 학생은 기계학습(Machine Learning) 부문에 이름을 올리는 영예를 안았다.

공태식 연구원은 KAIST 네트워킹 및 모바일 시스템 연구실 (지도교수: 전기및전자공학부 이성주 교수) 박사과정이다. 주 연구 분야는 기계학습을 활용한 모바일 센싱으로, “환경 독립적 모바일 센싱 (Condition-independent mobile sensing)” 연구에 대한 연구 업적과 가능성을 인정받아 이번 Google Ph.D. Fellowship 2020에 선정됐다.

한편, 공태식 연구원은 센서 및 유비쿼터스 컴퓨팅 분야 최고 학회인 ACM SenSys, ACM UbiComp 등에 주 저자로 논문을 발표했고 Microsoft Research Asia 및 Nokia Bell Labs에서 research intern으로 활동하였다. 또한 연구 성과를 인정받아 2018년 NAVER Ph.D. Fellowship에도 선정된 바 있다.

2020.10.12

조회수 23141

-

딥러닝 기반 실시간 기침 인식 카메라 개발

우리 대학 기계공학과 박용화 교수 연구팀이 ㈜에스엠 인스트루먼트와 공동으로 실시간으로 기침 소리를 인식하고 기침하는 사람의 위치를 이미지로 표시해주는 '기침 인식 카메라'를 개발했다고 3일 밝혔다.

작년 말부터 시작된 세계적 유행성 전염병인 코로나19가 최근 미국·중국·유럽 등 세계 각국에서 재확산되는 추세로 접어들면서 비접촉방식으로 전염병을 감지하는 기술에 대한 수요가 증가하고 있다.

코로나19의 대표적인 증상이 발열과 기침인데, 현재 발열은 열화상 카메라를 이용해 직접 접촉을 하지 않고도 체온을 쉽게 판별할 수 있다. 문제는 비접촉방식으로는 기침하는 사람의 증상을 쉽사리 파악하기 어렵다는 점이다. 박 교수 연구팀은 이런 문제를 해결하기 위해 기침 소리를 실시간으로 인식하는 딥러닝 기반의 기침 인식 모델을 개발했다. 또한 열화상 카메라와 같은 원리로 기침 소리와 기침하는 사람의 시각화를 위해 기침 인식 모델을 음향 카메라에 적용, 기침 소리와 기침하는 사람의 위치, 심지어 기침 횟수까지를 실시간으로 추적하고 기록이 가능한 '기침 인식 카메라'를 개발했다.

연구팀은 기침 인식 카메라가 사람이 밀집한 공공장소에서 전염병의 유행을 감지하거나 병원에서 환자의 상태를 상시 모니터링 가능한 의료용 장비로 활용될 것으로 기대하고 있다.

연구팀은 기침 인식 모델 개발을 위해 *합성 곱 신경망(convolutional neural network, CNN)을 기반으로 *지도학습(supervised learning)을 적용했다. 1초 길이 음향신호의 특징(feature)을 입력 신호로 받아, 1(기침) 또는 0(그 외)의 2진 신호를 출력하고 학습률의 최적화를 위해 일정 기간 학습률이 정체되면 학습률 값을 낮추도록 설정했다.

이어서 기침 인식 모델의 훈련 및 평가를 위해 구글과 유튜브 등에서 연구용으로 활발히 사용 중인 공개 음성데이터 세트인 `오디오세트(Audioset)'를 비롯해 `디맨드(DEMAND)'와 `이티에스아이(ETSI)', `티미트(TIMIT)' 등에서 데이터 세트를 수집했다. 이 중 `오디오세트'는 훈련 및 평가 데이터 세트 구성을 위해 사용했고 다른 데이터 세트의 경우 기침 인식 모델이 다양한 배경 소음을 학습할 수 있도록 데이터 증강(data augmentation)을 위한 배경 소음으로 사용했다.

☞ 합성 곱 신경망(convolutional neural network): 시각적 이미지를 분석하는 데 사용되는 인공신경망(생물학의 신경망에서 영감을 얻은 통계학적 학습 알고리즘)의 한 종류

☞ 지도학습(Supervised Learning): 훈련 데이터(Training Data)로부터 하나의 함수를 유추해내기 위한 기계 학습(Machine Learning)의 한 방법

데이터 증강을 위해 배경 소음을 15%~75%의 비율로 `오디오세트'에 섞은 후, 다양한 거리에 적응할 수 있게 음량을 0.25~1.0배로 조정했다. 훈련 및 평가 데이터 세트는 증강된 데이터 세트를 9:1 비율로 나눠 구성했으며, 시험 데이터 세트는 따로 사무실에서 녹음한 것을 사용했다.

모델 최적화를 위해서는 '스펙트로그램(spectrogram)' 등 5개의 음향 특징과 7개의 최적화 기기(optimizer)를 사용해 학습을 진행하고 시험 데이터 세트의 정확도를 측정, 성능을 확인한 결과 87.4%의 시험 정확도를 얻을 수 있었다.

연구팀은 이어 학습된 기침 인식 모델을 소리를 수집하는 마이크로폰 어레이와 카메라 모듈로 구성되는 음향 카메라에 적용했다. 그 결과 수집된 데이터는 음원의 위치를 계산하는 빔 형성 과정을 거쳐 기침 인식 모델이 기침 소리로 인식할 경우 기침 소리가 난 위치에 기침 소리임을 나타내는 등고선과 라벨이 각각 표시된다.

박 교수팀은 마지막 단계로 기침 인식 카메라의 예비 테스트를 진행한 결과, 여러 잡음 환경에서도 기침 소리와 그 이외의 소리로 구분이 가능하며 기침하는 사람과 그 사람의 위치, 횟수 등을 실시간으로 추적해 현장에서의 적용 가능성을 확인했다. 이들은 추후 병원 등 실사용 환경에서 추가 학습이 이뤄진다면 정확도는 87.4%보다 더 높아질 것으로 기대하고 있다.

박용화 교수는 "코로나19가 지속적으로 전파되고 있는 상황에서 공공장소와 다수 밀집 시설에 기침 인식 카메라를 활용하면 전염병의 방역 및 조기 감지에 큰 도움이 될 것ˮ이라고 말했다. 박 교수는 이어 "특히 병실에 적용하면 환자의 상태를 24시간 기록해 치료에 활용할 수 있기 때문에 의료진의 수고를 줄이고 환자 상태를 더 정밀하게 파악할 수 있을 것ˮ 이라고 강조했다.

한편, 이번 연구는 에너지기술평가원(산업통상자원부)의 지원을 받아 수행됐다.

딥러닝 기반 실시간 기침 인식 카메라 개발

우리 대학 기계공학과 박용화 교수 연구팀이 ㈜에스엠 인스트루먼트와 공동으로 실시간으로 기침 소리를 인식하고 기침하는 사람의 위치를 이미지로 표시해주는 '기침 인식 카메라'를 개발했다고 3일 밝혔다.

작년 말부터 시작된 세계적 유행성 전염병인 코로나19가 최근 미국·중국·유럽 등 세계 각국에서 재확산되는 추세로 접어들면서 비접촉방식으로 전염병을 감지하는 기술에 대한 수요가 증가하고 있다.

코로나19의 대표적인 증상이 발열과 기침인데, 현재 발열은 열화상 카메라를 이용해 직접 접촉을 하지 않고도 체온을 쉽게 판별할 수 있다. 문제는 비접촉방식으로는 기침하는 사람의 증상을 쉽사리 파악하기 어렵다는 점이다. 박 교수 연구팀은 이런 문제를 해결하기 위해 기침 소리를 실시간으로 인식하는 딥러닝 기반의 기침 인식 모델을 개발했다. 또한 열화상 카메라와 같은 원리로 기침 소리와 기침하는 사람의 시각화를 위해 기침 인식 모델을 음향 카메라에 적용, 기침 소리와 기침하는 사람의 위치, 심지어 기침 횟수까지를 실시간으로 추적하고 기록이 가능한 '기침 인식 카메라'를 개발했다.

연구팀은 기침 인식 카메라가 사람이 밀집한 공공장소에서 전염병의 유행을 감지하거나 병원에서 환자의 상태를 상시 모니터링 가능한 의료용 장비로 활용될 것으로 기대하고 있다.

연구팀은 기침 인식 모델 개발을 위해 *합성 곱 신경망(convolutional neural network, CNN)을 기반으로 *지도학습(supervised learning)을 적용했다. 1초 길이 음향신호의 특징(feature)을 입력 신호로 받아, 1(기침) 또는 0(그 외)의 2진 신호를 출력하고 학습률의 최적화를 위해 일정 기간 학습률이 정체되면 학습률 값을 낮추도록 설정했다.

이어서 기침 인식 모델의 훈련 및 평가를 위해 구글과 유튜브 등에서 연구용으로 활발히 사용 중인 공개 음성데이터 세트인 `오디오세트(Audioset)'를 비롯해 `디맨드(DEMAND)'와 `이티에스아이(ETSI)', `티미트(TIMIT)' 등에서 데이터 세트를 수집했다. 이 중 `오디오세트'는 훈련 및 평가 데이터 세트 구성을 위해 사용했고 다른 데이터 세트의 경우 기침 인식 모델이 다양한 배경 소음을 학습할 수 있도록 데이터 증강(data augmentation)을 위한 배경 소음으로 사용했다.

☞ 합성 곱 신경망(convolutional neural network): 시각적 이미지를 분석하는 데 사용되는 인공신경망(생물학의 신경망에서 영감을 얻은 통계학적 학습 알고리즘)의 한 종류

☞ 지도학습(Supervised Learning): 훈련 데이터(Training Data)로부터 하나의 함수를 유추해내기 위한 기계 학습(Machine Learning)의 한 방법

데이터 증강을 위해 배경 소음을 15%~75%의 비율로 `오디오세트'에 섞은 후, 다양한 거리에 적응할 수 있게 음량을 0.25~1.0배로 조정했다. 훈련 및 평가 데이터 세트는 증강된 데이터 세트를 9:1 비율로 나눠 구성했으며, 시험 데이터 세트는 따로 사무실에서 녹음한 것을 사용했다.

모델 최적화를 위해서는 '스펙트로그램(spectrogram)' 등 5개의 음향 특징과 7개의 최적화 기기(optimizer)를 사용해 학습을 진행하고 시험 데이터 세트의 정확도를 측정, 성능을 확인한 결과 87.4%의 시험 정확도를 얻을 수 있었다.

연구팀은 이어 학습된 기침 인식 모델을 소리를 수집하는 마이크로폰 어레이와 카메라 모듈로 구성되는 음향 카메라에 적용했다. 그 결과 수집된 데이터는 음원의 위치를 계산하는 빔 형성 과정을 거쳐 기침 인식 모델이 기침 소리로 인식할 경우 기침 소리가 난 위치에 기침 소리임을 나타내는 등고선과 라벨이 각각 표시된다.

박 교수팀은 마지막 단계로 기침 인식 카메라의 예비 테스트를 진행한 결과, 여러 잡음 환경에서도 기침 소리와 그 이외의 소리로 구분이 가능하며 기침하는 사람과 그 사람의 위치, 횟수 등을 실시간으로 추적해 현장에서의 적용 가능성을 확인했다. 이들은 추후 병원 등 실사용 환경에서 추가 학습이 이뤄진다면 정확도는 87.4%보다 더 높아질 것으로 기대하고 있다.

박용화 교수는 "코로나19가 지속적으로 전파되고 있는 상황에서 공공장소와 다수 밀집 시설에 기침 인식 카메라를 활용하면 전염병의 방역 및 조기 감지에 큰 도움이 될 것ˮ이라고 말했다. 박 교수는 이어 "특히 병실에 적용하면 환자의 상태를 24시간 기록해 치료에 활용할 수 있기 때문에 의료진의 수고를 줄이고 환자 상태를 더 정밀하게 파악할 수 있을 것ˮ 이라고 강조했다.

한편, 이번 연구는 에너지기술평가원(산업통상자원부)의 지원을 받아 수행됐다.

2020.08.03

조회수 31795

-

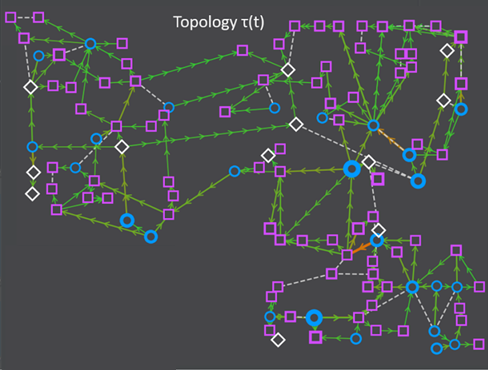

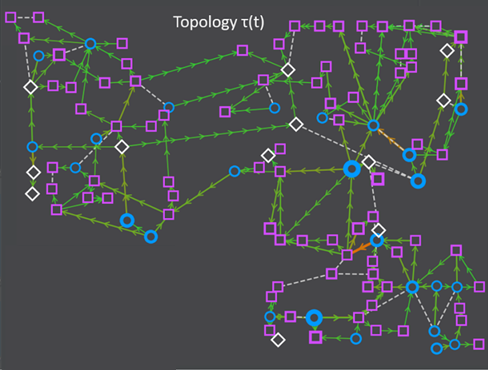

AI대학원 김기응 교수 연구팀, 인공지능 전력망 운영관리 국제대회 1위 달성

우리 대학 AI대학원 김기응 교수 연구팀(홍성훈, 윤든솔 석사과정, 이병준 박사과정)이 인공지능 기반 전력망 운영관리 기술을 겨루는 국제경진대회인 'L2RPN 챌린지(Learning to Run a Power Network Challenge 2020 WCCI)'에서 최종 1위를 차지했다. 이 대회는 기계학습 연구를 촉진하기 위한 각종 경진대회를 주관하는 비영리단체 ChaLearn, 유럽 최대 전력망을 운영관리하는 프랑스 전력공사의 자회사 RTE(Réseau de Transport d'Électricité)社 및 세계 최대 규모의 전력 회사 SGCC(State Grid of China)의 자회사인 GEIRI North America(Global Energy Interconnection Research Institute)에서 공동주최해, 세계 각국의 약 50팀이 약 40일간 (2020.05.20.~06.30) 온라인으로 참여해 성황리에 마감됐다.

단순한 전력망이 스마트 그리드를 넘어서 에너지 클라우드 및 네트워크로 진화하려면 신재생 에너지의 비율이 30% 이상이 돼야 하고, 신재생 에너지 비율이 높아지면 전력망 운영의 복잡도가 매우 증가한다. 실제로 독일의 경우 신재생 에너지 비율이 30%가 넘어가면서 전력사고가 3,000건 이상 증가할 정도로 심각하며, 미국의 ENRON 사태 직전에도 에너지 발전과 수요 사이의 수급 조절에 문제가 생기면서 잦은 정전 사태가 났던 사례도 있다.

전력망 운영에 인공지능 기술 도입은 아직 초기 단계이며, 현재 사용되고 있는 전력망은 관리자의 개입 없이 1시간 이상 운영되기 힘든 실정이다. 이에 프랑스의 RTE(Réseau de Transport d'Électricité) 社는 전력망 운영에 인공지능 기술을 접목하는 경진대회 'L2RPN'을 2019년 처음 개최했다. 2019년 대회는 IEEE-14라는 14개의 변전소를 포함하는 가상의 전력망에서 단순한 운영을 목표로 열렸다. 2020년 대회는 L2RPN 2020 WCCI 챌린지라는 이름으로 특정 국가 수도 규모의 복잡한 전력망을 72시간 동안 관리자의 개입 없이 스스로 안전하고 효율적으로 운영될 수 있는 인공지능 전력망 관리 에이전트를 개발하는 것을 목표로 열렸다. 시간에 따른 공급-수요의 변화, 시설 유지보수 및 재난에 따른 급작스러운 단전 등 다양한 시나리오에 대해 전력망 운영관리 능력의 평가가 이뤄졌다.

김 교수 연구팀은 이번 2020년 대회에서 전력망 구조를 효과적으로 반영할 수 있는 그래프 신경망 모델 기반의 강화학습 에이전트를 개발해 참가했다. 기존의 에이전트들은 소규모의 전력망에서만 적용 가능하다는 한계가 있었지만, 김 교수 연구팀은 국가 수도 규모의 복잡한 전력망에도 적용 가능한 에이전트를 개발했다. 연구팀이 개발한 인공지능 전력망 운영관리 에이전트는 주어진 모든 테스트 시나리오에 대해 안전하고 효율적으로 전력망을 운영해 최종 1위의 성적을 거뒀다. 우승팀에게는 상금으로 미국 실리콘밸리에 있는 GEIRI North America를 방문할 수 있는 여행경비와 학회참가 비용 3,000달러가 주어진다. 연구진은 앞으로도 기술을 고도화해 국가 규모의 전력망과 다양한 신재생 에너지원을 다룰 수 있도록 확장할 계획이다.

한편 이번 연구는 과기정통부 에너지 클라우드 기술개발 사업의 지원으로 설치된 개방형 에너지 클라우드 플랫폼 연구단과제로 수행됐다. (연구단장 KAIST 전산학부 문수복 교수)

※ 대회 결과 사이트 관련 링크: https://l2rpn.chalearn.org/competitions

※ 개방형 에너지 클라우드 플랫폼 연구단 사이트: https://www.oecp.kaist.ac.kr

AI대학원 김기응 교수 연구팀, 인공지능 전력망 운영관리 국제대회 1위 달성

우리 대학 AI대학원 김기응 교수 연구팀(홍성훈, 윤든솔 석사과정, 이병준 박사과정)이 인공지능 기반 전력망 운영관리 기술을 겨루는 국제경진대회인 'L2RPN 챌린지(Learning to Run a Power Network Challenge 2020 WCCI)'에서 최종 1위를 차지했다. 이 대회는 기계학습 연구를 촉진하기 위한 각종 경진대회를 주관하는 비영리단체 ChaLearn, 유럽 최대 전력망을 운영관리하는 프랑스 전력공사의 자회사 RTE(Réseau de Transport d'Électricité)社 및 세계 최대 규모의 전력 회사 SGCC(State Grid of China)의 자회사인 GEIRI North America(Global Energy Interconnection Research Institute)에서 공동주최해, 세계 각국의 약 50팀이 약 40일간 (2020.05.20.~06.30) 온라인으로 참여해 성황리에 마감됐다.

단순한 전력망이 스마트 그리드를 넘어서 에너지 클라우드 및 네트워크로 진화하려면 신재생 에너지의 비율이 30% 이상이 돼야 하고, 신재생 에너지 비율이 높아지면 전력망 운영의 복잡도가 매우 증가한다. 실제로 독일의 경우 신재생 에너지 비율이 30%가 넘어가면서 전력사고가 3,000건 이상 증가할 정도로 심각하며, 미국의 ENRON 사태 직전에도 에너지 발전과 수요 사이의 수급 조절에 문제가 생기면서 잦은 정전 사태가 났던 사례도 있다.

전력망 운영에 인공지능 기술 도입은 아직 초기 단계이며, 현재 사용되고 있는 전력망은 관리자의 개입 없이 1시간 이상 운영되기 힘든 실정이다. 이에 프랑스의 RTE(Réseau de Transport d'Électricité) 社는 전력망 운영에 인공지능 기술을 접목하는 경진대회 'L2RPN'을 2019년 처음 개최했다. 2019년 대회는 IEEE-14라는 14개의 변전소를 포함하는 가상의 전력망에서 단순한 운영을 목표로 열렸다. 2020년 대회는 L2RPN 2020 WCCI 챌린지라는 이름으로 특정 국가 수도 규모의 복잡한 전력망을 72시간 동안 관리자의 개입 없이 스스로 안전하고 효율적으로 운영될 수 있는 인공지능 전력망 관리 에이전트를 개발하는 것을 목표로 열렸다. 시간에 따른 공급-수요의 변화, 시설 유지보수 및 재난에 따른 급작스러운 단전 등 다양한 시나리오에 대해 전력망 운영관리 능력의 평가가 이뤄졌다.

김 교수 연구팀은 이번 2020년 대회에서 전력망 구조를 효과적으로 반영할 수 있는 그래프 신경망 모델 기반의 강화학습 에이전트를 개발해 참가했다. 기존의 에이전트들은 소규모의 전력망에서만 적용 가능하다는 한계가 있었지만, 김 교수 연구팀은 국가 수도 규모의 복잡한 전력망에도 적용 가능한 에이전트를 개발했다. 연구팀이 개발한 인공지능 전력망 운영관리 에이전트는 주어진 모든 테스트 시나리오에 대해 안전하고 효율적으로 전력망을 운영해 최종 1위의 성적을 거뒀다. 우승팀에게는 상금으로 미국 실리콘밸리에 있는 GEIRI North America를 방문할 수 있는 여행경비와 학회참가 비용 3,000달러가 주어진다. 연구진은 앞으로도 기술을 고도화해 국가 규모의 전력망과 다양한 신재생 에너지원을 다룰 수 있도록 확장할 계획이다.

한편 이번 연구는 과기정통부 에너지 클라우드 기술개발 사업의 지원으로 설치된 개방형 에너지 클라우드 플랫폼 연구단과제로 수행됐다. (연구단장 KAIST 전산학부 문수복 교수)

※ 대회 결과 사이트 관련 링크: https://l2rpn.chalearn.org/competitions

※ 개방형 에너지 클라우드 플랫폼 연구단 사이트: https://www.oecp.kaist.ac.kr

2020.07.28

조회수 31088

-

기존 인공지능 기술을 뛰어넘는 양자 인공지능 알고리즘 개발

우리 대학 전기및전자공학부 및 AI 양자컴퓨팅 IT 인력양성연구센터장 이준구 교수 연구팀이 독일 및 남아공 연구팀과의 협력 연구를 통해 비선형 양자 기계학습 인공지능 알고리즘을 개발했다고 7일 밝혔다.

양자 인공지능은 양자컴퓨터의 발전과 함께 현재의 인공지능을 앞설 것으로 크게 기대되고 있으나 연산 방법이 전혀 달라 새로운 양자 알고리즘의 개발이 절실하다. 특히 양자컴퓨터는 본질적으로 일차방정식을 잘 푸는 선형적 성질을 가지고 있어 복잡한 데이터를 다루는 비선형적 기계학습에 어려움이 존재했다. 하지만 이번 연구를 통해 비선형 커널이 고안되어 복잡한 데이터에 대한 양자 기계학습이 가능하게 됐다. 특히 이준구 교수팀이 개발한 양자 지도학습 알고리즘은 학습에 있어 매우 적은 계산량으로 연산이 가능하다. 따라서 대규모 계산량이 필요한 현재의 인공지능 기술을 추월할 가능성을 제시한 것으로 평가를 받고 있다.

이준구 교수팀은 학습데이터와 테스트데이터를 양자 정보로 생성한 후 양자 정보의 병렬연산을 가능하게 하는 양자포킹 기술과 간단한 양자 측정기술을 조합해 양자 데이터 간의 유사성을 효율적으로 계산하는 비선형 커널 기반의 지도학습을 구현하는 양자 알고리즘 체계를 만들었다. 이후 IBM 클라우드 서비스를 통해 실제 양자컴퓨터에서 양자 지도학습을 실제 시연하는 데 성공했다.

KAIST 박경덕 연구교수가 공동 제1 저자로 참여한 이번 연구결과는 국제 학술지 네이처 자매지인 `npj Quantum Information' 誌 2020년 5월 6권에 게재됐다. (논문명: Quantum classifier with tailored quantum kernel).

기계학습에 있어 중요한 문제 중 하나는 주어진 데이터의 특징(feature)을 구분해 분류하는 것이다. 간단한 예로 동물 이미지 학습데이터에서 입, 귀 등의 특징을 바탕으로 분류하기 위한 결정 경계(decision boundary)를 학습하고 새로운 이미지가 입력되었을 때 개 또는 고양이로 분류하는 작업을 생각해볼 수 있다. 데이터의 특징들이 잘 나타나는 경우에는 선형적 결정 경계만으로 분류할 수 있다. 그러나 입과 귀 모양의 특징으로만 개와 고양이를 분류하기 쉽지 않다면 새로운 결정 경계를 찾기 위해 특징에 관한 정보 공간의 차원을 확장해야 하는데 이러한 과정에서 비선형 커널 기술이 필요하다.

양자컴퓨팅은 고전 컴퓨팅과는 달리 큐비트(quantum bit, 양자컴퓨팅 정보처리의 기본 단위)의 개수에 따라 정보 공간의 차원이 기하급수적으로 증가하기 때문에 이론적으로 고차원 정보처리에 있어 기하급수적으로 뛰어난 성능을 낼 수 있다.

연구팀은 이러한 양자컴퓨팅의 장점을 활용해 데이터 특징 대비 기하급수적인 계산 효율성을 달성하는 양자 기계학습 알고리즘을 개발했다. 이 교수 연구팀이 개발한 이 알고리즘은 저차원 입력 공간에 존재하는 데이터들을 큐비트로 표현되는 고차원 데이터 특징 공간(feature space)으로 옮긴 후, 양자화된 모든 학습데이터와 테스트데이터 간의 커널 함수를 양자 중첩을 활용해 동시에 계산하고 테스트데이터의 분류를 효율적으로 결정한다. 이때 사용되는 양자 회로의 계산 복잡도는 학습 데이터양에 대해서는 선형적으로 증가하나, 데이터 특징 개수에 대해서는 불과 로그(log)함수로 매우 천천히 증가하는 장점이 있다.

연구팀은 이와 함께 양자 회로의 체계적 설계를 통해 다양한 양자 커널 구현이 가능함을 이론적으로 증명했다. 커널 기반 기계학습에서는 주어진 입력 데이터에 따라 최적 커널이 달라질 수 있으므로, 다양한 양자 커널을 효율적으로 구현할 수 있게 된 점은 양자 커널 기반 기계학습의 실제 응용에 있어 매우 중요한 성과다.

연구팀은 IBM이 클라우드 서비스로 제공하는 다섯 개의 큐비트로 구성된 초전도 기반 양자 컴퓨터에서 이번에 개발에 성공한 양자 기계학습 알고리즘을 실험적으로 구현해 양자 커널 기반 기계학습의 성능을 실제 시연을 통해 이를 입증하는 데 성공했다.

이 연구에 참여한 박경덕 연구교수는 "연구팀이 개발한 커널 기반 양자 기계학습 알고리즘은 수년 안에 상용화될 것으로 예측되는 수백 큐비트의 NISQ(Noisy Intermediate-Scale Quantum) 컴퓨팅의 시대가 되면 기존의 고전 커널 기반 지도학습을 뛰어넘을 것ˮ이라면서 "복잡한 비선형 데이터의 패턴 인식 등을 위한 양자 기계학습 알고리즘으로 활발히 사용될 것ˮ이라고 말했다.

한편 이번 연구는 각각 한국연구재단의 창의 도전 연구기반 지원 사업과 한국연구재단의 한-아프리카 협력기반 조성 사업, 정보통신기획평가원의 정보통신기술인력 양성사업(ITRC)의 지원을 받아 수행됐다.

관련 논문: https://www.nature.com/articles/s41534-020-0272-6

기존 인공지능 기술을 뛰어넘는 양자 인공지능 알고리즘 개발

우리 대학 전기및전자공학부 및 AI 양자컴퓨팅 IT 인력양성연구센터장 이준구 교수 연구팀이 독일 및 남아공 연구팀과의 협력 연구를 통해 비선형 양자 기계학습 인공지능 알고리즘을 개발했다고 7일 밝혔다.

양자 인공지능은 양자컴퓨터의 발전과 함께 현재의 인공지능을 앞설 것으로 크게 기대되고 있으나 연산 방법이 전혀 달라 새로운 양자 알고리즘의 개발이 절실하다. 특히 양자컴퓨터는 본질적으로 일차방정식을 잘 푸는 선형적 성질을 가지고 있어 복잡한 데이터를 다루는 비선형적 기계학습에 어려움이 존재했다. 하지만 이번 연구를 통해 비선형 커널이 고안되어 복잡한 데이터에 대한 양자 기계학습이 가능하게 됐다. 특히 이준구 교수팀이 개발한 양자 지도학습 알고리즘은 학습에 있어 매우 적은 계산량으로 연산이 가능하다. 따라서 대규모 계산량이 필요한 현재의 인공지능 기술을 추월할 가능성을 제시한 것으로 평가를 받고 있다.

이준구 교수팀은 학습데이터와 테스트데이터를 양자 정보로 생성한 후 양자 정보의 병렬연산을 가능하게 하는 양자포킹 기술과 간단한 양자 측정기술을 조합해 양자 데이터 간의 유사성을 효율적으로 계산하는 비선형 커널 기반의 지도학습을 구현하는 양자 알고리즘 체계를 만들었다. 이후 IBM 클라우드 서비스를 통해 실제 양자컴퓨터에서 양자 지도학습을 실제 시연하는 데 성공했다.

KAIST 박경덕 연구교수가 공동 제1 저자로 참여한 이번 연구결과는 국제 학술지 네이처 자매지인 `npj Quantum Information' 誌 2020년 5월 6권에 게재됐다. (논문명: Quantum classifier with tailored quantum kernel).

기계학습에 있어 중요한 문제 중 하나는 주어진 데이터의 특징(feature)을 구분해 분류하는 것이다. 간단한 예로 동물 이미지 학습데이터에서 입, 귀 등의 특징을 바탕으로 분류하기 위한 결정 경계(decision boundary)를 학습하고 새로운 이미지가 입력되었을 때 개 또는 고양이로 분류하는 작업을 생각해볼 수 있다. 데이터의 특징들이 잘 나타나는 경우에는 선형적 결정 경계만으로 분류할 수 있다. 그러나 입과 귀 모양의 특징으로만 개와 고양이를 분류하기 쉽지 않다면 새로운 결정 경계를 찾기 위해 특징에 관한 정보 공간의 차원을 확장해야 하는데 이러한 과정에서 비선형 커널 기술이 필요하다.

양자컴퓨팅은 고전 컴퓨팅과는 달리 큐비트(quantum bit, 양자컴퓨팅 정보처리의 기본 단위)의 개수에 따라 정보 공간의 차원이 기하급수적으로 증가하기 때문에 이론적으로 고차원 정보처리에 있어 기하급수적으로 뛰어난 성능을 낼 수 있다.

연구팀은 이러한 양자컴퓨팅의 장점을 활용해 데이터 특징 대비 기하급수적인 계산 효율성을 달성하는 양자 기계학습 알고리즘을 개발했다. 이 교수 연구팀이 개발한 이 알고리즘은 저차원 입력 공간에 존재하는 데이터들을 큐비트로 표현되는 고차원 데이터 특징 공간(feature space)으로 옮긴 후, 양자화된 모든 학습데이터와 테스트데이터 간의 커널 함수를 양자 중첩을 활용해 동시에 계산하고 테스트데이터의 분류를 효율적으로 결정한다. 이때 사용되는 양자 회로의 계산 복잡도는 학습 데이터양에 대해서는 선형적으로 증가하나, 데이터 특징 개수에 대해서는 불과 로그(log)함수로 매우 천천히 증가하는 장점이 있다.

연구팀은 이와 함께 양자 회로의 체계적 설계를 통해 다양한 양자 커널 구현이 가능함을 이론적으로 증명했다. 커널 기반 기계학습에서는 주어진 입력 데이터에 따라 최적 커널이 달라질 수 있으므로, 다양한 양자 커널을 효율적으로 구현할 수 있게 된 점은 양자 커널 기반 기계학습의 실제 응용에 있어 매우 중요한 성과다.

연구팀은 IBM이 클라우드 서비스로 제공하는 다섯 개의 큐비트로 구성된 초전도 기반 양자 컴퓨터에서 이번에 개발에 성공한 양자 기계학습 알고리즘을 실험적으로 구현해 양자 커널 기반 기계학습의 성능을 실제 시연을 통해 이를 입증하는 데 성공했다.

이 연구에 참여한 박경덕 연구교수는 "연구팀이 개발한 커널 기반 양자 기계학습 알고리즘은 수년 안에 상용화될 것으로 예측되는 수백 큐비트의 NISQ(Noisy Intermediate-Scale Quantum) 컴퓨팅의 시대가 되면 기존의 고전 커널 기반 지도학습을 뛰어넘을 것ˮ이라면서 "복잡한 비선형 데이터의 패턴 인식 등을 위한 양자 기계학습 알고리즘으로 활발히 사용될 것ˮ이라고 말했다.

한편 이번 연구는 각각 한국연구재단의 창의 도전 연구기반 지원 사업과 한국연구재단의 한-아프리카 협력기반 조성 사업, 정보통신기획평가원의 정보통신기술인력 양성사업(ITRC)의 지원을 받아 수행됐다.

관련 논문: https://www.nature.com/articles/s41534-020-0272-6

2020.07.07

조회수 24058

-

학습되지 않은 환경에서 스스로 학습하는 모바일 센싱 기술 개발

우리 대학 전산학부 이성주 교수 연구팀이 학습되지 않은 환경에 적은 양의 데이터로 스스로 적응하는 모바일 센싱 학습 기술 <메타센스(MetaSense)>를 개발했다.

모바일 센싱이란 스마트폰과 같은 모바일 기기의 다양한 센서를 이용하여 서비스(예: 수면의 질 평가, 걸음 수 추적 등)를 제공하는 기술이다. 최근 학계에서는 기계학습 기술의 발전과 더불어 우울증 진단, 운동 자세 관리 등 진보된 모바일 센싱의 가능성을 보여줌으로써 모바일 센싱의 범위를 더욱 확장하고 있다.

하지만 이러한 센싱 기술은 아직 널리 쓰이지 못하고 있다. 사용자 개인마다 가지고 있는 모바일 센싱의 환경이 다르기 때문이다. 사람마다 가지고 있는 고유한 생활패턴과 행동방식, 서로 다른 모바일 기기와 그 사양은 센서의 값에 큰 영향을 미친다. 다른 센서 값은 사람마다 고유한 센싱 환경을 만들고, 이는 센싱 모델이 미리 학습되지 않은 새로운 환경에서 작동할 때 사용이 어려울 만큼 성능 저하를 일으킨다.

연구팀은 이런 학습되지 않는 환경에서 적은 양의 데이터 (최소 1-2 샘플)만 가지고 적응할 수 있는 '메타러닝 프레임워크'를 제시했다. 메타러닝 (meta learning) 이란 적은 양의 데이터를 가지고도 새로운 지식을 학습할 수 있도록 하는 기계학습 원리다. 연구팀이 제시한 기술은 최신 전이학습 (transfer learning) 기술과 비교하여 18%, 메타러닝 기술과 비교하여 15%의 정확도 성능향상을 보였다.

이성주 교수는 ”최근 활발히 제안되고 있는 다양한 모바일 센싱 서비스가 특정 환경에 의존하지 않고 수많은 실제 사용 환경에서 우수한 성능을 보일 수 있게 해주는 연구다. 모바일 센싱 서비스가 연구에 그치지 않고 실제 많은 사람들에게 사용될 수 있는 가능성을 제시해 의미가 있다“라고 했다. 또한 신진우 교수는 “최근 메타러닝 방법론들이 기계학습 분야에서 크게 각광을 받고 있는데 주로 영상 데이터에 국한되어 왔었다. 본 연구에서 비영상 데이터에도 범용적으로 동작하는 메터러닝 기술을 개발하여 성공한 것은 앞으로도 관련 분야 연구에 큰 영향을 주리라 기대한다“라고 덧붙였다.

연구에 대한 설명이 담긴 비디오를 다음 링크에서 확인할 수 있고, (https://youtu.be/-6y0I1pd6XI) 자세한 정보는 프로젝트 웹사이트에서 볼 수 있다.

(https://nmsl.kaist.ac.kr/projects/metasense/)

이성주 교수, 신진우 AI대학원 교수, 공태식 박사과정, 김연수 학사과정이 참여한 이번 연구 결과는 2019년 11월 11일 센싱 컴퓨팅 분야 국제 최우수학회 ACM SenSys에서 발표됐다. (논문명: MetaSense: Few-Shot Adaptation to Untrained Conditions in Deep Mobile Sensing). 이 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단과 정보통신기술진흥센터, 한국연구재단 차세대 정보 컴퓨팅 기술개발사업의 지원을 받아 수행됐다.

학습되지 않은 환경에서 스스로 학습하는 모바일 센싱 기술 개발

우리 대학 전산학부 이성주 교수 연구팀이 학습되지 않은 환경에 적은 양의 데이터로 스스로 적응하는 모바일 센싱 학습 기술 <메타센스(MetaSense)>를 개발했다.

모바일 센싱이란 스마트폰과 같은 모바일 기기의 다양한 센서를 이용하여 서비스(예: 수면의 질 평가, 걸음 수 추적 등)를 제공하는 기술이다. 최근 학계에서는 기계학습 기술의 발전과 더불어 우울증 진단, 운동 자세 관리 등 진보된 모바일 센싱의 가능성을 보여줌으로써 모바일 센싱의 범위를 더욱 확장하고 있다.

하지만 이러한 센싱 기술은 아직 널리 쓰이지 못하고 있다. 사용자 개인마다 가지고 있는 모바일 센싱의 환경이 다르기 때문이다. 사람마다 가지고 있는 고유한 생활패턴과 행동방식, 서로 다른 모바일 기기와 그 사양은 센서의 값에 큰 영향을 미친다. 다른 센서 값은 사람마다 고유한 센싱 환경을 만들고, 이는 센싱 모델이 미리 학습되지 않은 새로운 환경에서 작동할 때 사용이 어려울 만큼 성능 저하를 일으킨다.

연구팀은 이런 학습되지 않는 환경에서 적은 양의 데이터 (최소 1-2 샘플)만 가지고 적응할 수 있는 '메타러닝 프레임워크'를 제시했다. 메타러닝 (meta learning) 이란 적은 양의 데이터를 가지고도 새로운 지식을 학습할 수 있도록 하는 기계학습 원리다. 연구팀이 제시한 기술은 최신 전이학습 (transfer learning) 기술과 비교하여 18%, 메타러닝 기술과 비교하여 15%의 정확도 성능향상을 보였다.

이성주 교수는 ”최근 활발히 제안되고 있는 다양한 모바일 센싱 서비스가 특정 환경에 의존하지 않고 수많은 실제 사용 환경에서 우수한 성능을 보일 수 있게 해주는 연구다. 모바일 센싱 서비스가 연구에 그치지 않고 실제 많은 사람들에게 사용될 수 있는 가능성을 제시해 의미가 있다“라고 했다. 또한 신진우 교수는 “최근 메타러닝 방법론들이 기계학습 분야에서 크게 각광을 받고 있는데 주로 영상 데이터에 국한되어 왔었다. 본 연구에서 비영상 데이터에도 범용적으로 동작하는 메터러닝 기술을 개발하여 성공한 것은 앞으로도 관련 분야 연구에 큰 영향을 주리라 기대한다“라고 덧붙였다.

연구에 대한 설명이 담긴 비디오를 다음 링크에서 확인할 수 있고, (https://youtu.be/-6y0I1pd6XI) 자세한 정보는 프로젝트 웹사이트에서 볼 수 있다.

(https://nmsl.kaist.ac.kr/projects/metasense/)

이성주 교수, 신진우 AI대학원 교수, 공태식 박사과정, 김연수 학사과정이 참여한 이번 연구 결과는 2019년 11월 11일 센싱 컴퓨팅 분야 국제 최우수학회 ACM SenSys에서 발표됐다. (논문명: MetaSense: Few-Shot Adaptation to Untrained Conditions in Deep Mobile Sensing). 이 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단과 정보통신기술진흥센터, 한국연구재단 차세대 정보 컴퓨팅 기술개발사업의 지원을 받아 수행됐다.

2020.06.09

조회수 18098

-

KAIST 사이언스 아웃리치 프로그램 참가자 모집

우리대학이 소외계층 중·고등학생을 위한 'KAIST 사이언스 아웃리치 프로그램(KAIST Science Outreach Program, 이하 KSOP)' 참가자를 모집한다.

중학교 재학생 중에서 학교장의 추천을 받은 사회통합대상자·수업이 가능한 신체장애 학생·북한 이탈주민·아동복지시설 보호 아동·소년·소녀 가장 학생 등이 지원할 수 있다. 고등학생은 1학년을 대상으로 기존 정원에서 남아있는 자리가 발생한 지역에 한해 지원자를 모집한다.

참가 신청서는 KSOP 홈페이지에서 지난 25일부터 접수 중인데 6월 19일 마감된다. 100% 서류 전형을 통해 선발된 최종 지원 대상자에게는 고3 학업 과정을 마칠 때까지 프로그램의 모든 교육 과정을 전액 무료로 제공한다. 또한, 교육 시 식사와 간식이 제공되며 가을 및 봄학기 학습 멘토링·여름 캠프 참가 자격·우수 학생 겨울 심화 캠프 참가 자격 등을 부여한다.

특히, 이번 모집을 통해 선발되는 신규 참여 학생들에게는 코로나19를 계기로 도입된 온라인 학습 멘토링을 제공할 예정이다.

지난 2014년 대전 지역을 중심으로 시작된 KSOP는 KAIST가 교육격차 해소를 목적으로 추진해온 교육 기부 프로그램이다. 소외계층 학생들에게 과학에 대한 지적 호기심과 학습 동기를 유발할 수 있는 교육 기회를 제공하기 위해 마련됐다. 이와 함께 지속적인 관심과 지원을 통해 꿈과 비전을 지닌 과학 인재로 성장할 수 있는 환경을 조성해주는 것이 주된 목표다.

2015년부터는 과학기술정보통신부의 지원을 받아 전국으로 확대해 운영하고 있으며, 지난해까지 중1~고3 학생 2천370명에게 학습 멘토링을 제공했다.

이 프로그램에 참여하는 학생들은 자기 주도적 온라인 학습을 선행한 후 전국 10개 수업장에서 월평균 2회가량 수학·과학 과목의 오프라인 교육을 받는다. 방학 중에는 KAIST에서 과학탐구 캠프를 개최하며, 50여 명의 KAIST 대학생 멘토들이 전체 교육 과정에 동참한다. 특히, 이공계 진로 멘토링을 통해 과학고에서 과기특성화대학 진학으로 이어지는 진로 사다리를 구축하는 데 힘쓰고 있다.

실제로 최근 2년간 KAIST·서울대·성균관대·POSTECH 입학생 11명을 포함해 전국 35개 대학에 51명의 합격생과 2명의 취업자도 배출했다. 합격자의 절반이 넘는 36명은 이공계 전공을 선택해 진학했다. 졸업생 중 일부는 대학생 멘토로 KSOP에 복귀해 후배 중·고생들에게 멘토링을 제공하고 있다.

중3 때부터 KSOP에 참가해 지난 2019년 KAIST에 입학한 이창민(19, 전산학부 2학년) 씨는 "KSOP을 통해 막연하게만 생각하던 이공계열 진학에 확신을 가질 수 있었다ˮ며 "열여섯의 어린 나이부터 KAIST 재학생들과 맺은 인연은 이공계 분야 진학과 관련해 정보를 얻을 수 있는 굉장히 중요한 계기가 됐다ˮ고 경험담을 전했다.

코로나19로 인해 대면 학습 멘토링이 어려워진 올해는 지난 4월 말부터 온라인을 통해 상시 학습 멘토링을 시행하고 있다. 학년별로 수학과 과학을 담당하는 KAIST 멘토가 학습 과제를 부여해 학생이 결과물을 제출하면 채점을 통해 피드백하는 방식이다. 그 외에도 학습 및 진로 관련 질의 사항을 상시 응답해주는 형태로 운영 중이며, 자체 조사결과 기존 참여 학생 550여 명 및 학부모의 만족도가 96.4%로 매우 높게 나타났다.

KSOP를 운영하는 KAIST 과학영재교육연구원 곽시종 원장은 "KSOP은 KAIST가 지금까지 국민 여러분께 받아온 사랑을 조금이나마 갚고자 만든 교육 기부프로그램ˮ이라고 전했다.

곽 원장은 이어 "지금은 비록 주변 환경의 문제로 어려움을 겪고 있다 해도 자신의 가능성을 믿고 도전하는 학생이라면 얼마든지 우리나라의 자랑스러운 이공계 인재가 될 수 있다ˮ 면서 "이를 돕는 KSOP에 많은 학생들이 참여해 스스로의 미래를 열어가길 바란다.ˮ 라고 강조했다.

KAIST 사이언스 아웃리치 프로그램 참가자 모집

우리대학이 소외계층 중·고등학생을 위한 'KAIST 사이언스 아웃리치 프로그램(KAIST Science Outreach Program, 이하 KSOP)' 참가자를 모집한다.

중학교 재학생 중에서 학교장의 추천을 받은 사회통합대상자·수업이 가능한 신체장애 학생·북한 이탈주민·아동복지시설 보호 아동·소년·소녀 가장 학생 등이 지원할 수 있다. 고등학생은 1학년을 대상으로 기존 정원에서 남아있는 자리가 발생한 지역에 한해 지원자를 모집한다.

참가 신청서는 KSOP 홈페이지에서 지난 25일부터 접수 중인데 6월 19일 마감된다. 100% 서류 전형을 통해 선발된 최종 지원 대상자에게는 고3 학업 과정을 마칠 때까지 프로그램의 모든 교육 과정을 전액 무료로 제공한다. 또한, 교육 시 식사와 간식이 제공되며 가을 및 봄학기 학습 멘토링·여름 캠프 참가 자격·우수 학생 겨울 심화 캠프 참가 자격 등을 부여한다.

특히, 이번 모집을 통해 선발되는 신규 참여 학생들에게는 코로나19를 계기로 도입된 온라인 학습 멘토링을 제공할 예정이다.

지난 2014년 대전 지역을 중심으로 시작된 KSOP는 KAIST가 교육격차 해소를 목적으로 추진해온 교육 기부 프로그램이다. 소외계층 학생들에게 과학에 대한 지적 호기심과 학습 동기를 유발할 수 있는 교육 기회를 제공하기 위해 마련됐다. 이와 함께 지속적인 관심과 지원을 통해 꿈과 비전을 지닌 과학 인재로 성장할 수 있는 환경을 조성해주는 것이 주된 목표다.

2015년부터는 과학기술정보통신부의 지원을 받아 전국으로 확대해 운영하고 있으며, 지난해까지 중1~고3 학생 2천370명에게 학습 멘토링을 제공했다.

이 프로그램에 참여하는 학생들은 자기 주도적 온라인 학습을 선행한 후 전국 10개 수업장에서 월평균 2회가량 수학·과학 과목의 오프라인 교육을 받는다. 방학 중에는 KAIST에서 과학탐구 캠프를 개최하며, 50여 명의 KAIST 대학생 멘토들이 전체 교육 과정에 동참한다. 특히, 이공계 진로 멘토링을 통해 과학고에서 과기특성화대학 진학으로 이어지는 진로 사다리를 구축하는 데 힘쓰고 있다.

실제로 최근 2년간 KAIST·서울대·성균관대·POSTECH 입학생 11명을 포함해 전국 35개 대학에 51명의 합격생과 2명의 취업자도 배출했다. 합격자의 절반이 넘는 36명은 이공계 전공을 선택해 진학했다. 졸업생 중 일부는 대학생 멘토로 KSOP에 복귀해 후배 중·고생들에게 멘토링을 제공하고 있다.

중3 때부터 KSOP에 참가해 지난 2019년 KAIST에 입학한 이창민(19, 전산학부 2학년) 씨는 "KSOP을 통해 막연하게만 생각하던 이공계열 진학에 확신을 가질 수 있었다ˮ며 "열여섯의 어린 나이부터 KAIST 재학생들과 맺은 인연은 이공계 분야 진학과 관련해 정보를 얻을 수 있는 굉장히 중요한 계기가 됐다ˮ고 경험담을 전했다.

코로나19로 인해 대면 학습 멘토링이 어려워진 올해는 지난 4월 말부터 온라인을 통해 상시 학습 멘토링을 시행하고 있다. 학년별로 수학과 과학을 담당하는 KAIST 멘토가 학습 과제를 부여해 학생이 결과물을 제출하면 채점을 통해 피드백하는 방식이다. 그 외에도 학습 및 진로 관련 질의 사항을 상시 응답해주는 형태로 운영 중이며, 자체 조사결과 기존 참여 학생 550여 명 및 학부모의 만족도가 96.4%로 매우 높게 나타났다.

KSOP를 운영하는 KAIST 과학영재교육연구원 곽시종 원장은 "KSOP은 KAIST가 지금까지 국민 여러분께 받아온 사랑을 조금이나마 갚고자 만든 교육 기부프로그램ˮ이라고 전했다.

곽 원장은 이어 "지금은 비록 주변 환경의 문제로 어려움을 겪고 있다 해도 자신의 가능성을 믿고 도전하는 학생이라면 얼마든지 우리나라의 자랑스러운 이공계 인재가 될 수 있다ˮ 면서 "이를 돕는 KSOP에 많은 학생들이 참여해 스스로의 미래를 열어가길 바란다.ˮ 라고 강조했다.

2020.05.30

조회수 20243

-

정확성이 획기적으로 향상된 코로나19 영상 진단 기술 개발

우리 대학 바이오및뇌공학과 예종철 교수 연구팀이 흉부 단순 방사선 촬영 영상으로 신종 코로나바이러스 감염증(이하 코로나19) 진단의 정확성을 획기적으로 개선한 인공지능(AI) 기술을 개발했다.

예 교수 연구팀이 개발한 인공지능 기술을 사용해 코로나19 감염 여부를 진단한 결과, 영상 판독 전문가의 69%보다 17%가 향상된 86%이상의 우수한 정확성을 보였다고 KAIST 관계자는 설명했다.

이 기술을 세계적으로 대유행하는 코로나19 선별 진료(Triage)체계에 도입하면 상시 신속한 진단이 가능할 뿐만 아니라 한정된 의료 자원의 효율적인 사용에 큰 도움을 줄 것으로 기대된다.

오유진 박사과정과 박상준 박사과정이 공동 1저자로 참여한 이 연구 결과는 국제 학술지 `아이트리플이 트랜잭션 온 메디컬 이미징(IEEE transactions on medical imaging)'의 `영상기반 코로나19 진단 인공지능기술' 특집호 5월 8일 字 온라인판에 게재됐다. (논문명 : Deep Learning COVID-19 Features on CXR using Limited Training Data Sets)

현재 전 세계적으로 확진자 500만 명을 넘긴 코로나19 진단검사에는 통상 역전사 중합 효소 연쇄 반응(RT-PCR, Reverse Transcription Polymerase Chain Reaction)을 이용한 장비가 사용된다. RT-PCR 검사의 정확성은 90% 이상으로 알려져 있으나, 검사 결과가 나오기까지는 많은 시간이 걸리며 모든 환자에게 시행하기에 비용이 많이 든다는 단점이 있다.

컴퓨터 단층촬영(CT, Computed Tomography)을 이용한 검사도 비교적 높은 정확성을 보이지만 일반적인 X선 단순촬영 검사에 비해 많은 시간이 소요되고 바이러스에 의한 장비의 오염 가능성 때문에 선별 진료에 사용되기 어렵다.

흉부 단순 방사선 촬영(CXR, Chest X-ray)은 여러 폐 질환에서 표준 선별 검사로 활용되고 있지만 코로나19에는 RT-PCR와 CT 검사에 비해 정확성이 현저하게 떨어진다. 그러나, 최근 팬데믹으로 세계 각국에서 확진자 수가 급증함에 따라 비용이 적게 들어가고 검사방법이 용이한 CXR 검사를 정확성을 높여 활용하자는 요구가 증가하고 있다.

그동안 심층 학습(Deep Learning) 기법을 적용해 CXR 영상을 통해 코로나19를 진단하는 여러 연구사례가 보고되고 있지만 진단 정확성을 높이기 위해서는 많은 양의 데이터 확보가 필수적이며 현재와 같은 비상 상황에서는 일관되게 정제된 대량의 데이터를 수집하기가 극히 어렵다.

예 교수 연구팀은 자체 개발한 전처리(Preprocessing)와 국소 패치 기반 방식(Local Patch-based Approach)을 통해 이런 문제점을 해결했다. 적은 데이터 세트에서 발생할 수 있는 영상 간 이질성(Heterogeneity)을 일관된 전처리 과정으로 정규화한 뒤, 국소 패치 기반 방식으로 하나의 영상에서 다양한 패치 영상들을 얻어냄으로써 이미지의 다양성을 확보했다.

또 국소 패치 기반 방식의 장점을 활용한 새로운 인공지능 기술인 `확률적 특징 지도 시각화(Probabilistic Saliency Map Visualization)' 방식을 활용해 CXR 영상에서 코로나19 진단에 중요한 부분을 고화질로 강조해주는 특징 지도를 만들었는데 이 지도가 진단 영상학적 특징과 일치하는 것을 확인했다.

예종철 교수는 "인공지능 알고리즘 기술을 환자의 선별 진료에 활용하면 코로나19 감염 여부를 상시 신속하게 진단할 수 있고 이를 통해 가능성이 낮은 환자를 배제함으로써 한정된 의료 자원을 보다 우선순위가 높은 대상에게 효율적으로 배분할 수 있게 해줄 것ˮ 이라고 말했다.

한편, 이 연구는 한국연구재단 중견연구자지원사업의 지원을 받아 수행됐다.

정확성이 획기적으로 향상된 코로나19 영상 진단 기술 개발

우리 대학 바이오및뇌공학과 예종철 교수 연구팀이 흉부 단순 방사선 촬영 영상으로 신종 코로나바이러스 감염증(이하 코로나19) 진단의 정확성을 획기적으로 개선한 인공지능(AI) 기술을 개발했다.

예 교수 연구팀이 개발한 인공지능 기술을 사용해 코로나19 감염 여부를 진단한 결과, 영상 판독 전문가의 69%보다 17%가 향상된 86%이상의 우수한 정확성을 보였다고 KAIST 관계자는 설명했다.

이 기술을 세계적으로 대유행하는 코로나19 선별 진료(Triage)체계에 도입하면 상시 신속한 진단이 가능할 뿐만 아니라 한정된 의료 자원의 효율적인 사용에 큰 도움을 줄 것으로 기대된다.

오유진 박사과정과 박상준 박사과정이 공동 1저자로 참여한 이 연구 결과는 국제 학술지 `아이트리플이 트랜잭션 온 메디컬 이미징(IEEE transactions on medical imaging)'의 `영상기반 코로나19 진단 인공지능기술' 특집호 5월 8일 字 온라인판에 게재됐다. (논문명 : Deep Learning COVID-19 Features on CXR using Limited Training Data Sets)

현재 전 세계적으로 확진자 500만 명을 넘긴 코로나19 진단검사에는 통상 역전사 중합 효소 연쇄 반응(RT-PCR, Reverse Transcription Polymerase Chain Reaction)을 이용한 장비가 사용된다. RT-PCR 검사의 정확성은 90% 이상으로 알려져 있으나, 검사 결과가 나오기까지는 많은 시간이 걸리며 모든 환자에게 시행하기에 비용이 많이 든다는 단점이 있다.

컴퓨터 단층촬영(CT, Computed Tomography)을 이용한 검사도 비교적 높은 정확성을 보이지만 일반적인 X선 단순촬영 검사에 비해 많은 시간이 소요되고 바이러스에 의한 장비의 오염 가능성 때문에 선별 진료에 사용되기 어렵다.

흉부 단순 방사선 촬영(CXR, Chest X-ray)은 여러 폐 질환에서 표준 선별 검사로 활용되고 있지만 코로나19에는 RT-PCR와 CT 검사에 비해 정확성이 현저하게 떨어진다. 그러나, 최근 팬데믹으로 세계 각국에서 확진자 수가 급증함에 따라 비용이 적게 들어가고 검사방법이 용이한 CXR 검사를 정확성을 높여 활용하자는 요구가 증가하고 있다.

그동안 심층 학습(Deep Learning) 기법을 적용해 CXR 영상을 통해 코로나19를 진단하는 여러 연구사례가 보고되고 있지만 진단 정확성을 높이기 위해서는 많은 양의 데이터 확보가 필수적이며 현재와 같은 비상 상황에서는 일관되게 정제된 대량의 데이터를 수집하기가 극히 어렵다.

예 교수 연구팀은 자체 개발한 전처리(Preprocessing)와 국소 패치 기반 방식(Local Patch-based Approach)을 통해 이런 문제점을 해결했다. 적은 데이터 세트에서 발생할 수 있는 영상 간 이질성(Heterogeneity)을 일관된 전처리 과정으로 정규화한 뒤, 국소 패치 기반 방식으로 하나의 영상에서 다양한 패치 영상들을 얻어냄으로써 이미지의 다양성을 확보했다.

또 국소 패치 기반 방식의 장점을 활용한 새로운 인공지능 기술인 `확률적 특징 지도 시각화(Probabilistic Saliency Map Visualization)' 방식을 활용해 CXR 영상에서 코로나19 진단에 중요한 부분을 고화질로 강조해주는 특징 지도를 만들었는데 이 지도가 진단 영상학적 특징과 일치하는 것을 확인했다.

예종철 교수는 "인공지능 알고리즘 기술을 환자의 선별 진료에 활용하면 코로나19 감염 여부를 상시 신속하게 진단할 수 있고 이를 통해 가능성이 낮은 환자를 배제함으로써 한정된 의료 자원을 보다 우선순위가 높은 대상에게 효율적으로 배분할 수 있게 해줄 것ˮ 이라고 말했다.

한편, 이 연구는 한국연구재단 중견연구자지원사업의 지원을 받아 수행됐다.

2020.05.25

조회수 17252

-

피부형 센서 패치 하나로 사람 움직임을 측정하는 기술 개발

우리 대학 전산학부 조성호 교수 연구팀이 서울대 기계공학과 고승환 교수 연구팀과 협력 연구를 통해 딥러닝 기술을 센서와 결합, 최소한의 데이터로 인체 움직임을 정확하게 측정 가능한 유연한 `피부 형 센서'를 개발했다.

공동연구팀이 개발한 피부 형 센서에는 인체의 움직임에 의해 발생하는 복합적 신호를 피부에 부착한 최소한의 센서로 정밀하게 측정하고, 이를 딥러닝 기술로 분리, 분석하는 기술이 적용됐다.

이번 연구에는 김민(우리 대학), 김권규(서울대), 하인호(서울대) 박사과정이 공동 제1 저자로 참여했으며 국제 학술지 `네이처 커뮤니케이션스(Nature Communications)' 5월 1일 字 온라인판에 게재됐다. (논문명 : A deep-learned skin decoding the epicentral human motions).

사람의 움직임 측정 방법 중 가장 널리 쓰이는 방식인 모션 캡처 카메라를 사용하는 방식은 카메라가 설치된 공간에서만 움직임 측정이 가능해 장소적 제약을 받아왔다. 반면 웨어러블 장비를 사용할 경우 장소제약 없이 사용자의 상태 변화를 측정할 수 있어, 다양한 환경에서 사람의 상태를 전달할 수 있다.

다만 기존 웨어러블 기기들은 측정 부위에 직접 센서를 부착해 측정이 이뤄지기 때문에 측정 부위, 즉 관절이 늘어나면 더 많은 센서가 수십 개에서 많게는 수백 개까지 요구된다는 단점이 있다.

공동연구팀이 개발한 피부 형 센서는 `크랙' 에 기반한 고(高) 민감 센서로, 인체의 움직임이 발생하는 근원지에서 먼 위치에 부착해서 간접적으로도 인체의 움직임을 측정할 수 있다. `크랙' 이란 나노 입자에 균열이 생긴다는 뜻인데, 연구팀은 이 균열로 인해 발생하는 센서값을 변화시켜 미세한 손목 움직임 변화까지 측정할 수 있다고 설명했다.

연구팀은 또 딥러닝 모델을 사용, 센서의 시계열 신호를 분석해 손목에 부착된 단 하나의 센서 신호로 여러 가지 손가락 관절 움직임을 측정할 수 있게 했다. 사용자별 신호 차이를 교정하고, 데이터 수집을 최소화하기 위해서는 전이학습(Transfer Learning)을 통해 기존 학습된 지식을 전달했다. 이로써 적은 양의 데이터와 적은 학습 시간으로 모델을 학습하는 시스템을 완성하는 데 성공했다.

우리 대학 전산학부 조성호 교수는 "이번 연구는 딥러닝 기술을 활용해 실제 환경에서 더욱 효과적으로 사람의 실시간 정보를 획득하는 방법을 제시했다는 점에서 의미가 있다ˮ며 "이 측정 방법을 적용하면 웨어러블 증강현실 기술의 보편화 시대는 더욱 빨리 다가올 것ˮ 이라고 예상했다.

한편, 이번 연구는 한국연구재단 기초연구사업(선도 연구센터 지원사업 ERC)과 기초연구사업 (중견연구자)의 지원을 받아 수행됐다.

< 피부형 센서 패치로 손가락 움직임 측정 모습 >

피부형 센서 패치 하나로 사람 움직임을 측정하는 기술 개발

우리 대학 전산학부 조성호 교수 연구팀이 서울대 기계공학과 고승환 교수 연구팀과 협력 연구를 통해 딥러닝 기술을 센서와 결합, 최소한의 데이터로 인체 움직임을 정확하게 측정 가능한 유연한 `피부 형 센서'를 개발했다.

공동연구팀이 개발한 피부 형 센서에는 인체의 움직임에 의해 발생하는 복합적 신호를 피부에 부착한 최소한의 센서로 정밀하게 측정하고, 이를 딥러닝 기술로 분리, 분석하는 기술이 적용됐다.

이번 연구에는 김민(우리 대학), 김권규(서울대), 하인호(서울대) 박사과정이 공동 제1 저자로 참여했으며 국제 학술지 `네이처 커뮤니케이션스(Nature Communications)' 5월 1일 字 온라인판에 게재됐다. (논문명 : A deep-learned skin decoding the epicentral human motions).

사람의 움직임 측정 방법 중 가장 널리 쓰이는 방식인 모션 캡처 카메라를 사용하는 방식은 카메라가 설치된 공간에서만 움직임 측정이 가능해 장소적 제약을 받아왔다. 반면 웨어러블 장비를 사용할 경우 장소제약 없이 사용자의 상태 변화를 측정할 수 있어, 다양한 환경에서 사람의 상태를 전달할 수 있다.

다만 기존 웨어러블 기기들은 측정 부위에 직접 센서를 부착해 측정이 이뤄지기 때문에 측정 부위, 즉 관절이 늘어나면 더 많은 센서가 수십 개에서 많게는 수백 개까지 요구된다는 단점이 있다.

공동연구팀이 개발한 피부 형 센서는 `크랙' 에 기반한 고(高) 민감 센서로, 인체의 움직임이 발생하는 근원지에서 먼 위치에 부착해서 간접적으로도 인체의 움직임을 측정할 수 있다. `크랙' 이란 나노 입자에 균열이 생긴다는 뜻인데, 연구팀은 이 균열로 인해 발생하는 센서값을 변화시켜 미세한 손목 움직임 변화까지 측정할 수 있다고 설명했다.

연구팀은 또 딥러닝 모델을 사용, 센서의 시계열 신호를 분석해 손목에 부착된 단 하나의 센서 신호로 여러 가지 손가락 관절 움직임을 측정할 수 있게 했다. 사용자별 신호 차이를 교정하고, 데이터 수집을 최소화하기 위해서는 전이학습(Transfer Learning)을 통해 기존 학습된 지식을 전달했다. 이로써 적은 양의 데이터와 적은 학습 시간으로 모델을 학습하는 시스템을 완성하는 데 성공했다.

우리 대학 전산학부 조성호 교수는 "이번 연구는 딥러닝 기술을 활용해 실제 환경에서 더욱 효과적으로 사람의 실시간 정보를 획득하는 방법을 제시했다는 점에서 의미가 있다ˮ며 "이 측정 방법을 적용하면 웨어러블 증강현실 기술의 보편화 시대는 더욱 빨리 다가올 것ˮ 이라고 예상했다.

한편, 이번 연구는 한국연구재단 기초연구사업(선도 연구센터 지원사업 ERC)과 기초연구사업 (중견연구자)의 지원을 받아 수행됐다.

< 피부형 센서 패치로 손가락 움직임 측정 모습 >

2020.05.20

조회수 15471

-

초저조도/초고조도 환경에서도 모션 블러 없는 고화질 및 고해상도 영상 생성이 가능한 알고리즘 개발

우리 대학 기계공학과 윤국진 교수 연구팀이 영국 임페리얼 칼리지 김태균 교수 연구팀과 GIST 최종현 교수 공동 연구팀과의 2건의 공동 연구를 통해 이벤트 카메라를 활용한 고화질 및 고해상도 영상 생성 알고리즘들을 개발했다.

연구팀은 이번에 개발한 알고리즘들을 통해 기존의 RGB 기반 카메라가 영상을 획득하지 못하는 초저조도/초고조도 환경에서도 이벤트 카메라(Event Camera)를 활용하여 고화질 및 고해상도 영상을 생성할 수 있고, 특히 이벤트 카메라의 장점을 살려 초고속의 움직임에도 모션 블러(motion blur, 빠른 움직임에 의한 영상 열화) 없는 고프레임율의 영상을 생성할 수 있다고 밝혔다.

이벤트 카메라는 카메라 각 화소에 입사하는 빛의 세기의 변화에 반응하여 광역동적범위(High Dynamic Range)에서 매우 짧은 지연 시간을 갖는 비동기적 이벤트 데이터를 영상 정보로 제공하기 때문에, 기존 RGB 카메라가 영상을 획득할 수 없었던 고조도/저조도 환경에서도 영상 데이터 획득이 가능하고 또한 초고속 움직임을 갖는 피사체에 대한 영상 데이터 획득이 가능하다는 장점이 있다.

하지만 기존의 영상과는 다른 형태의 영상 정보를 제공하기 때문에 기존의 영상 이해 기술을 접목시키기 어렵고 또한 센서의 제약으로 인해 영상의 해상도가 낮다는 단점이 있다. 연구팀은 이벤트 카메라의 장점을 유지하면서 이와 같은 문제를 해결하기 위해 이벤트 데이터로부터 고화질의 초고해상도의 영상을 생성해 내기 위한 최적화된 심층 신경망과 학습 알고리즘들을 제안하였다. 제안된 알고리즘들은 이벤트 카메라로부터 획득된 이벤트 데이터를 일정 시간 동안 누적하여 딥러닝 기반의 합성곱 신경망을 통해 영상을 생성하는 방식으로, 두 공동 연구에서 각각 교사 학습/비교사 학습 기반의 알고리즘을 제안하였는데, 제안된 두 알고리즘들 모두 이벤트 카메라의 장점을 유지할 수 있어 초당 최대 100만 프레임의 영상 생성이 가능하여 조명의 변화가 극심한 환경이나 고속 움직임에 대한 분석이 필요한 다양한 분야에 적용 가능할 것으로 기대된다.

윤국진 교수는 “본 기술은 이벤트 카메라를 활용한 영상 기반 상황 인식을 위한 기술로서, 기존 RGB 카메라로는 검출이 어려운 조명 변화가 극심한 상황에서 사용될 수 있고, 초고속 움직임에 대한 분석이 가능하기 때문에 자율주행 자동차, 드론, 로봇 등에 다양하게 활용될 것으로 기대한다.”고 말했다.

Mohammad Mostafavi 박사과정(GIST)이 1저자로 참여한 공동 연구와 Wang Lin 박사과정(KAIST)이 1저자로 참여한 공동 연구 논문들은 오는 6월에 개최 예정인 컴퓨터 비전/기계학습 분야의 국제 학술대회인 ‘IEEE Conference on Computer Vision and Pattern Recognition (CVPR)에 각각 구술/포스터 논문으로 발표될 예정이다. (논문명: (1) Learning to Super Resolve Intensity Images from Events, 이벤트를 활용한 초고해상도 이미지 생성 학습법, (2) EventSR: From Asynchronous Events to Image Reconstruction, Restoration, and Super-Resolution via End-to-End Adversarial Learning, 적대적 신경망 학습을 통한 비동기적 이벤트의 이미지로의 재구성, 복원 및 초해상도 연구)

한편, 이번 연구는 한국연구재단 중견연구자지원사업(NRF-2018R1A2B3008640)과 차세대정보・컴퓨팅기술개발사업(NRF-2017M3C4A7069369)의 지원을 받아 수행됐다.

초저조도/초고조도 환경에서도 모션 블러 없는 고화질 및 고해상도 영상 생성이 가능한 알고리즘 개발

우리 대학 기계공학과 윤국진 교수 연구팀이 영국 임페리얼 칼리지 김태균 교수 연구팀과 GIST 최종현 교수 공동 연구팀과의 2건의 공동 연구를 통해 이벤트 카메라를 활용한 고화질 및 고해상도 영상 생성 알고리즘들을 개발했다.

연구팀은 이번에 개발한 알고리즘들을 통해 기존의 RGB 기반 카메라가 영상을 획득하지 못하는 초저조도/초고조도 환경에서도 이벤트 카메라(Event Camera)를 활용하여 고화질 및 고해상도 영상을 생성할 수 있고, 특히 이벤트 카메라의 장점을 살려 초고속의 움직임에도 모션 블러(motion blur, 빠른 움직임에 의한 영상 열화) 없는 고프레임율의 영상을 생성할 수 있다고 밝혔다.

이벤트 카메라는 카메라 각 화소에 입사하는 빛의 세기의 변화에 반응하여 광역동적범위(High Dynamic Range)에서 매우 짧은 지연 시간을 갖는 비동기적 이벤트 데이터를 영상 정보로 제공하기 때문에, 기존 RGB 카메라가 영상을 획득할 수 없었던 고조도/저조도 환경에서도 영상 데이터 획득이 가능하고 또한 초고속 움직임을 갖는 피사체에 대한 영상 데이터 획득이 가능하다는 장점이 있다.

하지만 기존의 영상과는 다른 형태의 영상 정보를 제공하기 때문에 기존의 영상 이해 기술을 접목시키기 어렵고 또한 센서의 제약으로 인해 영상의 해상도가 낮다는 단점이 있다. 연구팀은 이벤트 카메라의 장점을 유지하면서 이와 같은 문제를 해결하기 위해 이벤트 데이터로부터 고화질의 초고해상도의 영상을 생성해 내기 위한 최적화된 심층 신경망과 학습 알고리즘들을 제안하였다. 제안된 알고리즘들은 이벤트 카메라로부터 획득된 이벤트 데이터를 일정 시간 동안 누적하여 딥러닝 기반의 합성곱 신경망을 통해 영상을 생성하는 방식으로, 두 공동 연구에서 각각 교사 학습/비교사 학습 기반의 알고리즘을 제안하였는데, 제안된 두 알고리즘들 모두 이벤트 카메라의 장점을 유지할 수 있어 초당 최대 100만 프레임의 영상 생성이 가능하여 조명의 변화가 극심한 환경이나 고속 움직임에 대한 분석이 필요한 다양한 분야에 적용 가능할 것으로 기대된다.

윤국진 교수는 “본 기술은 이벤트 카메라를 활용한 영상 기반 상황 인식을 위한 기술로서, 기존 RGB 카메라로는 검출이 어려운 조명 변화가 극심한 상황에서 사용될 수 있고, 초고속 움직임에 대한 분석이 가능하기 때문에 자율주행 자동차, 드론, 로봇 등에 다양하게 활용될 것으로 기대한다.”고 말했다.

Mohammad Mostafavi 박사과정(GIST)이 1저자로 참여한 공동 연구와 Wang Lin 박사과정(KAIST)이 1저자로 참여한 공동 연구 논문들은 오는 6월에 개최 예정인 컴퓨터 비전/기계학습 분야의 국제 학술대회인 ‘IEEE Conference on Computer Vision and Pattern Recognition (CVPR)에 각각 구술/포스터 논문으로 발표될 예정이다. (논문명: (1) Learning to Super Resolve Intensity Images from Events, 이벤트를 활용한 초고해상도 이미지 생성 학습법, (2) EventSR: From Asynchronous Events to Image Reconstruction, Restoration, and Super-Resolution via End-to-End Adversarial Learning, 적대적 신경망 학습을 통한 비동기적 이벤트의 이미지로의 재구성, 복원 및 초해상도 연구)

한편, 이번 연구는 한국연구재단 중견연구자지원사업(NRF-2018R1A2B3008640)과 차세대정보・컴퓨팅기술개발사업(NRF-2017M3C4A7069369)의 지원을 받아 수행됐다.

2020.05.12

조회수 14094

이수현 교수팀, 뇌 복부선조영역의 새로운 기억관련 기능 규명

우리 대학 바이오및뇌공학과 이수현 교수 연구팀과 서울대학교 생명과학부 김형 교수 연구팀이 공동연구를 통해 복부선조영역(ventral striatum)에서 습관행동을 제어하는데 필요한 장기기억이 자동적으로 인출된다는 사실을 밝혔다. 이러한 복부선조영역의 기능을 그 영역과 회로별로 규명하는 것은 인간에게 직접 적용할 수 있는 뇌질환 치료방법 개발과 뇌영역 맞춤형 치료의 이론적 기반이 될 수 있다.

뇌의 복부선조영역은 새로운 가치학습에 중요하며, 중독행동과 조현병 관련 행동에도 연관된 것으로 알려져 왔지만 이러한 행동에 기반이 될 수 있는 기억정보를 처리하고 있는지에 대해서는 불분명했다.

이에 연구팀은 기능적 자기공명뇌영상과 전기생리학적 뇌세포 활성측정법을 모두 이용해 과거에 학습한 물체를 의식적으로 인지하고 있지 않는 상황에서도 복부선조에서 과거에 배운 좋은 물체에 대한 장기기억정보가 활발하게 처리되고 있다는 사실을 밝혀냈다.

또한 자동적으로 인출된 좋은 물체에 대한 기억은 무의식적이며 자동적인 행동, 즉 습관행동을 제어하고, 이를 통해 동물이 장기기억을 기반으로 최대이익을 얻을 수 있는 자동적 의사결정(automatic decision-making) 과정에 사용된다는 실험적 증거를 제시했다.

바이오및뇌공학과 뇌인지공학프로그램 강준영 석박사통합과정 학생이 제1 저자로 참여한 이번 연구는 국제학술지 네이쳐 커뮤니케이션즈(Nature Communications)에 4월 8일(목) 게재됐다.

복부선조영역에서 기억의 자동적 인출과정을 이해함으로써 자동적 행동인 습관과 중독행동 제어의 이론적 기반을 다지고, 나아가 기억의 자동인출(automatic retrieval)과 연관된 현저성(salience) 이상으로 조현병을 이해할 수 있는 이론적 발판을 마련한 것에 이번 연구의 의의가 있다고 볼 수 있다.

이번 연구는 한국연구재단 뇌질환극복사업 및 개인기초연구지원사업 등의 지원을 받아 수행됐다.

2021.04.09 조회수 73272

이수현 교수팀, 뇌 복부선조영역의 새로운 기억관련 기능 규명

우리 대학 바이오및뇌공학과 이수현 교수 연구팀과 서울대학교 생명과학부 김형 교수 연구팀이 공동연구를 통해 복부선조영역(ventral striatum)에서 습관행동을 제어하는데 필요한 장기기억이 자동적으로 인출된다는 사실을 밝혔다. 이러한 복부선조영역의 기능을 그 영역과 회로별로 규명하는 것은 인간에게 직접 적용할 수 있는 뇌질환 치료방법 개발과 뇌영역 맞춤형 치료의 이론적 기반이 될 수 있다.

뇌의 복부선조영역은 새로운 가치학습에 중요하며, 중독행동과 조현병 관련 행동에도 연관된 것으로 알려져 왔지만 이러한 행동에 기반이 될 수 있는 기억정보를 처리하고 있는지에 대해서는 불분명했다.

이에 연구팀은 기능적 자기공명뇌영상과 전기생리학적 뇌세포 활성측정법을 모두 이용해 과거에 학습한 물체를 의식적으로 인지하고 있지 않는 상황에서도 복부선조에서 과거에 배운 좋은 물체에 대한 장기기억정보가 활발하게 처리되고 있다는 사실을 밝혀냈다.

또한 자동적으로 인출된 좋은 물체에 대한 기억은 무의식적이며 자동적인 행동, 즉 습관행동을 제어하고, 이를 통해 동물이 장기기억을 기반으로 최대이익을 얻을 수 있는 자동적 의사결정(automatic decision-making) 과정에 사용된다는 실험적 증거를 제시했다.

바이오및뇌공학과 뇌인지공학프로그램 강준영 석박사통합과정 학생이 제1 저자로 참여한 이번 연구는 국제학술지 네이쳐 커뮤니케이션즈(Nature Communications)에 4월 8일(목) 게재됐다.

복부선조영역에서 기억의 자동적 인출과정을 이해함으로써 자동적 행동인 습관과 중독행동 제어의 이론적 기반을 다지고, 나아가 기억의 자동인출(automatic retrieval)과 연관된 현저성(salience) 이상으로 조현병을 이해할 수 있는 이론적 발판을 마련한 것에 이번 연구의 의의가 있다고 볼 수 있다.

이번 연구는 한국연구재단 뇌질환극복사업 및 개인기초연구지원사업 등의 지원을 받아 수행됐다.

2021.04.09 조회수 73272 인공지능으로 3차원 고해상도 나노입자 영상화 기술 개발

우리 대학 바이오및뇌공학과 예종철 교수 연구팀이 삼성전자 종합기술원과 공동연구를 통해 나노입자의 3차원 형상과 조성 분포의 복원 성능을 획기적으로 향상한 인공지능 기술을 개발했다고 16일 밝혔다. 공동연구팀은 에너지 분산형 X선 분광법(EDX)을 주사 투과전자현미경(STEM)과 결합한 시스템을 활용했다.

이번 연구를 통해 나노입자를 형성하고 있는 물질의 형상과 조성 분포를 정확하게 재구성함으로써, 실제 상용 디스플레이를 구성하는 양자점(퀀텀닷)과 같은 반도체 입자의 정확한 분석에 도움을 줄 것으로 기대된다.

예종철 교수 연구팀의 한요섭 박사, 차은주 박사과정, 정형진 석사과정과 삼성종합기술원의 이은하 전문연구원팀의 장재덕, 이준호 전문연구원이 공동 제1 저자로 참여한 이번 연구 결과는 국제 학술지 `네이처 머신 인텔리전스(Nature Machine Intelligence)' 2월 8일 字 온라인판에 게재됐다. (논문명 : Deep learning STEM-EDX tomography of nanocrystals)

에너지 분산형 X선 분광법(이하 EDX)은 나노입자의 성분 분석에 주로 이용되며, X선과 반응한 물체의 성분에 따라 고유한 방출 스펙트럼을 보인다는 점에서 화학적인 분석이 가능하다. 퀀텀닷 및 배터리 등 다양한 나노 소재의 열화 메커니즘과 결함을 해석하기 위해 형상 및 조성 분포 분석이 가능한 이 분광법의 필요성과 중요도가 급증하고 있다.

그러나 EDX 측정 신호의 해상도를 향상하기 위해, 나노 소재를 오랜 시간 전자빔에 노출하면 소재의 영구적인 피해가 발생한다. 이로 인해 나노입자의 3차원 영상화를 위한 투사(projection) 데이터 획득 시간이 제한되며, 한 각도에서의 스캔 시간을 단축하거나 측정하는 각도를 줄이는 방식이 사용된다. 기존의 방식으로 획득된 투사 데이터를 이용해 3차원 영상을 복원할 시, 미량 존재하는 원자 신호의 측정이 불가능하거나 복원 영상의 정밀도와 해상도가 매우 낮다.

그러나 공동 연구팀이 자체 개발한 인공지능 기반의 커널 회귀(kernel regression)와 투사 데이터 향상(projection enhancement)은 정밀도와 해상도를 획기적으로 발전시켰다. 연구팀은 측정된 데이터의 분포를 네트워크가 스스로 학습하는 인공지능 기반의 커널 회귀를 통해 스캔 시간이 단축된 투사 데이터의 신호 대 잡음비(SNR)를 높인 데이터를 제공하는 네트워크를 개발했다. 그리고 개선된 고화질의 EDX 투사 데이터를 기반으로 기존의 방법으로는 불가능했던 적은 수의 투사 데이터로부터 더욱 정확한 3차원 복원 영상을 제공하는 데 성공했다.

연구팀이 개발한 알고리즘은 기존의 EDX 측정 신호 기반 3차원 재구성 기법과 비교해 나노입자를 형성하고 있는 원자의 형상과 경계를 뚜렷하게 구별했으며, 복원된 다양한 코어-쉘(core-shell) 구조의 퀀텀닷 3차원 영상이 샘플의 광학적 특성과 높은 상관관계를 나타내는 것이 확인됐다.

예종철 교수는 "연구에서 개발한 인공지능 기술을 통해 상용 디스플레이의 핵심 기반이 되는 퀀텀닷 및 반도체 소자의 양자 효율과 화학적 안정성을 더욱 정밀하게 분석할 수 있다ˮ고 말했다.

2021.02.16 조회수 85901

인공지능으로 3차원 고해상도 나노입자 영상화 기술 개발

우리 대학 바이오및뇌공학과 예종철 교수 연구팀이 삼성전자 종합기술원과 공동연구를 통해 나노입자의 3차원 형상과 조성 분포의 복원 성능을 획기적으로 향상한 인공지능 기술을 개발했다고 16일 밝혔다. 공동연구팀은 에너지 분산형 X선 분광법(EDX)을 주사 투과전자현미경(STEM)과 결합한 시스템을 활용했다.

이번 연구를 통해 나노입자를 형성하고 있는 물질의 형상과 조성 분포를 정확하게 재구성함으로써, 실제 상용 디스플레이를 구성하는 양자점(퀀텀닷)과 같은 반도체 입자의 정확한 분석에 도움을 줄 것으로 기대된다.

예종철 교수 연구팀의 한요섭 박사, 차은주 박사과정, 정형진 석사과정과 삼성종합기술원의 이은하 전문연구원팀의 장재덕, 이준호 전문연구원이 공동 제1 저자로 참여한 이번 연구 결과는 국제 학술지 `네이처 머신 인텔리전스(Nature Machine Intelligence)' 2월 8일 字 온라인판에 게재됐다. (논문명 : Deep learning STEM-EDX tomography of nanocrystals)

에너지 분산형 X선 분광법(이하 EDX)은 나노입자의 성분 분석에 주로 이용되며, X선과 반응한 물체의 성분에 따라 고유한 방출 스펙트럼을 보인다는 점에서 화학적인 분석이 가능하다. 퀀텀닷 및 배터리 등 다양한 나노 소재의 열화 메커니즘과 결함을 해석하기 위해 형상 및 조성 분포 분석이 가능한 이 분광법의 필요성과 중요도가 급증하고 있다.

그러나 EDX 측정 신호의 해상도를 향상하기 위해, 나노 소재를 오랜 시간 전자빔에 노출하면 소재의 영구적인 피해가 발생한다. 이로 인해 나노입자의 3차원 영상화를 위한 투사(projection) 데이터 획득 시간이 제한되며, 한 각도에서의 스캔 시간을 단축하거나 측정하는 각도를 줄이는 방식이 사용된다. 기존의 방식으로 획득된 투사 데이터를 이용해 3차원 영상을 복원할 시, 미량 존재하는 원자 신호의 측정이 불가능하거나 복원 영상의 정밀도와 해상도가 매우 낮다.

그러나 공동 연구팀이 자체 개발한 인공지능 기반의 커널 회귀(kernel regression)와 투사 데이터 향상(projection enhancement)은 정밀도와 해상도를 획기적으로 발전시켰다. 연구팀은 측정된 데이터의 분포를 네트워크가 스스로 학습하는 인공지능 기반의 커널 회귀를 통해 스캔 시간이 단축된 투사 데이터의 신호 대 잡음비(SNR)를 높인 데이터를 제공하는 네트워크를 개발했다. 그리고 개선된 고화질의 EDX 투사 데이터를 기반으로 기존의 방법으로는 불가능했던 적은 수의 투사 데이터로부터 더욱 정확한 3차원 복원 영상을 제공하는 데 성공했다.

연구팀이 개발한 알고리즘은 기존의 EDX 측정 신호 기반 3차원 재구성 기법과 비교해 나노입자를 형성하고 있는 원자의 형상과 경계를 뚜렷하게 구별했으며, 복원된 다양한 코어-쉘(core-shell) 구조의 퀀텀닷 3차원 영상이 샘플의 광학적 특성과 높은 상관관계를 나타내는 것이 확인됐다.

예종철 교수는 "연구에서 개발한 인공지능 기술을 통해 상용 디스플레이의 핵심 기반이 되는 퀀텀닷 및 반도체 소자의 양자 효율과 화학적 안정성을 더욱 정밀하게 분석할 수 있다ˮ고 말했다.

2021.02.16 조회수 85901 딥러닝으로 소재 합성 가능성 예측 기술 개발

우리 대학 생명화학공학과 정유성 교수 연구팀이 딥러닝을 활용해 소재의 합성 가능성을 높은 정확도로 예측하는 기술을 개발했다고 22일 밝혔다.

신소재 설계의 궁극적인 목표는 소재를 설계하고 그것을 실험적으로 합성하는 것이지만 현실적으로는 새롭게 설계된 대부분의 소재가 실제 합성 단계에서 성공하지 못하고 버려지는 경우가 많다. 이는 불필요한 시간과 자원의 낭비를 초래한다. 소재의 합성 여부는 반응 조건, 열역학, 반응 속도, 소재 구조 등 다양한 요인에 의해서 결정되기 때문에, 소재의 합성 가능성을 예측하는 것은 매우 도전적인 과제로 여겨져 왔다.

이런 문제 해결을 위한 방안으로 간단한 열역학적 안정성만을 고려해 고체 소재의 합성 가능성을 추정하지만 정확도는 매우 떨어지는 편이다. 일례로 에너지적으로 안정된 물질이라 하더라도 합성이 안 되는 경우가 아주 빈번하고, 또 반대로 *준안정 상태의 물질들도 합성되는 경우가 많기 때문이다. 따라서, 합성 가능성에 대한 예측 정확도를 획기적으로 높일 수 있는 방법론의 개발이 시급한 과제로 여겨져 왔다.

☞ 준안정(metastable) 상태 : 어떤 물질이 열역학적으로 안정된 ‘바닥 상태’가 아닌 상태

정유성 교수 연구팀이 개발한 소재 합성 가능성 예측기술은, 기존 합성이 보고된 고체 소재들의 구조적 유사성을 그래프 합성 곱 신경망(GCN, Graph Convolutional Neural Network)으로 학습해 새로운 소재의 합성 가능성을 예측할 수 있다. 특히, 현재까지 합성이 안 된 물질이라 하더라도 합성이 성공할 가능성은 여전히 존재하기 때문에 참값(레이블)을 이미 알고 학습을 진행하는 일반적인 지도학습과는 달리 양의 레이블(+)을 가진 데이터와 레이블이 없는 데이터(Positive-Unlabeled, P-U)를 이용한 분류 모델 기반의 준 지도학습을 사용했다.

정 교수팀은 5만여 종에 달하는 이미 합성이 보고된 물질과 8만여 종의 *가상 물질로 이뤄진 `머터리얼스 프로젝트(Materials Project, MP)'라는 소재 관련 데이터베이스를 이용해 모델을 구축했다. 연구팀 관계자는 이 신기술을 활용한 결과, 소재들의 합성 가능성을 약 87% 정확하게 예측할 수 있다고 설명했다. 정 교수팀은 또 이미 합성된 소재들의 열역학적 특성을 분석한 결과, 열역학적 안정성만으로는 실제 소재의 합성 가능성을 예측할 수 없다는 사실도 알아냈다.

☞ 가상 물질(hypothetical materials) : 기존에 합성되어 보고된 물질들을 원소 치환해서 얻어지는 가상의 물질들로 아직 실험적으로 합성 보고가 이루어지지 않은 물질

이와 함께 머터리얼스 프로젝트(MP) 데이터베이스 내에 합성 가능성 점수가 가장 높은 100개의 가상 물질에 대해 문헌조사를 실시한 결과, 이들 중 머터리얼스 프로젝트(MP) 데이터베이스에는 합성 여부가 아직 알려지지 않았지만 실제로 합성돼 논문에 보고된 소재만도 71개에 달하는 것을 확인했고 이를 통해 모델의 높은 정확도를 추가로 입증했다.

정유성 교수는 "빠른 신소재 발견을 위해 다양한 소재 설계 프레임워크가 존재하지만 정작 설계된 소재의 합성 가능성에 관한 판단은 전문가 직관의 영역으로 남아 있다ˮ면서 "이번에 개발한 합성 가능성 예측 모델은 새로운 소재를 설계할 때 실제로 합성 가능성을 실험 전에 미리 판단할 수 있어 새로운 소재의 개발시간을 단축하는 데 큰 도움이 될 것ˮ이라고 말했다.

생명화학공학과 장지돈 박사과정과 구근호 박사후연구원이 공동 제1 저자로 참여한 이번 연구결과는 미국화학회가 발행하는 국제학술지 미국화학회지(Journal of the American Chemical Society) 온라인 10월 26일 자에 실렸다. (논문명: Structure-Based Synthesizability Prediction of Crystals Using Partially Supervised Learing)

한편 이번 연구는 과학기술정보통신부 산하 한국연구재단의 기초연구사업(중견연구)과 미래소재 디스커버리 사업 지원을 받아 수행됐고, 연구에 KISTI의 슈퍼컴퓨터를 활용했다.

2020.12.22 조회수 54239

딥러닝으로 소재 합성 가능성 예측 기술 개발

우리 대학 생명화학공학과 정유성 교수 연구팀이 딥러닝을 활용해 소재의 합성 가능성을 높은 정확도로 예측하는 기술을 개발했다고 22일 밝혔다.

신소재 설계의 궁극적인 목표는 소재를 설계하고 그것을 실험적으로 합성하는 것이지만 현실적으로는 새롭게 설계된 대부분의 소재가 실제 합성 단계에서 성공하지 못하고 버려지는 경우가 많다. 이는 불필요한 시간과 자원의 낭비를 초래한다. 소재의 합성 여부는 반응 조건, 열역학, 반응 속도, 소재 구조 등 다양한 요인에 의해서 결정되기 때문에, 소재의 합성 가능성을 예측하는 것은 매우 도전적인 과제로 여겨져 왔다.

이런 문제 해결을 위한 방안으로 간단한 열역학적 안정성만을 고려해 고체 소재의 합성 가능성을 추정하지만 정확도는 매우 떨어지는 편이다. 일례로 에너지적으로 안정된 물질이라 하더라도 합성이 안 되는 경우가 아주 빈번하고, 또 반대로 *준안정 상태의 물질들도 합성되는 경우가 많기 때문이다. 따라서, 합성 가능성에 대한 예측 정확도를 획기적으로 높일 수 있는 방법론의 개발이 시급한 과제로 여겨져 왔다.

☞ 준안정(metastable) 상태 : 어떤 물질이 열역학적으로 안정된 ‘바닥 상태’가 아닌 상태

정유성 교수 연구팀이 개발한 소재 합성 가능성 예측기술은, 기존 합성이 보고된 고체 소재들의 구조적 유사성을 그래프 합성 곱 신경망(GCN, Graph Convolutional Neural Network)으로 학습해 새로운 소재의 합성 가능성을 예측할 수 있다. 특히, 현재까지 합성이 안 된 물질이라 하더라도 합성이 성공할 가능성은 여전히 존재하기 때문에 참값(레이블)을 이미 알고 학습을 진행하는 일반적인 지도학습과는 달리 양의 레이블(+)을 가진 데이터와 레이블이 없는 데이터(Positive-Unlabeled, P-U)를 이용한 분류 모델 기반의 준 지도학습을 사용했다.

정 교수팀은 5만여 종에 달하는 이미 합성이 보고된 물질과 8만여 종의 *가상 물질로 이뤄진 `머터리얼스 프로젝트(Materials Project, MP)'라는 소재 관련 데이터베이스를 이용해 모델을 구축했다. 연구팀 관계자는 이 신기술을 활용한 결과, 소재들의 합성 가능성을 약 87% 정확하게 예측할 수 있다고 설명했다. 정 교수팀은 또 이미 합성된 소재들의 열역학적 특성을 분석한 결과, 열역학적 안정성만으로는 실제 소재의 합성 가능성을 예측할 수 없다는 사실도 알아냈다.

☞ 가상 물질(hypothetical materials) : 기존에 합성되어 보고된 물질들을 원소 치환해서 얻어지는 가상의 물질들로 아직 실험적으로 합성 보고가 이루어지지 않은 물질

이와 함께 머터리얼스 프로젝트(MP) 데이터베이스 내에 합성 가능성 점수가 가장 높은 100개의 가상 물질에 대해 문헌조사를 실시한 결과, 이들 중 머터리얼스 프로젝트(MP) 데이터베이스에는 합성 여부가 아직 알려지지 않았지만 실제로 합성돼 논문에 보고된 소재만도 71개에 달하는 것을 확인했고 이를 통해 모델의 높은 정확도를 추가로 입증했다.

정유성 교수는 "빠른 신소재 발견을 위해 다양한 소재 설계 프레임워크가 존재하지만 정작 설계된 소재의 합성 가능성에 관한 판단은 전문가 직관의 영역으로 남아 있다ˮ면서 "이번에 개발한 합성 가능성 예측 모델은 새로운 소재를 설계할 때 실제로 합성 가능성을 실험 전에 미리 판단할 수 있어 새로운 소재의 개발시간을 단축하는 데 큰 도움이 될 것ˮ이라고 말했다.

생명화학공학과 장지돈 박사과정과 구근호 박사후연구원이 공동 제1 저자로 참여한 이번 연구결과는 미국화학회가 발행하는 국제학술지 미국화학회지(Journal of the American Chemical Society) 온라인 10월 26일 자에 실렸다. (논문명: Structure-Based Synthesizability Prediction of Crystals Using Partially Supervised Learing)

한편 이번 연구는 과학기술정보통신부 산하 한국연구재단의 기초연구사업(중견연구)과 미래소재 디스커버리 사업 지원을 받아 수행됐고, 연구에 KISTI의 슈퍼컴퓨터를 활용했다.

2020.12.22 조회수 54239 전산학부 공태식 박사과정, Google Ph.D Fellowship 2020선정

구글은 지난 10월 8일 2020년도 Google Ph.D Fellowship 수혜자 목록을 발표했다. Google Ph.D Fellowship 프로그램은 컴퓨터과학 및 관련 분야의 뛰어나고 촉망받는 대학원생들을 지원하기 위한 프로그램으로, 이번 년도에는 전 세계 대학에서 12개 분야에 총 53명이 선정됐다. 우리 대학 공태식 학생은 기계학습(Machine Learning) 부문에 이름을 올리는 영예를 안았다.

공태식 연구원은 KAIST 네트워킹 및 모바일 시스템 연구실 (지도교수: 전기및전자공학부 이성주 교수) 박사과정이다. 주 연구 분야는 기계학습을 활용한 모바일 센싱으로, “환경 독립적 모바일 센싱 (Condition-independent mobile sensing)” 연구에 대한 연구 업적과 가능성을 인정받아 이번 Google Ph.D. Fellowship 2020에 선정됐다.

한편, 공태식 연구원은 센서 및 유비쿼터스 컴퓨팅 분야 최고 학회인 ACM SenSys, ACM UbiComp 등에 주 저자로 논문을 발표했고 Microsoft Research Asia 및 Nokia Bell Labs에서 research intern으로 활동하였다. 또한 연구 성과를 인정받아 2018년 NAVER Ph.D. Fellowship에도 선정된 바 있다.

2020.10.12 조회수 23141

전산학부 공태식 박사과정, Google Ph.D Fellowship 2020선정

구글은 지난 10월 8일 2020년도 Google Ph.D Fellowship 수혜자 목록을 발표했다. Google Ph.D Fellowship 프로그램은 컴퓨터과학 및 관련 분야의 뛰어나고 촉망받는 대학원생들을 지원하기 위한 프로그램으로, 이번 년도에는 전 세계 대학에서 12개 분야에 총 53명이 선정됐다. 우리 대학 공태식 학생은 기계학습(Machine Learning) 부문에 이름을 올리는 영예를 안았다.

공태식 연구원은 KAIST 네트워킹 및 모바일 시스템 연구실 (지도교수: 전기및전자공학부 이성주 교수) 박사과정이다. 주 연구 분야는 기계학습을 활용한 모바일 센싱으로, “환경 독립적 모바일 센싱 (Condition-independent mobile sensing)” 연구에 대한 연구 업적과 가능성을 인정받아 이번 Google Ph.D. Fellowship 2020에 선정됐다.

한편, 공태식 연구원은 센서 및 유비쿼터스 컴퓨팅 분야 최고 학회인 ACM SenSys, ACM UbiComp 등에 주 저자로 논문을 발표했고 Microsoft Research Asia 및 Nokia Bell Labs에서 research intern으로 활동하였다. 또한 연구 성과를 인정받아 2018년 NAVER Ph.D. Fellowship에도 선정된 바 있다.

2020.10.12 조회수 23141 딥러닝 기반 실시간 기침 인식 카메라 개발

우리 대학 기계공학과 박용화 교수 연구팀이 ㈜에스엠 인스트루먼트와 공동으로 실시간으로 기침 소리를 인식하고 기침하는 사람의 위치를 이미지로 표시해주는 '기침 인식 카메라'를 개발했다고 3일 밝혔다.

작년 말부터 시작된 세계적 유행성 전염병인 코로나19가 최근 미국·중국·유럽 등 세계 각국에서 재확산되는 추세로 접어들면서 비접촉방식으로 전염병을 감지하는 기술에 대한 수요가 증가하고 있다.

코로나19의 대표적인 증상이 발열과 기침인데, 현재 발열은 열화상 카메라를 이용해 직접 접촉을 하지 않고도 체온을 쉽게 판별할 수 있다. 문제는 비접촉방식으로는 기침하는 사람의 증상을 쉽사리 파악하기 어렵다는 점이다. 박 교수 연구팀은 이런 문제를 해결하기 위해 기침 소리를 실시간으로 인식하는 딥러닝 기반의 기침 인식 모델을 개발했다. 또한 열화상 카메라와 같은 원리로 기침 소리와 기침하는 사람의 시각화를 위해 기침 인식 모델을 음향 카메라에 적용, 기침 소리와 기침하는 사람의 위치, 심지어 기침 횟수까지를 실시간으로 추적하고 기록이 가능한 '기침 인식 카메라'를 개발했다.

연구팀은 기침 인식 카메라가 사람이 밀집한 공공장소에서 전염병의 유행을 감지하거나 병원에서 환자의 상태를 상시 모니터링 가능한 의료용 장비로 활용될 것으로 기대하고 있다.

연구팀은 기침 인식 모델 개발을 위해 *합성 곱 신경망(convolutional neural network, CNN)을 기반으로 *지도학습(supervised learning)을 적용했다. 1초 길이 음향신호의 특징(feature)을 입력 신호로 받아, 1(기침) 또는 0(그 외)의 2진 신호를 출력하고 학습률의 최적화를 위해 일정 기간 학습률이 정체되면 학습률 값을 낮추도록 설정했다.

이어서 기침 인식 모델의 훈련 및 평가를 위해 구글과 유튜브 등에서 연구용으로 활발히 사용 중인 공개 음성데이터 세트인 `오디오세트(Audioset)'를 비롯해 `디맨드(DEMAND)'와 `이티에스아이(ETSI)', `티미트(TIMIT)' 등에서 데이터 세트를 수집했다. 이 중 `오디오세트'는 훈련 및 평가 데이터 세트 구성을 위해 사용했고 다른 데이터 세트의 경우 기침 인식 모델이 다양한 배경 소음을 학습할 수 있도록 데이터 증강(data augmentation)을 위한 배경 소음으로 사용했다.

☞ 합성 곱 신경망(convolutional neural network): 시각적 이미지를 분석하는 데 사용되는 인공신경망(생물학의 신경망에서 영감을 얻은 통계학적 학습 알고리즘)의 한 종류

☞ 지도학습(Supervised Learning): 훈련 데이터(Training Data)로부터 하나의 함수를 유추해내기 위한 기계 학습(Machine Learning)의 한 방법

데이터 증강을 위해 배경 소음을 15%~75%의 비율로 `오디오세트'에 섞은 후, 다양한 거리에 적응할 수 있게 음량을 0.25~1.0배로 조정했다. 훈련 및 평가 데이터 세트는 증강된 데이터 세트를 9:1 비율로 나눠 구성했으며, 시험 데이터 세트는 따로 사무실에서 녹음한 것을 사용했다.

모델 최적화를 위해서는 '스펙트로그램(spectrogram)' 등 5개의 음향 특징과 7개의 최적화 기기(optimizer)를 사용해 학습을 진행하고 시험 데이터 세트의 정확도를 측정, 성능을 확인한 결과 87.4%의 시험 정확도를 얻을 수 있었다.

연구팀은 이어 학습된 기침 인식 모델을 소리를 수집하는 마이크로폰 어레이와 카메라 모듈로 구성되는 음향 카메라에 적용했다. 그 결과 수집된 데이터는 음원의 위치를 계산하는 빔 형성 과정을 거쳐 기침 인식 모델이 기침 소리로 인식할 경우 기침 소리가 난 위치에 기침 소리임을 나타내는 등고선과 라벨이 각각 표시된다.

박 교수팀은 마지막 단계로 기침 인식 카메라의 예비 테스트를 진행한 결과, 여러 잡음 환경에서도 기침 소리와 그 이외의 소리로 구분이 가능하며 기침하는 사람과 그 사람의 위치, 횟수 등을 실시간으로 추적해 현장에서의 적용 가능성을 확인했다. 이들은 추후 병원 등 실사용 환경에서 추가 학습이 이뤄진다면 정확도는 87.4%보다 더 높아질 것으로 기대하고 있다.

박용화 교수는 "코로나19가 지속적으로 전파되고 있는 상황에서 공공장소와 다수 밀집 시설에 기침 인식 카메라를 활용하면 전염병의 방역 및 조기 감지에 큰 도움이 될 것ˮ이라고 말했다. 박 교수는 이어 "특히 병실에 적용하면 환자의 상태를 24시간 기록해 치료에 활용할 수 있기 때문에 의료진의 수고를 줄이고 환자 상태를 더 정밀하게 파악할 수 있을 것ˮ 이라고 강조했다.

한편, 이번 연구는 에너지기술평가원(산업통상자원부)의 지원을 받아 수행됐다.

2020.08.03 조회수 31795

딥러닝 기반 실시간 기침 인식 카메라 개발

우리 대학 기계공학과 박용화 교수 연구팀이 ㈜에스엠 인스트루먼트와 공동으로 실시간으로 기침 소리를 인식하고 기침하는 사람의 위치를 이미지로 표시해주는 '기침 인식 카메라'를 개발했다고 3일 밝혔다.

작년 말부터 시작된 세계적 유행성 전염병인 코로나19가 최근 미국·중국·유럽 등 세계 각국에서 재확산되는 추세로 접어들면서 비접촉방식으로 전염병을 감지하는 기술에 대한 수요가 증가하고 있다.

코로나19의 대표적인 증상이 발열과 기침인데, 현재 발열은 열화상 카메라를 이용해 직접 접촉을 하지 않고도 체온을 쉽게 판별할 수 있다. 문제는 비접촉방식으로는 기침하는 사람의 증상을 쉽사리 파악하기 어렵다는 점이다. 박 교수 연구팀은 이런 문제를 해결하기 위해 기침 소리를 실시간으로 인식하는 딥러닝 기반의 기침 인식 모델을 개발했다. 또한 열화상 카메라와 같은 원리로 기침 소리와 기침하는 사람의 시각화를 위해 기침 인식 모델을 음향 카메라에 적용, 기침 소리와 기침하는 사람의 위치, 심지어 기침 횟수까지를 실시간으로 추적하고 기록이 가능한 '기침 인식 카메라'를 개발했다.

연구팀은 기침 인식 카메라가 사람이 밀집한 공공장소에서 전염병의 유행을 감지하거나 병원에서 환자의 상태를 상시 모니터링 가능한 의료용 장비로 활용될 것으로 기대하고 있다.

연구팀은 기침 인식 모델 개발을 위해 *합성 곱 신경망(convolutional neural network, CNN)을 기반으로 *지도학습(supervised learning)을 적용했다. 1초 길이 음향신호의 특징(feature)을 입력 신호로 받아, 1(기침) 또는 0(그 외)의 2진 신호를 출력하고 학습률의 최적화를 위해 일정 기간 학습률이 정체되면 학습률 값을 낮추도록 설정했다.

이어서 기침 인식 모델의 훈련 및 평가를 위해 구글과 유튜브 등에서 연구용으로 활발히 사용 중인 공개 음성데이터 세트인 `오디오세트(Audioset)'를 비롯해 `디맨드(DEMAND)'와 `이티에스아이(ETSI)', `티미트(TIMIT)' 등에서 데이터 세트를 수집했다. 이 중 `오디오세트'는 훈련 및 평가 데이터 세트 구성을 위해 사용했고 다른 데이터 세트의 경우 기침 인식 모델이 다양한 배경 소음을 학습할 수 있도록 데이터 증강(data augmentation)을 위한 배경 소음으로 사용했다.

☞ 합성 곱 신경망(convolutional neural network): 시각적 이미지를 분석하는 데 사용되는 인공신경망(생물학의 신경망에서 영감을 얻은 통계학적 학습 알고리즘)의 한 종류

☞ 지도학습(Supervised Learning): 훈련 데이터(Training Data)로부터 하나의 함수를 유추해내기 위한 기계 학습(Machine Learning)의 한 방법

데이터 증강을 위해 배경 소음을 15%~75%의 비율로 `오디오세트'에 섞은 후, 다양한 거리에 적응할 수 있게 음량을 0.25~1.0배로 조정했다. 훈련 및 평가 데이터 세트는 증강된 데이터 세트를 9:1 비율로 나눠 구성했으며, 시험 데이터 세트는 따로 사무실에서 녹음한 것을 사용했다.

모델 최적화를 위해서는 '스펙트로그램(spectrogram)' 등 5개의 음향 특징과 7개의 최적화 기기(optimizer)를 사용해 학습을 진행하고 시험 데이터 세트의 정확도를 측정, 성능을 확인한 결과 87.4%의 시험 정확도를 얻을 수 있었다.

연구팀은 이어 학습된 기침 인식 모델을 소리를 수집하는 마이크로폰 어레이와 카메라 모듈로 구성되는 음향 카메라에 적용했다. 그 결과 수집된 데이터는 음원의 위치를 계산하는 빔 형성 과정을 거쳐 기침 인식 모델이 기침 소리로 인식할 경우 기침 소리가 난 위치에 기침 소리임을 나타내는 등고선과 라벨이 각각 표시된다.

박 교수팀은 마지막 단계로 기침 인식 카메라의 예비 테스트를 진행한 결과, 여러 잡음 환경에서도 기침 소리와 그 이외의 소리로 구분이 가능하며 기침하는 사람과 그 사람의 위치, 횟수 등을 실시간으로 추적해 현장에서의 적용 가능성을 확인했다. 이들은 추후 병원 등 실사용 환경에서 추가 학습이 이뤄진다면 정확도는 87.4%보다 더 높아질 것으로 기대하고 있다.

박용화 교수는 "코로나19가 지속적으로 전파되고 있는 상황에서 공공장소와 다수 밀집 시설에 기침 인식 카메라를 활용하면 전염병의 방역 및 조기 감지에 큰 도움이 될 것ˮ이라고 말했다. 박 교수는 이어 "특히 병실에 적용하면 환자의 상태를 24시간 기록해 치료에 활용할 수 있기 때문에 의료진의 수고를 줄이고 환자 상태를 더 정밀하게 파악할 수 있을 것ˮ 이라고 강조했다.

한편, 이번 연구는 에너지기술평가원(산업통상자원부)의 지원을 받아 수행됐다.

2020.08.03 조회수 31795 AI대학원 김기응 교수 연구팀, 인공지능 전력망 운영관리 국제대회 1위 달성

우리 대학 AI대학원 김기응 교수 연구팀(홍성훈, 윤든솔 석사과정, 이병준 박사과정)이 인공지능 기반 전력망 운영관리 기술을 겨루는 국제경진대회인 'L2RPN 챌린지(Learning to Run a Power Network Challenge 2020 WCCI)'에서 최종 1위를 차지했다. 이 대회는 기계학습 연구를 촉진하기 위한 각종 경진대회를 주관하는 비영리단체 ChaLearn, 유럽 최대 전력망을 운영관리하는 프랑스 전력공사의 자회사 RTE(Réseau de Transport d'Électricité)社 및 세계 최대 규모의 전력 회사 SGCC(State Grid of China)의 자회사인 GEIRI North America(Global Energy Interconnection Research Institute)에서 공동주최해, 세계 각국의 약 50팀이 약 40일간 (2020.05.20.~06.30) 온라인으로 참여해 성황리에 마감됐다.

단순한 전력망이 스마트 그리드를 넘어서 에너지 클라우드 및 네트워크로 진화하려면 신재생 에너지의 비율이 30% 이상이 돼야 하고, 신재생 에너지 비율이 높아지면 전력망 운영의 복잡도가 매우 증가한다. 실제로 독일의 경우 신재생 에너지 비율이 30%가 넘어가면서 전력사고가 3,000건 이상 증가할 정도로 심각하며, 미국의 ENRON 사태 직전에도 에너지 발전과 수요 사이의 수급 조절에 문제가 생기면서 잦은 정전 사태가 났던 사례도 있다.

전력망 운영에 인공지능 기술 도입은 아직 초기 단계이며, 현재 사용되고 있는 전력망은 관리자의 개입 없이 1시간 이상 운영되기 힘든 실정이다. 이에 프랑스의 RTE(Réseau de Transport d'Électricité) 社는 전력망 운영에 인공지능 기술을 접목하는 경진대회 'L2RPN'을 2019년 처음 개최했다. 2019년 대회는 IEEE-14라는 14개의 변전소를 포함하는 가상의 전력망에서 단순한 운영을 목표로 열렸다. 2020년 대회는 L2RPN 2020 WCCI 챌린지라는 이름으로 특정 국가 수도 규모의 복잡한 전력망을 72시간 동안 관리자의 개입 없이 스스로 안전하고 효율적으로 운영될 수 있는 인공지능 전력망 관리 에이전트를 개발하는 것을 목표로 열렸다. 시간에 따른 공급-수요의 변화, 시설 유지보수 및 재난에 따른 급작스러운 단전 등 다양한 시나리오에 대해 전력망 운영관리 능력의 평가가 이뤄졌다.

김 교수 연구팀은 이번 2020년 대회에서 전력망 구조를 효과적으로 반영할 수 있는 그래프 신경망 모델 기반의 강화학습 에이전트를 개발해 참가했다. 기존의 에이전트들은 소규모의 전력망에서만 적용 가능하다는 한계가 있었지만, 김 교수 연구팀은 국가 수도 규모의 복잡한 전력망에도 적용 가능한 에이전트를 개발했다. 연구팀이 개발한 인공지능 전력망 운영관리 에이전트는 주어진 모든 테스트 시나리오에 대해 안전하고 효율적으로 전력망을 운영해 최종 1위의 성적을 거뒀다. 우승팀에게는 상금으로 미국 실리콘밸리에 있는 GEIRI North America를 방문할 수 있는 여행경비와 학회참가 비용 3,000달러가 주어진다. 연구진은 앞으로도 기술을 고도화해 국가 규모의 전력망과 다양한 신재생 에너지원을 다룰 수 있도록 확장할 계획이다.

한편 이번 연구는 과기정통부 에너지 클라우드 기술개발 사업의 지원으로 설치된 개방형 에너지 클라우드 플랫폼 연구단과제로 수행됐다. (연구단장 KAIST 전산학부 문수복 교수)

※ 대회 결과 사이트 관련 링크: https://l2rpn.chalearn.org/competitions

※ 개방형 에너지 클라우드 플랫폼 연구단 사이트: https://www.oecp.kaist.ac.kr

2020.07.28 조회수 31088

AI대학원 김기응 교수 연구팀, 인공지능 전력망 운영관리 국제대회 1위 달성

우리 대학 AI대학원 김기응 교수 연구팀(홍성훈, 윤든솔 석사과정, 이병준 박사과정)이 인공지능 기반 전력망 운영관리 기술을 겨루는 국제경진대회인 'L2RPN 챌린지(Learning to Run a Power Network Challenge 2020 WCCI)'에서 최종 1위를 차지했다. 이 대회는 기계학습 연구를 촉진하기 위한 각종 경진대회를 주관하는 비영리단체 ChaLearn, 유럽 최대 전력망을 운영관리하는 프랑스 전력공사의 자회사 RTE(Réseau de Transport d'Électricité)社 및 세계 최대 규모의 전력 회사 SGCC(State Grid of China)의 자회사인 GEIRI North America(Global Energy Interconnection Research Institute)에서 공동주최해, 세계 각국의 약 50팀이 약 40일간 (2020.05.20.~06.30) 온라인으로 참여해 성황리에 마감됐다.

단순한 전력망이 스마트 그리드를 넘어서 에너지 클라우드 및 네트워크로 진화하려면 신재생 에너지의 비율이 30% 이상이 돼야 하고, 신재생 에너지 비율이 높아지면 전력망 운영의 복잡도가 매우 증가한다. 실제로 독일의 경우 신재생 에너지 비율이 30%가 넘어가면서 전력사고가 3,000건 이상 증가할 정도로 심각하며, 미국의 ENRON 사태 직전에도 에너지 발전과 수요 사이의 수급 조절에 문제가 생기면서 잦은 정전 사태가 났던 사례도 있다.

전력망 운영에 인공지능 기술 도입은 아직 초기 단계이며, 현재 사용되고 있는 전력망은 관리자의 개입 없이 1시간 이상 운영되기 힘든 실정이다. 이에 프랑스의 RTE(Réseau de Transport d'Électricité) 社는 전력망 운영에 인공지능 기술을 접목하는 경진대회 'L2RPN'을 2019년 처음 개최했다. 2019년 대회는 IEEE-14라는 14개의 변전소를 포함하는 가상의 전력망에서 단순한 운영을 목표로 열렸다. 2020년 대회는 L2RPN 2020 WCCI 챌린지라는 이름으로 특정 국가 수도 규모의 복잡한 전력망을 72시간 동안 관리자의 개입 없이 스스로 안전하고 효율적으로 운영될 수 있는 인공지능 전력망 관리 에이전트를 개발하는 것을 목표로 열렸다. 시간에 따른 공급-수요의 변화, 시설 유지보수 및 재난에 따른 급작스러운 단전 등 다양한 시나리오에 대해 전력망 운영관리 능력의 평가가 이뤄졌다.

김 교수 연구팀은 이번 2020년 대회에서 전력망 구조를 효과적으로 반영할 수 있는 그래프 신경망 모델 기반의 강화학습 에이전트를 개발해 참가했다. 기존의 에이전트들은 소규모의 전력망에서만 적용 가능하다는 한계가 있었지만, 김 교수 연구팀은 국가 수도 규모의 복잡한 전력망에도 적용 가능한 에이전트를 개발했다. 연구팀이 개발한 인공지능 전력망 운영관리 에이전트는 주어진 모든 테스트 시나리오에 대해 안전하고 효율적으로 전력망을 운영해 최종 1위의 성적을 거뒀다. 우승팀에게는 상금으로 미국 실리콘밸리에 있는 GEIRI North America를 방문할 수 있는 여행경비와 학회참가 비용 3,000달러가 주어진다. 연구진은 앞으로도 기술을 고도화해 국가 규모의 전력망과 다양한 신재생 에너지원을 다룰 수 있도록 확장할 계획이다.

한편 이번 연구는 과기정통부 에너지 클라우드 기술개발 사업의 지원으로 설치된 개방형 에너지 클라우드 플랫폼 연구단과제로 수행됐다. (연구단장 KAIST 전산학부 문수복 교수)

※ 대회 결과 사이트 관련 링크: https://l2rpn.chalearn.org/competitions

※ 개방형 에너지 클라우드 플랫폼 연구단 사이트: https://www.oecp.kaist.ac.kr

2020.07.28 조회수 31088 기존 인공지능 기술을 뛰어넘는 양자 인공지능 알고리즘 개발

우리 대학 전기및전자공학부 및 AI 양자컴퓨팅 IT 인력양성연구센터장 이준구 교수 연구팀이 독일 및 남아공 연구팀과의 협력 연구를 통해 비선형 양자 기계학습 인공지능 알고리즘을 개발했다고 7일 밝혔다.

양자 인공지능은 양자컴퓨터의 발전과 함께 현재의 인공지능을 앞설 것으로 크게 기대되고 있으나 연산 방법이 전혀 달라 새로운 양자 알고리즘의 개발이 절실하다. 특히 양자컴퓨터는 본질적으로 일차방정식을 잘 푸는 선형적 성질을 가지고 있어 복잡한 데이터를 다루는 비선형적 기계학습에 어려움이 존재했다. 하지만 이번 연구를 통해 비선형 커널이 고안되어 복잡한 데이터에 대한 양자 기계학습이 가능하게 됐다. 특히 이준구 교수팀이 개발한 양자 지도학습 알고리즘은 학습에 있어 매우 적은 계산량으로 연산이 가능하다. 따라서 대규모 계산량이 필요한 현재의 인공지능 기술을 추월할 가능성을 제시한 것으로 평가를 받고 있다.

이준구 교수팀은 학습데이터와 테스트데이터를 양자 정보로 생성한 후 양자 정보의 병렬연산을 가능하게 하는 양자포킹 기술과 간단한 양자 측정기술을 조합해 양자 데이터 간의 유사성을 효율적으로 계산하는 비선형 커널 기반의 지도학습을 구현하는 양자 알고리즘 체계를 만들었다. 이후 IBM 클라우드 서비스를 통해 실제 양자컴퓨터에서 양자 지도학습을 실제 시연하는 데 성공했다.

KAIST 박경덕 연구교수가 공동 제1 저자로 참여한 이번 연구결과는 국제 학술지 네이처 자매지인 `npj Quantum Information' 誌 2020년 5월 6권에 게재됐다. (논문명: Quantum classifier with tailored quantum kernel).

기계학습에 있어 중요한 문제 중 하나는 주어진 데이터의 특징(feature)을 구분해 분류하는 것이다. 간단한 예로 동물 이미지 학습데이터에서 입, 귀 등의 특징을 바탕으로 분류하기 위한 결정 경계(decision boundary)를 학습하고 새로운 이미지가 입력되었을 때 개 또는 고양이로 분류하는 작업을 생각해볼 수 있다. 데이터의 특징들이 잘 나타나는 경우에는 선형적 결정 경계만으로 분류할 수 있다. 그러나 입과 귀 모양의 특징으로만 개와 고양이를 분류하기 쉽지 않다면 새로운 결정 경계를 찾기 위해 특징에 관한 정보 공간의 차원을 확장해야 하는데 이러한 과정에서 비선형 커널 기술이 필요하다.

양자컴퓨팅은 고전 컴퓨팅과는 달리 큐비트(quantum bit, 양자컴퓨팅 정보처리의 기본 단위)의 개수에 따라 정보 공간의 차원이 기하급수적으로 증가하기 때문에 이론적으로 고차원 정보처리에 있어 기하급수적으로 뛰어난 성능을 낼 수 있다.

연구팀은 이러한 양자컴퓨팅의 장점을 활용해 데이터 특징 대비 기하급수적인 계산 효율성을 달성하는 양자 기계학습 알고리즘을 개발했다. 이 교수 연구팀이 개발한 이 알고리즘은 저차원 입력 공간에 존재하는 데이터들을 큐비트로 표현되는 고차원 데이터 특징 공간(feature space)으로 옮긴 후, 양자화된 모든 학습데이터와 테스트데이터 간의 커널 함수를 양자 중첩을 활용해 동시에 계산하고 테스트데이터의 분류를 효율적으로 결정한다. 이때 사용되는 양자 회로의 계산 복잡도는 학습 데이터양에 대해서는 선형적으로 증가하나, 데이터 특징 개수에 대해서는 불과 로그(log)함수로 매우 천천히 증가하는 장점이 있다.

연구팀은 이와 함께 양자 회로의 체계적 설계를 통해 다양한 양자 커널 구현이 가능함을 이론적으로 증명했다. 커널 기반 기계학습에서는 주어진 입력 데이터에 따라 최적 커널이 달라질 수 있으므로, 다양한 양자 커널을 효율적으로 구현할 수 있게 된 점은 양자 커널 기반 기계학습의 실제 응용에 있어 매우 중요한 성과다.

연구팀은 IBM이 클라우드 서비스로 제공하는 다섯 개의 큐비트로 구성된 초전도 기반 양자 컴퓨터에서 이번에 개발에 성공한 양자 기계학습 알고리즘을 실험적으로 구현해 양자 커널 기반 기계학습의 성능을 실제 시연을 통해 이를 입증하는 데 성공했다.

이 연구에 참여한 박경덕 연구교수는 "연구팀이 개발한 커널 기반 양자 기계학습 알고리즘은 수년 안에 상용화될 것으로 예측되는 수백 큐비트의 NISQ(Noisy Intermediate-Scale Quantum) 컴퓨팅의 시대가 되면 기존의 고전 커널 기반 지도학습을 뛰어넘을 것ˮ이라면서 "복잡한 비선형 데이터의 패턴 인식 등을 위한 양자 기계학습 알고리즘으로 활발히 사용될 것ˮ이라고 말했다.

한편 이번 연구는 각각 한국연구재단의 창의 도전 연구기반 지원 사업과 한국연구재단의 한-아프리카 협력기반 조성 사업, 정보통신기획평가원의 정보통신기술인력 양성사업(ITRC)의 지원을 받아 수행됐다.

관련 논문: https://www.nature.com/articles/s41534-020-0272-6

2020.07.07 조회수 24058

기존 인공지능 기술을 뛰어넘는 양자 인공지능 알고리즘 개발

우리 대학 전기및전자공학부 및 AI 양자컴퓨팅 IT 인력양성연구센터장 이준구 교수 연구팀이 독일 및 남아공 연구팀과의 협력 연구를 통해 비선형 양자 기계학습 인공지능 알고리즘을 개발했다고 7일 밝혔다.

양자 인공지능은 양자컴퓨터의 발전과 함께 현재의 인공지능을 앞설 것으로 크게 기대되고 있으나 연산 방법이 전혀 달라 새로운 양자 알고리즘의 개발이 절실하다. 특히 양자컴퓨터는 본질적으로 일차방정식을 잘 푸는 선형적 성질을 가지고 있어 복잡한 데이터를 다루는 비선형적 기계학습에 어려움이 존재했다. 하지만 이번 연구를 통해 비선형 커널이 고안되어 복잡한 데이터에 대한 양자 기계학습이 가능하게 됐다. 특히 이준구 교수팀이 개발한 양자 지도학습 알고리즘은 학습에 있어 매우 적은 계산량으로 연산이 가능하다. 따라서 대규모 계산량이 필요한 현재의 인공지능 기술을 추월할 가능성을 제시한 것으로 평가를 받고 있다.

이준구 교수팀은 학습데이터와 테스트데이터를 양자 정보로 생성한 후 양자 정보의 병렬연산을 가능하게 하는 양자포킹 기술과 간단한 양자 측정기술을 조합해 양자 데이터 간의 유사성을 효율적으로 계산하는 비선형 커널 기반의 지도학습을 구현하는 양자 알고리즘 체계를 만들었다. 이후 IBM 클라우드 서비스를 통해 실제 양자컴퓨터에서 양자 지도학습을 실제 시연하는 데 성공했다.

KAIST 박경덕 연구교수가 공동 제1 저자로 참여한 이번 연구결과는 국제 학술지 네이처 자매지인 `npj Quantum Information' 誌 2020년 5월 6권에 게재됐다. (논문명: Quantum classifier with tailored quantum kernel).

기계학습에 있어 중요한 문제 중 하나는 주어진 데이터의 특징(feature)을 구분해 분류하는 것이다. 간단한 예로 동물 이미지 학습데이터에서 입, 귀 등의 특징을 바탕으로 분류하기 위한 결정 경계(decision boundary)를 학습하고 새로운 이미지가 입력되었을 때 개 또는 고양이로 분류하는 작업을 생각해볼 수 있다. 데이터의 특징들이 잘 나타나는 경우에는 선형적 결정 경계만으로 분류할 수 있다. 그러나 입과 귀 모양의 특징으로만 개와 고양이를 분류하기 쉽지 않다면 새로운 결정 경계를 찾기 위해 특징에 관한 정보 공간의 차원을 확장해야 하는데 이러한 과정에서 비선형 커널 기술이 필요하다.

양자컴퓨팅은 고전 컴퓨팅과는 달리 큐비트(quantum bit, 양자컴퓨팅 정보처리의 기본 단위)의 개수에 따라 정보 공간의 차원이 기하급수적으로 증가하기 때문에 이론적으로 고차원 정보처리에 있어 기하급수적으로 뛰어난 성능을 낼 수 있다.

연구팀은 이러한 양자컴퓨팅의 장점을 활용해 데이터 특징 대비 기하급수적인 계산 효율성을 달성하는 양자 기계학습 알고리즘을 개발했다. 이 교수 연구팀이 개발한 이 알고리즘은 저차원 입력 공간에 존재하는 데이터들을 큐비트로 표현되는 고차원 데이터 특징 공간(feature space)으로 옮긴 후, 양자화된 모든 학습데이터와 테스트데이터 간의 커널 함수를 양자 중첩을 활용해 동시에 계산하고 테스트데이터의 분류를 효율적으로 결정한다. 이때 사용되는 양자 회로의 계산 복잡도는 학습 데이터양에 대해서는 선형적으로 증가하나, 데이터 특징 개수에 대해서는 불과 로그(log)함수로 매우 천천히 증가하는 장점이 있다.

연구팀은 이와 함께 양자 회로의 체계적 설계를 통해 다양한 양자 커널 구현이 가능함을 이론적으로 증명했다. 커널 기반 기계학습에서는 주어진 입력 데이터에 따라 최적 커널이 달라질 수 있으므로, 다양한 양자 커널을 효율적으로 구현할 수 있게 된 점은 양자 커널 기반 기계학습의 실제 응용에 있어 매우 중요한 성과다.

연구팀은 IBM이 클라우드 서비스로 제공하는 다섯 개의 큐비트로 구성된 초전도 기반 양자 컴퓨터에서 이번에 개발에 성공한 양자 기계학습 알고리즘을 실험적으로 구현해 양자 커널 기반 기계학습의 성능을 실제 시연을 통해 이를 입증하는 데 성공했다.

이 연구에 참여한 박경덕 연구교수는 "연구팀이 개발한 커널 기반 양자 기계학습 알고리즘은 수년 안에 상용화될 것으로 예측되는 수백 큐비트의 NISQ(Noisy Intermediate-Scale Quantum) 컴퓨팅의 시대가 되면 기존의 고전 커널 기반 지도학습을 뛰어넘을 것ˮ이라면서 "복잡한 비선형 데이터의 패턴 인식 등을 위한 양자 기계학습 알고리즘으로 활발히 사용될 것ˮ이라고 말했다.

한편 이번 연구는 각각 한국연구재단의 창의 도전 연구기반 지원 사업과 한국연구재단의 한-아프리카 협력기반 조성 사업, 정보통신기획평가원의 정보통신기술인력 양성사업(ITRC)의 지원을 받아 수행됐다.

관련 논문: https://www.nature.com/articles/s41534-020-0272-6

2020.07.07 조회수 24058 학습되지 않은 환경에서 스스로 학습하는 모바일 센싱 기술 개발

우리 대학 전산학부 이성주 교수 연구팀이 학습되지 않은 환경에 적은 양의 데이터로 스스로 적응하는 모바일 센싱 학습 기술 <메타센스(MetaSense)>를 개발했다.

모바일 센싱이란 스마트폰과 같은 모바일 기기의 다양한 센서를 이용하여 서비스(예: 수면의 질 평가, 걸음 수 추적 등)를 제공하는 기술이다. 최근 학계에서는 기계학습 기술의 발전과 더불어 우울증 진단, 운동 자세 관리 등 진보된 모바일 센싱의 가능성을 보여줌으로써 모바일 센싱의 범위를 더욱 확장하고 있다.

하지만 이러한 센싱 기술은 아직 널리 쓰이지 못하고 있다. 사용자 개인마다 가지고 있는 모바일 센싱의 환경이 다르기 때문이다. 사람마다 가지고 있는 고유한 생활패턴과 행동방식, 서로 다른 모바일 기기와 그 사양은 센서의 값에 큰 영향을 미친다. 다른 센서 값은 사람마다 고유한 센싱 환경을 만들고, 이는 센싱 모델이 미리 학습되지 않은 새로운 환경에서 작동할 때 사용이 어려울 만큼 성능 저하를 일으킨다.

연구팀은 이런 학습되지 않는 환경에서 적은 양의 데이터 (최소 1-2 샘플)만 가지고 적응할 수 있는 '메타러닝 프레임워크'를 제시했다. 메타러닝 (meta learning) 이란 적은 양의 데이터를 가지고도 새로운 지식을 학습할 수 있도록 하는 기계학습 원리다. 연구팀이 제시한 기술은 최신 전이학습 (transfer learning) 기술과 비교하여 18%, 메타러닝 기술과 비교하여 15%의 정확도 성능향상을 보였다.

이성주 교수는 ”최근 활발히 제안되고 있는 다양한 모바일 센싱 서비스가 특정 환경에 의존하지 않고 수많은 실제 사용 환경에서 우수한 성능을 보일 수 있게 해주는 연구다. 모바일 센싱 서비스가 연구에 그치지 않고 실제 많은 사람들에게 사용될 수 있는 가능성을 제시해 의미가 있다“라고 했다. 또한 신진우 교수는 “최근 메타러닝 방법론들이 기계학습 분야에서 크게 각광을 받고 있는데 주로 영상 데이터에 국한되어 왔었다. 본 연구에서 비영상 데이터에도 범용적으로 동작하는 메터러닝 기술을 개발하여 성공한 것은 앞으로도 관련 분야 연구에 큰 영향을 주리라 기대한다“라고 덧붙였다.

연구에 대한 설명이 담긴 비디오를 다음 링크에서 확인할 수 있고, (https://youtu.be/-6y0I1pd6XI) 자세한 정보는 프로젝트 웹사이트에서 볼 수 있다.

(https://nmsl.kaist.ac.kr/projects/metasense/)

이성주 교수, 신진우 AI대학원 교수, 공태식 박사과정, 김연수 학사과정이 참여한 이번 연구 결과는 2019년 11월 11일 센싱 컴퓨팅 분야 국제 최우수학회 ACM SenSys에서 발표됐다. (논문명: MetaSense: Few-Shot Adaptation to Untrained Conditions in Deep Mobile Sensing). 이 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단과 정보통신기술진흥센터, 한국연구재단 차세대 정보 컴퓨팅 기술개발사업의 지원을 받아 수행됐다.

2020.06.09 조회수 18098

학습되지 않은 환경에서 스스로 학습하는 모바일 센싱 기술 개발

우리 대학 전산학부 이성주 교수 연구팀이 학습되지 않은 환경에 적은 양의 데이터로 스스로 적응하는 모바일 센싱 학습 기술 <메타센스(MetaSense)>를 개발했다.

모바일 센싱이란 스마트폰과 같은 모바일 기기의 다양한 센서를 이용하여 서비스(예: 수면의 질 평가, 걸음 수 추적 등)를 제공하는 기술이다. 최근 학계에서는 기계학습 기술의 발전과 더불어 우울증 진단, 운동 자세 관리 등 진보된 모바일 센싱의 가능성을 보여줌으로써 모바일 센싱의 범위를 더욱 확장하고 있다.

하지만 이러한 센싱 기술은 아직 널리 쓰이지 못하고 있다. 사용자 개인마다 가지고 있는 모바일 센싱의 환경이 다르기 때문이다. 사람마다 가지고 있는 고유한 생활패턴과 행동방식, 서로 다른 모바일 기기와 그 사양은 센서의 값에 큰 영향을 미친다. 다른 센서 값은 사람마다 고유한 센싱 환경을 만들고, 이는 센싱 모델이 미리 학습되지 않은 새로운 환경에서 작동할 때 사용이 어려울 만큼 성능 저하를 일으킨다.

연구팀은 이런 학습되지 않는 환경에서 적은 양의 데이터 (최소 1-2 샘플)만 가지고 적응할 수 있는 '메타러닝 프레임워크'를 제시했다. 메타러닝 (meta learning) 이란 적은 양의 데이터를 가지고도 새로운 지식을 학습할 수 있도록 하는 기계학습 원리다. 연구팀이 제시한 기술은 최신 전이학습 (transfer learning) 기술과 비교하여 18%, 메타러닝 기술과 비교하여 15%의 정확도 성능향상을 보였다.

이성주 교수는 ”최근 활발히 제안되고 있는 다양한 모바일 센싱 서비스가 특정 환경에 의존하지 않고 수많은 실제 사용 환경에서 우수한 성능을 보일 수 있게 해주는 연구다. 모바일 센싱 서비스가 연구에 그치지 않고 실제 많은 사람들에게 사용될 수 있는 가능성을 제시해 의미가 있다“라고 했다. 또한 신진우 교수는 “최근 메타러닝 방법론들이 기계학습 분야에서 크게 각광을 받고 있는데 주로 영상 데이터에 국한되어 왔었다. 본 연구에서 비영상 데이터에도 범용적으로 동작하는 메터러닝 기술을 개발하여 성공한 것은 앞으로도 관련 분야 연구에 큰 영향을 주리라 기대한다“라고 덧붙였다.

연구에 대한 설명이 담긴 비디오를 다음 링크에서 확인할 수 있고, (https://youtu.be/-6y0I1pd6XI) 자세한 정보는 프로젝트 웹사이트에서 볼 수 있다.

(https://nmsl.kaist.ac.kr/projects/metasense/)

이성주 교수, 신진우 AI대학원 교수, 공태식 박사과정, 김연수 학사과정이 참여한 이번 연구 결과는 2019년 11월 11일 센싱 컴퓨팅 분야 국제 최우수학회 ACM SenSys에서 발표됐다. (논문명: MetaSense: Few-Shot Adaptation to Untrained Conditions in Deep Mobile Sensing). 이 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단과 정보통신기술진흥센터, 한국연구재단 차세대 정보 컴퓨팅 기술개발사업의 지원을 받아 수행됐다.

2020.06.09 조회수 18098 KAIST 사이언스 아웃리치 프로그램 참가자 모집

우리대학이 소외계층 중·고등학생을 위한 'KAIST 사이언스 아웃리치 프로그램(KAIST Science Outreach Program, 이하 KSOP)' 참가자를 모집한다.

중학교 재학생 중에서 학교장의 추천을 받은 사회통합대상자·수업이 가능한 신체장애 학생·북한 이탈주민·아동복지시설 보호 아동·소년·소녀 가장 학생 등이 지원할 수 있다. 고등학생은 1학년을 대상으로 기존 정원에서 남아있는 자리가 발생한 지역에 한해 지원자를 모집한다.

참가 신청서는 KSOP 홈페이지에서 지난 25일부터 접수 중인데 6월 19일 마감된다. 100% 서류 전형을 통해 선발된 최종 지원 대상자에게는 고3 학업 과정을 마칠 때까지 프로그램의 모든 교육 과정을 전액 무료로 제공한다. 또한, 교육 시 식사와 간식이 제공되며 가을 및 봄학기 학습 멘토링·여름 캠프 참가 자격·우수 학생 겨울 심화 캠프 참가 자격 등을 부여한다.

특히, 이번 모집을 통해 선발되는 신규 참여 학생들에게는 코로나19를 계기로 도입된 온라인 학습 멘토링을 제공할 예정이다.

지난 2014년 대전 지역을 중심으로 시작된 KSOP는 KAIST가 교육격차 해소를 목적으로 추진해온 교육 기부 프로그램이다. 소외계층 학생들에게 과학에 대한 지적 호기심과 학습 동기를 유발할 수 있는 교육 기회를 제공하기 위해 마련됐다. 이와 함께 지속적인 관심과 지원을 통해 꿈과 비전을 지닌 과학 인재로 성장할 수 있는 환경을 조성해주는 것이 주된 목표다.

2015년부터는 과학기술정보통신부의 지원을 받아 전국으로 확대해 운영하고 있으며, 지난해까지 중1~고3 학생 2천370명에게 학습 멘토링을 제공했다.

이 프로그램에 참여하는 학생들은 자기 주도적 온라인 학습을 선행한 후 전국 10개 수업장에서 월평균 2회가량 수학·과학 과목의 오프라인 교육을 받는다. 방학 중에는 KAIST에서 과학탐구 캠프를 개최하며, 50여 명의 KAIST 대학생 멘토들이 전체 교육 과정에 동참한다. 특히, 이공계 진로 멘토링을 통해 과학고에서 과기특성화대학 진학으로 이어지는 진로 사다리를 구축하는 데 힘쓰고 있다.

실제로 최근 2년간 KAIST·서울대·성균관대·POSTECH 입학생 11명을 포함해 전국 35개 대학에 51명의 합격생과 2명의 취업자도 배출했다. 합격자의 절반이 넘는 36명은 이공계 전공을 선택해 진학했다. 졸업생 중 일부는 대학생 멘토로 KSOP에 복귀해 후배 중·고생들에게 멘토링을 제공하고 있다.

중3 때부터 KSOP에 참가해 지난 2019년 KAIST에 입학한 이창민(19, 전산학부 2학년) 씨는 "KSOP을 통해 막연하게만 생각하던 이공계열 진학에 확신을 가질 수 있었다ˮ며 "열여섯의 어린 나이부터 KAIST 재학생들과 맺은 인연은 이공계 분야 진학과 관련해 정보를 얻을 수 있는 굉장히 중요한 계기가 됐다ˮ고 경험담을 전했다.

코로나19로 인해 대면 학습 멘토링이 어려워진 올해는 지난 4월 말부터 온라인을 통해 상시 학습 멘토링을 시행하고 있다. 학년별로 수학과 과학을 담당하는 KAIST 멘토가 학습 과제를 부여해 학생이 결과물을 제출하면 채점을 통해 피드백하는 방식이다. 그 외에도 학습 및 진로 관련 질의 사항을 상시 응답해주는 형태로 운영 중이며, 자체 조사결과 기존 참여 학생 550여 명 및 학부모의 만족도가 96.4%로 매우 높게 나타났다.

KSOP를 운영하는 KAIST 과학영재교육연구원 곽시종 원장은 "KSOP은 KAIST가 지금까지 국민 여러분께 받아온 사랑을 조금이나마 갚고자 만든 교육 기부프로그램ˮ이라고 전했다.

곽 원장은 이어 "지금은 비록 주변 환경의 문제로 어려움을 겪고 있다 해도 자신의 가능성을 믿고 도전하는 학생이라면 얼마든지 우리나라의 자랑스러운 이공계 인재가 될 수 있다ˮ 면서 "이를 돕는 KSOP에 많은 학생들이 참여해 스스로의 미래를 열어가길 바란다.ˮ 라고 강조했다.

2020.05.30 조회수 20243

KAIST 사이언스 아웃리치 프로그램 참가자 모집

우리대학이 소외계층 중·고등학생을 위한 'KAIST 사이언스 아웃리치 프로그램(KAIST Science Outreach Program, 이하 KSOP)' 참가자를 모집한다.

중학교 재학생 중에서 학교장의 추천을 받은 사회통합대상자·수업이 가능한 신체장애 학생·북한 이탈주민·아동복지시설 보호 아동·소년·소녀 가장 학생 등이 지원할 수 있다. 고등학생은 1학년을 대상으로 기존 정원에서 남아있는 자리가 발생한 지역에 한해 지원자를 모집한다.

참가 신청서는 KSOP 홈페이지에서 지난 25일부터 접수 중인데 6월 19일 마감된다. 100% 서류 전형을 통해 선발된 최종 지원 대상자에게는 고3 학업 과정을 마칠 때까지 프로그램의 모든 교육 과정을 전액 무료로 제공한다. 또한, 교육 시 식사와 간식이 제공되며 가을 및 봄학기 학습 멘토링·여름 캠프 참가 자격·우수 학생 겨울 심화 캠프 참가 자격 등을 부여한다.

특히, 이번 모집을 통해 선발되는 신규 참여 학생들에게는 코로나19를 계기로 도입된 온라인 학습 멘토링을 제공할 예정이다.

지난 2014년 대전 지역을 중심으로 시작된 KSOP는 KAIST가 교육격차 해소를 목적으로 추진해온 교육 기부 프로그램이다. 소외계층 학생들에게 과학에 대한 지적 호기심과 학습 동기를 유발할 수 있는 교육 기회를 제공하기 위해 마련됐다. 이와 함께 지속적인 관심과 지원을 통해 꿈과 비전을 지닌 과학 인재로 성장할 수 있는 환경을 조성해주는 것이 주된 목표다.

2015년부터는 과학기술정보통신부의 지원을 받아 전국으로 확대해 운영하고 있으며, 지난해까지 중1~고3 학생 2천370명에게 학습 멘토링을 제공했다.

이 프로그램에 참여하는 학생들은 자기 주도적 온라인 학습을 선행한 후 전국 10개 수업장에서 월평균 2회가량 수학·과학 과목의 오프라인 교육을 받는다. 방학 중에는 KAIST에서 과학탐구 캠프를 개최하며, 50여 명의 KAIST 대학생 멘토들이 전체 교육 과정에 동참한다. 특히, 이공계 진로 멘토링을 통해 과학고에서 과기특성화대학 진학으로 이어지는 진로 사다리를 구축하는 데 힘쓰고 있다.

실제로 최근 2년간 KAIST·서울대·성균관대·POSTECH 입학생 11명을 포함해 전국 35개 대학에 51명의 합격생과 2명의 취업자도 배출했다. 합격자의 절반이 넘는 36명은 이공계 전공을 선택해 진학했다. 졸업생 중 일부는 대학생 멘토로 KSOP에 복귀해 후배 중·고생들에게 멘토링을 제공하고 있다.

중3 때부터 KSOP에 참가해 지난 2019년 KAIST에 입학한 이창민(19, 전산학부 2학년) 씨는 "KSOP을 통해 막연하게만 생각하던 이공계열 진학에 확신을 가질 수 있었다ˮ며 "열여섯의 어린 나이부터 KAIST 재학생들과 맺은 인연은 이공계 분야 진학과 관련해 정보를 얻을 수 있는 굉장히 중요한 계기가 됐다ˮ고 경험담을 전했다.

코로나19로 인해 대면 학습 멘토링이 어려워진 올해는 지난 4월 말부터 온라인을 통해 상시 학습 멘토링을 시행하고 있다. 학년별로 수학과 과학을 담당하는 KAIST 멘토가 학습 과제를 부여해 학생이 결과물을 제출하면 채점을 통해 피드백하는 방식이다. 그 외에도 학습 및 진로 관련 질의 사항을 상시 응답해주는 형태로 운영 중이며, 자체 조사결과 기존 참여 학생 550여 명 및 학부모의 만족도가 96.4%로 매우 높게 나타났다.

KSOP를 운영하는 KAIST 과학영재교육연구원 곽시종 원장은 "KSOP은 KAIST가 지금까지 국민 여러분께 받아온 사랑을 조금이나마 갚고자 만든 교육 기부프로그램ˮ이라고 전했다.

곽 원장은 이어 "지금은 비록 주변 환경의 문제로 어려움을 겪고 있다 해도 자신의 가능성을 믿고 도전하는 학생이라면 얼마든지 우리나라의 자랑스러운 이공계 인재가 될 수 있다ˮ 면서 "이를 돕는 KSOP에 많은 학생들이 참여해 스스로의 미래를 열어가길 바란다.ˮ 라고 강조했다.

2020.05.30 조회수 20243 정확성이 획기적으로 향상된 코로나19 영상 진단 기술 개발

우리 대학 바이오및뇌공학과 예종철 교수 연구팀이 흉부 단순 방사선 촬영 영상으로 신종 코로나바이러스 감염증(이하 코로나19) 진단의 정확성을 획기적으로 개선한 인공지능(AI) 기술을 개발했다.

예 교수 연구팀이 개발한 인공지능 기술을 사용해 코로나19 감염 여부를 진단한 결과, 영상 판독 전문가의 69%보다 17%가 향상된 86%이상의 우수한 정확성을 보였다고 KAIST 관계자는 설명했다.

이 기술을 세계적으로 대유행하는 코로나19 선별 진료(Triage)체계에 도입하면 상시 신속한 진단이 가능할 뿐만 아니라 한정된 의료 자원의 효율적인 사용에 큰 도움을 줄 것으로 기대된다.

오유진 박사과정과 박상준 박사과정이 공동 1저자로 참여한 이 연구 결과는 국제 학술지 `아이트리플이 트랜잭션 온 메디컬 이미징(IEEE transactions on medical imaging)'의 `영상기반 코로나19 진단 인공지능기술' 특집호 5월 8일 字 온라인판에 게재됐다. (논문명 : Deep Learning COVID-19 Features on CXR using Limited Training Data Sets)

현재 전 세계적으로 확진자 500만 명을 넘긴 코로나19 진단검사에는 통상 역전사 중합 효소 연쇄 반응(RT-PCR, Reverse Transcription Polymerase Chain Reaction)을 이용한 장비가 사용된다. RT-PCR 검사의 정확성은 90% 이상으로 알려져 있으나, 검사 결과가 나오기까지는 많은 시간이 걸리며 모든 환자에게 시행하기에 비용이 많이 든다는 단점이 있다.

컴퓨터 단층촬영(CT, Computed Tomography)을 이용한 검사도 비교적 높은 정확성을 보이지만 일반적인 X선 단순촬영 검사에 비해 많은 시간이 소요되고 바이러스에 의한 장비의 오염 가능성 때문에 선별 진료에 사용되기 어렵다.

흉부 단순 방사선 촬영(CXR, Chest X-ray)은 여러 폐 질환에서 표준 선별 검사로 활용되고 있지만 코로나19에는 RT-PCR와 CT 검사에 비해 정확성이 현저하게 떨어진다. 그러나, 최근 팬데믹으로 세계 각국에서 확진자 수가 급증함에 따라 비용이 적게 들어가고 검사방법이 용이한 CXR 검사를 정확성을 높여 활용하자는 요구가 증가하고 있다.

그동안 심층 학습(Deep Learning) 기법을 적용해 CXR 영상을 통해 코로나19를 진단하는 여러 연구사례가 보고되고 있지만 진단 정확성을 높이기 위해서는 많은 양의 데이터 확보가 필수적이며 현재와 같은 비상 상황에서는 일관되게 정제된 대량의 데이터를 수집하기가 극히 어렵다.

예 교수 연구팀은 자체 개발한 전처리(Preprocessing)와 국소 패치 기반 방식(Local Patch-based Approach)을 통해 이런 문제점을 해결했다. 적은 데이터 세트에서 발생할 수 있는 영상 간 이질성(Heterogeneity)을 일관된 전처리 과정으로 정규화한 뒤, 국소 패치 기반 방식으로 하나의 영상에서 다양한 패치 영상들을 얻어냄으로써 이미지의 다양성을 확보했다.

또 국소 패치 기반 방식의 장점을 활용한 새로운 인공지능 기술인 `확률적 특징 지도 시각화(Probabilistic Saliency Map Visualization)' 방식을 활용해 CXR 영상에서 코로나19 진단에 중요한 부분을 고화질로 강조해주는 특징 지도를 만들었는데 이 지도가 진단 영상학적 특징과 일치하는 것을 확인했다.

예종철 교수는 "인공지능 알고리즘 기술을 환자의 선별 진료에 활용하면 코로나19 감염 여부를 상시 신속하게 진단할 수 있고 이를 통해 가능성이 낮은 환자를 배제함으로써 한정된 의료 자원을 보다 우선순위가 높은 대상에게 효율적으로 배분할 수 있게 해줄 것ˮ 이라고 말했다.

한편, 이 연구는 한국연구재단 중견연구자지원사업의 지원을 받아 수행됐다.

2020.05.25 조회수 17252

정확성이 획기적으로 향상된 코로나19 영상 진단 기술 개발

우리 대학 바이오및뇌공학과 예종철 교수 연구팀이 흉부 단순 방사선 촬영 영상으로 신종 코로나바이러스 감염증(이하 코로나19) 진단의 정확성을 획기적으로 개선한 인공지능(AI) 기술을 개발했다.

예 교수 연구팀이 개발한 인공지능 기술을 사용해 코로나19 감염 여부를 진단한 결과, 영상 판독 전문가의 69%보다 17%가 향상된 86%이상의 우수한 정확성을 보였다고 KAIST 관계자는 설명했다.

이 기술을 세계적으로 대유행하는 코로나19 선별 진료(Triage)체계에 도입하면 상시 신속한 진단이 가능할 뿐만 아니라 한정된 의료 자원의 효율적인 사용에 큰 도움을 줄 것으로 기대된다.

오유진 박사과정과 박상준 박사과정이 공동 1저자로 참여한 이 연구 결과는 국제 학술지 `아이트리플이 트랜잭션 온 메디컬 이미징(IEEE transactions on medical imaging)'의 `영상기반 코로나19 진단 인공지능기술' 특집호 5월 8일 字 온라인판에 게재됐다. (논문명 : Deep Learning COVID-19 Features on CXR using Limited Training Data Sets)

현재 전 세계적으로 확진자 500만 명을 넘긴 코로나19 진단검사에는 통상 역전사 중합 효소 연쇄 반응(RT-PCR, Reverse Transcription Polymerase Chain Reaction)을 이용한 장비가 사용된다. RT-PCR 검사의 정확성은 90% 이상으로 알려져 있으나, 검사 결과가 나오기까지는 많은 시간이 걸리며 모든 환자에게 시행하기에 비용이 많이 든다는 단점이 있다.

컴퓨터 단층촬영(CT, Computed Tomography)을 이용한 검사도 비교적 높은 정확성을 보이지만 일반적인 X선 단순촬영 검사에 비해 많은 시간이 소요되고 바이러스에 의한 장비의 오염 가능성 때문에 선별 진료에 사용되기 어렵다.

흉부 단순 방사선 촬영(CXR, Chest X-ray)은 여러 폐 질환에서 표준 선별 검사로 활용되고 있지만 코로나19에는 RT-PCR와 CT 검사에 비해 정확성이 현저하게 떨어진다. 그러나, 최근 팬데믹으로 세계 각국에서 확진자 수가 급증함에 따라 비용이 적게 들어가고 검사방법이 용이한 CXR 검사를 정확성을 높여 활용하자는 요구가 증가하고 있다.

그동안 심층 학습(Deep Learning) 기법을 적용해 CXR 영상을 통해 코로나19를 진단하는 여러 연구사례가 보고되고 있지만 진단 정확성을 높이기 위해서는 많은 양의 데이터 확보가 필수적이며 현재와 같은 비상 상황에서는 일관되게 정제된 대량의 데이터를 수집하기가 극히 어렵다.

예 교수 연구팀은 자체 개발한 전처리(Preprocessing)와 국소 패치 기반 방식(Local Patch-based Approach)을 통해 이런 문제점을 해결했다. 적은 데이터 세트에서 발생할 수 있는 영상 간 이질성(Heterogeneity)을 일관된 전처리 과정으로 정규화한 뒤, 국소 패치 기반 방식으로 하나의 영상에서 다양한 패치 영상들을 얻어냄으로써 이미지의 다양성을 확보했다.

또 국소 패치 기반 방식의 장점을 활용한 새로운 인공지능 기술인 `확률적 특징 지도 시각화(Probabilistic Saliency Map Visualization)' 방식을 활용해 CXR 영상에서 코로나19 진단에 중요한 부분을 고화질로 강조해주는 특징 지도를 만들었는데 이 지도가 진단 영상학적 특징과 일치하는 것을 확인했다.

예종철 교수는 "인공지능 알고리즘 기술을 환자의 선별 진료에 활용하면 코로나19 감염 여부를 상시 신속하게 진단할 수 있고 이를 통해 가능성이 낮은 환자를 배제함으로써 한정된 의료 자원을 보다 우선순위가 높은 대상에게 효율적으로 배분할 수 있게 해줄 것ˮ 이라고 말했다.

한편, 이 연구는 한국연구재단 중견연구자지원사업의 지원을 받아 수행됐다.

2020.05.25 조회수 17252 피부형 센서 패치 하나로 사람 움직임을 측정하는 기술 개발

우리 대학 전산학부 조성호 교수 연구팀이 서울대 기계공학과 고승환 교수 연구팀과 협력 연구를 통해 딥러닝 기술을 센서와 결합, 최소한의 데이터로 인체 움직임을 정확하게 측정 가능한 유연한 `피부 형 센서'를 개발했다.

공동연구팀이 개발한 피부 형 센서에는 인체의 움직임에 의해 발생하는 복합적 신호를 피부에 부착한 최소한의 센서로 정밀하게 측정하고, 이를 딥러닝 기술로 분리, 분석하는 기술이 적용됐다.

이번 연구에는 김민(우리 대학), 김권규(서울대), 하인호(서울대) 박사과정이 공동 제1 저자로 참여했으며 국제 학술지 `네이처 커뮤니케이션스(Nature Communications)' 5월 1일 字 온라인판에 게재됐다. (논문명 : A deep-learned skin decoding the epicentral human motions).

사람의 움직임 측정 방법 중 가장 널리 쓰이는 방식인 모션 캡처 카메라를 사용하는 방식은 카메라가 설치된 공간에서만 움직임 측정이 가능해 장소적 제약을 받아왔다. 반면 웨어러블 장비를 사용할 경우 장소제약 없이 사용자의 상태 변화를 측정할 수 있어, 다양한 환경에서 사람의 상태를 전달할 수 있다.

다만 기존 웨어러블 기기들은 측정 부위에 직접 센서를 부착해 측정이 이뤄지기 때문에 측정 부위, 즉 관절이 늘어나면 더 많은 센서가 수십 개에서 많게는 수백 개까지 요구된다는 단점이 있다.

공동연구팀이 개발한 피부 형 센서는 `크랙' 에 기반한 고(高) 민감 센서로, 인체의 움직임이 발생하는 근원지에서 먼 위치에 부착해서 간접적으로도 인체의 움직임을 측정할 수 있다. `크랙' 이란 나노 입자에 균열이 생긴다는 뜻인데, 연구팀은 이 균열로 인해 발생하는 센서값을 변화시켜 미세한 손목 움직임 변화까지 측정할 수 있다고 설명했다.

연구팀은 또 딥러닝 모델을 사용, 센서의 시계열 신호를 분석해 손목에 부착된 단 하나의 센서 신호로 여러 가지 손가락 관절 움직임을 측정할 수 있게 했다. 사용자별 신호 차이를 교정하고, 데이터 수집을 최소화하기 위해서는 전이학습(Transfer Learning)을 통해 기존 학습된 지식을 전달했다. 이로써 적은 양의 데이터와 적은 학습 시간으로 모델을 학습하는 시스템을 완성하는 데 성공했다.

우리 대학 전산학부 조성호 교수는 "이번 연구는 딥러닝 기술을 활용해 실제 환경에서 더욱 효과적으로 사람의 실시간 정보를 획득하는 방법을 제시했다는 점에서 의미가 있다ˮ며 "이 측정 방법을 적용하면 웨어러블 증강현실 기술의 보편화 시대는 더욱 빨리 다가올 것ˮ 이라고 예상했다.