%ED%8A%9C%ED%86%A0%EB%A6%AC%EC%96%BC

-

KAIST 설명가능 인공지능연구센터, XAI 기술 이해 저변을 넓히기 위한 튜토리얼 시리즈 개최

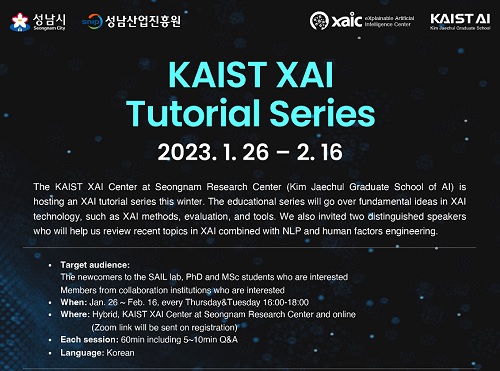

인공지능(AI) 기술 발전과 활용 분야가 확대되면서 다양한 AI 기반 서비스들이 등장하고 있다. 하지만 실제로는 어떤 원리로 작동하는지 이해하기 어려워 이용자 입장에서는 막연하게 느껴질 때가 많다. 이 같은 상황에서 국내 대표적인 설명가능 인공지능 연구그룹인 KAIST 설명가능 인공지능연구센터 (센터장 최재식 교수) 연구진이 지난 1월 26일부터 2월 16일까지 7회에 걸쳐 ‘설명가능 인공지능 (XAI, Explainable Artificial Intelligence)’ 알고리즘, 평가기법, 툴 등 XAI 분야의 주요 기술을 총망라하여 소개하는 튜토리얼 시리즈를 개최했다. 이 행사에는 관련 분야 연구자뿐만 아니라 AI 기술기반 제품을 개발 중인 기업(성남시 소재) 관계자 약 130여명이 신청하여 XAI에 대해 높아진 관심을 알 수 있었다. 센터장 최재식 교수는 “AI기술을 활용하는 산업에서 필수로 자리잡게 될 XAI 분야 기반 기술에 대한 교육 프로그램을 제공하여 유관 연구기관 및 기업들이 성과를 높이는 데에 기여하고자 한다”고 행사 취지를 밝혔다.

이번 KAIST XAI 튜토리얼 시리즈엔 KAIST 설명가능 인공지능연구센터 소속 석박사과정 연구원 총 11명과 센터장 최재식 교수, 그리고 초청 연사로서 박우진 교수(서울대 산업공학과), 서민준 교수(KAIST 김재철AI대학원) 등 국내외 전문가들이 강연을 담당해 △다양한 XAI 알고리즘 △XAI 알고리즘의 평가기법과 툴 △사용자 중심 XAI 인터페이스 △대규모 언어모델 기반 추론 기술로 최근 주목을 받고 있는 Chain of Thoughts 등을 주제로 발표했다.

‘설명가능 인공지능’이란 기계학습 및 딥러닝 모델이 내놓은 결과에 대해 왜 그런 결과가 나온 것인지를 사람이 이해할 수 있는 방식으로 설명해주는 기술이다. 예를 들어, 자율주행차가 주행 중 장애물을 발견하여 급정거를 했을 때 왜 그런 판단을 했는지 사람에게 설명할 수 있어야 한다. 그래야 사고 위험을 줄일 수 있고 오작동 시 책임 소재도 가릴 수 있다. 최근 딥러닝 알고리즘의 성능이 향상되고 있지만 아직까지는 사용자들이 내부 로직에 대해 이해할 수 있는 설명을 제공하는 기술까지 적용된 사례는 많지 않다. 앞으로 다양한 산업분야에서 인공지능 기술을 도입함에 따라 적용된 AI기술에 대한 신뢰성과 투명성을 담보하기 위해서 반드시 함께 제공되어야 하는 것이 설명가능 인공지능 기술이라고 볼 수 있다.

KAIST 설명가능 인공지능연구센터 (http://xai.kaist.ac.kr)는 사람중심인공지능 핵심원천기술개발(R&D)사업의 일환으로 과학기술정보통신부와 정보통신기획평가원(IITP)의 후원으로 설립된 연구조직으로서 현재 KAIST 김재철AI대학원 성남연구센터에 자리잡고 있다. 튜토리얼 자료와 동영상은 KAIST 설명가능 인공지능연구센터 홈페이지에서 제공될 예정이다. (관련 문의: 김나리 교수(nari.kim@kaist.ac.kr))

2023.02.15 조회수 7998

KAIST 설명가능 인공지능연구센터, XAI 기술 이해 저변을 넓히기 위한 튜토리얼 시리즈 개최

인공지능(AI) 기술 발전과 활용 분야가 확대되면서 다양한 AI 기반 서비스들이 등장하고 있다. 하지만 실제로는 어떤 원리로 작동하는지 이해하기 어려워 이용자 입장에서는 막연하게 느껴질 때가 많다. 이 같은 상황에서 국내 대표적인 설명가능 인공지능 연구그룹인 KAIST 설명가능 인공지능연구센터 (센터장 최재식 교수) 연구진이 지난 1월 26일부터 2월 16일까지 7회에 걸쳐 ‘설명가능 인공지능 (XAI, Explainable Artificial Intelligence)’ 알고리즘, 평가기법, 툴 등 XAI 분야의 주요 기술을 총망라하여 소개하는 튜토리얼 시리즈를 개최했다. 이 행사에는 관련 분야 연구자뿐만 아니라 AI 기술기반 제품을 개발 중인 기업(성남시 소재) 관계자 약 130여명이 신청하여 XAI에 대해 높아진 관심을 알 수 있었다. 센터장 최재식 교수는 “AI기술을 활용하는 산업에서 필수로 자리잡게 될 XAI 분야 기반 기술에 대한 교육 프로그램을 제공하여 유관 연구기관 및 기업들이 성과를 높이는 데에 기여하고자 한다”고 행사 취지를 밝혔다.

이번 KAIST XAI 튜토리얼 시리즈엔 KAIST 설명가능 인공지능연구센터 소속 석박사과정 연구원 총 11명과 센터장 최재식 교수, 그리고 초청 연사로서 박우진 교수(서울대 산업공학과), 서민준 교수(KAIST 김재철AI대학원) 등 국내외 전문가들이 강연을 담당해 △다양한 XAI 알고리즘 △XAI 알고리즘의 평가기법과 툴 △사용자 중심 XAI 인터페이스 △대규모 언어모델 기반 추론 기술로 최근 주목을 받고 있는 Chain of Thoughts 등을 주제로 발표했다.

‘설명가능 인공지능’이란 기계학습 및 딥러닝 모델이 내놓은 결과에 대해 왜 그런 결과가 나온 것인지를 사람이 이해할 수 있는 방식으로 설명해주는 기술이다. 예를 들어, 자율주행차가 주행 중 장애물을 발견하여 급정거를 했을 때 왜 그런 판단을 했는지 사람에게 설명할 수 있어야 한다. 그래야 사고 위험을 줄일 수 있고 오작동 시 책임 소재도 가릴 수 있다. 최근 딥러닝 알고리즘의 성능이 향상되고 있지만 아직까지는 사용자들이 내부 로직에 대해 이해할 수 있는 설명을 제공하는 기술까지 적용된 사례는 많지 않다. 앞으로 다양한 산업분야에서 인공지능 기술을 도입함에 따라 적용된 AI기술에 대한 신뢰성과 투명성을 담보하기 위해서 반드시 함께 제공되어야 하는 것이 설명가능 인공지능 기술이라고 볼 수 있다.

KAIST 설명가능 인공지능연구센터 (http://xai.kaist.ac.kr)는 사람중심인공지능 핵심원천기술개발(R&D)사업의 일환으로 과학기술정보통신부와 정보통신기획평가원(IITP)의 후원으로 설립된 연구조직으로서 현재 KAIST 김재철AI대학원 성남연구센터에 자리잡고 있다. 튜토리얼 자료와 동영상은 KAIST 설명가능 인공지능연구센터 홈페이지에서 제공될 예정이다. (관련 문의: 김나리 교수(nari.kim@kaist.ac.kr))

2023.02.15 조회수 7998 -

신기정 교수 연구팀, 정보검색 분야 최우수 학술대회 ACM CIKM 2022 튜토리얼 강연

우리 대학 김재철AI대학원 신기정 교수가 이끄는 연구팀이 지난 10월 17일부터 10월 21일까지 미국 애틀랜타에서 진행된 미 컴퓨터협회 정보 및 지식 관리 학술대회(이하 ACM CIKM 2022)에서 튜토리얼 강연을 진행했다고 1일 밝혔다.

올해 31회를 맞은 ACM CIKM은, 정보 검색(Information Retrieval) 분야 세계 최고 권위 학회 중 하나로, 전 세계에서 해당 분야 전문가들이 참석해 최신 연구 성과를 공유한다. ACM CIKM에서는 매년 강연자의 전문성 그리고 강연 주제의 깊이와 다양성 등을 고려해 강연자를 선정해 튜토리얼 강연을 열고 있다.

김재철AI대학원 이건 석박통합과정과 유재민 박사(미국 카네기멜론대학교 박사 후 연구원)로 구성된 신기정 교수 연구팀은 `Mining of Real-world Hypergraphs: Concepts, Patterns, and Generators'라는 제목으로 ACM CIKM 2022 학술대회에서 튜토리얼 강연을 진행했다.

사회, 뇌, 웹 등의 다양한 복잡계는 구성요소끼리 상호작용하는 특징이 있다. 이러한 상호작용 중 다수는 셋 이상의 구성요소가 참여하는 `그룹 상호작용'이나 분석의 용이성을 위해 두 개의 구성요소가 참여하는 `쌍 상호작용'을 가정하는 경우가 많았다. 하지만, 하이퍼그래프를 활용해 그룹 상호작용을 쉽고 효과적으로 모델링하고 분석할 수 있다는 사실이 최근 많은 주목을 받았다. 하이퍼그래프는 정점(Vertex)들과 초간선(Hyperedge)들로 구성되며, 하나의 초간선은 임의의 수의 정점을 포함하는 집합이다. 복잡계의 구성요소들을 표현하기 위해 정점이 사용되며, 그룹 상호작용들을 표현하기 초간선이 사용된다.

튜토리얼 강연에서 신기정 교수는 다양한 복잡계를 구성하는 요소들 사이의 그룹 상호작용으로 인해 발생하는 패턴을 발견하고 이에 대한 설명을 제공하기 위한 하이퍼그래프 기반 최신 인공지능 및 빅데이터 기술들을 소개했다. 강연은 정적인 패턴, 동적인 패턴, 그리고 패턴들에 대한 설명을 제공하기 위한 생성 모형 세 부분으로 나뉘어서 3시간 동안 진행됐다. 스탠퍼드 대학교, 코넬 대학교 등 세계 유수 대학의 연구 논문과 함께, 신기정 교수 연구팀의 연구 논문 7편도 소개됐다.

신기정 교수는 "하이퍼그래프에 대한 이론적인 연구는 많지만, 하이퍼그래프를 활용해 실제 복잡계를 분석하는 실증적인 연구는 걸음마 단계다ˮ라며, "튜토리얼을 통해 더 많은 사람이 이 주제에 관심을 갖기를 기대하며, 다양한 후속 연구를 통해 복잡계에 대한 인류의 이해를 크게 증진시킬 것을 기대한다ˮ라고 설명했다.

신기정 교수 연구팀은 올해 11월 28일부터 진행되는 전기전자공학자협회 데이터 마이닝 학술대회(IEEE ICDM 2022)에서도 튜토리얼 강연자로 선정됐다. 올해 22회를 맞는 IEEE ICDM은, 데이터 마이닝(Data Mining) 분야의 세계 최고 권위 학회 중 하나로, 올해 12월 1일까지 미국 올랜도에서 개최될 예정이다.

한편 이번 튜토리얼은 과학기술정보통신부 재원으로 한국연구재단의 지원을 받은 대용량 하이퍼그래프 마이닝: 패턴, 아웃라이어, 학습, 및 요약 과제와 정보통신기획평가원의 지원을 받은 강건하고 공정하며 확장 가능한 데이터 중심의 연속 학습 과제의 성과이다.

2022.11.01 조회수 7441

신기정 교수 연구팀, 정보검색 분야 최우수 학술대회 ACM CIKM 2022 튜토리얼 강연

우리 대학 김재철AI대학원 신기정 교수가 이끄는 연구팀이 지난 10월 17일부터 10월 21일까지 미국 애틀랜타에서 진행된 미 컴퓨터협회 정보 및 지식 관리 학술대회(이하 ACM CIKM 2022)에서 튜토리얼 강연을 진행했다고 1일 밝혔다.

올해 31회를 맞은 ACM CIKM은, 정보 검색(Information Retrieval) 분야 세계 최고 권위 학회 중 하나로, 전 세계에서 해당 분야 전문가들이 참석해 최신 연구 성과를 공유한다. ACM CIKM에서는 매년 강연자의 전문성 그리고 강연 주제의 깊이와 다양성 등을 고려해 강연자를 선정해 튜토리얼 강연을 열고 있다.

김재철AI대학원 이건 석박통합과정과 유재민 박사(미국 카네기멜론대학교 박사 후 연구원)로 구성된 신기정 교수 연구팀은 `Mining of Real-world Hypergraphs: Concepts, Patterns, and Generators'라는 제목으로 ACM CIKM 2022 학술대회에서 튜토리얼 강연을 진행했다.

사회, 뇌, 웹 등의 다양한 복잡계는 구성요소끼리 상호작용하는 특징이 있다. 이러한 상호작용 중 다수는 셋 이상의 구성요소가 참여하는 `그룹 상호작용'이나 분석의 용이성을 위해 두 개의 구성요소가 참여하는 `쌍 상호작용'을 가정하는 경우가 많았다. 하지만, 하이퍼그래프를 활용해 그룹 상호작용을 쉽고 효과적으로 모델링하고 분석할 수 있다는 사실이 최근 많은 주목을 받았다. 하이퍼그래프는 정점(Vertex)들과 초간선(Hyperedge)들로 구성되며, 하나의 초간선은 임의의 수의 정점을 포함하는 집합이다. 복잡계의 구성요소들을 표현하기 위해 정점이 사용되며, 그룹 상호작용들을 표현하기 초간선이 사용된다.

튜토리얼 강연에서 신기정 교수는 다양한 복잡계를 구성하는 요소들 사이의 그룹 상호작용으로 인해 발생하는 패턴을 발견하고 이에 대한 설명을 제공하기 위한 하이퍼그래프 기반 최신 인공지능 및 빅데이터 기술들을 소개했다. 강연은 정적인 패턴, 동적인 패턴, 그리고 패턴들에 대한 설명을 제공하기 위한 생성 모형 세 부분으로 나뉘어서 3시간 동안 진행됐다. 스탠퍼드 대학교, 코넬 대학교 등 세계 유수 대학의 연구 논문과 함께, 신기정 교수 연구팀의 연구 논문 7편도 소개됐다.

신기정 교수는 "하이퍼그래프에 대한 이론적인 연구는 많지만, 하이퍼그래프를 활용해 실제 복잡계를 분석하는 실증적인 연구는 걸음마 단계다ˮ라며, "튜토리얼을 통해 더 많은 사람이 이 주제에 관심을 갖기를 기대하며, 다양한 후속 연구를 통해 복잡계에 대한 인류의 이해를 크게 증진시킬 것을 기대한다ˮ라고 설명했다.

신기정 교수 연구팀은 올해 11월 28일부터 진행되는 전기전자공학자협회 데이터 마이닝 학술대회(IEEE ICDM 2022)에서도 튜토리얼 강연자로 선정됐다. 올해 22회를 맞는 IEEE ICDM은, 데이터 마이닝(Data Mining) 분야의 세계 최고 권위 학회 중 하나로, 올해 12월 1일까지 미국 올랜도에서 개최될 예정이다.

한편 이번 튜토리얼은 과학기술정보통신부 재원으로 한국연구재단의 지원을 받은 대용량 하이퍼그래프 마이닝: 패턴, 아웃라이어, 학습, 및 요약 과제와 정보통신기획평가원의 지원을 받은 강건하고 공정하며 확장 가능한 데이터 중심의 연속 학습 과제의 성과이다.

2022.11.01 조회수 7441 -

황의종 교수, AI with Google 2018 컨퍼런스 연설

우리 대학 전기및전자공학부 황의종 교수가 6월 26일 서울 대치동 구글캠퍼스서울에서 열린 ‘AI with Google 2018’ 컨퍼런스에서 산업계 전문가들과 발표 및 토론 패널로 참여했다.

'모두를 위한 AI’라는 주제 하에 AI 혁신에 대한 지식과 도전 과제에 대한 생각을 공유하는 이 날 행사에서는 구글 AI 총괄 제프 딘(Jeff Dean) 박사가 키노트 강연을 진행했고, 학계에서는 황의종 교수가 유일하게 참여해 ‘KAIST에서의 AI 연구 및 인재 양성’주제로 발표했다.

이어서 패널 토의에서는 AI 혁신에 대한 지식과 앞으로의 도전 과제를 나눴다.

황 교수는 구글 연구소에서 5년간 연구원으로 근무했고 TensorFlow Extended 머신러닝 플랫폼의 데이터 인프라를 공동개발하며 ACM SIGKDD 논문, ACM SIGMOD 튜토리얼 등의 연구실적이 있다.

우리 대학에서는 빅데이터-인공지능 융합 연구를 기반으로 머신러닝 과정에 들어가는 데이터 관리 연구를 수행 중이다.

2018.07.10 조회수 14140

황의종 교수, AI with Google 2018 컨퍼런스 연설

우리 대학 전기및전자공학부 황의종 교수가 6월 26일 서울 대치동 구글캠퍼스서울에서 열린 ‘AI with Google 2018’ 컨퍼런스에서 산업계 전문가들과 발표 및 토론 패널로 참여했다.

'모두를 위한 AI’라는 주제 하에 AI 혁신에 대한 지식과 도전 과제에 대한 생각을 공유하는 이 날 행사에서는 구글 AI 총괄 제프 딘(Jeff Dean) 박사가 키노트 강연을 진행했고, 학계에서는 황의종 교수가 유일하게 참여해 ‘KAIST에서의 AI 연구 및 인재 양성’주제로 발표했다.

이어서 패널 토의에서는 AI 혁신에 대한 지식과 앞으로의 도전 과제를 나눴다.

황 교수는 구글 연구소에서 5년간 연구원으로 근무했고 TensorFlow Extended 머신러닝 플랫폼의 데이터 인프라를 공동개발하며 ACM SIGKDD 논문, ACM SIGMOD 튜토리얼 등의 연구실적이 있다.

우리 대학에서는 빅데이터-인공지능 융합 연구를 기반으로 머신러닝 과정에 들어가는 데이터 관리 연구를 수행 중이다.

2018.07.10 조회수 14140