%EB%A8%B8%EC%8B%A0%EB%9F%AC%EB%8B%9D

-

최초 머신러닝 기반 유전체 정렬 소프트웨어 개발

우리 대학 전기및전자공학부 한동수 교수 연구팀이 머신러닝(기계학습)에 기반한 *유전체 정렬 소프트웨어를 개발했다고 12일 밝혔다.

☞ 유전체(genome): 생명체가 가지고 있는 염기서열 정보의 총합이며, 유전자는 생물학적 특징을 발현하는 염기서열들을 지칭한다. 유전체를 한 권의 책이라고 비유하면 유전자는 공백을 제외한 모든 글자라고 비유할 수 있다.

차세대 염기서열 분석은 유전체 정보를 해독하는 방법으로 유전체를 무수히 많은 조각으로 잘라낸 후 각 조각을 참조 유전체(reference genome)에 기반해 조립하는 과정을 거친다. 조립된 유전체 정보는 암을 포함한 여러 질병의 예측과 맞춤형 치료, 백신 개발 등 다양한 분야에서 사용된다.

유전체 정렬 소프트웨어는 차세대 염기서열 분석 방법으로 생성한 유전체 조각 데이터를 온전한 유전체 정보로 조립하기 위해 사용되는 소프트웨어다. 유전체 정렬 작업에는 많은 연산이 들어가며, 속도를 높이고 비용을 낮추는 방법에 관한 관심이 계속해서 증가하고 있다. 머신러닝(기계학습) 기반의 인덱싱(색인) 기법(Learned-index)을 유전체 정렬 소프트웨어에 적용한 사례는 이번이 최초다.

전기및전자공학부 정영목 박사과정이 제1 저자로 참여한 이번 연구는 국제 학술지 `옥스포드 바이오인포메틱스(Oxford Bioinformatics)' 2022년 3월에 공개됐다. (논문명 : BWA-MEME: BWA-MEM emulated with a machine learning approach)

유전체 정렬 작업은 정렬해야 하는 유전체 조각의 양이 많고 참조 유전체의 길이도 길어 많은 연산량이 요구되는 작업이다. 또한, 유전체 정렬 소프트웨어에서 정렬 결과의 정확도에 따라 추후의 유전체 분석의 정확도가 영향을 받는다. 이러한 특성 때문에 유전체 정렬 소프트웨어는 높은 정확성을 유지하며 빠르게 연산하는 것이 중요하다.

일반적으로 유전체 분석에는 하버드 브로드 연구소(Broad Institute)에서 개발한 유전체 분석 도구 키트(Genome Analysis Tool Kit, 이하 GATK)를 이용한 데이터 처리 방법을 표준으로 사용한다. 이들 키트 중 BWA-MEM은 GATK에서 표준으로 채택한 유전체 정렬 소프트웨어이며, 2019년에 하버드 대학과 인텔(Intel)의 공동 연구로 BWA-MEM2가 개발됐다.

연구팀이 개발한 머신러닝 기반의 유전체 정렬 소프트웨어는 연산량을 대폭 줄이면서도 표준 유전체 정렬 소프트웨어 BWA-MEM2과 동일한 결과를 만들어 정확도를 유지했다. 사용한 머신러닝 기반의 인덱싱 기법은 주어진 데이터의 분포를 머신러닝 모델이 학습해, 데이터 분포에 최적화된 인덱싱을 찾는 방법론이다. 데이터에 적합하다고 생각되는 인덱싱 방법을 사람이 정하던 기존의 방법과 대비된다.

BWA-MEM과 BWA-MEM2에서 사용하는 인덱싱 기법(FM-index)은 유전자 조각의 위치를 찾기 위해 유전자 조각 길이만큼의 연산이 필요하지만, 연구팀이 제안한 알고리즘은 머신러닝 기반의 인덱싱 기법(Learned-index)을 활용해, 유전자 조각 길이와 상관없이 적은 연산량으로도 유전자 조각의 위치를 찾을 수 있다. 연구팀이 제안한 인덱싱 기법은 기존 인덱싱 기법과 비교해 3.4배 정도 가속화됐고, 이로 인해 유전체 정렬 소프트웨어는 1.4 배 가속화됐다.

연구팀이 이번 연구에서 개발한 유전체 정렬 소프트웨어는 오픈소스 (https://github.com/kaist-ina/BWA-MEME)로 공개돼 많은 분야에 사용될 것으로 기대되며, 유전체 분석에서 사용되는 다양한 소프트웨어를 머신러닝 기술로 가속화하는 연구들의 초석이 될 것으로 기대된다.

한동수 교수는 "이번 연구를 통해 기계학습 기술을 접목해 전장 유전체 빅데이터 분석을 기존 방식보다 빠르고 적은 비용으로 할 수 있다는 것을 보여줬으며, 앞으로 인공지능 기술을 활용해 전장 유전체 빅데이터 분석을 효율화, 고도화할 수 있을 것이라 기대된다ˮ고 말했다.

한편 이번 연구는 과학기술정보통신부의 재원으로 한국연구재단의 지원을 받아 데이터 스테이션 구축·운영 사업으로서 수행됐다.

2022.04.17 조회수 12040

최초 머신러닝 기반 유전체 정렬 소프트웨어 개발

우리 대학 전기및전자공학부 한동수 교수 연구팀이 머신러닝(기계학습)에 기반한 *유전체 정렬 소프트웨어를 개발했다고 12일 밝혔다.

☞ 유전체(genome): 생명체가 가지고 있는 염기서열 정보의 총합이며, 유전자는 생물학적 특징을 발현하는 염기서열들을 지칭한다. 유전체를 한 권의 책이라고 비유하면 유전자는 공백을 제외한 모든 글자라고 비유할 수 있다.

차세대 염기서열 분석은 유전체 정보를 해독하는 방법으로 유전체를 무수히 많은 조각으로 잘라낸 후 각 조각을 참조 유전체(reference genome)에 기반해 조립하는 과정을 거친다. 조립된 유전체 정보는 암을 포함한 여러 질병의 예측과 맞춤형 치료, 백신 개발 등 다양한 분야에서 사용된다.

유전체 정렬 소프트웨어는 차세대 염기서열 분석 방법으로 생성한 유전체 조각 데이터를 온전한 유전체 정보로 조립하기 위해 사용되는 소프트웨어다. 유전체 정렬 작업에는 많은 연산이 들어가며, 속도를 높이고 비용을 낮추는 방법에 관한 관심이 계속해서 증가하고 있다. 머신러닝(기계학습) 기반의 인덱싱(색인) 기법(Learned-index)을 유전체 정렬 소프트웨어에 적용한 사례는 이번이 최초다.

전기및전자공학부 정영목 박사과정이 제1 저자로 참여한 이번 연구는 국제 학술지 `옥스포드 바이오인포메틱스(Oxford Bioinformatics)' 2022년 3월에 공개됐다. (논문명 : BWA-MEME: BWA-MEM emulated with a machine learning approach)

유전체 정렬 작업은 정렬해야 하는 유전체 조각의 양이 많고 참조 유전체의 길이도 길어 많은 연산량이 요구되는 작업이다. 또한, 유전체 정렬 소프트웨어에서 정렬 결과의 정확도에 따라 추후의 유전체 분석의 정확도가 영향을 받는다. 이러한 특성 때문에 유전체 정렬 소프트웨어는 높은 정확성을 유지하며 빠르게 연산하는 것이 중요하다.

일반적으로 유전체 분석에는 하버드 브로드 연구소(Broad Institute)에서 개발한 유전체 분석 도구 키트(Genome Analysis Tool Kit, 이하 GATK)를 이용한 데이터 처리 방법을 표준으로 사용한다. 이들 키트 중 BWA-MEM은 GATK에서 표준으로 채택한 유전체 정렬 소프트웨어이며, 2019년에 하버드 대학과 인텔(Intel)의 공동 연구로 BWA-MEM2가 개발됐다.

연구팀이 개발한 머신러닝 기반의 유전체 정렬 소프트웨어는 연산량을 대폭 줄이면서도 표준 유전체 정렬 소프트웨어 BWA-MEM2과 동일한 결과를 만들어 정확도를 유지했다. 사용한 머신러닝 기반의 인덱싱 기법은 주어진 데이터의 분포를 머신러닝 모델이 학습해, 데이터 분포에 최적화된 인덱싱을 찾는 방법론이다. 데이터에 적합하다고 생각되는 인덱싱 방법을 사람이 정하던 기존의 방법과 대비된다.

BWA-MEM과 BWA-MEM2에서 사용하는 인덱싱 기법(FM-index)은 유전자 조각의 위치를 찾기 위해 유전자 조각 길이만큼의 연산이 필요하지만, 연구팀이 제안한 알고리즘은 머신러닝 기반의 인덱싱 기법(Learned-index)을 활용해, 유전자 조각 길이와 상관없이 적은 연산량으로도 유전자 조각의 위치를 찾을 수 있다. 연구팀이 제안한 인덱싱 기법은 기존 인덱싱 기법과 비교해 3.4배 정도 가속화됐고, 이로 인해 유전체 정렬 소프트웨어는 1.4 배 가속화됐다.

연구팀이 이번 연구에서 개발한 유전체 정렬 소프트웨어는 오픈소스 (https://github.com/kaist-ina/BWA-MEME)로 공개돼 많은 분야에 사용될 것으로 기대되며, 유전체 분석에서 사용되는 다양한 소프트웨어를 머신러닝 기술로 가속화하는 연구들의 초석이 될 것으로 기대된다.

한동수 교수는 "이번 연구를 통해 기계학습 기술을 접목해 전장 유전체 빅데이터 분석을 기존 방식보다 빠르고 적은 비용으로 할 수 있다는 것을 보여줬으며, 앞으로 인공지능 기술을 활용해 전장 유전체 빅데이터 분석을 효율화, 고도화할 수 있을 것이라 기대된다ˮ고 말했다.

한편 이번 연구는 과학기술정보통신부의 재원으로 한국연구재단의 지원을 받아 데이터 스테이션 구축·운영 사업으로서 수행됐다.

2022.04.17 조회수 12040 -

신소재 영상화 및 머신러닝을 활용한 미래 개척

우리 대학 신소재공학과 홍승범 교수 연구팀이 KAIST 10대 플래그쉽 분야이자, 글로벌 특이점 과제인 `KAIST 신소재 혁명: M3I3 이니셔티브' 과제의 배경, 역사, 진행 상황 그리고 미래 방향을 제시했다고 31일 밝혔다.

홍 교수 연구팀은 다중스케일 다중모드 영상화 기술과 머신러닝(기계학습) 기법을 융합해서 고차원의 구조-물성 및 공정-구조 상관관계를 도출했다. 그리고 이를 인공지능과 3차원 다중 스케일 프린팅 기술을 활용해서 신소재 디자인부터 시장 진입까지의 기간을 획기적으로 단축할 수 있는 비전과 실행 플랫폼을 제안했다. M3I3 플랫폼은 고용량 에너지 소재 디자인에서 시작해서, 고밀도 메모리 소재, 고성능 자동차/항공 소재에도 응용 가능할 것으로 기대된다.

우리 대학 신소재공학과 홍승범 교수가 제1 저자로, 리오치하오 박사가 제2 저자로 참여하고, 육종민 교수, 변혜령 교수, 양용수 교수, 조은애 교수, 최벽파 교수, 이혁모 교수가 공동 저자로 참여한 이번 연구는 국제 학술지 `에이씨에스 나노(ACS Nano)' 2월 12일 字 온라인 출판됐다. (논문명 : Reducing Time to Discovery: Materials and Molecular Modeling, Imaging, Informatics, and Integration)

역사의 큰 흐름을 결정한 신소재는 시행착오와 도제식의 비결 전수를 통해서 발견 및 개발돼왔다. 각종 무기와 그릇, 그리고 장신구들이 좋은 예다. 광학현미경이 발명되면서 검의 미세구조와 검의 강도 혹은 경도 간의 상관관계를 이해하기 시작했고, 투과전자현미경과 원자간력 현미경의 발명으로 원자 수준의 분해능으로 신소재를 영상화하기 시작했다.

고려청자를 현재 재현하지 못하는 것은 고려 시대의 장인들이 그 비결을 남기지 않았기 때문이라고 우리는 가르치고 있다. 그러나, 미래에는 고려청자의 다중 스케일 구조를 영상화해서 데이터화 하고, 구조를 구현할 수 있는 공정 과정을 머신러닝의 힘을 빌려 역설계한다면, 고려청자를 재현하는 일은 가능할 것으로 보인다.

우리 대학 M3I3 플랫폼은 이처럼 다중 스케일 및 다중 모드 영상화 기술, 데이터 마이닝과 머신러닝, 그리고 다중 스케일 제조 기술을 접목해 미래에 필요한 신소재를 역설계해서 빠르게 공정 레시피를 확보할 수 있게 만들어준다.

이번 논문에서는 M3I3 플랫폼의 유효성을 확인하기 위해 배터리 소재에 적용하는 연구를 진행했다. 고용량 배터리 소재의 개발 기간을 단축할 수 있다는 것을 검증하기 위해서 20년간의 논문 자료를 50여 명의 학생이 읽고 데이터를 추출해 양극재의 에너지 밀도와 소재 조성 간의 상관관계를 도출했다. 그리고 논문에 나와 있는 공정, 측정 및 구조 변수들을 머신러닝 기법을 활용해 모델을 수립한 후, 무작위 조건에서 합성해 모델의 정확도를 측정함으로써 데이터 마이닝과 머신러닝의 우수성을 입증했다.

또한 투과전자현미경(TEM), 주사투과전자현미경(STEM), 원자간력현미경(AFM), 광학현미경 등의 다양한 현미경과 엑스레이(X-ray), 라만(Raman), UV/Visible/IR 등 다양한 분광 장비들을 통해 얻은 영상과 스펙트럼 데이터를 기반으로 다중 스케일 구조↔물성 상관관계를 도출하고, 여러 가지 공정변수 데이터를 수집해, 공정↔구조 상관관계를 수립하는 것이 M3I3 플랫폼의 중요한 핵심이다. 특히, 실험데이터와 시뮬레이션 데이터를 융합하고, 머신러닝으로 생성한 가상의 데이터를 과학적인 기준에 맞춰 유의미한 빅데이터로 만들면, 머신러닝을 활용해 물성→구조→공정으로 연결되는 역설계 알고리즘을 개발하는 것이 가능해지며, 이를 통해 미래에 필요한 물성을 갖는 신소재 공정 레시피를 신속하게 확보할 수 있게 된다.

제1 저자인 홍승범 교수는 "과학은 날카로운 관찰과 정량적 측정에서 시작한 학문이며, 기술의 발전으로 현재는 눈에 보이는 소재의 모양과 구조뿐만 아니라 눈에 보이지 않는 소재의 구조를 볼 수 있는 시대가 왔고, 물성마저 공간과 시간의 함수로 영상화할 수 있는 시대가 도래했다ˮ라며 "신소재 영상화 기술과 머신러닝 기술을 융합하고 3D 프린팅 기술을 다중 스케일 자동 합성 기술로 승화시키게 되면 20년 걸리던 신소재 개발 기간을 5년 이내로 단축할 수 있을 것이다ˮ 라고 말했다.

한편, 이번 연구는 글로벌 특이점 사업의 지원을 받아 수행됐다.

2021.04.01 조회수 92581

신소재 영상화 및 머신러닝을 활용한 미래 개척

우리 대학 신소재공학과 홍승범 교수 연구팀이 KAIST 10대 플래그쉽 분야이자, 글로벌 특이점 과제인 `KAIST 신소재 혁명: M3I3 이니셔티브' 과제의 배경, 역사, 진행 상황 그리고 미래 방향을 제시했다고 31일 밝혔다.

홍 교수 연구팀은 다중스케일 다중모드 영상화 기술과 머신러닝(기계학습) 기법을 융합해서 고차원의 구조-물성 및 공정-구조 상관관계를 도출했다. 그리고 이를 인공지능과 3차원 다중 스케일 프린팅 기술을 활용해서 신소재 디자인부터 시장 진입까지의 기간을 획기적으로 단축할 수 있는 비전과 실행 플랫폼을 제안했다. M3I3 플랫폼은 고용량 에너지 소재 디자인에서 시작해서, 고밀도 메모리 소재, 고성능 자동차/항공 소재에도 응용 가능할 것으로 기대된다.

우리 대학 신소재공학과 홍승범 교수가 제1 저자로, 리오치하오 박사가 제2 저자로 참여하고, 육종민 교수, 변혜령 교수, 양용수 교수, 조은애 교수, 최벽파 교수, 이혁모 교수가 공동 저자로 참여한 이번 연구는 국제 학술지 `에이씨에스 나노(ACS Nano)' 2월 12일 字 온라인 출판됐다. (논문명 : Reducing Time to Discovery: Materials and Molecular Modeling, Imaging, Informatics, and Integration)

역사의 큰 흐름을 결정한 신소재는 시행착오와 도제식의 비결 전수를 통해서 발견 및 개발돼왔다. 각종 무기와 그릇, 그리고 장신구들이 좋은 예다. 광학현미경이 발명되면서 검의 미세구조와 검의 강도 혹은 경도 간의 상관관계를 이해하기 시작했고, 투과전자현미경과 원자간력 현미경의 발명으로 원자 수준의 분해능으로 신소재를 영상화하기 시작했다.

고려청자를 현재 재현하지 못하는 것은 고려 시대의 장인들이 그 비결을 남기지 않았기 때문이라고 우리는 가르치고 있다. 그러나, 미래에는 고려청자의 다중 스케일 구조를 영상화해서 데이터화 하고, 구조를 구현할 수 있는 공정 과정을 머신러닝의 힘을 빌려 역설계한다면, 고려청자를 재현하는 일은 가능할 것으로 보인다.

우리 대학 M3I3 플랫폼은 이처럼 다중 스케일 및 다중 모드 영상화 기술, 데이터 마이닝과 머신러닝, 그리고 다중 스케일 제조 기술을 접목해 미래에 필요한 신소재를 역설계해서 빠르게 공정 레시피를 확보할 수 있게 만들어준다.

이번 논문에서는 M3I3 플랫폼의 유효성을 확인하기 위해 배터리 소재에 적용하는 연구를 진행했다. 고용량 배터리 소재의 개발 기간을 단축할 수 있다는 것을 검증하기 위해서 20년간의 논문 자료를 50여 명의 학생이 읽고 데이터를 추출해 양극재의 에너지 밀도와 소재 조성 간의 상관관계를 도출했다. 그리고 논문에 나와 있는 공정, 측정 및 구조 변수들을 머신러닝 기법을 활용해 모델을 수립한 후, 무작위 조건에서 합성해 모델의 정확도를 측정함으로써 데이터 마이닝과 머신러닝의 우수성을 입증했다.

또한 투과전자현미경(TEM), 주사투과전자현미경(STEM), 원자간력현미경(AFM), 광학현미경 등의 다양한 현미경과 엑스레이(X-ray), 라만(Raman), UV/Visible/IR 등 다양한 분광 장비들을 통해 얻은 영상과 스펙트럼 데이터를 기반으로 다중 스케일 구조↔물성 상관관계를 도출하고, 여러 가지 공정변수 데이터를 수집해, 공정↔구조 상관관계를 수립하는 것이 M3I3 플랫폼의 중요한 핵심이다. 특히, 실험데이터와 시뮬레이션 데이터를 융합하고, 머신러닝으로 생성한 가상의 데이터를 과학적인 기준에 맞춰 유의미한 빅데이터로 만들면, 머신러닝을 활용해 물성→구조→공정으로 연결되는 역설계 알고리즘을 개발하는 것이 가능해지며, 이를 통해 미래에 필요한 물성을 갖는 신소재 공정 레시피를 신속하게 확보할 수 있게 된다.

제1 저자인 홍승범 교수는 "과학은 날카로운 관찰과 정량적 측정에서 시작한 학문이며, 기술의 발전으로 현재는 눈에 보이는 소재의 모양과 구조뿐만 아니라 눈에 보이지 않는 소재의 구조를 볼 수 있는 시대가 왔고, 물성마저 공간과 시간의 함수로 영상화할 수 있는 시대가 도래했다ˮ라며 "신소재 영상화 기술과 머신러닝 기술을 융합하고 3D 프린팅 기술을 다중 스케일 자동 합성 기술로 승화시키게 되면 20년 걸리던 신소재 개발 기간을 5년 이내로 단축할 수 있을 것이다ˮ 라고 말했다.

한편, 이번 연구는 글로벌 특이점 사업의 지원을 받아 수행됐다.

2021.04.01 조회수 92581 -

반도체 다층 소자의 개별 층 두께를 옹스트롬 정확도로 비파괴 검사하는 기술 개발

우리 대학 기계공학과 김정원 교수 연구팀이 삼차원 낸드플래시 메모리(이하 3D-NAND)의 비파괴적인 검사를 위해 광학 측정법과 머신러닝을 사용한 다층 두께 측정기술을 개발했다. 이 기술은 200층 이상의 초고밀도 3D-NAND 소자 공정 과정에서 전수검사 방법으로 사용돼 공정의 효율을 극대화할 수 있을 것으로 기대된다.

3D-NAND 메모리는 수백층의 메모리 셀이 적층되어 있는 메모리 반도체로, 기존의 평면형 플래시 메모리와 비교하여 저장용량과 에너지 효율이 매우 우수하여 개인용 USB부터 서버 시스템까지 다양하게 사용되고 있다.

기존에는 수직으로 적층된 반도체 셀들의 두께를 측정하기 위하여 전자현미경을 사용하였다. 하지만 전자현미경을 사용한 방법은 샘플의 단면을 이미징하기 위하여 샘플을 절단해야 하고 비용도 많이 들기 때문에, 전수검사로서는 적합하지 않은 문제가 있었다.

연구팀은 반도체 다층 구조가 초고속 광학 시스템에 자주 사용되는 유전체 거울의 구조와 유사하다는 점에 착안하여, 유전체 거울의 분석에 활용되는 광학 스펙트럼 측정법을 반도체 다층 구조에도 적용했다.

연구팀은 엘립소미터(ellipsometer)와 스펙트로포토미터(spectrophotometer)를 이용한 반도체 다층 샘플의 스펙트럼 측정과 머신러닝 알고리즘을 활용하여 200층이 넘는 반도체 물질의 각 층 두께를 1.6 옹스트롬 (1Å = 1미터의 100억 분의 1)의 평균제곱근오차로 예측할 수 있는 방법을 개발했다. 이 기술은 삼차원 반도체 소자의 검수 공정, 적층 공정, 그리고 식각 공정의 정확도를 크게 향상시킬 수 있을 것으로 기대된다.

연구팀은 또한 시뮬레이션 스펙트럼 데이터를 생성해 개별 층의 두께 불량을 검출할 수 있는 머신러닝 학습법도 개발했다. 그 결과 반도체 물질 적층 시 목표로 설정한 두께보다 약 50Å만큼 얇게 제작된 샘플들을 정상 범주의 샘플들로부터 성공적으로 분리할 수 있었다. 연구팀이 개발한 불량샘플 검출법은 시뮬레이션 데이터를 활용하기 때문에 큰 비용이 들지 않으며, 공정의 초기에 발견될 수 있는 불량 샘플들을 효과적으로 검출할 수 있을 것으로 기대된다.

최근 글로벌 IT 기업들의 서버 시스템에 대한 수요가 늘어나고 높은 저장용량을 가진 스마트 기기들이 개발됨에 따라, 초고밀도, 초고효율을 갖는 3D-NAND 메모리가 반도체 시장에서 각광받고 있다. 이번 연구 결과는 다양한 삼차원 반도체 소자들의 비파괴적인 검수를 위해 활용될 수 있다.

김 교수는 “비파괴적인 광학 측정법과 머신러닝을 결합한 방법은 다양한 반도체 검수 공정에도 적용할 수 있다”고 밝히며, “다양한 반도체 소자들의 형상이나 공정 조건 모니터링에도 광학측정법과 머신러닝을 결합한 접근방식을 활용할 것”이라고 말했다.

기계공학과 곽현수 박사과정 학생이 제1저자로 참여하고 삼성전자 메모리 계측기술팀과의 산학협력연구로 수행된 이번 연구는 국제학술지 ‘라이트: 어드밴스드 매뉴팩처링(Light: Advanced Manufacturing)’ 창간호에 1월 12일 게재됐다. (논문명: Non-destructive thickness characterisation of 3D multilayer semiconductor devices using optical spectral measurements and machine learning)

이번 연구는 삼성전자 산학연구과제의 지원을 받아 수행됐다.

2021.01.13 조회수 67298

반도체 다층 소자의 개별 층 두께를 옹스트롬 정확도로 비파괴 검사하는 기술 개발

우리 대학 기계공학과 김정원 교수 연구팀이 삼차원 낸드플래시 메모리(이하 3D-NAND)의 비파괴적인 검사를 위해 광학 측정법과 머신러닝을 사용한 다층 두께 측정기술을 개발했다. 이 기술은 200층 이상의 초고밀도 3D-NAND 소자 공정 과정에서 전수검사 방법으로 사용돼 공정의 효율을 극대화할 수 있을 것으로 기대된다.

3D-NAND 메모리는 수백층의 메모리 셀이 적층되어 있는 메모리 반도체로, 기존의 평면형 플래시 메모리와 비교하여 저장용량과 에너지 효율이 매우 우수하여 개인용 USB부터 서버 시스템까지 다양하게 사용되고 있다.

기존에는 수직으로 적층된 반도체 셀들의 두께를 측정하기 위하여 전자현미경을 사용하였다. 하지만 전자현미경을 사용한 방법은 샘플의 단면을 이미징하기 위하여 샘플을 절단해야 하고 비용도 많이 들기 때문에, 전수검사로서는 적합하지 않은 문제가 있었다.

연구팀은 반도체 다층 구조가 초고속 광학 시스템에 자주 사용되는 유전체 거울의 구조와 유사하다는 점에 착안하여, 유전체 거울의 분석에 활용되는 광학 스펙트럼 측정법을 반도체 다층 구조에도 적용했다.

연구팀은 엘립소미터(ellipsometer)와 스펙트로포토미터(spectrophotometer)를 이용한 반도체 다층 샘플의 스펙트럼 측정과 머신러닝 알고리즘을 활용하여 200층이 넘는 반도체 물질의 각 층 두께를 1.6 옹스트롬 (1Å = 1미터의 100억 분의 1)의 평균제곱근오차로 예측할 수 있는 방법을 개발했다. 이 기술은 삼차원 반도체 소자의 검수 공정, 적층 공정, 그리고 식각 공정의 정확도를 크게 향상시킬 수 있을 것으로 기대된다.

연구팀은 또한 시뮬레이션 스펙트럼 데이터를 생성해 개별 층의 두께 불량을 검출할 수 있는 머신러닝 학습법도 개발했다. 그 결과 반도체 물질 적층 시 목표로 설정한 두께보다 약 50Å만큼 얇게 제작된 샘플들을 정상 범주의 샘플들로부터 성공적으로 분리할 수 있었다. 연구팀이 개발한 불량샘플 검출법은 시뮬레이션 데이터를 활용하기 때문에 큰 비용이 들지 않으며, 공정의 초기에 발견될 수 있는 불량 샘플들을 효과적으로 검출할 수 있을 것으로 기대된다.

최근 글로벌 IT 기업들의 서버 시스템에 대한 수요가 늘어나고 높은 저장용량을 가진 스마트 기기들이 개발됨에 따라, 초고밀도, 초고효율을 갖는 3D-NAND 메모리가 반도체 시장에서 각광받고 있다. 이번 연구 결과는 다양한 삼차원 반도체 소자들의 비파괴적인 검수를 위해 활용될 수 있다.

김 교수는 “비파괴적인 광학 측정법과 머신러닝을 결합한 방법은 다양한 반도체 검수 공정에도 적용할 수 있다”고 밝히며, “다양한 반도체 소자들의 형상이나 공정 조건 모니터링에도 광학측정법과 머신러닝을 결합한 접근방식을 활용할 것”이라고 말했다.

기계공학과 곽현수 박사과정 학생이 제1저자로 참여하고 삼성전자 메모리 계측기술팀과의 산학협력연구로 수행된 이번 연구는 국제학술지 ‘라이트: 어드밴스드 매뉴팩처링(Light: Advanced Manufacturing)’ 창간호에 1월 12일 게재됐다. (논문명: Non-destructive thickness characterisation of 3D multilayer semiconductor devices using optical spectral measurements and machine learning)

이번 연구는 삼성전자 산학연구과제의 지원을 받아 수행됐다.

2021.01.13 조회수 67298 -

전산학부 공태식 박사과정, Google Ph.D Fellowship 2020선정

구글은 지난 10월 8일 2020년도 Google Ph.D Fellowship 수혜자 목록을 발표했다. Google Ph.D Fellowship 프로그램은 컴퓨터과학 및 관련 분야의 뛰어나고 촉망받는 대학원생들을 지원하기 위한 프로그램으로, 이번 년도에는 전 세계 대학에서 12개 분야에 총 53명이 선정됐다. 우리 대학 공태식 학생은 기계학습(Machine Learning) 부문에 이름을 올리는 영예를 안았다.

공태식 연구원은 KAIST 네트워킹 및 모바일 시스템 연구실 (지도교수: 전기및전자공학부 이성주 교수) 박사과정이다. 주 연구 분야는 기계학습을 활용한 모바일 센싱으로, “환경 독립적 모바일 센싱 (Condition-independent mobile sensing)” 연구에 대한 연구 업적과 가능성을 인정받아 이번 Google Ph.D. Fellowship 2020에 선정됐다.

한편, 공태식 연구원은 센서 및 유비쿼터스 컴퓨팅 분야 최고 학회인 ACM SenSys, ACM UbiComp 등에 주 저자로 논문을 발표했고 Microsoft Research Asia 및 Nokia Bell Labs에서 research intern으로 활동하였다. 또한 연구 성과를 인정받아 2018년 NAVER Ph.D. Fellowship에도 선정된 바 있다.

2020.10.12 조회수 23163

전산학부 공태식 박사과정, Google Ph.D Fellowship 2020선정

구글은 지난 10월 8일 2020년도 Google Ph.D Fellowship 수혜자 목록을 발표했다. Google Ph.D Fellowship 프로그램은 컴퓨터과학 및 관련 분야의 뛰어나고 촉망받는 대학원생들을 지원하기 위한 프로그램으로, 이번 년도에는 전 세계 대학에서 12개 분야에 총 53명이 선정됐다. 우리 대학 공태식 학생은 기계학습(Machine Learning) 부문에 이름을 올리는 영예를 안았다.

공태식 연구원은 KAIST 네트워킹 및 모바일 시스템 연구실 (지도교수: 전기및전자공학부 이성주 교수) 박사과정이다. 주 연구 분야는 기계학습을 활용한 모바일 센싱으로, “환경 독립적 모바일 센싱 (Condition-independent mobile sensing)” 연구에 대한 연구 업적과 가능성을 인정받아 이번 Google Ph.D. Fellowship 2020에 선정됐다.

한편, 공태식 연구원은 센서 및 유비쿼터스 컴퓨팅 분야 최고 학회인 ACM SenSys, ACM UbiComp 등에 주 저자로 논문을 발표했고 Microsoft Research Asia 및 Nokia Bell Labs에서 research intern으로 활동하였다. 또한 연구 성과를 인정받아 2018년 NAVER Ph.D. Fellowship에도 선정된 바 있다.

2020.10.12 조회수 23163 -

학습되지 않은 환경에서 스스로 학습하는 모바일 센싱 기술 개발

우리 대학 전산학부 이성주 교수 연구팀이 학습되지 않은 환경에 적은 양의 데이터로 스스로 적응하는 모바일 센싱 학습 기술 <메타센스(MetaSense)>를 개발했다.

모바일 센싱이란 스마트폰과 같은 모바일 기기의 다양한 센서를 이용하여 서비스(예: 수면의 질 평가, 걸음 수 추적 등)를 제공하는 기술이다. 최근 학계에서는 기계학습 기술의 발전과 더불어 우울증 진단, 운동 자세 관리 등 진보된 모바일 센싱의 가능성을 보여줌으로써 모바일 센싱의 범위를 더욱 확장하고 있다.

하지만 이러한 센싱 기술은 아직 널리 쓰이지 못하고 있다. 사용자 개인마다 가지고 있는 모바일 센싱의 환경이 다르기 때문이다. 사람마다 가지고 있는 고유한 생활패턴과 행동방식, 서로 다른 모바일 기기와 그 사양은 센서의 값에 큰 영향을 미친다. 다른 센서 값은 사람마다 고유한 센싱 환경을 만들고, 이는 센싱 모델이 미리 학습되지 않은 새로운 환경에서 작동할 때 사용이 어려울 만큼 성능 저하를 일으킨다.

연구팀은 이런 학습되지 않는 환경에서 적은 양의 데이터 (최소 1-2 샘플)만 가지고 적응할 수 있는 '메타러닝 프레임워크'를 제시했다. 메타러닝 (meta learning) 이란 적은 양의 데이터를 가지고도 새로운 지식을 학습할 수 있도록 하는 기계학습 원리다. 연구팀이 제시한 기술은 최신 전이학습 (transfer learning) 기술과 비교하여 18%, 메타러닝 기술과 비교하여 15%의 정확도 성능향상을 보였다.

이성주 교수는 ”최근 활발히 제안되고 있는 다양한 모바일 센싱 서비스가 특정 환경에 의존하지 않고 수많은 실제 사용 환경에서 우수한 성능을 보일 수 있게 해주는 연구다. 모바일 센싱 서비스가 연구에 그치지 않고 실제 많은 사람들에게 사용될 수 있는 가능성을 제시해 의미가 있다“라고 했다. 또한 신진우 교수는 “최근 메타러닝 방법론들이 기계학습 분야에서 크게 각광을 받고 있는데 주로 영상 데이터에 국한되어 왔었다. 본 연구에서 비영상 데이터에도 범용적으로 동작하는 메터러닝 기술을 개발하여 성공한 것은 앞으로도 관련 분야 연구에 큰 영향을 주리라 기대한다“라고 덧붙였다.

연구에 대한 설명이 담긴 비디오를 다음 링크에서 확인할 수 있고, (https://youtu.be/-6y0I1pd6XI) 자세한 정보는 프로젝트 웹사이트에서 볼 수 있다.

(https://nmsl.kaist.ac.kr/projects/metasense/)

이성주 교수, 신진우 AI대학원 교수, 공태식 박사과정, 김연수 학사과정이 참여한 이번 연구 결과는 2019년 11월 11일 센싱 컴퓨팅 분야 국제 최우수학회 ACM SenSys에서 발표됐다. (논문명: MetaSense: Few-Shot Adaptation to Untrained Conditions in Deep Mobile Sensing). 이 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단과 정보통신기술진흥센터, 한국연구재단 차세대 정보 컴퓨팅 기술개발사업의 지원을 받아 수행됐다.

2020.06.09 조회수 18130

학습되지 않은 환경에서 스스로 학습하는 모바일 센싱 기술 개발

우리 대학 전산학부 이성주 교수 연구팀이 학습되지 않은 환경에 적은 양의 데이터로 스스로 적응하는 모바일 센싱 학습 기술 <메타센스(MetaSense)>를 개발했다.

모바일 센싱이란 스마트폰과 같은 모바일 기기의 다양한 센서를 이용하여 서비스(예: 수면의 질 평가, 걸음 수 추적 등)를 제공하는 기술이다. 최근 학계에서는 기계학습 기술의 발전과 더불어 우울증 진단, 운동 자세 관리 등 진보된 모바일 센싱의 가능성을 보여줌으로써 모바일 센싱의 범위를 더욱 확장하고 있다.

하지만 이러한 센싱 기술은 아직 널리 쓰이지 못하고 있다. 사용자 개인마다 가지고 있는 모바일 센싱의 환경이 다르기 때문이다. 사람마다 가지고 있는 고유한 생활패턴과 행동방식, 서로 다른 모바일 기기와 그 사양은 센서의 값에 큰 영향을 미친다. 다른 센서 값은 사람마다 고유한 센싱 환경을 만들고, 이는 센싱 모델이 미리 학습되지 않은 새로운 환경에서 작동할 때 사용이 어려울 만큼 성능 저하를 일으킨다.

연구팀은 이런 학습되지 않는 환경에서 적은 양의 데이터 (최소 1-2 샘플)만 가지고 적응할 수 있는 '메타러닝 프레임워크'를 제시했다. 메타러닝 (meta learning) 이란 적은 양의 데이터를 가지고도 새로운 지식을 학습할 수 있도록 하는 기계학습 원리다. 연구팀이 제시한 기술은 최신 전이학습 (transfer learning) 기술과 비교하여 18%, 메타러닝 기술과 비교하여 15%의 정확도 성능향상을 보였다.

이성주 교수는 ”최근 활발히 제안되고 있는 다양한 모바일 센싱 서비스가 특정 환경에 의존하지 않고 수많은 실제 사용 환경에서 우수한 성능을 보일 수 있게 해주는 연구다. 모바일 센싱 서비스가 연구에 그치지 않고 실제 많은 사람들에게 사용될 수 있는 가능성을 제시해 의미가 있다“라고 했다. 또한 신진우 교수는 “최근 메타러닝 방법론들이 기계학습 분야에서 크게 각광을 받고 있는데 주로 영상 데이터에 국한되어 왔었다. 본 연구에서 비영상 데이터에도 범용적으로 동작하는 메터러닝 기술을 개발하여 성공한 것은 앞으로도 관련 분야 연구에 큰 영향을 주리라 기대한다“라고 덧붙였다.

연구에 대한 설명이 담긴 비디오를 다음 링크에서 확인할 수 있고, (https://youtu.be/-6y0I1pd6XI) 자세한 정보는 프로젝트 웹사이트에서 볼 수 있다.

(https://nmsl.kaist.ac.kr/projects/metasense/)

이성주 교수, 신진우 AI대학원 교수, 공태식 박사과정, 김연수 학사과정이 참여한 이번 연구 결과는 2019년 11월 11일 센싱 컴퓨팅 분야 국제 최우수학회 ACM SenSys에서 발표됐다. (논문명: MetaSense: Few-Shot Adaptation to Untrained Conditions in Deep Mobile Sensing). 이 연구는 정부(과학기술정보통신부)의 재원으로 한국연구재단과 정보통신기술진흥센터, 한국연구재단 차세대 정보 컴퓨팅 기술개발사업의 지원을 받아 수행됐다.

2020.06.09 조회수 18130 -

유민수교수, 페이스북 패컬티 리서치 어워드 수상

우리 대학 전기및전자공학부 유민수 교수가 페이스북에서 수여하는 페이스북 패컬티 리서치 어워드(Facebook Faculty Research Award) 수상자로 선정됐다.

페이스북 패컬티 리서치 어워드는 인공지능 기술을 가속화 할 차세대 컴퓨팅 시스템의 개발 및 상용화에 이바지할 연구주제를 발굴하기 위해 제정됐다. 전 세계 26개국, 100개 대학 167명의 교수가 연구 제안요청서를 제출했고, 그중 10명의 수상자가 선정됐다. 유민수 교수는 아시아권에서는 유일하게 수상자 명단에 포함됐다. 유민수 교수는 이번 수상을 통해 5만 달러의 연구비를 지원받게 되며, 시상식은 오는 2020년 가을 페이스북 멘로 파크 본사에서 열릴 ‘AI 시스템 패컬티 서밋(AI Systems Faculty Summit’에서 진행될 예정이다.

유민수 교수는 ‘A Near-Memory Processing Architecture for Training Recommendation Systems’이라는 연구주제로 머신러닝 시스템(Systems for Machine Learning) 분야에서 최종 수상자로 선정됐다. 이번 수상의 기초 연구가 된 ‘메모리 중심의 딥-러닝 시스템 구조’는 유민수 교수가 2017년 삼성 미래 기술 육성 재단으로부터 3년간의 지원 속에 진행한 연구의 성과물로, 지능형 시스템 반도체 시장 진출에 어려움을 겪고 있는 삼성전자 및 SK 하이닉스 등의 국내 기업과 긴밀히 협력해 세계 시장에서 메모리 중심의 지능형 반도체 개발을 주도할 수 있는 초석으로 평가받는다.

유민수 교수는 인공지능 컴퓨팅 기술 기업인 미국 엔비디아 본사에 2014년 입사 후 인공지능 컴퓨팅 가속을 위한 다양한 하드웨어 및 소프트웨어 시스템 연구를 주도해 왔다. 지난 2018년부터는 KAIST 전기 및 전자공학부에서 재직 중이다. 해당 수상에 관한 자세한 소식은 아래 웹사이트에서 확인할 수 있다.

https://research.fb.com/blog/2020/02/announcing-the-winners-of-the-systems-for-machine-learning-rfp/

2020.02.19 조회수 14026

유민수교수, 페이스북 패컬티 리서치 어워드 수상

우리 대학 전기및전자공학부 유민수 교수가 페이스북에서 수여하는 페이스북 패컬티 리서치 어워드(Facebook Faculty Research Award) 수상자로 선정됐다.

페이스북 패컬티 리서치 어워드는 인공지능 기술을 가속화 할 차세대 컴퓨팅 시스템의 개발 및 상용화에 이바지할 연구주제를 발굴하기 위해 제정됐다. 전 세계 26개국, 100개 대학 167명의 교수가 연구 제안요청서를 제출했고, 그중 10명의 수상자가 선정됐다. 유민수 교수는 아시아권에서는 유일하게 수상자 명단에 포함됐다. 유민수 교수는 이번 수상을 통해 5만 달러의 연구비를 지원받게 되며, 시상식은 오는 2020년 가을 페이스북 멘로 파크 본사에서 열릴 ‘AI 시스템 패컬티 서밋(AI Systems Faculty Summit’에서 진행될 예정이다.

유민수 교수는 ‘A Near-Memory Processing Architecture for Training Recommendation Systems’이라는 연구주제로 머신러닝 시스템(Systems for Machine Learning) 분야에서 최종 수상자로 선정됐다. 이번 수상의 기초 연구가 된 ‘메모리 중심의 딥-러닝 시스템 구조’는 유민수 교수가 2017년 삼성 미래 기술 육성 재단으로부터 3년간의 지원 속에 진행한 연구의 성과물로, 지능형 시스템 반도체 시장 진출에 어려움을 겪고 있는 삼성전자 및 SK 하이닉스 등의 국내 기업과 긴밀히 협력해 세계 시장에서 메모리 중심의 지능형 반도체 개발을 주도할 수 있는 초석으로 평가받는다.

유민수 교수는 인공지능 컴퓨팅 기술 기업인 미국 엔비디아 본사에 2014년 입사 후 인공지능 컴퓨팅 가속을 위한 다양한 하드웨어 및 소프트웨어 시스템 연구를 주도해 왔다. 지난 2018년부터는 KAIST 전기 및 전자공학부에서 재직 중이다. 해당 수상에 관한 자세한 소식은 아래 웹사이트에서 확인할 수 있다.

https://research.fb.com/blog/2020/02/announcing-the-winners-of-the-systems-for-machine-learning-rfp/

2020.02.19 조회수 14026 -

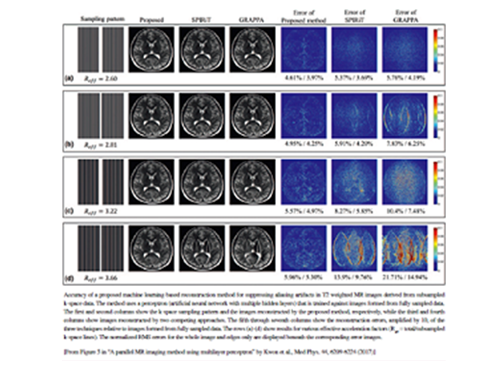

박현욱 교수, 머신러닝 통해 MRI 영상촬영시간 단축기술 개발

우리 대학 전기및전자공학부 박현욱 교수 연구팀이 머신러닝 기반의 영상복원법을 이용해 자기공명영상장치(이하 MRI)의 영상 획득시간을 6배 이상 단축시킬 수 있는 기술을 개발했다.

이번 연구를 통해 MRI의 영상획득시간을 대폭 줄임으로써 환자의 편의성을 높일 뿐 아니라 의료비용 절감 효과를 기대할 수 있을 것으로 보인다.

권기남 박사과정이 1저자로 참여한 이번 연구는 국제 학술지 ‘메디컬 피직스(Medical Physics)’ 12월 13일자에 게재됐고 그 우수성을 인정받아 표지 논문에 선정됐다.

MRI는 방사능 없이 연조직의 다양한 대조도를 촬영할 수 있는 영상기기이다. 다양한 해부학적 구조 뿐 아니라 기능적, 생리학적 정보 또한 영상화 할 수 있기 때문에 의료 진단을 위해 매우 높은 빈도로 사용되고 있다.

하지만 MRI는 다른 의료영상기기에 비해 영상획득시간이 오래 걸린다는 단점이 있다. 따라서 환자들은 MRI를 찍기 위해 긴 시간을 대기해야 하고 촬영 과정에서도 자세를 움직이지 않아야 하는 등의 불편함을 감수해야 한다.

특히 길게 소요되는 영상획득시간은 MRI의 비싼 촬영 비용과 직접적인 연관이 있다.

박 교수 연구팀은 MRI의 영상획득시간을 줄이기 위해 데이터를 적게 수집하고 대신 부족한 데이터를 기계학습(Machine Learning)을 이용해 복원하는 방법을 개발했다.

기존의 MRI는 주파수 영역에서 여러 위상 인코딩을 하면서 순차적으로 한 줄씩 얻기 때문에 영상획득시간이 오래 걸린다. 획득 시간을 단축시키기 위해 저주파 영역에서만 데이터를 얻으면 저해상도 영상을 얻게 되고 듬성듬성 데이터를 얻으면 영상에서 인공물이 생기는 에일리어싱 아티팩트 현상이 발생한다.

이러한 에일리어싱 아티팩트를 해결하기 위해 다른 민감도를 갖는 여러 수신 코일을 활용한 병렬 영상법과 신호의 희소성을 이용한 압축 센싱 기법이 주로 활용됐다.

그러나 병렬 영상법은 수신 코일들의 설계에 영향을 받기 때문에 시간을 많이 단축할 수 없고 영상 복원에도 시간이 많이 걸린다.

연구팀은 MRI의 가속화에 의해 발생하는 에일리어싱 아티팩트 현상을 없애기 위해 라인 전체를 고려한 인공 신경망(Deep Neural Networks)을 개발했다.

연구팀은 위 기술과 함께 기존 병렬 영상법에서 이용했던 복수 수신 코일의 정보를 활용했고, 이 방식을 통해 직접적으로 영향을 주는 부분만을 연결해 네트워크의 효율성을 높였다.

기존 방법들의 경우 서브 샘플링 패턴에 많은 영향을 받았지만 박 교수 연구팀의 기술은 다양한 서브샘플링 패턴에 적용 가능하며 기존 방법대비 복원 영상의 우수함을 보였고 실시간 복원 또한 가능하다.

박 교수는 “MRI는 환자 진단에 필요한 필수 장비가 됐지만 영상 획득 시간이 오래 걸려 비용이 비싸고 불편함이 많았다”며 “기계학습을 활용한 방법이 MRI의 영상 획득 시간을 크게 단축할 것으로 기대한다”고 말했다.

이번 연구는 과학기술정보통신부의 인공지능 국가전략프로젝트와 뇌과학원천기술개발사업의 지원을 받아 수행됐다.

□ 그림 설명

그림1. 국제 학술지 ‘메디컬 피직스 (Medical Physics)’12월호 표지

그림2. 제안하는 네트워크의 모식도

그림3. MRI의 일반적인 영상 획득 및 가속 영상 획득 모식도

2017.12.29 조회수 22409

박현욱 교수, 머신러닝 통해 MRI 영상촬영시간 단축기술 개발

우리 대학 전기및전자공학부 박현욱 교수 연구팀이 머신러닝 기반의 영상복원법을 이용해 자기공명영상장치(이하 MRI)의 영상 획득시간을 6배 이상 단축시킬 수 있는 기술을 개발했다.

이번 연구를 통해 MRI의 영상획득시간을 대폭 줄임으로써 환자의 편의성을 높일 뿐 아니라 의료비용 절감 효과를 기대할 수 있을 것으로 보인다.

권기남 박사과정이 1저자로 참여한 이번 연구는 국제 학술지 ‘메디컬 피직스(Medical Physics)’ 12월 13일자에 게재됐고 그 우수성을 인정받아 표지 논문에 선정됐다.

MRI는 방사능 없이 연조직의 다양한 대조도를 촬영할 수 있는 영상기기이다. 다양한 해부학적 구조 뿐 아니라 기능적, 생리학적 정보 또한 영상화 할 수 있기 때문에 의료 진단을 위해 매우 높은 빈도로 사용되고 있다.

하지만 MRI는 다른 의료영상기기에 비해 영상획득시간이 오래 걸린다는 단점이 있다. 따라서 환자들은 MRI를 찍기 위해 긴 시간을 대기해야 하고 촬영 과정에서도 자세를 움직이지 않아야 하는 등의 불편함을 감수해야 한다.

특히 길게 소요되는 영상획득시간은 MRI의 비싼 촬영 비용과 직접적인 연관이 있다.

박 교수 연구팀은 MRI의 영상획득시간을 줄이기 위해 데이터를 적게 수집하고 대신 부족한 데이터를 기계학습(Machine Learning)을 이용해 복원하는 방법을 개발했다.

기존의 MRI는 주파수 영역에서 여러 위상 인코딩을 하면서 순차적으로 한 줄씩 얻기 때문에 영상획득시간이 오래 걸린다. 획득 시간을 단축시키기 위해 저주파 영역에서만 데이터를 얻으면 저해상도 영상을 얻게 되고 듬성듬성 데이터를 얻으면 영상에서 인공물이 생기는 에일리어싱 아티팩트 현상이 발생한다.

이러한 에일리어싱 아티팩트를 해결하기 위해 다른 민감도를 갖는 여러 수신 코일을 활용한 병렬 영상법과 신호의 희소성을 이용한 압축 센싱 기법이 주로 활용됐다.

그러나 병렬 영상법은 수신 코일들의 설계에 영향을 받기 때문에 시간을 많이 단축할 수 없고 영상 복원에도 시간이 많이 걸린다.

연구팀은 MRI의 가속화에 의해 발생하는 에일리어싱 아티팩트 현상을 없애기 위해 라인 전체를 고려한 인공 신경망(Deep Neural Networks)을 개발했다.

연구팀은 위 기술과 함께 기존 병렬 영상법에서 이용했던 복수 수신 코일의 정보를 활용했고, 이 방식을 통해 직접적으로 영향을 주는 부분만을 연결해 네트워크의 효율성을 높였다.

기존 방법들의 경우 서브 샘플링 패턴에 많은 영향을 받았지만 박 교수 연구팀의 기술은 다양한 서브샘플링 패턴에 적용 가능하며 기존 방법대비 복원 영상의 우수함을 보였고 실시간 복원 또한 가능하다.

박 교수는 “MRI는 환자 진단에 필요한 필수 장비가 됐지만 영상 획득 시간이 오래 걸려 비용이 비싸고 불편함이 많았다”며 “기계학습을 활용한 방법이 MRI의 영상 획득 시간을 크게 단축할 것으로 기대한다”고 말했다.

이번 연구는 과학기술정보통신부의 인공지능 국가전략프로젝트와 뇌과학원천기술개발사업의 지원을 받아 수행됐다.

□ 그림 설명

그림1. 국제 학술지 ‘메디컬 피직스 (Medical Physics)’12월호 표지

그림2. 제안하는 네트워크의 모식도

그림3. MRI의 일반적인 영상 획득 및 가속 영상 획득 모식도

2017.12.29 조회수 22409