%EC%A0%84%EC%82%B0%ED%95%99%EB%B6%80

-

GPU에서 대규모 출력데이터 난제 해결

국내 연구진이 인공지능(AI) 등에 널리 사용되는 그래픽 연산 장치(이하 GPU)에서 메모리 크기의 한계로 인해 초병렬 연산*의 결과로 대규모 출력 데이터가 발생할 때 이를 잘 처리하지 못하던 난제를 해결했다. 이 기술을 통해 향후 가정에서 사용하는 메모리 크기가 작은 GPU로도 생성형 AI 등 고난이도 연산이 대규모 출력을 필요한 경우 이를 빠르게 수행할 수 있다.

*초병렬 연산: GPU를 이용하여 수 십 만에서 수 백 만 개의 작은 연산들을 동시에 수행하는 연산을 의미

우리 대학은 전산학부 김민수 교수 연구팀이 한정된 크기의 메모리를 지닌 GPU를 이용해 수십, 수백 만개 이상의 스레드들로 초병렬 연산을 하면서 수 테라바이트의 큰 출력 데이터*를 발생시킬 경우에도 메모리 에러를 발생시키지 않고 해당 출력 데이터를 메인 메모리로 고속으로 전송 및 저장할 수 있는 데이터 처리 기술(일명 INFINEL)을 개발했다고 7일 밝혔다.

*출력데이터: 데이터 분석 결과 또는 인공지능에 의한 생성 결과물에 해당하는 데이터

최근 AI의 활용이 급속히 증가하면서 지식 그래프와 같이 정점과 간선으로 이루어진 그래프 구조의 데이터의 구축과 사용도 점점 증가하고 있는데, 그래프 구조의 데이터에 대해 난이도가 높은 초병렬 연산을 수행할 경우 그 출력 결과가 매우 크고, 각 스레드의 출력 크기를 예측하기 어렵다는 문제점이 발생한다.

또한, GPU는 근본적으로 CPU와 달리 메모리 관리 기능이 매우 제한적이기 때문에 예측할 수 없는 대규모의 데이터를 유연하게 관리하기 어렵다는 문제가 있다. 이러한 이유로 지금까지는 GPU를 활용해 ‘삼각형 나열’과 같은 난이도가 높은 그래프 초병렬 연산을 수행할 수 없었다.

김 교수팀은 이를 근본적으로 해결하는 INFINEL 기술을 개발했다. 해당 기술은 GPU 메모리의 일부 공간을 수백 만개 이상의 청크(chunk)라 불리는 매우 작은 크기의 단위들로 나누고 관리하면서, 초병렬 연산 내용이 담긴 GPU 커널(kernel) 프로그램을 실행하면서 각 스레드가 메모리 충돌 없이 빠르게 자신이 필요한 청크 메모리들을 할당받아 자신의 출력 데이터를 저장할 수 있도록 한다.

또한, GPU 메모리가 가득 차도 무중단 방식으로 초병렬 연산과 결과 출력 및 저장을 지속할 수 있도록 한다. 따라서 이 기술을 사용하면 가정에서 사용하는 메모리 크기가 작은 GPU로도 수 테라 바이트 이상의 출력 데이터가 발생하는 고난이도 연산을 빠르게 수행할 수 있다.

김민수 교수 연구팀은 INFINEL 기술의 성능을 다양한 실험 환경과 데이터 셋을 통해 검증했으며, 종래의 최고 성능 동적 메모리 관리자 기술에 비해 약 55배, 커널을 2번 실행하는 2단계 기술에 비해 약 32배 연산 성능을 향상함을 보였다.

교신저자로 참여한 우리 대학 전산학부 김민수 교수는 “생성형 AI나 메타버스 시대에는 GPU 컴퓨팅의 대규모 출력 데이터를 빠르게 처리할 수 있는 기술이 중요해질 것으로 예상되며, INFINEL 기술이 그 일부 역할을 할 수 있을 것”이라고 말했다.

이번 연구에는 김 교수의 제자인 박성우 박사과정이 제1 저자로, 김 교수가 창업한 그래프 딥테크 기업인 (주)그래파이 소속의 오세연 연구원이 제 2 저자로, 김 교수가 교신 저자로 참여하였으며, 국제 학술지 ‘PPoPP’에 3월 4일자 발표됐다. (INFINEL: An efficient GPU-based processing method for unpredictable large output graph queries)

한편, 이번 연구는 과기정통부 IITP SW스타랩 및 ITRC 사업, 한국연구재단 선도연구센터인 암흑데이터 극한 활용 연구센터의 지원을 받아 수행됐다.

2024.03.07 조회수 1564

GPU에서 대규모 출력데이터 난제 해결

국내 연구진이 인공지능(AI) 등에 널리 사용되는 그래픽 연산 장치(이하 GPU)에서 메모리 크기의 한계로 인해 초병렬 연산*의 결과로 대규모 출력 데이터가 발생할 때 이를 잘 처리하지 못하던 난제를 해결했다. 이 기술을 통해 향후 가정에서 사용하는 메모리 크기가 작은 GPU로도 생성형 AI 등 고난이도 연산이 대규모 출력을 필요한 경우 이를 빠르게 수행할 수 있다.

*초병렬 연산: GPU를 이용하여 수 십 만에서 수 백 만 개의 작은 연산들을 동시에 수행하는 연산을 의미

우리 대학은 전산학부 김민수 교수 연구팀이 한정된 크기의 메모리를 지닌 GPU를 이용해 수십, 수백 만개 이상의 스레드들로 초병렬 연산을 하면서 수 테라바이트의 큰 출력 데이터*를 발생시킬 경우에도 메모리 에러를 발생시키지 않고 해당 출력 데이터를 메인 메모리로 고속으로 전송 및 저장할 수 있는 데이터 처리 기술(일명 INFINEL)을 개발했다고 7일 밝혔다.

*출력데이터: 데이터 분석 결과 또는 인공지능에 의한 생성 결과물에 해당하는 데이터

최근 AI의 활용이 급속히 증가하면서 지식 그래프와 같이 정점과 간선으로 이루어진 그래프 구조의 데이터의 구축과 사용도 점점 증가하고 있는데, 그래프 구조의 데이터에 대해 난이도가 높은 초병렬 연산을 수행할 경우 그 출력 결과가 매우 크고, 각 스레드의 출력 크기를 예측하기 어렵다는 문제점이 발생한다.

또한, GPU는 근본적으로 CPU와 달리 메모리 관리 기능이 매우 제한적이기 때문에 예측할 수 없는 대규모의 데이터를 유연하게 관리하기 어렵다는 문제가 있다. 이러한 이유로 지금까지는 GPU를 활용해 ‘삼각형 나열’과 같은 난이도가 높은 그래프 초병렬 연산을 수행할 수 없었다.

김 교수팀은 이를 근본적으로 해결하는 INFINEL 기술을 개발했다. 해당 기술은 GPU 메모리의 일부 공간을 수백 만개 이상의 청크(chunk)라 불리는 매우 작은 크기의 단위들로 나누고 관리하면서, 초병렬 연산 내용이 담긴 GPU 커널(kernel) 프로그램을 실행하면서 각 스레드가 메모리 충돌 없이 빠르게 자신이 필요한 청크 메모리들을 할당받아 자신의 출력 데이터를 저장할 수 있도록 한다.

또한, GPU 메모리가 가득 차도 무중단 방식으로 초병렬 연산과 결과 출력 및 저장을 지속할 수 있도록 한다. 따라서 이 기술을 사용하면 가정에서 사용하는 메모리 크기가 작은 GPU로도 수 테라 바이트 이상의 출력 데이터가 발생하는 고난이도 연산을 빠르게 수행할 수 있다.

김민수 교수 연구팀은 INFINEL 기술의 성능을 다양한 실험 환경과 데이터 셋을 통해 검증했으며, 종래의 최고 성능 동적 메모리 관리자 기술에 비해 약 55배, 커널을 2번 실행하는 2단계 기술에 비해 약 32배 연산 성능을 향상함을 보였다.

교신저자로 참여한 우리 대학 전산학부 김민수 교수는 “생성형 AI나 메타버스 시대에는 GPU 컴퓨팅의 대규모 출력 데이터를 빠르게 처리할 수 있는 기술이 중요해질 것으로 예상되며, INFINEL 기술이 그 일부 역할을 할 수 있을 것”이라고 말했다.

이번 연구에는 김 교수의 제자인 박성우 박사과정이 제1 저자로, 김 교수가 창업한 그래프 딥테크 기업인 (주)그래파이 소속의 오세연 연구원이 제 2 저자로, 김 교수가 교신 저자로 참여하였으며, 국제 학술지 ‘PPoPP’에 3월 4일자 발표됐다. (INFINEL: An efficient GPU-based processing method for unpredictable large output graph queries)

한편, 이번 연구는 과기정통부 IITP SW스타랩 및 ITRC 사업, 한국연구재단 선도연구센터인 암흑데이터 극한 활용 연구센터의 지원을 받아 수행됐다.

2024.03.07 조회수 1564 -

차미영 교수, 한국인 첫 獨 막스플랑크 연구소 단장 선임

세계적 기초과학 연구기관인 독일 막스플랑크 연구소(Max Planck Institute, MPI)에 첫 한국인 단장이 선임됐다. 우리 대학 전산학부 차미영 교수(기초과학연구원 수리 및 계산 과학 연구단 데이터 사이언스 그룹 CI(Chief Investigator))가 그 주인공이다. 차 교수는 독일 보흠 지역에 있는 막스플랑크 보안 및 정보보호 연구소(MPI for Security and Privacy)에서 6월부터 단장(Scientific Director)직 수행을 시작해 ‘인류를 위한 데이터 과학(Data Science for Humanity)’ 연구그룹을 이끌 예정이다. 현재 본격적인 연구그룹 출범을 준비하고 있다.

막스플랑크 연구소는 기초과학 분야를 아우르며 독일 전역과 해외에 85개 산하 연구소를 운영하고 있다. 연구소를 이끄는 300여 명의 단장 중 한국 국적 과학자가 발탁된 것은 이번이 처음이다. 한국계로는 지난해 8월 울산과학기술원(UNIST) 강사라 교수가 기후과학연구소 단장으로 선임된 바 있다.

차 교수는 구글 스칼라(Google Scholar) 기준 피인용 수 2만 회가 넘는 데이터 과학 분야 전문가로, 우리 대학 전산학부를 졸업하고 동 대학원에서 석·박사 학위를 받은 ‘토종박사’다. 박사 취득 이후 독일 자부르켄에 있는 막스플랑크 연구소에서 박사후연구원으로 근무했으며, 2010년부터 우리 대학 교수로 재직하고 있다. 2019년에는 IBS의 CI로 선정돼 데이터 사이언스 그룹을 이끌며 인공지능(AI) 분야에서 우수 논문을 다수 발표하는 등 국제적 인지도를 높였다.

차 교수가 이끄는 데이터 사이언스 그룹은 2019년 출범해 초대형 데이터를 계산하고 분석하는 방법론을 연구하고 있다. 특히 AI를 이용해 가짜뉴스와 혐오 표현을 탐지하는 등 우리 삶과 밀접한 사회 현상을 분석해 괄목할 만한 연구성과를 창출했다.

코로나19 팬데믹 시절 ‘루머를 앞선 팩트’ 캠페인을 기획해 감염병 관련 잘못된 정보에 대한 팩트체크 결과를 151개국에 전파했다. 최근에는 위성영상을 AI로 분석해 북한을 비롯한 저개발국가의 경제지도를 만들어 무료로 공개했다. 최근 실시한 5년 차 평가에서 AI 기술을 기초과학에 창의적으로 활용해 차별성 있는 연구를 수행했으며, 데이터 과학 연구의 사회적 가치를 제고할 수 있는 핵심 기술을 개발하는 등 국제적 파급력 있는 연구성과를 창출했다는 평가를 받았다.

IBS 노도영 원장은 “IBS는 미래 연구단장을 발굴·육성하기 위해 젊은 연구자를 선정해 독립 연구를 지원하고 있다”라며, “이 제도로 발굴한 연구자가 막스플랑크 연구소 단장으로 초청받은 것에 대해 매우 기쁘게 생각하며 한국과 독일의 국제 연구 교류에도 크게 기여할 것으로 기대한다”라고 전했다.

우리 대학 이광형 총장은 “KAIST가 키워낸 차 교수의 행보는 국제화에 좋은 롤모델이 될 것”이라며, “계속해서 KAIST 학생 및 동료와 협업할 수 있도록 겸직을 비롯한 지원을 아끼지 않겠다”라고 축하의 메시지를 전했다.

차미영 CI는 “KAIST 교수로 쌓아온 경험에 더하여 IBS에서 긴 호흡으로 창의적인 연구를 지속한 덕분에 좋은 결과를 얻은 것 같다”라며, “앞으로 큰 책임감을 가지고 데이터 과학을 통한 사회 공헌을 위해 최선을 다하겠다”라고 포부를 밝혔다.

2024.01.09 조회수 2463

차미영 교수, 한국인 첫 獨 막스플랑크 연구소 단장 선임

세계적 기초과학 연구기관인 독일 막스플랑크 연구소(Max Planck Institute, MPI)에 첫 한국인 단장이 선임됐다. 우리 대학 전산학부 차미영 교수(기초과학연구원 수리 및 계산 과학 연구단 데이터 사이언스 그룹 CI(Chief Investigator))가 그 주인공이다. 차 교수는 독일 보흠 지역에 있는 막스플랑크 보안 및 정보보호 연구소(MPI for Security and Privacy)에서 6월부터 단장(Scientific Director)직 수행을 시작해 ‘인류를 위한 데이터 과학(Data Science for Humanity)’ 연구그룹을 이끌 예정이다. 현재 본격적인 연구그룹 출범을 준비하고 있다.

막스플랑크 연구소는 기초과학 분야를 아우르며 독일 전역과 해외에 85개 산하 연구소를 운영하고 있다. 연구소를 이끄는 300여 명의 단장 중 한국 국적 과학자가 발탁된 것은 이번이 처음이다. 한국계로는 지난해 8월 울산과학기술원(UNIST) 강사라 교수가 기후과학연구소 단장으로 선임된 바 있다.

차 교수는 구글 스칼라(Google Scholar) 기준 피인용 수 2만 회가 넘는 데이터 과학 분야 전문가로, 우리 대학 전산학부를 졸업하고 동 대학원에서 석·박사 학위를 받은 ‘토종박사’다. 박사 취득 이후 독일 자부르켄에 있는 막스플랑크 연구소에서 박사후연구원으로 근무했으며, 2010년부터 우리 대학 교수로 재직하고 있다. 2019년에는 IBS의 CI로 선정돼 데이터 사이언스 그룹을 이끌며 인공지능(AI) 분야에서 우수 논문을 다수 발표하는 등 국제적 인지도를 높였다.

차 교수가 이끄는 데이터 사이언스 그룹은 2019년 출범해 초대형 데이터를 계산하고 분석하는 방법론을 연구하고 있다. 특히 AI를 이용해 가짜뉴스와 혐오 표현을 탐지하는 등 우리 삶과 밀접한 사회 현상을 분석해 괄목할 만한 연구성과를 창출했다.

코로나19 팬데믹 시절 ‘루머를 앞선 팩트’ 캠페인을 기획해 감염병 관련 잘못된 정보에 대한 팩트체크 결과를 151개국에 전파했다. 최근에는 위성영상을 AI로 분석해 북한을 비롯한 저개발국가의 경제지도를 만들어 무료로 공개했다. 최근 실시한 5년 차 평가에서 AI 기술을 기초과학에 창의적으로 활용해 차별성 있는 연구를 수행했으며, 데이터 과학 연구의 사회적 가치를 제고할 수 있는 핵심 기술을 개발하는 등 국제적 파급력 있는 연구성과를 창출했다는 평가를 받았다.

IBS 노도영 원장은 “IBS는 미래 연구단장을 발굴·육성하기 위해 젊은 연구자를 선정해 독립 연구를 지원하고 있다”라며, “이 제도로 발굴한 연구자가 막스플랑크 연구소 단장으로 초청받은 것에 대해 매우 기쁘게 생각하며 한국과 독일의 국제 연구 교류에도 크게 기여할 것으로 기대한다”라고 전했다.

우리 대학 이광형 총장은 “KAIST가 키워낸 차 교수의 행보는 국제화에 좋은 롤모델이 될 것”이라며, “계속해서 KAIST 학생 및 동료와 협업할 수 있도록 겸직을 비롯한 지원을 아끼지 않겠다”라고 축하의 메시지를 전했다.

차미영 CI는 “KAIST 교수로 쌓아온 경험에 더하여 IBS에서 긴 호흡으로 창의적인 연구를 지속한 덕분에 좋은 결과를 얻은 것 같다”라며, “앞으로 큰 책임감을 가지고 데이터 과학을 통한 사회 공헌을 위해 최선을 다하겠다”라고 포부를 밝혔다.

2024.01.09 조회수 2463 -

전산학부 이의진 교수, ICMU 학회 기조 강연 진행

우리 대학 전산학부 이의진 교수가 11월 29~12월 1일 동안 일본 교토에서 열린 ICMU 학회(The 14th International Conference on Mobile Computing and Ubiquitous Networking)에서 “참여도 증강을 위한 데이터 기반의 디지털 헬스 및 웰빙(Towards Data-Driven Digital Health and Wellbeing for Engagement Enhancement)”라는 주제로 기조 강연을 진행했다.

올해 14회째를 맞는 ICMU 학회는 모바일 및 유비쿼터스 컴퓨팅을 다루는 국제학회로 사람, 스마트 센서, 기기가 초연결된 차세대 컴퓨팅환경에 관한 최신연구 성과를 공유하고 연구 방향을 모색하는 학술교류의 장이다. 이번 학회는 센싱, 소셜 응용, 보안, 통신 등을 주제로 32편의 학술논문과 11편의 포스터가 발표됐다.

이의진 교수는 모바일, 웨어러블, 사물 인터넷(IoT) 기술을 활용하여 인간의 웰빙과 잠재력 실현을 목표로 하는 긍정 컴퓨팅에 분야를 연구하고 있다. 특히 데이터를 활용하여 정신적, 사회적 웰빙(예: 스트레스 관리 및 사회적 정서적 학습), 신체적 웰빙(예: 운동, 수면 코칭), 업무 생산성(예: 주의력 관리) 등을 증진하는 응용 기술을 개발해왔다. 이번 기조 강연에서는 이의진 교수는 모바일, 웨어러블, IoT로부터 수집되는 다양한 센서 및 상호작용 데이터를 활용하여 건강 및 웰빙 문제를 자동으로 찾아내 사용자의 참여도와 치료의 효과성을 증진할 수 있는 데이터 기반 디지털 헬스케어 최적화 기법과 연구 방향에 대해서 논의했다. 기조강연에서 논의된 일부 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행됐다. (No. 2022-0-00064, 감정노동자의 정신건강 위험 예측 및 관리를 위한 휴먼 디지털 트윈 기술 개발)

ICMU 학술대회 홈페이지: https://www.icmu.org/icmu2023/

2023.12.01 조회수 1250

전산학부 이의진 교수, ICMU 학회 기조 강연 진행

우리 대학 전산학부 이의진 교수가 11월 29~12월 1일 동안 일본 교토에서 열린 ICMU 학회(The 14th International Conference on Mobile Computing and Ubiquitous Networking)에서 “참여도 증강을 위한 데이터 기반의 디지털 헬스 및 웰빙(Towards Data-Driven Digital Health and Wellbeing for Engagement Enhancement)”라는 주제로 기조 강연을 진행했다.

올해 14회째를 맞는 ICMU 학회는 모바일 및 유비쿼터스 컴퓨팅을 다루는 국제학회로 사람, 스마트 센서, 기기가 초연결된 차세대 컴퓨팅환경에 관한 최신연구 성과를 공유하고 연구 방향을 모색하는 학술교류의 장이다. 이번 학회는 센싱, 소셜 응용, 보안, 통신 등을 주제로 32편의 학술논문과 11편의 포스터가 발표됐다.

이의진 교수는 모바일, 웨어러블, 사물 인터넷(IoT) 기술을 활용하여 인간의 웰빙과 잠재력 실현을 목표로 하는 긍정 컴퓨팅에 분야를 연구하고 있다. 특히 데이터를 활용하여 정신적, 사회적 웰빙(예: 스트레스 관리 및 사회적 정서적 학습), 신체적 웰빙(예: 운동, 수면 코칭), 업무 생산성(예: 주의력 관리) 등을 증진하는 응용 기술을 개발해왔다. 이번 기조 강연에서는 이의진 교수는 모바일, 웨어러블, IoT로부터 수집되는 다양한 센서 및 상호작용 데이터를 활용하여 건강 및 웰빙 문제를 자동으로 찾아내 사용자의 참여도와 치료의 효과성을 증진할 수 있는 데이터 기반 디지털 헬스케어 최적화 기법과 연구 방향에 대해서 논의했다. 기조강연에서 논의된 일부 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행됐다. (No. 2022-0-00064, 감정노동자의 정신건강 위험 예측 및 관리를 위한 휴먼 디지털 트윈 기술 개발)

ICMU 학술대회 홈페이지: https://www.icmu.org/icmu2023/

2023.12.01 조회수 1250 -

구글딥마인드와 공동연구를 통해 인공지능으로 시각을 상상하다

‘노란 포도'나 `보라색 바나나'와 같이 본 적 없는 시각 개념을 이해하고 상상하는 인공지능 능력 구현이 가능해졌다.

우리 대학 전산학부 안성진 교수 연구팀이 구글 딥마인드 및 미국 럿거스 대학교와의 국제 공동 연구를 통해 시각적 지식을 체계적으로 조합해 새로운 개념을 이해하는 인공지능 새로운 모델과 프로그램을 수행하는 벤치마크를 개발했다고 30일 밝혔다.

인간은 `보라색 포도'와 `노란 바나나' 같은 개념을 학습하고, 이를 분리한 뒤 재조합해 `노란 포도'나 `보라색 바나나'와 같이 본 적 없는 개념을 상상하는 능력이 있다. 이런 능력은 체계적 일반화 혹은 조합적 일반화라고 불리며, 범용 인공지능을 구현하는 데 있어 핵심적인 요소로 여겨진다.

체계적 일반화 문제는 1988년 미국의 저명한 인지과학자 제리 포더(Jerry Fodor)와 제논 필리쉰(Zenon Pylyshyn)이 인공신경망이 이 문제를 해결할 수 없다고 주장한 이후, 35년 동안 인공지능 딥러닝 분야에서 큰 도전 과제로 남아 있다. 이 문제는 언어뿐만 아니라 시각 정보에서도 발생하지만, 지금까지는 주로 언어의 체계적 일반화에만 초점이 맞춰져 있었고, 시각 정보에 관한 연구는 상대적으로 부족했다.

안성진 교수가 이끄는 국제 공동 연구팀은 이러한 공백을 메우고자 시각 정보에 대한 체계적 일반화를 연구할 수 있는 벤치마크를 개발했다. 시각 정보는 언어와는 달리 명확한 `단어'나 `토큰'의 구조가 없어, 이 구조를 학습하고 체계적 일반화를 달성하는 것이 큰 도전이다.

연구를 주도한 안성진 교수는 “시각 정보의 체계적 일반화가 범용 인공지능을 달성하기 위해 필수적인 능력이며 이 연구를 통해 인공지능의 추론능력과 상상능력 관련 분야의 발전을 가속할 것으로 기대한다”고 말했다.

또한, 딥마인드의 책임 연구원으로 연구에 참여한 연구원이자 현재 스위스 로잔연방공과대학교(EPFL)의 찰라 걸셔(Caglar Gulcehre) 교수는 “체계적 일반화가 가능해지면 현재보다 훨씬 적은 데이터로 더 높은 성능을 낼 수 있게 될 것이다”라고 전했다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Imagine the Unseen World: A Benchmark for Systematic Generalization in Visual World Models”, Yeongbin Kim, Gautam Singh, Junyeong Park, Caglar Gulcehre, Sungjin Ahn, NeurIPS 23

2023.11.30 조회수 1362

구글딥마인드와 공동연구를 통해 인공지능으로 시각을 상상하다

‘노란 포도'나 `보라색 바나나'와 같이 본 적 없는 시각 개념을 이해하고 상상하는 인공지능 능력 구현이 가능해졌다.

우리 대학 전산학부 안성진 교수 연구팀이 구글 딥마인드 및 미국 럿거스 대학교와의 국제 공동 연구를 통해 시각적 지식을 체계적으로 조합해 새로운 개념을 이해하는 인공지능 새로운 모델과 프로그램을 수행하는 벤치마크를 개발했다고 30일 밝혔다.

인간은 `보라색 포도'와 `노란 바나나' 같은 개념을 학습하고, 이를 분리한 뒤 재조합해 `노란 포도'나 `보라색 바나나'와 같이 본 적 없는 개념을 상상하는 능력이 있다. 이런 능력은 체계적 일반화 혹은 조합적 일반화라고 불리며, 범용 인공지능을 구현하는 데 있어 핵심적인 요소로 여겨진다.

체계적 일반화 문제는 1988년 미국의 저명한 인지과학자 제리 포더(Jerry Fodor)와 제논 필리쉰(Zenon Pylyshyn)이 인공신경망이 이 문제를 해결할 수 없다고 주장한 이후, 35년 동안 인공지능 딥러닝 분야에서 큰 도전 과제로 남아 있다. 이 문제는 언어뿐만 아니라 시각 정보에서도 발생하지만, 지금까지는 주로 언어의 체계적 일반화에만 초점이 맞춰져 있었고, 시각 정보에 관한 연구는 상대적으로 부족했다.

안성진 교수가 이끄는 국제 공동 연구팀은 이러한 공백을 메우고자 시각 정보에 대한 체계적 일반화를 연구할 수 있는 벤치마크를 개발했다. 시각 정보는 언어와는 달리 명확한 `단어'나 `토큰'의 구조가 없어, 이 구조를 학습하고 체계적 일반화를 달성하는 것이 큰 도전이다.

연구를 주도한 안성진 교수는 “시각 정보의 체계적 일반화가 범용 인공지능을 달성하기 위해 필수적인 능력이며 이 연구를 통해 인공지능의 추론능력과 상상능력 관련 분야의 발전을 가속할 것으로 기대한다”고 말했다.

또한, 딥마인드의 책임 연구원으로 연구에 참여한 연구원이자 현재 스위스 로잔연방공과대학교(EPFL)의 찰라 걸셔(Caglar Gulcehre) 교수는 “체계적 일반화가 가능해지면 현재보다 훨씬 적은 데이터로 더 높은 성능을 낼 수 있게 될 것이다”라고 전했다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Imagine the Unseen World: A Benchmark for Systematic Generalization in Visual World Models”, Yeongbin Kim, Gautam Singh, Junyeong Park, Caglar Gulcehre, Sungjin Ahn, NeurIPS 23

2023.11.30 조회수 1362 -

인공지능으로 북한 등 경제지표 추정하다

유엔기구(UN)의 지속가능발전목표(SDGs)에 따르면 하루 2달러 이하로 생활하는 절대빈곤 인구가 7억 명에 달하지만 그 빈곤의 현황을 제대로 파악하기는 쉽지 않다. 전 세계 중 53개국은 지난 15년 동안 농업 관련 현황 조사를 하지 못했으며, 17개국은 인구 센서스(인구주택 총조사)조차 진행하지 못했다. 이러한 데이터 부족을 극복하려는 시도로, 누구나 웹에서 받아볼 수 있는 인공위성 영상을 활용해 경제 지표를 추정하는 기술이 주목받고 있다.

우리 대학 차미영-김지희 교수 연구팀이 기초과학연구원, 서강대, 홍콩과기대(HKUST), 싱가포르국립대(NUS)와 국제공동연구를 통해 주간 위성영상을 활용해 경제 상황을 분석하는 새로운 인공지능(AI) 기법을 개발했다고 21일 밝혔다. 연구팀이 주목한 것은 기존 통계자료를 기반으로 학습하는 일반적인 환경이 아닌, 기초 통계도 미비한 최빈국(最貧國)까지 모니터링할 수 있는 범용적인 모델이다.

연구팀은 유럽우주국(ESA)이 운용하며 무료로 공개하는 센티넬-2(Sentinel-2) 위성영상을 활용했다. 연구팀은 먼저 위성영상을 약 6제곱킬로미터(2.5×2.5㎢)의 작은 구역으로 세밀하게 분할한 후, 각 구역의 경제 지표를 건물, 도로, 녹지 등의 시각적 정보를 기반으로 AI 기법을 통해 수치화했다.

이번 연구 모델이 이전 연구와 차별화된 점은 기초 데이터가 부족한 지역에도 적용할 수 있게끔 인간이 제시하는 정보를 인공지능의 예측에 반영하는 `인간-기계 협업 알고리즘'에 있다. 즉, 인간이 위성영상을 보고 경제 활동의 많고 적음을 비교하면, 기계는 이러한 인간이 제공한 정보를 학습하여 각각의 영상자료에 경제 점수를 부여한다. 검증 결과, 기계학습만 사용했을 때보다 인간과 협업할 경우 성능이 월등히 우수했다.

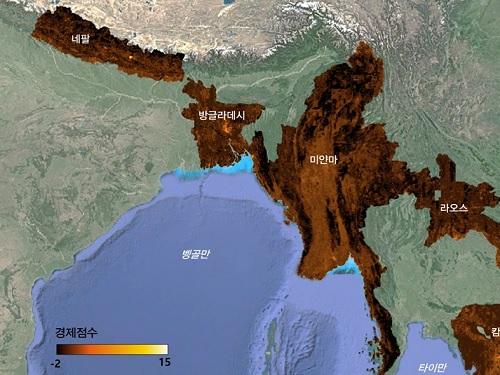

이번 연구를 통해 연구팀은 기존 통계자료가 부족한 지역까지 경제분석의 범위를 확장하고, 북한 및 아시아 5개국(네팔, 라오스, 미얀마, 방글라데시, 캄보디아)에도 같은 기술을 적용하여 세밀한 경제 지표 점수를 공개했다. (그림 1) 이 연구가 제시한 경제 지표는 기존의 인구밀도, 고용 수, 사업체 수 등의 사회경제지표와 높은 상관관계를 보였으며, 데이터가 부족한 저개발국가에 적용 가능함을 연구팀은 확인했다.

이러한 변화탐지를 북한에 적용한 결과, 대북 경제제재가 심화된 2016년과 2019년 사이에 북한 경제에서 세 가지 경향을 발견할 수 있었다. 첫째, 북한의 경제 발전은 평양과 대도시에 더욱 집중되어 도시와 농촌 간 격차가 심화됐다. 둘째, 경제제재와 달러 외환의 부족을 극복하기 위해 설치한 관광 경제개발구에서는 새로운 건물 건설 등 유의미한 변화가 위성영상 이미지와 연구의 경제 지표 점수 변화에서 드러났다. 셋째, 전통적인 공업 및 수출 경제개발구 유형에서는 반대로 변화가 미미한 것으로 확인됐다.

연구에 참여한 우리 대학 전산학부·IBS 데이터사이언스그룹 CI 차미영 교수는 "전산학, 경제학, 지리학이 융합된 이번 연구는 범지구적 차원의 빈곤 문제를 다룬다는 점에서 중요한 의미가 있으며, 이번에 개발한 인공지능 알고리즘을 앞으로 이산화탄소 배출량, 재해재난 피해 탐지, 기후 변화로 인한 영향 등 다양한 국제사회 문제에 적용해 볼 계획이다ˮ 라고 말했다.

이 연구에는 경제학자인 우리 대학 기술경영학부 김지희 교수, 서강대 경제학과 양현주 교수, 홍콩과기대 박상윤 교수도 함께 참여하였다. 이들은 “이 모델은 저비용으로 개발도상국의 경제 상황을 상세하게 확인할 수 있어 국제개발협력(ODA) 사업에 도움을 줄 수 있을 것으로 예상된다”며 “이번 연구가 선진국과 후진국 간의 데이터 격차를 줄이고 유엔과 국제사회의 공동목표인 지속가능한 발전을 달성하는 데 기여할 수 있기를 바란다ˮ고 밝혔다.

위성영상과 인공지능을 활용한 SDGs 지표의 개발과 이의 정책적 활용은 국제적인 주목을 받고 있는 기술 분야 중 하나이며 한국이 앞으로 주도권을 가지고 이끌 수 있는 연구 분야이다. 이에 연구팀은 개발한 모델 코드를 무료로 공개하며, 측정한 지표가 여러 국가의 정책 설계 및 평가에 유용하게 사용될 수 있도록 앞으로도 기술을 개선하고 매해 새롭게 업데이트되는 인공위성 영상에 적용하여 공개할 계획이다.

한편 이번 연구 결과는 전산학부 안동현 박사과정, 싱가포르 국립대 양재석 박사과정이 공동 1저자로 국제 학술지 네이처 출판 그룹의 `네이처 커뮤니케이션즈(Nature Communications)'에 지난 10월 26일 자 게재됐다. (논문명: A human-machine collaborative approach measures economic development using satellite imagery, 인간-기계 협업과 위성영상 분석에 기반한 경제 발전 측정).

논문링크: https://www.nature.com/articles/s41467-023-42122-8

2023.11.21 조회수 1923

인공지능으로 북한 등 경제지표 추정하다

유엔기구(UN)의 지속가능발전목표(SDGs)에 따르면 하루 2달러 이하로 생활하는 절대빈곤 인구가 7억 명에 달하지만 그 빈곤의 현황을 제대로 파악하기는 쉽지 않다. 전 세계 중 53개국은 지난 15년 동안 농업 관련 현황 조사를 하지 못했으며, 17개국은 인구 센서스(인구주택 총조사)조차 진행하지 못했다. 이러한 데이터 부족을 극복하려는 시도로, 누구나 웹에서 받아볼 수 있는 인공위성 영상을 활용해 경제 지표를 추정하는 기술이 주목받고 있다.

우리 대학 차미영-김지희 교수 연구팀이 기초과학연구원, 서강대, 홍콩과기대(HKUST), 싱가포르국립대(NUS)와 국제공동연구를 통해 주간 위성영상을 활용해 경제 상황을 분석하는 새로운 인공지능(AI) 기법을 개발했다고 21일 밝혔다. 연구팀이 주목한 것은 기존 통계자료를 기반으로 학습하는 일반적인 환경이 아닌, 기초 통계도 미비한 최빈국(最貧國)까지 모니터링할 수 있는 범용적인 모델이다.

연구팀은 유럽우주국(ESA)이 운용하며 무료로 공개하는 센티넬-2(Sentinel-2) 위성영상을 활용했다. 연구팀은 먼저 위성영상을 약 6제곱킬로미터(2.5×2.5㎢)의 작은 구역으로 세밀하게 분할한 후, 각 구역의 경제 지표를 건물, 도로, 녹지 등의 시각적 정보를 기반으로 AI 기법을 통해 수치화했다.

이번 연구 모델이 이전 연구와 차별화된 점은 기초 데이터가 부족한 지역에도 적용할 수 있게끔 인간이 제시하는 정보를 인공지능의 예측에 반영하는 `인간-기계 협업 알고리즘'에 있다. 즉, 인간이 위성영상을 보고 경제 활동의 많고 적음을 비교하면, 기계는 이러한 인간이 제공한 정보를 학습하여 각각의 영상자료에 경제 점수를 부여한다. 검증 결과, 기계학습만 사용했을 때보다 인간과 협업할 경우 성능이 월등히 우수했다.

이번 연구를 통해 연구팀은 기존 통계자료가 부족한 지역까지 경제분석의 범위를 확장하고, 북한 및 아시아 5개국(네팔, 라오스, 미얀마, 방글라데시, 캄보디아)에도 같은 기술을 적용하여 세밀한 경제 지표 점수를 공개했다. (그림 1) 이 연구가 제시한 경제 지표는 기존의 인구밀도, 고용 수, 사업체 수 등의 사회경제지표와 높은 상관관계를 보였으며, 데이터가 부족한 저개발국가에 적용 가능함을 연구팀은 확인했다.

이러한 변화탐지를 북한에 적용한 결과, 대북 경제제재가 심화된 2016년과 2019년 사이에 북한 경제에서 세 가지 경향을 발견할 수 있었다. 첫째, 북한의 경제 발전은 평양과 대도시에 더욱 집중되어 도시와 농촌 간 격차가 심화됐다. 둘째, 경제제재와 달러 외환의 부족을 극복하기 위해 설치한 관광 경제개발구에서는 새로운 건물 건설 등 유의미한 변화가 위성영상 이미지와 연구의 경제 지표 점수 변화에서 드러났다. 셋째, 전통적인 공업 및 수출 경제개발구 유형에서는 반대로 변화가 미미한 것으로 확인됐다.

연구에 참여한 우리 대학 전산학부·IBS 데이터사이언스그룹 CI 차미영 교수는 "전산학, 경제학, 지리학이 융합된 이번 연구는 범지구적 차원의 빈곤 문제를 다룬다는 점에서 중요한 의미가 있으며, 이번에 개발한 인공지능 알고리즘을 앞으로 이산화탄소 배출량, 재해재난 피해 탐지, 기후 변화로 인한 영향 등 다양한 국제사회 문제에 적용해 볼 계획이다ˮ 라고 말했다.

이 연구에는 경제학자인 우리 대학 기술경영학부 김지희 교수, 서강대 경제학과 양현주 교수, 홍콩과기대 박상윤 교수도 함께 참여하였다. 이들은 “이 모델은 저비용으로 개발도상국의 경제 상황을 상세하게 확인할 수 있어 국제개발협력(ODA) 사업에 도움을 줄 수 있을 것으로 예상된다”며 “이번 연구가 선진국과 후진국 간의 데이터 격차를 줄이고 유엔과 국제사회의 공동목표인 지속가능한 발전을 달성하는 데 기여할 수 있기를 바란다ˮ고 밝혔다.

위성영상과 인공지능을 활용한 SDGs 지표의 개발과 이의 정책적 활용은 국제적인 주목을 받고 있는 기술 분야 중 하나이며 한국이 앞으로 주도권을 가지고 이끌 수 있는 연구 분야이다. 이에 연구팀은 개발한 모델 코드를 무료로 공개하며, 측정한 지표가 여러 국가의 정책 설계 및 평가에 유용하게 사용될 수 있도록 앞으로도 기술을 개선하고 매해 새롭게 업데이트되는 인공위성 영상에 적용하여 공개할 계획이다.

한편 이번 연구 결과는 전산학부 안동현 박사과정, 싱가포르 국립대 양재석 박사과정이 공동 1저자로 국제 학술지 네이처 출판 그룹의 `네이처 커뮤니케이션즈(Nature Communications)'에 지난 10월 26일 자 게재됐다. (논문명: A human-machine collaborative approach measures economic development using satellite imagery, 인간-기계 협업과 위성영상 분석에 기반한 경제 발전 측정).

논문링크: https://www.nature.com/articles/s41467-023-42122-8

2023.11.21 조회수 1923 -

트랜스포머 대체할 차세대 월드모델 기술 세계 최초 개발

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스 대학교와 협력하여 트랜스포머 및 재귀신경망 기반의 월드모델을 대체할 차세대 에이전트 월드모델 기술을 세계 최초로 개발했다.

월드모델은 인간의 뇌가 현실 세계의 경험을 바탕으로 환경 모델을 구축하는 과정과 유사하다. 이러한 월드모델을 활용하는 인공지능은 특정 행동의 결과를 미리 시뮬레이션해보고 다양한 가설을 검증할 수 있어, 범용 인공지능의 핵심 구성 요소로 여겨진다.

특히, 로봇이나 자율주행 차량과 같은 인공지능 에이전트는 학습을 위해 여러 가지 행동을 시도해 보아야하는데, 이는 위험성과 고장 가능성을 높인다는 단점을 갖는다. 이에 반해, 월드모델을 갖춘 인공지능은 실세계 상호작용 없이도 상상모델 속에서 학습을 가능케 해 큰 이점을 제공한다.

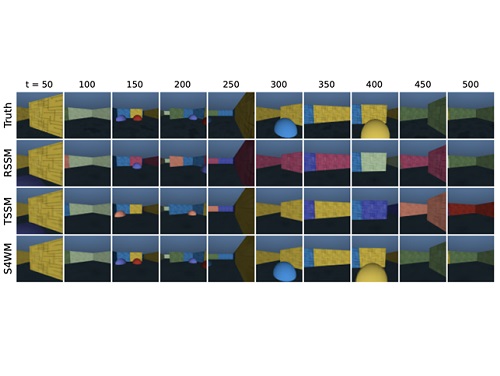

그러나 월드모델은 자연어처리 등에서 큰 발전을 가능하게 한 트랜스포머와 S4와 같은 새로운 시퀀스 모델링 아키텍처의 적용에 한계가 있었다. 이로 인해, 대부분의 월드모델이 성능과 효율성 면에서 제약이 있는 고전적인 재귀적 신경망에 의존하고 있었고 안성진 교수팀은 작년 세계최초로 트랜스포머 기반의 월드모델을 개발하였으나 추론 계산속도나 메모리능력에서 여전히 개선할 문제를 갖고 있었다.

이러한 문제를 해결하기 위해, 안성진 교수가 이끄는 KAIST와 럿거스 대학교 공동연구팀은 재귀적 신경망과 트랜스포머 기반 월드모델의 단점을 극복한 새로운 월드모델의 개발에 성공했다. 연구팀은 S4 시퀀스 모델에 기반한 S4 World Model (S4WM)을 개발하여, 재귀적 신경망의 최대 단점인 병렬처리가 가능한 시퀀스 학습이 불가능하다는 문제를 해결하였다. 또한, 재귀적 신경망의 장점인 빠른 추론시간을 유지하도록 하여 느린 추론 시간을 제공하는 트랜스포머 기반 월드모델의 단점을 극복했다.

연구를 주도한 안성진 교수는 "병렬 학습과 빠른 추론이 가능한 에이전트 월드모델을 세계 최초로 개발했다ˮ며, 이는 "모델기반 강화학습 능력을 획기적으로 개선해 지능형 로봇, 자율주행 차량, 그리고 자율형 인공지능 에이전트 기술 전반에 비용절감과 성능 향상이 예상된다ˮ고 밝혔다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 세계 최고 수준의 인공지능 학회인 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Facing off World Model Backbones: RNNs, Transformers, and S4”Fei Deng, Junyeong Park, Sungjin Ahn, NeurIPS 23, https://arxiv.org/abs/2307.02064

2023.11.09 조회수 1739

트랜스포머 대체할 차세대 월드모델 기술 세계 최초 개발

우리 대학 전산학부 안성진 교수 연구팀이 미국 럿거스 대학교와 협력하여 트랜스포머 및 재귀신경망 기반의 월드모델을 대체할 차세대 에이전트 월드모델 기술을 세계 최초로 개발했다.

월드모델은 인간의 뇌가 현실 세계의 경험을 바탕으로 환경 모델을 구축하는 과정과 유사하다. 이러한 월드모델을 활용하는 인공지능은 특정 행동의 결과를 미리 시뮬레이션해보고 다양한 가설을 검증할 수 있어, 범용 인공지능의 핵심 구성 요소로 여겨진다.

특히, 로봇이나 자율주행 차량과 같은 인공지능 에이전트는 학습을 위해 여러 가지 행동을 시도해 보아야하는데, 이는 위험성과 고장 가능성을 높인다는 단점을 갖는다. 이에 반해, 월드모델을 갖춘 인공지능은 실세계 상호작용 없이도 상상모델 속에서 학습을 가능케 해 큰 이점을 제공한다.

그러나 월드모델은 자연어처리 등에서 큰 발전을 가능하게 한 트랜스포머와 S4와 같은 새로운 시퀀스 모델링 아키텍처의 적용에 한계가 있었다. 이로 인해, 대부분의 월드모델이 성능과 효율성 면에서 제약이 있는 고전적인 재귀적 신경망에 의존하고 있었고 안성진 교수팀은 작년 세계최초로 트랜스포머 기반의 월드모델을 개발하였으나 추론 계산속도나 메모리능력에서 여전히 개선할 문제를 갖고 있었다.

이러한 문제를 해결하기 위해, 안성진 교수가 이끄는 KAIST와 럿거스 대학교 공동연구팀은 재귀적 신경망과 트랜스포머 기반 월드모델의 단점을 극복한 새로운 월드모델의 개발에 성공했다. 연구팀은 S4 시퀀스 모델에 기반한 S4 World Model (S4WM)을 개발하여, 재귀적 신경망의 최대 단점인 병렬처리가 가능한 시퀀스 학습이 불가능하다는 문제를 해결하였다. 또한, 재귀적 신경망의 장점인 빠른 추론시간을 유지하도록 하여 느린 추론 시간을 제공하는 트랜스포머 기반 월드모델의 단점을 극복했다.

연구를 주도한 안성진 교수는 "병렬 학습과 빠른 추론이 가능한 에이전트 월드모델을 세계 최초로 개발했다ˮ며, 이는 "모델기반 강화학습 능력을 획기적으로 개선해 지능형 로봇, 자율주행 차량, 그리고 자율형 인공지능 에이전트 기술 전반에 비용절감과 성능 향상이 예상된다ˮ고 밝혔다.

이번 연구는 12월 10일부터 16일까지 미국 뉴올리언스에서 열리는 세계 최고 수준의 인공지능 학회인 제37회 신경정보처리학회(NeurIPS)에서 발표될 예정이다.

관련논문: “Facing off World Model Backbones: RNNs, Transformers, and S4”Fei Deng, Junyeong Park, Sungjin Ahn, NeurIPS 23, https://arxiv.org/abs/2307.02064

2023.11.09 조회수 1739 -

인공지능 챗봇 이미지 데이터 훈련 비용 최소화하다

최근 다양한 분야에서 인공지능 심층 학습(딥러닝) 기술을 활용한 서비스가 급속히 증가하고 있다. GPT와 같은 거대 언어 모델을 훈련하기 위해서는 수백 대의 GPU와 몇 주 이상의 시간이 필요하다고 알려져 있다. 따라서, 심층신경망 훈련 비용을 최소화하는 방법 개발이 요구되고 있다.

우리 대학 전산학부 이재길 교수 연구팀이 심층신경망 훈련 비용을 최소화할 수 있도록 훈련 데이터의 양을 줄이는 새로운 데이터 선택 기술을 개발했다고 2일 밝혔다.

일반적으로 대용량의 심층 학습용 훈련 데이터는 레이블 오류(예를 들어, 강아지 사진이 `고양이'라고 잘못 표기되어 있음)를 포함한다. 최신 인공지능 방법론인 재(再)레이블링(Re-labeling) 학습법은 훈련 도중 레이블 오류를 스스로 수정하면서 높은 심층신경망 성능을 달성하는데, 레이블 오류를 수정하기 위한 추가적인 과정들로 인해 훈련에 필요한 시간이 더욱 증가한다는 단점이 있다. 한편 막대한 훈련 시간을 줄이려는 방법으로 중복되거나 성능 향상에 도움이 되지 않는 데이터를 제거해 훈련 데이터의 크기를 줄이는 핵심 집합 선별(coreset selection) 방식이 큰 주목을 받고 있다. 그러나 기존 핵심 집합 선별 방식은 훈련 데이터에 레이블 오류가 없다고 가정한 표준 학습법을 위해 개발됐고, 재레이블링 학습법을 위한 핵심 집합 선별 방식에 관한 연구는 부족한 실정이다.

이재길 교수팀이 개발한 기술은 레이블 오류를 스스로 수정하는 최신 재레이블링 학습법을 위해 핵심 집합 선별을 수행하여 심층 학습 훈련 비용을 최소화할 수 있도록 해준다. 따라서, 레이블 오류가 포함된 현실적인 훈련 데이터를 지원하므로 실용성이 매우 높다.

또한 이 교수팀은 특정 데이터의 레이블 오류 수정 정확도가 해당 데이터의 이웃 데이터의 신뢰도와 높은 상관관계가 있음을 발견했다. 즉, 이웃 데이터의 신뢰도가 높으면 레이블 오류 수정 정확도가 커지는 경향이 있다. 이웃 데이터의 신뢰도는 심층신경망의 충분한 훈련 전에도 측정할 수 있으므로, 각 데이터의 레이블 수정 가능 여부를 예측할 수 있게 된다. 연구팀은 이러한 발견을 기반으로 전체 훈련 데이터의 총합 이웃 신뢰도를 최대화하는 데이터 부분 집합을 선별해 레이블 수정 정확도와 일반화 성능을 최대화하는 `재레이블링을 위한 핵심 집합 선별'을 제안했다. 총합 이웃 신뢰도를 최대화하는 부분 집합을 찾는 조합 최적화 문제의 효율적인 해법을 위해 총합 이웃 신뢰도를 가장 증가시키는 데이터를 차례차례 선택하는 탐욕 알고리즘(greedy algorithm)을 도입했다.

연구팀은 이미지 분류 문제에 대해 다양한 실세계의 훈련 데이터를 사용해 방법론을 검증했다. 그 결과, 레이블 오류가 없다는 가정에 따른 표준 학습법에서는 최대 9%, 재레이블링 학습법에서는 최대 21% 최종 예측 정확도가 기존 방법론에 비해 향상되었고, 모든 범위의 데이터 선별 비율에서 일관되게 최고 성능을 달성했다. 또한, 총합 이웃 신뢰도를 최대화한 효율적 탐욕 알고리즘을 통해 기존 방법론에 비해 획기적으로 시간을 줄이고 수백만 장의 이미지를 포함하는 초대용량 훈련 데이터에도 쉽게 확장될 수 있음을 확인했다.

제1 저자인 박동민 박사과정 학생은 "이번 기술은 오류를 포함한 데이터에 대한 최신 인공지능 방법론의 훈련 가속화를 위한 획기적인 방법ˮ 이라면서 "다양한 데이터 상황에서의 강건성이 검증됐기 때문에, 실생활의 기계 학습 문제에 폭넓게 적용될 수 있어 전반적인 심층 학습의 훈련 데이터 준비 비용 절감에 기여할 것ˮ 이라고 밝혔다.

연구팀을 지도한 이재길 교수도 "이 기술이 파이토치(PyTorch) 혹은 텐서플로우(TensorFlow)와 같은 기존의 심층 학습 라이브러리에 추가되면 기계 학습 및 심층 학습 학계에 큰 파급효과를 낼 수 있을 것이다ˮ고 말했다.

우리 대학 데이터사이언스대학원에 재학 중인 박동민 박사과정 학생이 제1 저자, 최설아 석사과정, 김도영 박사과정 학생이 제2, 제3 저자로 각각 참여한 이번 연구는 최고권위 국제학술대회 `신경정보처리시스템학회(NeurIPS) 2023'에서 올 12월 발표될 예정이다. (논문명 : Robust Data Pruning under Label Noise via Maximizing Re-labeling Accuracy)

한편, 이 기술은 과학기술정보통신부 재원으로 정보통신기획평가원의 지원을 받아 SW컴퓨팅산업원천기술개발사업 SW스타랩 과제로 개발한 연구성과 결과물(2020-0-00862, DB4DL: 딥러닝 지원 고사용성 및 고성능 분산 인메모리 DBMS 개발)이다.

2023.11.02 조회수 1791

인공지능 챗봇 이미지 데이터 훈련 비용 최소화하다

최근 다양한 분야에서 인공지능 심층 학습(딥러닝) 기술을 활용한 서비스가 급속히 증가하고 있다. GPT와 같은 거대 언어 모델을 훈련하기 위해서는 수백 대의 GPU와 몇 주 이상의 시간이 필요하다고 알려져 있다. 따라서, 심층신경망 훈련 비용을 최소화하는 방법 개발이 요구되고 있다.

우리 대학 전산학부 이재길 교수 연구팀이 심층신경망 훈련 비용을 최소화할 수 있도록 훈련 데이터의 양을 줄이는 새로운 데이터 선택 기술을 개발했다고 2일 밝혔다.

일반적으로 대용량의 심층 학습용 훈련 데이터는 레이블 오류(예를 들어, 강아지 사진이 `고양이'라고 잘못 표기되어 있음)를 포함한다. 최신 인공지능 방법론인 재(再)레이블링(Re-labeling) 학습법은 훈련 도중 레이블 오류를 스스로 수정하면서 높은 심층신경망 성능을 달성하는데, 레이블 오류를 수정하기 위한 추가적인 과정들로 인해 훈련에 필요한 시간이 더욱 증가한다는 단점이 있다. 한편 막대한 훈련 시간을 줄이려는 방법으로 중복되거나 성능 향상에 도움이 되지 않는 데이터를 제거해 훈련 데이터의 크기를 줄이는 핵심 집합 선별(coreset selection) 방식이 큰 주목을 받고 있다. 그러나 기존 핵심 집합 선별 방식은 훈련 데이터에 레이블 오류가 없다고 가정한 표준 학습법을 위해 개발됐고, 재레이블링 학습법을 위한 핵심 집합 선별 방식에 관한 연구는 부족한 실정이다.

이재길 교수팀이 개발한 기술은 레이블 오류를 스스로 수정하는 최신 재레이블링 학습법을 위해 핵심 집합 선별을 수행하여 심층 학습 훈련 비용을 최소화할 수 있도록 해준다. 따라서, 레이블 오류가 포함된 현실적인 훈련 데이터를 지원하므로 실용성이 매우 높다.

또한 이 교수팀은 특정 데이터의 레이블 오류 수정 정확도가 해당 데이터의 이웃 데이터의 신뢰도와 높은 상관관계가 있음을 발견했다. 즉, 이웃 데이터의 신뢰도가 높으면 레이블 오류 수정 정확도가 커지는 경향이 있다. 이웃 데이터의 신뢰도는 심층신경망의 충분한 훈련 전에도 측정할 수 있으므로, 각 데이터의 레이블 수정 가능 여부를 예측할 수 있게 된다. 연구팀은 이러한 발견을 기반으로 전체 훈련 데이터의 총합 이웃 신뢰도를 최대화하는 데이터 부분 집합을 선별해 레이블 수정 정확도와 일반화 성능을 최대화하는 `재레이블링을 위한 핵심 집합 선별'을 제안했다. 총합 이웃 신뢰도를 최대화하는 부분 집합을 찾는 조합 최적화 문제의 효율적인 해법을 위해 총합 이웃 신뢰도를 가장 증가시키는 데이터를 차례차례 선택하는 탐욕 알고리즘(greedy algorithm)을 도입했다.

연구팀은 이미지 분류 문제에 대해 다양한 실세계의 훈련 데이터를 사용해 방법론을 검증했다. 그 결과, 레이블 오류가 없다는 가정에 따른 표준 학습법에서는 최대 9%, 재레이블링 학습법에서는 최대 21% 최종 예측 정확도가 기존 방법론에 비해 향상되었고, 모든 범위의 데이터 선별 비율에서 일관되게 최고 성능을 달성했다. 또한, 총합 이웃 신뢰도를 최대화한 효율적 탐욕 알고리즘을 통해 기존 방법론에 비해 획기적으로 시간을 줄이고 수백만 장의 이미지를 포함하는 초대용량 훈련 데이터에도 쉽게 확장될 수 있음을 확인했다.

제1 저자인 박동민 박사과정 학생은 "이번 기술은 오류를 포함한 데이터에 대한 최신 인공지능 방법론의 훈련 가속화를 위한 획기적인 방법ˮ 이라면서 "다양한 데이터 상황에서의 강건성이 검증됐기 때문에, 실생활의 기계 학습 문제에 폭넓게 적용될 수 있어 전반적인 심층 학습의 훈련 데이터 준비 비용 절감에 기여할 것ˮ 이라고 밝혔다.

연구팀을 지도한 이재길 교수도 "이 기술이 파이토치(PyTorch) 혹은 텐서플로우(TensorFlow)와 같은 기존의 심층 학습 라이브러리에 추가되면 기계 학습 및 심층 학습 학계에 큰 파급효과를 낼 수 있을 것이다ˮ고 말했다.

우리 대학 데이터사이언스대학원에 재학 중인 박동민 박사과정 학생이 제1 저자, 최설아 석사과정, 김도영 박사과정 학생이 제2, 제3 저자로 각각 참여한 이번 연구는 최고권위 국제학술대회 `신경정보처리시스템학회(NeurIPS) 2023'에서 올 12월 발표될 예정이다. (논문명 : Robust Data Pruning under Label Noise via Maximizing Re-labeling Accuracy)

한편, 이 기술은 과학기술정보통신부 재원으로 정보통신기획평가원의 지원을 받아 SW컴퓨팅산업원천기술개발사업 SW스타랩 과제로 개발한 연구성과 결과물(2020-0-00862, DB4DL: 딥러닝 지원 고사용성 및 고성능 분산 인메모리 DBMS 개발)이다.

2023.11.02 조회수 1791 -

1형당뇨 환우 청소년에게 KAIST 과학캠프 제공

우리 대학은 한국1형당뇨병환우회(대표 김미영, 이하 1형환우회)와 함께 '2023 1형당뇨 청소년 KAIST 과학 캠프'를 개최했다. 1형환우회의 제안으로 20일부터 이틀간 KAIST 대전 본원 전산학동에서 열린 캠프에는 초등학교 5학년부터 고등학교 2학년까지 32명의 청소년이 참가했다. 학생들은 KAIST 기숙사에서 1박 2일간 생활하며, 학부생 동아리 케이렛(K-Let)의 진로 멘토링, 교원 및 대학원생 특강, 리더십 프로그램, 랩투어 등에 참가했다.

특히, 학부모도 함께 참석한 특강에는 시각장애인으로 의료 인공지능을 연구하는 가현욱 KAIST 융합인재학부 교수가 '꿈은 어디에서 오는가?'라는 제목으로 강연했다. 시각장애라는 제약 속에서 과학자를 꿈꾸게 된 계기와 이뤄가는 과정을 통해 "꿈은 경쟁하고 비교하며 확인하는 것이 아니라 자신 삶에 대한 바른 질문과 일상의 소소한 일들을 수용하고 사랑하는 태도에서 시작된다"라고 강조했다.

중증장애인 중 처음으로 KAIST에 입학한 박혜린 전산학부 석사과정 학생도 '내가 가진 특별함으로 반짝이기'를 주제로 휠체어를 타고 KAIST 학부에 입학한 뒤 대학원생이 되기까지 겪은 진솔한 삶의 이야기를 학생들과 공유하는 시간을 가졌다.

이외에도, 사람의 움직임을 돕는 착용형 로봇을 개발하는 공경철 기계공학과 교수 연구실, 영상 효과에 사용되는 컴퓨터 그래픽 기술을 개발하는 노준용 문화기술대학원 교수 연구실, 물리적 자극과 세포의 상호작용을 연구해 생명과 질병에 대해 알아보는 신현정 기계공학과 교수 연구실을 탐방하며 사람과 세상을 위한 연구 현장에서 과학 기술을 직접 보고 듣는 경험을 쌓았다.

캠프에 참석한 초등학교 6학년 이승현 학생은 "작년 12월에 발병한 뒤 이번 캠프에서 처음으로 환우회 형, 누나들을 직접 만나게 되어 기뻤고 동경했던 KAIST에서 랩투어를 하면서 사람을 이롭게 하는 과학 기술에 흥미를 가지게 되었다"고 말했다.

1형환우회 김미영 대표는 "1형당뇨병은 환자가 의학적 지식뿐만 아니라 새로운 의료기술이나 IT 기술 등도 적극적으로 받아들이고 활용하여 관리해야 하는 질환"이라고 설명하며, 이어 "1형당뇨 청소년들이 과학 기술에 관심을 가질 수 있는 좋은 기회가 된 것 같다"라고 전했다.

류석영 전산학부장은 "이번 캠프는 카카오헬스케어, 아이센스, 애보트 등의 기업이 재정을 후원하고 KAIST 과학영재교육연구원을 비롯해 생활관, 식당 등 학내 다양한 부처에서 적극적으로 도움과 지지를 보내준 교직원들 덕분에 가능했다"라며, "KAIST에서 보낸 1박 2일이 1형환우회 청소년들에게 행복한 기억으로 남길 기대한다"라고 밝혔다.

한편, 이번 캠프를 주최한 KAIST 전산학부는 지난 2월 전산학부와 카카오임팩트(이사장 홍은택)와 '사회 변화 및 사회 문제 해결에 기여하는 기술 개발 및 기술 인력 발굴' 업무 협약을 추진했다. 이후, 학부생 동아리 케이렛(K-Let)이 김미영 카카오임팩트 펠로우가 대표로 있는 1형환우회 청소년들의 멘토링을 진행해 왔다. 올해 2학기에는 전산학부에 테크 포 임팩트(Tech for Impact) 수업을 개설해 사회 문제 해결을 위한 학부생들의 관심을 제고하고, 디지털 기술의 사회적 활용을 제안하는 프로젝트를 운영할 계획이다.

2023.07.21 조회수 2714

1형당뇨 환우 청소년에게 KAIST 과학캠프 제공

우리 대학은 한국1형당뇨병환우회(대표 김미영, 이하 1형환우회)와 함께 '2023 1형당뇨 청소년 KAIST 과학 캠프'를 개최했다. 1형환우회의 제안으로 20일부터 이틀간 KAIST 대전 본원 전산학동에서 열린 캠프에는 초등학교 5학년부터 고등학교 2학년까지 32명의 청소년이 참가했다. 학생들은 KAIST 기숙사에서 1박 2일간 생활하며, 학부생 동아리 케이렛(K-Let)의 진로 멘토링, 교원 및 대학원생 특강, 리더십 프로그램, 랩투어 등에 참가했다.

특히, 학부모도 함께 참석한 특강에는 시각장애인으로 의료 인공지능을 연구하는 가현욱 KAIST 융합인재학부 교수가 '꿈은 어디에서 오는가?'라는 제목으로 강연했다. 시각장애라는 제약 속에서 과학자를 꿈꾸게 된 계기와 이뤄가는 과정을 통해 "꿈은 경쟁하고 비교하며 확인하는 것이 아니라 자신 삶에 대한 바른 질문과 일상의 소소한 일들을 수용하고 사랑하는 태도에서 시작된다"라고 강조했다.

중증장애인 중 처음으로 KAIST에 입학한 박혜린 전산학부 석사과정 학생도 '내가 가진 특별함으로 반짝이기'를 주제로 휠체어를 타고 KAIST 학부에 입학한 뒤 대학원생이 되기까지 겪은 진솔한 삶의 이야기를 학생들과 공유하는 시간을 가졌다.

이외에도, 사람의 움직임을 돕는 착용형 로봇을 개발하는 공경철 기계공학과 교수 연구실, 영상 효과에 사용되는 컴퓨터 그래픽 기술을 개발하는 노준용 문화기술대학원 교수 연구실, 물리적 자극과 세포의 상호작용을 연구해 생명과 질병에 대해 알아보는 신현정 기계공학과 교수 연구실을 탐방하며 사람과 세상을 위한 연구 현장에서 과학 기술을 직접 보고 듣는 경험을 쌓았다.

캠프에 참석한 초등학교 6학년 이승현 학생은 "작년 12월에 발병한 뒤 이번 캠프에서 처음으로 환우회 형, 누나들을 직접 만나게 되어 기뻤고 동경했던 KAIST에서 랩투어를 하면서 사람을 이롭게 하는 과학 기술에 흥미를 가지게 되었다"고 말했다.

1형환우회 김미영 대표는 "1형당뇨병은 환자가 의학적 지식뿐만 아니라 새로운 의료기술이나 IT 기술 등도 적극적으로 받아들이고 활용하여 관리해야 하는 질환"이라고 설명하며, 이어 "1형당뇨 청소년들이 과학 기술에 관심을 가질 수 있는 좋은 기회가 된 것 같다"라고 전했다.

류석영 전산학부장은 "이번 캠프는 카카오헬스케어, 아이센스, 애보트 등의 기업이 재정을 후원하고 KAIST 과학영재교육연구원을 비롯해 생활관, 식당 등 학내 다양한 부처에서 적극적으로 도움과 지지를 보내준 교직원들 덕분에 가능했다"라며, "KAIST에서 보낸 1박 2일이 1형환우회 청소년들에게 행복한 기억으로 남길 기대한다"라고 밝혔다.

한편, 이번 캠프를 주최한 KAIST 전산학부는 지난 2월 전산학부와 카카오임팩트(이사장 홍은택)와 '사회 변화 및 사회 문제 해결에 기여하는 기술 개발 및 기술 인력 발굴' 업무 협약을 추진했다. 이후, 학부생 동아리 케이렛(K-Let)이 김미영 카카오임팩트 펠로우가 대표로 있는 1형환우회 청소년들의 멘토링을 진행해 왔다. 올해 2학기에는 전산학부에 테크 포 임팩트(Tech for Impact) 수업을 개설해 사회 문제 해결을 위한 학부생들의 관심을 제고하고, 디지털 기술의 사회적 활용을 제안하는 프로젝트를 운영할 계획이다.

2023.07.21 조회수 2714 -

전산학부 박종철 교수 연구팀, ACL2023 Outstanding Paper Award 수상

우리 대학 전산학부 박종철 교수 연구팀이 2023년 7월 9일~13일 토론토에서 열린 ACL 2023 에서 Outstanding Paper Award를 수상했다.

연구팀의 획기적인 논문인 “Question-Answering in a Low-resourced Language: Benchmark Dataset and Models for Tigrinya“는 저자원 언어이며 동아프리카의 에리트레아와 에티오피아에서 사용되는 티그리냐를 다룬다.

연구팀은 티그리냐 질문-답변 데이터셋을 세계 최초로 구축하고 티그리냐로 작성된 문서를 읽고 답할 수 있는 언어모델을 만들었다.

이 상은 학회에 제출한 연구 중 상위 1.5~2.5%에게만 주어지는 의미 있는 상이다.

이 연구팀은 티그리냐와 다른 동아프리카 언어들에 대한 사전학습 언어 모델과 언어 식별 방법에 대한 연구를 LREC2022와 EMNLP2021 등 저명한 NLP 학회에 소개한 경험이 있다.

본 연구의 첫 번째 저자인 Fitsum은 전산학부 NLP*CL 연구실의 박사과정 학생이다. 그의 연구는 현재 티그리냐 언어에 초점을 맞추고 있지만, 특정 언어를 넘어 연구의 지평을 확장하기 위해 노력하고 있다.

이 연구팀이 개발한 방법론, 데이터수집 방법, 어노테이션 툴, 그리고 모델은 언어 자원이 부족한 언어들에 대한 유용한 참고자료로 활용될 것으로 기대된다. 특히 이들의 연구는 최근 심각해 지고 있는 디지털 격차를 해소하기 위해 언어적으로 다양하고, 역사적으로 혜택을 받지 못했던 커뮤니티에 대등한 연구가 가능한 디지털 표현 방법을 제공하였다는 의미가 있다.

본 연구는 NLP*CL 연구실에서 ACL 2023을 통해 발표한 다섯 편의 Long Paper (세 편은 메인 학술대회, 두 편은 Findings) 중 하나이다.

2023.07.18 조회수 1305

전산학부 박종철 교수 연구팀, ACL2023 Outstanding Paper Award 수상

우리 대학 전산학부 박종철 교수 연구팀이 2023년 7월 9일~13일 토론토에서 열린 ACL 2023 에서 Outstanding Paper Award를 수상했다.

연구팀의 획기적인 논문인 “Question-Answering in a Low-resourced Language: Benchmark Dataset and Models for Tigrinya“는 저자원 언어이며 동아프리카의 에리트레아와 에티오피아에서 사용되는 티그리냐를 다룬다.

연구팀은 티그리냐 질문-답변 데이터셋을 세계 최초로 구축하고 티그리냐로 작성된 문서를 읽고 답할 수 있는 언어모델을 만들었다.

이 상은 학회에 제출한 연구 중 상위 1.5~2.5%에게만 주어지는 의미 있는 상이다.

이 연구팀은 티그리냐와 다른 동아프리카 언어들에 대한 사전학습 언어 모델과 언어 식별 방법에 대한 연구를 LREC2022와 EMNLP2021 등 저명한 NLP 학회에 소개한 경험이 있다.

본 연구의 첫 번째 저자인 Fitsum은 전산학부 NLP*CL 연구실의 박사과정 학생이다. 그의 연구는 현재 티그리냐 언어에 초점을 맞추고 있지만, 특정 언어를 넘어 연구의 지평을 확장하기 위해 노력하고 있다.

이 연구팀이 개발한 방법론, 데이터수집 방법, 어노테이션 툴, 그리고 모델은 언어 자원이 부족한 언어들에 대한 유용한 참고자료로 활용될 것으로 기대된다. 특히 이들의 연구는 최근 심각해 지고 있는 디지털 격차를 해소하기 위해 언어적으로 다양하고, 역사적으로 혜택을 받지 못했던 커뮤니티에 대등한 연구가 가능한 디지털 표현 방법을 제공하였다는 의미가 있다.

본 연구는 NLP*CL 연구실에서 ACL 2023을 통해 발표한 다섯 편의 Long Paper (세 편은 메인 학술대회, 두 편은 Findings) 중 하나이다.

2023.07.18 조회수 1305 -

전산학부 오혜연 교수, RSS 2023 기조강연 진행

전산학부 오혜연 교수가 2023년 7월 11일 대구 엑스코에서 개최된 '2023 로봇공학, 과학 및 시스템 컨퍼런스(Robotics: Science and Systems, 이하 RSS 2023)' 초청을 받아 기조강연을 진행했다.

발표 제목은 "Toward Culturally Intelligent Language Models" 로 최근 많은 주목을 받고 있는 대형언어모델(Large Langue Models; LLM)이 문화적 지식 및 지능을 갖기 위해 어떤 연구를 해야 하는지에 대한 내용으로 강연을 진행했다.

RSS 2023은 2005년부터 개최된 Robotics 분야의 저명 컨퍼런스로 이번 컨퍼런스는 아시아에서 처음 개최되었다.

이번 RSS 2023에는 전 세계의 AI와 로봇 분야 연구자들과 아마존 로보틱스, 토요타 연구소, 한화시스템 등 세계적 기업을 포함해 40개국에서 온 800여 명이 참여했으며 세계적인 석학 초청 기조 강연, 25개의 워크숍, 112개의 논문 발표, 포스터 세션으로 진행되었다.

2023.07.17 조회수 1591

전산학부 오혜연 교수, RSS 2023 기조강연 진행

전산학부 오혜연 교수가 2023년 7월 11일 대구 엑스코에서 개최된 '2023 로봇공학, 과학 및 시스템 컨퍼런스(Robotics: Science and Systems, 이하 RSS 2023)' 초청을 받아 기조강연을 진행했다.

발표 제목은 "Toward Culturally Intelligent Language Models" 로 최근 많은 주목을 받고 있는 대형언어모델(Large Langue Models; LLM)이 문화적 지식 및 지능을 갖기 위해 어떤 연구를 해야 하는지에 대한 내용으로 강연을 진행했다.

RSS 2023은 2005년부터 개최된 Robotics 분야의 저명 컨퍼런스로 이번 컨퍼런스는 아시아에서 처음 개최되었다.

이번 RSS 2023에는 전 세계의 AI와 로봇 분야 연구자들과 아마존 로보틱스, 토요타 연구소, 한화시스템 등 세계적 기업을 포함해 40개국에서 온 800여 명이 참여했으며 세계적인 석학 초청 기조 강연, 25개의 워크숍, 112개의 논문 발표, 포스터 세션으로 진행되었다.

2023.07.17 조회수 1591 -

취침시간 지리/문화적 영향에 따라 더 늦어져

수면은 건강과 웰빙, 생산성에 큰 영향을 미치지만, 현대인이 얼마나 오래 그리고 잘 수면을 취하는지에 대해 정확히 보고되지 않았다. 수면의 양과 질은 개인의 선택일까, 아니면 문화와 지리와 같은 사회적 요인에 얼마나 영향을 받을까?

우리 대학 전산학부 차미영 교수가 이끄는 IBS(원장 노도영) 연구팀과 영국의 노키아 벨 연구소(Nokia Bell Labs)는 공동 연구를 통해 현대인의 ‘수면’이 어떤 사회적 및 개인적 요인에 영향을 받는다고 6일 밝혔다.

연구팀은 스마트 워치가 상용화되며 데이터의 대량 수집이 가능해진 기회에 주목했다. 노키아에서 개발한 스마트 워치를 착용한 미국, 캐나다, 스페인, 영국, 핀란드, 한국, 일본을 포함 11개국의 30,082명으로부터 4년간 수집한 5,200만 건의 데이터를 분석해 나라별 디지털 로그 기반 수면 패턴을 분석했다.

먼저 연구팀은 나라별 취침 시간, 기상 시간, 총 수면시간이 어떤지를 살폈다. 스마트워치 데이터에 기록된 취침 시간은 기존 설문지 기반 조사에 보고된 결과 대비 나라마다 수십 분에서 한 시간까지도 늦었다. 전 세계 평균 취침 시간은 자정(00:01)이고 기상 시간은 오전 7시 42분이었다. 이러한 차이는 설문조사가 가지는 편향과 함께 스마트 워치의 모션 센서가 뒤척임 없이 수면을 시작하는 순간을 정밀히 기록하는 데서 기인한다.

기상 시간은 나라별 비슷하지만 취침 시간은 지리적 문화적 영향을 상당히 받았다. 특히 국민 소득(GDP)이 높을수록 취침 시간이 늦어졌으며, 문화적으로 개인주의보다는 집단주의 지수가 높을수록 취침 시간이 늦었다. 조사된 나라 중 일본은 총 수면시간이 평균 7시간 미만으로 가장 적었으며 핀란드는 평균 수면시간이 8시간으로 가장 길었다. (그림 1)

연구팀은 이와 더불어 그동안 임상 연구에서 사용된 다양한 수면의 요소들을 정량화하여 수면 효율성(설명: 취침 중 깨지 않고 연속으로 자는 시간의 비율)과 같은 질적 요인을 분석했다. 빅데이터를 사용해 성향 점수 매칭 기법(propensity score matching methods, PSM)으로, 개인마다 문화적 요인을 고정한 상태에서 운동량을 늘어나면 수면이 어떻게 변하는지에 대한 가상 테스트를 진행했다. 그 결과 걸음 수가 늘수록 취침 시 더 빨리 잠들고 밤에 덜 깨는 긍정적 효과를 확인했다. 운동량은 수면의 질을 개선하지만, 총 수면시간을 늘리지는 않았다. 흥미롭게도 이러한 운동의 긍정적 효과는 국가별로 다르며, 특히 미국과 핀란드에서 효과가 강하게 나타난 반면 일본에서는 운동의 효과가 미미했다.

강원대학교 박성규 교수, 우리 대학 차미영 교수, 노키아 연구소의 퀘르시아 박사가 주저자로 참여한 이번 연구 결과는 국제 학술지 네이처 출판 그룹의 ‘사이언티픽 리포트(Scientific Reports)’에 게재됐다. (논문명: Social dimensions impact individual sleep quantity and quality, 사회적 차원이 개인의 수면 양과 질에 미치는 영향)

퀘르시아 박사는 “수면의 양과 질에 사회적 영향이 절반이나 차지했다. 고소득 국가에서 업무 스케줄이 과도하고 근무시간이 길어지며 취침 시간이 늦어지고, 집단주의가 강한 스페인과 일본은 사회적 요구에 부응하기 위해 취침 시간이 지연될 수 있다”고 연구 결과를 해석했다.

차미영 교수는 “수면은 웰빙, 비만, 치매 등과도 연관이 있다고 알려져 중요하다. 고령화 사회에서 국민의 건강 증진을 위해 적절한 수면의 양을 보장하고 수면의 질을 높이기 위해 개인의 노력은 물론 사회적 지원이 함께해야 한다”고 말했다.

연구팀은 이번 연구에서 개발한 수면의 지표를 쉽게 계산하는 코드를 무료로 공개해 첨단 수면 산업 발달에 기여하며, 다양한 생체 신호를 포함하는 수면에 대한 벤치마크 데이터도 추후 공개할 예정이다.

2023.07.06 조회수 1902

취침시간 지리/문화적 영향에 따라 더 늦어져

수면은 건강과 웰빙, 생산성에 큰 영향을 미치지만, 현대인이 얼마나 오래 그리고 잘 수면을 취하는지에 대해 정확히 보고되지 않았다. 수면의 양과 질은 개인의 선택일까, 아니면 문화와 지리와 같은 사회적 요인에 얼마나 영향을 받을까?

우리 대학 전산학부 차미영 교수가 이끄는 IBS(원장 노도영) 연구팀과 영국의 노키아 벨 연구소(Nokia Bell Labs)는 공동 연구를 통해 현대인의 ‘수면’이 어떤 사회적 및 개인적 요인에 영향을 받는다고 6일 밝혔다.

연구팀은 스마트 워치가 상용화되며 데이터의 대량 수집이 가능해진 기회에 주목했다. 노키아에서 개발한 스마트 워치를 착용한 미국, 캐나다, 스페인, 영국, 핀란드, 한국, 일본을 포함 11개국의 30,082명으로부터 4년간 수집한 5,200만 건의 데이터를 분석해 나라별 디지털 로그 기반 수면 패턴을 분석했다.

먼저 연구팀은 나라별 취침 시간, 기상 시간, 총 수면시간이 어떤지를 살폈다. 스마트워치 데이터에 기록된 취침 시간은 기존 설문지 기반 조사에 보고된 결과 대비 나라마다 수십 분에서 한 시간까지도 늦었다. 전 세계 평균 취침 시간은 자정(00:01)이고 기상 시간은 오전 7시 42분이었다. 이러한 차이는 설문조사가 가지는 편향과 함께 스마트 워치의 모션 센서가 뒤척임 없이 수면을 시작하는 순간을 정밀히 기록하는 데서 기인한다.

기상 시간은 나라별 비슷하지만 취침 시간은 지리적 문화적 영향을 상당히 받았다. 특히 국민 소득(GDP)이 높을수록 취침 시간이 늦어졌으며, 문화적으로 개인주의보다는 집단주의 지수가 높을수록 취침 시간이 늦었다. 조사된 나라 중 일본은 총 수면시간이 평균 7시간 미만으로 가장 적었으며 핀란드는 평균 수면시간이 8시간으로 가장 길었다. (그림 1)

연구팀은 이와 더불어 그동안 임상 연구에서 사용된 다양한 수면의 요소들을 정량화하여 수면 효율성(설명: 취침 중 깨지 않고 연속으로 자는 시간의 비율)과 같은 질적 요인을 분석했다. 빅데이터를 사용해 성향 점수 매칭 기법(propensity score matching methods, PSM)으로, 개인마다 문화적 요인을 고정한 상태에서 운동량을 늘어나면 수면이 어떻게 변하는지에 대한 가상 테스트를 진행했다. 그 결과 걸음 수가 늘수록 취침 시 더 빨리 잠들고 밤에 덜 깨는 긍정적 효과를 확인했다. 운동량은 수면의 질을 개선하지만, 총 수면시간을 늘리지는 않았다. 흥미롭게도 이러한 운동의 긍정적 효과는 국가별로 다르며, 특히 미국과 핀란드에서 효과가 강하게 나타난 반면 일본에서는 운동의 효과가 미미했다.

강원대학교 박성규 교수, 우리 대학 차미영 교수, 노키아 연구소의 퀘르시아 박사가 주저자로 참여한 이번 연구 결과는 국제 학술지 네이처 출판 그룹의 ‘사이언티픽 리포트(Scientific Reports)’에 게재됐다. (논문명: Social dimensions impact individual sleep quantity and quality, 사회적 차원이 개인의 수면 양과 질에 미치는 영향)

퀘르시아 박사는 “수면의 양과 질에 사회적 영향이 절반이나 차지했다. 고소득 국가에서 업무 스케줄이 과도하고 근무시간이 길어지며 취침 시간이 늦어지고, 집단주의가 강한 스페인과 일본은 사회적 요구에 부응하기 위해 취침 시간이 지연될 수 있다”고 연구 결과를 해석했다.

차미영 교수는 “수면은 웰빙, 비만, 치매 등과도 연관이 있다고 알려져 중요하다. 고령화 사회에서 국민의 건강 증진을 위해 적절한 수면의 양을 보장하고 수면의 질을 높이기 위해 개인의 노력은 물론 사회적 지원이 함께해야 한다”고 말했다.

연구팀은 이번 연구에서 개발한 수면의 지표를 쉽게 계산하는 코드를 무료로 공개해 첨단 수면 산업 발달에 기여하며, 다양한 생체 신호를 포함하는 수면에 대한 벤치마크 데이터도 추후 공개할 예정이다.

2023.07.06 조회수 1902 -

리던던트 로봇 매니퓰레이터를 사용한 최적화 기반의 경로 추종 문제에 대한 학습 기반 초기화 기술 개발

자율 로봇이 일상적인 작업을 수행하기 위해 6차원 카르테시안 경로 추종은 중요한 능력이지만, 리던던트 로봇 매니퓰레이터(Redundant Robot Manipulator)의 사용에는 다양한 제약 조건과 무한한 역기구학 솔루션으로 인해 연속적인 제어는 어렵다.

이에 장기적 의존성을 고려하는 경로 계획 기술이 필요하지만 경로의 길이와 환경의 복잡성이 증가하면 생성 시간이 오래 걸리게 되고, 국소 최적 경로 도출의 가능성이 커지게 된다. 이는 용접, 수술 로봇 등과 같이 정확도와 실시간성을 모두 요구하는 분야에서 리던던트 매니퓰레이터의 사용에 병목이 되고 있기에, 우리 대학 전산학부 윤성의 교수 연구팀은 다양한 문제에 적용성을 높이는 학습 기반과 최적성을 보장하는 최적화 기반 방식의 결합을 통해 각각의 방식이 갖는 이점을 유지하고 단점을 상호 보완하는 구조를 개발했다. 이러한 모델은 리던던트 매니퓰레이션의 경로 추종 문제에 적용되어 추종에 걸리는 시간, 정확도 등 다양한 평가 지표에 성능 향상을 보였다.

연구팀은 고차원의 탐색 공간에서 효율적인 강화 학습을 위해 최적화 기반의 방식으로부터 파생된 국소 최적의 사전 지식 정보를 활용하는 구조를 도입했다. 국소 최적 지식을 모방함으로써 성능 하락 문제를 해결하기 위해 리던던트 매니퓰레이터의 구조적 특성을 고려한 영공간 투영 (Null-space projection) 기법을 제안했다.

연구팀은 제안한 방식으로부터 생성된 초기 궤적과 최적화 기법에 대표적으로 사용되는 초기화 방식들을 다양한 평가 지표를 통해 비교하고, 제약조건 매니폴드 상에서 움직임을 확인하여 초기 궤적의 성능을 검증했다. 또한 본 방식의 사용을 통해 최적화 기법에 향상된 최적성, 효율성, 다양한 문제에 적용성을 보인다.

연구팀은 연구를 통해 리던던트 매니퓰레이터를 활용한 경로 추종 문제에 있어 강화 학습 프레임워크를 제안하고, 충돌 위험을 낮추기 위한 여분 자유도 제어 기법을 제시했으며 학습 기반과 최적화 기반 방식의 결합이 속도와 최적성을 모두 요구하는 문제에 중요한 전략이 될 수 있음을 보여주었다.

이는 협동 로봇, 수술 로봇 등 고자유도의 매니퓰레이터 모션을 요구하는 상황에 적용 가능하고, 이를 통해 다양한 도메인에서 고차원 매니퓰레이터의 사용성을 높여줄 것으로 기대한다.

해당 연구는 지난 2023년 5월 29일 ~ 6월 2일 영국 런던에서 진행된 로보틱스 분야 최대 국제 학회인 IEEE International Conference on Robotics and Automation (ICRA) 2023에서 Outstanding Planning Paper Award를 수상했다.

ICRA 2023 Award는 1,341편의 논문 중 15편에 수여되었으며, Planning 분야에서는 1편이 선정됐다.

2023.06.23 조회수 1744

리던던트 로봇 매니퓰레이터를 사용한 최적화 기반의 경로 추종 문제에 대한 학습 기반 초기화 기술 개발

자율 로봇이 일상적인 작업을 수행하기 위해 6차원 카르테시안 경로 추종은 중요한 능력이지만, 리던던트 로봇 매니퓰레이터(Redundant Robot Manipulator)의 사용에는 다양한 제약 조건과 무한한 역기구학 솔루션으로 인해 연속적인 제어는 어렵다.

이에 장기적 의존성을 고려하는 경로 계획 기술이 필요하지만 경로의 길이와 환경의 복잡성이 증가하면 생성 시간이 오래 걸리게 되고, 국소 최적 경로 도출의 가능성이 커지게 된다. 이는 용접, 수술 로봇 등과 같이 정확도와 실시간성을 모두 요구하는 분야에서 리던던트 매니퓰레이터의 사용에 병목이 되고 있기에, 우리 대학 전산학부 윤성의 교수 연구팀은 다양한 문제에 적용성을 높이는 학습 기반과 최적성을 보장하는 최적화 기반 방식의 결합을 통해 각각의 방식이 갖는 이점을 유지하고 단점을 상호 보완하는 구조를 개발했다. 이러한 모델은 리던던트 매니퓰레이션의 경로 추종 문제에 적용되어 추종에 걸리는 시간, 정확도 등 다양한 평가 지표에 성능 향상을 보였다.

연구팀은 고차원의 탐색 공간에서 효율적인 강화 학습을 위해 최적화 기반의 방식으로부터 파생된 국소 최적의 사전 지식 정보를 활용하는 구조를 도입했다. 국소 최적 지식을 모방함으로써 성능 하락 문제를 해결하기 위해 리던던트 매니퓰레이터의 구조적 특성을 고려한 영공간 투영 (Null-space projection) 기법을 제안했다.

연구팀은 제안한 방식으로부터 생성된 초기 궤적과 최적화 기법에 대표적으로 사용되는 초기화 방식들을 다양한 평가 지표를 통해 비교하고, 제약조건 매니폴드 상에서 움직임을 확인하여 초기 궤적의 성능을 검증했다. 또한 본 방식의 사용을 통해 최적화 기법에 향상된 최적성, 효율성, 다양한 문제에 적용성을 보인다.

연구팀은 연구를 통해 리던던트 매니퓰레이터를 활용한 경로 추종 문제에 있어 강화 학습 프레임워크를 제안하고, 충돌 위험을 낮추기 위한 여분 자유도 제어 기법을 제시했으며 학습 기반과 최적화 기반 방식의 결합이 속도와 최적성을 모두 요구하는 문제에 중요한 전략이 될 수 있음을 보여주었다.

이는 협동 로봇, 수술 로봇 등 고자유도의 매니퓰레이터 모션을 요구하는 상황에 적용 가능하고, 이를 통해 다양한 도메인에서 고차원 매니퓰레이터의 사용성을 높여줄 것으로 기대한다.

해당 연구는 지난 2023년 5월 29일 ~ 6월 2일 영국 런던에서 진행된 로보틱스 분야 최대 국제 학회인 IEEE International Conference on Robotics and Automation (ICRA) 2023에서 Outstanding Planning Paper Award를 수상했다.

ICRA 2023 Award는 1,341편의 논문 중 15편에 수여되었으며, Planning 분야에서는 1편이 선정됐다.

2023.06.23 조회수 1744