-

KAI 및 대덕연구단지 벤처기업과 SAR 위성영상 정보 활용 위한 차세대 AI 연구 협력 체결

우리 대학이 SAR* 위성영상 정보 활용을 위한 차세대 AI 연구개발을 위해 한국항공우주산업주식회사(대표이사 안현호, 이하 KAI) 및 대전 지역 소프트웨어 벤처회사들과 업무협력을 추진한다.

☞SAR(Synthetic Aperture Radar, 합성 개구 레이더): 마이크로파를 사용해 영상 정보를 얻는 기술. 구름·안개·눈 등 기상 환경에 따른 제약은 물론 주야간 구분 없이 광범위한 지역의 고화질 영상을 확보할 수 있다.

전기및전자공학부 윤찬현·김문철 교수팀이 참여하는 이번 연구 협력은 설명가능한 인공지능(AI) 기술, 위성탑재형 딥러닝 가속처리 하드웨어(HW) 기술 등을 적용해 고도화된 위성영상 분석 시스템 개발하는 것이 목표다.

이를 위해 KAIST는 KAI, ㈜I-OPS(대표 김영욱) 등의 위성전문기업 및 ㈜FISYS(대표 김종오), ㈜모두텍(대표 박경숙), ㈜유니인포(대표 이동길) 등의 벤처기업과 지난 20일 'SAR 위성영상 분석을 위한 차세대 AI 연구개발에 관한 업무협약'을 체결했다.

지금까지의 위성영상 판독은 지상에 있는 판독관의 분석에 의존하는 방식으로 운영되어왔다. 판독관의 경험과 지식을 바탕으로 자신이 담당하는 주요 지역 위주의 정보를 분석하는 구조다. 그러나 인간이 분석할 수 있는 정보 처리량에는 한계가 있어 판독 대상 외의 위협지역 및 이동하는 표적을 광범위하게 전수조사하는 것은 사실상 불가능했다.

공동 연구팀은 이런 문제점을 극복하기 위해 위성 온보드 시스템에서 설명가능 인공지능(Explainable AI, XAI)을 활용해 데이터를 선별하는 연구를 수행한다. 수백 기가바이트 단위로 수집되는 위성영상 데이터를 정제해 판독관이 분석해야 할 정보량을 압축하고 광역 전수조사가 가능하도록 돕는 기술이다.

일반적인 위성영상은 촬영 시 발생한 잡음, 왜곡, 저해상도 등의 문제로 판독 결과가 불분명한 경우가 빈번하게 발생한다. 윤찬현 교수 연구팀은 주요 시각 특성(Visual Feature)을 학습할 수 있는 주의집중(Attention) 기법을 설명가능한 인공지능에 적용해 판독할 객체 검출 및 인식 성능을 향상하는 기술을 제공한다. 판독관이 위성영상의 시각적·영상 문맥적인 정보를 분석할 수 있도록 지원하는 핵심 시스템 기술이다.

이와 함께, 판독관 피드백을 반영하는 전문판독관 참여형(Human-In-the-Loop) 학습 모델을 바탕으로 한 약한 지도학습(weakly supervised learning) 기법도 적용한다. 판독관의 판단 근거를 효과적으로 추출하여 인공지능의 시각적인 설명성을 개선하고 위성영상 분석의 신뢰도를 높이기 위해서다.

또한, 윤 교수 연구팀은 위성 탑재가 가능한 인공지능 처리용 하드웨어 보드를 개발해 대용량의 위성영상 정보를 고속으로 처리하는 기술을 확보했으며, 설명가능한 인공지능 모델 처리용 칩인 EPU(Explainable Neuro-Processing Unit)를 구현하는 연구도 진행 중이다.

이뿐만 아니라, 세계 최고 수준의 위성영상 해상도 향상 기술을 보유하고 있는 김문철 교수 연구팀에서는 SAR 위성 영상의 해상도를 2배 이상 향상할 수 있는 기술 개발로 협력한다.

KAIST와 함께 공동 연구에 참여하는 KAI는 초소형위성, 중대형위성, 발사체 등 우주 제조 분야 주도한 경험을 바탕으로 고부가가치 위성 서비스 분야까지 다각화를 추진하는 중이며, 이번 연구 협력을 통해 설명가능한 인공지능 기반 초소형위성용 SAR 영상처리기술을 공동연구한다.

또한, 국내 지구관측 위성 운영 전문기업인 ㈜I-OPS는 천리안위성, 다목적실용위성(아리랑 2/3/5호) 등 다양한 국내 위성의 운영 및 관제 경험 및 축적 기술을 활용해 위성에서 수집되는 데이터의 시계열 분석 분야에서 협업한다.

대덕연구단지 벤처기업인 ㈜FISYS, ㈜모두텍, ㈜유니인포 등은 각각 인공지능 연산처리를 위한 최적의 하드웨어 설계·제작 기술 및 대규모 데이터 분석·관리를 위한 인공지능 가속 시스템 기술을 공동으로 개발할 계획이다.윤찬현 KAIST 전기및전자공학부 교수는 "뉴 스페이스시대에 수많은 초소형위성들로부터 초대규모 데이터가 수집되는 상황에서 인공지능을 활용한 지능형 데이터 분석 기술은 필수적이다"라고 강조했다. 이어, 윤 교수는 "저해상도 SAR 영상 분석의 모호성을 해결할 수 있는 영상 품질 향상과 설명가능하고 신뢰성 있는 인공지능의 핵심기술을 확보하는 성공적인 연구 개발 협력이 되길 기대한다"라고 밝혔다.

KAI 및 대덕연구단지 벤처기업과 SAR 위성영상 정보 활용 위한 차세대 AI 연구 협력 체결

우리 대학이 SAR* 위성영상 정보 활용을 위한 차세대 AI 연구개발을 위해 한국항공우주산업주식회사(대표이사 안현호, 이하 KAI) 및 대전 지역 소프트웨어 벤처회사들과 업무협력을 추진한다.

☞SAR(Synthetic Aperture Radar, 합성 개구 레이더): 마이크로파를 사용해 영상 정보를 얻는 기술. 구름·안개·눈 등 기상 환경에 따른 제약은 물론 주야간 구분 없이 광범위한 지역의 고화질 영상을 확보할 수 있다.

전기및전자공학부 윤찬현·김문철 교수팀이 참여하는 이번 연구 협력은 설명가능한 인공지능(AI) 기술, 위성탑재형 딥러닝 가속처리 하드웨어(HW) 기술 등을 적용해 고도화된 위성영상 분석 시스템 개발하는 것이 목표다.

이를 위해 KAIST는 KAI, ㈜I-OPS(대표 김영욱) 등의 위성전문기업 및 ㈜FISYS(대표 김종오), ㈜모두텍(대표 박경숙), ㈜유니인포(대표 이동길) 등의 벤처기업과 지난 20일 'SAR 위성영상 분석을 위한 차세대 AI 연구개발에 관한 업무협약'을 체결했다.

지금까지의 위성영상 판독은 지상에 있는 판독관의 분석에 의존하는 방식으로 운영되어왔다. 판독관의 경험과 지식을 바탕으로 자신이 담당하는 주요 지역 위주의 정보를 분석하는 구조다. 그러나 인간이 분석할 수 있는 정보 처리량에는 한계가 있어 판독 대상 외의 위협지역 및 이동하는 표적을 광범위하게 전수조사하는 것은 사실상 불가능했다.

공동 연구팀은 이런 문제점을 극복하기 위해 위성 온보드 시스템에서 설명가능 인공지능(Explainable AI, XAI)을 활용해 데이터를 선별하는 연구를 수행한다. 수백 기가바이트 단위로 수집되는 위성영상 데이터를 정제해 판독관이 분석해야 할 정보량을 압축하고 광역 전수조사가 가능하도록 돕는 기술이다.

일반적인 위성영상은 촬영 시 발생한 잡음, 왜곡, 저해상도 등의 문제로 판독 결과가 불분명한 경우가 빈번하게 발생한다. 윤찬현 교수 연구팀은 주요 시각 특성(Visual Feature)을 학습할 수 있는 주의집중(Attention) 기법을 설명가능한 인공지능에 적용해 판독할 객체 검출 및 인식 성능을 향상하는 기술을 제공한다. 판독관이 위성영상의 시각적·영상 문맥적인 정보를 분석할 수 있도록 지원하는 핵심 시스템 기술이다.

이와 함께, 판독관 피드백을 반영하는 전문판독관 참여형(Human-In-the-Loop) 학습 모델을 바탕으로 한 약한 지도학습(weakly supervised learning) 기법도 적용한다. 판독관의 판단 근거를 효과적으로 추출하여 인공지능의 시각적인 설명성을 개선하고 위성영상 분석의 신뢰도를 높이기 위해서다.

또한, 윤 교수 연구팀은 위성 탑재가 가능한 인공지능 처리용 하드웨어 보드를 개발해 대용량의 위성영상 정보를 고속으로 처리하는 기술을 확보했으며, 설명가능한 인공지능 모델 처리용 칩인 EPU(Explainable Neuro-Processing Unit)를 구현하는 연구도 진행 중이다.

이뿐만 아니라, 세계 최고 수준의 위성영상 해상도 향상 기술을 보유하고 있는 김문철 교수 연구팀에서는 SAR 위성 영상의 해상도를 2배 이상 향상할 수 있는 기술 개발로 협력한다.

KAIST와 함께 공동 연구에 참여하는 KAI는 초소형위성, 중대형위성, 발사체 등 우주 제조 분야 주도한 경험을 바탕으로 고부가가치 위성 서비스 분야까지 다각화를 추진하는 중이며, 이번 연구 협력을 통해 설명가능한 인공지능 기반 초소형위성용 SAR 영상처리기술을 공동연구한다.

또한, 국내 지구관측 위성 운영 전문기업인 ㈜I-OPS는 천리안위성, 다목적실용위성(아리랑 2/3/5호) 등 다양한 국내 위성의 운영 및 관제 경험 및 축적 기술을 활용해 위성에서 수집되는 데이터의 시계열 분석 분야에서 협업한다.

대덕연구단지 벤처기업인 ㈜FISYS, ㈜모두텍, ㈜유니인포 등은 각각 인공지능 연산처리를 위한 최적의 하드웨어 설계·제작 기술 및 대규모 데이터 분석·관리를 위한 인공지능 가속 시스템 기술을 공동으로 개발할 계획이다.윤찬현 KAIST 전기및전자공학부 교수는 "뉴 스페이스시대에 수많은 초소형위성들로부터 초대규모 데이터가 수집되는 상황에서 인공지능을 활용한 지능형 데이터 분석 기술은 필수적이다"라고 강조했다. 이어, 윤 교수는 "저해상도 SAR 영상 분석의 모호성을 해결할 수 있는 영상 품질 향상과 설명가능하고 신뢰성 있는 인공지능의 핵심기술을 확보하는 성공적인 연구 개발 협력이 되길 기대한다"라고 밝혔다.

2022.07.25

조회수 3711

-

한컴인스페이스와 지구관측 위성 영상 분석 인공지능 기술 협력

우리 대학 전기및전자공학부 김문철 교수 연구팀이 지난 5월 26일 국내 최초 민간 초소형 위성인 세종 1호를 발사한 한글과컴퓨터그룹의 계열사인 한컴인스페이스(대표이사 최명진)와 위성 영상정보제공 서비스 향상을 위한 협력 연구체계를 구축하는 협약을 19일 체결했다.

전기및전자공학부 김문철 교수는 세계 최고 수준의 위성 영상 해상도 향상(초해상화)기술을 보유하고 있어, 한컴인스페이스와 기술협력체계를 구축하고 세종 1호의 해상도를 2배 이상 향상할 수 있는 기술 개발에 착수한다.

민간 초소형 위성인 세종 1호 위성은 5m 해상도의 다중밴드 위성으로 농업, 산림 등 다양한 분야에서 위성영상 및 분석정보를 제공할 수 있다. 한컴인스페이스는 더 나아가 고화질 영상정보가 필요한 응용을 위해 인공지능 기술로 영상의 해상도 품질을 향상시킨다.

초해상화 기술은 영상정보를 촬영하는 플랫폼의 하드웨어적 한계를 극복하고 컴퓨터비전, 인공지능 기술을 이용해 원본영상의 품질을 향상할 수 있는 기술이다. 해외의 대표적인 상업위성정보 서비스 업체인 `플래닛 랩스(Planet Labs)'는 다수의 초소형 위성을 운영하고 있으며, 초소형 위성의 한계로 제한된 관측정보의 해상도 향상을 위해 초해상화 기술을 적용해 서비스 중이다.

최명진 한컴인스페이스 대표는 "이번 기술협력은 세종 1호 뿐만 아니라 향후 발사 예정인 후속 위성의 영상 품질이 향상될 것ˮ이라며 "이를 통해 최초 사업 목표였던 농림, 산림분야 뿐만 아니라, 초고해상도의 위성정보가 필요한 다양한 사용자를 대상으로 서비스영역을 확장할 예정ˮ이라고 밝혔다. 또한 "김문철 교수가 보유한 최고 수준의 전천후 관측 영상 레이더(이하 SAR) 위성영상 객체 탐지 분석 기술을 적용해 민간뿐만 아니라 군의 수요를 만족할 수 있는 다종영상정보의 분석, 서비스 체계의 완비를 목표로 한다ˮ고 강조했다.

김문철 교수는 "지난 6월 누리호 발사 성공으로 향후 많은 초소형 위성들이 우리 기술로 발사돼 지구궤도를 돌며 엄청난 양의 지상 영상 정보를 획득할 것ˮ이라며 "이번 기술협력을 통해 지금까지 연구해왔던 세계 최고 수준의 위성 영상 초해상도 및 SAR 영상 분석을 위한 인공지능 기술 등을 상용화하는 데 최선을 다할 것ˮ이라고 밝혔다. 또한 “최근 우리나라 인접국들에서 위성 광학/SAR 영상 분석 관련 인공지능 기술들이 매우 빠른 속도로 개발되고 있고, 우리나라는 이들 국가를 능가하는 세계 최고 수준의 기술 개발을 통해 지피지기(知彼知己)할 수 있는 능력을 확보해 주변국들의 위협에 대비할 수 있는 힘을 키워야 한다ˮ고 강조했다.

김문철 교수는 세계 최고 인공지능/컴퓨터비전 국제학술대회인 국제 컴퓨터비전 및 패턴인식 학술대회(CVPR) 및 국제 컴퓨터비전 학회(ICCV)의 메인 프로그램에서 약 3% 내외 수준에서 선별하는 우수 구두 논문으로 발표된 위성 및 자연 영상 영상 초해상화 기술들을 보유하고 있으며, SAR 영상 표적 탐지 및 식별을 위한 딥러닝 기술, SAR 영상 표적 자세 추정 딥러닝 기술, SAR 영상을 광학 영상으로 변환하는 딥러닝 기술 등을 해당 분야 최고 국제 저널에 관련 연구성과들을 발표해 오고 있어 기술력을 인정받고 있다.

한컴인스페이스와 지구관측 위성 영상 분석 인공지능 기술 협력

우리 대학 전기및전자공학부 김문철 교수 연구팀이 지난 5월 26일 국내 최초 민간 초소형 위성인 세종 1호를 발사한 한글과컴퓨터그룹의 계열사인 한컴인스페이스(대표이사 최명진)와 위성 영상정보제공 서비스 향상을 위한 협력 연구체계를 구축하는 협약을 19일 체결했다.

전기및전자공학부 김문철 교수는 세계 최고 수준의 위성 영상 해상도 향상(초해상화)기술을 보유하고 있어, 한컴인스페이스와 기술협력체계를 구축하고 세종 1호의 해상도를 2배 이상 향상할 수 있는 기술 개발에 착수한다.

민간 초소형 위성인 세종 1호 위성은 5m 해상도의 다중밴드 위성으로 농업, 산림 등 다양한 분야에서 위성영상 및 분석정보를 제공할 수 있다. 한컴인스페이스는 더 나아가 고화질 영상정보가 필요한 응용을 위해 인공지능 기술로 영상의 해상도 품질을 향상시킨다.

초해상화 기술은 영상정보를 촬영하는 플랫폼의 하드웨어적 한계를 극복하고 컴퓨터비전, 인공지능 기술을 이용해 원본영상의 품질을 향상할 수 있는 기술이다. 해외의 대표적인 상업위성정보 서비스 업체인 `플래닛 랩스(Planet Labs)'는 다수의 초소형 위성을 운영하고 있으며, 초소형 위성의 한계로 제한된 관측정보의 해상도 향상을 위해 초해상화 기술을 적용해 서비스 중이다.

최명진 한컴인스페이스 대표는 "이번 기술협력은 세종 1호 뿐만 아니라 향후 발사 예정인 후속 위성의 영상 품질이 향상될 것ˮ이라며 "이를 통해 최초 사업 목표였던 농림, 산림분야 뿐만 아니라, 초고해상도의 위성정보가 필요한 다양한 사용자를 대상으로 서비스영역을 확장할 예정ˮ이라고 밝혔다. 또한 "김문철 교수가 보유한 최고 수준의 전천후 관측 영상 레이더(이하 SAR) 위성영상 객체 탐지 분석 기술을 적용해 민간뿐만 아니라 군의 수요를 만족할 수 있는 다종영상정보의 분석, 서비스 체계의 완비를 목표로 한다ˮ고 강조했다.

김문철 교수는 "지난 6월 누리호 발사 성공으로 향후 많은 초소형 위성들이 우리 기술로 발사돼 지구궤도를 돌며 엄청난 양의 지상 영상 정보를 획득할 것ˮ이라며 "이번 기술협력을 통해 지금까지 연구해왔던 세계 최고 수준의 위성 영상 초해상도 및 SAR 영상 분석을 위한 인공지능 기술 등을 상용화하는 데 최선을 다할 것ˮ이라고 밝혔다. 또한 “최근 우리나라 인접국들에서 위성 광학/SAR 영상 분석 관련 인공지능 기술들이 매우 빠른 속도로 개발되고 있고, 우리나라는 이들 국가를 능가하는 세계 최고 수준의 기술 개발을 통해 지피지기(知彼知己)할 수 있는 능력을 확보해 주변국들의 위협에 대비할 수 있는 힘을 키워야 한다ˮ고 강조했다.

김문철 교수는 세계 최고 인공지능/컴퓨터비전 국제학술대회인 국제 컴퓨터비전 및 패턴인식 학술대회(CVPR) 및 국제 컴퓨터비전 학회(ICCV)의 메인 프로그램에서 약 3% 내외 수준에서 선별하는 우수 구두 논문으로 발표된 위성 및 자연 영상 영상 초해상화 기술들을 보유하고 있으며, SAR 영상 표적 탐지 및 식별을 위한 딥러닝 기술, SAR 영상 표적 자세 추정 딥러닝 기술, SAR 영상을 광학 영상으로 변환하는 딥러닝 기술 등을 해당 분야 최고 국제 저널에 관련 연구성과들을 발표해 오고 있어 기술력을 인정받고 있다.

2022.07.21

조회수 3993

-

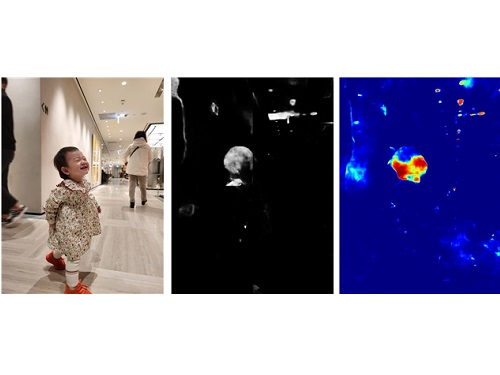

새로운 인공지능 형광 현미경 적용, 뇌 신경세포 등 3차원 고화질 영상기술 개발

우리 대학 김재철 AI 대학원 예종철 교수 연구팀이 서울대학교 장성호 교수팀, 포스텍 김기현 교수팀과 공동연구를 통해 형광 현미경의 오랜 문제인 이방성(Anisotropy)을 해결해, 3차원 영상 화질을 획기적으로 끌어올리는 인공지능 기술을 개발했다고 29일 밝혔다.

이방성 문제란 형광 현미경으로 3차원 영상을 획득하는 데 있어 빛의 성질로 인해 영상 공간 방향 간에 적게는 2~3배, 많게는 10배까지도 화질 차이가 발생하는 문제를 뜻한다. 예를 들면 3차원 영상을 보는 각도마다 화질의 차이가 발생하는 것이다.

연구팀은 수학적 기법인 최적 수송이론 기반을 둔 새로운 인공지능 시스템을 개발해 공초점 현미경과 광 시트 현미경에 적용했다. 기존 인공지능 기법들과는 다르게, 인공지능 학습 데이터가 따로 필요하지 않고, 하나의 3차원 영상만으로도 인공지능 학습에 적용할 수 있다는 점에서 획기적이라 볼 수 있으며, 생물학 연구자들에게 생물 표본의 3차원 고화질 영상 획득에 큰 도움을 줄 것으로 기대된다.

예종철 교수는 "3차원 영상 획득에 있어 극복하기 어려웠던 현미경의 물리적 한계를 인공지능 기술을 통해 뛰어넘었다는 점에서 의미가 있고, 비지도 학습 기반으로 훈련이 진행되기 때문에, 다양한 많은 종류의 3차원 영상 촬영 기법에도 확장 적용 가능하며, 또한 인공지능 연구의 새로운 응용을 개척했다는 데 의미가 있다ˮ 고 말했다.

김재철 AI 대학원의 예종철 교수가 주도하고, 박형준 연구원이 제1 저자로 참여한 이번 연구 결과는 국제 학술지 `네이처 커뮤니케이션스(Nature Communications)' 6월 8일 字 온라인판에 게재됐다.

*논문명 : Deep learning enables reference-free isotropic super-resolution for volumetric fluorescence microscopy

논문 링크: https://www.nature.com/articles/s41467-022-30949-6

새로운 인공지능 형광 현미경 적용, 뇌 신경세포 등 3차원 고화질 영상기술 개발

우리 대학 김재철 AI 대학원 예종철 교수 연구팀이 서울대학교 장성호 교수팀, 포스텍 김기현 교수팀과 공동연구를 통해 형광 현미경의 오랜 문제인 이방성(Anisotropy)을 해결해, 3차원 영상 화질을 획기적으로 끌어올리는 인공지능 기술을 개발했다고 29일 밝혔다.

이방성 문제란 형광 현미경으로 3차원 영상을 획득하는 데 있어 빛의 성질로 인해 영상 공간 방향 간에 적게는 2~3배, 많게는 10배까지도 화질 차이가 발생하는 문제를 뜻한다. 예를 들면 3차원 영상을 보는 각도마다 화질의 차이가 발생하는 것이다.

연구팀은 수학적 기법인 최적 수송이론 기반을 둔 새로운 인공지능 시스템을 개발해 공초점 현미경과 광 시트 현미경에 적용했다. 기존 인공지능 기법들과는 다르게, 인공지능 학습 데이터가 따로 필요하지 않고, 하나의 3차원 영상만으로도 인공지능 학습에 적용할 수 있다는 점에서 획기적이라 볼 수 있으며, 생물학 연구자들에게 생물 표본의 3차원 고화질 영상 획득에 큰 도움을 줄 것으로 기대된다.

예종철 교수는 "3차원 영상 획득에 있어 극복하기 어려웠던 현미경의 물리적 한계를 인공지능 기술을 통해 뛰어넘었다는 점에서 의미가 있고, 비지도 학습 기반으로 훈련이 진행되기 때문에, 다양한 많은 종류의 3차원 영상 촬영 기법에도 확장 적용 가능하며, 또한 인공지능 연구의 새로운 응용을 개척했다는 데 의미가 있다ˮ 고 말했다.

김재철 AI 대학원의 예종철 교수가 주도하고, 박형준 연구원이 제1 저자로 참여한 이번 연구 결과는 국제 학술지 `네이처 커뮤니케이션스(Nature Communications)' 6월 8일 字 온라인판에 게재됐다.

*논문명 : Deep learning enables reference-free isotropic super-resolution for volumetric fluorescence microscopy

논문 링크: https://www.nature.com/articles/s41467-022-30949-6

2022.06.29

조회수 4729

-

인공지능 엔진으로 영상 위변조 탐지 기술 개발

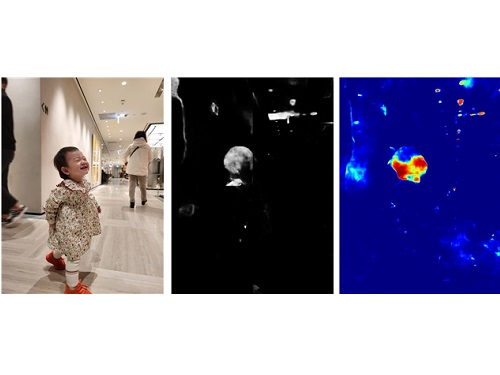

우리 연구진이 영상 내 변형 영역을 더욱 정밀하게 탐지하기 위해 영상내 색상 정보와 주파수 정보를 함께 활용하는 인공지능 엔진 기술을 학계 처음으로 개발했다. 이번 개발 기술은 기존 기술보다 정밀도와 정확도를 크게 높여 위변조 탐지 기술의 기술 유용성을 일정 수준 확보할 수 있는 기반을 제공한다는 점에서 그 의미가 크다. KAIST에서 각종 위변조 영상들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어는 이미지, 영상뿐만 아니라 CCTV 비디오 변형 여부도 분석할 수 있다.

우리 대학 전산학부 이흥규 교수 연구팀이 새로운 인공지능 구조와학습 방법론, 그리고 실험실 환경에서는 구하기 힘든 고급 변형 이미지 영상들을 사용해 영상 이미지 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'의 영상 이미지 정밀도와 정확도를 크게 높일 뿐만 아니라 비디오 편집 변형도 탐지할 수 있는 카이캐치 2.1 버전을 개발했다고 13일 밝혔다.

카이캐치 소프트웨어는 `이상(異常) 유형 분석 엔진'과 `이상(異常) 영역 추정 엔진' 두 개의 인공지능 엔진으로 구성된다. `이상 유형 분석 엔진'은 블러링, 노이즈, 크기 변화, 명암 대비 변화, 모핑, 리샘플링 등을 필수 변이로 정의해 이를 탐지하며 `이상 영역 추정 엔진'은 이미지 짜깁기, 잘라 붙이기, 복사 붙이기, 복사 이동 등을 탐지한다. 이번에 새로 개발한 기술은 `이상 영역 추정 엔진'으로 기존 기술에서는 이상 영역 탐지 시 그레이 스케일(회색조)로 이상 유무를 탐지하였으나 분석 신호의 표현력이 낮고 탐지 오류가 많아 위변조 여부 판정에 어려움이 많았다. 이번에 개발된 기술은 색상 정보와 주파수 정보를 함께 활용해 정밀도(precision)와 재현율(recall)이 크게 향상되고 변형 영역을 컬러 스케일로 표현함으로써 해당 영역의 이상 유무뿐만 아니라 위변조 여부도 더욱 명확하게 판별이 가능해졌다.

연구팀은 이번 연구에서 영상 생성 시 발생하는 흔적과 압축 시 발생하는 흔적 신호들을 함께 분석하기 위해 색상 정보와 주파수 정보를 모두 활용하는 접근 방법을 학계 처음으로 제시했다. 또 이러한 방법론을 설계 구현하기 위해 주파수 정보를 하나의 분할 네트워크에서 직접 입력으로 받아들이는 방식의 ‘압축 왜곡신호 탐지 네트워크(Compression Artifact Tracing Network, 이하 CAT-Net)’을 학계 최초로 개발하고 기존 기법들과 비교해 탐지 성능이 크게 뛰어남을 입증했다. 개발한 기술은 기존에 제시된 기법들과 비교할 때 특히 원본과 변형본을 판별하는 평가 척도인 F1 점수, 평균 정밀도(average precision)에서 대단히 뛰어나 실환경 위변조 탐지 능력이 크게 강화됐다.

비디오 편집 변형의 경우도, 프레임 삭제, 추가 등에 의한 편집 변형이 흔히 CCTV 비디오 등에서 발생한다는데 착안해 이러한 비디오 편집 변형을 탐지하는 기능 역시 이번 카이캐치 2.1 버전에 탑재됐다.

이번에 카이캐치 2.1 소프트웨어를 연구 개발한 이흥규 교수는 "영상 이미지 위변조 소프트웨어인 카이캐치를 휴대폰에 탑재되는 안드로이드 앱 형태로 일반에 소개한 2021년 3월 이후 현재까지 카이캐치 앱을 통한 900여 건의 위변조 분석 의뢰와 개별적으로 60건이 넘는 정밀 위변조 분석 의뢰를 받았다. KAIST 발표 논문 수준이나 실험 결과 등을 감안할 때 위변조 분야 최고 기술로 만든 소프트웨어인데, 오탐지율이 높아 실제 탐지 정밀도가 이론치보다 매우 낮았다. 많은 경우 위변조나 변형 여부에 대한 명확한 기술 판정이 불가능했으나 이번에 개발한 카이캐치 2.1 은 CAT-Net이라는 새로운 네트워크 구조와 학습 방법론, 그리고 ‘색상 및 주파수 영역 왜곡 흔적 동시 분석’이라는 첨단 기술을 사용해 정밀도를 높여, 보다 명확한 판별이 가능하도록 개발됐다. 앞으로 영상 위변조 판단 여부가 어려운 경우가 많이 줄어들기를 기대한다”고 말했다.

이 교수는 이어 "비디오는 MP4 파일 포맷이, 그리고 영상 이미지는 JPEG 이미지들이 일반인들이 널리 사용한다는 점에서 해당 포맷을 주 개발 대상으로 삼았다. 영상 이미지의 경우 영상 편집 변형 시 영상에 남겨지는 인위적으로 발생하는 JPEG 압축 미세 신호 탐지에 주안점을 두어, 위변조 여부와 위변조 영역을 잡아내는 것에 집중했다. 비디오의 경우 특정 프레임들을 삭제하거나 삽입하는 경우, 프레임 부분 편집 후 재압축 하는 경우 등을 탐지한다. 최근 CCTV 비디오 편집 여부에 대한 분쟁이 많아 크게 도움을 줄 수 있을 것으로 기대하며 향후에도 지속적으로 연구 개발해 취약점들을 보완해 나갈 계획이다ˮ 고 덧붙였다.

현재 카이캐치 소프트웨어는 안드로이드 기반 휴대폰의 구글 플레이스토어에서 ‘카이캐치’를 검색하여 앱을 다운로드 받아 설치한 후, 영상 이미지들을 카이캐치에 업로드하면 위변조 여부를 간단하게 테스트해 볼 수 있다.

한편 이번 연구는 제1 저자로 참여한 우리 대학 전기및전자공학부 권명준 박사, 그리고 김창익 교수, 남승훈 박사, 유인재 박사 등과 공동으로 수행됐으며, `스프링거 네이처(Springer Nature)'에서 발간하는 컴퓨터 비전 분야 톱 국제저널인 `국제 컴퓨터 비전 저널(International Journal of Computer Vision, IF 7.410)'에 2022년 5월 25일 字 온라인판에 게재됐다. (논문명 : Learning JPEG Compression Artifacts for Image Manipulation Detection and Localization)

이번 연구는 한국연구재단 창의도전연구기반지원사업지원과 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과의 산학협력 연구로 수행됐다.

인공지능 엔진으로 영상 위변조 탐지 기술 개발

우리 연구진이 영상 내 변형 영역을 더욱 정밀하게 탐지하기 위해 영상내 색상 정보와 주파수 정보를 함께 활용하는 인공지능 엔진 기술을 학계 처음으로 개발했다. 이번 개발 기술은 기존 기술보다 정밀도와 정확도를 크게 높여 위변조 탐지 기술의 기술 유용성을 일정 수준 확보할 수 있는 기반을 제공한다는 점에서 그 의미가 크다. KAIST에서 각종 위변조 영상들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어는 이미지, 영상뿐만 아니라 CCTV 비디오 변형 여부도 분석할 수 있다.

우리 대학 전산학부 이흥규 교수 연구팀이 새로운 인공지능 구조와학습 방법론, 그리고 실험실 환경에서는 구하기 힘든 고급 변형 이미지 영상들을 사용해 영상 이미지 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'의 영상 이미지 정밀도와 정확도를 크게 높일 뿐만 아니라 비디오 편집 변형도 탐지할 수 있는 카이캐치 2.1 버전을 개발했다고 13일 밝혔다.

카이캐치 소프트웨어는 `이상(異常) 유형 분석 엔진'과 `이상(異常) 영역 추정 엔진' 두 개의 인공지능 엔진으로 구성된다. `이상 유형 분석 엔진'은 블러링, 노이즈, 크기 변화, 명암 대비 변화, 모핑, 리샘플링 등을 필수 변이로 정의해 이를 탐지하며 `이상 영역 추정 엔진'은 이미지 짜깁기, 잘라 붙이기, 복사 붙이기, 복사 이동 등을 탐지한다. 이번에 새로 개발한 기술은 `이상 영역 추정 엔진'으로 기존 기술에서는 이상 영역 탐지 시 그레이 스케일(회색조)로 이상 유무를 탐지하였으나 분석 신호의 표현력이 낮고 탐지 오류가 많아 위변조 여부 판정에 어려움이 많았다. 이번에 개발된 기술은 색상 정보와 주파수 정보를 함께 활용해 정밀도(precision)와 재현율(recall)이 크게 향상되고 변형 영역을 컬러 스케일로 표현함으로써 해당 영역의 이상 유무뿐만 아니라 위변조 여부도 더욱 명확하게 판별이 가능해졌다.

연구팀은 이번 연구에서 영상 생성 시 발생하는 흔적과 압축 시 발생하는 흔적 신호들을 함께 분석하기 위해 색상 정보와 주파수 정보를 모두 활용하는 접근 방법을 학계 처음으로 제시했다. 또 이러한 방법론을 설계 구현하기 위해 주파수 정보를 하나의 분할 네트워크에서 직접 입력으로 받아들이는 방식의 ‘압축 왜곡신호 탐지 네트워크(Compression Artifact Tracing Network, 이하 CAT-Net)’을 학계 최초로 개발하고 기존 기법들과 비교해 탐지 성능이 크게 뛰어남을 입증했다. 개발한 기술은 기존에 제시된 기법들과 비교할 때 특히 원본과 변형본을 판별하는 평가 척도인 F1 점수, 평균 정밀도(average precision)에서 대단히 뛰어나 실환경 위변조 탐지 능력이 크게 강화됐다.

비디오 편집 변형의 경우도, 프레임 삭제, 추가 등에 의한 편집 변형이 흔히 CCTV 비디오 등에서 발생한다는데 착안해 이러한 비디오 편집 변형을 탐지하는 기능 역시 이번 카이캐치 2.1 버전에 탑재됐다.

이번에 카이캐치 2.1 소프트웨어를 연구 개발한 이흥규 교수는 "영상 이미지 위변조 소프트웨어인 카이캐치를 휴대폰에 탑재되는 안드로이드 앱 형태로 일반에 소개한 2021년 3월 이후 현재까지 카이캐치 앱을 통한 900여 건의 위변조 분석 의뢰와 개별적으로 60건이 넘는 정밀 위변조 분석 의뢰를 받았다. KAIST 발표 논문 수준이나 실험 결과 등을 감안할 때 위변조 분야 최고 기술로 만든 소프트웨어인데, 오탐지율이 높아 실제 탐지 정밀도가 이론치보다 매우 낮았다. 많은 경우 위변조나 변형 여부에 대한 명확한 기술 판정이 불가능했으나 이번에 개발한 카이캐치 2.1 은 CAT-Net이라는 새로운 네트워크 구조와 학습 방법론, 그리고 ‘색상 및 주파수 영역 왜곡 흔적 동시 분석’이라는 첨단 기술을 사용해 정밀도를 높여, 보다 명확한 판별이 가능하도록 개발됐다. 앞으로 영상 위변조 판단 여부가 어려운 경우가 많이 줄어들기를 기대한다”고 말했다.

이 교수는 이어 "비디오는 MP4 파일 포맷이, 그리고 영상 이미지는 JPEG 이미지들이 일반인들이 널리 사용한다는 점에서 해당 포맷을 주 개발 대상으로 삼았다. 영상 이미지의 경우 영상 편집 변형 시 영상에 남겨지는 인위적으로 발생하는 JPEG 압축 미세 신호 탐지에 주안점을 두어, 위변조 여부와 위변조 영역을 잡아내는 것에 집중했다. 비디오의 경우 특정 프레임들을 삭제하거나 삽입하는 경우, 프레임 부분 편집 후 재압축 하는 경우 등을 탐지한다. 최근 CCTV 비디오 편집 여부에 대한 분쟁이 많아 크게 도움을 줄 수 있을 것으로 기대하며 향후에도 지속적으로 연구 개발해 취약점들을 보완해 나갈 계획이다ˮ 고 덧붙였다.

현재 카이캐치 소프트웨어는 안드로이드 기반 휴대폰의 구글 플레이스토어에서 ‘카이캐치’를 검색하여 앱을 다운로드 받아 설치한 후, 영상 이미지들을 카이캐치에 업로드하면 위변조 여부를 간단하게 테스트해 볼 수 있다.

한편 이번 연구는 제1 저자로 참여한 우리 대학 전기및전자공학부 권명준 박사, 그리고 김창익 교수, 남승훈 박사, 유인재 박사 등과 공동으로 수행됐으며, `스프링거 네이처(Springer Nature)'에서 발간하는 컴퓨터 비전 분야 톱 국제저널인 `국제 컴퓨터 비전 저널(International Journal of Computer Vision, IF 7.410)'에 2022년 5월 25일 字 온라인판에 게재됐다. (논문명 : Learning JPEG Compression Artifacts for Image Manipulation Detection and Localization)

이번 연구는 한국연구재단 창의도전연구기반지원사업지원과 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과의 산학협력 연구로 수행됐다.

2022.06.13

조회수 4990

-

리튬이온전지 충방전 과정을 나노스케일에서 영상화 성공

리튬이온전지는 스마트폰과 전기차 그리고 드론을 비롯한 각종 이동 수단에 필수적인 에너지 저장 매체로 사용되고 있다. 기후변화와 코로나 팬데믹이 키워드가 되는 시대가 도래하면서 급증하는 수요에 대응하기 위해 리튬이온전지의 에너지 용량, 충전 속도 등의 전기화학적 특성을 향상하려는 연구들이 이뤄지고 있지만, 기존의 전기화학 특성 평가 방법으로는 나노미터 수준의 미시세계에서 벌어지고 있는 현상들을 이해하기 어렵다. 따라서, 전기화학 특성에 대한 통합적인 이해를 위해 나노스케일 수준에서 리튬이온의 농도 및 전기전도도 분석 기술의 개발은 필수적이다.

우리 대학 신소재공학과 홍승범 교수 연구팀이 독일의 아헨공과대학교 플로리안 하우센(Florian Hausen) 교수와 독일 뮌스터 대학교 카린 클라이너(Karin Kleiner) 교수와 협업하여 고용량 리튬이온배터리를 충‧방전할 때 리튬이온이 움직이는 모습과 그로 인해서 전자들이 움직이는 전도 경로 그리고 격자들의 움직임을 원자간력 현미경과 엑스레이 회절 및 흡수 패턴을 분석해 영상화하는 데 성공했다고 28일 밝혔다.

홍 교수 연구팀은 원자간력 현미경의 모드 중에서 전기화학적 변형 현미경(Electrochemical Strain Microscopy, 이하 ESM)과 전도성 원자간력 현미경(Conductive Atomic Force Microscopy, 이하 C-AFM)을 활용해, 친환경차 배터리에 적용되는 고용량 양극재인 NCM622 시료의 충방전상태(State of Charge, SOC)에 따른 리튬이온의 나노스케일 분포도를 영상화했으며, 이를 근단엑스선형광분광계(Near Edge X-ray Absorption Fluorescence Spectroscopy, NEXAFS)와 엑스선회절패턴(X-ray Diffraction Pattern, XRD pattern)과 비교 분석해 리튬이온이 양극재에 확산하여 들어갈 때 산소팔면체에 들어가면서 니켈과 산소의 결합이 이온 결합에서 공유결합으로 바뀌면서 전기전도도가 낮아지는 현상을 검증하고, 이를 ESM, C-AFM 영상과 비교하면서 상당한 상관관계가 있음을 밝혀냈다.

교신 저자인 홍승범 교수는 "배터리 소재 내에서 리튬이온의 확산을 영상화하고 이를 통해서 일어나는 현상들을 다중스케일에서 이해하는 것은 향후 신뢰성이 높고 수명이 긴 고속 충‧방전 배터리 소재를 디자인하는 데 있어 매우 중요하다ˮ라며 "향후 신소재 영상화 기술과 머신러닝 기술을 융합하는 것이 20년 걸리던 배터리 소재 개발기간을 5년 이내로 단축할 수 있을 것이다ˮ 라고 말했다.

신소재공학과 알비나 제티바예바(Albina Jetybayeva) 연구원이 제1 저자로 참여한 이번 연구는 국제 학술지 `ACS 어플라이드 에너지 머티리얼스 (ACS Applied Energy Materials)'에 게재됐다. (논문명: Unraveling the State of Charge-Dependent Electronic and Ionic Structure−Property Relationships in NCM622 Cells by Multiscale Characterization)

이번 연구는 KAIST 글로벌 특이점 사업과 한국연구재단의 거대과학연구개발사업의 지원을 받아 수행됐다.

리튬이온전지 충방전 과정을 나노스케일에서 영상화 성공

리튬이온전지는 스마트폰과 전기차 그리고 드론을 비롯한 각종 이동 수단에 필수적인 에너지 저장 매체로 사용되고 있다. 기후변화와 코로나 팬데믹이 키워드가 되는 시대가 도래하면서 급증하는 수요에 대응하기 위해 리튬이온전지의 에너지 용량, 충전 속도 등의 전기화학적 특성을 향상하려는 연구들이 이뤄지고 있지만, 기존의 전기화학 특성 평가 방법으로는 나노미터 수준의 미시세계에서 벌어지고 있는 현상들을 이해하기 어렵다. 따라서, 전기화학 특성에 대한 통합적인 이해를 위해 나노스케일 수준에서 리튬이온의 농도 및 전기전도도 분석 기술의 개발은 필수적이다.

우리 대학 신소재공학과 홍승범 교수 연구팀이 독일의 아헨공과대학교 플로리안 하우센(Florian Hausen) 교수와 독일 뮌스터 대학교 카린 클라이너(Karin Kleiner) 교수와 협업하여 고용량 리튬이온배터리를 충‧방전할 때 리튬이온이 움직이는 모습과 그로 인해서 전자들이 움직이는 전도 경로 그리고 격자들의 움직임을 원자간력 현미경과 엑스레이 회절 및 흡수 패턴을 분석해 영상화하는 데 성공했다고 28일 밝혔다.

홍 교수 연구팀은 원자간력 현미경의 모드 중에서 전기화학적 변형 현미경(Electrochemical Strain Microscopy, 이하 ESM)과 전도성 원자간력 현미경(Conductive Atomic Force Microscopy, 이하 C-AFM)을 활용해, 친환경차 배터리에 적용되는 고용량 양극재인 NCM622 시료의 충방전상태(State of Charge, SOC)에 따른 리튬이온의 나노스케일 분포도를 영상화했으며, 이를 근단엑스선형광분광계(Near Edge X-ray Absorption Fluorescence Spectroscopy, NEXAFS)와 엑스선회절패턴(X-ray Diffraction Pattern, XRD pattern)과 비교 분석해 리튬이온이 양극재에 확산하여 들어갈 때 산소팔면체에 들어가면서 니켈과 산소의 결합이 이온 결합에서 공유결합으로 바뀌면서 전기전도도가 낮아지는 현상을 검증하고, 이를 ESM, C-AFM 영상과 비교하면서 상당한 상관관계가 있음을 밝혀냈다.

교신 저자인 홍승범 교수는 "배터리 소재 내에서 리튬이온의 확산을 영상화하고 이를 통해서 일어나는 현상들을 다중스케일에서 이해하는 것은 향후 신뢰성이 높고 수명이 긴 고속 충‧방전 배터리 소재를 디자인하는 데 있어 매우 중요하다ˮ라며 "향후 신소재 영상화 기술과 머신러닝 기술을 융합하는 것이 20년 걸리던 배터리 소재 개발기간을 5년 이내로 단축할 수 있을 것이다ˮ 라고 말했다.

신소재공학과 알비나 제티바예바(Albina Jetybayeva) 연구원이 제1 저자로 참여한 이번 연구는 국제 학술지 `ACS 어플라이드 에너지 머티리얼스 (ACS Applied Energy Materials)'에 게재됐다. (논문명: Unraveling the State of Charge-Dependent Electronic and Ionic Structure−Property Relationships in NCM622 Cells by Multiscale Characterization)

이번 연구는 KAIST 글로벌 특이점 사업과 한국연구재단의 거대과학연구개발사업의 지원을 받아 수행됐다.

2022.04.29

조회수 6554

-

KAIST-한예종 신입생 영상캠프 성료

우리 대학이 한국예술종합학교(총장 김대진)와의 협력 추진에 박차를 가하고 있다. 올해 1월 한예종과 상호교류 업무협약을 체결한 뒤 첫 번째 시행하는 프로그램으로 ‘KAIST x 한예종 신입생 영상캠프(이하, 영상캠프)’를 추진해 성공적으로 마무리했다.

양교 학생들의 상호교류 및 예술과 기술의 융합 협력 확대를 위해 마련된 이번 영상캠프는 지난달 14일부터 8일간 한국예술종합학교 영상원에서 진행됐다. 각 학교에서 선발된 2022학년도 새내기 34명은 영상 5개 팀, 게임 6개 팀 등 총 11개 팀으로 나뉘어 촬영·편집·음향, 컴퓨터그래픽·스토리텔링·연출·기획 등의 이론 강의와 촬영용 카메라·편집장비·음향·게임 툴을 다루는 기술 강의를 수강했다. 총 49시간으로 구성된 강의를 바탕으로 단편 영화와 간단한 게임을 제작해, 융합예술 및 첨단 콘텐츠에 대한 이해력과 창의력을 높이고 과학과 예술 분야가 함께하는 공동 창작을 입학 전에 체험하는 기회를 가졌다. 행사 후 진행된 설문조사에서 참가자의 97%(매우 그렇다 78.8%, 그렇다 18.2%)가 캠프에서 제공한 이론 및 기술 지식을 매우 긍정적으로 평가했으며, 전원(매우 그렇다 90.9%, 그렇다 9.1%)이 영상캠프를 타인에게 추천할 의향이 있다고 밝혔다.

정재웅 KAIST 새내기과정학부 학생은 “다른 삶을 살아온 친구들의 인생을 잠시나마 나 자신과 겹쳐볼 수 있는 인상적인 경험이었던 만큼, 앞으로 하게 될 다른 많은 일에도 좋은 영감으로 작용할 것 같다”라고 참여 소감을 밝혔다.

또한, 신연수 한국예술종합학교 영상원 학생은 “한예종과 KAIST 모두 자신만의 길을 뚜렷하게 가진 학생들이 준비하는 학교이다 보니 자기가 설정해놓은 방향에 매몰되기 쉬운데, 이번 영상캠프를 통해 생각의 틀을 깨고 더 넓게 볼 수 있는 시각을 얻는 계기가 된 것 같다”라고 전했다.

이번 영상캠프를 총괄한 이승무 한국예술종합학교 아트앤테크놀로지랩(ART & TECHNOLOGY LAB) 소장은 “이번 캠프를 통해 서로 다른 분야의 사람들이 자발적 비전을 공유하고 그것을 함께 즐기며 만들어가는 과정에서 진정한 융합의 씨앗이 생겨남을 확인할 수 있었다”라고 이번 캠프의 의의를 평가했다.

두 학교는 이번 영상캠프의 성료를 바탕으로 매년 신입생들이 참여하는 영상캠프를 개최하는 것은 물론 재학생 대상 프로그램도 빠르면 올해 상반기 중 추진할 예정이다. 신병하 KAIST 학생생활처장은 “KAIST가 초일류 대학으로 한 걸음 더 나아가기 위해서는 과학과 기술에만 몰두하기보다는 인문학, 예술적 소양을 함께 기르고 두 분야를 접목하는 노력과 시도가 필요하다”라며, “이번 영상캠프 뿐만 아니라 한예종과 함께 하는 교류 활동의 폭을 더욱 다양하게 넓혀나갈 계획”라고 밝혔다.

KAIST-한예종 신입생 영상캠프 성료

우리 대학이 한국예술종합학교(총장 김대진)와의 협력 추진에 박차를 가하고 있다. 올해 1월 한예종과 상호교류 업무협약을 체결한 뒤 첫 번째 시행하는 프로그램으로 ‘KAIST x 한예종 신입생 영상캠프(이하, 영상캠프)’를 추진해 성공적으로 마무리했다.

양교 학생들의 상호교류 및 예술과 기술의 융합 협력 확대를 위해 마련된 이번 영상캠프는 지난달 14일부터 8일간 한국예술종합학교 영상원에서 진행됐다. 각 학교에서 선발된 2022학년도 새내기 34명은 영상 5개 팀, 게임 6개 팀 등 총 11개 팀으로 나뉘어 촬영·편집·음향, 컴퓨터그래픽·스토리텔링·연출·기획 등의 이론 강의와 촬영용 카메라·편집장비·음향·게임 툴을 다루는 기술 강의를 수강했다. 총 49시간으로 구성된 강의를 바탕으로 단편 영화와 간단한 게임을 제작해, 융합예술 및 첨단 콘텐츠에 대한 이해력과 창의력을 높이고 과학과 예술 분야가 함께하는 공동 창작을 입학 전에 체험하는 기회를 가졌다. 행사 후 진행된 설문조사에서 참가자의 97%(매우 그렇다 78.8%, 그렇다 18.2%)가 캠프에서 제공한 이론 및 기술 지식을 매우 긍정적으로 평가했으며, 전원(매우 그렇다 90.9%, 그렇다 9.1%)이 영상캠프를 타인에게 추천할 의향이 있다고 밝혔다.

정재웅 KAIST 새내기과정학부 학생은 “다른 삶을 살아온 친구들의 인생을 잠시나마 나 자신과 겹쳐볼 수 있는 인상적인 경험이었던 만큼, 앞으로 하게 될 다른 많은 일에도 좋은 영감으로 작용할 것 같다”라고 참여 소감을 밝혔다.

또한, 신연수 한국예술종합학교 영상원 학생은 “한예종과 KAIST 모두 자신만의 길을 뚜렷하게 가진 학생들이 준비하는 학교이다 보니 자기가 설정해놓은 방향에 매몰되기 쉬운데, 이번 영상캠프를 통해 생각의 틀을 깨고 더 넓게 볼 수 있는 시각을 얻는 계기가 된 것 같다”라고 전했다.

이번 영상캠프를 총괄한 이승무 한국예술종합학교 아트앤테크놀로지랩(ART & TECHNOLOGY LAB) 소장은 “이번 캠프를 통해 서로 다른 분야의 사람들이 자발적 비전을 공유하고 그것을 함께 즐기며 만들어가는 과정에서 진정한 융합의 씨앗이 생겨남을 확인할 수 있었다”라고 이번 캠프의 의의를 평가했다.

두 학교는 이번 영상캠프의 성료를 바탕으로 매년 신입생들이 참여하는 영상캠프를 개최하는 것은 물론 재학생 대상 프로그램도 빠르면 올해 상반기 중 추진할 예정이다. 신병하 KAIST 학생생활처장은 “KAIST가 초일류 대학으로 한 걸음 더 나아가기 위해서는 과학과 기술에만 몰두하기보다는 인문학, 예술적 소양을 함께 기르고 두 분야를 접목하는 노력과 시도가 필요하다”라며, “이번 영상캠프 뿐만 아니라 한예종과 함께 하는 교류 활동의 폭을 더욱 다양하게 넓혀나갈 계획”라고 밝혔다.

2022.03.18

조회수 5682

-

서민준 교수 연구팀, VALUE Challenge 2021 영상검색 트랙 부문 우승

우리 대학 김재철AI대학원 서민준 교수 연구팀(오한석 석사과정)이 마이크로소프트가 주최한 AI 영상 인식 대회(VALUE Challenge 2021, 이하 밸류 챌린지) 영상 검색 트랙(Video Retrieval Track)에서 텐센트, 카카오, 컬럼비아 대학 등 우수한 팀들을 제치고 우승했다. 이 대회에는 영상 AI 분야 스타트업 트웰브랩스(대표 이재성) 이승준 CTO와 함께 참여했다.

이번 밸류 챌린지는 컴퓨터 비전 분야 권위의 학회인 ICCV(International Conference on Computer Vision)의 행사 중 일환으로 진행된 대회로 영상에 대한 인공지능의 이해능력을 평가하는 세계 최초의 비교·평가 대회로, 올해 6월부터 9월까지 진행되었다. 밸류 챌린지에서는 3개의 트랙으로 나뉘어 진행됐다. 이 중 영상 검색 트랙에서는 7만4천 개의 특정 분야에 치우치지 않은 다양한 동영상에 담긴 시각 및 음성 정보를 분석하여, 주어진 문장에 해당되는 영상 내 구간을 정확하게 빨리 찾는 것이 평가 기준이었다.

서민준 교수 연구팀과 트웰브랩스는 시각 정보에 특화된 기존의 영상검색 기술에서 진일보하여 음성과 시간의 흐름 등의 다양한 정보까지 종합적으로 인식할 수 있도록 AI 모델을 학습하여 인식률을 극대화하였다. 또한 다양한 유형의 콘텐츠를 이해할 수 있는 하나의 AI 모델을 독자적으로 개발하여 기술의 범용성을 입증하였다. 특히 마이크로소프트가 기록한 역대 최고 정확도를 앞질렀을 뿐만 아니라, 세계적인 기술 기업인 텐센트 및 카카오브레인과 미국 컬럼비아 대학 연구팀 등을 제치고 전 세계 1위를 차지했다.

위 상을 수상한 서민준 교수는 “자연어 처리 및 문서검색 분야에서 활용되는 최신 기술을 비디오 검색에 응용하고, 클라우드 컴퓨팅을 통한 대규모 실험으로 정확성과 속도를 극대로 끌어 올릴 수 있었다”며, “미디어의 홍수 속에서 유저가 원하는 비디오를 정확하게 찾아주는 제품을 만드는데 기여하길 바란다”고 밝혔다.

서민준 교수 연구팀, VALUE Challenge 2021 영상검색 트랙 부문 우승

우리 대학 김재철AI대학원 서민준 교수 연구팀(오한석 석사과정)이 마이크로소프트가 주최한 AI 영상 인식 대회(VALUE Challenge 2021, 이하 밸류 챌린지) 영상 검색 트랙(Video Retrieval Track)에서 텐센트, 카카오, 컬럼비아 대학 등 우수한 팀들을 제치고 우승했다. 이 대회에는 영상 AI 분야 스타트업 트웰브랩스(대표 이재성) 이승준 CTO와 함께 참여했다.

이번 밸류 챌린지는 컴퓨터 비전 분야 권위의 학회인 ICCV(International Conference on Computer Vision)의 행사 중 일환으로 진행된 대회로 영상에 대한 인공지능의 이해능력을 평가하는 세계 최초의 비교·평가 대회로, 올해 6월부터 9월까지 진행되었다. 밸류 챌린지에서는 3개의 트랙으로 나뉘어 진행됐다. 이 중 영상 검색 트랙에서는 7만4천 개의 특정 분야에 치우치지 않은 다양한 동영상에 담긴 시각 및 음성 정보를 분석하여, 주어진 문장에 해당되는 영상 내 구간을 정확하게 빨리 찾는 것이 평가 기준이었다.

서민준 교수 연구팀과 트웰브랩스는 시각 정보에 특화된 기존의 영상검색 기술에서 진일보하여 음성과 시간의 흐름 등의 다양한 정보까지 종합적으로 인식할 수 있도록 AI 모델을 학습하여 인식률을 극대화하였다. 또한 다양한 유형의 콘텐츠를 이해할 수 있는 하나의 AI 모델을 독자적으로 개발하여 기술의 범용성을 입증하였다. 특히 마이크로소프트가 기록한 역대 최고 정확도를 앞질렀을 뿐만 아니라, 세계적인 기술 기업인 텐센트 및 카카오브레인과 미국 컬럼비아 대학 연구팀 등을 제치고 전 세계 1위를 차지했다.

위 상을 수상한 서민준 교수는 “자연어 처리 및 문서검색 분야에서 활용되는 최신 기술을 비디오 검색에 응용하고, 클라우드 컴퓨팅을 통한 대규모 실험으로 정확성과 속도를 극대로 끌어 올릴 수 있었다”며, “미디어의 홍수 속에서 유저가 원하는 비디오를 정확하게 찾아주는 제품을 만드는데 기여하길 바란다”고 밝혔다.

2021.10.20

조회수 5331

-

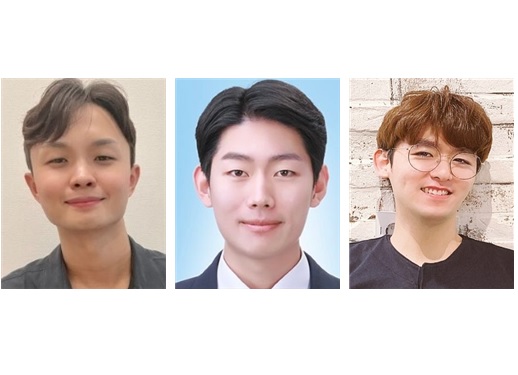

전기및전자공학부 윤영규 교수팀, 국제의료영상처리학회 젊은과학자상 수상

우리 대학 전기및전자공학부 윤영규 교수팀이 2021년 국제의료영상처리학회(MICCAI)로부터 젊은 과학자 상(Young Scientist Award) 수상자로 선정되었다고 8일 밝혔다.

젊은 과학자 상(Young Scientist Award)은 의료영상처리 분야 저명 국제 학술대회인 국제의료영상학회에 출판된 논문 중 학생 혹은 박사 학위를 받은 지 2년 이내의 주저자에 의해 작성된 가장 우수한 논문에 주어지는 상으로 우리나라에서 이 상을 받기는 처음이다.

전기및전자공학부 신창엽 학생(現 석사과정 학생)과 전기및전자공학부 류현 학생(現 학사과정 학생)이 공동 제1 저자, 전기및전자공학부 조은서 학생(現 박사과정 학생)이 공저자로 저술한 아래 논문으로 상을 수상했다.

“RLP-Net: A Recursive Light Propagation Network for 3-D Virtual Refocusing,”International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2021.

이 논문은 두 장의 현미경 이미지만 활용해 3차원 영상을 복원하는 가상 재초점 기술에 관한 것으로, 빛의 전파 과정이 공간적 불변성을 가지는 점에 착안해 빛의 전파 함수를 재귀적 신경망을 활용해 근사함으로써 정확한 가상 재초점이 가능함을 보였다.

시상식은 COVID19 상황으로 인해 가상으로 진행된 2021 MICCAI 학술대회에서 지난 9월 30일 진행됐으며, 수상자 리스트는 영구적으로 MICCAI 학술회 홈페이지에 게시될 예정이다.

전기및전자공학부 윤영규 교수팀, 국제의료영상처리학회 젊은과학자상 수상

우리 대학 전기및전자공학부 윤영규 교수팀이 2021년 국제의료영상처리학회(MICCAI)로부터 젊은 과학자 상(Young Scientist Award) 수상자로 선정되었다고 8일 밝혔다.

젊은 과학자 상(Young Scientist Award)은 의료영상처리 분야 저명 국제 학술대회인 국제의료영상학회에 출판된 논문 중 학생 혹은 박사 학위를 받은 지 2년 이내의 주저자에 의해 작성된 가장 우수한 논문에 주어지는 상으로 우리나라에서 이 상을 받기는 처음이다.

전기및전자공학부 신창엽 학생(現 석사과정 학생)과 전기및전자공학부 류현 학생(現 학사과정 학생)이 공동 제1 저자, 전기및전자공학부 조은서 학생(現 박사과정 학생)이 공저자로 저술한 아래 논문으로 상을 수상했다.

“RLP-Net: A Recursive Light Propagation Network for 3-D Virtual Refocusing,”International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2021.

이 논문은 두 장의 현미경 이미지만 활용해 3차원 영상을 복원하는 가상 재초점 기술에 관한 것으로, 빛의 전파 과정이 공간적 불변성을 가지는 점에 착안해 빛의 전파 함수를 재귀적 신경망을 활용해 근사함으로써 정확한 가상 재초점이 가능함을 보였다.

시상식은 COVID19 상황으로 인해 가상으로 진행된 2021 MICCAI 학술대회에서 지난 9월 30일 진행됐으며, 수상자 리스트는 영구적으로 MICCAI 학술회 홈페이지에 게시될 예정이다.

2021.10.08

조회수 5873

-

KBS와 함께 뉴스 영상 인공지능 데이터베이스와 한국형 메타데이터 구축한다

우리 대학은 KBS(사장 양승동)와 함께 한국형 보도영상 인공지능(AI) 데이터베이스와 메타데이터 구축에 나선다고 20일 밝혔다.

문화기술대학원 박주용(과제총괄책임), 이원재, 노준용 교수 연구팀이 주도하는 컨소시엄은 인공지능을 이용해 영상 정보 추출과 편집을 손쉽게 하는 기술 개발에 착수했다. 이와 함께 수행기관인 KBS가 보유한 방대한 뉴스 영상 데이터를 결합해 포스트 코로나 시대 인공지능 기반 영상 콘텐츠 산업 창출에 적극적으로 나설 계획이라고 밝혔다.

현재 인공지능은 질병 진단과 자율운전 등 인간의 기계적인 움직임과 판단력을 보완하는 영역을 벗어나 미디어 콘텐츠 제작과 같은 창의적 분야까지 급속히 확장하고 있다. 하지만 비전문가 누구라도 말을 통해 손쉽게 콘텐츠를 만들고 편집할 수 있게 하는 인공지능 기술은 아직 많은 발전이 필요하며 우리나라에서는 특히 한국어 기반 데이터 세트의 부족이 큰 걸림돌이 되고 있다고 전문가들은 입을 모으고 있다.

우리 대학은 KBS와 함께 인공지능 모델 학습을 위한 고품질의 영상 데이터를 구축하고 ‘한국형 뉴스 영상 메타데이터 표준 모델’ 개발을 목표로 하고 있다. 메타데이터 기반 공공개방형 뉴스 아카이브 분야는 현재 미국의 AP와 영국의 BBC가 주도하고 있는데, 박주용 교수는 “이 프로젝트를 통해 저작권 문제와 범용성 메타데이터의 부족으로 연구 개발에 어려움을 겪던 연구자들과 관련 스타트업들의 숨통이 트일 것으로 기대한다”며 “더 나아가 한국형 콘텐츠 플랫폼의 틀을 다지게 될 것”이라고 밝혔다.

과기정통부(장관 임혜숙)와 한국지능정보사회진흥원(원장 문용식)의 `2021년도 인공지능 학습용 데이터 구축' 사업 예산 및 KAIST가 주도하는 컨소시엄의 민간투자금 등 모두 42억 원의 재원으로 운용되는 이 과제는 우리 대학 문화기술대학원이 주관하고 KBS, 메트릭스리서치(대표 나윤정), 액션파워(공동대표 조홍식/이지화), 소리자바(대표이사 안상현), 데이터메이커(대표이사 김태헌), 미소정보기술(대표이사 안동욱), 인터마인즈(대표이사 김종진)가 공동연구기관으로 참여한다. 이 프로젝트에서 개발되는 데이터베이스, 인공지능 학습모델, 프로그래밍 코드 등 모든 연구 결과는 공공재이기 때문에 누구나 연구와 사업에 사용할 수 있다.

KBS와 함께 뉴스 영상 인공지능 데이터베이스와 한국형 메타데이터 구축한다

우리 대학은 KBS(사장 양승동)와 함께 한국형 보도영상 인공지능(AI) 데이터베이스와 메타데이터 구축에 나선다고 20일 밝혔다.

문화기술대학원 박주용(과제총괄책임), 이원재, 노준용 교수 연구팀이 주도하는 컨소시엄은 인공지능을 이용해 영상 정보 추출과 편집을 손쉽게 하는 기술 개발에 착수했다. 이와 함께 수행기관인 KBS가 보유한 방대한 뉴스 영상 데이터를 결합해 포스트 코로나 시대 인공지능 기반 영상 콘텐츠 산업 창출에 적극적으로 나설 계획이라고 밝혔다.

현재 인공지능은 질병 진단과 자율운전 등 인간의 기계적인 움직임과 판단력을 보완하는 영역을 벗어나 미디어 콘텐츠 제작과 같은 창의적 분야까지 급속히 확장하고 있다. 하지만 비전문가 누구라도 말을 통해 손쉽게 콘텐츠를 만들고 편집할 수 있게 하는 인공지능 기술은 아직 많은 발전이 필요하며 우리나라에서는 특히 한국어 기반 데이터 세트의 부족이 큰 걸림돌이 되고 있다고 전문가들은 입을 모으고 있다.

우리 대학은 KBS와 함께 인공지능 모델 학습을 위한 고품질의 영상 데이터를 구축하고 ‘한국형 뉴스 영상 메타데이터 표준 모델’ 개발을 목표로 하고 있다. 메타데이터 기반 공공개방형 뉴스 아카이브 분야는 현재 미국의 AP와 영국의 BBC가 주도하고 있는데, 박주용 교수는 “이 프로젝트를 통해 저작권 문제와 범용성 메타데이터의 부족으로 연구 개발에 어려움을 겪던 연구자들과 관련 스타트업들의 숨통이 트일 것으로 기대한다”며 “더 나아가 한국형 콘텐츠 플랫폼의 틀을 다지게 될 것”이라고 밝혔다.

과기정통부(장관 임혜숙)와 한국지능정보사회진흥원(원장 문용식)의 `2021년도 인공지능 학습용 데이터 구축' 사업 예산 및 KAIST가 주도하는 컨소시엄의 민간투자금 등 모두 42억 원의 재원으로 운용되는 이 과제는 우리 대학 문화기술대학원이 주관하고 KBS, 메트릭스리서치(대표 나윤정), 액션파워(공동대표 조홍식/이지화), 소리자바(대표이사 안상현), 데이터메이커(대표이사 김태헌), 미소정보기술(대표이사 안동욱), 인터마인즈(대표이사 김종진)가 공동연구기관으로 참여한다. 이 프로젝트에서 개발되는 데이터베이스, 인공지능 학습모델, 프로그래밍 코드 등 모든 연구 결과는 공공재이기 때문에 누구나 연구와 사업에 사용할 수 있다.

2021.07.20

조회수 6833

-

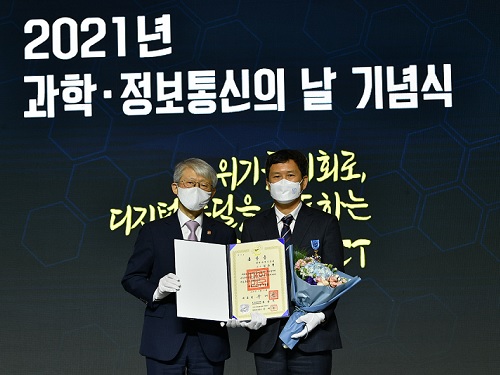

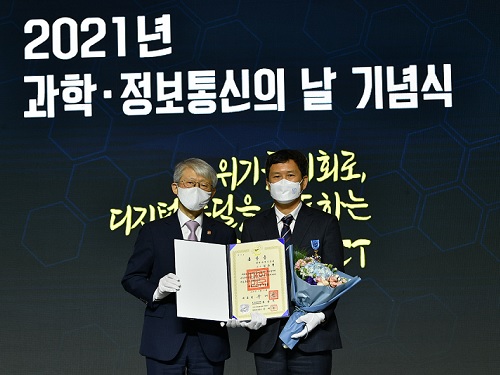

물리학과 김용현 교수, 과학의 날 과학기술 훈장 (진보장) 수상

우리 대학 물리학과 김용현 교수가 21일 서울 중구 동대문디자인플라자에서 열린 '2021년 과학정보통신의 날 기념식'에서 과학기술 훈장 진보장을 수상했다.

과학기술정보통신부, 방송통신위원회, 한국정보방송통신대연합(ICT대연합), 한국과학기술단체총연합회(과총)이 주관하는 이 행사는 과학기술·정보통신 진흥 및 국가연구개발 성과평가 유공자에 대한 정부포상을 통해 명예를 진작하고, 과학기술과 정보통신을 기반으로 '회복·포용·도약'의 시간을 만들어 가겠다는 의지를 다지는 자리로 마련됐다.

이날 행사는 사회적 거리두기 방침에 따라 과학기술·정보통신 진흥 및 국가연구개발 성과평가 유공자 151명 중 대표 수상자 37명이 현장에서 시상하는 방식으로 진행됐다.

우리 대학 입학처장이기도 한 물리학과 김용현 교수는 수소저장, 연료전지 촉매, 열전영상, 양자점 등 신재생에너지분야 기초이론 확립과 기술개발에 기여한 공로를 인정받아 훈장을 수상했다.

최기영 과기정통부 장관은 "어려운 여건 속에서도 과학기술과 정보통신 발전에 크게 기여하신 유공자 여러분께 존경하는 마음을 담아 진심으로 축하드린다"면서 대한민국의 성장은 과학기술과 정보통신의 발전과 함께 해온 만큼 과학기술과 정보통신 역량을 총동원해 신산업과 일자리를 창출하고 디지털 전환 시대의 새로운 성장기회를 만들어 나가겠다"고 말했다.

물리학과 김용현 교수, 과학의 날 과학기술 훈장 (진보장) 수상

우리 대학 물리학과 김용현 교수가 21일 서울 중구 동대문디자인플라자에서 열린 '2021년 과학정보통신의 날 기념식'에서 과학기술 훈장 진보장을 수상했다.

과학기술정보통신부, 방송통신위원회, 한국정보방송통신대연합(ICT대연합), 한국과학기술단체총연합회(과총)이 주관하는 이 행사는 과학기술·정보통신 진흥 및 국가연구개발 성과평가 유공자에 대한 정부포상을 통해 명예를 진작하고, 과학기술과 정보통신을 기반으로 '회복·포용·도약'의 시간을 만들어 가겠다는 의지를 다지는 자리로 마련됐다.

이날 행사는 사회적 거리두기 방침에 따라 과학기술·정보통신 진흥 및 국가연구개발 성과평가 유공자 151명 중 대표 수상자 37명이 현장에서 시상하는 방식으로 진행됐다.

우리 대학 입학처장이기도 한 물리학과 김용현 교수는 수소저장, 연료전지 촉매, 열전영상, 양자점 등 신재생에너지분야 기초이론 확립과 기술개발에 기여한 공로를 인정받아 훈장을 수상했다.

최기영 과기정통부 장관은 "어려운 여건 속에서도 과학기술과 정보통신 발전에 크게 기여하신 유공자 여러분께 존경하는 마음을 담아 진심으로 축하드린다"면서 대한민국의 성장은 과학기술과 정보통신의 발전과 함께 해온 만큼 과학기술과 정보통신 역량을 총동원해 신산업과 일자리를 창출하고 디지털 전환 시대의 새로운 성장기회를 만들어 나가겠다"고 말했다.

2021.04.26

조회수 22978

-

신소재 영상화 및 머신러닝을 활용한 미래 개척

우리 대학 신소재공학과 홍승범 교수 연구팀이 KAIST 10대 플래그쉽 분야이자, 글로벌 특이점 과제인 `KAIST 신소재 혁명: M3I3 이니셔티브' 과제의 배경, 역사, 진행 상황 그리고 미래 방향을 제시했다고 31일 밝혔다.

홍 교수 연구팀은 다중스케일 다중모드 영상화 기술과 머신러닝(기계학습) 기법을 융합해서 고차원의 구조-물성 및 공정-구조 상관관계를 도출했다. 그리고 이를 인공지능과 3차원 다중 스케일 프린팅 기술을 활용해서 신소재 디자인부터 시장 진입까지의 기간을 획기적으로 단축할 수 있는 비전과 실행 플랫폼을 제안했다. M3I3 플랫폼은 고용량 에너지 소재 디자인에서 시작해서, 고밀도 메모리 소재, 고성능 자동차/항공 소재에도 응용 가능할 것으로 기대된다.

우리 대학 신소재공학과 홍승범 교수가 제1 저자로, 리오치하오 박사가 제2 저자로 참여하고, 육종민 교수, 변혜령 교수, 양용수 교수, 조은애 교수, 최벽파 교수, 이혁모 교수가 공동 저자로 참여한 이번 연구는 국제 학술지 `에이씨에스 나노(ACS Nano)' 2월 12일 字 온라인 출판됐다. (논문명 : Reducing Time to Discovery: Materials and Molecular Modeling, Imaging, Informatics, and Integration)

역사의 큰 흐름을 결정한 신소재는 시행착오와 도제식의 비결 전수를 통해서 발견 및 개발돼왔다. 각종 무기와 그릇, 그리고 장신구들이 좋은 예다. 광학현미경이 발명되면서 검의 미세구조와 검의 강도 혹은 경도 간의 상관관계를 이해하기 시작했고, 투과전자현미경과 원자간력 현미경의 발명으로 원자 수준의 분해능으로 신소재를 영상화하기 시작했다.

고려청자를 현재 재현하지 못하는 것은 고려 시대의 장인들이 그 비결을 남기지 않았기 때문이라고 우리는 가르치고 있다. 그러나, 미래에는 고려청자의 다중 스케일 구조를 영상화해서 데이터화 하고, 구조를 구현할 수 있는 공정 과정을 머신러닝의 힘을 빌려 역설계한다면, 고려청자를 재현하는 일은 가능할 것으로 보인다.

우리 대학 M3I3 플랫폼은 이처럼 다중 스케일 및 다중 모드 영상화 기술, 데이터 마이닝과 머신러닝, 그리고 다중 스케일 제조 기술을 접목해 미래에 필요한 신소재를 역설계해서 빠르게 공정 레시피를 확보할 수 있게 만들어준다.

이번 논문에서는 M3I3 플랫폼의 유효성을 확인하기 위해 배터리 소재에 적용하는 연구를 진행했다. 고용량 배터리 소재의 개발 기간을 단축할 수 있다는 것을 검증하기 위해서 20년간의 논문 자료를 50여 명의 학생이 읽고 데이터를 추출해 양극재의 에너지 밀도와 소재 조성 간의 상관관계를 도출했다. 그리고 논문에 나와 있는 공정, 측정 및 구조 변수들을 머신러닝 기법을 활용해 모델을 수립한 후, 무작위 조건에서 합성해 모델의 정확도를 측정함으로써 데이터 마이닝과 머신러닝의 우수성을 입증했다.

또한 투과전자현미경(TEM), 주사투과전자현미경(STEM), 원자간력현미경(AFM), 광학현미경 등의 다양한 현미경과 엑스레이(X-ray), 라만(Raman), UV/Visible/IR 등 다양한 분광 장비들을 통해 얻은 영상과 스펙트럼 데이터를 기반으로 다중 스케일 구조↔물성 상관관계를 도출하고, 여러 가지 공정변수 데이터를 수집해, 공정↔구조 상관관계를 수립하는 것이 M3I3 플랫폼의 중요한 핵심이다. 특히, 실험데이터와 시뮬레이션 데이터를 융합하고, 머신러닝으로 생성한 가상의 데이터를 과학적인 기준에 맞춰 유의미한 빅데이터로 만들면, 머신러닝을 활용해 물성→구조→공정으로 연결되는 역설계 알고리즘을 개발하는 것이 가능해지며, 이를 통해 미래에 필요한 물성을 갖는 신소재 공정 레시피를 신속하게 확보할 수 있게 된다.

제1 저자인 홍승범 교수는 "과학은 날카로운 관찰과 정량적 측정에서 시작한 학문이며, 기술의 발전으로 현재는 눈에 보이는 소재의 모양과 구조뿐만 아니라 눈에 보이지 않는 소재의 구조를 볼 수 있는 시대가 왔고, 물성마저 공간과 시간의 함수로 영상화할 수 있는 시대가 도래했다ˮ라며 "신소재 영상화 기술과 머신러닝 기술을 융합하고 3D 프린팅 기술을 다중 스케일 자동 합성 기술로 승화시키게 되면 20년 걸리던 신소재 개발 기간을 5년 이내로 단축할 수 있을 것이다ˮ 라고 말했다.

한편, 이번 연구는 글로벌 특이점 사업의 지원을 받아 수행됐다.

신소재 영상화 및 머신러닝을 활용한 미래 개척

우리 대학 신소재공학과 홍승범 교수 연구팀이 KAIST 10대 플래그쉽 분야이자, 글로벌 특이점 과제인 `KAIST 신소재 혁명: M3I3 이니셔티브' 과제의 배경, 역사, 진행 상황 그리고 미래 방향을 제시했다고 31일 밝혔다.

홍 교수 연구팀은 다중스케일 다중모드 영상화 기술과 머신러닝(기계학습) 기법을 융합해서 고차원의 구조-물성 및 공정-구조 상관관계를 도출했다. 그리고 이를 인공지능과 3차원 다중 스케일 프린팅 기술을 활용해서 신소재 디자인부터 시장 진입까지의 기간을 획기적으로 단축할 수 있는 비전과 실행 플랫폼을 제안했다. M3I3 플랫폼은 고용량 에너지 소재 디자인에서 시작해서, 고밀도 메모리 소재, 고성능 자동차/항공 소재에도 응용 가능할 것으로 기대된다.

우리 대학 신소재공학과 홍승범 교수가 제1 저자로, 리오치하오 박사가 제2 저자로 참여하고, 육종민 교수, 변혜령 교수, 양용수 교수, 조은애 교수, 최벽파 교수, 이혁모 교수가 공동 저자로 참여한 이번 연구는 국제 학술지 `에이씨에스 나노(ACS Nano)' 2월 12일 字 온라인 출판됐다. (논문명 : Reducing Time to Discovery: Materials and Molecular Modeling, Imaging, Informatics, and Integration)

역사의 큰 흐름을 결정한 신소재는 시행착오와 도제식의 비결 전수를 통해서 발견 및 개발돼왔다. 각종 무기와 그릇, 그리고 장신구들이 좋은 예다. 광학현미경이 발명되면서 검의 미세구조와 검의 강도 혹은 경도 간의 상관관계를 이해하기 시작했고, 투과전자현미경과 원자간력 현미경의 발명으로 원자 수준의 분해능으로 신소재를 영상화하기 시작했다.

고려청자를 현재 재현하지 못하는 것은 고려 시대의 장인들이 그 비결을 남기지 않았기 때문이라고 우리는 가르치고 있다. 그러나, 미래에는 고려청자의 다중 스케일 구조를 영상화해서 데이터화 하고, 구조를 구현할 수 있는 공정 과정을 머신러닝의 힘을 빌려 역설계한다면, 고려청자를 재현하는 일은 가능할 것으로 보인다.

우리 대학 M3I3 플랫폼은 이처럼 다중 스케일 및 다중 모드 영상화 기술, 데이터 마이닝과 머신러닝, 그리고 다중 스케일 제조 기술을 접목해 미래에 필요한 신소재를 역설계해서 빠르게 공정 레시피를 확보할 수 있게 만들어준다.

이번 논문에서는 M3I3 플랫폼의 유효성을 확인하기 위해 배터리 소재에 적용하는 연구를 진행했다. 고용량 배터리 소재의 개발 기간을 단축할 수 있다는 것을 검증하기 위해서 20년간의 논문 자료를 50여 명의 학생이 읽고 데이터를 추출해 양극재의 에너지 밀도와 소재 조성 간의 상관관계를 도출했다. 그리고 논문에 나와 있는 공정, 측정 및 구조 변수들을 머신러닝 기법을 활용해 모델을 수립한 후, 무작위 조건에서 합성해 모델의 정확도를 측정함으로써 데이터 마이닝과 머신러닝의 우수성을 입증했다.

또한 투과전자현미경(TEM), 주사투과전자현미경(STEM), 원자간력현미경(AFM), 광학현미경 등의 다양한 현미경과 엑스레이(X-ray), 라만(Raman), UV/Visible/IR 등 다양한 분광 장비들을 통해 얻은 영상과 스펙트럼 데이터를 기반으로 다중 스케일 구조↔물성 상관관계를 도출하고, 여러 가지 공정변수 데이터를 수집해, 공정↔구조 상관관계를 수립하는 것이 M3I3 플랫폼의 중요한 핵심이다. 특히, 실험데이터와 시뮬레이션 데이터를 융합하고, 머신러닝으로 생성한 가상의 데이터를 과학적인 기준에 맞춰 유의미한 빅데이터로 만들면, 머신러닝을 활용해 물성→구조→공정으로 연결되는 역설계 알고리즘을 개발하는 것이 가능해지며, 이를 통해 미래에 필요한 물성을 갖는 신소재 공정 레시피를 신속하게 확보할 수 있게 된다.

제1 저자인 홍승범 교수는 "과학은 날카로운 관찰과 정량적 측정에서 시작한 학문이며, 기술의 발전으로 현재는 눈에 보이는 소재의 모양과 구조뿐만 아니라 눈에 보이지 않는 소재의 구조를 볼 수 있는 시대가 왔고, 물성마저 공간과 시간의 함수로 영상화할 수 있는 시대가 도래했다ˮ라며 "신소재 영상화 기술과 머신러닝 기술을 융합하고 3D 프린팅 기술을 다중 스케일 자동 합성 기술로 승화시키게 되면 20년 걸리던 신소재 개발 기간을 5년 이내로 단축할 수 있을 것이다ˮ 라고 말했다.

한편, 이번 연구는 글로벌 특이점 사업의 지원을 받아 수행됐다.

2021.04.01

조회수 86252

-

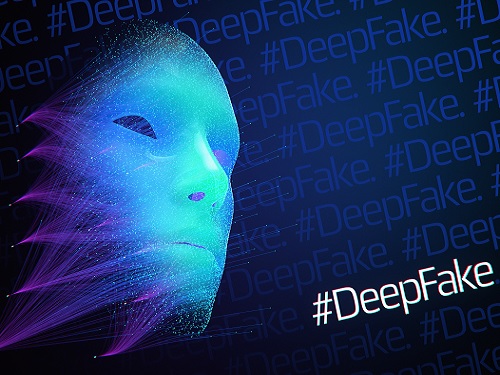

딥페이크 탐지 모바일 앱 서비스 개시

우리 대학 전산학부 이흥규 교수 연구팀이 인공신경망 기반 딥페이크(deepfake) 탐지와 사진 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'를 모바일 앱 형태로 개발해 서비스를 시작한다고 30일 밝혔다. 이는 디지털콘텐츠 위변조 탐지가 필요한 공공기관, 산업계, 언론 및 방송사, 각종 포털 종사자들 및 일반인들도 손쉽게 활용할 수 있을 것으로 기대된다.

이번 모바일 앱 서비스는 본격적으로 일반인들도 손쉽게 디지털콘텐츠 위변조 탐지 기술을 활용할 수 있도록 실용화 단계로 들어섰다는 점에서 의미가 크다. KAIST에서 딥페이크 영상을 포함해 각종 위변조 사진들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어를 모바일 앱 형태로 개발해 서비스를 시작하는데 이러한 유형의 서비스로는 국내 최초다. 구글스토어에서 `카이캐치'를 검색해 앱을 다운로드하면 간단하게 딥페이크 및 이미지 위변조 분석을 할 수 있다.

주로 사람의 얼굴을 대상으로 하는 딥페이크 기술은 얼굴 교체, 얼굴 재현, 얼굴 속성 변환으로 크게 3가지 유형으로 나눌 수 있다. 그중 얼굴 교체와 얼굴 재현은 악의적으로 사용할 때 가짜 뉴스로 사회적 큰 혼란을 일으킬 수 있고 음란물 제작 등에도 악용돼 개인의 인권을 크게 침해할 수 있다. 또한, 얼굴 속성 변환은 영상 증거를 조작하는데 악용될 수 있다.

연구팀이 개발한 기술은 딥페이크 생성 유형에 상관없이 딥페이크 여부를 탐지하기 위해 영상의 미세 변형 신호 흔적과 미세 이상 신호 흔적 탐지 기술을 적용한 신호처리 및 인공지능 기술로 개발됐다. 이러한 핵심 기술들을 사용해, 얼굴 영역의 미세 변형과 코, 입, 얼굴 윤곽 등 얼굴 내 기하학적 왜곡 발생 가능 영역의 이상 신호 흔적을 분석해 딥페이크를 탐지한다.

딥페이크 탐지 기술의 경우, avi 나 mp4 형식의 딥페이크 의심 동영상이 주어지면 개별 프레임으로 자른 뒤 분석하고자 하는 프레임을 이미지로 변환 후 딥페이크 탐지를 수행한다. 동영상 내의 얼굴이 지나치게 작거나(해상도 128×128 이하) 동영상 내 사람 얼굴이 상당 부분 잘린 경우가 아니면 정상적인 탐지가 가능하다. 따라서 동영상의 한 프레임을 잘라 이미지로 만들어 카이캐치 앱에 업로드하면 손쉽게 딥페이크 여부를 확인할 수 있다. 분석 결과는 0에서 100 (%) 값으로 표시되며 숫자가 높을수록 딥페이크일 확률이 높은 것으로 판단한다.

사진 위변조 탐지 기술의 경우도 마찬가지로 카이캐치 앱에 해당 이미지를 업로드하면 위변조 분석 결과를 받아 볼 수 있다. 카이캐치는 BMP, TIF, TIFF, PNG 등 무압축, 무손실 압축을 포함해 50여 개의 표준 양자화 테이블과 1,000여 개가 넘는 비표준화된 양자화 테이블에 기반한 JPEG 이미지들도 모두 처리할 수 있다. 사진 위변조가 의심되는 이미지를 업로드하면 해당 이미지를 분석한 결과를 시각화한 두 장의 분석 이미지를 도출하며, 분석 이미지 내에 위변조가 의심되는 특징들이 포함된 주요 영역들이 다른 주변 영역들과 색상이 크게 다르거나, 또는 주요 영역들에만 다양한 색상들이 혼재해 나타나면 해당 영역이 위변조된 것으로 일반인들도 간단하게 판단할 수 있다.

이번에 개발한 모바일용 위변조 탐지 앱 개발은 국내 최초이자 선진국에서도 찾기 어려운 위변조 탐지 앱 서비스 기술이다. 이흥규 교수는 "카이캐치는 인공지능과 미세 이상 신호 흔적 분석 기법이라는 첨단 기술을 사용해 다양한 유형의 변형에 대응한 범용성을 가지도록 개발됐다”며 "우리가 예측하지 못하거나 모르는 변형 기법을 사용해도 90% 내외의 높은 신뢰도로 탐지한다”고 말했다.

이 교수는 이어 "이번에는 안드로이드 기반의 모바일 환경에서만 동작하는 앱 서비스 기술로 개발됐지만 가까운 기간내 애플 iOS 기반의 앱 출시와 함께, 영어, 중국어, 일어 앱 들도 출시하려고 한다ˮ며 "기존 탐지 기법과는 매우 상이한 기법들을 사용한 위변조 탐지 기술도 실용화해 카이캐치에 추가 탑재 운용함으로써, 탐지가 안 되는 각종 예외 경우들을 대폭 줄이도록 노력하겠다ˮ 고 덧붙였다.

한편 이번 연구는 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과 산학협력 연구로 수행됐다.

딥페이크 탐지 모바일 앱 서비스 개시

우리 대학 전산학부 이흥규 교수 연구팀이 인공신경망 기반 딥페이크(deepfake) 탐지와 사진 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'를 모바일 앱 형태로 개발해 서비스를 시작한다고 30일 밝혔다. 이는 디지털콘텐츠 위변조 탐지가 필요한 공공기관, 산업계, 언론 및 방송사, 각종 포털 종사자들 및 일반인들도 손쉽게 활용할 수 있을 것으로 기대된다.

이번 모바일 앱 서비스는 본격적으로 일반인들도 손쉽게 디지털콘텐츠 위변조 탐지 기술을 활용할 수 있도록 실용화 단계로 들어섰다는 점에서 의미가 크다. KAIST에서 딥페이크 영상을 포함해 각종 위변조 사진들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어를 모바일 앱 형태로 개발해 서비스를 시작하는데 이러한 유형의 서비스로는 국내 최초다. 구글스토어에서 `카이캐치'를 검색해 앱을 다운로드하면 간단하게 딥페이크 및 이미지 위변조 분석을 할 수 있다.

주로 사람의 얼굴을 대상으로 하는 딥페이크 기술은 얼굴 교체, 얼굴 재현, 얼굴 속성 변환으로 크게 3가지 유형으로 나눌 수 있다. 그중 얼굴 교체와 얼굴 재현은 악의적으로 사용할 때 가짜 뉴스로 사회적 큰 혼란을 일으킬 수 있고 음란물 제작 등에도 악용돼 개인의 인권을 크게 침해할 수 있다. 또한, 얼굴 속성 변환은 영상 증거를 조작하는데 악용될 수 있다.

연구팀이 개발한 기술은 딥페이크 생성 유형에 상관없이 딥페이크 여부를 탐지하기 위해 영상의 미세 변형 신호 흔적과 미세 이상 신호 흔적 탐지 기술을 적용한 신호처리 및 인공지능 기술로 개발됐다. 이러한 핵심 기술들을 사용해, 얼굴 영역의 미세 변형과 코, 입, 얼굴 윤곽 등 얼굴 내 기하학적 왜곡 발생 가능 영역의 이상 신호 흔적을 분석해 딥페이크를 탐지한다.

딥페이크 탐지 기술의 경우, avi 나 mp4 형식의 딥페이크 의심 동영상이 주어지면 개별 프레임으로 자른 뒤 분석하고자 하는 프레임을 이미지로 변환 후 딥페이크 탐지를 수행한다. 동영상 내의 얼굴이 지나치게 작거나(해상도 128×128 이하) 동영상 내 사람 얼굴이 상당 부분 잘린 경우가 아니면 정상적인 탐지가 가능하다. 따라서 동영상의 한 프레임을 잘라 이미지로 만들어 카이캐치 앱에 업로드하면 손쉽게 딥페이크 여부를 확인할 수 있다. 분석 결과는 0에서 100 (%) 값으로 표시되며 숫자가 높을수록 딥페이크일 확률이 높은 것으로 판단한다.

사진 위변조 탐지 기술의 경우도 마찬가지로 카이캐치 앱에 해당 이미지를 업로드하면 위변조 분석 결과를 받아 볼 수 있다. 카이캐치는 BMP, TIF, TIFF, PNG 등 무압축, 무손실 압축을 포함해 50여 개의 표준 양자화 테이블과 1,000여 개가 넘는 비표준화된 양자화 테이블에 기반한 JPEG 이미지들도 모두 처리할 수 있다. 사진 위변조가 의심되는 이미지를 업로드하면 해당 이미지를 분석한 결과를 시각화한 두 장의 분석 이미지를 도출하며, 분석 이미지 내에 위변조가 의심되는 특징들이 포함된 주요 영역들이 다른 주변 영역들과 색상이 크게 다르거나, 또는 주요 영역들에만 다양한 색상들이 혼재해 나타나면 해당 영역이 위변조된 것으로 일반인들도 간단하게 판단할 수 있다.

이번에 개발한 모바일용 위변조 탐지 앱 개발은 국내 최초이자 선진국에서도 찾기 어려운 위변조 탐지 앱 서비스 기술이다. 이흥규 교수는 "카이캐치는 인공지능과 미세 이상 신호 흔적 분석 기법이라는 첨단 기술을 사용해 다양한 유형의 변형에 대응한 범용성을 가지도록 개발됐다”며 "우리가 예측하지 못하거나 모르는 변형 기법을 사용해도 90% 내외의 높은 신뢰도로 탐지한다”고 말했다.

이 교수는 이어 "이번에는 안드로이드 기반의 모바일 환경에서만 동작하는 앱 서비스 기술로 개발됐지만 가까운 기간내 애플 iOS 기반의 앱 출시와 함께, 영어, 중국어, 일어 앱 들도 출시하려고 한다ˮ며 "기존 탐지 기법과는 매우 상이한 기법들을 사용한 위변조 탐지 기술도 실용화해 카이캐치에 추가 탑재 운용함으로써, 탐지가 안 되는 각종 예외 경우들을 대폭 줄이도록 노력하겠다ˮ 고 덧붙였다.

한편 이번 연구는 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과 산학협력 연구로 수행됐다.

2021.03.31

조회수 85550

KAI 및 대덕연구단지 벤처기업과 SAR 위성영상 정보 활용 위한 차세대 AI 연구 협력 체결

우리 대학이 SAR* 위성영상 정보 활용을 위한 차세대 AI 연구개발을 위해 한국항공우주산업주식회사(대표이사 안현호, 이하 KAI) 및 대전 지역 소프트웨어 벤처회사들과 업무협력을 추진한다.

☞SAR(Synthetic Aperture Radar, 합성 개구 레이더): 마이크로파를 사용해 영상 정보를 얻는 기술. 구름·안개·눈 등 기상 환경에 따른 제약은 물론 주야간 구분 없이 광범위한 지역의 고화질 영상을 확보할 수 있다.

전기및전자공학부 윤찬현·김문철 교수팀이 참여하는 이번 연구 협력은 설명가능한 인공지능(AI) 기술, 위성탑재형 딥러닝 가속처리 하드웨어(HW) 기술 등을 적용해 고도화된 위성영상 분석 시스템 개발하는 것이 목표다.

이를 위해 KAIST는 KAI, ㈜I-OPS(대표 김영욱) 등의 위성전문기업 및 ㈜FISYS(대표 김종오), ㈜모두텍(대표 박경숙), ㈜유니인포(대표 이동길) 등의 벤처기업과 지난 20일 'SAR 위성영상 분석을 위한 차세대 AI 연구개발에 관한 업무협약'을 체결했다.

지금까지의 위성영상 판독은 지상에 있는 판독관의 분석에 의존하는 방식으로 운영되어왔다. 판독관의 경험과 지식을 바탕으로 자신이 담당하는 주요 지역 위주의 정보를 분석하는 구조다. 그러나 인간이 분석할 수 있는 정보 처리량에는 한계가 있어 판독 대상 외의 위협지역 및 이동하는 표적을 광범위하게 전수조사하는 것은 사실상 불가능했다.

공동 연구팀은 이런 문제점을 극복하기 위해 위성 온보드 시스템에서 설명가능 인공지능(Explainable AI, XAI)을 활용해 데이터를 선별하는 연구를 수행한다. 수백 기가바이트 단위로 수집되는 위성영상 데이터를 정제해 판독관이 분석해야 할 정보량을 압축하고 광역 전수조사가 가능하도록 돕는 기술이다.

일반적인 위성영상은 촬영 시 발생한 잡음, 왜곡, 저해상도 등의 문제로 판독 결과가 불분명한 경우가 빈번하게 발생한다. 윤찬현 교수 연구팀은 주요 시각 특성(Visual Feature)을 학습할 수 있는 주의집중(Attention) 기법을 설명가능한 인공지능에 적용해 판독할 객체 검출 및 인식 성능을 향상하는 기술을 제공한다. 판독관이 위성영상의 시각적·영상 문맥적인 정보를 분석할 수 있도록 지원하는 핵심 시스템 기술이다.

이와 함께, 판독관 피드백을 반영하는 전문판독관 참여형(Human-In-the-Loop) 학습 모델을 바탕으로 한 약한 지도학습(weakly supervised learning) 기법도 적용한다. 판독관의 판단 근거를 효과적으로 추출하여 인공지능의 시각적인 설명성을 개선하고 위성영상 분석의 신뢰도를 높이기 위해서다.

또한, 윤 교수 연구팀은 위성 탑재가 가능한 인공지능 처리용 하드웨어 보드를 개발해 대용량의 위성영상 정보를 고속으로 처리하는 기술을 확보했으며, 설명가능한 인공지능 모델 처리용 칩인 EPU(Explainable Neuro-Processing Unit)를 구현하는 연구도 진행 중이다.

이뿐만 아니라, 세계 최고 수준의 위성영상 해상도 향상 기술을 보유하고 있는 김문철 교수 연구팀에서는 SAR 위성 영상의 해상도를 2배 이상 향상할 수 있는 기술 개발로 협력한다.

KAIST와 함께 공동 연구에 참여하는 KAI는 초소형위성, 중대형위성, 발사체 등 우주 제조 분야 주도한 경험을 바탕으로 고부가가치 위성 서비스 분야까지 다각화를 추진하는 중이며, 이번 연구 협력을 통해 설명가능한 인공지능 기반 초소형위성용 SAR 영상처리기술을 공동연구한다.

또한, 국내 지구관측 위성 운영 전문기업인 ㈜I-OPS는 천리안위성, 다목적실용위성(아리랑 2/3/5호) 등 다양한 국내 위성의 운영 및 관제 경험 및 축적 기술을 활용해 위성에서 수집되는 데이터의 시계열 분석 분야에서 협업한다.

대덕연구단지 벤처기업인 ㈜FISYS, ㈜모두텍, ㈜유니인포 등은 각각 인공지능 연산처리를 위한 최적의 하드웨어 설계·제작 기술 및 대규모 데이터 분석·관리를 위한 인공지능 가속 시스템 기술을 공동으로 개발할 계획이다.윤찬현 KAIST 전기및전자공학부 교수는 "뉴 스페이스시대에 수많은 초소형위성들로부터 초대규모 데이터가 수집되는 상황에서 인공지능을 활용한 지능형 데이터 분석 기술은 필수적이다"라고 강조했다. 이어, 윤 교수는 "저해상도 SAR 영상 분석의 모호성을 해결할 수 있는 영상 품질 향상과 설명가능하고 신뢰성 있는 인공지능의 핵심기술을 확보하는 성공적인 연구 개발 협력이 되길 기대한다"라고 밝혔다.

2022.07.25 조회수 3711

KAI 및 대덕연구단지 벤처기업과 SAR 위성영상 정보 활용 위한 차세대 AI 연구 협력 체결

우리 대학이 SAR* 위성영상 정보 활용을 위한 차세대 AI 연구개발을 위해 한국항공우주산업주식회사(대표이사 안현호, 이하 KAI) 및 대전 지역 소프트웨어 벤처회사들과 업무협력을 추진한다.

☞SAR(Synthetic Aperture Radar, 합성 개구 레이더): 마이크로파를 사용해 영상 정보를 얻는 기술. 구름·안개·눈 등 기상 환경에 따른 제약은 물론 주야간 구분 없이 광범위한 지역의 고화질 영상을 확보할 수 있다.

전기및전자공학부 윤찬현·김문철 교수팀이 참여하는 이번 연구 협력은 설명가능한 인공지능(AI) 기술, 위성탑재형 딥러닝 가속처리 하드웨어(HW) 기술 등을 적용해 고도화된 위성영상 분석 시스템 개발하는 것이 목표다.

이를 위해 KAIST는 KAI, ㈜I-OPS(대표 김영욱) 등의 위성전문기업 및 ㈜FISYS(대표 김종오), ㈜모두텍(대표 박경숙), ㈜유니인포(대표 이동길) 등의 벤처기업과 지난 20일 'SAR 위성영상 분석을 위한 차세대 AI 연구개발에 관한 업무협약'을 체결했다.

지금까지의 위성영상 판독은 지상에 있는 판독관의 분석에 의존하는 방식으로 운영되어왔다. 판독관의 경험과 지식을 바탕으로 자신이 담당하는 주요 지역 위주의 정보를 분석하는 구조다. 그러나 인간이 분석할 수 있는 정보 처리량에는 한계가 있어 판독 대상 외의 위협지역 및 이동하는 표적을 광범위하게 전수조사하는 것은 사실상 불가능했다.

공동 연구팀은 이런 문제점을 극복하기 위해 위성 온보드 시스템에서 설명가능 인공지능(Explainable AI, XAI)을 활용해 데이터를 선별하는 연구를 수행한다. 수백 기가바이트 단위로 수집되는 위성영상 데이터를 정제해 판독관이 분석해야 할 정보량을 압축하고 광역 전수조사가 가능하도록 돕는 기술이다.

일반적인 위성영상은 촬영 시 발생한 잡음, 왜곡, 저해상도 등의 문제로 판독 결과가 불분명한 경우가 빈번하게 발생한다. 윤찬현 교수 연구팀은 주요 시각 특성(Visual Feature)을 학습할 수 있는 주의집중(Attention) 기법을 설명가능한 인공지능에 적용해 판독할 객체 검출 및 인식 성능을 향상하는 기술을 제공한다. 판독관이 위성영상의 시각적·영상 문맥적인 정보를 분석할 수 있도록 지원하는 핵심 시스템 기술이다.

이와 함께, 판독관 피드백을 반영하는 전문판독관 참여형(Human-In-the-Loop) 학습 모델을 바탕으로 한 약한 지도학습(weakly supervised learning) 기법도 적용한다. 판독관의 판단 근거를 효과적으로 추출하여 인공지능의 시각적인 설명성을 개선하고 위성영상 분석의 신뢰도를 높이기 위해서다.

또한, 윤 교수 연구팀은 위성 탑재가 가능한 인공지능 처리용 하드웨어 보드를 개발해 대용량의 위성영상 정보를 고속으로 처리하는 기술을 확보했으며, 설명가능한 인공지능 모델 처리용 칩인 EPU(Explainable Neuro-Processing Unit)를 구현하는 연구도 진행 중이다.

이뿐만 아니라, 세계 최고 수준의 위성영상 해상도 향상 기술을 보유하고 있는 김문철 교수 연구팀에서는 SAR 위성 영상의 해상도를 2배 이상 향상할 수 있는 기술 개발로 협력한다.

KAIST와 함께 공동 연구에 참여하는 KAI는 초소형위성, 중대형위성, 발사체 등 우주 제조 분야 주도한 경험을 바탕으로 고부가가치 위성 서비스 분야까지 다각화를 추진하는 중이며, 이번 연구 협력을 통해 설명가능한 인공지능 기반 초소형위성용 SAR 영상처리기술을 공동연구한다.

또한, 국내 지구관측 위성 운영 전문기업인 ㈜I-OPS는 천리안위성, 다목적실용위성(아리랑 2/3/5호) 등 다양한 국내 위성의 운영 및 관제 경험 및 축적 기술을 활용해 위성에서 수집되는 데이터의 시계열 분석 분야에서 협업한다.

대덕연구단지 벤처기업인 ㈜FISYS, ㈜모두텍, ㈜유니인포 등은 각각 인공지능 연산처리를 위한 최적의 하드웨어 설계·제작 기술 및 대규모 데이터 분석·관리를 위한 인공지능 가속 시스템 기술을 공동으로 개발할 계획이다.윤찬현 KAIST 전기및전자공학부 교수는 "뉴 스페이스시대에 수많은 초소형위성들로부터 초대규모 데이터가 수집되는 상황에서 인공지능을 활용한 지능형 데이터 분석 기술은 필수적이다"라고 강조했다. 이어, 윤 교수는 "저해상도 SAR 영상 분석의 모호성을 해결할 수 있는 영상 품질 향상과 설명가능하고 신뢰성 있는 인공지능의 핵심기술을 확보하는 성공적인 연구 개발 협력이 되길 기대한다"라고 밝혔다.

2022.07.25 조회수 3711 한컴인스페이스와 지구관측 위성 영상 분석 인공지능 기술 협력

우리 대학 전기및전자공학부 김문철 교수 연구팀이 지난 5월 26일 국내 최초 민간 초소형 위성인 세종 1호를 발사한 한글과컴퓨터그룹의 계열사인 한컴인스페이스(대표이사 최명진)와 위성 영상정보제공 서비스 향상을 위한 협력 연구체계를 구축하는 협약을 19일 체결했다.

전기및전자공학부 김문철 교수는 세계 최고 수준의 위성 영상 해상도 향상(초해상화)기술을 보유하고 있어, 한컴인스페이스와 기술협력체계를 구축하고 세종 1호의 해상도를 2배 이상 향상할 수 있는 기술 개발에 착수한다.

민간 초소형 위성인 세종 1호 위성은 5m 해상도의 다중밴드 위성으로 농업, 산림 등 다양한 분야에서 위성영상 및 분석정보를 제공할 수 있다. 한컴인스페이스는 더 나아가 고화질 영상정보가 필요한 응용을 위해 인공지능 기술로 영상의 해상도 품질을 향상시킨다.

초해상화 기술은 영상정보를 촬영하는 플랫폼의 하드웨어적 한계를 극복하고 컴퓨터비전, 인공지능 기술을 이용해 원본영상의 품질을 향상할 수 있는 기술이다. 해외의 대표적인 상업위성정보 서비스 업체인 `플래닛 랩스(Planet Labs)'는 다수의 초소형 위성을 운영하고 있으며, 초소형 위성의 한계로 제한된 관측정보의 해상도 향상을 위해 초해상화 기술을 적용해 서비스 중이다.

최명진 한컴인스페이스 대표는 "이번 기술협력은 세종 1호 뿐만 아니라 향후 발사 예정인 후속 위성의 영상 품질이 향상될 것ˮ이라며 "이를 통해 최초 사업 목표였던 농림, 산림분야 뿐만 아니라, 초고해상도의 위성정보가 필요한 다양한 사용자를 대상으로 서비스영역을 확장할 예정ˮ이라고 밝혔다. 또한 "김문철 교수가 보유한 최고 수준의 전천후 관측 영상 레이더(이하 SAR) 위성영상 객체 탐지 분석 기술을 적용해 민간뿐만 아니라 군의 수요를 만족할 수 있는 다종영상정보의 분석, 서비스 체계의 완비를 목표로 한다ˮ고 강조했다.

김문철 교수는 "지난 6월 누리호 발사 성공으로 향후 많은 초소형 위성들이 우리 기술로 발사돼 지구궤도를 돌며 엄청난 양의 지상 영상 정보를 획득할 것ˮ이라며 "이번 기술협력을 통해 지금까지 연구해왔던 세계 최고 수준의 위성 영상 초해상도 및 SAR 영상 분석을 위한 인공지능 기술 등을 상용화하는 데 최선을 다할 것ˮ이라고 밝혔다. 또한 “최근 우리나라 인접국들에서 위성 광학/SAR 영상 분석 관련 인공지능 기술들이 매우 빠른 속도로 개발되고 있고, 우리나라는 이들 국가를 능가하는 세계 최고 수준의 기술 개발을 통해 지피지기(知彼知己)할 수 있는 능력을 확보해 주변국들의 위협에 대비할 수 있는 힘을 키워야 한다ˮ고 강조했다.

김문철 교수는 세계 최고 인공지능/컴퓨터비전 국제학술대회인 국제 컴퓨터비전 및 패턴인식 학술대회(CVPR) 및 국제 컴퓨터비전 학회(ICCV)의 메인 프로그램에서 약 3% 내외 수준에서 선별하는 우수 구두 논문으로 발표된 위성 및 자연 영상 영상 초해상화 기술들을 보유하고 있으며, SAR 영상 표적 탐지 및 식별을 위한 딥러닝 기술, SAR 영상 표적 자세 추정 딥러닝 기술, SAR 영상을 광학 영상으로 변환하는 딥러닝 기술 등을 해당 분야 최고 국제 저널에 관련 연구성과들을 발표해 오고 있어 기술력을 인정받고 있다.

2022.07.21 조회수 3993

한컴인스페이스와 지구관측 위성 영상 분석 인공지능 기술 협력

우리 대학 전기및전자공학부 김문철 교수 연구팀이 지난 5월 26일 국내 최초 민간 초소형 위성인 세종 1호를 발사한 한글과컴퓨터그룹의 계열사인 한컴인스페이스(대표이사 최명진)와 위성 영상정보제공 서비스 향상을 위한 협력 연구체계를 구축하는 협약을 19일 체결했다.

전기및전자공학부 김문철 교수는 세계 최고 수준의 위성 영상 해상도 향상(초해상화)기술을 보유하고 있어, 한컴인스페이스와 기술협력체계를 구축하고 세종 1호의 해상도를 2배 이상 향상할 수 있는 기술 개발에 착수한다.

민간 초소형 위성인 세종 1호 위성은 5m 해상도의 다중밴드 위성으로 농업, 산림 등 다양한 분야에서 위성영상 및 분석정보를 제공할 수 있다. 한컴인스페이스는 더 나아가 고화질 영상정보가 필요한 응용을 위해 인공지능 기술로 영상의 해상도 품질을 향상시킨다.

초해상화 기술은 영상정보를 촬영하는 플랫폼의 하드웨어적 한계를 극복하고 컴퓨터비전, 인공지능 기술을 이용해 원본영상의 품질을 향상할 수 있는 기술이다. 해외의 대표적인 상업위성정보 서비스 업체인 `플래닛 랩스(Planet Labs)'는 다수의 초소형 위성을 운영하고 있으며, 초소형 위성의 한계로 제한된 관측정보의 해상도 향상을 위해 초해상화 기술을 적용해 서비스 중이다.

최명진 한컴인스페이스 대표는 "이번 기술협력은 세종 1호 뿐만 아니라 향후 발사 예정인 후속 위성의 영상 품질이 향상될 것ˮ이라며 "이를 통해 최초 사업 목표였던 농림, 산림분야 뿐만 아니라, 초고해상도의 위성정보가 필요한 다양한 사용자를 대상으로 서비스영역을 확장할 예정ˮ이라고 밝혔다. 또한 "김문철 교수가 보유한 최고 수준의 전천후 관측 영상 레이더(이하 SAR) 위성영상 객체 탐지 분석 기술을 적용해 민간뿐만 아니라 군의 수요를 만족할 수 있는 다종영상정보의 분석, 서비스 체계의 완비를 목표로 한다ˮ고 강조했다.

김문철 교수는 "지난 6월 누리호 발사 성공으로 향후 많은 초소형 위성들이 우리 기술로 발사돼 지구궤도를 돌며 엄청난 양의 지상 영상 정보를 획득할 것ˮ이라며 "이번 기술협력을 통해 지금까지 연구해왔던 세계 최고 수준의 위성 영상 초해상도 및 SAR 영상 분석을 위한 인공지능 기술 등을 상용화하는 데 최선을 다할 것ˮ이라고 밝혔다. 또한 “최근 우리나라 인접국들에서 위성 광학/SAR 영상 분석 관련 인공지능 기술들이 매우 빠른 속도로 개발되고 있고, 우리나라는 이들 국가를 능가하는 세계 최고 수준의 기술 개발을 통해 지피지기(知彼知己)할 수 있는 능력을 확보해 주변국들의 위협에 대비할 수 있는 힘을 키워야 한다ˮ고 강조했다.

김문철 교수는 세계 최고 인공지능/컴퓨터비전 국제학술대회인 국제 컴퓨터비전 및 패턴인식 학술대회(CVPR) 및 국제 컴퓨터비전 학회(ICCV)의 메인 프로그램에서 약 3% 내외 수준에서 선별하는 우수 구두 논문으로 발표된 위성 및 자연 영상 영상 초해상화 기술들을 보유하고 있으며, SAR 영상 표적 탐지 및 식별을 위한 딥러닝 기술, SAR 영상 표적 자세 추정 딥러닝 기술, SAR 영상을 광학 영상으로 변환하는 딥러닝 기술 등을 해당 분야 최고 국제 저널에 관련 연구성과들을 발표해 오고 있어 기술력을 인정받고 있다.

2022.07.21 조회수 3993 새로운 인공지능 형광 현미경 적용, 뇌 신경세포 등 3차원 고화질 영상기술 개발

우리 대학 김재철 AI 대학원 예종철 교수 연구팀이 서울대학교 장성호 교수팀, 포스텍 김기현 교수팀과 공동연구를 통해 형광 현미경의 오랜 문제인 이방성(Anisotropy)을 해결해, 3차원 영상 화질을 획기적으로 끌어올리는 인공지능 기술을 개발했다고 29일 밝혔다.

이방성 문제란 형광 현미경으로 3차원 영상을 획득하는 데 있어 빛의 성질로 인해 영상 공간 방향 간에 적게는 2~3배, 많게는 10배까지도 화질 차이가 발생하는 문제를 뜻한다. 예를 들면 3차원 영상을 보는 각도마다 화질의 차이가 발생하는 것이다.

연구팀은 수학적 기법인 최적 수송이론 기반을 둔 새로운 인공지능 시스템을 개발해 공초점 현미경과 광 시트 현미경에 적용했다. 기존 인공지능 기법들과는 다르게, 인공지능 학습 데이터가 따로 필요하지 않고, 하나의 3차원 영상만으로도 인공지능 학습에 적용할 수 있다는 점에서 획기적이라 볼 수 있으며, 생물학 연구자들에게 생물 표본의 3차원 고화질 영상 획득에 큰 도움을 줄 것으로 기대된다.

예종철 교수는 "3차원 영상 획득에 있어 극복하기 어려웠던 현미경의 물리적 한계를 인공지능 기술을 통해 뛰어넘었다는 점에서 의미가 있고, 비지도 학습 기반으로 훈련이 진행되기 때문에, 다양한 많은 종류의 3차원 영상 촬영 기법에도 확장 적용 가능하며, 또한 인공지능 연구의 새로운 응용을 개척했다는 데 의미가 있다ˮ 고 말했다.

김재철 AI 대학원의 예종철 교수가 주도하고, 박형준 연구원이 제1 저자로 참여한 이번 연구 결과는 국제 학술지 `네이처 커뮤니케이션스(Nature Communications)' 6월 8일 字 온라인판에 게재됐다.

*논문명 : Deep learning enables reference-free isotropic super-resolution for volumetric fluorescence microscopy

논문 링크: https://www.nature.com/articles/s41467-022-30949-6

2022.06.29 조회수 4729

새로운 인공지능 형광 현미경 적용, 뇌 신경세포 등 3차원 고화질 영상기술 개발

우리 대학 김재철 AI 대학원 예종철 교수 연구팀이 서울대학교 장성호 교수팀, 포스텍 김기현 교수팀과 공동연구를 통해 형광 현미경의 오랜 문제인 이방성(Anisotropy)을 해결해, 3차원 영상 화질을 획기적으로 끌어올리는 인공지능 기술을 개발했다고 29일 밝혔다.

이방성 문제란 형광 현미경으로 3차원 영상을 획득하는 데 있어 빛의 성질로 인해 영상 공간 방향 간에 적게는 2~3배, 많게는 10배까지도 화질 차이가 발생하는 문제를 뜻한다. 예를 들면 3차원 영상을 보는 각도마다 화질의 차이가 발생하는 것이다.

연구팀은 수학적 기법인 최적 수송이론 기반을 둔 새로운 인공지능 시스템을 개발해 공초점 현미경과 광 시트 현미경에 적용했다. 기존 인공지능 기법들과는 다르게, 인공지능 학습 데이터가 따로 필요하지 않고, 하나의 3차원 영상만으로도 인공지능 학습에 적용할 수 있다는 점에서 획기적이라 볼 수 있으며, 생물학 연구자들에게 생물 표본의 3차원 고화질 영상 획득에 큰 도움을 줄 것으로 기대된다.

예종철 교수는 "3차원 영상 획득에 있어 극복하기 어려웠던 현미경의 물리적 한계를 인공지능 기술을 통해 뛰어넘었다는 점에서 의미가 있고, 비지도 학습 기반으로 훈련이 진행되기 때문에, 다양한 많은 종류의 3차원 영상 촬영 기법에도 확장 적용 가능하며, 또한 인공지능 연구의 새로운 응용을 개척했다는 데 의미가 있다ˮ 고 말했다.

김재철 AI 대학원의 예종철 교수가 주도하고, 박형준 연구원이 제1 저자로 참여한 이번 연구 결과는 국제 학술지 `네이처 커뮤니케이션스(Nature Communications)' 6월 8일 字 온라인판에 게재됐다.

*논문명 : Deep learning enables reference-free isotropic super-resolution for volumetric fluorescence microscopy

논문 링크: https://www.nature.com/articles/s41467-022-30949-6

2022.06.29 조회수 4729 인공지능 엔진으로 영상 위변조 탐지 기술 개발

우리 연구진이 영상 내 변형 영역을 더욱 정밀하게 탐지하기 위해 영상내 색상 정보와 주파수 정보를 함께 활용하는 인공지능 엔진 기술을 학계 처음으로 개발했다. 이번 개발 기술은 기존 기술보다 정밀도와 정확도를 크게 높여 위변조 탐지 기술의 기술 유용성을 일정 수준 확보할 수 있는 기반을 제공한다는 점에서 그 의미가 크다. KAIST에서 각종 위변조 영상들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어는 이미지, 영상뿐만 아니라 CCTV 비디오 변형 여부도 분석할 수 있다.

우리 대학 전산학부 이흥규 교수 연구팀이 새로운 인공지능 구조와학습 방법론, 그리고 실험실 환경에서는 구하기 힘든 고급 변형 이미지 영상들을 사용해 영상 이미지 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'의 영상 이미지 정밀도와 정확도를 크게 높일 뿐만 아니라 비디오 편집 변형도 탐지할 수 있는 카이캐치 2.1 버전을 개발했다고 13일 밝혔다.

카이캐치 소프트웨어는 `이상(異常) 유형 분석 엔진'과 `이상(異常) 영역 추정 엔진' 두 개의 인공지능 엔진으로 구성된다. `이상 유형 분석 엔진'은 블러링, 노이즈, 크기 변화, 명암 대비 변화, 모핑, 리샘플링 등을 필수 변이로 정의해 이를 탐지하며 `이상 영역 추정 엔진'은 이미지 짜깁기, 잘라 붙이기, 복사 붙이기, 복사 이동 등을 탐지한다. 이번에 새로 개발한 기술은 `이상 영역 추정 엔진'으로 기존 기술에서는 이상 영역 탐지 시 그레이 스케일(회색조)로 이상 유무를 탐지하였으나 분석 신호의 표현력이 낮고 탐지 오류가 많아 위변조 여부 판정에 어려움이 많았다. 이번에 개발된 기술은 색상 정보와 주파수 정보를 함께 활용해 정밀도(precision)와 재현율(recall)이 크게 향상되고 변형 영역을 컬러 스케일로 표현함으로써 해당 영역의 이상 유무뿐만 아니라 위변조 여부도 더욱 명확하게 판별이 가능해졌다.

연구팀은 이번 연구에서 영상 생성 시 발생하는 흔적과 압축 시 발생하는 흔적 신호들을 함께 분석하기 위해 색상 정보와 주파수 정보를 모두 활용하는 접근 방법을 학계 처음으로 제시했다. 또 이러한 방법론을 설계 구현하기 위해 주파수 정보를 하나의 분할 네트워크에서 직접 입력으로 받아들이는 방식의 ‘압축 왜곡신호 탐지 네트워크(Compression Artifact Tracing Network, 이하 CAT-Net)’을 학계 최초로 개발하고 기존 기법들과 비교해 탐지 성능이 크게 뛰어남을 입증했다. 개발한 기술은 기존에 제시된 기법들과 비교할 때 특히 원본과 변형본을 판별하는 평가 척도인 F1 점수, 평균 정밀도(average precision)에서 대단히 뛰어나 실환경 위변조 탐지 능력이 크게 강화됐다.

비디오 편집 변형의 경우도, 프레임 삭제, 추가 등에 의한 편집 변형이 흔히 CCTV 비디오 등에서 발생한다는데 착안해 이러한 비디오 편집 변형을 탐지하는 기능 역시 이번 카이캐치 2.1 버전에 탑재됐다.

이번에 카이캐치 2.1 소프트웨어를 연구 개발한 이흥규 교수는 "영상 이미지 위변조 소프트웨어인 카이캐치를 휴대폰에 탑재되는 안드로이드 앱 형태로 일반에 소개한 2021년 3월 이후 현재까지 카이캐치 앱을 통한 900여 건의 위변조 분석 의뢰와 개별적으로 60건이 넘는 정밀 위변조 분석 의뢰를 받았다. KAIST 발표 논문 수준이나 실험 결과 등을 감안할 때 위변조 분야 최고 기술로 만든 소프트웨어인데, 오탐지율이 높아 실제 탐지 정밀도가 이론치보다 매우 낮았다. 많은 경우 위변조나 변형 여부에 대한 명확한 기술 판정이 불가능했으나 이번에 개발한 카이캐치 2.1 은 CAT-Net이라는 새로운 네트워크 구조와 학습 방법론, 그리고 ‘색상 및 주파수 영역 왜곡 흔적 동시 분석’이라는 첨단 기술을 사용해 정밀도를 높여, 보다 명확한 판별이 가능하도록 개발됐다. 앞으로 영상 위변조 판단 여부가 어려운 경우가 많이 줄어들기를 기대한다”고 말했다.

이 교수는 이어 "비디오는 MP4 파일 포맷이, 그리고 영상 이미지는 JPEG 이미지들이 일반인들이 널리 사용한다는 점에서 해당 포맷을 주 개발 대상으로 삼았다. 영상 이미지의 경우 영상 편집 변형 시 영상에 남겨지는 인위적으로 발생하는 JPEG 압축 미세 신호 탐지에 주안점을 두어, 위변조 여부와 위변조 영역을 잡아내는 것에 집중했다. 비디오의 경우 특정 프레임들을 삭제하거나 삽입하는 경우, 프레임 부분 편집 후 재압축 하는 경우 등을 탐지한다. 최근 CCTV 비디오 편집 여부에 대한 분쟁이 많아 크게 도움을 줄 수 있을 것으로 기대하며 향후에도 지속적으로 연구 개발해 취약점들을 보완해 나갈 계획이다ˮ 고 덧붙였다.

현재 카이캐치 소프트웨어는 안드로이드 기반 휴대폰의 구글 플레이스토어에서 ‘카이캐치’를 검색하여 앱을 다운로드 받아 설치한 후, 영상 이미지들을 카이캐치에 업로드하면 위변조 여부를 간단하게 테스트해 볼 수 있다.

한편 이번 연구는 제1 저자로 참여한 우리 대학 전기및전자공학부 권명준 박사, 그리고 김창익 교수, 남승훈 박사, 유인재 박사 등과 공동으로 수행됐으며, `스프링거 네이처(Springer Nature)'에서 발간하는 컴퓨터 비전 분야 톱 국제저널인 `국제 컴퓨터 비전 저널(International Journal of Computer Vision, IF 7.410)'에 2022년 5월 25일 字 온라인판에 게재됐다. (논문명 : Learning JPEG Compression Artifacts for Image Manipulation Detection and Localization)

이번 연구는 한국연구재단 창의도전연구기반지원사업지원과 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과의 산학협력 연구로 수행됐다.

2022.06.13 조회수 4990

인공지능 엔진으로 영상 위변조 탐지 기술 개발

우리 연구진이 영상 내 변형 영역을 더욱 정밀하게 탐지하기 위해 영상내 색상 정보와 주파수 정보를 함께 활용하는 인공지능 엔진 기술을 학계 처음으로 개발했다. 이번 개발 기술은 기존 기술보다 정밀도와 정확도를 크게 높여 위변조 탐지 기술의 기술 유용성을 일정 수준 확보할 수 있는 기반을 제공한다는 점에서 그 의미가 크다. KAIST에서 각종 위변조 영상들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어는 이미지, 영상뿐만 아니라 CCTV 비디오 변형 여부도 분석할 수 있다.

우리 대학 전산학부 이흥규 교수 연구팀이 새로운 인공지능 구조와학습 방법론, 그리고 실험실 환경에서는 구하기 힘든 고급 변형 이미지 영상들을 사용해 영상 이미지 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'의 영상 이미지 정밀도와 정확도를 크게 높일 뿐만 아니라 비디오 편집 변형도 탐지할 수 있는 카이캐치 2.1 버전을 개발했다고 13일 밝혔다.

카이캐치 소프트웨어는 `이상(異常) 유형 분석 엔진'과 `이상(異常) 영역 추정 엔진' 두 개의 인공지능 엔진으로 구성된다. `이상 유형 분석 엔진'은 블러링, 노이즈, 크기 변화, 명암 대비 변화, 모핑, 리샘플링 등을 필수 변이로 정의해 이를 탐지하며 `이상 영역 추정 엔진'은 이미지 짜깁기, 잘라 붙이기, 복사 붙이기, 복사 이동 등을 탐지한다. 이번에 새로 개발한 기술은 `이상 영역 추정 엔진'으로 기존 기술에서는 이상 영역 탐지 시 그레이 스케일(회색조)로 이상 유무를 탐지하였으나 분석 신호의 표현력이 낮고 탐지 오류가 많아 위변조 여부 판정에 어려움이 많았다. 이번에 개발된 기술은 색상 정보와 주파수 정보를 함께 활용해 정밀도(precision)와 재현율(recall)이 크게 향상되고 변형 영역을 컬러 스케일로 표현함으로써 해당 영역의 이상 유무뿐만 아니라 위변조 여부도 더욱 명확하게 판별이 가능해졌다.

연구팀은 이번 연구에서 영상 생성 시 발생하는 흔적과 압축 시 발생하는 흔적 신호들을 함께 분석하기 위해 색상 정보와 주파수 정보를 모두 활용하는 접근 방법을 학계 처음으로 제시했다. 또 이러한 방법론을 설계 구현하기 위해 주파수 정보를 하나의 분할 네트워크에서 직접 입력으로 받아들이는 방식의 ‘압축 왜곡신호 탐지 네트워크(Compression Artifact Tracing Network, 이하 CAT-Net)’을 학계 최초로 개발하고 기존 기법들과 비교해 탐지 성능이 크게 뛰어남을 입증했다. 개발한 기술은 기존에 제시된 기법들과 비교할 때 특히 원본과 변형본을 판별하는 평가 척도인 F1 점수, 평균 정밀도(average precision)에서 대단히 뛰어나 실환경 위변조 탐지 능력이 크게 강화됐다.

비디오 편집 변형의 경우도, 프레임 삭제, 추가 등에 의한 편집 변형이 흔히 CCTV 비디오 등에서 발생한다는데 착안해 이러한 비디오 편집 변형을 탐지하는 기능 역시 이번 카이캐치 2.1 버전에 탑재됐다.

이번에 카이캐치 2.1 소프트웨어를 연구 개발한 이흥규 교수는 "영상 이미지 위변조 소프트웨어인 카이캐치를 휴대폰에 탑재되는 안드로이드 앱 형태로 일반에 소개한 2021년 3월 이후 현재까지 카이캐치 앱을 통한 900여 건의 위변조 분석 의뢰와 개별적으로 60건이 넘는 정밀 위변조 분석 의뢰를 받았다. KAIST 발표 논문 수준이나 실험 결과 등을 감안할 때 위변조 분야 최고 기술로 만든 소프트웨어인데, 오탐지율이 높아 실제 탐지 정밀도가 이론치보다 매우 낮았다. 많은 경우 위변조나 변형 여부에 대한 명확한 기술 판정이 불가능했으나 이번에 개발한 카이캐치 2.1 은 CAT-Net이라는 새로운 네트워크 구조와 학습 방법론, 그리고 ‘색상 및 주파수 영역 왜곡 흔적 동시 분석’이라는 첨단 기술을 사용해 정밀도를 높여, 보다 명확한 판별이 가능하도록 개발됐다. 앞으로 영상 위변조 판단 여부가 어려운 경우가 많이 줄어들기를 기대한다”고 말했다.

이 교수는 이어 "비디오는 MP4 파일 포맷이, 그리고 영상 이미지는 JPEG 이미지들이 일반인들이 널리 사용한다는 점에서 해당 포맷을 주 개발 대상으로 삼았다. 영상 이미지의 경우 영상 편집 변형 시 영상에 남겨지는 인위적으로 발생하는 JPEG 압축 미세 신호 탐지에 주안점을 두어, 위변조 여부와 위변조 영역을 잡아내는 것에 집중했다. 비디오의 경우 특정 프레임들을 삭제하거나 삽입하는 경우, 프레임 부분 편집 후 재압축 하는 경우 등을 탐지한다. 최근 CCTV 비디오 편집 여부에 대한 분쟁이 많아 크게 도움을 줄 수 있을 것으로 기대하며 향후에도 지속적으로 연구 개발해 취약점들을 보완해 나갈 계획이다ˮ 고 덧붙였다.

현재 카이캐치 소프트웨어는 안드로이드 기반 휴대폰의 구글 플레이스토어에서 ‘카이캐치’를 검색하여 앱을 다운로드 받아 설치한 후, 영상 이미지들을 카이캐치에 업로드하면 위변조 여부를 간단하게 테스트해 볼 수 있다.

한편 이번 연구는 제1 저자로 참여한 우리 대학 전기및전자공학부 권명준 박사, 그리고 김창익 교수, 남승훈 박사, 유인재 박사 등과 공동으로 수행됐으며, `스프링거 네이처(Springer Nature)'에서 발간하는 컴퓨터 비전 분야 톱 국제저널인 `국제 컴퓨터 비전 저널(International Journal of Computer Vision, IF 7.410)'에 2022년 5월 25일 字 온라인판에 게재됐다. (논문명 : Learning JPEG Compression Artifacts for Image Manipulation Detection and Localization)

이번 연구는 한국연구재단 창의도전연구기반지원사업지원과 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과의 산학협력 연구로 수행됐다.

2022.06.13 조회수 4990 리튬이온전지 충방전 과정을 나노스케일에서 영상화 성공

리튬이온전지는 스마트폰과 전기차 그리고 드론을 비롯한 각종 이동 수단에 필수적인 에너지 저장 매체로 사용되고 있다. 기후변화와 코로나 팬데믹이 키워드가 되는 시대가 도래하면서 급증하는 수요에 대응하기 위해 리튬이온전지의 에너지 용량, 충전 속도 등의 전기화학적 특성을 향상하려는 연구들이 이뤄지고 있지만, 기존의 전기화학 특성 평가 방법으로는 나노미터 수준의 미시세계에서 벌어지고 있는 현상들을 이해하기 어렵다. 따라서, 전기화학 특성에 대한 통합적인 이해를 위해 나노스케일 수준에서 리튬이온의 농도 및 전기전도도 분석 기술의 개발은 필수적이다.

우리 대학 신소재공학과 홍승범 교수 연구팀이 독일의 아헨공과대학교 플로리안 하우센(Florian Hausen) 교수와 독일 뮌스터 대학교 카린 클라이너(Karin Kleiner) 교수와 협업하여 고용량 리튬이온배터리를 충‧방전할 때 리튬이온이 움직이는 모습과 그로 인해서 전자들이 움직이는 전도 경로 그리고 격자들의 움직임을 원자간력 현미경과 엑스레이 회절 및 흡수 패턴을 분석해 영상화하는 데 성공했다고 28일 밝혔다.

홍 교수 연구팀은 원자간력 현미경의 모드 중에서 전기화학적 변형 현미경(Electrochemical Strain Microscopy, 이하 ESM)과 전도성 원자간력 현미경(Conductive Atomic Force Microscopy, 이하 C-AFM)을 활용해, 친환경차 배터리에 적용되는 고용량 양극재인 NCM622 시료의 충방전상태(State of Charge, SOC)에 따른 리튬이온의 나노스케일 분포도를 영상화했으며, 이를 근단엑스선형광분광계(Near Edge X-ray Absorption Fluorescence Spectroscopy, NEXAFS)와 엑스선회절패턴(X-ray Diffraction Pattern, XRD pattern)과 비교 분석해 리튬이온이 양극재에 확산하여 들어갈 때 산소팔면체에 들어가면서 니켈과 산소의 결합이 이온 결합에서 공유결합으로 바뀌면서 전기전도도가 낮아지는 현상을 검증하고, 이를 ESM, C-AFM 영상과 비교하면서 상당한 상관관계가 있음을 밝혀냈다.

교신 저자인 홍승범 교수는 "배터리 소재 내에서 리튬이온의 확산을 영상화하고 이를 통해서 일어나는 현상들을 다중스케일에서 이해하는 것은 향후 신뢰성이 높고 수명이 긴 고속 충‧방전 배터리 소재를 디자인하는 데 있어 매우 중요하다ˮ라며 "향후 신소재 영상화 기술과 머신러닝 기술을 융합하는 것이 20년 걸리던 배터리 소재 개발기간을 5년 이내로 단축할 수 있을 것이다ˮ 라고 말했다.

신소재공학과 알비나 제티바예바(Albina Jetybayeva) 연구원이 제1 저자로 참여한 이번 연구는 국제 학술지 `ACS 어플라이드 에너지 머티리얼스 (ACS Applied Energy Materials)'에 게재됐다. (논문명: Unraveling the State of Charge-Dependent Electronic and Ionic Structure−Property Relationships in NCM622 Cells by Multiscale Characterization)

이번 연구는 KAIST 글로벌 특이점 사업과 한국연구재단의 거대과학연구개발사업의 지원을 받아 수행됐다.

2022.04.29 조회수 6554

리튬이온전지 충방전 과정을 나노스케일에서 영상화 성공

리튬이온전지는 스마트폰과 전기차 그리고 드론을 비롯한 각종 이동 수단에 필수적인 에너지 저장 매체로 사용되고 있다. 기후변화와 코로나 팬데믹이 키워드가 되는 시대가 도래하면서 급증하는 수요에 대응하기 위해 리튬이온전지의 에너지 용량, 충전 속도 등의 전기화학적 특성을 향상하려는 연구들이 이뤄지고 있지만, 기존의 전기화학 특성 평가 방법으로는 나노미터 수준의 미시세계에서 벌어지고 있는 현상들을 이해하기 어렵다. 따라서, 전기화학 특성에 대한 통합적인 이해를 위해 나노스케일 수준에서 리튬이온의 농도 및 전기전도도 분석 기술의 개발은 필수적이다.

우리 대학 신소재공학과 홍승범 교수 연구팀이 독일의 아헨공과대학교 플로리안 하우센(Florian Hausen) 교수와 독일 뮌스터 대학교 카린 클라이너(Karin Kleiner) 교수와 협업하여 고용량 리튬이온배터리를 충‧방전할 때 리튬이온이 움직이는 모습과 그로 인해서 전자들이 움직이는 전도 경로 그리고 격자들의 움직임을 원자간력 현미경과 엑스레이 회절 및 흡수 패턴을 분석해 영상화하는 데 성공했다고 28일 밝혔다.

홍 교수 연구팀은 원자간력 현미경의 모드 중에서 전기화학적 변형 현미경(Electrochemical Strain Microscopy, 이하 ESM)과 전도성 원자간력 현미경(Conductive Atomic Force Microscopy, 이하 C-AFM)을 활용해, 친환경차 배터리에 적용되는 고용량 양극재인 NCM622 시료의 충방전상태(State of Charge, SOC)에 따른 리튬이온의 나노스케일 분포도를 영상화했으며, 이를 근단엑스선형광분광계(Near Edge X-ray Absorption Fluorescence Spectroscopy, NEXAFS)와 엑스선회절패턴(X-ray Diffraction Pattern, XRD pattern)과 비교 분석해 리튬이온이 양극재에 확산하여 들어갈 때 산소팔면체에 들어가면서 니켈과 산소의 결합이 이온 결합에서 공유결합으로 바뀌면서 전기전도도가 낮아지는 현상을 검증하고, 이를 ESM, C-AFM 영상과 비교하면서 상당한 상관관계가 있음을 밝혀냈다.

교신 저자인 홍승범 교수는 "배터리 소재 내에서 리튬이온의 확산을 영상화하고 이를 통해서 일어나는 현상들을 다중스케일에서 이해하는 것은 향후 신뢰성이 높고 수명이 긴 고속 충‧방전 배터리 소재를 디자인하는 데 있어 매우 중요하다ˮ라며 "향후 신소재 영상화 기술과 머신러닝 기술을 융합하는 것이 20년 걸리던 배터리 소재 개발기간을 5년 이내로 단축할 수 있을 것이다ˮ 라고 말했다.

신소재공학과 알비나 제티바예바(Albina Jetybayeva) 연구원이 제1 저자로 참여한 이번 연구는 국제 학술지 `ACS 어플라이드 에너지 머티리얼스 (ACS Applied Energy Materials)'에 게재됐다. (논문명: Unraveling the State of Charge-Dependent Electronic and Ionic Structure−Property Relationships in NCM622 Cells by Multiscale Characterization)

이번 연구는 KAIST 글로벌 특이점 사업과 한국연구재단의 거대과학연구개발사업의 지원을 받아 수행됐다.

2022.04.29 조회수 6554 KAIST-한예종 신입생 영상캠프 성료

우리 대학이 한국예술종합학교(총장 김대진)와의 협력 추진에 박차를 가하고 있다. 올해 1월 한예종과 상호교류 업무협약을 체결한 뒤 첫 번째 시행하는 프로그램으로 ‘KAIST x 한예종 신입생 영상캠프(이하, 영상캠프)’를 추진해 성공적으로 마무리했다.

양교 학생들의 상호교류 및 예술과 기술의 융합 협력 확대를 위해 마련된 이번 영상캠프는 지난달 14일부터 8일간 한국예술종합학교 영상원에서 진행됐다. 각 학교에서 선발된 2022학년도 새내기 34명은 영상 5개 팀, 게임 6개 팀 등 총 11개 팀으로 나뉘어 촬영·편집·음향, 컴퓨터그래픽·스토리텔링·연출·기획 등의 이론 강의와 촬영용 카메라·편집장비·음향·게임 툴을 다루는 기술 강의를 수강했다. 총 49시간으로 구성된 강의를 바탕으로 단편 영화와 간단한 게임을 제작해, 융합예술 및 첨단 콘텐츠에 대한 이해력과 창의력을 높이고 과학과 예술 분야가 함께하는 공동 창작을 입학 전에 체험하는 기회를 가졌다. 행사 후 진행된 설문조사에서 참가자의 97%(매우 그렇다 78.8%, 그렇다 18.2%)가 캠프에서 제공한 이론 및 기술 지식을 매우 긍정적으로 평가했으며, 전원(매우 그렇다 90.9%, 그렇다 9.1%)이 영상캠프를 타인에게 추천할 의향이 있다고 밝혔다.

정재웅 KAIST 새내기과정학부 학생은 “다른 삶을 살아온 친구들의 인생을 잠시나마 나 자신과 겹쳐볼 수 있는 인상적인 경험이었던 만큼, 앞으로 하게 될 다른 많은 일에도 좋은 영감으로 작용할 것 같다”라고 참여 소감을 밝혔다.

또한, 신연수 한국예술종합학교 영상원 학생은 “한예종과 KAIST 모두 자신만의 길을 뚜렷하게 가진 학생들이 준비하는 학교이다 보니 자기가 설정해놓은 방향에 매몰되기 쉬운데, 이번 영상캠프를 통해 생각의 틀을 깨고 더 넓게 볼 수 있는 시각을 얻는 계기가 된 것 같다”라고 전했다.

이번 영상캠프를 총괄한 이승무 한국예술종합학교 아트앤테크놀로지랩(ART & TECHNOLOGY LAB) 소장은 “이번 캠프를 통해 서로 다른 분야의 사람들이 자발적 비전을 공유하고 그것을 함께 즐기며 만들어가는 과정에서 진정한 융합의 씨앗이 생겨남을 확인할 수 있었다”라고 이번 캠프의 의의를 평가했다.

두 학교는 이번 영상캠프의 성료를 바탕으로 매년 신입생들이 참여하는 영상캠프를 개최하는 것은 물론 재학생 대상 프로그램도 빠르면 올해 상반기 중 추진할 예정이다. 신병하 KAIST 학생생활처장은 “KAIST가 초일류 대학으로 한 걸음 더 나아가기 위해서는 과학과 기술에만 몰두하기보다는 인문학, 예술적 소양을 함께 기르고 두 분야를 접목하는 노력과 시도가 필요하다”라며, “이번 영상캠프 뿐만 아니라 한예종과 함께 하는 교류 활동의 폭을 더욱 다양하게 넓혀나갈 계획”라고 밝혔다.

2022.03.18 조회수 5682

KAIST-한예종 신입생 영상캠프 성료

우리 대학이 한국예술종합학교(총장 김대진)와의 협력 추진에 박차를 가하고 있다. 올해 1월 한예종과 상호교류 업무협약을 체결한 뒤 첫 번째 시행하는 프로그램으로 ‘KAIST x 한예종 신입생 영상캠프(이하, 영상캠프)’를 추진해 성공적으로 마무리했다.

양교 학생들의 상호교류 및 예술과 기술의 융합 협력 확대를 위해 마련된 이번 영상캠프는 지난달 14일부터 8일간 한국예술종합학교 영상원에서 진행됐다. 각 학교에서 선발된 2022학년도 새내기 34명은 영상 5개 팀, 게임 6개 팀 등 총 11개 팀으로 나뉘어 촬영·편집·음향, 컴퓨터그래픽·스토리텔링·연출·기획 등의 이론 강의와 촬영용 카메라·편집장비·음향·게임 툴을 다루는 기술 강의를 수강했다. 총 49시간으로 구성된 강의를 바탕으로 단편 영화와 간단한 게임을 제작해, 융합예술 및 첨단 콘텐츠에 대한 이해력과 창의력을 높이고 과학과 예술 분야가 함께하는 공동 창작을 입학 전에 체험하는 기회를 가졌다. 행사 후 진행된 설문조사에서 참가자의 97%(매우 그렇다 78.8%, 그렇다 18.2%)가 캠프에서 제공한 이론 및 기술 지식을 매우 긍정적으로 평가했으며, 전원(매우 그렇다 90.9%, 그렇다 9.1%)이 영상캠프를 타인에게 추천할 의향이 있다고 밝혔다.

정재웅 KAIST 새내기과정학부 학생은 “다른 삶을 살아온 친구들의 인생을 잠시나마 나 자신과 겹쳐볼 수 있는 인상적인 경험이었던 만큼, 앞으로 하게 될 다른 많은 일에도 좋은 영감으로 작용할 것 같다”라고 참여 소감을 밝혔다.

또한, 신연수 한국예술종합학교 영상원 학생은 “한예종과 KAIST 모두 자신만의 길을 뚜렷하게 가진 학생들이 준비하는 학교이다 보니 자기가 설정해놓은 방향에 매몰되기 쉬운데, 이번 영상캠프를 통해 생각의 틀을 깨고 더 넓게 볼 수 있는 시각을 얻는 계기가 된 것 같다”라고 전했다.

이번 영상캠프를 총괄한 이승무 한국예술종합학교 아트앤테크놀로지랩(ART & TECHNOLOGY LAB) 소장은 “이번 캠프를 통해 서로 다른 분야의 사람들이 자발적 비전을 공유하고 그것을 함께 즐기며 만들어가는 과정에서 진정한 융합의 씨앗이 생겨남을 확인할 수 있었다”라고 이번 캠프의 의의를 평가했다.

두 학교는 이번 영상캠프의 성료를 바탕으로 매년 신입생들이 참여하는 영상캠프를 개최하는 것은 물론 재학생 대상 프로그램도 빠르면 올해 상반기 중 추진할 예정이다. 신병하 KAIST 학생생활처장은 “KAIST가 초일류 대학으로 한 걸음 더 나아가기 위해서는 과학과 기술에만 몰두하기보다는 인문학, 예술적 소양을 함께 기르고 두 분야를 접목하는 노력과 시도가 필요하다”라며, “이번 영상캠프 뿐만 아니라 한예종과 함께 하는 교류 활동의 폭을 더욱 다양하게 넓혀나갈 계획”라고 밝혔다.

2022.03.18 조회수 5682 서민준 교수 연구팀, VALUE Challenge 2021 영상검색 트랙 부문 우승

우리 대학 김재철AI대학원 서민준 교수 연구팀(오한석 석사과정)이 마이크로소프트가 주최한 AI 영상 인식 대회(VALUE Challenge 2021, 이하 밸류 챌린지) 영상 검색 트랙(Video Retrieval Track)에서 텐센트, 카카오, 컬럼비아 대학 등 우수한 팀들을 제치고 우승했다. 이 대회에는 영상 AI 분야 스타트업 트웰브랩스(대표 이재성) 이승준 CTO와 함께 참여했다.

이번 밸류 챌린지는 컴퓨터 비전 분야 권위의 학회인 ICCV(International Conference on Computer Vision)의 행사 중 일환으로 진행된 대회로 영상에 대한 인공지능의 이해능력을 평가하는 세계 최초의 비교·평가 대회로, 올해 6월부터 9월까지 진행되었다. 밸류 챌린지에서는 3개의 트랙으로 나뉘어 진행됐다. 이 중 영상 검색 트랙에서는 7만4천 개의 특정 분야에 치우치지 않은 다양한 동영상에 담긴 시각 및 음성 정보를 분석하여, 주어진 문장에 해당되는 영상 내 구간을 정확하게 빨리 찾는 것이 평가 기준이었다.

서민준 교수 연구팀과 트웰브랩스는 시각 정보에 특화된 기존의 영상검색 기술에서 진일보하여 음성과 시간의 흐름 등의 다양한 정보까지 종합적으로 인식할 수 있도록 AI 모델을 학습하여 인식률을 극대화하였다. 또한 다양한 유형의 콘텐츠를 이해할 수 있는 하나의 AI 모델을 독자적으로 개발하여 기술의 범용성을 입증하였다. 특히 마이크로소프트가 기록한 역대 최고 정확도를 앞질렀을 뿐만 아니라, 세계적인 기술 기업인 텐센트 및 카카오브레인과 미국 컬럼비아 대학 연구팀 등을 제치고 전 세계 1위를 차지했다.

위 상을 수상한 서민준 교수는 “자연어 처리 및 문서검색 분야에서 활용되는 최신 기술을 비디오 검색에 응용하고, 클라우드 컴퓨팅을 통한 대규모 실험으로 정확성과 속도를 극대로 끌어 올릴 수 있었다”며, “미디어의 홍수 속에서 유저가 원하는 비디오를 정확하게 찾아주는 제품을 만드는데 기여하길 바란다”고 밝혔다.

2021.10.20 조회수 5331

서민준 교수 연구팀, VALUE Challenge 2021 영상검색 트랙 부문 우승

우리 대학 김재철AI대학원 서민준 교수 연구팀(오한석 석사과정)이 마이크로소프트가 주최한 AI 영상 인식 대회(VALUE Challenge 2021, 이하 밸류 챌린지) 영상 검색 트랙(Video Retrieval Track)에서 텐센트, 카카오, 컬럼비아 대학 등 우수한 팀들을 제치고 우승했다. 이 대회에는 영상 AI 분야 스타트업 트웰브랩스(대표 이재성) 이승준 CTO와 함께 참여했다.

이번 밸류 챌린지는 컴퓨터 비전 분야 권위의 학회인 ICCV(International Conference on Computer Vision)의 행사 중 일환으로 진행된 대회로 영상에 대한 인공지능의 이해능력을 평가하는 세계 최초의 비교·평가 대회로, 올해 6월부터 9월까지 진행되었다. 밸류 챌린지에서는 3개의 트랙으로 나뉘어 진행됐다. 이 중 영상 검색 트랙에서는 7만4천 개의 특정 분야에 치우치지 않은 다양한 동영상에 담긴 시각 및 음성 정보를 분석하여, 주어진 문장에 해당되는 영상 내 구간을 정확하게 빨리 찾는 것이 평가 기준이었다.

서민준 교수 연구팀과 트웰브랩스는 시각 정보에 특화된 기존의 영상검색 기술에서 진일보하여 음성과 시간의 흐름 등의 다양한 정보까지 종합적으로 인식할 수 있도록 AI 모델을 학습하여 인식률을 극대화하였다. 또한 다양한 유형의 콘텐츠를 이해할 수 있는 하나의 AI 모델을 독자적으로 개발하여 기술의 범용성을 입증하였다. 특히 마이크로소프트가 기록한 역대 최고 정확도를 앞질렀을 뿐만 아니라, 세계적인 기술 기업인 텐센트 및 카카오브레인과 미국 컬럼비아 대학 연구팀 등을 제치고 전 세계 1위를 차지했다.

위 상을 수상한 서민준 교수는 “자연어 처리 및 문서검색 분야에서 활용되는 최신 기술을 비디오 검색에 응용하고, 클라우드 컴퓨팅을 통한 대규모 실험으로 정확성과 속도를 극대로 끌어 올릴 수 있었다”며, “미디어의 홍수 속에서 유저가 원하는 비디오를 정확하게 찾아주는 제품을 만드는데 기여하길 바란다”고 밝혔다.

2021.10.20 조회수 5331 전기및전자공학부 윤영규 교수팀, 국제의료영상처리학회 젊은과학자상 수상

우리 대학 전기및전자공학부 윤영규 교수팀이 2021년 국제의료영상처리학회(MICCAI)로부터 젊은 과학자 상(Young Scientist Award) 수상자로 선정되었다고 8일 밝혔다.

젊은 과학자 상(Young Scientist Award)은 의료영상처리 분야 저명 국제 학술대회인 국제의료영상학회에 출판된 논문 중 학생 혹은 박사 학위를 받은 지 2년 이내의 주저자에 의해 작성된 가장 우수한 논문에 주어지는 상으로 우리나라에서 이 상을 받기는 처음이다.

전기및전자공학부 신창엽 학생(現 석사과정 학생)과 전기및전자공학부 류현 학생(現 학사과정 학생)이 공동 제1 저자, 전기및전자공학부 조은서 학생(現 박사과정 학생)이 공저자로 저술한 아래 논문으로 상을 수상했다.

“RLP-Net: A Recursive Light Propagation Network for 3-D Virtual Refocusing,”International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2021.

이 논문은 두 장의 현미경 이미지만 활용해 3차원 영상을 복원하는 가상 재초점 기술에 관한 것으로, 빛의 전파 과정이 공간적 불변성을 가지는 점에 착안해 빛의 전파 함수를 재귀적 신경망을 활용해 근사함으로써 정확한 가상 재초점이 가능함을 보였다.

시상식은 COVID19 상황으로 인해 가상으로 진행된 2021 MICCAI 학술대회에서 지난 9월 30일 진행됐으며, 수상자 리스트는 영구적으로 MICCAI 학술회 홈페이지에 게시될 예정이다.

2021.10.08 조회수 5873

전기및전자공학부 윤영규 교수팀, 국제의료영상처리학회 젊은과학자상 수상

우리 대학 전기및전자공학부 윤영규 교수팀이 2021년 국제의료영상처리학회(MICCAI)로부터 젊은 과학자 상(Young Scientist Award) 수상자로 선정되었다고 8일 밝혔다.

젊은 과학자 상(Young Scientist Award)은 의료영상처리 분야 저명 국제 학술대회인 국제의료영상학회에 출판된 논문 중 학생 혹은 박사 학위를 받은 지 2년 이내의 주저자에 의해 작성된 가장 우수한 논문에 주어지는 상으로 우리나라에서 이 상을 받기는 처음이다.

전기및전자공학부 신창엽 학생(現 석사과정 학생)과 전기및전자공학부 류현 학생(現 학사과정 학생)이 공동 제1 저자, 전기및전자공학부 조은서 학생(現 박사과정 학생)이 공저자로 저술한 아래 논문으로 상을 수상했다.

“RLP-Net: A Recursive Light Propagation Network for 3-D Virtual Refocusing,”International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2021.

이 논문은 두 장의 현미경 이미지만 활용해 3차원 영상을 복원하는 가상 재초점 기술에 관한 것으로, 빛의 전파 과정이 공간적 불변성을 가지는 점에 착안해 빛의 전파 함수를 재귀적 신경망을 활용해 근사함으로써 정확한 가상 재초점이 가능함을 보였다.

시상식은 COVID19 상황으로 인해 가상으로 진행된 2021 MICCAI 학술대회에서 지난 9월 30일 진행됐으며, 수상자 리스트는 영구적으로 MICCAI 학술회 홈페이지에 게시될 예정이다.

2021.10.08 조회수 5873 KBS와 함께 뉴스 영상 인공지능 데이터베이스와 한국형 메타데이터 구축한다

우리 대학은 KBS(사장 양승동)와 함께 한국형 보도영상 인공지능(AI) 데이터베이스와 메타데이터 구축에 나선다고 20일 밝혔다.

문화기술대학원 박주용(과제총괄책임), 이원재, 노준용 교수 연구팀이 주도하는 컨소시엄은 인공지능을 이용해 영상 정보 추출과 편집을 손쉽게 하는 기술 개발에 착수했다. 이와 함께 수행기관인 KBS가 보유한 방대한 뉴스 영상 데이터를 결합해 포스트 코로나 시대 인공지능 기반 영상 콘텐츠 산업 창출에 적극적으로 나설 계획이라고 밝혔다.

현재 인공지능은 질병 진단과 자율운전 등 인간의 기계적인 움직임과 판단력을 보완하는 영역을 벗어나 미디어 콘텐츠 제작과 같은 창의적 분야까지 급속히 확장하고 있다. 하지만 비전문가 누구라도 말을 통해 손쉽게 콘텐츠를 만들고 편집할 수 있게 하는 인공지능 기술은 아직 많은 발전이 필요하며 우리나라에서는 특히 한국어 기반 데이터 세트의 부족이 큰 걸림돌이 되고 있다고 전문가들은 입을 모으고 있다.

우리 대학은 KBS와 함께 인공지능 모델 학습을 위한 고품질의 영상 데이터를 구축하고 ‘한국형 뉴스 영상 메타데이터 표준 모델’ 개발을 목표로 하고 있다. 메타데이터 기반 공공개방형 뉴스 아카이브 분야는 현재 미국의 AP와 영국의 BBC가 주도하고 있는데, 박주용 교수는 “이 프로젝트를 통해 저작권 문제와 범용성 메타데이터의 부족으로 연구 개발에 어려움을 겪던 연구자들과 관련 스타트업들의 숨통이 트일 것으로 기대한다”며 “더 나아가 한국형 콘텐츠 플랫폼의 틀을 다지게 될 것”이라고 밝혔다.

과기정통부(장관 임혜숙)와 한국지능정보사회진흥원(원장 문용식)의 `2021년도 인공지능 학습용 데이터 구축' 사업 예산 및 KAIST가 주도하는 컨소시엄의 민간투자금 등 모두 42억 원의 재원으로 운용되는 이 과제는 우리 대학 문화기술대학원이 주관하고 KBS, 메트릭스리서치(대표 나윤정), 액션파워(공동대표 조홍식/이지화), 소리자바(대표이사 안상현), 데이터메이커(대표이사 김태헌), 미소정보기술(대표이사 안동욱), 인터마인즈(대표이사 김종진)가 공동연구기관으로 참여한다. 이 프로젝트에서 개발되는 데이터베이스, 인공지능 학습모델, 프로그래밍 코드 등 모든 연구 결과는 공공재이기 때문에 누구나 연구와 사업에 사용할 수 있다.

2021.07.20 조회수 6833

KBS와 함께 뉴스 영상 인공지능 데이터베이스와 한국형 메타데이터 구축한다

우리 대학은 KBS(사장 양승동)와 함께 한국형 보도영상 인공지능(AI) 데이터베이스와 메타데이터 구축에 나선다고 20일 밝혔다.

문화기술대학원 박주용(과제총괄책임), 이원재, 노준용 교수 연구팀이 주도하는 컨소시엄은 인공지능을 이용해 영상 정보 추출과 편집을 손쉽게 하는 기술 개발에 착수했다. 이와 함께 수행기관인 KBS가 보유한 방대한 뉴스 영상 데이터를 결합해 포스트 코로나 시대 인공지능 기반 영상 콘텐츠 산업 창출에 적극적으로 나설 계획이라고 밝혔다.

현재 인공지능은 질병 진단과 자율운전 등 인간의 기계적인 움직임과 판단력을 보완하는 영역을 벗어나 미디어 콘텐츠 제작과 같은 창의적 분야까지 급속히 확장하고 있다. 하지만 비전문가 누구라도 말을 통해 손쉽게 콘텐츠를 만들고 편집할 수 있게 하는 인공지능 기술은 아직 많은 발전이 필요하며 우리나라에서는 특히 한국어 기반 데이터 세트의 부족이 큰 걸림돌이 되고 있다고 전문가들은 입을 모으고 있다.

우리 대학은 KBS와 함께 인공지능 모델 학습을 위한 고품질의 영상 데이터를 구축하고 ‘한국형 뉴스 영상 메타데이터 표준 모델’ 개발을 목표로 하고 있다. 메타데이터 기반 공공개방형 뉴스 아카이브 분야는 현재 미국의 AP와 영국의 BBC가 주도하고 있는데, 박주용 교수는 “이 프로젝트를 통해 저작권 문제와 범용성 메타데이터의 부족으로 연구 개발에 어려움을 겪던 연구자들과 관련 스타트업들의 숨통이 트일 것으로 기대한다”며 “더 나아가 한국형 콘텐츠 플랫폼의 틀을 다지게 될 것”이라고 밝혔다.

과기정통부(장관 임혜숙)와 한국지능정보사회진흥원(원장 문용식)의 `2021년도 인공지능 학습용 데이터 구축' 사업 예산 및 KAIST가 주도하는 컨소시엄의 민간투자금 등 모두 42억 원의 재원으로 운용되는 이 과제는 우리 대학 문화기술대학원이 주관하고 KBS, 메트릭스리서치(대표 나윤정), 액션파워(공동대표 조홍식/이지화), 소리자바(대표이사 안상현), 데이터메이커(대표이사 김태헌), 미소정보기술(대표이사 안동욱), 인터마인즈(대표이사 김종진)가 공동연구기관으로 참여한다. 이 프로젝트에서 개발되는 데이터베이스, 인공지능 학습모델, 프로그래밍 코드 등 모든 연구 결과는 공공재이기 때문에 누구나 연구와 사업에 사용할 수 있다.

2021.07.20 조회수 6833 물리학과 김용현 교수, 과학의 날 과학기술 훈장 (진보장) 수상

우리 대학 물리학과 김용현 교수가 21일 서울 중구 동대문디자인플라자에서 열린 '2021년 과학정보통신의 날 기념식'에서 과학기술 훈장 진보장을 수상했다.

과학기술정보통신부, 방송통신위원회, 한국정보방송통신대연합(ICT대연합), 한국과학기술단체총연합회(과총)이 주관하는 이 행사는 과학기술·정보통신 진흥 및 국가연구개발 성과평가 유공자에 대한 정부포상을 통해 명예를 진작하고, 과학기술과 정보통신을 기반으로 '회복·포용·도약'의 시간을 만들어 가겠다는 의지를 다지는 자리로 마련됐다.

이날 행사는 사회적 거리두기 방침에 따라 과학기술·정보통신 진흥 및 국가연구개발 성과평가 유공자 151명 중 대표 수상자 37명이 현장에서 시상하는 방식으로 진행됐다.

우리 대학 입학처장이기도 한 물리학과 김용현 교수는 수소저장, 연료전지 촉매, 열전영상, 양자점 등 신재생에너지분야 기초이론 확립과 기술개발에 기여한 공로를 인정받아 훈장을 수상했다.

최기영 과기정통부 장관은 "어려운 여건 속에서도 과학기술과 정보통신 발전에 크게 기여하신 유공자 여러분께 존경하는 마음을 담아 진심으로 축하드린다"면서 대한민국의 성장은 과학기술과 정보통신의 발전과 함께 해온 만큼 과학기술과 정보통신 역량을 총동원해 신산업과 일자리를 창출하고 디지털 전환 시대의 새로운 성장기회를 만들어 나가겠다"고 말했다.

2021.04.26 조회수 22978

물리학과 김용현 교수, 과학의 날 과학기술 훈장 (진보장) 수상

우리 대학 물리학과 김용현 교수가 21일 서울 중구 동대문디자인플라자에서 열린 '2021년 과학정보통신의 날 기념식'에서 과학기술 훈장 진보장을 수상했다.

과학기술정보통신부, 방송통신위원회, 한국정보방송통신대연합(ICT대연합), 한국과학기술단체총연합회(과총)이 주관하는 이 행사는 과학기술·정보통신 진흥 및 국가연구개발 성과평가 유공자에 대한 정부포상을 통해 명예를 진작하고, 과학기술과 정보통신을 기반으로 '회복·포용·도약'의 시간을 만들어 가겠다는 의지를 다지는 자리로 마련됐다.

이날 행사는 사회적 거리두기 방침에 따라 과학기술·정보통신 진흥 및 국가연구개발 성과평가 유공자 151명 중 대표 수상자 37명이 현장에서 시상하는 방식으로 진행됐다.

우리 대학 입학처장이기도 한 물리학과 김용현 교수는 수소저장, 연료전지 촉매, 열전영상, 양자점 등 신재생에너지분야 기초이론 확립과 기술개발에 기여한 공로를 인정받아 훈장을 수상했다.

최기영 과기정통부 장관은 "어려운 여건 속에서도 과학기술과 정보통신 발전에 크게 기여하신 유공자 여러분께 존경하는 마음을 담아 진심으로 축하드린다"면서 대한민국의 성장은 과학기술과 정보통신의 발전과 함께 해온 만큼 과학기술과 정보통신 역량을 총동원해 신산업과 일자리를 창출하고 디지털 전환 시대의 새로운 성장기회를 만들어 나가겠다"고 말했다.

2021.04.26 조회수 22978 신소재 영상화 및 머신러닝을 활용한 미래 개척

우리 대학 신소재공학과 홍승범 교수 연구팀이 KAIST 10대 플래그쉽 분야이자, 글로벌 특이점 과제인 `KAIST 신소재 혁명: M3I3 이니셔티브' 과제의 배경, 역사, 진행 상황 그리고 미래 방향을 제시했다고 31일 밝혔다.

홍 교수 연구팀은 다중스케일 다중모드 영상화 기술과 머신러닝(기계학습) 기법을 융합해서 고차원의 구조-물성 및 공정-구조 상관관계를 도출했다. 그리고 이를 인공지능과 3차원 다중 스케일 프린팅 기술을 활용해서 신소재 디자인부터 시장 진입까지의 기간을 획기적으로 단축할 수 있는 비전과 실행 플랫폼을 제안했다. M3I3 플랫폼은 고용량 에너지 소재 디자인에서 시작해서, 고밀도 메모리 소재, 고성능 자동차/항공 소재에도 응용 가능할 것으로 기대된다.

우리 대학 신소재공학과 홍승범 교수가 제1 저자로, 리오치하오 박사가 제2 저자로 참여하고, 육종민 교수, 변혜령 교수, 양용수 교수, 조은애 교수, 최벽파 교수, 이혁모 교수가 공동 저자로 참여한 이번 연구는 국제 학술지 `에이씨에스 나노(ACS Nano)' 2월 12일 字 온라인 출판됐다. (논문명 : Reducing Time to Discovery: Materials and Molecular Modeling, Imaging, Informatics, and Integration)

역사의 큰 흐름을 결정한 신소재는 시행착오와 도제식의 비결 전수를 통해서 발견 및 개발돼왔다. 각종 무기와 그릇, 그리고 장신구들이 좋은 예다. 광학현미경이 발명되면서 검의 미세구조와 검의 강도 혹은 경도 간의 상관관계를 이해하기 시작했고, 투과전자현미경과 원자간력 현미경의 발명으로 원자 수준의 분해능으로 신소재를 영상화하기 시작했다.

고려청자를 현재 재현하지 못하는 것은 고려 시대의 장인들이 그 비결을 남기지 않았기 때문이라고 우리는 가르치고 있다. 그러나, 미래에는 고려청자의 다중 스케일 구조를 영상화해서 데이터화 하고, 구조를 구현할 수 있는 공정 과정을 머신러닝의 힘을 빌려 역설계한다면, 고려청자를 재현하는 일은 가능할 것으로 보인다.

우리 대학 M3I3 플랫폼은 이처럼 다중 스케일 및 다중 모드 영상화 기술, 데이터 마이닝과 머신러닝, 그리고 다중 스케일 제조 기술을 접목해 미래에 필요한 신소재를 역설계해서 빠르게 공정 레시피를 확보할 수 있게 만들어준다.

이번 논문에서는 M3I3 플랫폼의 유효성을 확인하기 위해 배터리 소재에 적용하는 연구를 진행했다. 고용량 배터리 소재의 개발 기간을 단축할 수 있다는 것을 검증하기 위해서 20년간의 논문 자료를 50여 명의 학생이 읽고 데이터를 추출해 양극재의 에너지 밀도와 소재 조성 간의 상관관계를 도출했다. 그리고 논문에 나와 있는 공정, 측정 및 구조 변수들을 머신러닝 기법을 활용해 모델을 수립한 후, 무작위 조건에서 합성해 모델의 정확도를 측정함으로써 데이터 마이닝과 머신러닝의 우수성을 입증했다.

또한 투과전자현미경(TEM), 주사투과전자현미경(STEM), 원자간력현미경(AFM), 광학현미경 등의 다양한 현미경과 엑스레이(X-ray), 라만(Raman), UV/Visible/IR 등 다양한 분광 장비들을 통해 얻은 영상과 스펙트럼 데이터를 기반으로 다중 스케일 구조↔물성 상관관계를 도출하고, 여러 가지 공정변수 데이터를 수집해, 공정↔구조 상관관계를 수립하는 것이 M3I3 플랫폼의 중요한 핵심이다. 특히, 실험데이터와 시뮬레이션 데이터를 융합하고, 머신러닝으로 생성한 가상의 데이터를 과학적인 기준에 맞춰 유의미한 빅데이터로 만들면, 머신러닝을 활용해 물성→구조→공정으로 연결되는 역설계 알고리즘을 개발하는 것이 가능해지며, 이를 통해 미래에 필요한 물성을 갖는 신소재 공정 레시피를 신속하게 확보할 수 있게 된다.

제1 저자인 홍승범 교수는 "과학은 날카로운 관찰과 정량적 측정에서 시작한 학문이며, 기술의 발전으로 현재는 눈에 보이는 소재의 모양과 구조뿐만 아니라 눈에 보이지 않는 소재의 구조를 볼 수 있는 시대가 왔고, 물성마저 공간과 시간의 함수로 영상화할 수 있는 시대가 도래했다ˮ라며 "신소재 영상화 기술과 머신러닝 기술을 융합하고 3D 프린팅 기술을 다중 스케일 자동 합성 기술로 승화시키게 되면 20년 걸리던 신소재 개발 기간을 5년 이내로 단축할 수 있을 것이다ˮ 라고 말했다.

한편, 이번 연구는 글로벌 특이점 사업의 지원을 받아 수행됐다.

2021.04.01 조회수 86252

신소재 영상화 및 머신러닝을 활용한 미래 개척

우리 대학 신소재공학과 홍승범 교수 연구팀이 KAIST 10대 플래그쉽 분야이자, 글로벌 특이점 과제인 `KAIST 신소재 혁명: M3I3 이니셔티브' 과제의 배경, 역사, 진행 상황 그리고 미래 방향을 제시했다고 31일 밝혔다.

홍 교수 연구팀은 다중스케일 다중모드 영상화 기술과 머신러닝(기계학습) 기법을 융합해서 고차원의 구조-물성 및 공정-구조 상관관계를 도출했다. 그리고 이를 인공지능과 3차원 다중 스케일 프린팅 기술을 활용해서 신소재 디자인부터 시장 진입까지의 기간을 획기적으로 단축할 수 있는 비전과 실행 플랫폼을 제안했다. M3I3 플랫폼은 고용량 에너지 소재 디자인에서 시작해서, 고밀도 메모리 소재, 고성능 자동차/항공 소재에도 응용 가능할 것으로 기대된다.

우리 대학 신소재공학과 홍승범 교수가 제1 저자로, 리오치하오 박사가 제2 저자로 참여하고, 육종민 교수, 변혜령 교수, 양용수 교수, 조은애 교수, 최벽파 교수, 이혁모 교수가 공동 저자로 참여한 이번 연구는 국제 학술지 `에이씨에스 나노(ACS Nano)' 2월 12일 字 온라인 출판됐다. (논문명 : Reducing Time to Discovery: Materials and Molecular Modeling, Imaging, Informatics, and Integration)

역사의 큰 흐름을 결정한 신소재는 시행착오와 도제식의 비결 전수를 통해서 발견 및 개발돼왔다. 각종 무기와 그릇, 그리고 장신구들이 좋은 예다. 광학현미경이 발명되면서 검의 미세구조와 검의 강도 혹은 경도 간의 상관관계를 이해하기 시작했고, 투과전자현미경과 원자간력 현미경의 발명으로 원자 수준의 분해능으로 신소재를 영상화하기 시작했다.

고려청자를 현재 재현하지 못하는 것은 고려 시대의 장인들이 그 비결을 남기지 않았기 때문이라고 우리는 가르치고 있다. 그러나, 미래에는 고려청자의 다중 스케일 구조를 영상화해서 데이터화 하고, 구조를 구현할 수 있는 공정 과정을 머신러닝의 힘을 빌려 역설계한다면, 고려청자를 재현하는 일은 가능할 것으로 보인다.

우리 대학 M3I3 플랫폼은 이처럼 다중 스케일 및 다중 모드 영상화 기술, 데이터 마이닝과 머신러닝, 그리고 다중 스케일 제조 기술을 접목해 미래에 필요한 신소재를 역설계해서 빠르게 공정 레시피를 확보할 수 있게 만들어준다.

이번 논문에서는 M3I3 플랫폼의 유효성을 확인하기 위해 배터리 소재에 적용하는 연구를 진행했다. 고용량 배터리 소재의 개발 기간을 단축할 수 있다는 것을 검증하기 위해서 20년간의 논문 자료를 50여 명의 학생이 읽고 데이터를 추출해 양극재의 에너지 밀도와 소재 조성 간의 상관관계를 도출했다. 그리고 논문에 나와 있는 공정, 측정 및 구조 변수들을 머신러닝 기법을 활용해 모델을 수립한 후, 무작위 조건에서 합성해 모델의 정확도를 측정함으로써 데이터 마이닝과 머신러닝의 우수성을 입증했다.

또한 투과전자현미경(TEM), 주사투과전자현미경(STEM), 원자간력현미경(AFM), 광학현미경 등의 다양한 현미경과 엑스레이(X-ray), 라만(Raman), UV/Visible/IR 등 다양한 분광 장비들을 통해 얻은 영상과 스펙트럼 데이터를 기반으로 다중 스케일 구조↔물성 상관관계를 도출하고, 여러 가지 공정변수 데이터를 수집해, 공정↔구조 상관관계를 수립하는 것이 M3I3 플랫폼의 중요한 핵심이다. 특히, 실험데이터와 시뮬레이션 데이터를 융합하고, 머신러닝으로 생성한 가상의 데이터를 과학적인 기준에 맞춰 유의미한 빅데이터로 만들면, 머신러닝을 활용해 물성→구조→공정으로 연결되는 역설계 알고리즘을 개발하는 것이 가능해지며, 이를 통해 미래에 필요한 물성을 갖는 신소재 공정 레시피를 신속하게 확보할 수 있게 된다.

제1 저자인 홍승범 교수는 "과학은 날카로운 관찰과 정량적 측정에서 시작한 학문이며, 기술의 발전으로 현재는 눈에 보이는 소재의 모양과 구조뿐만 아니라 눈에 보이지 않는 소재의 구조를 볼 수 있는 시대가 왔고, 물성마저 공간과 시간의 함수로 영상화할 수 있는 시대가 도래했다ˮ라며 "신소재 영상화 기술과 머신러닝 기술을 융합하고 3D 프린팅 기술을 다중 스케일 자동 합성 기술로 승화시키게 되면 20년 걸리던 신소재 개발 기간을 5년 이내로 단축할 수 있을 것이다ˮ 라고 말했다.

한편, 이번 연구는 글로벌 특이점 사업의 지원을 받아 수행됐다.

2021.04.01 조회수 86252 딥페이크 탐지 모바일 앱 서비스 개시

우리 대학 전산학부 이흥규 교수 연구팀이 인공신경망 기반 딥페이크(deepfake) 탐지와 사진 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'를 모바일 앱 형태로 개발해 서비스를 시작한다고 30일 밝혔다. 이는 디지털콘텐츠 위변조 탐지가 필요한 공공기관, 산업계, 언론 및 방송사, 각종 포털 종사자들 및 일반인들도 손쉽게 활용할 수 있을 것으로 기대된다.

이번 모바일 앱 서비스는 본격적으로 일반인들도 손쉽게 디지털콘텐츠 위변조 탐지 기술을 활용할 수 있도록 실용화 단계로 들어섰다는 점에서 의미가 크다. KAIST에서 딥페이크 영상을 포함해 각종 위변조 사진들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어를 모바일 앱 형태로 개발해 서비스를 시작하는데 이러한 유형의 서비스로는 국내 최초다. 구글스토어에서 `카이캐치'를 검색해 앱을 다운로드하면 간단하게 딥페이크 및 이미지 위변조 분석을 할 수 있다.

주로 사람의 얼굴을 대상으로 하는 딥페이크 기술은 얼굴 교체, 얼굴 재현, 얼굴 속성 변환으로 크게 3가지 유형으로 나눌 수 있다. 그중 얼굴 교체와 얼굴 재현은 악의적으로 사용할 때 가짜 뉴스로 사회적 큰 혼란을 일으킬 수 있고 음란물 제작 등에도 악용돼 개인의 인권을 크게 침해할 수 있다. 또한, 얼굴 속성 변환은 영상 증거를 조작하는데 악용될 수 있다.

연구팀이 개발한 기술은 딥페이크 생성 유형에 상관없이 딥페이크 여부를 탐지하기 위해 영상의 미세 변형 신호 흔적과 미세 이상 신호 흔적 탐지 기술을 적용한 신호처리 및 인공지능 기술로 개발됐다. 이러한 핵심 기술들을 사용해, 얼굴 영역의 미세 변형과 코, 입, 얼굴 윤곽 등 얼굴 내 기하학적 왜곡 발생 가능 영역의 이상 신호 흔적을 분석해 딥페이크를 탐지한다.

딥페이크 탐지 기술의 경우, avi 나 mp4 형식의 딥페이크 의심 동영상이 주어지면 개별 프레임으로 자른 뒤 분석하고자 하는 프레임을 이미지로 변환 후 딥페이크 탐지를 수행한다. 동영상 내의 얼굴이 지나치게 작거나(해상도 128×128 이하) 동영상 내 사람 얼굴이 상당 부분 잘린 경우가 아니면 정상적인 탐지가 가능하다. 따라서 동영상의 한 프레임을 잘라 이미지로 만들어 카이캐치 앱에 업로드하면 손쉽게 딥페이크 여부를 확인할 수 있다. 분석 결과는 0에서 100 (%) 값으로 표시되며 숫자가 높을수록 딥페이크일 확률이 높은 것으로 판단한다.

사진 위변조 탐지 기술의 경우도 마찬가지로 카이캐치 앱에 해당 이미지를 업로드하면 위변조 분석 결과를 받아 볼 수 있다. 카이캐치는 BMP, TIF, TIFF, PNG 등 무압축, 무손실 압축을 포함해 50여 개의 표준 양자화 테이블과 1,000여 개가 넘는 비표준화된 양자화 테이블에 기반한 JPEG 이미지들도 모두 처리할 수 있다. 사진 위변조가 의심되는 이미지를 업로드하면 해당 이미지를 분석한 결과를 시각화한 두 장의 분석 이미지를 도출하며, 분석 이미지 내에 위변조가 의심되는 특징들이 포함된 주요 영역들이 다른 주변 영역들과 색상이 크게 다르거나, 또는 주요 영역들에만 다양한 색상들이 혼재해 나타나면 해당 영역이 위변조된 것으로 일반인들도 간단하게 판단할 수 있다.

이번에 개발한 모바일용 위변조 탐지 앱 개발은 국내 최초이자 선진국에서도 찾기 어려운 위변조 탐지 앱 서비스 기술이다. 이흥규 교수는 "카이캐치는 인공지능과 미세 이상 신호 흔적 분석 기법이라는 첨단 기술을 사용해 다양한 유형의 변형에 대응한 범용성을 가지도록 개발됐다”며 "우리가 예측하지 못하거나 모르는 변형 기법을 사용해도 90% 내외의 높은 신뢰도로 탐지한다”고 말했다.

이 교수는 이어 "이번에는 안드로이드 기반의 모바일 환경에서만 동작하는 앱 서비스 기술로 개발됐지만 가까운 기간내 애플 iOS 기반의 앱 출시와 함께, 영어, 중국어, 일어 앱 들도 출시하려고 한다ˮ며 "기존 탐지 기법과는 매우 상이한 기법들을 사용한 위변조 탐지 기술도 실용화해 카이캐치에 추가 탑재 운용함으로써, 탐지가 안 되는 각종 예외 경우들을 대폭 줄이도록 노력하겠다ˮ 고 덧붙였다.

한편 이번 연구는 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과 산학협력 연구로 수행됐다.

2021.03.31 조회수 85550

딥페이크 탐지 모바일 앱 서비스 개시

우리 대학 전산학부 이흥규 교수 연구팀이 인공신경망 기반 딥페이크(deepfake) 탐지와 사진 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'를 모바일 앱 형태로 개발해 서비스를 시작한다고 30일 밝혔다. 이는 디지털콘텐츠 위변조 탐지가 필요한 공공기관, 산업계, 언론 및 방송사, 각종 포털 종사자들 및 일반인들도 손쉽게 활용할 수 있을 것으로 기대된다.

이번 모바일 앱 서비스는 본격적으로 일반인들도 손쉽게 디지털콘텐츠 위변조 탐지 기술을 활용할 수 있도록 실용화 단계로 들어섰다는 점에서 의미가 크다. KAIST에서 딥페이크 영상을 포함해 각종 위변조 사진들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어를 모바일 앱 형태로 개발해 서비스를 시작하는데 이러한 유형의 서비스로는 국내 최초다. 구글스토어에서 `카이캐치'를 검색해 앱을 다운로드하면 간단하게 딥페이크 및 이미지 위변조 분석을 할 수 있다.

주로 사람의 얼굴을 대상으로 하는 딥페이크 기술은 얼굴 교체, 얼굴 재현, 얼굴 속성 변환으로 크게 3가지 유형으로 나눌 수 있다. 그중 얼굴 교체와 얼굴 재현은 악의적으로 사용할 때 가짜 뉴스로 사회적 큰 혼란을 일으킬 수 있고 음란물 제작 등에도 악용돼 개인의 인권을 크게 침해할 수 있다. 또한, 얼굴 속성 변환은 영상 증거를 조작하는데 악용될 수 있다.

연구팀이 개발한 기술은 딥페이크 생성 유형에 상관없이 딥페이크 여부를 탐지하기 위해 영상의 미세 변형 신호 흔적과 미세 이상 신호 흔적 탐지 기술을 적용한 신호처리 및 인공지능 기술로 개발됐다. 이러한 핵심 기술들을 사용해, 얼굴 영역의 미세 변형과 코, 입, 얼굴 윤곽 등 얼굴 내 기하학적 왜곡 발생 가능 영역의 이상 신호 흔적을 분석해 딥페이크를 탐지한다.

딥페이크 탐지 기술의 경우, avi 나 mp4 형식의 딥페이크 의심 동영상이 주어지면 개별 프레임으로 자른 뒤 분석하고자 하는 프레임을 이미지로 변환 후 딥페이크 탐지를 수행한다. 동영상 내의 얼굴이 지나치게 작거나(해상도 128×128 이하) 동영상 내 사람 얼굴이 상당 부분 잘린 경우가 아니면 정상적인 탐지가 가능하다. 따라서 동영상의 한 프레임을 잘라 이미지로 만들어 카이캐치 앱에 업로드하면 손쉽게 딥페이크 여부를 확인할 수 있다. 분석 결과는 0에서 100 (%) 값으로 표시되며 숫자가 높을수록 딥페이크일 확률이 높은 것으로 판단한다.

사진 위변조 탐지 기술의 경우도 마찬가지로 카이캐치 앱에 해당 이미지를 업로드하면 위변조 분석 결과를 받아 볼 수 있다. 카이캐치는 BMP, TIF, TIFF, PNG 등 무압축, 무손실 압축을 포함해 50여 개의 표준 양자화 테이블과 1,000여 개가 넘는 비표준화된 양자화 테이블에 기반한 JPEG 이미지들도 모두 처리할 수 있다. 사진 위변조가 의심되는 이미지를 업로드하면 해당 이미지를 분석한 결과를 시각화한 두 장의 분석 이미지를 도출하며, 분석 이미지 내에 위변조가 의심되는 특징들이 포함된 주요 영역들이 다른 주변 영역들과 색상이 크게 다르거나, 또는 주요 영역들에만 다양한 색상들이 혼재해 나타나면 해당 영역이 위변조된 것으로 일반인들도 간단하게 판단할 수 있다.

이번에 개발한 모바일용 위변조 탐지 앱 개발은 국내 최초이자 선진국에서도 찾기 어려운 위변조 탐지 앱 서비스 기술이다. 이흥규 교수는 "카이캐치는 인공지능과 미세 이상 신호 흔적 분석 기법이라는 첨단 기술을 사용해 다양한 유형의 변형에 대응한 범용성을 가지도록 개발됐다”며 "우리가 예측하지 못하거나 모르는 변형 기법을 사용해도 90% 내외의 높은 신뢰도로 탐지한다”고 말했다.

이 교수는 이어 "이번에는 안드로이드 기반의 모바일 환경에서만 동작하는 앱 서비스 기술로 개발됐지만 가까운 기간내 애플 iOS 기반의 앱 출시와 함께, 영어, 중국어, 일어 앱 들도 출시하려고 한다ˮ며 "기존 탐지 기법과는 매우 상이한 기법들을 사용한 위변조 탐지 기술도 실용화해 카이캐치에 추가 탑재 운용함으로써, 탐지가 안 되는 각종 예외 경우들을 대폭 줄이도록 노력하겠다ˮ 고 덧붙였다.

한편 이번 연구는 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과 산학협력 연구로 수행됐다.

2021.03.31 조회수 85550