-

카이캐치(KaiCatch), 악성 동영상 위변조 탐지 기술 개발

우리 대학 전산학부 이흥규 명예교수 연구팀이 KAIST 창업기업인 ㈜디지탈이노텍의 후원으로 악성 위변조에 활용되는 프레임 업 변환, 보간법에 의해 생성된 프레임, 영상내 위변조 영역 등을 탐지하는 동영상 위변조 탐지 기술을 개발했다.

위변조 분야 최상위 저명 논문지인 Forensic Science International 11월호에 논문으로도 발표했다.

CCTV의 대량 보급과 함께 동영상은 수많은 분쟁시 주요 증거물로 사용되고 있다. 그러나 동영상에 대한 편집 도구 기술과 인공지능 기술 발전과 함께 동영상의 편집, 프레임 삭제 및 추가 등의 위변조를 포함하여 프레임 업 변환 이라는 기술을 사용하여 위변조 동영상을 고품질 영상으로 변환함으로써 위변조 동영상을 원본과 유사하게 변환함으로써 위변조 탐지를 더욱 어렵게 하는 악성 변조 기술 등도 등장하고 있다.

이번 연구에서는 동영상내 특정 영역들의 편집 변조를 포함하여 프레임 추가, 삭제, 프레임률 변환 탐지를 포함하여 공간정보와 시간정보를 연속적으로 활용하는 프레임-업 변환을 탐지하기 위해 프레임-업 특징들을 추출하는 4개 유형의 네트워크블럭들과 보팅(voting) 기능을 채택한 프레임-업 탐지 뉴럴 네트워크를 제시하였다.

개발된 기술은 특히 동영상의 극히 작은 영역들의 정보를 사용하여 무결성 여부를 판독하기 때문에 동영상 위변조 탐지를 고속으로 수행할 수 있어 기존 기술들과 비교하여 기술의 유용성과 실용성이 매우 뛰어나다.

이번 연구는 KAIST 윤민석 박사, ㈜네이버웹튠AI의 남승훈 박사 등이 참여하였으며 KAIST에서 위변조를 잡아낸다는 의미인 카이캐치(KaiCatch) 위변조 탐지 소프트웨어 기능을 동영상으로도 크게 확장 했다는 점에서 그 의미가 있다.

개발된 기술은 영상 위변조 분야 최상위 저명 논문지인 Forensic Science International 2022년 11월호(Vol 340)에 ‘Frame-rate Up-conversion Detection based on Convolutional Neural Network for Learning Spatiotemporal Features’ 논문으로 발표 되었다. 본 연구는 한국연구재단 창의도전연구기반지원사업과 KAIST 창업기업인 ㈜디지탈이노텍의 후원으로 수행하였다.

카이캐치(KaiCatch), 악성 동영상 위변조 탐지 기술 개발

우리 대학 전산학부 이흥규 명예교수 연구팀이 KAIST 창업기업인 ㈜디지탈이노텍의 후원으로 악성 위변조에 활용되는 프레임 업 변환, 보간법에 의해 생성된 프레임, 영상내 위변조 영역 등을 탐지하는 동영상 위변조 탐지 기술을 개발했다.

위변조 분야 최상위 저명 논문지인 Forensic Science International 11월호에 논문으로도 발표했다.

CCTV의 대량 보급과 함께 동영상은 수많은 분쟁시 주요 증거물로 사용되고 있다. 그러나 동영상에 대한 편집 도구 기술과 인공지능 기술 발전과 함께 동영상의 편집, 프레임 삭제 및 추가 등의 위변조를 포함하여 프레임 업 변환 이라는 기술을 사용하여 위변조 동영상을 고품질 영상으로 변환함으로써 위변조 동영상을 원본과 유사하게 변환함으로써 위변조 탐지를 더욱 어렵게 하는 악성 변조 기술 등도 등장하고 있다.

이번 연구에서는 동영상내 특정 영역들의 편집 변조를 포함하여 프레임 추가, 삭제, 프레임률 변환 탐지를 포함하여 공간정보와 시간정보를 연속적으로 활용하는 프레임-업 변환을 탐지하기 위해 프레임-업 특징들을 추출하는 4개 유형의 네트워크블럭들과 보팅(voting) 기능을 채택한 프레임-업 탐지 뉴럴 네트워크를 제시하였다.

개발된 기술은 특히 동영상의 극히 작은 영역들의 정보를 사용하여 무결성 여부를 판독하기 때문에 동영상 위변조 탐지를 고속으로 수행할 수 있어 기존 기술들과 비교하여 기술의 유용성과 실용성이 매우 뛰어나다.

이번 연구는 KAIST 윤민석 박사, ㈜네이버웹튠AI의 남승훈 박사 등이 참여하였으며 KAIST에서 위변조를 잡아낸다는 의미인 카이캐치(KaiCatch) 위변조 탐지 소프트웨어 기능을 동영상으로도 크게 확장 했다는 점에서 그 의미가 있다.

개발된 기술은 영상 위변조 분야 최상위 저명 논문지인 Forensic Science International 2022년 11월호(Vol 340)에 ‘Frame-rate Up-conversion Detection based on Convolutional Neural Network for Learning Spatiotemporal Features’ 논문으로 발표 되었다. 본 연구는 한국연구재단 창의도전연구기반지원사업과 KAIST 창업기업인 ㈜디지탈이노텍의 후원으로 수행하였다.

2022.10.20

조회수 4583

-

인공지능 엔진으로 영상 위변조 탐지 기술 개발

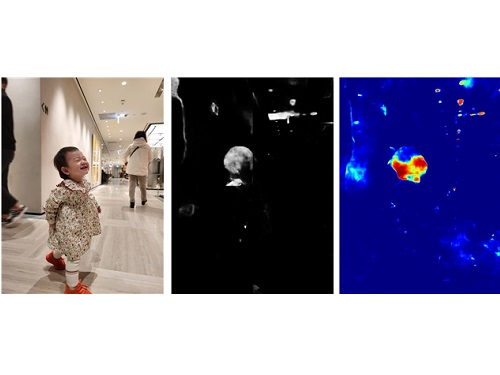

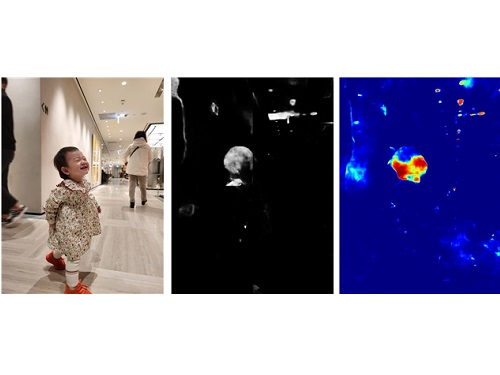

우리 연구진이 영상 내 변형 영역을 더욱 정밀하게 탐지하기 위해 영상내 색상 정보와 주파수 정보를 함께 활용하는 인공지능 엔진 기술을 학계 처음으로 개발했다. 이번 개발 기술은 기존 기술보다 정밀도와 정확도를 크게 높여 위변조 탐지 기술의 기술 유용성을 일정 수준 확보할 수 있는 기반을 제공한다는 점에서 그 의미가 크다. KAIST에서 각종 위변조 영상들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어는 이미지, 영상뿐만 아니라 CCTV 비디오 변형 여부도 분석할 수 있다.

우리 대학 전산학부 이흥규 교수 연구팀이 새로운 인공지능 구조와학습 방법론, 그리고 실험실 환경에서는 구하기 힘든 고급 변형 이미지 영상들을 사용해 영상 이미지 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'의 영상 이미지 정밀도와 정확도를 크게 높일 뿐만 아니라 비디오 편집 변형도 탐지할 수 있는 카이캐치 2.1 버전을 개발했다고 13일 밝혔다.

카이캐치 소프트웨어는 `이상(異常) 유형 분석 엔진'과 `이상(異常) 영역 추정 엔진' 두 개의 인공지능 엔진으로 구성된다. `이상 유형 분석 엔진'은 블러링, 노이즈, 크기 변화, 명암 대비 변화, 모핑, 리샘플링 등을 필수 변이로 정의해 이를 탐지하며 `이상 영역 추정 엔진'은 이미지 짜깁기, 잘라 붙이기, 복사 붙이기, 복사 이동 등을 탐지한다. 이번에 새로 개발한 기술은 `이상 영역 추정 엔진'으로 기존 기술에서는 이상 영역 탐지 시 그레이 스케일(회색조)로 이상 유무를 탐지하였으나 분석 신호의 표현력이 낮고 탐지 오류가 많아 위변조 여부 판정에 어려움이 많았다. 이번에 개발된 기술은 색상 정보와 주파수 정보를 함께 활용해 정밀도(precision)와 재현율(recall)이 크게 향상되고 변형 영역을 컬러 스케일로 표현함으로써 해당 영역의 이상 유무뿐만 아니라 위변조 여부도 더욱 명확하게 판별이 가능해졌다.

연구팀은 이번 연구에서 영상 생성 시 발생하는 흔적과 압축 시 발생하는 흔적 신호들을 함께 분석하기 위해 색상 정보와 주파수 정보를 모두 활용하는 접근 방법을 학계 처음으로 제시했다. 또 이러한 방법론을 설계 구현하기 위해 주파수 정보를 하나의 분할 네트워크에서 직접 입력으로 받아들이는 방식의 ‘압축 왜곡신호 탐지 네트워크(Compression Artifact Tracing Network, 이하 CAT-Net)’을 학계 최초로 개발하고 기존 기법들과 비교해 탐지 성능이 크게 뛰어남을 입증했다. 개발한 기술은 기존에 제시된 기법들과 비교할 때 특히 원본과 변형본을 판별하는 평가 척도인 F1 점수, 평균 정밀도(average precision)에서 대단히 뛰어나 실환경 위변조 탐지 능력이 크게 강화됐다.

비디오 편집 변형의 경우도, 프레임 삭제, 추가 등에 의한 편집 변형이 흔히 CCTV 비디오 등에서 발생한다는데 착안해 이러한 비디오 편집 변형을 탐지하는 기능 역시 이번 카이캐치 2.1 버전에 탑재됐다.

이번에 카이캐치 2.1 소프트웨어를 연구 개발한 이흥규 교수는 "영상 이미지 위변조 소프트웨어인 카이캐치를 휴대폰에 탑재되는 안드로이드 앱 형태로 일반에 소개한 2021년 3월 이후 현재까지 카이캐치 앱을 통한 900여 건의 위변조 분석 의뢰와 개별적으로 60건이 넘는 정밀 위변조 분석 의뢰를 받았다. KAIST 발표 논문 수준이나 실험 결과 등을 감안할 때 위변조 분야 최고 기술로 만든 소프트웨어인데, 오탐지율이 높아 실제 탐지 정밀도가 이론치보다 매우 낮았다. 많은 경우 위변조나 변형 여부에 대한 명확한 기술 판정이 불가능했으나 이번에 개발한 카이캐치 2.1 은 CAT-Net이라는 새로운 네트워크 구조와 학습 방법론, 그리고 ‘색상 및 주파수 영역 왜곡 흔적 동시 분석’이라는 첨단 기술을 사용해 정밀도를 높여, 보다 명확한 판별이 가능하도록 개발됐다. 앞으로 영상 위변조 판단 여부가 어려운 경우가 많이 줄어들기를 기대한다”고 말했다.

이 교수는 이어 "비디오는 MP4 파일 포맷이, 그리고 영상 이미지는 JPEG 이미지들이 일반인들이 널리 사용한다는 점에서 해당 포맷을 주 개발 대상으로 삼았다. 영상 이미지의 경우 영상 편집 변형 시 영상에 남겨지는 인위적으로 발생하는 JPEG 압축 미세 신호 탐지에 주안점을 두어, 위변조 여부와 위변조 영역을 잡아내는 것에 집중했다. 비디오의 경우 특정 프레임들을 삭제하거나 삽입하는 경우, 프레임 부분 편집 후 재압축 하는 경우 등을 탐지한다. 최근 CCTV 비디오 편집 여부에 대한 분쟁이 많아 크게 도움을 줄 수 있을 것으로 기대하며 향후에도 지속적으로 연구 개발해 취약점들을 보완해 나갈 계획이다ˮ 고 덧붙였다.

현재 카이캐치 소프트웨어는 안드로이드 기반 휴대폰의 구글 플레이스토어에서 ‘카이캐치’를 검색하여 앱을 다운로드 받아 설치한 후, 영상 이미지들을 카이캐치에 업로드하면 위변조 여부를 간단하게 테스트해 볼 수 있다.

한편 이번 연구는 제1 저자로 참여한 우리 대학 전기및전자공학부 권명준 박사, 그리고 김창익 교수, 남승훈 박사, 유인재 박사 등과 공동으로 수행됐으며, `스프링거 네이처(Springer Nature)'에서 발간하는 컴퓨터 비전 분야 톱 국제저널인 `국제 컴퓨터 비전 저널(International Journal of Computer Vision, IF 7.410)'에 2022년 5월 25일 字 온라인판에 게재됐다. (논문명 : Learning JPEG Compression Artifacts for Image Manipulation Detection and Localization)

이번 연구는 한국연구재단 창의도전연구기반지원사업지원과 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과의 산학협력 연구로 수행됐다.

인공지능 엔진으로 영상 위변조 탐지 기술 개발

우리 연구진이 영상 내 변형 영역을 더욱 정밀하게 탐지하기 위해 영상내 색상 정보와 주파수 정보를 함께 활용하는 인공지능 엔진 기술을 학계 처음으로 개발했다. 이번 개발 기술은 기존 기술보다 정밀도와 정확도를 크게 높여 위변조 탐지 기술의 기술 유용성을 일정 수준 확보할 수 있는 기반을 제공한다는 점에서 그 의미가 크다. KAIST에서 각종 위변조 영상들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어는 이미지, 영상뿐만 아니라 CCTV 비디오 변형 여부도 분석할 수 있다.

우리 대학 전산학부 이흥규 교수 연구팀이 새로운 인공지능 구조와학습 방법론, 그리고 실험실 환경에서는 구하기 힘든 고급 변형 이미지 영상들을 사용해 영상 이미지 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'의 영상 이미지 정밀도와 정확도를 크게 높일 뿐만 아니라 비디오 편집 변형도 탐지할 수 있는 카이캐치 2.1 버전을 개발했다고 13일 밝혔다.

카이캐치 소프트웨어는 `이상(異常) 유형 분석 엔진'과 `이상(異常) 영역 추정 엔진' 두 개의 인공지능 엔진으로 구성된다. `이상 유형 분석 엔진'은 블러링, 노이즈, 크기 변화, 명암 대비 변화, 모핑, 리샘플링 등을 필수 변이로 정의해 이를 탐지하며 `이상 영역 추정 엔진'은 이미지 짜깁기, 잘라 붙이기, 복사 붙이기, 복사 이동 등을 탐지한다. 이번에 새로 개발한 기술은 `이상 영역 추정 엔진'으로 기존 기술에서는 이상 영역 탐지 시 그레이 스케일(회색조)로 이상 유무를 탐지하였으나 분석 신호의 표현력이 낮고 탐지 오류가 많아 위변조 여부 판정에 어려움이 많았다. 이번에 개발된 기술은 색상 정보와 주파수 정보를 함께 활용해 정밀도(precision)와 재현율(recall)이 크게 향상되고 변형 영역을 컬러 스케일로 표현함으로써 해당 영역의 이상 유무뿐만 아니라 위변조 여부도 더욱 명확하게 판별이 가능해졌다.

연구팀은 이번 연구에서 영상 생성 시 발생하는 흔적과 압축 시 발생하는 흔적 신호들을 함께 분석하기 위해 색상 정보와 주파수 정보를 모두 활용하는 접근 방법을 학계 처음으로 제시했다. 또 이러한 방법론을 설계 구현하기 위해 주파수 정보를 하나의 분할 네트워크에서 직접 입력으로 받아들이는 방식의 ‘압축 왜곡신호 탐지 네트워크(Compression Artifact Tracing Network, 이하 CAT-Net)’을 학계 최초로 개발하고 기존 기법들과 비교해 탐지 성능이 크게 뛰어남을 입증했다. 개발한 기술은 기존에 제시된 기법들과 비교할 때 특히 원본과 변형본을 판별하는 평가 척도인 F1 점수, 평균 정밀도(average precision)에서 대단히 뛰어나 실환경 위변조 탐지 능력이 크게 강화됐다.

비디오 편집 변형의 경우도, 프레임 삭제, 추가 등에 의한 편집 변형이 흔히 CCTV 비디오 등에서 발생한다는데 착안해 이러한 비디오 편집 변형을 탐지하는 기능 역시 이번 카이캐치 2.1 버전에 탑재됐다.

이번에 카이캐치 2.1 소프트웨어를 연구 개발한 이흥규 교수는 "영상 이미지 위변조 소프트웨어인 카이캐치를 휴대폰에 탑재되는 안드로이드 앱 형태로 일반에 소개한 2021년 3월 이후 현재까지 카이캐치 앱을 통한 900여 건의 위변조 분석 의뢰와 개별적으로 60건이 넘는 정밀 위변조 분석 의뢰를 받았다. KAIST 발표 논문 수준이나 실험 결과 등을 감안할 때 위변조 분야 최고 기술로 만든 소프트웨어인데, 오탐지율이 높아 실제 탐지 정밀도가 이론치보다 매우 낮았다. 많은 경우 위변조나 변형 여부에 대한 명확한 기술 판정이 불가능했으나 이번에 개발한 카이캐치 2.1 은 CAT-Net이라는 새로운 네트워크 구조와 학습 방법론, 그리고 ‘색상 및 주파수 영역 왜곡 흔적 동시 분석’이라는 첨단 기술을 사용해 정밀도를 높여, 보다 명확한 판별이 가능하도록 개발됐다. 앞으로 영상 위변조 판단 여부가 어려운 경우가 많이 줄어들기를 기대한다”고 말했다.

이 교수는 이어 "비디오는 MP4 파일 포맷이, 그리고 영상 이미지는 JPEG 이미지들이 일반인들이 널리 사용한다는 점에서 해당 포맷을 주 개발 대상으로 삼았다. 영상 이미지의 경우 영상 편집 변형 시 영상에 남겨지는 인위적으로 발생하는 JPEG 압축 미세 신호 탐지에 주안점을 두어, 위변조 여부와 위변조 영역을 잡아내는 것에 집중했다. 비디오의 경우 특정 프레임들을 삭제하거나 삽입하는 경우, 프레임 부분 편집 후 재압축 하는 경우 등을 탐지한다. 최근 CCTV 비디오 편집 여부에 대한 분쟁이 많아 크게 도움을 줄 수 있을 것으로 기대하며 향후에도 지속적으로 연구 개발해 취약점들을 보완해 나갈 계획이다ˮ 고 덧붙였다.

현재 카이캐치 소프트웨어는 안드로이드 기반 휴대폰의 구글 플레이스토어에서 ‘카이캐치’를 검색하여 앱을 다운로드 받아 설치한 후, 영상 이미지들을 카이캐치에 업로드하면 위변조 여부를 간단하게 테스트해 볼 수 있다.

한편 이번 연구는 제1 저자로 참여한 우리 대학 전기및전자공학부 권명준 박사, 그리고 김창익 교수, 남승훈 박사, 유인재 박사 등과 공동으로 수행됐으며, `스프링거 네이처(Springer Nature)'에서 발간하는 컴퓨터 비전 분야 톱 국제저널인 `국제 컴퓨터 비전 저널(International Journal of Computer Vision, IF 7.410)'에 2022년 5월 25일 字 온라인판에 게재됐다. (논문명 : Learning JPEG Compression Artifacts for Image Manipulation Detection and Localization)

이번 연구는 한국연구재단 창의도전연구기반지원사업지원과 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과의 산학협력 연구로 수행됐다.

2022.06.13

조회수 5082

-

사진 위변조 탐지하는 실용 소프트웨어 개발

위조되거나 변조된 사진·영상자료를 손쉽게 탐지해내는 고성능 소프트웨어가 우리 연구진에 의해 개발됐다. 이 기술은 논문 발표 수준에만 머물러 있던 사진과 영상자료의 위·변조 탐지기술을 국내 최초로, 세계에서 두 번째로 실용화 단계로 끌어 올렸다는 점에서 의미가 크다.

우리 대학 전산학부 이흥규 교수 연구팀이 인공신경망을 이용해 디지털 형태의 사진 변형 여부를 광범위하게 탐지하는 실용 소프트웨어 `카이캐치(KAICATCH)'를 개발했다고 3일 밝혔다.

최근 딥페이크(deepfake)를 포함해 각종 위·변조 영상의 등장과 온라인 유통으로 인한 위·변조 탐지기술에 관한 관심이 급속히 증가하고 있다. 그러나 위·변조 여부를 직접 확인할 수 있는 객관적인 분석 도구가 없기 때문에 사실확인 작업이나 정황 판단 등에 의존해 진위를 판단함으로써 주관적 판단 여부의 논란 등 문제가 자주 발생하고 있다.

특히 기존의 디지털사진 포렌식 기술은 개개 변형의 유형에 대응해 개발돼서 변형 유형이 다양하거나, 사전 특정되기 전에는 일정 수준 이상의 높은 신뢰도를 확보하기가 어렵다. 즉, 기존 기술들은 제한된 형식과 알려진 특정 변형에 대해서는 만족할 만한 탐지 성능을 보여주지만, 어떤 변형들이 가해진 것인지 전혀 알 수 없는 임의의 디지털사진을 분석해야 하는 실제 상황에서는 판독의 정확성과 신뢰도가 크게 떨어질 수 밖에 없다.

다양한 변형이 가해진 채 온라인에서 유통되는 사진이나 영상에 대한 변형 여부의 탐지는 극소수 전문가들의 주관적인 판단의 영역에 머물러 왔기 때문에 이런 문제해결을 위해 많은 도전적 연구들이 진행되고 있다.

이흥규 교수 연구팀이 개발한 이 기술은 국내 최초이자 세계 두 번째로 거둔 쾌거이다. 연구팀은 일반인들을 대상으로 2015년 6월부터 `디지털 이미지 위·변조 식별 웹서비스'를 통해 수집한 30여만 장의 실 유통 이미지 데이터와 특징기반·신경망 기반의 포렌식 영상 데이터, 딥페이크와 스테고 분석을 위한 대량의 실험 영상자료를 정밀 분석해 활용한 연구 결과물이다.

이 교수팀은 특정 변형을 탐지하는 개개의 알고리즘들을 모아놓은 기존 기술의 한계를 극복하고, 다양한 변형에 대한 탐지를 유기적으로 통합하는 기술에 주목했다.

이를 위해 잘라 붙이기·복사 붙이기·지우기·이미지 내 물체 크기 변화와 이동·리터칭 등 일상적이면서 자주 발생하는 변형들에서 언제나 발생하는 변이들을 분류, 정리해 필수 변이로 정의하고 이들을 종합 탐지하는 연구를 수행했다. 그 결과 변형의 유형을 특정하지 못하는 상태에서도 변형이 발생했는지 여부를 판단함으로써 탐지 신뢰도를 크게 높였다.

연구팀은 이어 BMP·TIF·TIFF·PNG 등 무압축, 무손실 압축을 포함해 50여 개의 표준 양자화 테이블과 1,000여 개가 넘는 비표준화된 양자화 테이블에 기반한 JPEG 이미지들도 포괄적으로 처리하는 기술을 포함한 실용 소프트웨어를 개발하는 데 성공했다.

이 교수팀이 개발한 `카이캐치'는 전통적인 영상 포렌식 기술, 스테그 분석 기술 등 픽셀 단위의 미세한 변화를 탐지하는 기술들을 응용해, `이상 영역 추정 엔진'과 `이상 유형 분석 엔진' 두 개의 인공지능 엔진으로 구성됐으며 이를 기반으로 결과를 판단하고 사진에 대한 다양한 변형 탐지 기능과 사진의 변형 영역 추정 기능 등을 함께 제공한다.

이흥규 교수는 "다양한 변형 시 공통으로 발생하는 픽셀 수준에서의 변형 탐지와 인공지능 기술을 융합한 영상 포렌식 기술을 카이캐치에 담았는데 이 기술은 특히 임의의 환경에서 주어진 디지털사진의 변형 여부를 판단하는데 탁월한 성능을 보인다ˮ고 말했다.

이 교수는 이어 "향후 각종 편집 도구들의 고급 기능들에 대한 광범위한 탐지 기능을 추가하는 한편 현재 확보한 실험실 수준의 딥페이크 탐지 엔진과 일반 비디오 변형 탐지 엔진들도 실용화 수준으로 발전시켜 카이캐치에 탑재하겠다ˮ 고 덧붙였다.

한편 이번 연구는 우리 대학 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과 산학협력 연구로 수행됐다.

사진 위변조 탐지하는 실용 소프트웨어 개발

위조되거나 변조된 사진·영상자료를 손쉽게 탐지해내는 고성능 소프트웨어가 우리 연구진에 의해 개발됐다. 이 기술은 논문 발표 수준에만 머물러 있던 사진과 영상자료의 위·변조 탐지기술을 국내 최초로, 세계에서 두 번째로 실용화 단계로 끌어 올렸다는 점에서 의미가 크다.

우리 대학 전산학부 이흥규 교수 연구팀이 인공신경망을 이용해 디지털 형태의 사진 변형 여부를 광범위하게 탐지하는 실용 소프트웨어 `카이캐치(KAICATCH)'를 개발했다고 3일 밝혔다.

최근 딥페이크(deepfake)를 포함해 각종 위·변조 영상의 등장과 온라인 유통으로 인한 위·변조 탐지기술에 관한 관심이 급속히 증가하고 있다. 그러나 위·변조 여부를 직접 확인할 수 있는 객관적인 분석 도구가 없기 때문에 사실확인 작업이나 정황 판단 등에 의존해 진위를 판단함으로써 주관적 판단 여부의 논란 등 문제가 자주 발생하고 있다.

특히 기존의 디지털사진 포렌식 기술은 개개 변형의 유형에 대응해 개발돼서 변형 유형이 다양하거나, 사전 특정되기 전에는 일정 수준 이상의 높은 신뢰도를 확보하기가 어렵다. 즉, 기존 기술들은 제한된 형식과 알려진 특정 변형에 대해서는 만족할 만한 탐지 성능을 보여주지만, 어떤 변형들이 가해진 것인지 전혀 알 수 없는 임의의 디지털사진을 분석해야 하는 실제 상황에서는 판독의 정확성과 신뢰도가 크게 떨어질 수 밖에 없다.

다양한 변형이 가해진 채 온라인에서 유통되는 사진이나 영상에 대한 변형 여부의 탐지는 극소수 전문가들의 주관적인 판단의 영역에 머물러 왔기 때문에 이런 문제해결을 위해 많은 도전적 연구들이 진행되고 있다.

이흥규 교수 연구팀이 개발한 이 기술은 국내 최초이자 세계 두 번째로 거둔 쾌거이다. 연구팀은 일반인들을 대상으로 2015년 6월부터 `디지털 이미지 위·변조 식별 웹서비스'를 통해 수집한 30여만 장의 실 유통 이미지 데이터와 특징기반·신경망 기반의 포렌식 영상 데이터, 딥페이크와 스테고 분석을 위한 대량의 실험 영상자료를 정밀 분석해 활용한 연구 결과물이다.

이 교수팀은 특정 변형을 탐지하는 개개의 알고리즘들을 모아놓은 기존 기술의 한계를 극복하고, 다양한 변형에 대한 탐지를 유기적으로 통합하는 기술에 주목했다.

이를 위해 잘라 붙이기·복사 붙이기·지우기·이미지 내 물체 크기 변화와 이동·리터칭 등 일상적이면서 자주 발생하는 변형들에서 언제나 발생하는 변이들을 분류, 정리해 필수 변이로 정의하고 이들을 종합 탐지하는 연구를 수행했다. 그 결과 변형의 유형을 특정하지 못하는 상태에서도 변형이 발생했는지 여부를 판단함으로써 탐지 신뢰도를 크게 높였다.

연구팀은 이어 BMP·TIF·TIFF·PNG 등 무압축, 무손실 압축을 포함해 50여 개의 표준 양자화 테이블과 1,000여 개가 넘는 비표준화된 양자화 테이블에 기반한 JPEG 이미지들도 포괄적으로 처리하는 기술을 포함한 실용 소프트웨어를 개발하는 데 성공했다.

이 교수팀이 개발한 `카이캐치'는 전통적인 영상 포렌식 기술, 스테그 분석 기술 등 픽셀 단위의 미세한 변화를 탐지하는 기술들을 응용해, `이상 영역 추정 엔진'과 `이상 유형 분석 엔진' 두 개의 인공지능 엔진으로 구성됐으며 이를 기반으로 결과를 판단하고 사진에 대한 다양한 변형 탐지 기능과 사진의 변형 영역 추정 기능 등을 함께 제공한다.

이흥규 교수는 "다양한 변형 시 공통으로 발생하는 픽셀 수준에서의 변형 탐지와 인공지능 기술을 융합한 영상 포렌식 기술을 카이캐치에 담았는데 이 기술은 특히 임의의 환경에서 주어진 디지털사진의 변형 여부를 판단하는데 탁월한 성능을 보인다ˮ고 말했다.

이 교수는 이어 "향후 각종 편집 도구들의 고급 기능들에 대한 광범위한 탐지 기능을 추가하는 한편 현재 확보한 실험실 수준의 딥페이크 탐지 엔진과 일반 비디오 변형 탐지 엔진들도 실용화 수준으로 발전시켜 카이캐치에 탑재하겠다ˮ 고 덧붙였다.

한편 이번 연구는 우리 대학 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과 산학협력 연구로 수행됐다.

2020.11.04

조회수 22725

-

SSD보다 더 빠른 차세대 저장장치 만드는 기술 개발

데이터(DB)의 초고속·대용량 처리에 적합한 정보저장장치인 기존의 *NVMe 컨트롤러를 차세대 메모리 개발에 적합하도록 초당 입출력 처리 능력 등 각종 기능적 측면에서 성능을 대폭 향상시킨 차세대 NVMe 컨트롤러 관련 기술이 우리 연구진에 의해 세계 최초로 개발됐다. 연구진은 이와 함께 이 기술을 국내·외 대학과 연구소에 무상으로 공개함으로써 관련 연구비용을 대폭 절감할 수 있게 했다.

☞ NVMe(Non Volatile Memory express): 비휘발성 메모리 익스프레스. PCI 익스프레스(PCIe) 인터페이스를 기반으로 한 저장장치를 위한 통신 규격(프로토콜)이다. SATA 인터페이스 대비 최대 6배 이상의 속도를 낼 수 있어 초고속, 대용량 데이터 처리에 적합하다.

전기및전자공학부 정명수 교수 연구팀(컴퓨터 아키텍처 및 메모리 시스템 연구실)이 *SSD의 데이터 병렬 입출력 처리를 순수 하드웨어로 구현한 차세대 NVMe 컨트롤러 'OpenExpress'를 개발하는 데 성공했다고 4일 밝혔다.

☞ SSD(Solid State Drive): 자기디스크를 이용하는 데이터 저장장치인 하드디스크(HDD)와는 달리 반도체를 이용해 데이터를 저장하는 장치로서 빠른 속도로 데이터의 읽기와 쓰기가 가능하다. 발열과 소음도 적으며, 소형화‧경량화할 수 있는 장점이 있으나, 비싼 가격이 단점으로 꼽힌다.

정 교수의 관련 논문(논문명: OpenExpress: Fully Hardware Automated Open Research Framework for Future Fast NVMe Devices)은 지난달 18일 열린 시스템 분야 최우수 학술대회인 'The USENIX Annual Technical Conference (ATC), 2020'에서 발표됐는데 아시아권 단일저자가 작성한 논문이 USENIX ATC 학술대회에 채택된 것은 해당 학술대회가 시작된 1993년 이후 27년 만에 처음이다.

빠른 입출력 장치에 특화된 NVMe 인터페이스 기술은 하드디스크(HDD)용으로 설계된 기존의 SATA(Serial ATA) 규격이 SSD에서 제대로 성능을 발휘하지 못하자 이를 대체하기 위해 개발됐다. NVMe는 SSD 성능을 최대한 활용할 수 있도록 개발된 초고속 데이터 전송규격으로 자리를 잡았으며 현재 다양한 플래시 기반 저장장치에 적용되고 있다. NVMe는 또 학계와 산업계에서 차세대 메모리를 기반으로 한 시스템 장치 구성을 위해 계속 연구되고 있다.

전 세계 ICT 분야의 주요 기업들은 NVMe를 사용하는 데 필요한 하드웨어 NVMe 컨트롤러 관련 지식 재산권(IP) 확보를 위해 막대한 비용을 투자해 독자적인 개발에 나서고 있다. 하지만 해당 IP는 외부에 공개가 되지 않아 대학이나 연구소 등에서 이를 연구목적으로 사용하기에는 어려움이 많다. 미국 실리콘밸리에 있는 소수의 벤처기업이 자체적으로 개발한 IP를 일부 제공하지만 한 달에 약 4천만 원의 이용료를 내야 한다. 또 IP 수정을 위한 단일 사용 소스 코드를 받기 위해서는 복사본 당 약 1억 원을 지급해야 하는 등 막대한 비용지출이 필요하다.

이러한 문제해결을 위해 정명수 교수 연구팀은 자유롭게 수정이 가능한 하드웨어 NVMe 컨트롤러 지식 재산권(IP)인 `OpenExpress'를 개발하고 이를 무상으로 공개했다. 이 공개용 컨트롤러는 수십 개 이상의 하드웨어 기본 IP들과 여러 핵심 NVMe IP 코어로 구성돼 있다. 정 교수팀은 실제 성능평가를 위해 OpenExpress를 이용한 NVMe 하드웨어 컨트롤러를 프로토타입(시제품)으로 제작하고, OpenExpress에서 제공되는 모든 로직은 높은 주파수에서 동작하도록 설계했다.

'OpenExpress'를 이용해 개발한 FPGA 스토리지 카드 시제품은 최대 7GB/s의 대역폭을 지원한다. 따라서 초고속 차세대 메모리 등의 연구에 적합하며, 다양한 스토리지 서버 작업 부하를 비교 테스트에서도 인텔의 새로운 고성능 저장장치인 옵테인 SSD(Optane SSD)보다 76% 높은 대역폭과 68% 낮은 입출력 지연시간을 보였다. 사용자의 필요에 따라 실리콘 장치 합성을 하게 되면 훨씬 더 높은 성능을 도출할 수 있을 것으로 예상된다.

정 교수팀이 개발한 이 컨트롤러는 비영리를 목적으로 하는 대학 및 연구소들이라면 `OpenExpress' 공개 소스 규약 내에서 자유로운 사용과 함께 수정사용도 가능해서 차세대 메모리를 수용하는 NVMe의 컨트롤러와 소프트웨어 스택에 관한 연구에 적합하다.

정명수 교수는 "이번 연구성과를 공개했기 때문에 기존 SSD 기술을 이끄는 몇몇 세계 최고 기업들만이 갖고 있던 컨트롤러를 대학과 연구소에서도 이젠 무상 사용이 가능하다ˮ면서 "초고속 차세대 메모리 등 저장장치 시스템의 연구를 위한 초석을 다졌다는 점에서 의미가 있다ˮ고 강조했다.

한편 이번 연구는 차세대 메모리 개발 및 공급업체인 '멤레이(MemRay)'의 지원을 받아 진행됐으며 해당 연구에 대한 자세한 내용은 웹사이트(http://camelab.org)에서 확인할 수 있다.

SSD보다 더 빠른 차세대 저장장치 만드는 기술 개발

데이터(DB)의 초고속·대용량 처리에 적합한 정보저장장치인 기존의 *NVMe 컨트롤러를 차세대 메모리 개발에 적합하도록 초당 입출력 처리 능력 등 각종 기능적 측면에서 성능을 대폭 향상시킨 차세대 NVMe 컨트롤러 관련 기술이 우리 연구진에 의해 세계 최초로 개발됐다. 연구진은 이와 함께 이 기술을 국내·외 대학과 연구소에 무상으로 공개함으로써 관련 연구비용을 대폭 절감할 수 있게 했다.

☞ NVMe(Non Volatile Memory express): 비휘발성 메모리 익스프레스. PCI 익스프레스(PCIe) 인터페이스를 기반으로 한 저장장치를 위한 통신 규격(프로토콜)이다. SATA 인터페이스 대비 최대 6배 이상의 속도를 낼 수 있어 초고속, 대용량 데이터 처리에 적합하다.

전기및전자공학부 정명수 교수 연구팀(컴퓨터 아키텍처 및 메모리 시스템 연구실)이 *SSD의 데이터 병렬 입출력 처리를 순수 하드웨어로 구현한 차세대 NVMe 컨트롤러 'OpenExpress'를 개발하는 데 성공했다고 4일 밝혔다.

☞ SSD(Solid State Drive): 자기디스크를 이용하는 데이터 저장장치인 하드디스크(HDD)와는 달리 반도체를 이용해 데이터를 저장하는 장치로서 빠른 속도로 데이터의 읽기와 쓰기가 가능하다. 발열과 소음도 적으며, 소형화‧경량화할 수 있는 장점이 있으나, 비싼 가격이 단점으로 꼽힌다.

정 교수의 관련 논문(논문명: OpenExpress: Fully Hardware Automated Open Research Framework for Future Fast NVMe Devices)은 지난달 18일 열린 시스템 분야 최우수 학술대회인 'The USENIX Annual Technical Conference (ATC), 2020'에서 발표됐는데 아시아권 단일저자가 작성한 논문이 USENIX ATC 학술대회에 채택된 것은 해당 학술대회가 시작된 1993년 이후 27년 만에 처음이다.

빠른 입출력 장치에 특화된 NVMe 인터페이스 기술은 하드디스크(HDD)용으로 설계된 기존의 SATA(Serial ATA) 규격이 SSD에서 제대로 성능을 발휘하지 못하자 이를 대체하기 위해 개발됐다. NVMe는 SSD 성능을 최대한 활용할 수 있도록 개발된 초고속 데이터 전송규격으로 자리를 잡았으며 현재 다양한 플래시 기반 저장장치에 적용되고 있다. NVMe는 또 학계와 산업계에서 차세대 메모리를 기반으로 한 시스템 장치 구성을 위해 계속 연구되고 있다.

전 세계 ICT 분야의 주요 기업들은 NVMe를 사용하는 데 필요한 하드웨어 NVMe 컨트롤러 관련 지식 재산권(IP) 확보를 위해 막대한 비용을 투자해 독자적인 개발에 나서고 있다. 하지만 해당 IP는 외부에 공개가 되지 않아 대학이나 연구소 등에서 이를 연구목적으로 사용하기에는 어려움이 많다. 미국 실리콘밸리에 있는 소수의 벤처기업이 자체적으로 개발한 IP를 일부 제공하지만 한 달에 약 4천만 원의 이용료를 내야 한다. 또 IP 수정을 위한 단일 사용 소스 코드를 받기 위해서는 복사본 당 약 1억 원을 지급해야 하는 등 막대한 비용지출이 필요하다.

이러한 문제해결을 위해 정명수 교수 연구팀은 자유롭게 수정이 가능한 하드웨어 NVMe 컨트롤러 지식 재산권(IP)인 `OpenExpress'를 개발하고 이를 무상으로 공개했다. 이 공개용 컨트롤러는 수십 개 이상의 하드웨어 기본 IP들과 여러 핵심 NVMe IP 코어로 구성돼 있다. 정 교수팀은 실제 성능평가를 위해 OpenExpress를 이용한 NVMe 하드웨어 컨트롤러를 프로토타입(시제품)으로 제작하고, OpenExpress에서 제공되는 모든 로직은 높은 주파수에서 동작하도록 설계했다.

'OpenExpress'를 이용해 개발한 FPGA 스토리지 카드 시제품은 최대 7GB/s의 대역폭을 지원한다. 따라서 초고속 차세대 메모리 등의 연구에 적합하며, 다양한 스토리지 서버 작업 부하를 비교 테스트에서도 인텔의 새로운 고성능 저장장치인 옵테인 SSD(Optane SSD)보다 76% 높은 대역폭과 68% 낮은 입출력 지연시간을 보였다. 사용자의 필요에 따라 실리콘 장치 합성을 하게 되면 훨씬 더 높은 성능을 도출할 수 있을 것으로 예상된다.

정 교수팀이 개발한 이 컨트롤러는 비영리를 목적으로 하는 대학 및 연구소들이라면 `OpenExpress' 공개 소스 규약 내에서 자유로운 사용과 함께 수정사용도 가능해서 차세대 메모리를 수용하는 NVMe의 컨트롤러와 소프트웨어 스택에 관한 연구에 적합하다.

정명수 교수는 "이번 연구성과를 공개했기 때문에 기존 SSD 기술을 이끄는 몇몇 세계 최고 기업들만이 갖고 있던 컨트롤러를 대학과 연구소에서도 이젠 무상 사용이 가능하다ˮ면서 "초고속 차세대 메모리 등 저장장치 시스템의 연구를 위한 초석을 다졌다는 점에서 의미가 있다ˮ고 강조했다.

한편 이번 연구는 차세대 메모리 개발 및 공급업체인 '멤레이(MemRay)'의 지원을 받아 진행됐으며 해당 연구에 대한 자세한 내용은 웹사이트(http://camelab.org)에서 확인할 수 있다.

2020.08.04

조회수 22992

-

정유성 교수, 아태이론및계산화학회 포플 메달 수상

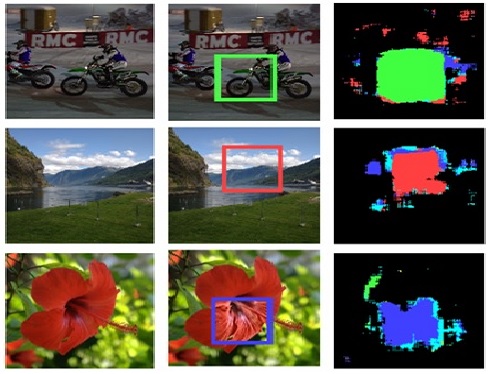

〈 정 유 성 교수 〉

우리 대학 EEWS대학원 정유성 교수가 아태이론 및 계산화학회(APATCC)가 수여하는 2018년도 ‘포플 메달(Pople Medal)’을 수상했다.

포플 메달은 양자역학 이론을 분자화학에 적용하기 위한 계산방법론을 개발한 공으로 1998년 노벨화학상을 수상한 존 포플 교수(John A. Pople)를 기념해 2007년 처음 제정됐다.

이 상은 매년 아시아-태평양 지역에서 연구업적이 우수한 만 45세 이하의 젊은 이론계산화학자 1인에게 주어진다.

정 교수는 기존의 양자화학 계산 정확도와 속도를 향상시키는 알고리즘들을 개발하고 이를 에너지 소재 개발에 응용해 관련 분야 발전에 기여한 공을 인정받았다. 지금까지 120편 이상의 논문을 전문 학술지에 발표했고 8천 회 이상의 피인용 횟수와 44의 H-지수를 기록 중이다.

정 교수는 “계산화학 분야의 권위 있는 포플 메달을 수상해 큰 영광이다”며 “앞으로는 양자화학과 인공지능 기술을 융합한 계산 방법론의 개발과 이를 에너지 소재 개발에 활용하는 연구로 분야에 기여하고 싶다” 고 말했다.

정유성 교수, 아태이론및계산화학회 포플 메달 수상

〈 정 유 성 교수 〉

우리 대학 EEWS대학원 정유성 교수가 아태이론 및 계산화학회(APATCC)가 수여하는 2018년도 ‘포플 메달(Pople Medal)’을 수상했다.

포플 메달은 양자역학 이론을 분자화학에 적용하기 위한 계산방법론을 개발한 공으로 1998년 노벨화학상을 수상한 존 포플 교수(John A. Pople)를 기념해 2007년 처음 제정됐다.

이 상은 매년 아시아-태평양 지역에서 연구업적이 우수한 만 45세 이하의 젊은 이론계산화학자 1인에게 주어진다.

정 교수는 기존의 양자화학 계산 정확도와 속도를 향상시키는 알고리즘들을 개발하고 이를 에너지 소재 개발에 응용해 관련 분야 발전에 기여한 공을 인정받았다. 지금까지 120편 이상의 논문을 전문 학술지에 발표했고 8천 회 이상의 피인용 횟수와 44의 H-지수를 기록 중이다.

정 교수는 “계산화학 분야의 권위 있는 포플 메달을 수상해 큰 영광이다”며 “앞으로는 양자화학과 인공지능 기술을 융합한 계산 방법론의 개발과 이를 에너지 소재 개발에 활용하는 연구로 분야에 기여하고 싶다” 고 말했다.

2018.01.10

조회수 9083

-

서준호 서지호 형제, 과학적 헬스방법 소개한 영문판 MASS EFFECT 출간

“근력운동과 다이어트 성공비결은 인체의 생리학적 메커니즘을 이해하고 과학적 지식을 활용해 개인의 라이프스타일에 맞춰 운동하는 것이다.”

KAIST 학부과정에 재학 중인 형제가 이 같은 내용의 과학적 운동방법을 소개한 책을 영문으로 출간했다.

주인공은 KAIST 학부과정에 재학 중인 서준호(24 ․ 항공우주공학 4학년)와 서지호(21 ․ 기계공학 4학년) 형제.

이들은 지난달 근육강화와 식이요법 등 과학적 운동방법을 설명한 책‘매스 이펙트(MASS EFFECT)’를 출간했다.

사람들은 유전적 요소가 모두 달라 개인마다 최적화된 운동과 영양섭취 방법도 다르다. 하지만 현실에서는 유명인의 다이어트를 무작정 따라하거나 미디어에 소개되는‘완벽한’운동 프로그램에 이끌리곤 한다. 예를 들어 특별한 질병이 없는 정상체중의 사람이 비만인을 위해 고안된 다이어트를 하거나, 일반인이 선수들의 운동 프로그램을 모방하곤 한다.

이러한 문제점을 개선하기 위해 저자들은 해부학, 생리학, 그리고 역학적 원리를 골고루 응용하고 외국의 최신 논문들을 참고해 개인의 라이프스타일 맞는 최신 운동방법을 책에 소개했다.

저자들은 특히 ATC(Active Torque Control)라는 역학적 저항운동법을 소개한다. ATC 테크닉은 몸의 각도와 위치, 그리고 저항의 방향을 전략적으로 변화시켜 관절의 모든 가동범위에서 최대한 근육에 자극을 가할 수 있도록 해주는 운동법이다. 간단해 보이는 기술이지만 중요한 과학적 의미를 담고 있어 운동효과를 극대화 할 수 있는 방법이다.

서준호(형) 씨는 “근육운동과 다이어트는 무조건 힘들게 하는 것으로 효과를 보는게 아니다”며 “이번 책을 통해 다양한 과학적 지식을 접목해야만 운동목표를 효율적으로 달성할 수 있다는 메시지를 전달하고 싶었다”라고 말했다.

이어 “실제로 헬스 초보자들을 대상으로 한 달(1일 1시간) 동안 과학적 헬스방법을 적용한 결과 평균 1~1.5kg의 근육량이 증가하고 2~3kg의 체지방이 감소했음을 확인했다”고 밝혔다.

한편 저자들은 내년 상반기 중에 한국어판도 출간할 계획이다. 끝.

서준호 서지호 형제, 과학적 헬스방법 소개한 영문판 MASS EFFECT 출간

“근력운동과 다이어트 성공비결은 인체의 생리학적 메커니즘을 이해하고 과학적 지식을 활용해 개인의 라이프스타일에 맞춰 운동하는 것이다.”

KAIST 학부과정에 재학 중인 형제가 이 같은 내용의 과학적 운동방법을 소개한 책을 영문으로 출간했다.

주인공은 KAIST 학부과정에 재학 중인 서준호(24 ․ 항공우주공학 4학년)와 서지호(21 ․ 기계공학 4학년) 형제.

이들은 지난달 근육강화와 식이요법 등 과학적 운동방법을 설명한 책‘매스 이펙트(MASS EFFECT)’를 출간했다.

사람들은 유전적 요소가 모두 달라 개인마다 최적화된 운동과 영양섭취 방법도 다르다. 하지만 현실에서는 유명인의 다이어트를 무작정 따라하거나 미디어에 소개되는‘완벽한’운동 프로그램에 이끌리곤 한다. 예를 들어 특별한 질병이 없는 정상체중의 사람이 비만인을 위해 고안된 다이어트를 하거나, 일반인이 선수들의 운동 프로그램을 모방하곤 한다.

이러한 문제점을 개선하기 위해 저자들은 해부학, 생리학, 그리고 역학적 원리를 골고루 응용하고 외국의 최신 논문들을 참고해 개인의 라이프스타일 맞는 최신 운동방법을 책에 소개했다.

저자들은 특히 ATC(Active Torque Control)라는 역학적 저항운동법을 소개한다. ATC 테크닉은 몸의 각도와 위치, 그리고 저항의 방향을 전략적으로 변화시켜 관절의 모든 가동범위에서 최대한 근육에 자극을 가할 수 있도록 해주는 운동법이다. 간단해 보이는 기술이지만 중요한 과학적 의미를 담고 있어 운동효과를 극대화 할 수 있는 방법이다.

서준호(형) 씨는 “근육운동과 다이어트는 무조건 힘들게 하는 것으로 효과를 보는게 아니다”며 “이번 책을 통해 다양한 과학적 지식을 접목해야만 운동목표를 효율적으로 달성할 수 있다는 메시지를 전달하고 싶었다”라고 말했다.

이어 “실제로 헬스 초보자들을 대상으로 한 달(1일 1시간) 동안 과학적 헬스방법을 적용한 결과 평균 1~1.5kg의 근육량이 증가하고 2~3kg의 체지방이 감소했음을 확인했다”고 밝혔다.

한편 저자들은 내년 상반기 중에 한국어판도 출간할 계획이다. 끝.

2015.10.21

조회수 10255

카이캐치(KaiCatch), 악성 동영상 위변조 탐지 기술 개발

우리 대학 전산학부 이흥규 명예교수 연구팀이 KAIST 창업기업인 ㈜디지탈이노텍의 후원으로 악성 위변조에 활용되는 프레임 업 변환, 보간법에 의해 생성된 프레임, 영상내 위변조 영역 등을 탐지하는 동영상 위변조 탐지 기술을 개발했다.

위변조 분야 최상위 저명 논문지인 Forensic Science International 11월호에 논문으로도 발표했다.

CCTV의 대량 보급과 함께 동영상은 수많은 분쟁시 주요 증거물로 사용되고 있다. 그러나 동영상에 대한 편집 도구 기술과 인공지능 기술 발전과 함께 동영상의 편집, 프레임 삭제 및 추가 등의 위변조를 포함하여 프레임 업 변환 이라는 기술을 사용하여 위변조 동영상을 고품질 영상으로 변환함으로써 위변조 동영상을 원본과 유사하게 변환함으로써 위변조 탐지를 더욱 어렵게 하는 악성 변조 기술 등도 등장하고 있다.

이번 연구에서는 동영상내 특정 영역들의 편집 변조를 포함하여 프레임 추가, 삭제, 프레임률 변환 탐지를 포함하여 공간정보와 시간정보를 연속적으로 활용하는 프레임-업 변환을 탐지하기 위해 프레임-업 특징들을 추출하는 4개 유형의 네트워크블럭들과 보팅(voting) 기능을 채택한 프레임-업 탐지 뉴럴 네트워크를 제시하였다.

개발된 기술은 특히 동영상의 극히 작은 영역들의 정보를 사용하여 무결성 여부를 판독하기 때문에 동영상 위변조 탐지를 고속으로 수행할 수 있어 기존 기술들과 비교하여 기술의 유용성과 실용성이 매우 뛰어나다.

이번 연구는 KAIST 윤민석 박사, ㈜네이버웹튠AI의 남승훈 박사 등이 참여하였으며 KAIST에서 위변조를 잡아낸다는 의미인 카이캐치(KaiCatch) 위변조 탐지 소프트웨어 기능을 동영상으로도 크게 확장 했다는 점에서 그 의미가 있다.

개발된 기술은 영상 위변조 분야 최상위 저명 논문지인 Forensic Science International 2022년 11월호(Vol 340)에 ‘Frame-rate Up-conversion Detection based on Convolutional Neural Network for Learning Spatiotemporal Features’ 논문으로 발표 되었다. 본 연구는 한국연구재단 창의도전연구기반지원사업과 KAIST 창업기업인 ㈜디지탈이노텍의 후원으로 수행하였다.

2022.10.20 조회수 4583

카이캐치(KaiCatch), 악성 동영상 위변조 탐지 기술 개발

우리 대학 전산학부 이흥규 명예교수 연구팀이 KAIST 창업기업인 ㈜디지탈이노텍의 후원으로 악성 위변조에 활용되는 프레임 업 변환, 보간법에 의해 생성된 프레임, 영상내 위변조 영역 등을 탐지하는 동영상 위변조 탐지 기술을 개발했다.

위변조 분야 최상위 저명 논문지인 Forensic Science International 11월호에 논문으로도 발표했다.

CCTV의 대량 보급과 함께 동영상은 수많은 분쟁시 주요 증거물로 사용되고 있다. 그러나 동영상에 대한 편집 도구 기술과 인공지능 기술 발전과 함께 동영상의 편집, 프레임 삭제 및 추가 등의 위변조를 포함하여 프레임 업 변환 이라는 기술을 사용하여 위변조 동영상을 고품질 영상으로 변환함으로써 위변조 동영상을 원본과 유사하게 변환함으로써 위변조 탐지를 더욱 어렵게 하는 악성 변조 기술 등도 등장하고 있다.

이번 연구에서는 동영상내 특정 영역들의 편집 변조를 포함하여 프레임 추가, 삭제, 프레임률 변환 탐지를 포함하여 공간정보와 시간정보를 연속적으로 활용하는 프레임-업 변환을 탐지하기 위해 프레임-업 특징들을 추출하는 4개 유형의 네트워크블럭들과 보팅(voting) 기능을 채택한 프레임-업 탐지 뉴럴 네트워크를 제시하였다.

개발된 기술은 특히 동영상의 극히 작은 영역들의 정보를 사용하여 무결성 여부를 판독하기 때문에 동영상 위변조 탐지를 고속으로 수행할 수 있어 기존 기술들과 비교하여 기술의 유용성과 실용성이 매우 뛰어나다.

이번 연구는 KAIST 윤민석 박사, ㈜네이버웹튠AI의 남승훈 박사 등이 참여하였으며 KAIST에서 위변조를 잡아낸다는 의미인 카이캐치(KaiCatch) 위변조 탐지 소프트웨어 기능을 동영상으로도 크게 확장 했다는 점에서 그 의미가 있다.

개발된 기술은 영상 위변조 분야 최상위 저명 논문지인 Forensic Science International 2022년 11월호(Vol 340)에 ‘Frame-rate Up-conversion Detection based on Convolutional Neural Network for Learning Spatiotemporal Features’ 논문으로 발표 되었다. 본 연구는 한국연구재단 창의도전연구기반지원사업과 KAIST 창업기업인 ㈜디지탈이노텍의 후원으로 수행하였다.

2022.10.20 조회수 4583 인공지능 엔진으로 영상 위변조 탐지 기술 개발

우리 연구진이 영상 내 변형 영역을 더욱 정밀하게 탐지하기 위해 영상내 색상 정보와 주파수 정보를 함께 활용하는 인공지능 엔진 기술을 학계 처음으로 개발했다. 이번 개발 기술은 기존 기술보다 정밀도와 정확도를 크게 높여 위변조 탐지 기술의 기술 유용성을 일정 수준 확보할 수 있는 기반을 제공한다는 점에서 그 의미가 크다. KAIST에서 각종 위변조 영상들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어는 이미지, 영상뿐만 아니라 CCTV 비디오 변형 여부도 분석할 수 있다.

우리 대학 전산학부 이흥규 교수 연구팀이 새로운 인공지능 구조와학습 방법론, 그리고 실험실 환경에서는 구하기 힘든 고급 변형 이미지 영상들을 사용해 영상 이미지 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'의 영상 이미지 정밀도와 정확도를 크게 높일 뿐만 아니라 비디오 편집 변형도 탐지할 수 있는 카이캐치 2.1 버전을 개발했다고 13일 밝혔다.

카이캐치 소프트웨어는 `이상(異常) 유형 분석 엔진'과 `이상(異常) 영역 추정 엔진' 두 개의 인공지능 엔진으로 구성된다. `이상 유형 분석 엔진'은 블러링, 노이즈, 크기 변화, 명암 대비 변화, 모핑, 리샘플링 등을 필수 변이로 정의해 이를 탐지하며 `이상 영역 추정 엔진'은 이미지 짜깁기, 잘라 붙이기, 복사 붙이기, 복사 이동 등을 탐지한다. 이번에 새로 개발한 기술은 `이상 영역 추정 엔진'으로 기존 기술에서는 이상 영역 탐지 시 그레이 스케일(회색조)로 이상 유무를 탐지하였으나 분석 신호의 표현력이 낮고 탐지 오류가 많아 위변조 여부 판정에 어려움이 많았다. 이번에 개발된 기술은 색상 정보와 주파수 정보를 함께 활용해 정밀도(precision)와 재현율(recall)이 크게 향상되고 변형 영역을 컬러 스케일로 표현함으로써 해당 영역의 이상 유무뿐만 아니라 위변조 여부도 더욱 명확하게 판별이 가능해졌다.

연구팀은 이번 연구에서 영상 생성 시 발생하는 흔적과 압축 시 발생하는 흔적 신호들을 함께 분석하기 위해 색상 정보와 주파수 정보를 모두 활용하는 접근 방법을 학계 처음으로 제시했다. 또 이러한 방법론을 설계 구현하기 위해 주파수 정보를 하나의 분할 네트워크에서 직접 입력으로 받아들이는 방식의 ‘압축 왜곡신호 탐지 네트워크(Compression Artifact Tracing Network, 이하 CAT-Net)’을 학계 최초로 개발하고 기존 기법들과 비교해 탐지 성능이 크게 뛰어남을 입증했다. 개발한 기술은 기존에 제시된 기법들과 비교할 때 특히 원본과 변형본을 판별하는 평가 척도인 F1 점수, 평균 정밀도(average precision)에서 대단히 뛰어나 실환경 위변조 탐지 능력이 크게 강화됐다.

비디오 편집 변형의 경우도, 프레임 삭제, 추가 등에 의한 편집 변형이 흔히 CCTV 비디오 등에서 발생한다는데 착안해 이러한 비디오 편집 변형을 탐지하는 기능 역시 이번 카이캐치 2.1 버전에 탑재됐다.

이번에 카이캐치 2.1 소프트웨어를 연구 개발한 이흥규 교수는 "영상 이미지 위변조 소프트웨어인 카이캐치를 휴대폰에 탑재되는 안드로이드 앱 형태로 일반에 소개한 2021년 3월 이후 현재까지 카이캐치 앱을 통한 900여 건의 위변조 분석 의뢰와 개별적으로 60건이 넘는 정밀 위변조 분석 의뢰를 받았다. KAIST 발표 논문 수준이나 실험 결과 등을 감안할 때 위변조 분야 최고 기술로 만든 소프트웨어인데, 오탐지율이 높아 실제 탐지 정밀도가 이론치보다 매우 낮았다. 많은 경우 위변조나 변형 여부에 대한 명확한 기술 판정이 불가능했으나 이번에 개발한 카이캐치 2.1 은 CAT-Net이라는 새로운 네트워크 구조와 학습 방법론, 그리고 ‘색상 및 주파수 영역 왜곡 흔적 동시 분석’이라는 첨단 기술을 사용해 정밀도를 높여, 보다 명확한 판별이 가능하도록 개발됐다. 앞으로 영상 위변조 판단 여부가 어려운 경우가 많이 줄어들기를 기대한다”고 말했다.

이 교수는 이어 "비디오는 MP4 파일 포맷이, 그리고 영상 이미지는 JPEG 이미지들이 일반인들이 널리 사용한다는 점에서 해당 포맷을 주 개발 대상으로 삼았다. 영상 이미지의 경우 영상 편집 변형 시 영상에 남겨지는 인위적으로 발생하는 JPEG 압축 미세 신호 탐지에 주안점을 두어, 위변조 여부와 위변조 영역을 잡아내는 것에 집중했다. 비디오의 경우 특정 프레임들을 삭제하거나 삽입하는 경우, 프레임 부분 편집 후 재압축 하는 경우 등을 탐지한다. 최근 CCTV 비디오 편집 여부에 대한 분쟁이 많아 크게 도움을 줄 수 있을 것으로 기대하며 향후에도 지속적으로 연구 개발해 취약점들을 보완해 나갈 계획이다ˮ 고 덧붙였다.

현재 카이캐치 소프트웨어는 안드로이드 기반 휴대폰의 구글 플레이스토어에서 ‘카이캐치’를 검색하여 앱을 다운로드 받아 설치한 후, 영상 이미지들을 카이캐치에 업로드하면 위변조 여부를 간단하게 테스트해 볼 수 있다.

한편 이번 연구는 제1 저자로 참여한 우리 대학 전기및전자공학부 권명준 박사, 그리고 김창익 교수, 남승훈 박사, 유인재 박사 등과 공동으로 수행됐으며, `스프링거 네이처(Springer Nature)'에서 발간하는 컴퓨터 비전 분야 톱 국제저널인 `국제 컴퓨터 비전 저널(International Journal of Computer Vision, IF 7.410)'에 2022년 5월 25일 字 온라인판에 게재됐다. (논문명 : Learning JPEG Compression Artifacts for Image Manipulation Detection and Localization)

이번 연구는 한국연구재단 창의도전연구기반지원사업지원과 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과의 산학협력 연구로 수행됐다.

2022.06.13 조회수 5082

인공지능 엔진으로 영상 위변조 탐지 기술 개발

우리 연구진이 영상 내 변형 영역을 더욱 정밀하게 탐지하기 위해 영상내 색상 정보와 주파수 정보를 함께 활용하는 인공지능 엔진 기술을 학계 처음으로 개발했다. 이번 개발 기술은 기존 기술보다 정밀도와 정확도를 크게 높여 위변조 탐지 기술의 기술 유용성을 일정 수준 확보할 수 있는 기반을 제공한다는 점에서 그 의미가 크다. KAIST에서 각종 위변조 영상들을 잡아낸다는 의미를 지닌 `카이캐치(KaiCatch)' 소프트웨어는 이미지, 영상뿐만 아니라 CCTV 비디오 변형 여부도 분석할 수 있다.

우리 대학 전산학부 이흥규 교수 연구팀이 새로운 인공지능 구조와학습 방법론, 그리고 실험실 환경에서는 구하기 힘든 고급 변형 이미지 영상들을 사용해 영상 이미지 위변조 탐지 소프트웨어인 `카이캐치(KaiCatch)'의 영상 이미지 정밀도와 정확도를 크게 높일 뿐만 아니라 비디오 편집 변형도 탐지할 수 있는 카이캐치 2.1 버전을 개발했다고 13일 밝혔다.

카이캐치 소프트웨어는 `이상(異常) 유형 분석 엔진'과 `이상(異常) 영역 추정 엔진' 두 개의 인공지능 엔진으로 구성된다. `이상 유형 분석 엔진'은 블러링, 노이즈, 크기 변화, 명암 대비 변화, 모핑, 리샘플링 등을 필수 변이로 정의해 이를 탐지하며 `이상 영역 추정 엔진'은 이미지 짜깁기, 잘라 붙이기, 복사 붙이기, 복사 이동 등을 탐지한다. 이번에 새로 개발한 기술은 `이상 영역 추정 엔진'으로 기존 기술에서는 이상 영역 탐지 시 그레이 스케일(회색조)로 이상 유무를 탐지하였으나 분석 신호의 표현력이 낮고 탐지 오류가 많아 위변조 여부 판정에 어려움이 많았다. 이번에 개발된 기술은 색상 정보와 주파수 정보를 함께 활용해 정밀도(precision)와 재현율(recall)이 크게 향상되고 변형 영역을 컬러 스케일로 표현함으로써 해당 영역의 이상 유무뿐만 아니라 위변조 여부도 더욱 명확하게 판별이 가능해졌다.

연구팀은 이번 연구에서 영상 생성 시 발생하는 흔적과 압축 시 발생하는 흔적 신호들을 함께 분석하기 위해 색상 정보와 주파수 정보를 모두 활용하는 접근 방법을 학계 처음으로 제시했다. 또 이러한 방법론을 설계 구현하기 위해 주파수 정보를 하나의 분할 네트워크에서 직접 입력으로 받아들이는 방식의 ‘압축 왜곡신호 탐지 네트워크(Compression Artifact Tracing Network, 이하 CAT-Net)’을 학계 최초로 개발하고 기존 기법들과 비교해 탐지 성능이 크게 뛰어남을 입증했다. 개발한 기술은 기존에 제시된 기법들과 비교할 때 특히 원본과 변형본을 판별하는 평가 척도인 F1 점수, 평균 정밀도(average precision)에서 대단히 뛰어나 실환경 위변조 탐지 능력이 크게 강화됐다.

비디오 편집 변형의 경우도, 프레임 삭제, 추가 등에 의한 편집 변형이 흔히 CCTV 비디오 등에서 발생한다는데 착안해 이러한 비디오 편집 변형을 탐지하는 기능 역시 이번 카이캐치 2.1 버전에 탑재됐다.

이번에 카이캐치 2.1 소프트웨어를 연구 개발한 이흥규 교수는 "영상 이미지 위변조 소프트웨어인 카이캐치를 휴대폰에 탑재되는 안드로이드 앱 형태로 일반에 소개한 2021년 3월 이후 현재까지 카이캐치 앱을 통한 900여 건의 위변조 분석 의뢰와 개별적으로 60건이 넘는 정밀 위변조 분석 의뢰를 받았다. KAIST 발표 논문 수준이나 실험 결과 등을 감안할 때 위변조 분야 최고 기술로 만든 소프트웨어인데, 오탐지율이 높아 실제 탐지 정밀도가 이론치보다 매우 낮았다. 많은 경우 위변조나 변형 여부에 대한 명확한 기술 판정이 불가능했으나 이번에 개발한 카이캐치 2.1 은 CAT-Net이라는 새로운 네트워크 구조와 학습 방법론, 그리고 ‘색상 및 주파수 영역 왜곡 흔적 동시 분석’이라는 첨단 기술을 사용해 정밀도를 높여, 보다 명확한 판별이 가능하도록 개발됐다. 앞으로 영상 위변조 판단 여부가 어려운 경우가 많이 줄어들기를 기대한다”고 말했다.

이 교수는 이어 "비디오는 MP4 파일 포맷이, 그리고 영상 이미지는 JPEG 이미지들이 일반인들이 널리 사용한다는 점에서 해당 포맷을 주 개발 대상으로 삼았다. 영상 이미지의 경우 영상 편집 변형 시 영상에 남겨지는 인위적으로 발생하는 JPEG 압축 미세 신호 탐지에 주안점을 두어, 위변조 여부와 위변조 영역을 잡아내는 것에 집중했다. 비디오의 경우 특정 프레임들을 삭제하거나 삽입하는 경우, 프레임 부분 편집 후 재압축 하는 경우 등을 탐지한다. 최근 CCTV 비디오 편집 여부에 대한 분쟁이 많아 크게 도움을 줄 수 있을 것으로 기대하며 향후에도 지속적으로 연구 개발해 취약점들을 보완해 나갈 계획이다ˮ 고 덧붙였다.

현재 카이캐치 소프트웨어는 안드로이드 기반 휴대폰의 구글 플레이스토어에서 ‘카이캐치’를 검색하여 앱을 다운로드 받아 설치한 후, 영상 이미지들을 카이캐치에 업로드하면 위변조 여부를 간단하게 테스트해 볼 수 있다.

한편 이번 연구는 제1 저자로 참여한 우리 대학 전기및전자공학부 권명준 박사, 그리고 김창익 교수, 남승훈 박사, 유인재 박사 등과 공동으로 수행됐으며, `스프링거 네이처(Springer Nature)'에서 발간하는 컴퓨터 비전 분야 톱 국제저널인 `국제 컴퓨터 비전 저널(International Journal of Computer Vision, IF 7.410)'에 2022년 5월 25일 字 온라인판에 게재됐다. (논문명 : Learning JPEG Compression Artifacts for Image Manipulation Detection and Localization)

이번 연구는 한국연구재단 창의도전연구기반지원사업지원과 KAIST 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과의 산학협력 연구로 수행됐다.

2022.06.13 조회수 5082 사진 위변조 탐지하는 실용 소프트웨어 개발

위조되거나 변조된 사진·영상자료를 손쉽게 탐지해내는 고성능 소프트웨어가 우리 연구진에 의해 개발됐다. 이 기술은 논문 발표 수준에만 머물러 있던 사진과 영상자료의 위·변조 탐지기술을 국내 최초로, 세계에서 두 번째로 실용화 단계로 끌어 올렸다는 점에서 의미가 크다.

우리 대학 전산학부 이흥규 교수 연구팀이 인공신경망을 이용해 디지털 형태의 사진 변형 여부를 광범위하게 탐지하는 실용 소프트웨어 `카이캐치(KAICATCH)'를 개발했다고 3일 밝혔다.

최근 딥페이크(deepfake)를 포함해 각종 위·변조 영상의 등장과 온라인 유통으로 인한 위·변조 탐지기술에 관한 관심이 급속히 증가하고 있다. 그러나 위·변조 여부를 직접 확인할 수 있는 객관적인 분석 도구가 없기 때문에 사실확인 작업이나 정황 판단 등에 의존해 진위를 판단함으로써 주관적 판단 여부의 논란 등 문제가 자주 발생하고 있다.

특히 기존의 디지털사진 포렌식 기술은 개개 변형의 유형에 대응해 개발돼서 변형 유형이 다양하거나, 사전 특정되기 전에는 일정 수준 이상의 높은 신뢰도를 확보하기가 어렵다. 즉, 기존 기술들은 제한된 형식과 알려진 특정 변형에 대해서는 만족할 만한 탐지 성능을 보여주지만, 어떤 변형들이 가해진 것인지 전혀 알 수 없는 임의의 디지털사진을 분석해야 하는 실제 상황에서는 판독의 정확성과 신뢰도가 크게 떨어질 수 밖에 없다.

다양한 변형이 가해진 채 온라인에서 유통되는 사진이나 영상에 대한 변형 여부의 탐지는 극소수 전문가들의 주관적인 판단의 영역에 머물러 왔기 때문에 이런 문제해결을 위해 많은 도전적 연구들이 진행되고 있다.

이흥규 교수 연구팀이 개발한 이 기술은 국내 최초이자 세계 두 번째로 거둔 쾌거이다. 연구팀은 일반인들을 대상으로 2015년 6월부터 `디지털 이미지 위·변조 식별 웹서비스'를 통해 수집한 30여만 장의 실 유통 이미지 데이터와 특징기반·신경망 기반의 포렌식 영상 데이터, 딥페이크와 스테고 분석을 위한 대량의 실험 영상자료를 정밀 분석해 활용한 연구 결과물이다.

이 교수팀은 특정 변형을 탐지하는 개개의 알고리즘들을 모아놓은 기존 기술의 한계를 극복하고, 다양한 변형에 대한 탐지를 유기적으로 통합하는 기술에 주목했다.

이를 위해 잘라 붙이기·복사 붙이기·지우기·이미지 내 물체 크기 변화와 이동·리터칭 등 일상적이면서 자주 발생하는 변형들에서 언제나 발생하는 변이들을 분류, 정리해 필수 변이로 정의하고 이들을 종합 탐지하는 연구를 수행했다. 그 결과 변형의 유형을 특정하지 못하는 상태에서도 변형이 발생했는지 여부를 판단함으로써 탐지 신뢰도를 크게 높였다.

연구팀은 이어 BMP·TIF·TIFF·PNG 등 무압축, 무손실 압축을 포함해 50여 개의 표준 양자화 테이블과 1,000여 개가 넘는 비표준화된 양자화 테이블에 기반한 JPEG 이미지들도 포괄적으로 처리하는 기술을 포함한 실용 소프트웨어를 개발하는 데 성공했다.

이 교수팀이 개발한 `카이캐치'는 전통적인 영상 포렌식 기술, 스테그 분석 기술 등 픽셀 단위의 미세한 변화를 탐지하는 기술들을 응용해, `이상 영역 추정 엔진'과 `이상 유형 분석 엔진' 두 개의 인공지능 엔진으로 구성됐으며 이를 기반으로 결과를 판단하고 사진에 대한 다양한 변형 탐지 기능과 사진의 변형 영역 추정 기능 등을 함께 제공한다.

이흥규 교수는 "다양한 변형 시 공통으로 발생하는 픽셀 수준에서의 변형 탐지와 인공지능 기술을 융합한 영상 포렌식 기술을 카이캐치에 담았는데 이 기술은 특히 임의의 환경에서 주어진 디지털사진의 변형 여부를 판단하는데 탁월한 성능을 보인다ˮ고 말했다.

이 교수는 이어 "향후 각종 편집 도구들의 고급 기능들에 대한 광범위한 탐지 기능을 추가하는 한편 현재 확보한 실험실 수준의 딥페이크 탐지 엔진과 일반 비디오 변형 탐지 엔진들도 실용화 수준으로 발전시켜 카이캐치에 탑재하겠다ˮ 고 덧붙였다.

한편 이번 연구는 우리 대학 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과 산학협력 연구로 수행됐다.

2020.11.04 조회수 22725

사진 위변조 탐지하는 실용 소프트웨어 개발

위조되거나 변조된 사진·영상자료를 손쉽게 탐지해내는 고성능 소프트웨어가 우리 연구진에 의해 개발됐다. 이 기술은 논문 발표 수준에만 머물러 있던 사진과 영상자료의 위·변조 탐지기술을 국내 최초로, 세계에서 두 번째로 실용화 단계로 끌어 올렸다는 점에서 의미가 크다.

우리 대학 전산학부 이흥규 교수 연구팀이 인공신경망을 이용해 디지털 형태의 사진 변형 여부를 광범위하게 탐지하는 실용 소프트웨어 `카이캐치(KAICATCH)'를 개발했다고 3일 밝혔다.

최근 딥페이크(deepfake)를 포함해 각종 위·변조 영상의 등장과 온라인 유통으로 인한 위·변조 탐지기술에 관한 관심이 급속히 증가하고 있다. 그러나 위·변조 여부를 직접 확인할 수 있는 객관적인 분석 도구가 없기 때문에 사실확인 작업이나 정황 판단 등에 의존해 진위를 판단함으로써 주관적 판단 여부의 논란 등 문제가 자주 발생하고 있다.

특히 기존의 디지털사진 포렌식 기술은 개개 변형의 유형에 대응해 개발돼서 변형 유형이 다양하거나, 사전 특정되기 전에는 일정 수준 이상의 높은 신뢰도를 확보하기가 어렵다. 즉, 기존 기술들은 제한된 형식과 알려진 특정 변형에 대해서는 만족할 만한 탐지 성능을 보여주지만, 어떤 변형들이 가해진 것인지 전혀 알 수 없는 임의의 디지털사진을 분석해야 하는 실제 상황에서는 판독의 정확성과 신뢰도가 크게 떨어질 수 밖에 없다.

다양한 변형이 가해진 채 온라인에서 유통되는 사진이나 영상에 대한 변형 여부의 탐지는 극소수 전문가들의 주관적인 판단의 영역에 머물러 왔기 때문에 이런 문제해결을 위해 많은 도전적 연구들이 진행되고 있다.

이흥규 교수 연구팀이 개발한 이 기술은 국내 최초이자 세계 두 번째로 거둔 쾌거이다. 연구팀은 일반인들을 대상으로 2015년 6월부터 `디지털 이미지 위·변조 식별 웹서비스'를 통해 수집한 30여만 장의 실 유통 이미지 데이터와 특징기반·신경망 기반의 포렌식 영상 데이터, 딥페이크와 스테고 분석을 위한 대량의 실험 영상자료를 정밀 분석해 활용한 연구 결과물이다.

이 교수팀은 특정 변형을 탐지하는 개개의 알고리즘들을 모아놓은 기존 기술의 한계를 극복하고, 다양한 변형에 대한 탐지를 유기적으로 통합하는 기술에 주목했다.

이를 위해 잘라 붙이기·복사 붙이기·지우기·이미지 내 물체 크기 변화와 이동·리터칭 등 일상적이면서 자주 발생하는 변형들에서 언제나 발생하는 변이들을 분류, 정리해 필수 변이로 정의하고 이들을 종합 탐지하는 연구를 수행했다. 그 결과 변형의 유형을 특정하지 못하는 상태에서도 변형이 발생했는지 여부를 판단함으로써 탐지 신뢰도를 크게 높였다.

연구팀은 이어 BMP·TIF·TIFF·PNG 등 무압축, 무손실 압축을 포함해 50여 개의 표준 양자화 테이블과 1,000여 개가 넘는 비표준화된 양자화 테이블에 기반한 JPEG 이미지들도 포괄적으로 처리하는 기술을 포함한 실용 소프트웨어를 개발하는 데 성공했다.

이 교수팀이 개발한 `카이캐치'는 전통적인 영상 포렌식 기술, 스테그 분석 기술 등 픽셀 단위의 미세한 변화를 탐지하는 기술들을 응용해, `이상 영역 추정 엔진'과 `이상 유형 분석 엔진' 두 개의 인공지능 엔진으로 구성됐으며 이를 기반으로 결과를 판단하고 사진에 대한 다양한 변형 탐지 기능과 사진의 변형 영역 추정 기능 등을 함께 제공한다.

이흥규 교수는 "다양한 변형 시 공통으로 발생하는 픽셀 수준에서의 변형 탐지와 인공지능 기술을 융합한 영상 포렌식 기술을 카이캐치에 담았는데 이 기술은 특히 임의의 환경에서 주어진 디지털사진의 변형 여부를 판단하는데 탁월한 성능을 보인다ˮ고 말했다.

이 교수는 이어 "향후 각종 편집 도구들의 고급 기능들에 대한 광범위한 탐지 기능을 추가하는 한편 현재 확보한 실험실 수준의 딥페이크 탐지 엔진과 일반 비디오 변형 탐지 엔진들도 실용화 수준으로 발전시켜 카이캐치에 탑재하겠다ˮ 고 덧붙였다.

한편 이번 연구는 우리 대학 창업기업인 ㈜디지탈이노텍(http://www.kaicatch.com/) 과 산학협력 연구로 수행됐다.

2020.11.04 조회수 22725 SSD보다 더 빠른 차세대 저장장치 만드는 기술 개발

데이터(DB)의 초고속·대용량 처리에 적합한 정보저장장치인 기존의 *NVMe 컨트롤러를 차세대 메모리 개발에 적합하도록 초당 입출력 처리 능력 등 각종 기능적 측면에서 성능을 대폭 향상시킨 차세대 NVMe 컨트롤러 관련 기술이 우리 연구진에 의해 세계 최초로 개발됐다. 연구진은 이와 함께 이 기술을 국내·외 대학과 연구소에 무상으로 공개함으로써 관련 연구비용을 대폭 절감할 수 있게 했다.

☞ NVMe(Non Volatile Memory express): 비휘발성 메모리 익스프레스. PCI 익스프레스(PCIe) 인터페이스를 기반으로 한 저장장치를 위한 통신 규격(프로토콜)이다. SATA 인터페이스 대비 최대 6배 이상의 속도를 낼 수 있어 초고속, 대용량 데이터 처리에 적합하다.

전기및전자공학부 정명수 교수 연구팀(컴퓨터 아키텍처 및 메모리 시스템 연구실)이 *SSD의 데이터 병렬 입출력 처리를 순수 하드웨어로 구현한 차세대 NVMe 컨트롤러 'OpenExpress'를 개발하는 데 성공했다고 4일 밝혔다.

☞ SSD(Solid State Drive): 자기디스크를 이용하는 데이터 저장장치인 하드디스크(HDD)와는 달리 반도체를 이용해 데이터를 저장하는 장치로서 빠른 속도로 데이터의 읽기와 쓰기가 가능하다. 발열과 소음도 적으며, 소형화‧경량화할 수 있는 장점이 있으나, 비싼 가격이 단점으로 꼽힌다.

정 교수의 관련 논문(논문명: OpenExpress: Fully Hardware Automated Open Research Framework for Future Fast NVMe Devices)은 지난달 18일 열린 시스템 분야 최우수 학술대회인 'The USENIX Annual Technical Conference (ATC), 2020'에서 발표됐는데 아시아권 단일저자가 작성한 논문이 USENIX ATC 학술대회에 채택된 것은 해당 학술대회가 시작된 1993년 이후 27년 만에 처음이다.

빠른 입출력 장치에 특화된 NVMe 인터페이스 기술은 하드디스크(HDD)용으로 설계된 기존의 SATA(Serial ATA) 규격이 SSD에서 제대로 성능을 발휘하지 못하자 이를 대체하기 위해 개발됐다. NVMe는 SSD 성능을 최대한 활용할 수 있도록 개발된 초고속 데이터 전송규격으로 자리를 잡았으며 현재 다양한 플래시 기반 저장장치에 적용되고 있다. NVMe는 또 학계와 산업계에서 차세대 메모리를 기반으로 한 시스템 장치 구성을 위해 계속 연구되고 있다.

전 세계 ICT 분야의 주요 기업들은 NVMe를 사용하는 데 필요한 하드웨어 NVMe 컨트롤러 관련 지식 재산권(IP) 확보를 위해 막대한 비용을 투자해 독자적인 개발에 나서고 있다. 하지만 해당 IP는 외부에 공개가 되지 않아 대학이나 연구소 등에서 이를 연구목적으로 사용하기에는 어려움이 많다. 미국 실리콘밸리에 있는 소수의 벤처기업이 자체적으로 개발한 IP를 일부 제공하지만 한 달에 약 4천만 원의 이용료를 내야 한다. 또 IP 수정을 위한 단일 사용 소스 코드를 받기 위해서는 복사본 당 약 1억 원을 지급해야 하는 등 막대한 비용지출이 필요하다.

이러한 문제해결을 위해 정명수 교수 연구팀은 자유롭게 수정이 가능한 하드웨어 NVMe 컨트롤러 지식 재산권(IP)인 `OpenExpress'를 개발하고 이를 무상으로 공개했다. 이 공개용 컨트롤러는 수십 개 이상의 하드웨어 기본 IP들과 여러 핵심 NVMe IP 코어로 구성돼 있다. 정 교수팀은 실제 성능평가를 위해 OpenExpress를 이용한 NVMe 하드웨어 컨트롤러를 프로토타입(시제품)으로 제작하고, OpenExpress에서 제공되는 모든 로직은 높은 주파수에서 동작하도록 설계했다.

'OpenExpress'를 이용해 개발한 FPGA 스토리지 카드 시제품은 최대 7GB/s의 대역폭을 지원한다. 따라서 초고속 차세대 메모리 등의 연구에 적합하며, 다양한 스토리지 서버 작업 부하를 비교 테스트에서도 인텔의 새로운 고성능 저장장치인 옵테인 SSD(Optane SSD)보다 76% 높은 대역폭과 68% 낮은 입출력 지연시간을 보였다. 사용자의 필요에 따라 실리콘 장치 합성을 하게 되면 훨씬 더 높은 성능을 도출할 수 있을 것으로 예상된다.

정 교수팀이 개발한 이 컨트롤러는 비영리를 목적으로 하는 대학 및 연구소들이라면 `OpenExpress' 공개 소스 규약 내에서 자유로운 사용과 함께 수정사용도 가능해서 차세대 메모리를 수용하는 NVMe의 컨트롤러와 소프트웨어 스택에 관한 연구에 적합하다.

정명수 교수는 "이번 연구성과를 공개했기 때문에 기존 SSD 기술을 이끄는 몇몇 세계 최고 기업들만이 갖고 있던 컨트롤러를 대학과 연구소에서도 이젠 무상 사용이 가능하다ˮ면서 "초고속 차세대 메모리 등 저장장치 시스템의 연구를 위한 초석을 다졌다는 점에서 의미가 있다ˮ고 강조했다.

한편 이번 연구는 차세대 메모리 개발 및 공급업체인 '멤레이(MemRay)'의 지원을 받아 진행됐으며 해당 연구에 대한 자세한 내용은 웹사이트(http://camelab.org)에서 확인할 수 있다.

2020.08.04 조회수 22992

SSD보다 더 빠른 차세대 저장장치 만드는 기술 개발

데이터(DB)의 초고속·대용량 처리에 적합한 정보저장장치인 기존의 *NVMe 컨트롤러를 차세대 메모리 개발에 적합하도록 초당 입출력 처리 능력 등 각종 기능적 측면에서 성능을 대폭 향상시킨 차세대 NVMe 컨트롤러 관련 기술이 우리 연구진에 의해 세계 최초로 개발됐다. 연구진은 이와 함께 이 기술을 국내·외 대학과 연구소에 무상으로 공개함으로써 관련 연구비용을 대폭 절감할 수 있게 했다.

☞ NVMe(Non Volatile Memory express): 비휘발성 메모리 익스프레스. PCI 익스프레스(PCIe) 인터페이스를 기반으로 한 저장장치를 위한 통신 규격(프로토콜)이다. SATA 인터페이스 대비 최대 6배 이상의 속도를 낼 수 있어 초고속, 대용량 데이터 처리에 적합하다.

전기및전자공학부 정명수 교수 연구팀(컴퓨터 아키텍처 및 메모리 시스템 연구실)이 *SSD의 데이터 병렬 입출력 처리를 순수 하드웨어로 구현한 차세대 NVMe 컨트롤러 'OpenExpress'를 개발하는 데 성공했다고 4일 밝혔다.

☞ SSD(Solid State Drive): 자기디스크를 이용하는 데이터 저장장치인 하드디스크(HDD)와는 달리 반도체를 이용해 데이터를 저장하는 장치로서 빠른 속도로 데이터의 읽기와 쓰기가 가능하다. 발열과 소음도 적으며, 소형화‧경량화할 수 있는 장점이 있으나, 비싼 가격이 단점으로 꼽힌다.

정 교수의 관련 논문(논문명: OpenExpress: Fully Hardware Automated Open Research Framework for Future Fast NVMe Devices)은 지난달 18일 열린 시스템 분야 최우수 학술대회인 'The USENIX Annual Technical Conference (ATC), 2020'에서 발표됐는데 아시아권 단일저자가 작성한 논문이 USENIX ATC 학술대회에 채택된 것은 해당 학술대회가 시작된 1993년 이후 27년 만에 처음이다.

빠른 입출력 장치에 특화된 NVMe 인터페이스 기술은 하드디스크(HDD)용으로 설계된 기존의 SATA(Serial ATA) 규격이 SSD에서 제대로 성능을 발휘하지 못하자 이를 대체하기 위해 개발됐다. NVMe는 SSD 성능을 최대한 활용할 수 있도록 개발된 초고속 데이터 전송규격으로 자리를 잡았으며 현재 다양한 플래시 기반 저장장치에 적용되고 있다. NVMe는 또 학계와 산업계에서 차세대 메모리를 기반으로 한 시스템 장치 구성을 위해 계속 연구되고 있다.

전 세계 ICT 분야의 주요 기업들은 NVMe를 사용하는 데 필요한 하드웨어 NVMe 컨트롤러 관련 지식 재산권(IP) 확보를 위해 막대한 비용을 투자해 독자적인 개발에 나서고 있다. 하지만 해당 IP는 외부에 공개가 되지 않아 대학이나 연구소 등에서 이를 연구목적으로 사용하기에는 어려움이 많다. 미국 실리콘밸리에 있는 소수의 벤처기업이 자체적으로 개발한 IP를 일부 제공하지만 한 달에 약 4천만 원의 이용료를 내야 한다. 또 IP 수정을 위한 단일 사용 소스 코드를 받기 위해서는 복사본 당 약 1억 원을 지급해야 하는 등 막대한 비용지출이 필요하다.

이러한 문제해결을 위해 정명수 교수 연구팀은 자유롭게 수정이 가능한 하드웨어 NVMe 컨트롤러 지식 재산권(IP)인 `OpenExpress'를 개발하고 이를 무상으로 공개했다. 이 공개용 컨트롤러는 수십 개 이상의 하드웨어 기본 IP들과 여러 핵심 NVMe IP 코어로 구성돼 있다. 정 교수팀은 실제 성능평가를 위해 OpenExpress를 이용한 NVMe 하드웨어 컨트롤러를 프로토타입(시제품)으로 제작하고, OpenExpress에서 제공되는 모든 로직은 높은 주파수에서 동작하도록 설계했다.

'OpenExpress'를 이용해 개발한 FPGA 스토리지 카드 시제품은 최대 7GB/s의 대역폭을 지원한다. 따라서 초고속 차세대 메모리 등의 연구에 적합하며, 다양한 스토리지 서버 작업 부하를 비교 테스트에서도 인텔의 새로운 고성능 저장장치인 옵테인 SSD(Optane SSD)보다 76% 높은 대역폭과 68% 낮은 입출력 지연시간을 보였다. 사용자의 필요에 따라 실리콘 장치 합성을 하게 되면 훨씬 더 높은 성능을 도출할 수 있을 것으로 예상된다.

정 교수팀이 개발한 이 컨트롤러는 비영리를 목적으로 하는 대학 및 연구소들이라면 `OpenExpress' 공개 소스 규약 내에서 자유로운 사용과 함께 수정사용도 가능해서 차세대 메모리를 수용하는 NVMe의 컨트롤러와 소프트웨어 스택에 관한 연구에 적합하다.

정명수 교수는 "이번 연구성과를 공개했기 때문에 기존 SSD 기술을 이끄는 몇몇 세계 최고 기업들만이 갖고 있던 컨트롤러를 대학과 연구소에서도 이젠 무상 사용이 가능하다ˮ면서 "초고속 차세대 메모리 등 저장장치 시스템의 연구를 위한 초석을 다졌다는 점에서 의미가 있다ˮ고 강조했다.

한편 이번 연구는 차세대 메모리 개발 및 공급업체인 '멤레이(MemRay)'의 지원을 받아 진행됐으며 해당 연구에 대한 자세한 내용은 웹사이트(http://camelab.org)에서 확인할 수 있다.

2020.08.04 조회수 22992 정유성 교수, 아태이론및계산화학회 포플 메달 수상

〈 정 유 성 교수 〉

우리 대학 EEWS대학원 정유성 교수가 아태이론 및 계산화학회(APATCC)가 수여하는 2018년도 ‘포플 메달(Pople Medal)’을 수상했다.

포플 메달은 양자역학 이론을 분자화학에 적용하기 위한 계산방법론을 개발한 공으로 1998년 노벨화학상을 수상한 존 포플 교수(John A. Pople)를 기념해 2007년 처음 제정됐다.

이 상은 매년 아시아-태평양 지역에서 연구업적이 우수한 만 45세 이하의 젊은 이론계산화학자 1인에게 주어진다.

정 교수는 기존의 양자화학 계산 정확도와 속도를 향상시키는 알고리즘들을 개발하고 이를 에너지 소재 개발에 응용해 관련 분야 발전에 기여한 공을 인정받았다. 지금까지 120편 이상의 논문을 전문 학술지에 발표했고 8천 회 이상의 피인용 횟수와 44의 H-지수를 기록 중이다.

정 교수는 “계산화학 분야의 권위 있는 포플 메달을 수상해 큰 영광이다”며 “앞으로는 양자화학과 인공지능 기술을 융합한 계산 방법론의 개발과 이를 에너지 소재 개발에 활용하는 연구로 분야에 기여하고 싶다” 고 말했다.

2018.01.10 조회수 9083

정유성 교수, 아태이론및계산화학회 포플 메달 수상

〈 정 유 성 교수 〉

우리 대학 EEWS대학원 정유성 교수가 아태이론 및 계산화학회(APATCC)가 수여하는 2018년도 ‘포플 메달(Pople Medal)’을 수상했다.

포플 메달은 양자역학 이론을 분자화학에 적용하기 위한 계산방법론을 개발한 공으로 1998년 노벨화학상을 수상한 존 포플 교수(John A. Pople)를 기념해 2007년 처음 제정됐다.

이 상은 매년 아시아-태평양 지역에서 연구업적이 우수한 만 45세 이하의 젊은 이론계산화학자 1인에게 주어진다.

정 교수는 기존의 양자화학 계산 정확도와 속도를 향상시키는 알고리즘들을 개발하고 이를 에너지 소재 개발에 응용해 관련 분야 발전에 기여한 공을 인정받았다. 지금까지 120편 이상의 논문을 전문 학술지에 발표했고 8천 회 이상의 피인용 횟수와 44의 H-지수를 기록 중이다.

정 교수는 “계산화학 분야의 권위 있는 포플 메달을 수상해 큰 영광이다”며 “앞으로는 양자화학과 인공지능 기술을 융합한 계산 방법론의 개발과 이를 에너지 소재 개발에 활용하는 연구로 분야에 기여하고 싶다” 고 말했다.

2018.01.10 조회수 9083 서준호 서지호 형제, 과학적 헬스방법 소개한 영문판 MASS EFFECT 출간

“근력운동과 다이어트 성공비결은 인체의 생리학적 메커니즘을 이해하고 과학적 지식을 활용해 개인의 라이프스타일에 맞춰 운동하는 것이다.”

KAIST 학부과정에 재학 중인 형제가 이 같은 내용의 과학적 운동방법을 소개한 책을 영문으로 출간했다.

주인공은 KAIST 학부과정에 재학 중인 서준호(24 ․ 항공우주공학 4학년)와 서지호(21 ․ 기계공학 4학년) 형제.

이들은 지난달 근육강화와 식이요법 등 과학적 운동방법을 설명한 책‘매스 이펙트(MASS EFFECT)’를 출간했다.

사람들은 유전적 요소가 모두 달라 개인마다 최적화된 운동과 영양섭취 방법도 다르다. 하지만 현실에서는 유명인의 다이어트를 무작정 따라하거나 미디어에 소개되는‘완벽한’운동 프로그램에 이끌리곤 한다. 예를 들어 특별한 질병이 없는 정상체중의 사람이 비만인을 위해 고안된 다이어트를 하거나, 일반인이 선수들의 운동 프로그램을 모방하곤 한다.

이러한 문제점을 개선하기 위해 저자들은 해부학, 생리학, 그리고 역학적 원리를 골고루 응용하고 외국의 최신 논문들을 참고해 개인의 라이프스타일 맞는 최신 운동방법을 책에 소개했다.

저자들은 특히 ATC(Active Torque Control)라는 역학적 저항운동법을 소개한다. ATC 테크닉은 몸의 각도와 위치, 그리고 저항의 방향을 전략적으로 변화시켜 관절의 모든 가동범위에서 최대한 근육에 자극을 가할 수 있도록 해주는 운동법이다. 간단해 보이는 기술이지만 중요한 과학적 의미를 담고 있어 운동효과를 극대화 할 수 있는 방법이다.

서준호(형) 씨는 “근육운동과 다이어트는 무조건 힘들게 하는 것으로 효과를 보는게 아니다”며 “이번 책을 통해 다양한 과학적 지식을 접목해야만 운동목표를 효율적으로 달성할 수 있다는 메시지를 전달하고 싶었다”라고 말했다.

이어 “실제로 헬스 초보자들을 대상으로 한 달(1일 1시간) 동안 과학적 헬스방법을 적용한 결과 평균 1~1.5kg의 근육량이 증가하고 2~3kg의 체지방이 감소했음을 확인했다”고 밝혔다.

한편 저자들은 내년 상반기 중에 한국어판도 출간할 계획이다. 끝.

2015.10.21 조회수 10255

서준호 서지호 형제, 과학적 헬스방법 소개한 영문판 MASS EFFECT 출간

“근력운동과 다이어트 성공비결은 인체의 생리학적 메커니즘을 이해하고 과학적 지식을 활용해 개인의 라이프스타일에 맞춰 운동하는 것이다.”

KAIST 학부과정에 재학 중인 형제가 이 같은 내용의 과학적 운동방법을 소개한 책을 영문으로 출간했다.

주인공은 KAIST 학부과정에 재학 중인 서준호(24 ․ 항공우주공학 4학년)와 서지호(21 ․ 기계공학 4학년) 형제.

이들은 지난달 근육강화와 식이요법 등 과학적 운동방법을 설명한 책‘매스 이펙트(MASS EFFECT)’를 출간했다.

사람들은 유전적 요소가 모두 달라 개인마다 최적화된 운동과 영양섭취 방법도 다르다. 하지만 현실에서는 유명인의 다이어트를 무작정 따라하거나 미디어에 소개되는‘완벽한’운동 프로그램에 이끌리곤 한다. 예를 들어 특별한 질병이 없는 정상체중의 사람이 비만인을 위해 고안된 다이어트를 하거나, 일반인이 선수들의 운동 프로그램을 모방하곤 한다.

이러한 문제점을 개선하기 위해 저자들은 해부학, 생리학, 그리고 역학적 원리를 골고루 응용하고 외국의 최신 논문들을 참고해 개인의 라이프스타일 맞는 최신 운동방법을 책에 소개했다.

저자들은 특히 ATC(Active Torque Control)라는 역학적 저항운동법을 소개한다. ATC 테크닉은 몸의 각도와 위치, 그리고 저항의 방향을 전략적으로 변화시켜 관절의 모든 가동범위에서 최대한 근육에 자극을 가할 수 있도록 해주는 운동법이다. 간단해 보이는 기술이지만 중요한 과학적 의미를 담고 있어 운동효과를 극대화 할 수 있는 방법이다.

서준호(형) 씨는 “근육운동과 다이어트는 무조건 힘들게 하는 것으로 효과를 보는게 아니다”며 “이번 책을 통해 다양한 과학적 지식을 접목해야만 운동목표를 효율적으로 달성할 수 있다는 메시지를 전달하고 싶었다”라고 말했다.

이어 “실제로 헬스 초보자들을 대상으로 한 달(1일 1시간) 동안 과학적 헬스방법을 적용한 결과 평균 1~1.5kg의 근육량이 증가하고 2~3kg의 체지방이 감소했음을 확인했다”고 밝혔다.

한편 저자들은 내년 상반기 중에 한국어판도 출간할 계획이다. 끝.

2015.10.21 조회수 10255